機械学習における重要な問題は、モデルの予測の理由を理解することです。既存のアルゴリズムモデルを通じてアルゴリズムの機能を知ることはできますが、なぜそのモデルがそのような予測結果を生み出すのかを説明することは困難です。ただし、解釈アルゴリズムは、関心のある結果や意味のある変動効果を特定するのに役立ちます。

説明アルゴリズムを使用すると、結果を予測するだけでなく、モデル内の変数間の関係を理解できるようになります。したがって、複数のアルゴリズムを使用することで、特定のモデルの独立変数と従属変数の関係をより深く理解できるようになります。

説明アルゴリズム

線形/ロジスティック回帰は、1 つ以上の独立変数間の線形関係を持つ従属変数をモデル化するために使用される統計手法です。 。この方法は、係数の合計をテストすることで変数間の関係を理解するのに役立ちます。

デシジョン ツリーは、ツリー状のモデルを作成して意思決定を行う機械学習アルゴリズムです。分岐の分割ルールを分析することで、変数間の関係を理解するのに役立ちます。

主成分分析 (PCA): 可能な限り多くの分散を保持しながら、データを低次元空間に投影する次元削減手法。 PCA を使用すると、データを単純化したり、特徴の重要性を判断したりできます。

LIME (ローカル解釈可能なモデルに依存しない説明): 線形回帰やデシジョン ツリーなどの手法を使用してより単純なモデルを構築し、予測に基づいてモデルを近似することで、機械学習モデルの予測を説明します。 。

SHAPLEY (Shapley Additive の説明): 「限界寄与」の概念に基づく方法を使用して、予測に対する各特徴の寄与を計算することで、機械学習モデルの予測を説明します。場合によっては、SHAP よりも正確です。

SHAP (Shapley 近似): 予測における各特徴の重要性を推定することによって機械学習モデルを説明する予測手法。 SHAP は「ジョイント ゲーム」と呼ばれる方法を使用して Shapley 値を近似し、一般に SHAPLEY よりも高速です。

以上が機械学習における解釈アルゴリズムの定義と応用の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

1つのプロンプトは、すべての主要なLLMのセーフガードをバイパスできますApr 25, 2025 am 11:16 AM

1つのプロンプトは、すべての主要なLLMのセーフガードをバイパスできますApr 25, 2025 am 11:16 AMHiddenLayerの画期的な研究は、主要な大規模な言語モデル(LLMS)における重大な脆弱性を明らかにしています。 彼らの発見は、ほぼすべての主要なLLMSを回避できる「政策の人形劇」と呼ばれる普遍的なバイパス技術を明らかにしています

5つの間違いほとんどの企業が今年持続可能性を備えていますApr 25, 2025 am 11:15 AM

5つの間違いほとんどの企業が今年持続可能性を備えていますApr 25, 2025 am 11:15 AM環境責任と廃棄物の削減の推進は、企業の運営方法を根本的に変えています。 この変革は、製品開発、製造プロセス、顧客関係、パートナーの選択、および新しいものの採用に影響します

H20チップバンジョルツチャイナ企業ですが、彼らはインパクトのために長い間支えられてきましたApr 25, 2025 am 11:12 AM

H20チップバンジョルツチャイナ企業ですが、彼らはインパクトのために長い間支えられてきましたApr 25, 2025 am 11:12 AM高度なAIハードウェアに関する最近の制限は、AI優位のためのエスカレートする地政学的競争を強調し、中国の外国半導体技術への依存を明らかにしています。 2024年、中国は3,850億ドル相当の半導体を大量に輸入しました

OpenaiがChromeを購入すると、AIはブラウザ戦争を支配する場合がありますApr 25, 2025 am 11:11 AM

OpenaiがChromeを購入すると、AIはブラウザ戦争を支配する場合がありますApr 25, 2025 am 11:11 AMGoogleからのChromeの強制的な売却の可能性は、ハイテク業界での激しい議論に火をつけました。 Openaiが65%の世界市場シェアを誇る大手ブラウザを取得する見込みは、THの将来について重要な疑問を提起します

AIが小売メディアの成長する痛みをどのように解決できるかApr 25, 2025 am 11:10 AM

AIが小売メディアの成長する痛みをどのように解決できるかApr 25, 2025 am 11:10 AM全体的な広告の成長を上回っているにもかかわらず、小売メディアの成長は減速しています。 この成熟段階は、生態系の断片化、コストの上昇、測定の問題、統合の複雑さなど、課題を提示します。 ただし、人工知能

「aiは私たちであり、それは私たち以上のものです」Apr 25, 2025 am 11:09 AM

「aiは私たちであり、それは私たち以上のものです」Apr 25, 2025 am 11:09 AM古いラジオは、ちらつきと不活性なスクリーンのコレクションの中で静的なパチパチと鳴ります。簡単に不安定になっているこの不安定な電子機器の山は、没入型展示会の6つのインスタレーションの1つである「e-waste land」の核心を形成しています。

Google Cloudは、次の2025年にインフラストラクチャについてより深刻になりますApr 25, 2025 am 11:08 AM

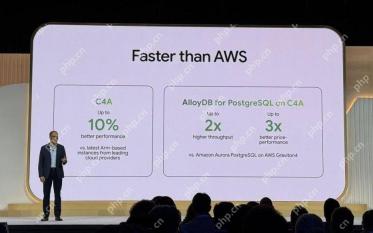

Google Cloudは、次の2025年にインフラストラクチャについてより深刻になりますApr 25, 2025 am 11:08 AMGoogle Cloudの次の2025年:インフラストラクチャ、接続性、およびAIに焦点を当てています Google Cloudの次の2025年の会議では、多くの進歩を紹介しました。 特定の発表の詳細な分析については、私の記事を参照してください

Baby Ai Meme、Arcanaの550万ドルのAI映画パイプライン、IRの秘密の支援者が明らかにした話Apr 25, 2025 am 11:07 AM

Baby Ai Meme、Arcanaの550万ドルのAI映画パイプライン、IRの秘密の支援者が明らかにした話Apr 25, 2025 am 11:07 AM今週はAIとXR:AIを搭載した創造性の波が、音楽の世代から映画制作まで、メディアとエンターテイメントを席巻しています。 見出しに飛び込みましょう。 AIに生成されたコンテンツの影響力の高まり:テクノロジーコンサルタントのShelly Palme

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター

MinGW - Minimalist GNU for Windows

このプロジェクトは osdn.net/projects/mingw に移行中です。引き続きそこでフォローしていただけます。 MinGW: GNU Compiler Collection (GCC) のネイティブ Windows ポートであり、ネイティブ Windows アプリケーションを構築するための自由に配布可能なインポート ライブラリとヘッダー ファイルであり、C99 機能をサポートする MSVC ランタイムの拡張機能が含まれています。すべての MinGW ソフトウェアは 64 ビット Windows プラットフォームで実行できます。

EditPlus 中国語クラック版

サイズが小さく、構文の強調表示、コード プロンプト機能はサポートされていません

SAP NetWeaver Server Adapter for Eclipse

Eclipse を SAP NetWeaver アプリケーション サーバーと統合します。

Dreamweaver Mac版

ビジュアル Web 開発ツール

ホットトピック

7720

7720 15

15 1642

1642 14

14 1396

1396 52

52 1289

1289 25

25 1233

1233 29

29