一般的に使用される AI 活性化関数の分析: Sigmoid、Tanh、ReLU、Softmax のディープラーニングの実践

アクティベーション関数は深層学習において重要な役割を果たしており、ニューラル ネットワークに非線形特性を導入することで、ネットワークが複雑な入出力関係をより適切に学習し、シミュレートできるようになります。活性化関数の正しい選択と使用は、ニューラル ネットワークのパフォーマンスとトレーニング効果に重要な影響を与えます。

この記事では、一般的に使用される 4 つの活性化関数、Sigmoid、Tanh、ReLU、Softmax について、導入から使用方法まで紹介します。シナリオ、利点、欠点、最適化ソリューションについて 5 つの側面で説明し、アクティベーション関数を包括的に理解できるようにします。

シグモイド関数の公式

シグモイド関数の公式

正規化されていない予測値を確率分布に変換するためによく使用されます。

SIgmoid 関数のイメージ

SIgmoid 関数のイメージ

- 出力は 0 から 1 の間に制限されており、確率分布。

- 回帰問題またはバイナリ分類問題を処理します。

- 入力の任意の範囲を 0 ~ 1 の間の にマッピングできるため、確率を表現するのに適しています。

- 範囲が制限されているため、計算がより簡単かつ高速になります。

最適化計画:

- ReLU などの他のアクティベーション関数を使用する: ReLU またはそのバリアント (Leaky ReLU および Parametric ReLU) などの他のアクティベーション関数を組み合わせて使用します。

- 深層学習フレームワークで最適化手法を使用する: TensorFlow や PyTorch などの深層学習フレームワークによって提供される最適化手法を使用します。勾配クリッピング、学習率調整など。

Tanh 関数の公式

Tanh 関数の公式

anh 関数はシグモイドです任意の実数を -1 から 1 までにマッピングする関数の双曲線バージョン。

Tanh 関数のイメージ

Tanh 関数のイメージ

最適化計画:

- 他の活性化関数を使用してくださいReLU など:ReLU やそのバリアント (Leaky ReLU および Parametric ReLU) など、他のアクティベーション関数と組み合わせて使用します。

- 残留接続の使用: 残留接続は、ResNet (残留ネットワーク) などの効果的な最適化戦略です。

ReLU 関数

ReLU 関数の式 はじめに: ReLU 活性化関数は単純な非線形関数であり、その数式は f(x) = max(0,

はじめに: ReLU 活性化関数は単純な非線形関数であり、その数式は f(x) = max(0,

ReLU 関数のイメージ アプリケーション シナリオ: ReLU 活性化関数は、深層学習モデル、特に畳み込みニューラル ネットワーク (CNN) 中間で広く使用されています。 。その主な利点は、計算が簡単で、勾配消失問題を効果的に軽減できること、および

アプリケーション シナリオ: ReLU 活性化関数は、深層学習モデル、特に畳み込みニューラル ネットワーク (CNN) 中間で広く使用されています。 。その主な利点は、計算が簡単で、勾配消失問題を効果的に軽減できること、および

次の利点があります: 欠点: 最適化計画: はじめに: Softmax は一般的に使用される活性化関数であり、主に多分類問題で使用され、入力ニューロンを確率分布に変換できます。主な特徴は、出力値の範囲が 0 ~ 1 であり、すべての出力値の合計が 1 になることです。 アプリケーション シナリオ: 次のような利点があります: 複数分類の問題では、各カテゴリに相対確率値を提供して、その後の意思決定と分類を容易にすることができます。 欠点: グラデーションの消失またはグラデーションの爆発の問題が発生します。 最適化スキーム:

4. ソフトマックス関数

ソフトマックス関数の公式

ソフトマックス関数の公式 ソフトマックス計算プロセス

ソフトマックス計算プロセス

以上が一般的に使用される AI 活性化関数の分析: Sigmoid、Tanh、ReLU、Softmax のディープラーニングの実践の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

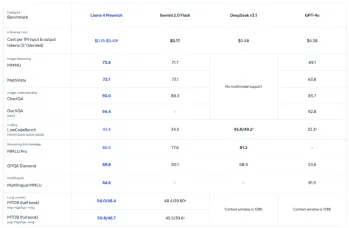

オープンAIの最新のGPT 4.1ファミリ - 分析VidhyaApr 26, 2025 am 10:19 AM

オープンAIの最新のGPT 4.1ファミリ - 分析VidhyaApr 26, 2025 am 10:19 AMOpenaiは、強力なGPT-4.1シリーズを発表しました。実際のアプリケーション向けに設計された3つの高度な言語モデルのファミリー。 この大幅な飛躍は、より速い応答時間、理解の強化、およびTと比較した大幅に削減されたコストを提供します

LLMベンチマークとは何ですか?Apr 26, 2025 am 10:13 AM

LLMベンチマークとは何ですか?Apr 26, 2025 am 10:13 AM大規模な言語モデル(LLM)は最新のAIアプリケーションに不可欠になっていますが、その機能を評価することは依然として課題です。従来のベンチマークは長い間LLMパフォーマンスを測定するための標準でしたが、RAでは

7タスクGemini 2.5 Proは他のどのチャットボットよりも優れています!Apr 26, 2025 am 10:00 AM

7タスクGemini 2.5 Proは他のどのチャットボットよりも優れています!Apr 26, 2025 am 10:00 AMAIチャットボットはより賢くなり、その日までにますます洗練されています。 Google Deepmindの最新の実験モデルであるGemini 2.5 Proは、AIチャットボット機能における大きな前進を表しています。 Contexが改善されています

6 O3プロンプト今日試してみる必要があります-AnalyticsVidhyaApr 26, 2025 am 09:56 AM

6 O3プロンプト今日試してみる必要があります-AnalyticsVidhyaApr 26, 2025 am 09:56 AMOpenaiのO3:推論とマルチモーダル機能における前進 OpenaiのO3モデルは、AI推論能力の大きな進歩を表しています。複雑な問題解決、分析タスク、および自律的なツールの使用のために設計されたO3

Canva Codeを試しましたが、ここでそれがどのように進んだかを試しました。Apr 26, 2025 am 09:53 AM

Canva Codeを試しましたが、ここでそれがどのように進んだかを試しました。Apr 26, 2025 am 09:53 AMCanva Create2025:Canva CodeとAIを使用してデザインを革新する CanvaのCreate 2025イベントは、AIを搭載したツール、エンタープライズソリューション、特に開発者ツールにプラットフォームを拡大し、重要な進歩を発表しました。 キーアップデートにはentが含まれています

タスク用のAIチャットボット:AIエージェントがどのように静かにアプリを交換しているかApr 26, 2025 am 09:50 AM

タスク用のAIチャットボット:AIエージェントがどのように静かにアプリを交換しているかApr 26, 2025 am 09:50 AM簡単なタスクのためのApp-Hoppingの時代は終わりです。 1回の会話で休暇を予約したり、請求書を自動的に交渉したりすることを想像してください。 これはAIエージェントの力です - あなたのニーズを予測する新しいデジタルアシスタント、JUSではなく

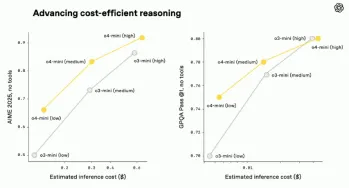

O3およびO4-MINI:Openaiの最も高度な推論モデルApr 26, 2025 am 09:46 AM

O3およびO4-MINI:Openaiの最も高度な推論モデルApr 26, 2025 am 09:46 AMOpenaiの画期的なO3およびO4-MINI推論モデル:AGIへの巨大な飛躍 GPT 4.1ファミリーの打ち上げのかかとで、Openaiは、AIであるO3およびO4-MINI推論モデルでの最新の進歩を発表しました。 これらは単なるAIモデルではありません。

Llama 4とAutogenでAIエージェントを構築しますApr 26, 2025 am 09:44 AM

Llama 4とAutogenでAIエージェントを構築しますApr 26, 2025 am 09:44 AMインテリジェントAIエージェントを構築するためにLlama 4とオートゲンの力を活用する MetaのLlama 4ファミリのモデルはAIの景観を変換しており、インテリジェントなシステム開発に革命をもたらすためにネイティブのマルチモーダル機能を提供しています。 この記事の探検

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

SecLists

SecLists は、セキュリティ テスターの究極の相棒です。これは、セキュリティ評価中に頻繁に使用されるさまざまな種類のリストを 1 か所にまとめたものです。 SecLists は、セキュリティ テスターが必要とする可能性のあるすべてのリストを便利に提供することで、セキュリティ テストをより効率的かつ生産的にするのに役立ちます。リストの種類には、ユーザー名、パスワード、URL、ファジング ペイロード、機密データ パターン、Web シェルなどが含まれます。テスターはこのリポジトリを新しいテスト マシンにプルするだけで、必要なあらゆる種類のリストにアクセスできるようになります。

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター

MantisBT

Mantis は、製品の欠陥追跡を支援するために設計された、導入が簡単な Web ベースの欠陥追跡ツールです。 PHP、MySQL、Web サーバーが必要です。デモおよびホスティング サービスをチェックしてください。

メモ帳++7.3.1

使いやすく無料のコードエディター

ホットトピック

7723

7723 15

15 1643

1643 14

14 1396

1396 52

52 1290

1290 25

25 1233

1233 29

29