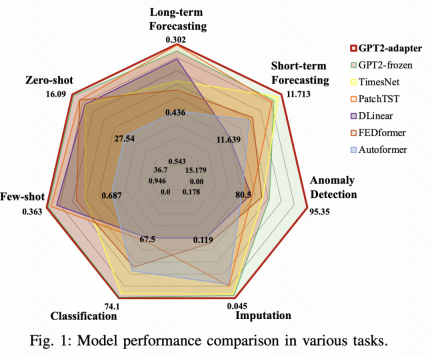

今日は、大規模モデルの時系列予測に関する最新の研究についてお話したいと思います。Alibaba Damo Academy から、アダプターに基づく一般的な時系列分析フレームワークが提案されており、長期予測、短期予測に使用できます。 -期間予測、およびゼロショット フューショット、異常検出、時系列分類、時系列充填を含む 7 つの時系列タスクで顕著な結果が達成されました。

論文タイトル: One size fits all: 事前トレーニング済み言語モデルと特別に設計されたアダプターを使用したユニバーサル時系列分析

ダウンロード可能なリンク: https:// arxiv .org/pdf/2311.14782v1.pdf

1. 背景

時系列予測の分野では、大規模なモデルを構築する際の困難の 1 つは、次のような十分なトレーニング データが不足していることです。 NLP または CV フィールド。この記事では、NLP または CV の分野でトレーニングされた大規模モデルに基づいて時系列に適応させ、アダプター テクノロジーと組み合わせて、さまざまな時系列の問題を解決するソリューションを提案します。

アダプターは広く使用されています。特に最近の大規模モデルのアプリケーションでは、大規模モデルの軽量な微調整を行うためにアダプターがよく使用されます。アダプターは軽量のネットワークであり、大規模モデルの一部のモジュールにアダプターを挿入し、大規模モデルのパラメーターを固定し、アダプターのパラメーターのみを更新することで、軽量の大規模モデルの微調整を実現できます。

写真

写真

次に、Alibaba Damo Academy のこの取り組みで、アダプターを使用して事前トレーニング済みの NLP モデルと CV モデルを組み合わせる方法を紹介します。統一された時系列モデルを構築します。

2. 全体構造

この記事で提案するモデルは、Freeze パラメータの事前学習済み言語モデルに基づいており、4 種類のアダプターを組み合わせて実装されています。モデル全体の構造を次の図に示します。

図

図

まず、入力時系列に対して、RevIN メソッドを使用して正規化します。これは、各時系列から平均を引き、分散で割ることを意味します。次に、PatchTST メソッドを使用して、スライディング ウィンドウを通じて時系列を複数のセグメントに分割し、セグメント エンベディングを生成します。処理された時系列は、NLP フィールドの事前トレーニングされた言語モデルに入力されます。トレーニング プロセス全体を通じて、言語モデルの元のパラメーターは変更されず、新しく追加された 4 種類のアダプター パラメーターのみを更新します

3. アダプターの設計

この記事では、4 つのアダプター パラメーターを紹介します。時系列を適応させるという目標を達成するために、NLP および CV の分野の大規模モデルのさまざまな場所に接続できるアダプターのタイプ。これら 4 つのアダプタは、時間アダプタ、チャネル アダプタ、周波数アダプタ、および例外アダプタです。

時間アダプタ: 時間アダプタは、時間次元情報を融合するために使用される MLP ネットワークです。本論文では、時間次元や空間次元の高次元情報を低次元空間にマッピングし、その後高次元空間にマッピングし直すというボトルネック構造を採用する。この目的は、時系列関係を抽出するプロセスでの過剰適合のリスクを回避することです

チャネル アダプター: チャネル アダプターの構造は時間アダプターと似ていますが、実行される点が異なります。空間次元で使用され、多変量シーケンスの変数を抽出するために使用されます。それらの間の関係にも bottleect が使用されます。

Picture

Picture

周波数アダプター:周波数アダプターは、周波数ドメインで時系列情報を抽出します。この部分は、時系列が周波数ドメインにマッピングされ、MLP が周波数ドメインで実行され、その後時間ドメインにマッピングされて、周波数でのグローバル情報の抽出を実現します。ドメイン。

異常アダプター: この部分は主に新しい時系列異常検出手法を実装します。ここでは注意スコア マトリックスが使用されます。正常なシーケンスの場合、注意スコア マトリックスは周期的な繰り返し特性を示しますが、異常なシーケンスはそうではありません。そこで、本記事では異常アダプタとしてガウシアンカーネルを使用し、アテンションの出力結果とその計算されたKL発散を時系列異常検出に利用します。

画像

画像

さらに、さまざまなデータが各アダプタによってさまざまな程度の影響を受けるため、この記事ではゲート ネットワークを使用して、選択的に使用します。アダプター

4と実験結果

では、7つの時系列タスクの効果を比較しましたが、本記事で提案した時系列統合大規模モデルは、各タスクにおいて各種SOTAモデルを上回る結果を達成しました。業界での効果。長期予測タスクを例にとると、GPT2 アダプターに基づく統合モデルが最高のパフォーマンスを発揮します

#########写真############以上がアダプターとGPTに基づく時系列マルチタスク統合大規模モデルの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

迅速なエンジニアリングにおける思考のグラフは何ですかApr 13, 2025 am 11:53 AM

迅速なエンジニアリングにおける思考のグラフは何ですかApr 13, 2025 am 11:53 AM導入 迅速なエンジニアリングでは、「思考のグラフ」とは、グラフ理論を使用してAIの推論プロセスを構造化および導く新しいアプローチを指します。しばしば線形sを含む従来の方法とは異なります

Genaiエージェントとの電子メールマーケティングを組織に最適化しますApr 13, 2025 am 11:44 AM

Genaiエージェントとの電子メールマーケティングを組織に最適化しますApr 13, 2025 am 11:44 AM導入 おめでとう!あなたは成功したビジネスを運営しています。ウェブページ、ソーシャルメディアキャンペーン、ウェビナー、会議、無料リソース、その他のソースを通じて、毎日5000の電子メールIDを収集します。次の明白なステップはです

Apache Pinotによるリアルタイムアプリのパフォーマンス監視Apr 13, 2025 am 11:40 AM

Apache Pinotによるリアルタイムアプリのパフォーマンス監視Apr 13, 2025 am 11:40 AM導入 今日のペースの速いソフトウェア開発環境では、最適なアプリケーションパフォーマンスが重要です。応答時間、エラーレート、リソース利用などのリアルタイムメトリックを監視することで、メインに役立ちます

ChatGptは10億人のユーザーにヒットしますか? 「わずか数週間で2倍になりました」とOpenai CEOは言いますApr 13, 2025 am 11:23 AM

ChatGptは10億人のユーザーにヒットしますか? 「わずか数週間で2倍になりました」とOpenai CEOは言いますApr 13, 2025 am 11:23 AM「ユーザーは何人いますか?」彼は突き出した。 「私たちが最後に言ったのは毎週5億人のアクティブであり、非常に急速に成長していると思います」とアルトマンは答えました。 「わずか数週間で2倍になったと言った」とアンダーソンは続けた。 「私はそのprivと言いました

PIXTRAL -12B:Mistral AI'の最初のマルチモーダルモデル-Analytics VidhyaApr 13, 2025 am 11:20 AM

PIXTRAL -12B:Mistral AI'の最初のマルチモーダルモデル-Analytics VidhyaApr 13, 2025 am 11:20 AM導入 Mistralは、最初のマルチモーダルモデル、つまりPixtral-12B-2409をリリースしました。このモデルは、Mistralの120億個のパラメーターであるNemo 12bに基づいて構築されています。このモデルを際立たせるものは何ですか?これで、画像とTexの両方を採用できます

生成AIアプリケーションのエージェントフレームワーク - 分析VidhyaApr 13, 2025 am 11:13 AM

生成AIアプリケーションのエージェントフレームワーク - 分析VidhyaApr 13, 2025 am 11:13 AMクエリに応答するだけでなく、情報を自律的に収集し、タスクを実行し、テキスト、画像、コードなどの複数のタイプのデータを処理するAIを搭載したアシスタントがいることを想像してください。未来的に聞こえますか?これでa

金融セクターにおける生成AIの応用Apr 13, 2025 am 11:12 AM

金融セクターにおける生成AIの応用Apr 13, 2025 am 11:12 AM導入 金融業界は、効率的な取引と信用の可用性を促進することにより経済成長を促進するため、あらゆる国の発展の基礎となっています。取引の容易さとクレジット

オンライン学習とパッシブアグレッシブアルゴリズムのガイドApr 13, 2025 am 11:09 AM

オンライン学習とパッシブアグレッシブアルゴリズムのガイドApr 13, 2025 am 11:09 AM導入 データは、ソーシャルメディア、金融取引、eコマースプラットフォームなどのソースから前例のないレートで生成されています。この連続的な情報ストリームを処理することは課題ですが、

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

SublimeText3 中国語版

中国語版、とても使いやすい

WebStorm Mac版

便利なJavaScript開発ツール

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター