初のマルチビュー自動運転シーンビデオ生成世界モデル | DrivingDiffusion: BEV データとシミュレーションの新しいアイデア

著者の個人的な考え

自動運転の分野では、BEV ベースのサブタスク/エンドツーエンド ソリューションの開発により、高品質 マルチビュー トレーニング データ とそれに対応する シミュレーション シーン構築 の重要性がますます高まっています。現在のタスクの問題点に対応して、「高品質」は 3 つの側面に分割できます。

- さまざまな次元でのロングテール シナリオ : 近距離の車両など。障害物データだけでなく、車の切断中の正確な進行角度だけでなく、収集が難しい車線データやランプ/合流/合流におけるさまざまな曲率を持つシーンも同様です。これらは多くの場合、大量のデータ収集と複雑なデータ マイニング戦略に依存しており、コストがかかります。

- 3D の真の価値 - 画像の高い一貫性 : 現在の BEV データ取得は、センサーの設置/校正、高精度マップ、再構成アルゴリズム自体のエラーの影響を受けることがよくあります。このため、データ内の [3D 真の値 - 画像センサー パラメーター] の各セットが正確で一貫していることを確認することが困難になります。

- 上記の条件を満たした時系列データ: 現在の認識/予測/意思決定/エンドツーに必要な連続フレームの多視点画像と対応する真の値-endおよびその他のタスクに不可欠です。

シミュレーションの場合、上記の条件を満たすビデオ生成は、レイアウトを通じて直接生成できます。これは間違いなく、マルチエージェント センサー入力を構築する最も直接的な方法です。 DrivingDiffusion は上記の問題を新たな視点で解決します。

普及促進とは何ですか?

- DrivingDiffusion は、自動運転シーン生成のための拡散モデル フレームワークであり、レイアウト制御された マルチビュー画像/ビデオ生成と SOTA を実装します。それぞれ実装されています。

- DrivingDiffusion-Future は、自動運転世界モデルとして、単一フレーム画像 に基づいて将来のシーンのビデオを予測し、主車両/他の車両の動作計画に影響を与える機能を備えています言語プロンプトについて。

DrivingDiffusion 生成の効果は何ですか?

必要な学生は、まずプロジェクトのホームページをご覧ください: https://drivingdiffusion.github.io(1) DrivingDiffusion

レイアウト制御されたマルチビュー イメージの生成

レイアウトの調整: 生成された結果を正確に制御

#レイアウト制御されたマルチビュー ビデオの生成

入力フレームのテキスト記述に基づいて後続のフレームを生成します

単一のフレーム画像を入力として使用し、主要な車/他の車のテキスト説明に基づいて後続のフレームの運転シーンを構築します。図中最初の3段目と4段目はそれぞれ自車両と他車両の挙動のテキスト記述制御後の生成効果を示している。 (緑色のボックスが入力、青色のボックスが出力です)

単一のフレーム画像を入力として使用し、主要な車/他の車のテキスト説明に基づいて後続のフレームの運転シーンを構築します。図中最初の3段目と4段目はそれぞれ自車両と他車両の挙動のテキスト記述制御後の生成効果を示している。 (緑色のボックスが入力、青色のボックスが出力です)

他のコントロールは必要ありません。単一フレームの画像を入力として使用して、後続の運転シーンのフレームを予測するだけです。 (緑のボックスが入力、青のボックスが出力)

他のコントロールは必要ありません。単一フレームの画像を入力として使用して、後続の運転シーンのフレームを予測するだけです。 (緑のボックスが入力、青のボックスが出力)

DrivingDiffusion は上記の問題をどのように解決しますか?

DrivingDiffusion は、まずシーン内のすべての 3D 真値 (障害物/道路構造物) を人工的に構築し、真値をレイアウト画像に投影した後、これをモデル入力として使用してマルチ- カメラの視点、実際の画像/ビデオ。 3D 真の値 (BEV ビューまたはエンコードされたインスタンス) がモデル入力として直接使用されず、パラメーターが投影後の入力に使用される理由は、体系的な 3D-2D 一貫性エラーを排除するためです。 (このようなデータセットでは、3D 真値 と 車両パラメータ が実際のニーズに応じて人工的に構築されます。前者は、希少なシーン データを自由に構築する機能をもたらします。 後者は、従来のデータ生成における幾何学的一貫性のエラーを排除します。)

現時点ではまだ 1 つの疑問が残っています。生成された画像/ビデオの品質が用途を満たすかどうかです。要件 ? シナリオ構築というと、誰もがシミュレーション エンジンの使用を思い浮かべますが、生成されるデータと実際のデータの間には大きな領域のギャップがあります。 GAN ベースの手法で生成された結果には、実際の実データの分布からの偏りがあることがよくあります。拡散モデルは、ノイズを学習してデータを生成するマルコフ連鎖の特性に基づいており、生成される結果の忠実度が高く、実際のデータの代替として使用するのに適しています。 DrivingDiffusion は、人工的に構築されたシーン と 車両パラメータ に基づいて シーケンシャル マルチビュー ビュー を直接生成します。これらは参照として使用できるだけでなく、ダウンストリームの自動運転タスク用 トレーニング データを使用して、自動運転アルゴリズムのフィードバック用のシミュレーション システムを構築することもできます。

ここでいう「人工的に構築されたシーン」には障害物と道路構造情報のみが含まれていますが、DrivingDiffusion のフレームワークでは、看板、信号機、工事エリア、さらには低レベルの占有グリッド/深度マップなどのレイアウト情報を簡単に導入できます。他の制御モード。DrivingDiffusion 手法の概要

マルチビュー ビデオを生成する場合、いくつかの問題があります:

- 比較的一般的画像生成の場合、マルチビュー ビデオ生成により、

- perspective と timing という 2 つの新しい次元が追加されます。長いビデオを生成できるフレームワークを設計するにはどうすればよいですか?ビュー間の一貫性とフレーム間の一貫性を維持するにはどうすればよいですか? 自動運転タスクの観点から見ると、シーン内のインスタンスは非常に重要です。生成されたインスタンスの品質を確保するにはどうすればよいですか?

DrivingDiffusion は長いビデオ プロセスを生成します

単一フレーム マルチビュー モデル: マルチビュー キー フレームを生成します。 追加の制御としてフレームを使用するシングルビュー タイミング モデルとマルチビュー共有: 各ビューでタイミング拡張を並行して実行します。

追加の制御としてフレームを使用するシングルビュー タイミング モデルとマルチビュー共有: 各ビューでタイミング拡張を並行して実行します。

- 生成された結果を追加の制御として使用するシングル フレーム マルチビュー モデル: 微調整

- 新しいキーフレームを決定し、スライディング ウィンドウを通してビデオを拡張します。

- クロスビュー モデルと時間モデルのトレーニング フレームワーク

- マルチビュー モデルとシーケンシャル モデルの場合、3D-Unet の拡張次元はそれぞれ視点と時間です。どちらも同じレイアウト コントローラーを持っています。著者は、後続のフレームがマルチビュー キー フレームからシーン内の情報を取得し、さまざまなターゲットの関連情報を暗黙的に学習できると考えています。どちらも、それぞれ異なる整合性アテンション モジュールと同じローカル プロンプト モジュールを使用します。

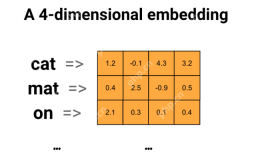

- レイアウト エンコード: 障害物カテゴリ/障害物情報と道路構造物セグメンテーション レイアウトは、異なる固定エンコード値を使用して RGB 画像にエンコードされ、エンコード後にレイアウト トークンが出力されます。

- キー フレーム制御: すべてのタイミング拡張プロセスは、特定のキー フレームの多視点画像を使用します。これは、短いタイミング シーケンスの後続のフレームがキー フレームから情報を取得できるという前提に基づいています。すべての微調整プロセスでは、キー フレームと、それによって生成された後続フレームの多視点画像を追加の制御として使用し、フレームの視点間の一貫性を最適化した後に多視点画像を出力します。

- 特定の視点に基づく事前のオプティカル フロー: 時間モデルの場合、トレーニング中に特定の視点からのデータのみがサンプリングされます。また、事前に計算しておいた透視画像下の各画素位置のオプティカルフロー事前値を利用し、カメラIDトークンとしてエンコードすることで、拡散処理における時間埋め込みと同様の隠れ層のインタラクティブな制御を行う。

整合性モジュールとローカル プロンプト

##整合性モジュール は 2 つの部分に分かれています: 整合性注意メカニズム および 一貫性相関損失。

一貫性注意メカニズムは、隣接するビューとタイミング関連のフレーム間の相互作用に焦点を当てます。特に、フレーム間の一貫性については、重なり合う左右の隣接するビュー間の情報の相互作用のみに焦点を当てます。モデルでは、各フレームはキーフレームと前のフレームのみに焦点を当てます。これにより、グローバルな相互作用によって引き起こされる膨大な計算負荷が回避されます。 一貫性のある相関損失は、ピクセルレベルの相関とポーズの回帰によって幾何学的制約を追加します。その勾配は、事前トレーニングされたポーズ回帰子によって提供されます。リグレッサーは、LoFTR に基づいてポーズ回帰ヘッドを追加し、対応するデータセットの実データの真のポーズ値を使用してトレーニングされます。マルチビュー モデルと時系列モデルの場合、このモジュールはそれぞれカメラの相対姿勢と主車両の運動姿勢を監視します。ローカル プロンプト と グローバル プロンプト は連携して、CLIP と安定拡散 v1-4 のパラメータ セマンティクスを再利用して、特定のカテゴリ インスタンス領域をローカルに強化します。図に示すように、画像トークンとグローバル テキスト説明プロンプトのクロスアテンション メカニズムに基づいて、作成者は特定のカテゴリのローカル プロンプトを設計し、カテゴリのマスク領域で画像トークンを使用してローカル クエリをクエリします。プロンプト。このプロセスでは、元のモデル パラメーターのオープン ドメインでのテキスト ガイド付き画像生成の概念が最大限に活用されます。

DrivingDiffusion-Future メソッドの概要

メイン車両制御テキスト記述コントローラと他の車両制御/環境テキスト記述コントローラが分離されていることは注目に値します。

実験分析

モデルのパフォーマンスを評価するために、DrivingDiffusion はフレームレベルのフレシェ開始距離 (FID) を使用して、生成された画像の品質を評価します。したがって、FVD を使用して生成された画像を評価します。すべてのメトリクスは、nuScenes 検証セットに基づいて計算されます。表 1 に示すように、自動運転シナリオにおける画像生成タスク BEVGen およびビデオ生成タスク DriveDreamer と比較して、DrivingDiffusion はさまざまな設定の下でパフォーマンス指標において大きな利点があります。

FID などの方法は、画像合成の品質を測定するためによく使用されますが、タスクの設計目標を完全にフィードバックするものではなく、さまざまなセマンティック カテゴリの合成品質を反映するものでもありません。このタスクは 3D レイアウトと一致するマルチビュー画像を生成することに特化しているため、DrivingDiffuison は、一貫性の観点からパフォーマンスを測定するために BEV 知覚モデル メトリクスを使用することを提案しています。CVT と BEVFusion の公式モデルを評価者として使用し、同じ実際の 3D モデルを使用します。 nuScenes 検証セットとして、レイアウト上で条件付きで画像を生成し、生成された画像の各セットに対して CVT および BevFusion 推論を実行し、予測結果を実際の結果と比較します。これには、運転可能エリアの平均交差 U (mIoU) スコアが含まれます。すべてのオブジェクト クラスの NDS 統計を表 2 に示します。実験結果は、合成データ評価セットの知覚指標が実際の評価セットの知覚指標に非常に近いことを示しており、これは生成された結果と 3D 真の値の高い一貫性、および画質の高い忠実度を反映しています。

上記の実験に加えて、DrivingDiffusion は、解決する主な問題、つまり自動運転の下流タスクのパフォーマンスを向上させるために、合成データ トレーニングを追加する実験を実施しました。表 3 は、BEV 認識タスクにおける合成データ拡張によって達成されるパフォーマンスの向上を示しています。元のトレーニング データでは、特に小さなターゲット、近距離の車両、および車両の向きの角度について、ロングテール分布に問題があります。 DrivingDiffusion は、この問題を解決するために、限られたサンプルを使用してこれらのクラスの追加データを生成することに重点を置いています。障害物方向角度の分布の改善に焦点を当てた 2000 フレームのデータを追加した後、NDS はわずかに改善しましたが、mAOE は 0.5613 から 0.5295 に大幅に低下しました。トレーニングを支援するために、より包括的でまれなシーンに焦点を当てた 6000 フレームの合成データを使用した後、nuScenes 検証セットで大幅な強化が観察できます。NDS は 0.412 から 0.434 に増加し、mAOE は 0.5613 から 0.5130 に減少しました。これは、合成データのデータ拡張が認識タスクに大幅な改善をもたらす可能性があることを示しています。ユーザーは、実際のニーズに基づいてデータ内の各次元の分布に関する統計を作成し、ターゲットを絞った合成データでそれを補完できます。

DrivingDiffusionの意義と今後の取り組み

DrivingDiffusionは、自動運転シーンの多視点動画生成と未来予測を同時に実現するという非常に重要な機能です。自動運転タスクに。このうち、layout と parameters はすべて人工的に構築されており、3D と 2D の間の変換は学習可能なモデル パラメーターに依存するのではなく投影を通じて行われるため、前の取得プロセスでの幾何学的エラーが排除されます。データは、強力な実用的価値を持っています。同時に、DrivingDiffuison は非常にスケーラブルであり、新しいシーン コンテンツ レイアウトと追加のコントローラーをサポートし、超解像度とビデオ フレーム挿入テクノロジーを通じてロスレスに生成品質を向上させることもできます。

自動運転シミュレーションでは、ナーフの試みが増えています。しかし、ストリートビュー生成のタスクでは、動的コンテンツと静的コンテンツの分離、大規模なブロックの再構築、天候やその他の次元の外観制御の切り離しなど、膨大な作業量が発生します。トレーニング後にのみ、後続のシミュレーションで新しい視点合成タスクをサポートできるようになります。 DrivingDiffusion には、ビジュアルとテキストのつながり、ビジュアルコンテンツの概念理解など、ある程度の一般的な知識が当然含まれており、レイアウトを構築するだけで、ニーズに応じたシーンを迅速に作成できます。ただし、前述したように、プロセス全体は比較的複雑であり、長いビデオの生成には後処理モデルの微調整と拡張が必要です。 DrivingDiffusion は、視点次元と時間次元の圧縮を引き続き検討し、新しい視点の生成と変換のために Nerf を組み合わせ、生成の品質とスケーラビリティを向上させ続けます。

以上が初のマルチビュー自動運転シーンビデオ生成世界モデル | DrivingDiffusion: BEV データとシミュレーションの新しいアイデアの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

6 ChatGptは、ブランドブーストポッドキャストの招待状を取得するためのプロンプトを作成しますApr 16, 2025 am 11:16 AM

6 ChatGptは、ブランドブーストポッドキャストの招待状を取得するためのプロンプトを作成しますApr 16, 2025 am 11:16 AMポッドキャストのインタビューを受けるには戦略と一貫した行動が必要なので、多くのビジネスオーナーが到着しない招待状を待っています。今日行動を起こしてください。 これらのプロンプトはあなたを完璧なゲストとして位置づけ、それらのキャリアを獲得します

5つの強力なAIプロンプトは、あらゆるビジネスアイデアを高めることができますApr 16, 2025 am 11:11 AM

5つの強力なAIプロンプトは、あらゆるビジネスアイデアを高めることができますApr 16, 2025 am 11:11 AM幸いなことに、これは生成的AIが非常に役立つ分野です。いいえ、完全な戦略は考えられません。しかし、それはあなたがビジネス計画をブレインストーミングし、あなたの市場を調査し、マーケティングのコンテンツとメッセージを微調整するのに役立ちます。 それはそうではありません

卒業生スマート:AI時代のキャリアアドバイスApr 16, 2025 am 11:10 AM

卒業生スマート:AI時代のキャリアアドバイスApr 16, 2025 am 11:10 AM今年だけが違うと感じています。不確実です。 関税戦争が順調に進んでいるという事実だけではありません。 AIは、頭のひっかきと魂が最近検索するという根本的な原因です。ナショナルユースチャリティーワンサイドは最近の調査を実施しました

効果的な加速主義または向社会的AI。 AIの未来は何ですか?Apr 16, 2025 am 11:09 AM

効果的な加速主義または向社会的AI。 AIの未来は何ですか?Apr 16, 2025 am 11:09 AMアクセラレーション主義者のビジョン:フルスピード先 略してE/ACCとして知られる効果的な加速主義は、2022年頃に、シリコンバレー以降で、その中核で著しく大幅な牽引力を獲得している技術的な最適主義運動として出現しました。

Excelの相対的、絶対的、混合参照とは何ですか?Apr 16, 2025 am 11:03 AM

Excelの相対的、絶対的、混合参照とは何ですか?Apr 16, 2025 am 11:03 AM導入 私の最初のスプレッドシートの経験は、コピーしたときにフォーミュラの予測不可能な動作のためにイライラしていました。 私はその時のセルの参照を理解していませんでしたが、相対的、絶対的、混合された参照をマスターすることは私のスプレッドに革命をもたらしました

Word2vecを使用したスマートサブジェクトの電子メールラインの生成Apr 16, 2025 am 11:01 AM

Word2vecを使用したスマートサブジェクトの電子メールラインの生成Apr 16, 2025 am 11:01 AMこの記事では、Word2VECエンボードを使用して効果的な電子メールの件名を生成する方法を示しています。 セマンティックな類似性を活用して、コンテキストに関連する件名を作成し、電子メールマーケティングを改善するシステムを構築することでガイドします。

データアナリストの将来Apr 16, 2025 am 11:00 AM

データアナリストの将来Apr 16, 2025 am 11:00 AMデータ分析:進化する風景のナビゲート データが数字だけでなく、すべての経営陣の決定の礎石を想像してください。 この動的環境では、データアナリストは不可欠であり、生データを実行可能に変換します

Excelの等式機能は何ですか? - 分析VidhyaApr 16, 2025 am 10:55 AM

Excelの等式機能は何ですか? - 分析VidhyaApr 16, 2025 am 10:55 AMExcelの等式関数:データ分析パワーハウス 合理化されたデータ分析のためのExcelの等式関数の力のロックを解除します。この汎用性のある関数は、合計と乗算機能を簡単に組み合わせて、追加に拡張し、減算

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

Dreamweaver Mac版

ビジュアル Web 開発ツール

PhpStorm Mac バージョン

最新(2018.2.1)のプロフェッショナル向けPHP統合開発ツール

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!

DVWA

Damn Vulnerable Web App (DVWA) は、非常に脆弱な PHP/MySQL Web アプリケーションです。その主な目的は、セキュリティ専門家が法的環境でスキルとツールをテストするのに役立ち、Web 開発者が Web アプリケーションを保護するプロセスをより深く理解できるようにし、教師/生徒が教室環境で Web アプリケーションを教え/学習できるようにすることです。安全。 DVWA の目標は、シンプルでわかりやすいインターフェイスを通じて、さまざまな難易度で最も一般的な Web 脆弱性のいくつかを実践することです。このソフトウェアは、

mPDF

mPDF は、UTF-8 でエンコードされた HTML から PDF ファイルを生成できる PHP ライブラリです。オリジナルの作者である Ian Back は、Web サイトから「オンザフライ」で PDF ファイルを出力し、さまざまな言語を処理するために mPDF を作成しました。 HTML2FPDF などのオリジナルのスクリプトよりも遅く、Unicode フォントを使用すると生成されるファイルが大きくなりますが、CSS スタイルなどをサポートし、多くの機能強化が施されています。 RTL (アラビア語とヘブライ語) や CJK (中国語、日本語、韓国語) を含むほぼすべての言語をサポートします。ネストされたブロックレベル要素 (P、DIV など) をサポートします。