紙のリンク: https://arxiv.org/abs/2309.01029 Github リンク: https://github.com/hy-zhao23/Explainability-for-Large-Language-Models

モデルの複雑さの高さ。深層学習モデルや LLM 時代以前の従来の統計機械学習モデルとは異なり、LLM モデルは規模が大きく、数十億のパラメータが含まれており、その内部表現と推論プロセスは非常に複雑であり、その具体的な出力を説明するのは困難です。 強いデータ依存性。 LLM は学習プロセス中に大規模なテキスト コーパスに依存するため、これらの学習データの偏りや誤差などがモデルに影響を与える可能性がありますが、学習データの品質がモデルに与える影響を完全に判断することは困難です。 ブラックボックスの性質。私たちは通常、Llama-2 のようなオープンソース モデルであっても、LLM をブラック ボックス モデルとして考えています。その内部の推論連鎖や意思決定プロセスを明確に判断することは難しく、入力と出力に基づいて分析するしかないため、解釈が困難になります。 - #出力の不確実性。 LLM の出力は不確実であることが多く、同じ入力に対して異なる出力が生成される可能性があり、これも解釈の難しさを高めます。

- 評価指標が不十分です。現在の対話システムの自動評価指標ではモデルの解釈可能性を十分に反映できておらず、人間の理解を考慮したさらなる評価指標が必要である。

従来の微調整の場合-tuning パラダイムは、まず大規模なラベルなしテキスト ライブラリで基本的な言語モデルを事前トレーニングし、次に特定のドメインからのラベル付きデータ セットを通じてそれを微調整します。このような一般的なモデルには、BERT、RoBERTa、ELECTRA、DeBERTa などが含まれます。

プロンプトベースのパラダイムプロンプトを使用して、ゼロショット学習または少数ショット学習を実装します。従来の微調整パラダイムと同様に、基本モデルを事前トレーニングする必要があります。ただし、プロンプトパラダイムに基づく微調整は、通常、命令チューニングとヒューマンフィードバックからの強化学習 (RLHF) によって実装されます。このような一般的なモデルには、GPT-3.5、GPT 4、Claude、LLaMA-2-Chat、Alpaca、Vicuna などが含まれます。トレーニング プロセスは次のとおりです:

- #摂動ベースの解釈、特定の入力特徴を変更することによる出力結果への影響を観察する

- According勾配の解釈では、入力に対する出力の偏微分が、対応する入力の重要度指標として使用されます。

- 代替モデル。人間が理解できる単純なモデルを使用して適合させます。各入力の重要性を取得するための複雑なモデル出力の単一コンポーネント;

- 分解ベースのテクノロジは、特徴相関スコアを線形に分解することを目的としています。

注意度の変化をさまざまなスケールで直感的に観察するための注意力視覚化テクノロジー。 注意の偏微分の出力など、関数ベースの解釈。しかし、研究の視点としての注意の使用については、学術界で依然として議論の余地があります。

- # 敵対的な例は、小さな変化に非常に敏感なモデルの特性に対して生成されたデータです。自然言語処理では、通常、これらは次のように取得されます。テキストの変更。これは人間にとっては困難です。テキストの変換が異なると、モデルからの予測が異なることがよくあります。

- 反事実サンプルは、否定などのテキストを変形することによって取得されます。これは通常、モデルの因果推論能力のテストです。

##グローバルな解釈は、以下から派生することを目的としています。モデルの構成レベルにはニューロン、隠れ層、およびより大きなチャンクが含まれており、大規模なモデルがどのように機能するかについての高次の説明を提供します。主に、さまざまなネットワーク コンポーネントで学習された意味論的な知識を調査します。

- ニューロン活性化 従来のニューロン活性化解析では、重要なニューロンの一部のみを考慮し、ニューロンと意味的特徴との関係を学習していました。最近では GPT-4 をニューロンの説明にも使用するようになり、一部のニューロンを選択して説明するのではなく、すべてのニューロンを説明することができます。

- 概念ベースの解釈入力はまず一連の概念にマッピングされ、次に予測に対する概念の重要性を測定することによってモデルが解釈されます。

- 状況学習 大規模モデルにおける状況学習のメカニズムを調査し、大規模モデルと中規模モデルの状況学習の違いを区別します。

- 思考チェーン プロンプト モデルのパフォーマンスを向上させる思考チェーン プロンプトを調べます。

- #アシスタントモデルの説明

#モデル解釈の評価

以上が大規模モデルの解釈可能性の分析: レビューにより真実が明らかになり、疑問が解決されます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

AIゲーム開発は、激動の夢想家ポータルでエージェントの時代に入りますMay 02, 2025 am 11:17 AM

AIゲーム開発は、激動の夢想家ポータルでエージェントの時代に入りますMay 02, 2025 am 11:17 AM激動ゲーム:AIエージェントとのゲーム開発に革命をもたらします BlizzardやObsidianなどの業界の巨人の退役軍人で構成されるゲーム開発スタジオであるUpheavalは、革新的なAIを搭載したPlatforでゲームの作成に革命をもたらす態勢を整えています。

UberはあなたのRobotaxiショップになりたいと思っています、プロバイダーはそれらを許可しますか?May 02, 2025 am 11:16 AM

UberはあなたのRobotaxiショップになりたいと思っています、プロバイダーはそれらを許可しますか?May 02, 2025 am 11:16 AMUberのRobotaxi戦略:自動運転車用の乗車エコシステム 最近のCurbivore Conferenceで、UberのRichard Willderは、Robotaxiプロバイダーの乗車プラットフォームになるための戦略を発表しました。 で支配的な位置を活用します

ビデオゲームをプレイするAIエージェントは、将来のロボットを変革しますMay 02, 2025 am 11:15 AM

ビデオゲームをプレイするAIエージェントは、将来のロボットを変革しますMay 02, 2025 am 11:15 AMビデオゲームは、特に自律的なエージェントと現実世界のロボットの開発において、最先端のAI研究のための非常に貴重なテストの根拠であることが証明されています。 a

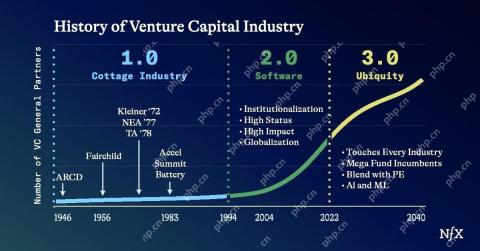

スタートアップインダストリアルコンプレックス、VC 3.0、およびジェームズクーリエのマニフェストMay 02, 2025 am 11:14 AM

スタートアップインダストリアルコンプレックス、VC 3.0、およびジェームズクーリエのマニフェストMay 02, 2025 am 11:14 AM進化するベンチャーキャピタルの景観の影響は、メディア、財務報告、日常の会話で明らかです。 ただし、投資家、スタートアップ、資金に対する特定の結果はしばしば見落とされています。 ベンチャーキャピタル3.0:パラダイム

AdobeはAdobe Max London 2025でクリエイティブクラウドとホタルを更新しますMay 02, 2025 am 11:13 AM

AdobeはAdobe Max London 2025でクリエイティブクラウドとホタルを更新しますMay 02, 2025 am 11:13 AMAdobe Max London 2025は、アクセシビリティと生成AIへの戦略的シフトを反映して、Creative Cloud and Fireflyに大幅な更新を提供しました。 この分析には、イベント以前のブリーフィングからの洞察がAdobeのリーダーシップを取り入れています。 (注:ADOB

すべてのメタがラマコンで発表しましたMay 02, 2025 am 11:12 AM

すべてのメタがラマコンで発表しましたMay 02, 2025 am 11:12 AMMetaのLlamaconアナウンスは、Openaiのような閉じたAIシステムと直接競合するように設計された包括的なAI戦略を紹介し、同時にオープンソースモデルの新しい収益ストリームを作成します。 この多面的なアプローチはBOをターゲットにします

AIは単なる通常のテクノロジーに過ぎないという提案に関する醸造論争May 02, 2025 am 11:10 AM

AIは単なる通常のテクノロジーに過ぎないという提案に関する醸造論争May 02, 2025 am 11:10 AMこの結論に関して、人工知能の分野には深刻な違いがあります。 「皇帝の新しい服」を暴露する時が来たと主張する人もいれば、人工知能は普通の技術であるという考えに強く反対する人もいます。 それについて議論しましょう。 この革新的なAIブレークスルーの分析は、AIの分野での最新の進歩をカバーする私の進行中のForbesコラムの一部です。 一般的な技術としての人工知能 第一に、この重要な議論の基礎を築くためには、いくつかの基本的な知識が必要です。 現在、人工知能をさらに発展させることに専念する大量の研究があります。全体的な目標は、人工的な一般情報(AGI)を達成し、さらには可能な人工スーパーインテリジェンス(AS)を達成することです

モデル市民、なぜAI価値が次のビジネスヤードスティックであるのかMay 02, 2025 am 11:09 AM

モデル市民、なぜAI価値が次のビジネスヤードスティックであるのかMay 02, 2025 am 11:09 AM企業のAIモデルの有効性は、現在、重要なパフォーマンス指標になっています。 AIブーム以来、生成AIは、誕生日の招待状の作成からソフトウェアコードの作成まで、すべてに使用されてきました。 これにより、言語modが急増しました

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

WebStorm Mac版

便利なJavaScript開発ツール

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!

EditPlus 中国語クラック版

サイズが小さく、構文の強調表示、コード プロンプト機能はサポートされていません

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

ホットトピック

7906

7906 15

15 1652

1652 14

14 1411

1411 52

52 1303

1303 25

25 1248

1248 29

29