ホームページ >テクノロジー周辺機器 >IT業界 >Alibaba Cloudは、Tongyi Qianwenの140億パラメータモデルQwen-14Bとその対話モデルをオープンソース化し、商用利用は無料になると発表した。

Alibaba Cloudは、Tongyi Qianwenの140億パラメータモデルQwen-14Bとその対話モデルをオープンソース化し、商用利用は無料になると発表した。

- 王林転載

- 2023-09-26 20:05:012696ブラウズ

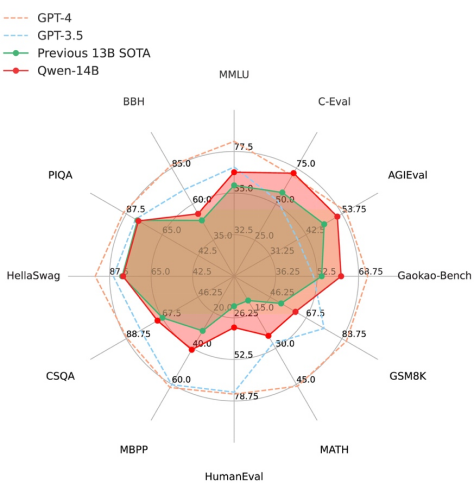

Alibaba Cloud は本日、パラメトリック モデルと会話モデルを含む Qwen-14B と呼ばれるオープンソース プロジェクトを発表しました。このオープンソース プロジェクトでは、無料で商用利用が許可されています

環境の構成とインストール

- #python 3.8 以降

- pytorch 1.12 以降、2.0 以降を推奨

- CUDA 11.4 以降の使用を推奨 (GPU ユーザーはこのオプションを検討する必要があります)

- 使用手順

注: PAI-DSW の環境構成で実行します (シングル カード操作を使用します。ビデオ メモリの最小要件は 11G です)

- Qwen-14B-Chat モデル リンク:

- https:/ /modelscope.cn/models /qwen/Qwen-14B-Chat

- Qwen-14B モデル リンク:

##https ://modelscope.cn/models/qwen/Qwen-14B

- Qwen-14B-Chat-Int4 モデル リンク:

- #https://www.modelscope.cn/models/qwen/Qwen-14B-Chat-Int4

- コミュニティは、モデルのリポジトリの直接ダウンロードをサポートしています:

model_dir = snapshot_download('qwen/Qwen-14B-Chat', 'v1.0.0')<br>広告文: 記事に含まれる外部ジャンプ リンク (ハイパーリンク、QR コード、パスワードなどを含むがこれらに限定されない) は、より多くの情報を伝え、選択時間を節約するために使用されます。このサイトのすべての記事にはこの記述が含まれています。

以上がAlibaba Cloudは、Tongyi Qianwenの140億パラメータモデルQwen-14Bとその対話モデルをオープンソース化し、商用利用は無料になると発表した。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

声明:

この記事はithome.comで複製されています。侵害がある場合は、admin@php.cn までご連絡ください。