ホームページ >テクノロジー周辺機器 >AI >効果はOpanAI同等モデルの96%に達し、国産オープンソースAI言語モデルTigerBotをリリース

効果はOpanAI同等モデルの96%に達し、国産オープンソースAI言語モデルTigerBotをリリース

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-06-10 13:35:101182ブラウズ

6 月 8 日のニュースによると、国内のマルチモーダル大規模言語モデル TigerBot が最近正式にリリースされ、70 億パラメータと 1,800 億パラメータの 2 つのバージョンが含まれ、現在 GitHub でオープンソースになっています。

▲ 画像ソース TigerBot の GitHub ページ

TigerBot によってもたらされたイノベーションは主に次の点にあると報告されています:

- 提案教師あり微調整のための革新的なアルゴリズムにより、モデルの学習可能性が向上します。

- アンサンブルおよび確率的モデリング手法を使用して、制御可能な事実と創造性を実現します。

- ディープスピードの並列トレーニングなどの主流のフレームワークにおけるメモリと通信の問題を解決します。

さらに、このモデルは、中国語のより不規則な分布に合わせて、トークナイザーからトレーニング アルゴリズムまで、より適切な最適化も行います。

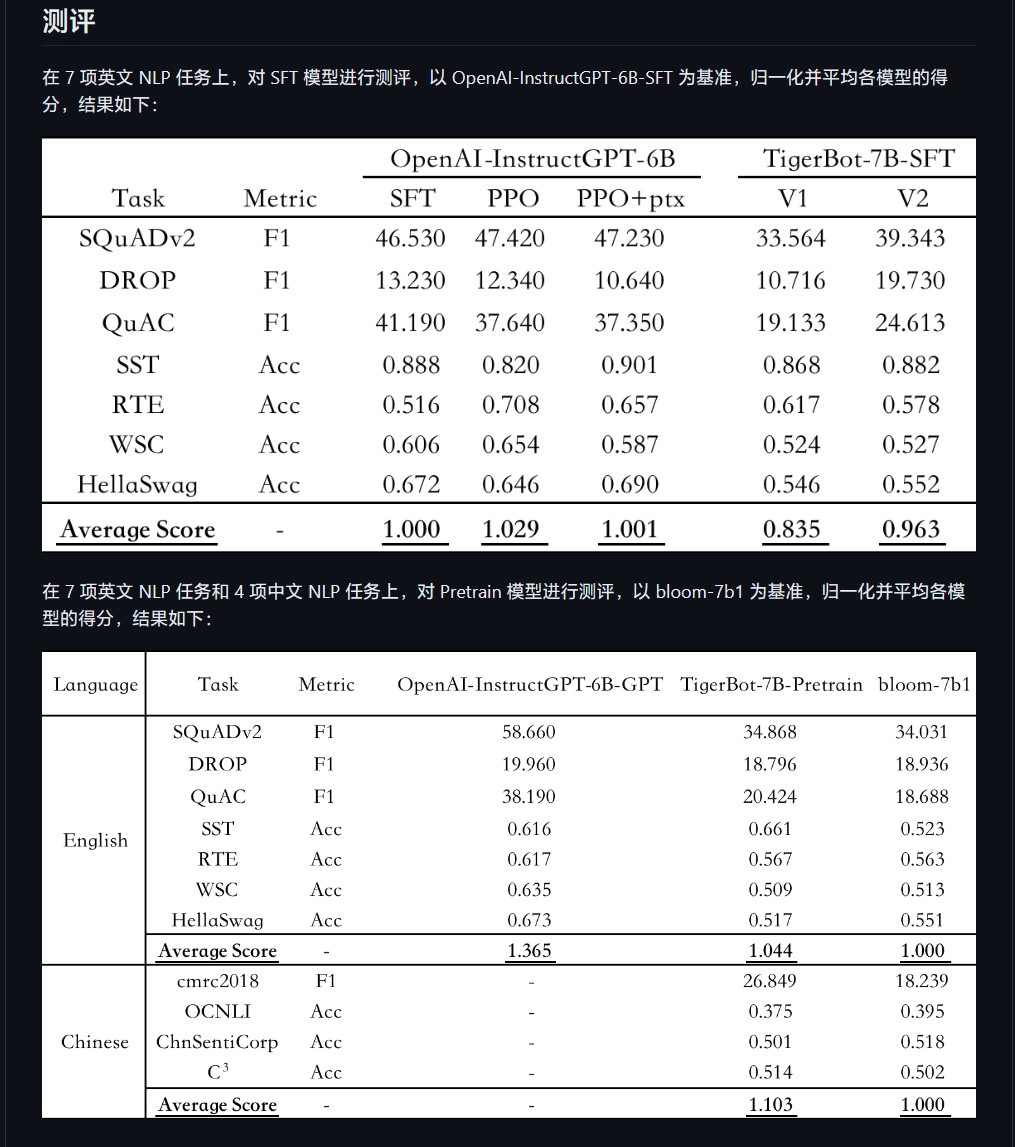

研究者のChen Ye氏は、Hubo Technologyの公式Webサイトで次のように述べています。「このモデルは、少数のパラメーターのみを使用して、人間がどのような種類の質問をしたのかを迅速に理解できます。公開NLPデータに関するOpenAI InstructGPT論文によると」自動評価によると、TigerBot-7B は、同じサイズの OpenAI モデルの総合パフォーマンスの 96% に達しました。"

▲ 画像ソース TigerBot の GitHub ページ

によると レポートによると、TigerBot-7B ベースのパフォーマンスは「OpenAI の同等モデルよりも優れています。」オープン ソース コードには、基本的なトレーニング コードと推論コード、およびデュアルの定量化コードと推論コードが含まれています。 -カード推論180Bモデル。データには、100G の事前トレーニング データと、教師付き微調整用の 1G または 100 万個のデータが含まれます。

IT House の友人は、ここで GitHub のオープンソース プロジェクトを見つけることができます。

以上が効果はOpanAI同等モデルの96%に達し、国産オープンソースAI言語モデルTigerBotをリリースの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。