マシンの心臓コラム

ハートオブマシン編集部

AI詐欺の成功率は非常に高く、数日前には「10分で430万人が騙された」という検索ワードが話題になった。研究者たちは最近、最も人気のある大規模言語モデルに基づいて認識方法を研究しました。

大規模な生成モデルの継続的な進歩により、生成されるコーパスは徐々に人間のそれに近づきつつあります。大型モデルは無数の店員の手を解放していますが、偽物を偽造するその強力な能力も一部の犯罪者によって利用され、一連の社会問題を引き起こしています。

https://arxiv.org/abs/2305.18149

コードアドレス (MindSpore):

https://github.com/mindspore-lab/mindone/tree/master/examples/detect_chatgpt

コードアドレス (PyTorch):

https://github.com/YuchuanTian/AIGC_text_detector

######導入######

大規模な言語モデルの生成効果がますます現実的になるにつれて、さまざまな業界が信頼性の高い AI 生成のテキスト検出器を緊急に必要としています。ただし、コーパス検出に対する要件は業界によって異なります。たとえば、学術界では一般に、大規模で完全な学術文書を検出する必要がありますが、ソーシャル プラットフォームでは、比較的短く断片的なフェイク ニュースを検出する必要があります。しかし、既存の検出器ではさまざまなニーズに対応できないことがよくあります。たとえば、一部の主流の AI テキスト検出器は、一般に、短いコーパスに対する予測機能が不十分です。異なる長さのコーパスの異なる検出効果に関して、著者は、AI が生成した短い文の帰属にはある程度の「不確実性」がある可能性があることを観察しました。より率直に言うと、AI が生成した一部の短い文は、人間が利用することも多いため、AIが生成した短文が人間によるものなのか、AIによるものなのかを判断することは困難です。人間と AI が同じ質問に答える例をいくつか示します:

これらの例からわかるように、AI によって生成された短答は識別が困難です。この種のコーパスは人間との差が小さすぎて、その真の属性を厳密に判断することが困難です。したがって、単純に短いテキストに人間/AI として注釈を付け、テキスト検出のための従来の二値分類問題に従うことは不適切です。

この問題に対応して、この研究では人間/AI の二項分類検出部分を部分 PU (Positive-Unlabeled) 学習問題に変換します。つまり、短い文では人間の言語はポジティブ (Positive) であり、 machine 言語はラベルなしであり、トレーニング損失関数が改善されています。この改善により、さまざまな身体に対する検出器の分類パフォーマンスが大幅に向上しました。

アルゴリズムの詳細

従来の PU 学習設定では、2 分類モデルはポジティブなトレーニング サンプルとラベルのないトレーニング サンプルに基づいてのみ学習できます。一般的に使用される PU 学習方法は、PU 損失を次のように定式化して、負のサンプルに対応するバイナリ分類損失を推定することです。

このうち、 は陽性サンプルと陽性ラベルで計算した二値分類損失、 はすべてのラベルなしサンプルを陰性ラベルと仮定して計算した二値分類損失、 は陽性サンプルを陰性ラベルと仮定して計算した二値分類損失、 は以前の陽性サンプル確率は、すべての PU サンプルにおける陽性サンプルの推定割合です。従来の PU 学習では、通常、事前確率は固定ハイパーパラメータに設定されます。ただし、テキスト検出シナリオでは、検出器はさまざまな長さのさまざまなテキストを処理する必要があり、さまざまな長さのテキストの場合、サンプルと同じ長さのすべての PU サンプル間の陽性サンプルの推定割合も異なります。したがって、この研究では PU 損失を改善し、長さに敏感なマルチスケール PU (MPU) 損失関数を提案します。

具体的には、この研究では、短いテキストの検出をモデル化するための抽象的再帰モデルを提案します。従来の NLP モデルがシーケンスを処理する場合、通常は RNN、LSTM などのマルコフ連鎖構造を持ちます。このタイプの循環モデルのプロセスは、通常、徐々に反復的なプロセスとして理解できます。つまり、各トークン出力の予測は、前のトークンと前のシーケンスの予測結果を、このトークンの予測結果と変換およびマージすることによって取得されます。トークン。それは次のプロセスです:

この抽象モデルに基づいて事前確率を推定するには、モデルの出力が、特定の文が肯定的であるという確信度、つまり、それが発話サンプルであると判断される確率であると仮定する必要があります。人によって。各トークンの寄与サイズは文トークンの長さの反比例であり、それは正、つまりラベルなしであり、ラベルなしの確率は正である確率よりもはるかに大きいと想定されます。なぜなら、大規模モデルの語彙が徐々に人間の語彙に近づくにつれて、ほとんどの単語が AI と人間のコーパスの両方に出現するようになるからです。この単純化されたモデルと設定された正のトークン確率に基づいて、さまざまな入力条件下でのモデル出力の信頼度の合計期待値を見つけることによって、最終的な事前推定値が取得されます。

理論的な導出と実験により、事前確率はテキストの長さが増加するにつれて増加し、最終的には安定すると推定されます。テキストが長くなると、検出器がより多くの情報を取得できるようになり、テキストの「ソースの不確実性」が徐々に弱くなるため、この現象も予想されます。

さらに、MPU 損失はさまざまな長さのトレーニング コーパスに適応することに注意する必要があります。既存の学習データが明らかに同種であり、コーパスの大部分が長大なテキストで構成されている場合には、MPU 手法の効果を十分に発揮できません。トレーニングコーパスの長さをより多様にするために、この研究では文レベルでのマルチスケーリングモジュールも導入しています。このモジュールは、トレーニング コーパス内のいくつかの文をランダムにカバーし、元の順序を維持したまま残りの文を再編成します。トレーニング コーパスのマルチスケール操作後、トレーニング テキストの長さが大幅に強化され、AI テキスト検出器のトレーニングに PU 学習が最大限に活用されています。

さらに、MPU 損失はさまざまな長さのトレーニング コーパスに適応することに注意する必要があります。既存の学習データが明らかに同種であり、コーパスの大部分が長大なテキストで構成されている場合には、MPU 手法の効果を十分に発揮できません。トレーニングコーパスの長さをより多様にするために、この研究では文レベルでのマルチスケーリングモジュールも導入しています。このモジュールは、トレーニング コーパス内のいくつかの文をランダムにカバーし、元の順序を維持したまま残りの文を再編成します。トレーニング コーパスのマルチスケール操作後、トレーニング テキストの長さが大幅に強化され、AI テキスト検出器のトレーニングに PU 学習が最大限に活用されています。

上の表に示すように、著者は最初に、AI によって生成された短いコーパス データ セット Tweep-Fake に対する MPU 損失の影響をテストしました。このデータセットのコーパスはすべて Twitter 上の比較的短いセグメントです。また、著者は、従来の 2 つのカテゴリの損失を、従来の言語モデルの微調整に基づいた MPU 損失を含む最適化目標に置き換えます。改良された言語モデル検出器はより効果的で、他のベースライン アルゴリズムを上回ります。

著者はまた、chatGPT によって生成されたテキストをテストしました。従来の微調整によって取得された言語モデル検出器は、短い文ではあまりパフォーマンスが良くありませんでしたが、MPU メソッドを通じて同じ条件下でトレーニングされた検出器は、短い文では良好なパフォーマンスを示しました。 、完全なコーパスで大幅なパフォーマンスの向上を達成でき、F1 スコアが 1% 増加し、OpenAI や DetectGPT などの SOTA アルゴリズムを上回ります。

上の表に示すように、著者はアブレーション実験において各部位によってもたらされる効果の増加を観察しました。 MPU 損失により、長い材料と短い材料の分類効果が高まります。

著者は、従来の PU とマルチスケール PU (MPU) も比較しました。上の表から、MPU 効果がより優れており、AI マルチスケール テキスト検出のタスクによりよく適応できることがわかります。

要約

著者は、マルチスケール PU 学習に基づくソリューションを提案することで、テキスト検出器による短文認識の問題を解決しました。今後、AIGC 生成モデルの普及に伴い、この種のコンテンツの検出はますます重要になります。この研究は、AI テキスト検出の問題において確実な一歩を踏み出したものであり、AIGC コンテンツをより適切に制御し、AI によって生成されたコンテンツの悪用を防止するために、今後さらに同様の研究が行われることが期待されています。

以上がChatGPT詐欺を特定、その効果はOpenAIを超える:北京大学とファーウェイのAI生成検出器が登場の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

個人的なハッキングはかなり激しいクマになりますMay 11, 2025 am 11:09 AM

個人的なハッキングはかなり激しいクマになりますMay 11, 2025 am 11:09 AMサイバー攻撃が進化しています。 一般的なフィッシングメールの時代は終わりました。 サイバー犯罪の将来は超個人化されており、高度にターゲットを絞った攻撃を作成するために、容易に利用可能なオンラインデータとAIを活用しています。 あなたの仕事を知っている詐欺師を想像してください、あなたのf

教皇レオXIVは、AIが彼の名前の選択にどのように影響したかを明らかにしますMay 11, 2025 am 11:07 AM

教皇レオXIVは、AIが彼の名前の選択にどのように影響したかを明らかにしますMay 11, 2025 am 11:07 AM枢機of大学への彼の就任演説では、シカゴ生まれのロバート・フランシス・プレボスト、新たに選出された教皇レオ14世は、彼の同名の教皇レオXIIIの影響について議論しました。

初心者および専門家向けのFastapi -MCPチュートリアル-Analytics VidhyaMay 11, 2025 am 10:56 AM

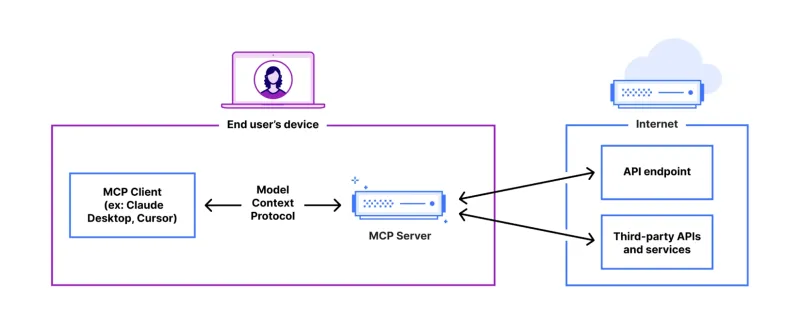

初心者および専門家向けのFastapi -MCPチュートリアル-Analytics VidhyaMay 11, 2025 am 10:56 AMこのチュートリアルでは、モデルコンテキストプロトコル(MCP)とFastAPIを使用して、大規模な言語モデル(LLM)と外部ツールを統合する方法を示しています。 FastAPIを使用して簡単なWebアプリケーションを構築し、それをMCPサーバーに変換し、Lを有効にします

DIA-1.6B TTS:最高のテキストからダイアログの生成モデル - 分析VidhyaMay 11, 2025 am 10:27 AM

DIA-1.6B TTS:最高のテキストからダイアログの生成モデル - 分析VidhyaMay 11, 2025 am 10:27 AMDIA-1.6Bを探索:資金がゼロの2人の学部生によって開発された画期的なテキストからスピーチモデル! この16億個のパラメーターモデルは、笑い声やくしゃみなどの非言語的手がかりを含む、非常に現実的なスピーチを生成します。この記事ガイド

AIがメンターシップをこれまで以上に意味のあるものにする3つの方法May 10, 2025 am 11:17 AM

AIがメンターシップをこれまで以上に意味のあるものにする3つの方法May 10, 2025 am 11:17 AM私は心から同意します。 私の成功は、メンターの指導に密接に関連しています。 特にビジネス管理に関する彼らの洞察は、私の信念と実践の基盤を形成しました。 この経験は、メンターへの私のコミットメントを強調しています

AIは、鉱業で新しい可能性を発掘しますMay 10, 2025 am 11:16 AM

AIは、鉱業で新しい可能性を発掘しますMay 10, 2025 am 11:16 AMAIはマイニング機器を強化しました 採掘操作環境は厳しく危険です。人工知能システムは、最も危険な環境から人間を排除し、人間の能力を高めることにより、全体的な効率とセキュリティを改善するのに役立ちます。人工知能は、マイニング操作で使用される自動運転トラック、ドリル、ローダーの電源にますます使用されています。 これらのAI搭載車両は、危険な環境で正確に動作し、それにより安全性と生産性が向上します。一部の企業は、大規模な鉱業作業のために自動鉱業車両を開発しています。 挑戦的な環境で動作する機器には、継続的なメンテナンスが必要です。ただし、メンテナンスは重要なデバイスをオフラインに保ち、リソースを消費する可能性があります。より正確なメンテナンスとは、高価で必要な機器の稼働時間が増加し、大幅なコスト削減を意味します。 AI駆動型

AIエージェントが25年で最大の職場革命を引き起こす理由May 10, 2025 am 11:15 AM

AIエージェントが25年で最大の職場革命を引き起こす理由May 10, 2025 am 11:15 AMSalesforceのCEOであるMarc Benioffは、AIエージェントが推進する記念碑的な職場革命、Salesforceとその顧客ベース内ですでに進行中の変革を予測しています。 彼は、従来の市場から、に焦点を当てた非常に大きな市場への移行を想定しています

ai hrは、aiの養子縁組が舞い上がるので私たちの世界を揺るがそうとしていますMay 10, 2025 am 11:14 AM

ai hrは、aiの養子縁組が舞い上がるので私たちの世界を揺るがそうとしていますMay 10, 2025 am 11:14 AMHRでのAIの台頭:ロボットの同僚との労働力をナビゲートする AIと人事(HR)への統合は、もはや未来の概念ではありません。急速に新しい現実になりつつあります。 このシフトは、人事の専門家と従業員の両方のDEMに影響を与えます

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

Dreamweaver Mac版

ビジュアル Web 開発ツール

MantisBT

Mantis は、製品の欠陥追跡を支援するために設計された、導入が簡単な Web ベースの欠陥追跡ツールです。 PHP、MySQL、Web サーバーが必要です。デモおよびホスティング サービスをチェックしてください。

SublimeText3 中国語版

中国語版、とても使いやすい

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!