ホームページ >テクノロジー周辺機器 >AI >テスラの自動運転技術ソリューションの詳細な分析

テスラの自動運転技術ソリューションの詳細な分析

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-05-17 08:55:052212ブラウズ

01 認識: リアルタイム 4D 自動運転シーンの構築

1. Tesla カメラのレイアウト

テスラのカメラの視野は車体の周囲 360 度をカバーでき、前方には 120 度の魚眼レンズと望遠レンズがあり、観察を強化します。

2. テスラ画像データの前処理

テスラは 36Hz 1280*960-12 ビットのオリジナル画像データを使用しますこれには、8 ビット ISP 後処理データのみと比較して 4 ビット多くの情報が含まれており、動的方向性は 16 倍に拡張されています。 Tesla がこれに対処する理由は 2 つあります:

1) ISP が自動フォーカス (AF)、自動露出 (AE)、自動ホワイト バランス (AWB)、デッド ピクセル補正 (DNS) を実行します。 、ハイダイナミックレンジイメージング(HDR)、色補正(CCM)など、これらは人間の目の視覚化のニーズを満たしますが、必ずしも自動運転のニーズを満たしているわけではありません。ルールベース ISP と比較して、ニューラル ネットワークはより強力な処理能力を備えており、ISP によるデータ損失を回避しながら、画像の元の情報をより有効に活用できます。

2) ISP の存在はデータの高速伝送に役立たず、画像のフレーム レートに影響を与えます。ネットワーク操作では元の信号を処理する方がはるかに高速です。

この方法は、従来の ISP のような専門知識をバイパスし、バックエンドの要求からネットワークを直接駆動して、より強力な ISP 機能を学習させます。これにより、暗い場所や低環境下でシステムを強化できます。人間の目の認識を超えた視界条件。この原則に基づいて、ネットワーク フィッティングに LIDAR とレーダーの生データを使用する方が良い方法となるはずです。

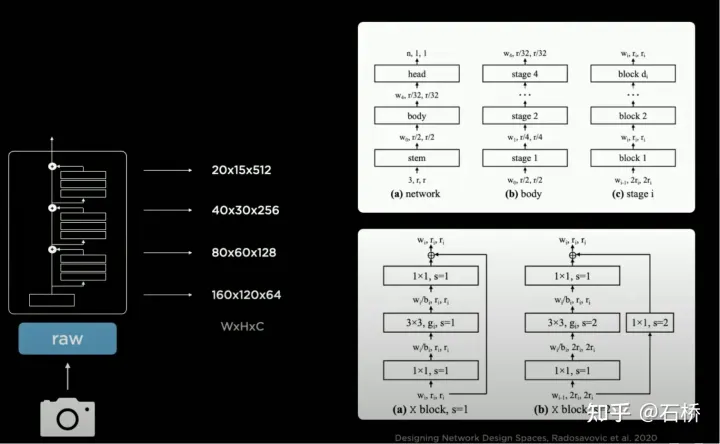

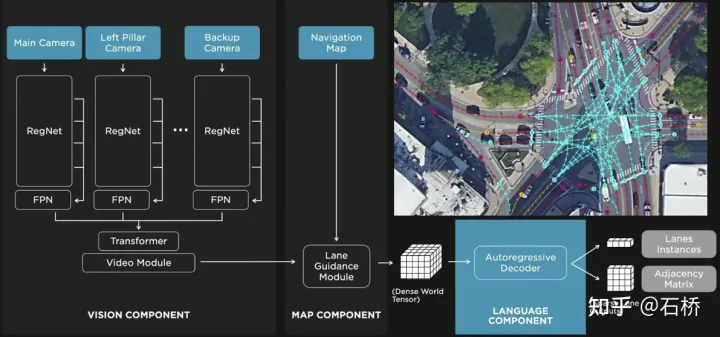

##3.バックボーン ネットワーク: ネットワーク設計スペースの設計

##RegNet

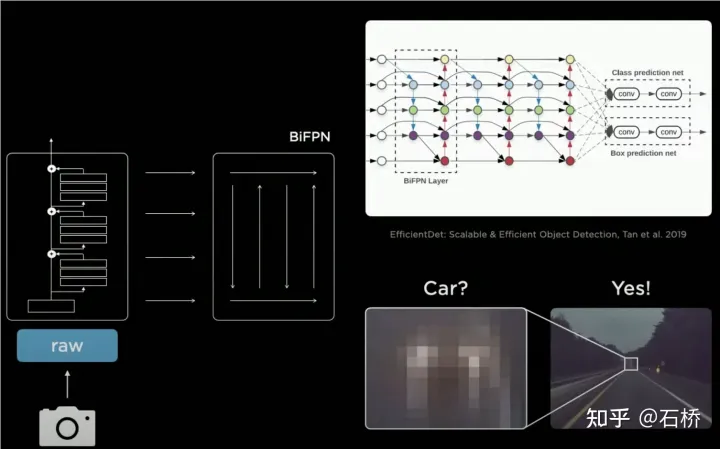

Tesla は、ResNet よりも高い抽象レベルを持つ RegNet を使用し、NAS 検索設計空間 (畳み込み、プーリング、その他のモジュール: 接続の組み合わせ /トレーニング評価/最適の選択) を解決します。新しいモジュールを作成するために、新しい設計空間パラダイムを作成し、新しい「ResNet」に適応するためのより多くのシナリオを探索できるため、ニューラル ネットワーク アーキテクチャを特別に調査および設計する必要がなくなります。もっと良いBackBoneが出てきたらこの部分は交換可能です。4. ネックワーク : EfficientDet: スケーラブルで効率的なオブジェクト検出

#BiFPN

- PAnet は FPN よりも正確です。その理由は次のとおりです。FPN のトップダウンの単一パス フローに基づいて、追加のボトムアップ パス フローが追加されるため、より高いパフォーマンスが得られます。パラメータと計算;

- BiFPN は、入力が 1 つだけ (最上層と最下層) でノードを削除します。ネットワークの目的は機能を融合することであるため、融合機能はありません。ノードを直接接続するだけです。

- BiFPN は入力を出力ノードに直接接続し、計算を増やすことなくより多くの機能を統合します。

- BiFPN は、基本構造を複数の層に積み重ね、高次元の機能を統合できます。

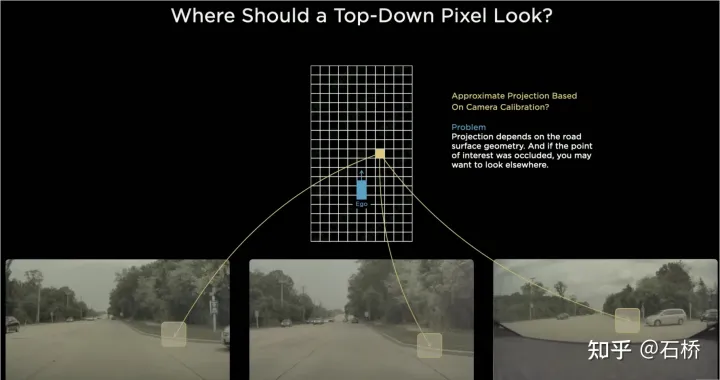

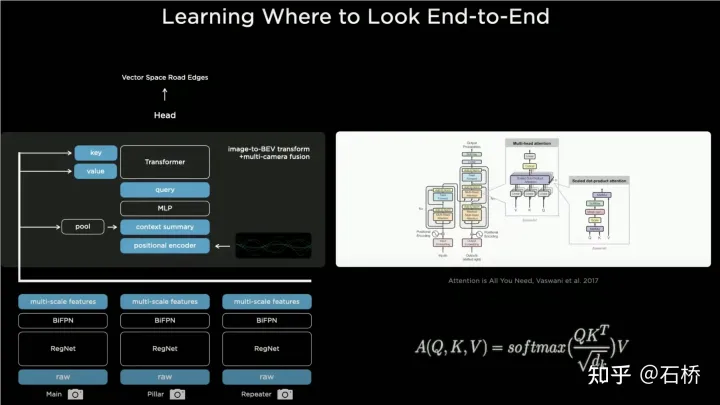

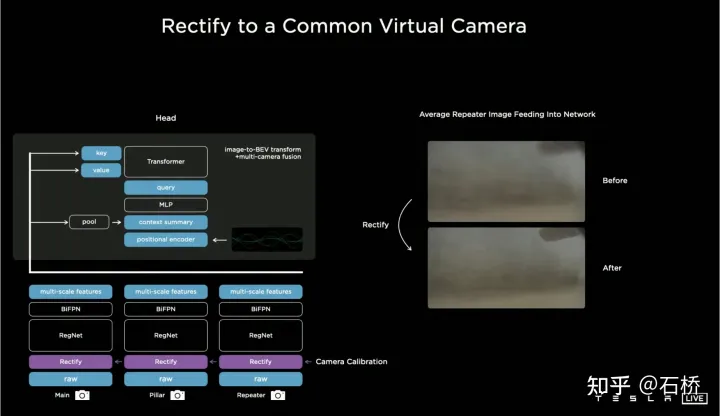

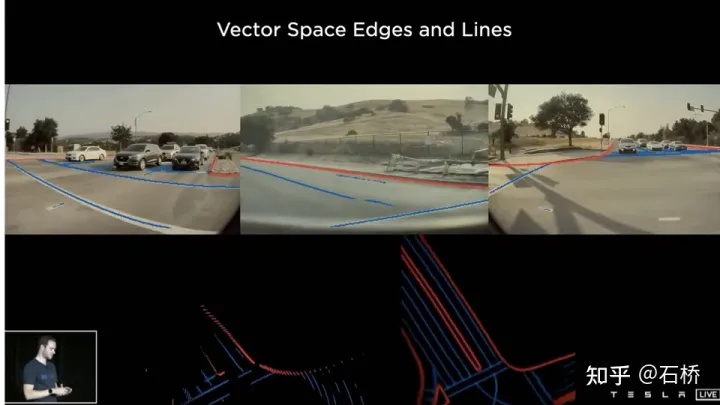

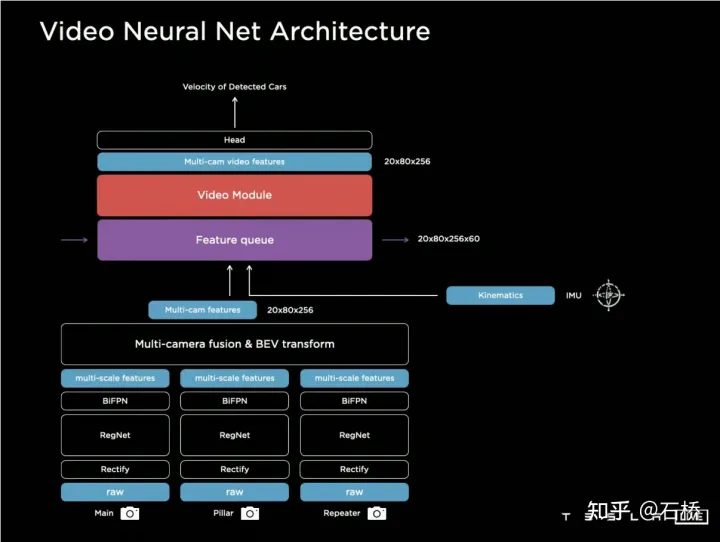

#5.BEV 融合 : FSD知覚の空間理解能力

BEV が登場する前、自動運転知覚の主流のソリューションはすべてカメラの 2D 画像空間に基づいていましたが、知覚の下流アプリケーションである意思決定や経路計画はすべてシステム内で実行されます。車両が位置する 2D BEV 空間規制と制御の間の認識と障壁が FSD の発展を妨げます。この障壁を取り除くためには、2D画像空間から2D自車基準系空間、すなわちBEV空間に知覚を再配置する必要がある。 従来の技術に基づく: 地面が平坦であり、 use Camera-auto 車両外部参照は、2D 画像空間を BEV 鳥瞰図空間である 2D 自車両空間に変換します。ここには明らかな欠陥があります。道路で上り下りがある場合、平面の仮定はもはや当てはまりません。 マルチカメラ エッジ ステッチの問題 視野角によるには制限があるため、IPM を使用して 2D 画像空間を 2D BEV 空間に変換する場合でも、複数のカメラ画像の BEV 空間スプライシングを解決する必要があります。これには実際には、高精度のマルチカメラ キャリブレーション アルゴリズムとオンライン リアルタイム補正アルゴリズムが必要です。要約すると、達成する必要があるのは、キャリブレーションと非平面仮定によって生じる変換の重複問題を解決しながら、マルチカメラ 2D 画像空間の特徴を BEV 空間にマッピングすることです。 Tesla の Transformer に基づく BEV レイヤーの実装: BEV_FUSION まず、各カメラは CNN バックボーン ネットワークと BiFPN を通じてマルチスケール フィーチャ レイヤーを抽出します。一方で、マルチスケール フィーチャ レイヤーは、一方、グローバル プーリング操作は、マルチスケールの特徴マップに対して実行され、グローバル記述ベクトル (つまり、図のコンテキスト サマリ) を取得し、同時にターゲット出力 BEV 空間がラスタライズされます。 、その後、各 BEV ラスターは位置コード化され、これらの位置コードはグローバル記述ベクトルと連結 (Concatenate) され、その後、MLP 層の層を使用して、Transformer に必要なクエリが取得されます。 クロス アテンション操作では、クエリのスケールによって最後の BEV レイヤー後の出力スケール (つまり、BEV グリッドのスケール) が決まり、キーと値はTransformer の原理に従って、Query と Key を使用して 2D 画像平面のピクセルを受け取る各 BEV ラスターの影響重みを確立し、それによって BEV と入力画像の間の関連付けを確立します。これらの重みを使用して、画像平面下の特徴によって得られた特徴に重み付けを行い、最終的に BEV 座標系での特徴マップを取得し、BEV 座標変換層の使命を完了します。その後、BEV での特徴マップに基づいて、成熟したセンシング機能ヘッドを使用して、BEV 空間で直接センシングできます。 BEV 空間での知覚結果は意思決定計画の座標系と統合されるため、知覚とその後のモジュールは BEV 変換を通じて密接にリンクされます。 ##キャリブレーション この方法を通じて、実際には、カメラと地面の形状の変化は、トレーニング プロセス中にニューラル ネットワーク モデルによってパラメーターに組み込まれます。ここでの問題の 1 つは、同じモデル パラメーターのセットを使用するさまざまな車のカメラの外部パラメーターにわずかな違いがあることです。Karparthy 氏は、テスラが AI デーに外部パラメーターの違いに対処するための方法を追加しました。収集された画像は、歪みの除去、回転、歪みの復元を通じて、仮想標準カメラ配置位置の同じセットに均一に変換されるため、異なる車両カメラの外部パラメータのわずかな違いが排除されます。 BEV の手法は、非常に効果的なマルチカメラ フュージョン フレームワークです。BEV のソリューションにより、元々は正確に関連付けることが困難であった、複数のカメラにまたがる近接した大きなターゲットのサイズ推定と追跡がはるかに簡単になりました。同時に、このソリューションにより、アルゴリズムが 1 つまたは複数のカメラの短期的な遮蔽や損失に対してより堅牢になります。つまり、BEV は複数のカメラの画像融合と結合の問題を解決し、堅牢性を高めます。 #マルチカメラの車線ラインと境界融合を解決する 障害物がより安定する #(PPT の観点から見ると、テスラの初期計画は主な A 前進となるはずです)カメラは知覚と車線の予測に使用されます。)

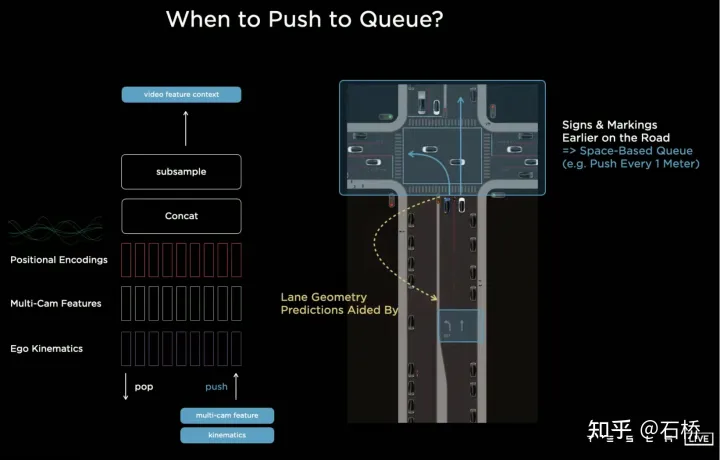

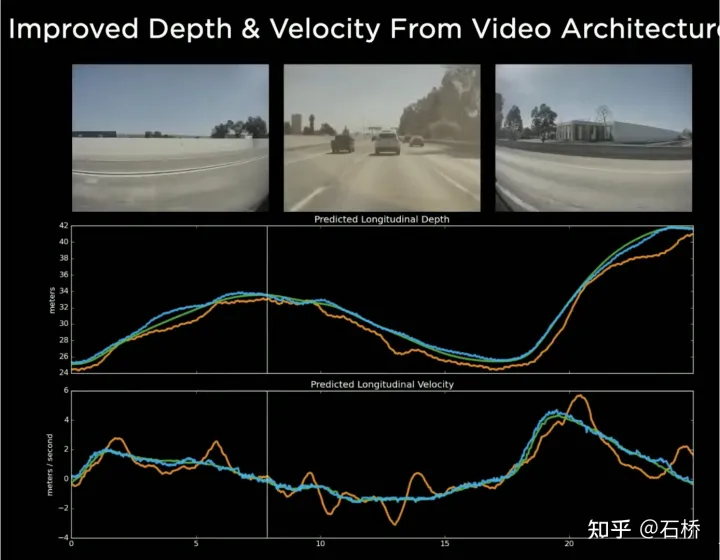

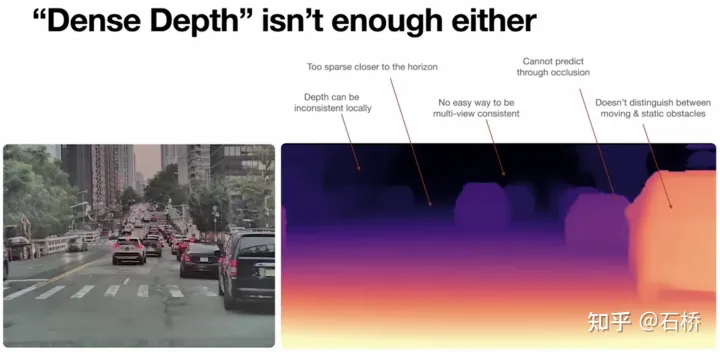

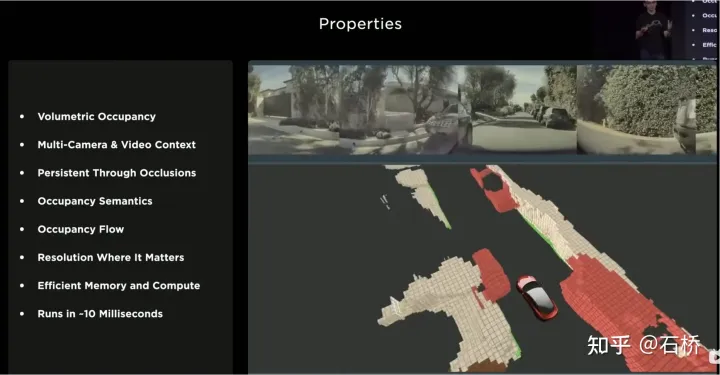

LSTM の特徴は、Hidden State が以前の N 瞬間の状態のエンコーディング (つまり、短期記憶) を可変長で保持でき、現在の瞬間がその状態のどの部分であるかを決定できることです。メモリ状態は入力と隠し状態を通じて必要とされ、使用されるか、どの部分を忘れる必要があるかなど。 Spatial RNN では、Hidden State は、BEV グリッド空間よりも大きい、(WxHxC) のサイズを持つ長方形のグリッド領域です (上図を参照、WxH は BEV サイズ 20x80 より大きくなります)。連続 BEV データが継続的に隠れ状態の大きな長方形領域を更新するように、隠れ状態グリッドのどの部分が影響を受けるか、それぞれの更新の位置は前方と後方の BEV 特徴の動きと一致します。自家用車。継続的な更新の後、次の図に示すように、ローカル マップに似た隠れ状態特徴マップが形成されます。 #逐次キューを使用すると、ニューラル ネットワークはフレーム間で連続的な知覚結果を取得できるようになります。結合後、FSD は視野内の死角と遮蔽に対処し、ローカル マップを選択的に読み書きする機能を持ちます。リアルタイムのローカル マップを構築するこの機能により、FSD は都市計画を実行できます。高精度地図に依存しないナビゲーション。 3D マップ機能だけでなく、予測などに使用できるローカル 4D シーン構築機能も備えています。 Occupancy が登場した後、Spatial RNN に基づくソリューションは前述のトランスフォーマー ソリューションに変更されたと一般に考えられていました。 2D の鳥瞰図実際の自動運転が直面する 3D シーンとの間にはまだギャップがあるため、特定のシナリオでは BEV2D 認識が失敗する状況が存在するはずです。 2021年にはテスラが深層ビルを構築できるようになるため、2Dから3Dになるのは時間の問題であり、2022年にはBEVネットワークを高さ方向にさらに拡張したOccupancy Networkが登場する予定です。 BEV 座標系をダウンさせる 2D ラスター位置エンコーディングによって生成されたクエリは、3D ラスター位置エンコーディングによって生成されたクエリにアップグレードされ、BEV フィーチャは占有フィーチャに置き換えられます。 CVPR2022 で、Ashork は、画像ベースの深度推定の代わりに占有特徴を使用する理由を次のように述べました: ##1) 距離の推定は近くでは問題ありませんが、遠方の距離では一貫性がなく、地面に近づくほど奥行き値のポイントが少なくなります (これは画像の結像原理によるもので、20m 離れているためです)。ピクセルで表される距離は 30cm を超える場合があります)、このデータをその後の計画プロセスで使用するのは困難です。 2) ディープ ネットワークは回帰に基づいて構築されており、オクルージョンによる予測が難しいため、境界での予測が難しく、車両から背景にスムーズに移行する可能性があります。 占有を使用する利点は次のとおりです: 占有の利点 1) 統合されたボクセルが BEV 空間で生成され、任意のボクセルの占有確率を予測できます。 2) すべてのビデオカメラはフローを取得し、統合されています (ライダーとカメラの融合の問題はなく、情報の次元がライダーより高い) 3) 遮蔽されたオブジェクトの状態を予測できるリアルタイム (占有率のダイナミクス。記述能力は 3D から 4D への移行です) 4) 対応する意味カテゴリをボクセルごとに生成できます (画像認識能力ははるかに強力です) LIDAR より) カテゴリを認識しなくても移動オブジェクトを処理できます 5) 各ボクセルの運動状態を予測し、ランダムな運動をモデル化できます。 6) 各位置の解像度を調整できます (つまり、 BEV スペース ズーム機能) ##7) Tesla のハードウェアのおかげで、Occupancy には効率的なストレージとコンピューティングの利点があります 8) 計算は次の時間内で完了できます10 ミリ秒、処理周波数は非常に高くなります (36 Hz の画像出力能力は、10 Hz の LIDAR 周波数よりもすでに強力です) バウンディング ボックスと比較した占有ソリューションの利点認識ソリューション 理由は次のとおりです: は、固定の境界ボックスを持たず、自由に形状を変更し、自由に移動できる未知のオブジェクトを記述できます。これにより、障害物の記述の粒度が向上します。ボックスからボクセルまでの粒度を調整することで、知覚の問題や多くのロングテール問題を解決できます。 Occupancy の全体的な計画を見てみましょう: ##Occupancy Network 2)画像特徴: RegNet BiFPN はマルチスケール画像特徴を抽出します 3) 空間的注意: 3D 空間位置を使用した空間クエリによる 2D 画像特徴の注意ベースのマルチカメラ融合 実装計画 2: 位置埋め込みを使用して暗黙的マッピングを実行します。つまり、カメラの内部パラメータと外部パラメータ、ピクセル座標などの 2D 特徴マップの各位置に適切な位置埋め込みを追加します。など。その後、モデルに 2D 特徴と 3D 特徴の間の対応関係をそれ自体で学習させます。 4) 時間的アライメント: 軌跡情報を使用して、各フレームの 3D 占有特徴を時系列でつなぎ合わせます。空間チャネル次元。時間の経過とともに重みが減衰し、結合された特徴がデコンボリューション モジュールに入力されて解像度が向上します。 5) ボリューム出力: 占有と占有フローを出力します。固定サイズ ラスター 6) クエリ可能な出力: 暗黙的なクエリ可能な MLP デコーダーは、任意の座標値 (x、y、z) を入力して、より高解像度の連続ボクセル セマンティクスを取得するように設計されています。および占有フロー情報は、モデル解像度の制限を打ち破ります。 7) 3 次元のジオメトリとセマンティクスを備えた走行可能エリアの舗装を生成します。これは、坂道や曲線道路での制御に有益です。

8) NeRF 状態: Nerf はシーンの幾何学的構造を構築し、あらゆる視点から画像を生成し、高解像度の実際のシーンを復元できます。 アップグレードまたはナーフとの交換が可能であれば、実際のシーンを復元する機能があり、このシーン復元機能は過去、現在、未来になります。これは、テスラの技術ソリューションが追求する 4D シーンの自動運転を大幅に補完し、改善するものとなるはずです。 8.FSD 車線ニューラル ネットワーク: 車線のトポロジー接続関係の予測

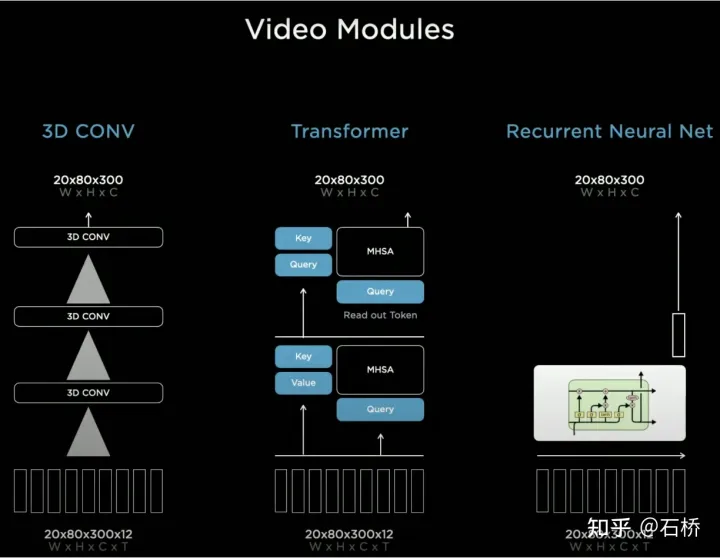

1) 車線誘導モジュール: ナビゲーション マップ内の道路の幾何学的および位相関係、車線レベル、量、幅、属性情報を使用し、この情報を占有機能と統合して、高密度ワールド テンソルをエンコードして生成します。トポロジ関係を確立するモジュールに対して、ビデオ ストリームの密な特徴がシーケンス生成パラダイムを通じて解析され、疎な道路トポロジ情報 (車線ノードの車線セグメントと隣接する接続関係) が取得されます。 2) 言語コンポーネント: 車線関連情報には、車線ノードの位置、属性 (始点、中間点、終点など)、分岐点、合流点、車線スプラインが含まれます。ジオメトリ パラメーターは、言語モデルの単語トークンに似たコードにエンコードされ、タイミング処理メソッドを使用して処理されます。具体的なプロセスは次のとおりです。 レーン プロセスの言語 レーンの言語 最終的に、レーンの言語は、グラフ内のトポロジー的な接続関係を表します。 障害物の知覚FSD のオブジェクト認識は 2 段階の方法です。第 1 段階では、3D 空間内の障害物の位置が占有率から特定されます。第 2 段階では、これらの 3D オブジェクトのテンソルを連結して、運動学的情報 (自己など) をエンコードします。 -車両の動き、ターゲットの走行車線、信号機、交通信号など)を追跡し、軌道予測、オブジェクトモデリング、歩行者の姿勢予測などのヘッドにアクセスします。複雑なセンシング ヘッドを限られた ROI エリアに集中させることで、処理遅延が軽減されます。上の図からわかるように、ビデオ モジュールには 2 つのステップがあり、それぞれ自車と他車の予測を行います。 ここに質問を残してください: 上の図の 2 つのビデオ モジュールの違いは何ですか?効率に問題はありませんか?

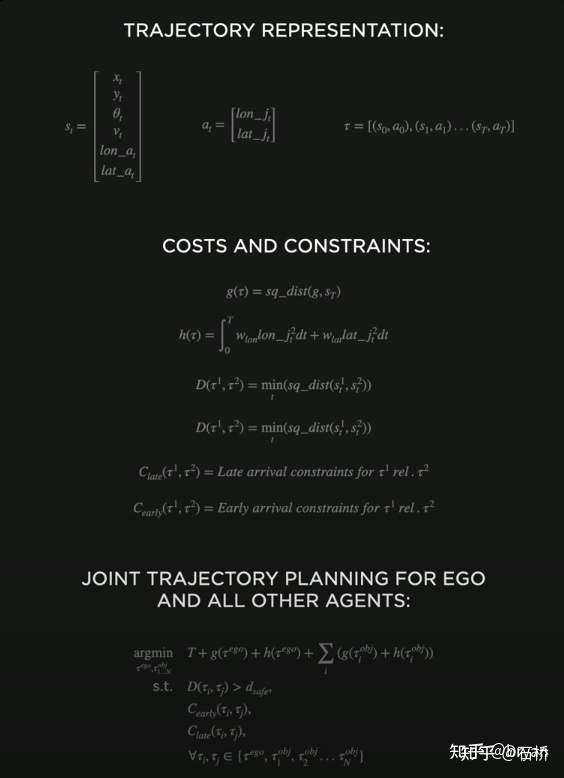

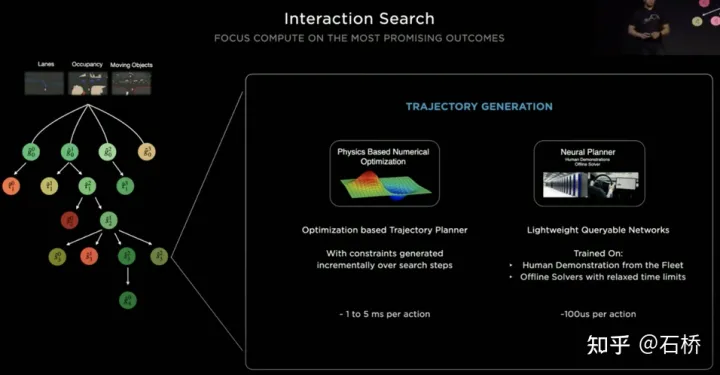

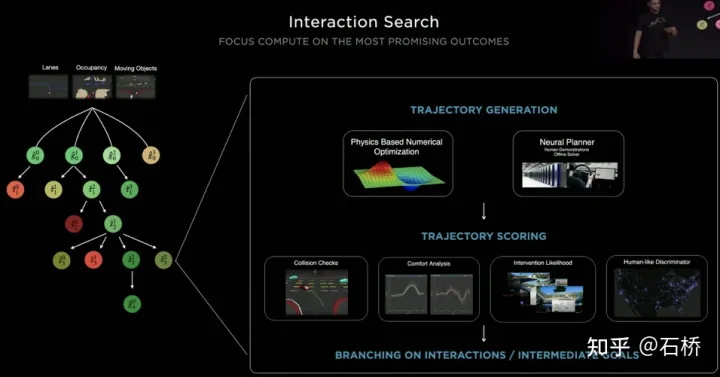

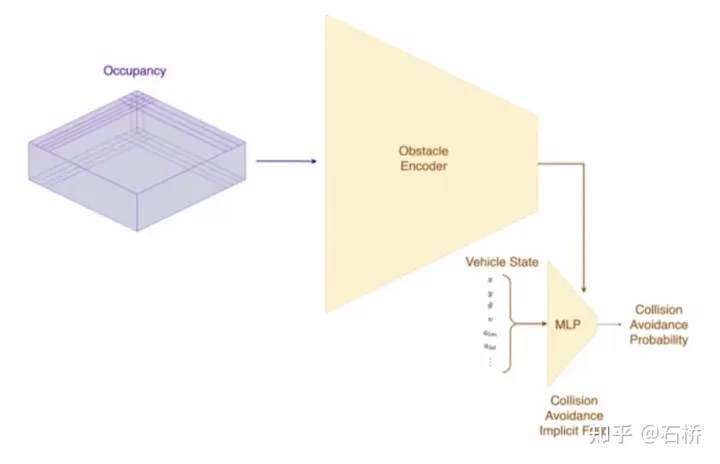

決定- 上記のシナリオの作成と計画 問題は次のとおりです。 前者との対話の決定は、後者との対話戦略に直接影響します。ここで選択される最終的な解決策は、他の交通参加者の移動を妨げないようにすることです。 意思決定と計画のプロセス Tesla は、この目標を達成するために「対話型検索」を使用しています。一連の可能な運動軌跡が並行して検索され、対応する状態空間には車両、障害物、走行可能エリア、車線、信号機などが含まれます。解決空間では、他のトラフィックとのインタラクティブな意思決定に参加した後に分岐する一連のターゲット運動候補軌道を使用し、その後、漸進的な意思決定と計画を進め、最終的に最適な軌道を選択します。上図: 1) 道路トポロジまたは人間の運転データに基づいて、ゴール地点またはその確率分布 (ビッグデータ軌跡) をアプリオリに取得します 2) 目標点に基づいて候補軌道を生成 (最適化アルゴリズム ニューラル ネットワーク) 3) 候補軌道に沿ったロールアウトとインタラクティブな意思決定、パスの再計画、評価各パスのリスクとスコア、最適なパスの探索に優先順位を付け、ゴール ポイントを知る 意思決定計画全体の最適化表現: 意思決定計画の最適化表現 軽量計画軌道クエリ ネットワーク Tesla 新しい意思決定制約が増分的に継続的に追加され、より少ない制約の下での最適解が初期値として使用されて解決が続けられます。より複雑な最適化問題を解決し、最終的に最適解が得られます。ただし、多くの可能な分岐が存在するため、意思決定と計画のプロセス全体が非常に効率的である必要があります。従来の最適化アルゴリズムに基づくプランナーの各意思決定計画には 1 ~ 5 ミリ秒かかります。高密度の交通参加者がいます。 Tesla が使用する Neural Planner は軽量ネットワークであり、クエリ プランニングの軌道は、Tesla フリートの人間ドライバーの運転データと、時間制約のないオフライン条件下で計画されたグローバル最適パスの真の値を使用してトレーニングされ、各意思決定が行われます。計画には 100 秒しかかかりません。 #計画決定の評価 各決定後にクエリされるクエリの数各候補軌道を評価する必要があります。評価は、衝突チェック、快適性分析、乗っ取りの可能性、人物との類似性などの仕様に基づいて行われます。これは、検索ブランチを枝刈りし、決定木全体が大きくなりすぎることを避けるのに役立ちます。計算能力は最も可能性の高い分岐に集中します。テスラは、このソリューションはオクルージョンシーンにも適用可能であり、プランニングプロセスではオクルージョンされたオブジェクトの動きの状態が考慮され、「ゴースト」を追加してプランニングが実行されると強調しました。 ゴースト オクルージョン シーン CVPR での衝突回避のためのネットワーク プロセスと対応する計画についても共有しました。プロセスについては詳しく説明しません。 衝突回避ネットワーク

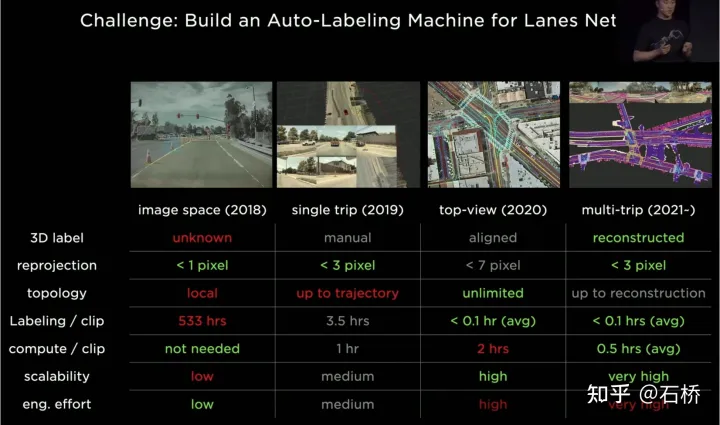

フェーズ 1 (2018): 純粋に手動による 2 次元画像注釈のみがあり、非常に非効率です フェーズ 2 (2019):最初に 3D ラベルが表示されますが、これは単一の手動プロセスです フェーズ 3 (2020): ラベル付けと再投影に BEV スペースを使用します 精度は大幅に低下します フェーズ 4 (2021): アノテーションに複数の再構成が使用され、精度、効率、トポロジー関係が非常に高いレベルに達しました ##テスラの自動ラベル付けシステムは 500 万時間の手作業を置き換えることができます。手動による検査と漏れの修理に必要なのは、非常に小さな部品 ( このマルチトラベル軌道再構築ソリューションのプロセスは次のとおりです。 (オフラインのセマンティック スラム システムと同様)

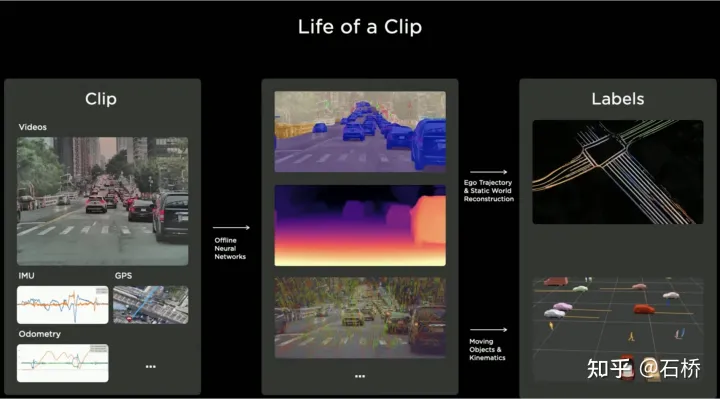

ステップ 1: VIO が高精度の軌道を生成します。ビデオ ストリーム、IMU、オドメトリをニューラル ネットワークにフィードし、点、線、地面、セグメンテーションの特徴を推論して抽出し、マルチカメラ VIO を使用して BEV 空間での追跡と最適化を行い、100Hz 6dof 軌道と 3dof 構造を出力します。カメラのキャリブレーション値も出力できます。再構成された軌道の精度は 1.3cm/m、0.45rad/m とあまり高くありません。すべての FSD はこのプロセスを実行して、特定の旅行の前処理された軌跡と構造情報を取得できます。 (ビデオを見ると、vio は点の特徴のみを明示的に使用し、線と面の特徴を暗黙的に使用しているように感じます。)

#ステップ 2: マルチトリップ軌跡の再構築。異なる車両からの複数の再構成データは、大まかな位置合わせ -> 特徴マッチング -> 結合最適化 -> 路面改良のためにグループ化され、その後、手動介入が実行されて最終的にラベリング結果を検証および確認されます。ここでは, 結合最適化後に路面最適化も実行した. 視覚的再構成の誤差は比較的大きいと推測される. 全体最適化後, ローカル道路には階層的な重複問題が存在する. この部分の誤差を除去するには,グローバル最適化の割り当てミス、路面最適化が追加されました。アルゴリズム ロジックの観点から見ると、自動運転の要件はどこでも運転できることであるため、グローバルな最適化に続いてローカルな最適化が必須となります。プロセス全体がクラスター上で並列化されます。

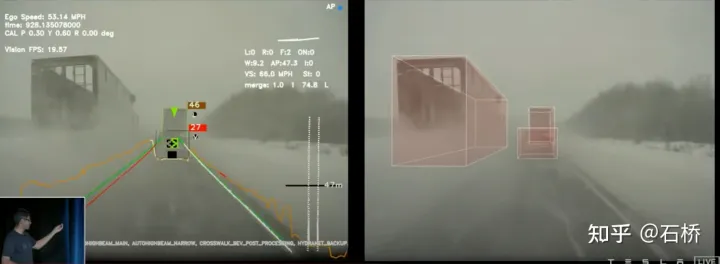

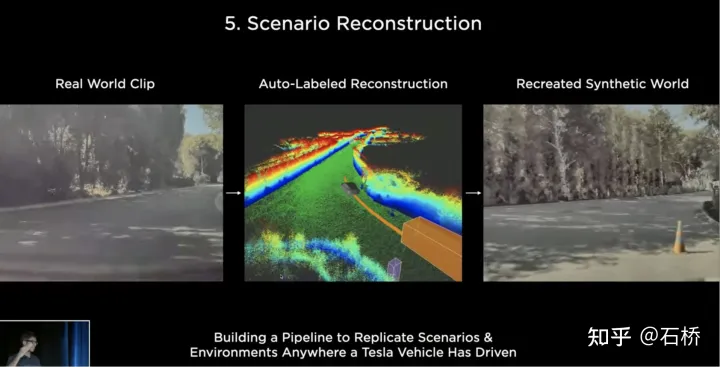

ステップ 3: 新しい軌跡データに自動的にラベルを付けます。事前構築マップ上では、複数の軌跡再構成と同じ再構成プロセスが新しい運転軌跡データに対して実行されるため、位置合わせされた新しい軌跡データは、事前構築マップから意味論的な注釈を自動的に取得できます。これは実際には、セマンティック タグを取得するための再配置のプロセスです。この自動ラベル付けは、実際には、車線境界線や道路境界線などの静的オブジェクトのみを自動的にラベル付けできます。知覚モデルを通じて、車線境界線などの意味カテゴリを実際に取得できますが、過酷なシナリオでは整合性や誤認識の問題が発生しますが、これらの問題は、この自動アノテーションによって解決できます。ただし、移動する車両や歩行者などの動的障害物には適さない可能性があるという欠点があります。使用シナリオは次のとおりです: 自動ラベル付けの使用シナリオ Tes La が表示する画像の多くには、ぼやけや汚れのオクルージョンがあるという特徴がありますが、知覚結果には重大な影響を与えません。通常の使用では、車両のカメラレンズは簡単に汚れてしまいますが、この自動ラベル付けにより、テスラの認識は非常に堅牢になり、カメラのメンテナンスコストが削減されます。 #自動ラベル付けは動的車両には適用されません 2021 年の振り返りAI Day は、上記の再構成によって静的な世界が構築されるが、車線や車線の境界線だけでなく、車両や建物も構築されることが示されています。 ##3D 再構築

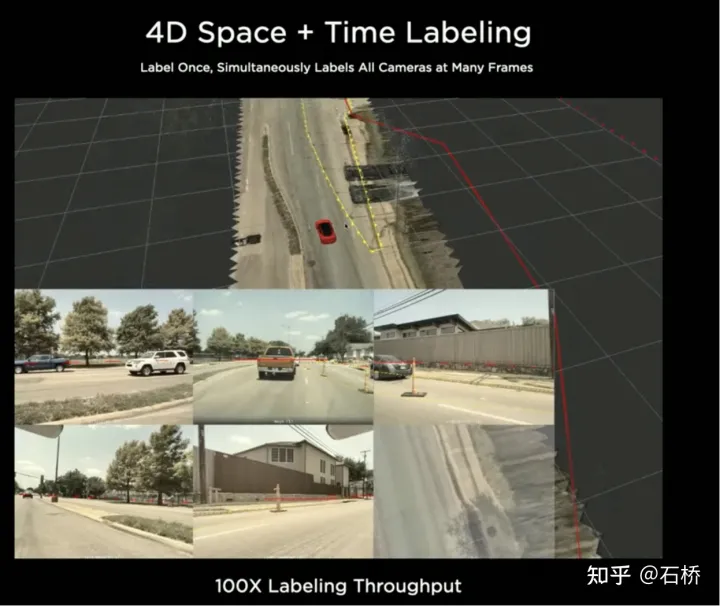

BEV 空間のアノテーションが完了すると、そのアノテーションは複数のカメラの画像にマッピングされるため、4D 空間の 1 つのアノテーションを 2D の複数のフレームに適用できます。 シーンの再構成に関しては、現在の再構成能力と精度ではまだテスラのエンジニアの期待を満たしていない可能性がありますが、最終的な目標は、テスラ車が走行したすべてのシーンを真に復元および再構成することです。シーン、およびこれらのシーンの条件を実際に変更して新しい実際のシーンを生成する機能が最終的な目標です。

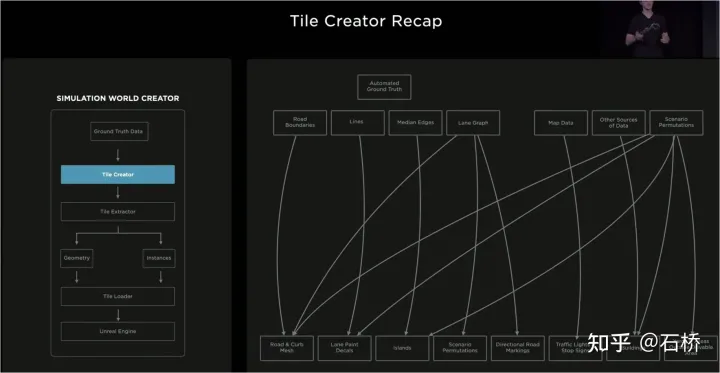

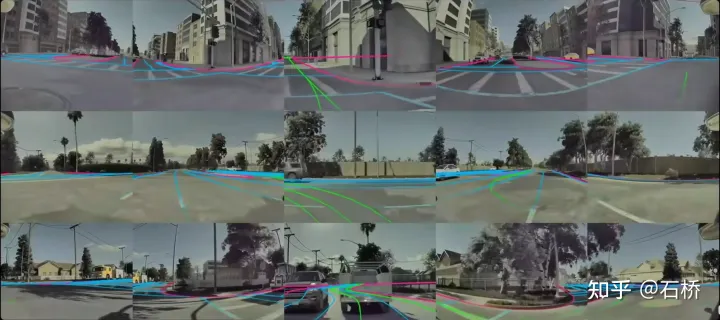

現実世界を復元 04 シーンシミュレーション: 実際の道路情報に基づいた自動運転シナリオの作成 ##シミュレーションは完全に正しいラベルを取得できます 再構成に基づいて構築される現実のシーンは、データやアルゴリズムなどによって制限されており、現状では大規模に実装することは難しく、長時間を要します。上の写真は2週間かかります。ただし、自動運転の実装はさまざまなシナリオでのトレーニングとテストに依存しているため、テスラは自動運転シナリオをシミュレートするシミュレーション システムを構築しました。このシステムは現実のシナリオを真にシミュレートすることはできませんが、利点は、上記の実際の一般的な再構成ソリューションよりも 1,000 倍高速であることです。現実では取得またはラベル付けが困難なデータを提供でき、依然として非常に意味のあるデータを提供できます。自動運転の訓練。 シミュレーションのアーキテクチャ このシミュレータのアーキテクチャは次のとおりです。上の図のように、シーン作成プロセスでは次の手順が必要です。 ステップ 1: シミュレーション ワールドに道路を広げ、境界ラベルを使用してエンティティ道路メッシュを生成します。それを道路トポロジ関係に再度関連付けます。 ステップ 2: 道路表面上の車線の境界線と幾何学的記述要素を車線セグメントに投影し、車線の詳細を構築します ステップ 3 ステップ: 道路の中央境界領域に中央車線分離領域を生成し、それを埋める植物と交通標識をランダムに生成します。道路境界の外側では、ランダム ヒューリスティックを使用します。一連の建物、樹木、交通標識などを生成するメソッドです。 ステップ 4: 地図から信号機または一時停止標識の位置を取得します。番号も取得できます。車線の数、道路名など。 ステップ 5: 車線マップを使用して車線の位置を取得します。トポロジ関係を取得し、運転方向 (左折および右折標識) と補助マーカーを生成します。 #ステップ 6: 車線マップ自体を使用して、車線の隣接関係やその他の有用な情報を決定します ステップ 7: ランダムな交通流の組み合わせに基づいて生成します車線関係について 上記のプロセスでは、シミュレーション パラメーターを変更して、車線ナビゲーション マップの真の値のセットに基づいて変更を生成し、複数の組み合わせシナリオを生成できます。さらに、トレーニングのニーズに応じて、真の値の一部の属性を変更して、トレーニングの目的を達成するための新しいシナリオを作成することもできます。 #データはタイル ストレージに分割されます タイル粒度に基づいて構築された世界

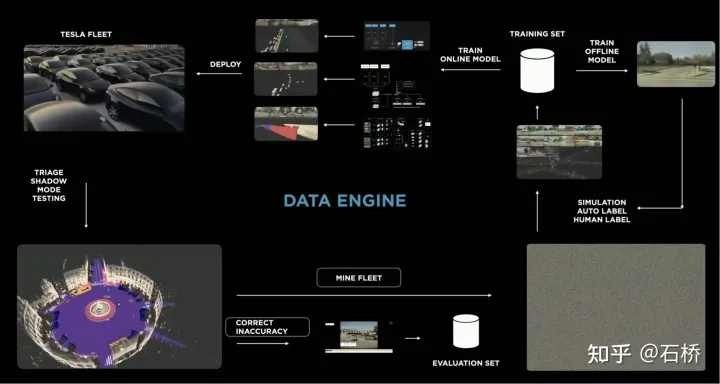

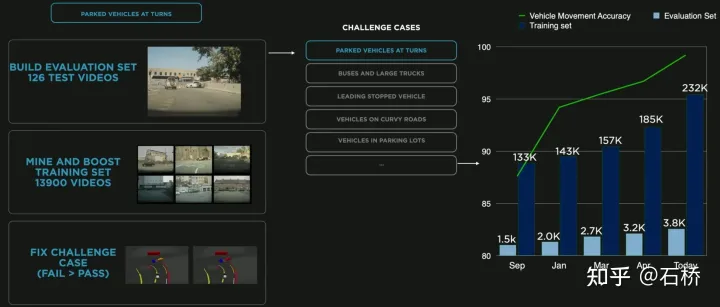

実感: 自動運転にとってかけがえのない地図情報とは? このシミュレーション構築プロセスから、その答えが見えてきます。 #05 データ エンジン: マイニングのコーナーケース データ データ エンジンは、シャドウ モードからモデルによって誤って判断されたデータをマイニングし、それを呼び出し、自動アノテーション ツールを使用してラベルを修正し、それをトレーニングとテスト セットは、ネットワークを継続的に最適化できます。このプロセスはデータ閉ループのキー ノードであり、コーナー ケースのサンプル データを生成し続けます。 彎道停車的資料探勘 上圖是彎道停車資料探勘對模型提升的案例,隨著資料源源不絕的加入到訓練中,準確率指標持續提升。

7.占有ネットワーク: BEV は 2D から 3D へ

車線の境界線をセグメント化して識別するだけでは十分ではありません。車線間のトポロジー的な接続関係を取得する推論も必要であり、軌道計画に使用できます。

9. オブジェクトの知覚: 他の交通参加者の知覚と予測

1. 複雑なシナリオ: 高頻度で多様なトラフィック参加者との対話計画

交差点での無防備な左折の意思決定と計画のシナリオ

2. 従来の最適化手法: [ジョイント複数オブジェクト軌道計画]: 複数オブジェクト MPC

3. インタラクティブなツリー検索: 並列パスの計画と評価枝刈り

##03 シーンの再構成と自動アノテーション

自動ラベル付けシステム

自動ラベル付けシステム 続きトリップ軌跡の再構築

続きトリップ軌跡の再構築 粗調整

粗調整

##4D 空間のラベル付け

##4D 空間のラベル付け

#シーン シミュレーション

データは終了しました-ループ処理

データは終了しました-ループ処理

以上がテスラの自動運転技術ソリューションの詳細な分析の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。