ChatGPT は急速に世界中に「普及」し、間違いなく人工知能の分野で注目を集める「スター製品」になりました。学術詐欺、ハッカー兵器の作成、ユーザーの漏洩など、機密性の高いチャット情報や一連のネガティブなニュース。この時点で、社会はChatGPTのような人工知能テクノロジーを再検討し始めています。

これまで産業分野で活躍してきたインテリジェントロボットと比較すると、人間の代わりにできるのは複雑で機械的で危険な肉体労働だけです。 、ChatGPT人工知能に似ています インテリジェントテクノロジーは、より強力な対話性、柔軟性、優れた「独立した思考能力」を備えており、人工知能の分野に対する社会の理解を再形成しました。現在、テクノロジー大手がリリースした人工知能製品は、執筆、プログラミング、絵画などのさまざまな種類の産業に統合され、新たな技術変化を引き起こしています。

Chat GPT のような人工知能テクノロジーが完全に開発されれば、社会に十分に貢献し、人類に利益をもたらすことができることは疑いの余地がありません。同時に、Chat GPT 人工知能テクノロジーは「諸刃の剣」でもあり、そのセキュリティ上の問題、コンプライアンス上の問題、社会人材の仕事配分への影響が多くの業界リーダーや国の注目を集めています。

ChatGPTに類似した人工知能の研究開発の検討を求める著名人も多数

#ChatGPTに類似した人工知能技術が社会全体を巻き起こすという「幻想」に浸るとき、第 4 次産業革命の影響を受け、テクノロジー コミュニティの多くの偉い人たちが相反する意見を出し、ChatGPT のような人工知能テクノロジーの急速な発展に対して懸念を表明しました。 バフェット氏は、人工知能技術が社会に有益であるかどうかについて疑問を表明しました。最近、投資業界のゴッドファーザーであるバフェット氏は、ChatGPT に似た人工知能の急速な発展についての考えを語りました。メディアとのインタビュー。バフェット氏は記者団に対し、人工知能技術が技術的能力の点で確かに信じられないほどの進歩を遂げていることに疑いの余地はないが、社会全体への影響を考慮すると、人工知能技術の開発が進んでいることを裏付ける大規模な実験結果は現時点ではないと述べた。知能は人類にとって有益であり、この観点から、人工知能の開発は慎重かつ合理的でなければなりません。 バフェット氏の懸念は無理からぬものではありません。ChatGPT の急速な普及により、その背後にあるセキュリティ、コンプライアンス、その他の問題が隠蔽されてきました。人間がこの種のテクノロジーを直接経験したのは、それが先進的で効率的であるということだけです。彼らはその潜在的な脅威を理解していません。

イタリアはChatGPTのセキュリティ問題に対して「第一弾」を発射した。

10 日以上前、イタリア政府は、OpenAI がイタリアのユーザーの大量の個人データを違法に収集し、ユーザーの年齢を確認するメカニズムを確立していなかったという理由で、イタリアでの Chat GPT の運営を禁止しました。 ChatGPT ユーザーは、未成年者が違法なマテリアルにアクセスするのを防ぎます。数日間のバッファリングの後、イタリアのデータ保護機関は若干の譲歩をし、一連の要件を OpenAI に提案し、それが満たされればイタリアは ChatGPT の国内での運営継続を許可することになる。

現時点で、イタリアは ChatGPT セキュリティ コンプライアンス問題に対して「最初の攻撃」を開始しました。

イタリアが実施したChatGPTのセキュリティ対策は欧州諸国の注目を集めており、現在、欧州諸国はChatGPTと同様の人工知能技術に対して厳しい制限措置を講じる必要があるか検討している。その中で、スペインのデータ保護庁は、EUプライバシー規制当局に対し、ChatGPTの使用に関するプライバシーコンプライアンス問題を評価するよう要請した。

その直後、ドイツの規制当局もChatGPTの使用禁止を発表し、フランス、アイルランド、スペインなどの欧州諸国もAIチャットボットの監督強化を検討し始めた。

米国は EU を厳しくフォローし、人工知能の規制を計画している

イタリアは一石二鳥で ChatGPT の監督を強化したが、これは EU 諸国の人工知能に対する懸念を引き起こしただけではない. 心配は海の向こうの米国にも影響を及ぼします。

アメリカ現地時間の4月11日、「ウォール・ストリート・ジャーナル」は突然、ChatGPTなどの人工知能技術がもたらす安全保障上の脅威をアメリカ社会が懸念しているため、バイデン政権が政権を交代したとのニュースを報じた。そうしたツールを制御する必要があるかどうかを検討し始めています。

これを受けて、米国商務省は4月11日、関連する説明責任措置について正式に意見を求めた(意見募集期間は、潜在的なリスクを伴う新しい人工知能モデルのリリースを含めて60日間である)。この動きは、米国における人工知能技術の潜在的な規制の第一歩とみなされています。

ChatGPT のような人工知能技術の開発を規制するルールを早急に定める必要性について、米国商務省傘下の機関である国家電気通信情報局の局長、アラン・デイビッドソン氏は次のように指摘しました。人工知能技術は初期段階の「先進」にすぎず、政府はこの技術を利用して犯罪活動を行う潜在的な犯罪者を考慮する必要があるため、必要な境界線を設定する必要があります。

中国政府は人工知能分野の管理措置を発動しました

米国だけでなく我が国も人間知能分野の研究開発を強化し始めています。中国サイバースペース局は4月11日、生成人工知能サービスの健全な発展と標準化された適用を促進することを理由に、「生成人工知能サービスの管理措置(コメント草案)」(以下、「管理措置」という)を発表した。インテリジェンス技術。 「管理措置」には計21項目が含まれており、このうち「生成型人工知能」には、アルゴリズムやモデル、ルールに基づいて文字、画像、音声、動画、コードなどのコンテンツを生成する技術が含まれるという。

「行政措置」は、人工知能技術の応用によって生成された情報に対する責任の分担を制限し、生成型人工知能製品を使用してチャットやテキストなどのサービスを提供する組織および個人が、画像および音声の生成 (プログラマブル インターフェイスやその他の方法の提供を含む) により、他者が独自にテキスト、画像、音声などを生成できるようになり、製品によって生成されたコンテンツの製作者が責任を負います。に関与し、個人情報処理者の法的責任を負い、個人情報保護義務を果たします。

さらに、人工知能製品の製造業者も要件を提示しており、「行政措置」では、製品を市場に投入する前に、「安全性評価に関する規制」に従って国家に報告する必要があると規定されています。サイバーセキュリティ・情報化部門は、「インターネット向けアルゴリズム勧告の管理に関する規則」に従って、セキュリティ評価を申請し、アルゴリズムの申請、変更、取り消しの申請手続きを実行するものとします。情報サービス」。

ChatGPT のような人工知能製品について社会レベルで話すとき、彼らはメーカーが人工知能製品をトレーニングするために使用するデータについてより懸念しています。この点は「管理措置」でも強調されており、次のように明確に指摘されています。生成型人工知能向けのスマート製品の事前トレーニングおよび最適化されたトレーニング データは、次の要件を満たす必要があります。

- (1) 「人民サイバーセキュリティ法」などの法令の要件を満たす必要があります。中華民国」;

- (2) ) 知的財産権を侵害する内容は含まれていません;

- (3) データに個人情報が含まれる場合、個人情報主体の同意が必要です法律および行政規制に準拠するその他の状況;

- (4) ) データの信頼性、正確性、客観性および多様性を確保できる;

- (5) その他の規制要件生成人工知能サービスに関する国家サイバースペース部門。

最後に、「管理措置」では、運用中に発見され、本措置の要件を満たさないユーザーによって報告された生成コンテンツについては、コンテンツ フィルタリングなどの措置を講じるほか、次のことを強調しています。 3 か月以内にモデルを最適化する トレーニングやその他の方法で再生を防止します。

現在、多数のトレーニング反復を経て、ChatGPT のような人工知能技術は急速に発展していますが、それどころか、各国の既存の法制度は、明らかに ChatGPT のような人工知能技術を監督するには不十分です。したがって、人工知能技術を規制するための規制が策定されており、その開発はすべての国が解決する必要がある主要な問題となっています。

結論

コンピューティング技術は急速に発展しており、人工知能技術革命の波は避けられず、将来的には一部の「人工知能」が置き換えられることは避けられません。さらに、ChatGPTのような人工知能技術の多数の応用は、データ漏洩、ネットワークハッキングツールの最適化、大規模詐欺、AI架空写真などのセキュリティ問題を確実に引き起こすでしょう。

しかし、上記のいずれの要因も、人工知能技術の研究開発を中止する言い訳にはなりません。人類は人工知能の到来を恐れて立ち向かうべきではありません。私たちは常に「人間」が存在することを忘れてはなりません。将来的には、技術の最適化と規制の策定を継続的に行うことで、「デリバティブ」による被害を最小限に抑えることができると考えています。

以上がGPTはクールになるでしょうか?バフェット氏、マスク氏ら大物著名人が活動停止を要求の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

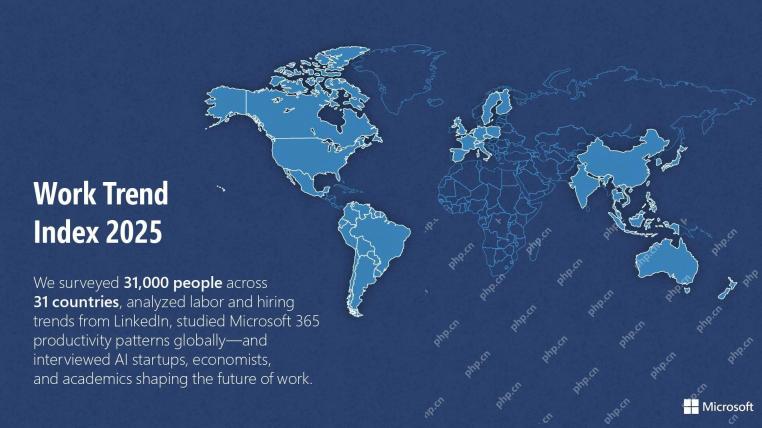

Microsoft Work Trend Index 2025は、職場の容量の緊張を示していますApr 24, 2025 am 11:19 AM

Microsoft Work Trend Index 2025は、職場の容量の緊張を示していますApr 24, 2025 am 11:19 AMAIの急速な統合により悪化した職場での急成長能力の危機は、増分調整を超えて戦略的な変化を要求します。 これは、WTIの調査結果によって強調されています。従業員の68%がワークロードに苦労しており、BURにつながります

AIは理解できますか?中国の部屋の議論はノーと言っていますが、それは正しいですか?Apr 24, 2025 am 11:18 AM

AIは理解できますか?中国の部屋の議論はノーと言っていますが、それは正しいですか?Apr 24, 2025 am 11:18 AMジョン・サールの中国の部屋の議論:AIの理解への挑戦 Searleの思考実験は、人工知能が真に言語を理解できるのか、それとも真の意識を持っているのかを直接疑問に思っています。 チャインを無知な人を想像してください

中国の「スマート」AIアシスタントは、マイクロソフトのリコールのプライバシーの欠陥をエコーしますApr 24, 2025 am 11:17 AM

中国の「スマート」AIアシスタントは、マイクロソフトのリコールのプライバシーの欠陥をエコーしますApr 24, 2025 am 11:17 AM中国のハイテク大手は、西部のカウンターパートと比較して、AI開発の別のコースを図っています。 技術的なベンチマークとAPI統合のみに焦点を当てるのではなく、「スクリーン認識」AIアシスタントを優先しています。

Dockerは、おなじみのコンテナワークフローをAIモデルとMCPツールにもたらしますApr 24, 2025 am 11:16 AM

Dockerは、おなじみのコンテナワークフローをAIモデルとMCPツールにもたらしますApr 24, 2025 am 11:16 AMMCP:AIシステムに外部ツールにアクセスできるようになります モデルコンテキストプロトコル(MCP)により、AIアプリケーションは標準化されたインターフェイスを介して外部ツールとデータソースと対話できます。人類によって開発され、主要なAIプロバイダーによってサポートされているMCPは、言語モデルとエージェントが利用可能なツールを発見し、適切なパラメーターでそれらを呼び出すことができます。ただし、環境紛争、セキュリティの脆弱性、一貫性のないクロスプラットフォーム動作など、MCPサーバーの実装にはいくつかの課題があります。 Forbesの記事「人類のモデルコンテキストプロトコルは、AIエージェントの開発における大きなステップです」著者:Janakiram MSVDockerは、コンテナ化を通じてこれらの問題を解決します。 Docker Hubインフラストラクチャに基づいて構築されたドキュメント

6億ドルのスタートアップを構築するために6つのAIストリートスマート戦略を使用するApr 24, 2025 am 11:15 AM

6億ドルのスタートアップを構築するために6つのAIストリートスマート戦略を使用するApr 24, 2025 am 11:15 AM最先端のテクノロジーと巧妙なビジネスの洞察力を活用して、コントロールを維持しながら非常に収益性の高いスケーラブルな企業を作成する先見の明のある起業家によって採用された6つの戦略。このガイドは、建設を目指している起業家向けのためのものです

Googleフォトの更新は、すべての写真の見事なウルトラHDRのロックを解除しますApr 24, 2025 am 11:14 AM

Googleフォトの更新は、すべての写真の見事なウルトラHDRのロックを解除しますApr 24, 2025 am 11:14 AMGoogle Photosの新しいウルトラHDRツール:画像強化のゲームチェンジャー Google Photosは、強力なウルトラHDR変換ツールを導入し、標準的な写真を活気のある高ダイナミックレンジ画像に変換しました。この強化は写真家に利益をもたらします

Descopeは、AIエージェント統合の認証フレームワークを構築しますApr 24, 2025 am 11:13 AM

Descopeは、AIエージェント統合の認証フレームワークを構築しますApr 24, 2025 am 11:13 AM技術アーキテクチャは、新たな認証の課題を解決します エージェントアイデンティティハブは、AIエージェントの実装を開始した後にのみ多くの組織が発見した問題に取り組んでいます。

Google Cloud Next2025と現代の仕事の接続された未来Apr 24, 2025 am 11:12 AM

Google Cloud Next2025と現代の仕事の接続された未来Apr 24, 2025 am 11:12 AM(注:Googleは私の会社であるMoor Insights&Strategyのアドバイザリークライアントです。) AI:実験からエンタープライズ財団まで Google Cloud Next 2025は、実験機能からエンタープライズテクノロジーのコアコンポーネント、ストリームへのAIの進化を紹介しました

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

MinGW - Minimalist GNU for Windows

このプロジェクトは osdn.net/projects/mingw に移行中です。引き続きそこでフォローしていただけます。 MinGW: GNU Compiler Collection (GCC) のネイティブ Windows ポートであり、ネイティブ Windows アプリケーションを構築するための自由に配布可能なインポート ライブラリとヘッダー ファイルであり、C99 機能をサポートする MSVC ランタイムの拡張機能が含まれています。すべての MinGW ソフトウェアは 64 ビット Windows プラットフォームで実行できます。

SAP NetWeaver Server Adapter for Eclipse

Eclipse を SAP NetWeaver アプリケーション サーバーと統合します。

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

ホットトピック

7698

7698 15

15 1640

1640 14

14 1393

1393 52

52 1287

1287 25

25 1229

1229 29

29