ホームページ >バックエンド開発 >Python チュートリアル >Python動作検知プログラミング実践ドリル

Python動作検知プログラミング実践ドリル

- PHPz転載

- 2023-04-25 13:10:061522ブラウズ

翻訳者 | Zhu Xianzhong

査読者 | Sun Shujuan

概要

Python プログラミング言語には、利用可能な複数のオープンソース ライブラリがあるため、 ; したがって、動き検出開発用の Python 言語を選択するのは簡単です。現在、動き検出には多くの商業用途があります。たとえば、オンライン試験の監督や店舗、銀行などのセキュリティ目的に使用できます。

Python プログラミング言語は、非常に豊富なサポート ライブラリを備えたオープンソース言語であり、現在ではこの言語をベースにした多数のアプリケーションが開発され、多くのユーザーを抱えています。このため、Python 言語は市場で急速に成長しています。 Python 言語の利点は、構文が単純でエラーが見つけやすいことだけでなく、非常に高速なデバッグ プロセスによりユーザーフレンドリーになるため、数多くあります。

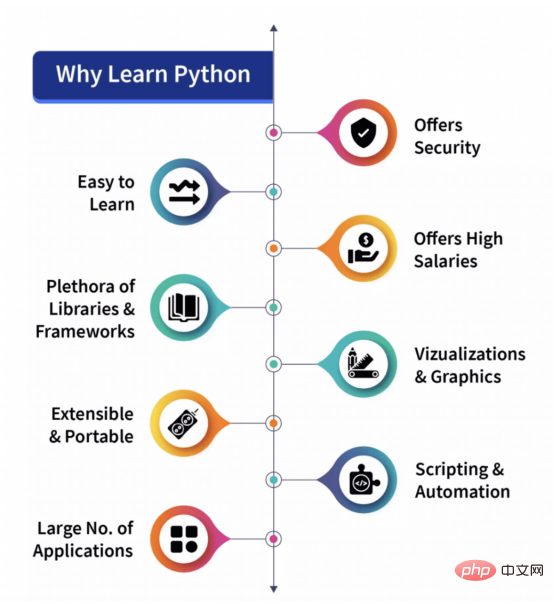

Python を学ぶことが推奨される理由は何ですか?次の図を使って簡単に説明します。

Python は 1991 年に設計され、Python Software Foundation によって開発されました。今日、多くのバージョンがリリースされました。その中でも Python2 と Python3 が最も有名です。現在、Python3は広く使われており、利用者数も急速に増加しています。このプロジェクトでは、開発言語として Python3 を使用します。

動体検知とは何ですか?

物理学の原理によれば、物体が静止していて速度がない場合、その物体は静止していると見なされますが、その逆に、物体が完全に静止しておらず、特定の方向に移動している場合は静止していると見なされます。一定の動きや速度(左右、前後、上下)があるとき、それは動いているとみなします。この記事では、オブジェクトの動作を検出してみます。

現在、モーション検出は多くの現実の状況に実装または適用されており、その応用価値が非常に大きいことが十分に証明されています。その中でも、Web カメラ (この記事で実装します) をオンライン試験の監視などの警備員として使用するのが最も典型的なアプリケーションです。

この記事では、スクリプトを実装してみます。このスクリプトでは、デスクトップまたはラップトップにインストールされている Web カメラを使用してオブジェクトの動きを検出します。アイデアは、ビデオの 2 フレームを取得し、それらの間の違いを見つけようとすることです。 2 つのフレーム間に何らかの違いがある場合は、明らかにカメラの前でオブジェクトに何らかの動きがあり、それが違いを生み出します。

主な参照ライブラリ

コードの実装を開始する前に、動き検出のために Web カメラを操作するためにコードで使用するいくつかのモジュールまたはライブラリを見てみましょう。すでに説明したように、これらのオープンソース ライブラリは、Python の評判を広める上で重要な役割を果たしています。この記事のサンプル プロジェクトで必要なオープン ソース ライブラリを見てみましょう:

- OpenCV

- Pandas

上記の 2 つのライブラリ OpenCV とPandas は純粋に Python 用の無料のオープン ソース ライブラリに基づいており、Python 言語の Python3 バージョンを通じて使用します。

1.OpenCV

OpenCV は、多くのプログラミング言語 (C、Python など) で使用でき、特に画像処理に使用される非常に有名なオープン ソース ライブラリです。およびビデオプログラムの開発。アプリケーションを Python のオープンソース ライブラリ Pandas または NumPy ライブラリと統合することで、OpenCV の機能を最大限に活用できます。

2.Pandas

Pandas は、データ分析用の豊富な組み込みツールを提供するオープンソースの Python ライブラリであるため、データ サイエンスとデータ分析の分野で広く使用されています。 Pandas は DataFrame 形式のデータ構造を提供し、表形式のデータを 2 次元データ構造に操作および保存するための非常に便利なサポートを提供します。

上記の 2 つのモジュールはどちらも Python に組み込まれていないため、使用する前にインストールする必要があります。これとは別に、プロジェクトでは他の 2 つのモジュールも使用します。

- Python 日付と時刻 (DateTime) モジュール

- Python 時刻 (Time) モジュール

両方のモジュールは Python に組み込まれているため、インストールする必要はありません。将来的にはインストールされます。これらのモジュールは、日付と時刻に関連する関数をそれぞれ処理するために使用されます。

コードの実装

これまで、コードで使用するライブラリを見てきました。次に、ビデオが多数の静止画像またはフレームの単なる組み合わせであるという仮定から始めて、それらすべてのフレームの組み合わせを使用してビデオを作成してみましょう。

必要なライブラリをインポートする

このセクションでは、まず Pandas や OpenCV などのすべてのライブラリをインポートします。次に、DateTime モジュールから time 関数と DateTime 関数をインポートします。

#导入Pandas库 import Pandas as panda # 导入OpenCV库 import cv2 #导入时间模块 import time #从datetime 模块导入datetime 函数 from datetime import datetime

データ変数の初期化

このセクションでは、いくつかの変数を初期化し、これらの変数を使用しますさらに遠く。まず、初期状態を「なし」として定義し、別の変数 motionTrackList を通じて追跡されたモーションを保存します。

此外,我们还定义了一个列表“motionTime”,用于存储发现运动的时间,并使用Panda的模块初始化数据帧列表。

# 对于初始帧,以变量initialState的形式将初始状态指定为None initialState = None # 帧中检测到任何运动时存储所有轨迹的列表 motionTrackList= [ None, None ] # 一个新的“时间”列表,用于存储检测到移动时的时间 motionTime = [] # 使用带有初始列和最终列的Panda库初始化数据帧变量“DataFrame” dataFrame = panda.DataFrame(columns = ["Initial", "Final"])

关键帧捕获过程

在本节中,我们将实现本文示例项目中最关键的运动检测步骤。下面,让我们分步骤进行解说:

- 首先,我们将开始使用cv2模块捕获视频,并将其存储在视频变量中。

- 然后,我们将使用无限while循环从视频中捕获每一帧。

- 接下来,将使用read()方法读取每个帧,并将它们存储到各自的变量中。

- 我们定义了一个变量var_motion,并将其初始化为零。

- 我们使用cv2函数cvtColor和GaussianBlur创建另外两个变量grayImage和grayFrame,以找到运动中的变化。

- 如果我们的initialState为None,则我们将当前grayFrame指定为initialState;否则,使用“continue”关键字跳过后面代码的执行。

- 在后面代码中,我们计算在当前迭代中创建的初始帧和灰度帧grayscale之间的差异。

- 然后,我们将使用cv2阈值和dilate函数突出显示初始帧和当前帧之间的变化。

- 我们将从当前图像或帧中的运动对象中找到轮廓,并通过使用rectangle函数在其周围创建绿色边界来指示运动对象。

- 在此之后,我们将把当前检测到的元素添加到列表变量motionTrackList。

- 到目前为止,我们已经通过使用imshow方法显示出如灰度和原始帧等所有的关键帧。

- 此外,我们还使用cv2模块的witkey()方法来结束进程。程序中,我们选择使用按下键盘上的'm'键来结束我们的进程。

# 使用cv2模块启动网络摄像头以捕获视频

video = cv2.VideoCapture(0)

# 使用无限循环从视频中捕获帧

while True:

# 使用read功能从视频中读取每个图像或帧

check, cur_frame = video.read()

#将'motion'变量定义为等于零的初始帧

var_motion = 0

# 从彩色图像创建灰色帧

gray_image = cv2.cvtColor(cur_frame, cv2.COLOR_BGR2GRAY)

# 从灰度图像中使用GaussianBlur函数找到变化部分

gray_frame = cv2.GaussianBlur(gray_image, (21, 21), 0)

# 在第一次迭代时进行条件检查

# 如果为None,则把grayFrame赋值给变量initalState

if initialState is None:

initialState = gray_frame

continue

# 计算静态(或初始)帧与我们创建的灰色帧之间的差异

differ_frame = cv2.absdiff(initialState, gray_frame)

# 静态或初始背景与当前灰色帧之间的变化将突出显示

thresh_frame = cv2.threshold(differ_frame, 30, 255, cv2.THRESH_BINARY)[1]

thresh_frame = cv2.dilate(thresh_frame, None, iterations = 2)

#对于帧中的移动对象,查找轮廓

cont,_ = cv2.findContours(thresh_frame.copy(),

cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

for cur in cont:

if cv2.contourArea(cur) < 10000:

continue

var_motion = 1

(cur_x, cur_y,cur_w, cur_h) = cv2.boundingRect(cur)

# 在移动对象周围创建一个绿色矩形

cv2.rectangle(cur_frame, (cur_x, cur_y), (cur_x + cur_w, cur_y + cur_h), (0, 255, 0), 3)

# 从帧中添加运动状态

motionTrackList.append(var_motion)

motionTrackList = motionTrackList[-2:]

# 添加运动的开始时间

if motionTrackList[-1] == 1 and motionTrackList[-2] == 0:

motionTime.append(datetime.now())

# 添加运动的结束时间

if motionTrackList[-1] == 0 and motionTrackList[-2] == 1:

motionTime.append(datetime.now())

# 在显示捕获图像的灰度级中

cv2.imshow("The image captured in the Gray Frame is shown below: ", gray_frame)

# 显示初始静态帧和当前帧之间的差异

cv2.imshow("Difference between theinital static frame and the current frame: ", differ_frame)

# 在框架屏幕上显示视频中的黑白图像

cv2.imshow("Threshold Frame created from the PC or Laptop Webcam is: ", thresh_frame)

#通过彩色框显示物体的轮廓

cv2.imshow("From the PC or Laptop webcam, this is one example of the Colour Frame:", cur_frame)

# 创建处于等待状态的键盘按键

wait_key = cv2.waitKey(1)

# 按下'm'键时,结束整个进程执行

if wait_key == ord('m'):

# 当屏幕上有东西移动时,将运动变量值添加到motiontime列表中

if var_motion == 1:

motionTime.append(datetime.now())

break

代码收尾工作

在结束循环体执行后,我们将从dataFrame和motionTime列表中添加数据到CSV文件中,最后关闭视频。这一部分代码的实现如下所示:

# 最后,我们在数据帧中添加运动时间

for a in range(0, len(motionTime), 2):

dataFrame = dataFrame.append({"Initial" : time[a], "Final" : motionTime[a + 1]}, ignore_index = True)

# 创建CSV文件记录下所有运动信息

dataFrame.to_csv("EachMovement.csv")

# 释放视频内存

video.release()

#现在,在openCV的帮助下关闭或销毁所有打开的窗口

cv2.destroyAllWindows()至此,我们已经成功地创建完所有代码。现在,让我们再次归纳一下整个过程。

首先,我们使用设备的网络摄像头捕捉视频,然后将输入视频的初始帧作为参考,并不时检查下一帧。如果发现与第一帧不同的帧,则说明存在运动。该信息将被标记在绿色矩形中。

完整的代码

现在,让我们把上面所有代码片断连接到一起,如下所示:

#导入Pandas库

import Pandas as panda

# 导入OpenCV库

import cv2

#导入时间模块

import time

#从datetime 模块导入datetime 函数

from datetime import datetime

# 对于初始帧,以变量initialState的形式将初始状态指定为None

initialState = None

# 帧中检测到任何运动时存储所有轨迹的列表

motionTrackList= [ None, None ]

# 一个新的“时间”列表,用于存储检测到移动时的时间

motionTime = []

# 使用带有初始列和最终列的Panda库初始化数据帧变量“DataFrame”

dataFrame = panda.DataFrame(columns = ["Initial", "Final"])

# 使用cv2模块启动网络摄像头以捕获视频

video = cv2.VideoCapture(0)

# 使用无限循环从视频中捕获帧

while True:

# 使用read功能从视频中读取每个图像或帧

check, cur_frame = video.read()

#将'motion'变量定义为等于零的初始帧

var_motion = 0

# 从彩色图像创建灰色帧

gray_image = cv2.cvtColor(cur_frame, cv2.COLOR_BGR2GRAY)

# 从灰度图像中使用GaussianBlur函数找到变化部分

gray_frame = cv2.GaussianBlur(gray_image, (21, 21), 0)

# 在第一次迭代时进行条件检查

# 如果为None,则把grayFrame赋值给变量initalState

if initialState is None:

initialState = gray_frame

continue

# 计算静态(或初始)帧与我们创建的灰色帧之间的差异

differ_frame = cv2.absdiff(initialState, gray_frame)

# 静态或初始背景与当前灰色帧之间的变化将突出显示

thresh_frame = cv2.threshold(differ_frame, 30, 255, cv2.THRESH_BINARY)[1]

thresh_frame = cv2.dilate(thresh_frame, None, iterations = 2)

#对于帧中的移动对象,查找轮廓

cont,_ = cv2.findContours(thresh_frame.copy(),

cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

for cur in cont:

if cv2.contourArea(cur) < 10000:

continue

var_motion = 1

(cur_x, cur_y,cur_w, cur_h) = cv2.boundingRect(cur)

# 在移动对象周围创建一个绿色矩形

cv2.rectangle(cur_frame, (cur_x, cur_y), (cur_x + cur_w, cur_y + cur_h), (0, 255, 0), 3)

# 从帧中添加运动状态

motionTrackList.append(var_motion)

motionTrackList = motionTrackList[-2:]

# 添加运动的开始时间

if motionTrackList[-1] == 1 and motionTrackList[-2] == 0:

motionTime.append(datetime.now())

# 添加运动的结束时间

if motionTrackList[-1] == 0 and motionTrackList[-2] == 1:

motionTime.append(datetime.now())

# 在显示捕获图像的灰度级中

cv2.imshow("The image captured in the Gray Frame is shown below: ", gray_frame)

# 显示初始静态帧和当前帧之间的差异

cv2.imshow("Difference between theinital static frame and the current frame: ", differ_frame)

# 在框架屏幕上显示视频中的黑白图像

cv2.imshow("Threshold Frame created from the PC or Laptop Webcam is: ", thresh_frame)

#通过彩色框显示物体的轮廓

cv2.imshow("From the PC or Laptop webcam, this is one example of the Colour Frame:", cur_frame)

# 创建处于等待状态的键盘按键

wait_key = cv2.waitKey(1)

# 借助'm'键结束我们系统的整个进行

if wait_key == ord('m'):

# 当屏幕上有物体运行时把运动变量值添加到列表motiontime中

if var_motion == 1:

motionTime.append(datetime.now())

break

# 最后,我们在数据帧中添加运动时间

for a in range(0, len(motionTime), 2):

dataFrame = dataFrame.append({"Initial" : time[a], "Final" : motionTime[a + 1]}, ignore_index = True)

# 记录下所有运行,并创建到一个CSV文件中

dataFrame.to_csv("EachMovement.csv")

# 释放视频内存

video.release()

#现在,在openCV的帮助下关闭或销毁所有打开的窗口

cv2.destroyAllWindows()运行结果

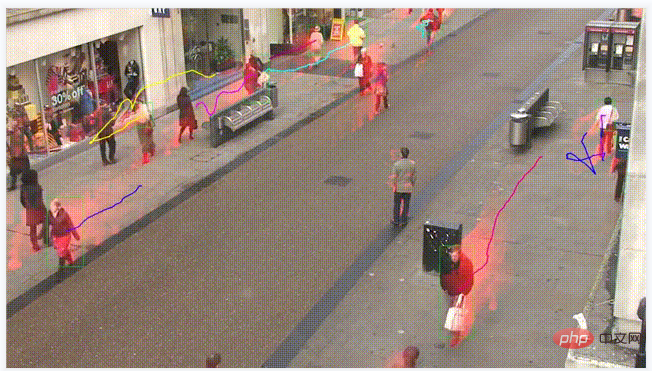

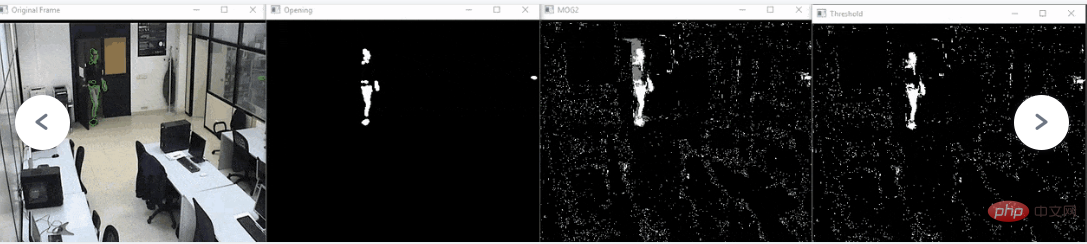

运行上述代码后得到的结果与下面看到的结果类似。

从这个动画中,我们可以看到该男子在视频中的动作已经被跟踪。因此,可以相应地看到输出结果。

然而,在这段代码中,跟踪是在移动对象周围的矩形框的帮助下完成,类似于下面动画中所示的。这里要注意的一件有趣的事情是,这段视频是一个实际的安全摄像头的镜头,已经对其进行了检测处理。

结论

- Python编程语言是一种开源的且有丰富的开源库支持的语言,目前已经为用户提供了许多现成的应用程序。

- 当一个物体静止不动且没有速度时,则认为它处于静止状态;反之,当一个对象未完全静止时,则视为它处于运动状态。

- OpenCV是一个开源库,可用于多种编程语言,通过将其与Python的Panda/NumPy库集成,我们可以充分发挥OpenCV的功能。

最后来归纳一下。本文中所介绍的运动检测的主要思想是,每个视频只是许多静态图像(称为帧)的组合,我们是通过判断帧之间的差异来实现运行检测的。

译者介绍

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。早期专注各种微软技术(编著成ASP.NET AJX、Cocos 2d-X相关三本技术图书),近十多年投身于开源世界(熟悉流行全栈Web开发技术),了解基于OneNet/AliOS+Arduino/ESP32/树莓派等物联网开发技术与Scala+Hadoop+Spark+Flink等大数据开发技术。

原文标题:How to Perform Motion Detection Using Python,作者:Vaishnavi Amira Yada

以上がPython動作検知プログラミング実践ドリルの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。