ホームページ >テクノロジー周辺機器 >AI >注意を払わない事前トレーニング、GPT による文脈に沿った学習

注意を払わない事前トレーニング、GPT による文脈に沿った学習

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-14 17:31:031195ブラウズ

論文 1: ClimateNeRF: 極端な気候合成のための物理ベースのニューラル レンダリング

- 著者: Yuan Li et al

- #論文アドレス: https://arxiv.org/pdf/2211.13226.pdf

#要約: この論文では、物理シミュレーションとシーンの NeRF モデルを融合して、これらのシーンの物理現象のリアルなムービーを生成する新しい方法を紹介します。具体的な結果として、この方法は気候変動の考えられる影響を現実的にシミュレートできます。小規模な洪水の後、遊び場はどのようになるでしょうか?大洪水の後はどうなるのでしょうか?吹雪の後はどうでしょうか?

## 推奨: 霧、冬、洪水、新しい NeRF モデルが物理的にリアルな大ヒット作をレンダリング。

論文 2: 注意を払わない事前トレーニング

- ##著者: Junxiong Wang 他

- #論文アドレス: https://arxiv.org/pdf/2212.10544.pdf

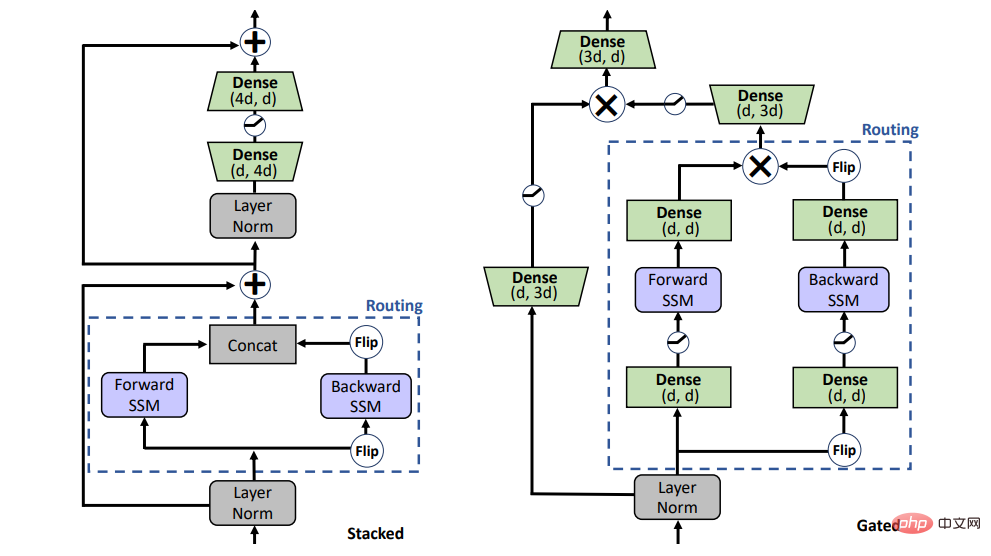

- ##要約: この論文では、状態空間モデル (SSM) に基づくルーティング層と乗算ゲートに基づくモデル アーキテクチャを組み合わせた双方向ゲーティング SSM (BiGS) モデルを提案します。これにより、BERT 予測を問題なく再現できます。トレーニング結果を使用して、近似を必要とせずに 4096 トークンの長距離事前トレーニングに拡張できます。

推奨事項:  事前トレーニングには注意を払う必要はなく、BERT と同様に 4096 トークンへのスケーリングも問題ありません。

事前トレーニングには注意を払う必要はなく、BERT と同様に 4096 トークンへのスケーリングも問題ありません。

論文 3: 1 つのモデルですべてを編集: セマンティック変調を使用した自由形式のテキスト駆動の画像操作

#著者: Yiming Zhu 他

- 論文アドレス: https://arxiv.org/pdf/2210.07883.pdf

- ##要約: 最近、特に StableDiffusion や DALLE wait などのノイズ除去拡散モデルに基づいて、テキストを使用した画像編集のガイドが大きな進歩と注目を集めています。 。ただし、GAN ベースのテキスト画像編集には、まだ解決されていない問題がいくつかあります。たとえば、古典的な StyleCILP では、テキストごとにモデルをトレーニングする必要があります。この単一テキストから単一モデルへのアプローチは、実際には不便です。アプリケーション。

この記事は FFCLIP を提案し、この問題を解決します。柔軟なさまざまなテキスト入力の場合、FFCLIP はテキストごとにモデルを再トレーニングすることなく、それに応じて画像を編集するために 1 つのモデルだけを必要とします。複数のデータセットで非常に良い結果が得られました。この論文は NeurIPS 2022 に受理されました。

推奨事項: テキストと画像編集の新しいパラダイムにより、単一のモデルでマルチテキストのガイド付き画像編集が可能になります。

論文 4: SELF-INSTRUCT: 言語モデルと自己生成命令の調整

著者: Yizhong Wang 他

- 論文アドレス: https://arxiv.org/pdf/2212.10560v1.pdf

- 要約: ワシントン大学と他の機関が最近共同で論文を発表しました提案された新しいフレームワーク SELF-INSTRUCT は、モデルのガイドを行うことで事前トレーニングされた言語モデルのパフォーマンスを向上させます独自の生成プロセス、指示に従う能力。 SELF-INSTRUCT は、モデル自体からの命令信号を使用して、事前トレーニングされた LM で命令チューニングを実行する半自動プロセスです。

推奨事項: 手動によるアノテーションは必要ありません。自己生成された命令フレームワークにより、ChatGPT などの LLM のコストのボトルネックが解消されます。

#論文 5: ニューラル ネットワークによる実固体の Ab Initio 計算Ansatz

- 著者: Xiang Li 他

- ##論文アドレス: https://www.nature.com/articles/s41467-022 - 35627-1

要約: 機械学習は、大量のデータを処理し、複雑なシナリオで科学的問題を解決し、科学的探査を主導できます。これまで不可能だった領域への到達、新たな領域への取り組み。たとえば、DeepMind は人工知能ソフトウェア AlphaFold を使用して、科学界に知られているほぼすべてのタンパク質構造を高精度に予測します。Christian Lagemann が提案した深層学習に基づく粒子画像流速測定 (PIV) 手法は、当初の純粋な手動設定を大幅に改善しました。モデルの適用範囲は、自動車、航空宇宙、生体医工学などの多くの分野の研究にとって極めて重要です。

最近、ByteDance AI Lab 研究チームと北京大学物理学部の Chen Ji の研究グループによる研究「ニューラル ネットワークによる実固体の第一原理計算」により、物理学における新しいアイデアであるこの研究は、固体系に適した業界初のニューラル ネットワーク波動関数を提案し、固体の第一原理計算を実現し、計算結果を熱力学的限界に押し上げます。これは、ニューラル ネットワークが固体物理学を研究するための効率的なツールであることを強く証明するとともに、深層学習技術が物性物理学においてますます重要な役割を果たすことを示しています。関連する研究結果は、2022 年 12 月 22 日にトップ国際ジャーナル Nature Communication に掲載されました。

推奨事項: 固体システムに適した業界初のニューラル ネットワーク波動関数が Nature サブジャーナルに掲載されました。

論文 6: なぜ GPT はコンテキスト内で学習できるのでしょうか? 言語モデルはメタ オプティマイザーとして密かに勾配降下法を実行します

- #著者: Damai Dai 他

- 論文アドレス: https://arxiv.org/pdf/2212.10559v2.pdf

要約: インコンテキスト学習 (ICL) は、大規模な事前トレーニング済み言語モデルで大きな成功を収めていますが、その動作メカニズムはまだ未解決です。答えのない質問。この記事では、北京大学、清華大学、マイクロソフトの研究者が ICL を一種の暗黙的微調整であると理解し、ICL と明示的微調整が複数のレベルで同様に機能することを証明する経験的証拠を提供します。

推奨: GPT によるインコンテキスト学習が機能するのはなぜですか?モデルは勾配降下を秘密裏に実行します。

論文 7: 非古典的な脳機能の実験的兆候

- 著者: Christian Matthias Kerskens 他

- 論文アドレス: https://iopscience.iop.org/article/10.1088/2399-6528/ac94be

数十年にわたり、科学者たちは人間の脳のコンピューティングと思考のメカニズムを研究してきました。しかし、人間の脳の構造は非常に複雑で、数兆個のチップに相当する数百億個のニューロンが存在するため、それを解明するのは困難です。ブラックホールの研究への貢献でノーベル物理学賞を受賞したロジャー・ペンローズは、かつて「量子意識」という概念、つまり人間の脳そのものが量子構造、つまり量子コンピューターであるという考えを大胆に提唱した。しかし、この見解には疑問が投げかけられています。 ダブリントリニティ大学の最近の研究は、私たちの脳が量子計算を実行していることを示唆しており、人間の脳には意識に関連する脳機能を介したもつれが存在すると主張しています。これらの脳機能が非古典的な方法で動作する必要がある場合、これは意識が非古典的であることを意味します。つまり、脳の認知プロセスには量子計算が含まれます。

推奨事項:

脳の思考は量子コンピューティングです。この推測には新しい証拠があります。

ArXiv ウィークリー ラジオステーションHeart of Machine は、Chu Hang 氏と Luo Ruotian 氏が立ち上げた ArXiv Weekly Radiostation と協力し、今週、NLP、CV、ML の各分野で選ばれた 10 件の論文を含む 7 件の論文に基づいて、より重要な論文を選出します。論文の音声要約を提供します。詳細は次のとおりです: 10 NLP Papers音声: 00:0020:18 ##今週選ばれた 10 件の NLP 論文 はい: 1. 教師なし文法帰納法にはピクセルが必要ですか? (Serge Belongie、Kilian Q. Weinberger、Jitendra Malik、Trevor Darrell より) 3. 画像による曖昧さへの取り組み: マルチモーダル機械翻訳と対比の改善評価 (Cordelia Schmid、Ivan Laptev より) 4. 視覚言語関係調整のためのクロスモーダル注意合同正則化 (Ruslan Salakhutdinov、Louis-Philippe Morency より) 6. 人間的な評価を目指してエラー分析による自然言語生成 (Dacheng Tao より) 7. 現在のタスク指向対話モデルは、実際の現実世界のシナリオを自動化できますか? (Kyunghyun Cho より) 8. テキスト生成のためのモデルベースの評価指標の盲点について (Kyunghyun Cho より) 9. 対照学習を超えて:多言語検索のための変分生成モデル (William W. Cohen より) 10. 少数ショット推論のための文脈内学習に対する記号表現の影響(Li Erran Li より) 、エリック・シン)

10 の履歴書 音声:#00:0023:15 1. 敵対的堅牢性のための残差ネットワークの再考: アーキテクチャの視点. (Kalyanmoy Deb より) 2. テキストから画像への生成における空間関係のベンチマーク. (from Kalyanmoy Deb) Eric Horvitz) 3. 離れた場所での人物認識に関する簡単な調査 (Rama Chellappa より) 4. MetaCLUE: 包括的を目指してVisual Metaphors Research. (Leonidas Guibas、William T. Freeman より) 5. エイリアシングは敵対的攻撃の推進力です. (Antonio Torralba より) 6. Reversible Column Networks (from Xiangyu Zhang) 7. Hi-LASSIE: High-Fidelity Articulated Shape and Skeleton Discovery from Sparse Image Ensemble (from Ming-Hsuan) Yang) ##8. 半教師あり 3D オブジェクト検出のためのオブジェクトレベルのポイント オーグメンタの学習 (Ming-Hsuan Yang より) 9.ピクセル レベルでの視覚的プロンプトの力を解き放つ (Alan Yuille より) 10.画像からテキスト プロンプトまで: 凍結された大規模言語モデルを使用したゼロショット VQA。 (ダチェン・タオ、スティーブン・C・H・ホイより)

以上が注意を払わない事前トレーニング、GPT による文脈に沿った学習の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。