ホームページ >テクノロジー周辺機器 >AI >推論速度は安定拡散の 2 倍高速、Visual Transformer により画像テキストが統一されます

推論速度は安定拡散の 2 倍高速、Visual Transformer により画像テキストが統一されます

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-13 23:55:011641ブラウズ

論文 1: 1 つのモデルですべてを編集: セマンティック変調を使用した自由形式のテキスト駆動型画像操作

- #著者: Yiming Zhu、Hongyu Liu など

- 論文アドレス: https://arxiv.org/pdf/2210.07883.pdf

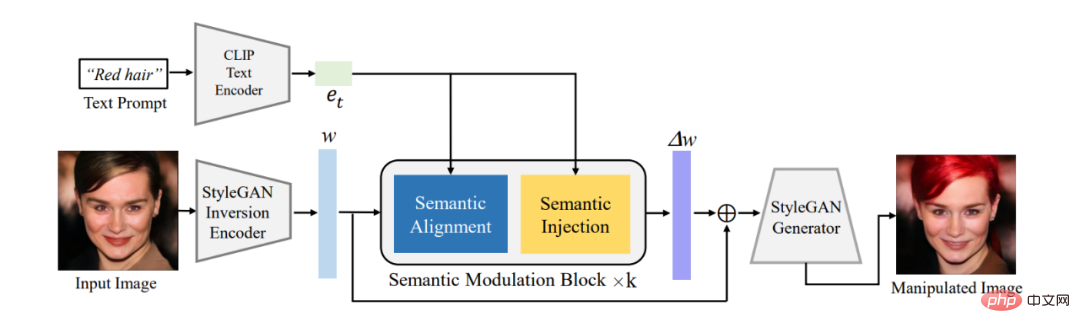

##要約: この記事では、まず既存のエンコーダーを使用して、編集が必要な画像を StyleGAN の W^ セマンティック空間内の潜在エンコーディング w に変換します。 、提案されたセマンティック変調モジュールを使用して、潜在コーディングに対して適応変調を実行します。セマンティック変調モジュールには、セマンティック アラインメント モジュールとセマンティック インジェクション モジュールが含まれています。最初に、アテンション メカニズムを通じてテキスト エンコーディングと GAN の潜在エンコーディングの間でセマンティクスを調整し、次にアラインメントされた潜在エンコーディングにテキスト情報を注入して、Cain エンコーディングが確実に所有するようにします。テキストを使用して画像を編集する機能を実現する情報。

従来の StyleCLIP モデルとは異なり、このモデルはテキストごとに個別のモデルをトレーニングする必要はありません。1 つのモデルが複数のテキストに応答して画像を効果的に編集できるため、モデルは次のようになります。 FFCLIP フリーフォームのテキスト駆動型画像操作。同時に、私たちのモデルは、古典的な教会、顔、車のデータセットで非常に良い結果を達成しました。

#図 1: 全体のフレーム図

## 推奨: テキストおよび画像編集の新しいパラダイムである単一モデルで、複数のテキストのガイド付き画像編集が可能になります。

論文 2: 付加的電源として転写可能な極薄基板上に印刷された有機太陽電池モジュール

- 著者:Mayuran Saravanapavanantham、Jeremiah Mwaura 他

- 論文アドレス: https://onlinelibrary.wiley.com/doi/10.1002/smtd。 202200940

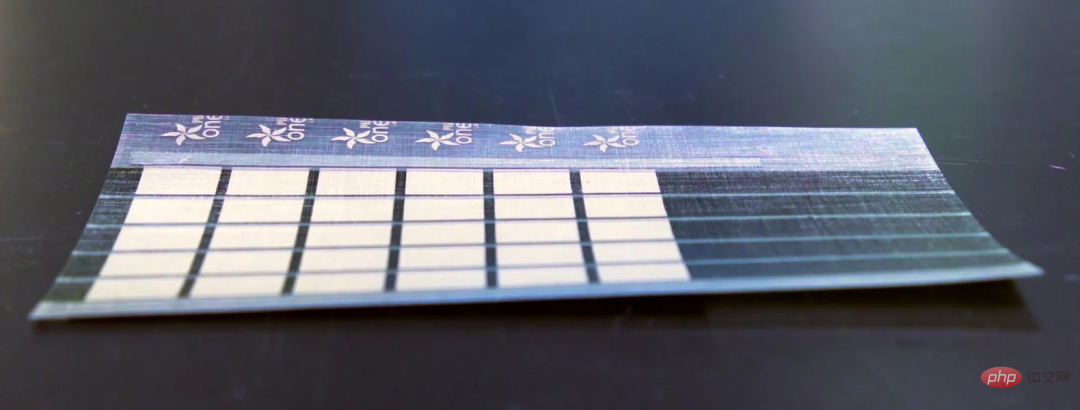

要約: MIT の研究者は、超薄型、軽量の太陽電池を製造できるスケーラブルな製造技術を開発しました。表面。

MITの研究者は、人間の髪の毛よりも薄く、現在のガラスおよびシリコンベースのソーラーパネルよりも1キログラムあたり18倍多くのエネルギーを供給するソーラーパネルを開発しました。これらのソーラーパネルの重量は、従来の太陽電池のわずか 1% です。この超薄型ソーラー パネルは、ボートの帆、ドローンの翼、テントにも設置できます。これらは、遠隔地や災害救援活動で特に役立ちます。

推奨: MIT は紙のように薄いソーラー パネルを作成します。

論文 3: 数学的推論のための深層学習に関する調査

- 著者: Pan Lu、Liang Qiu 他 #論文アドレス: https://arxiv.org/pdf/2212.10535.pdf

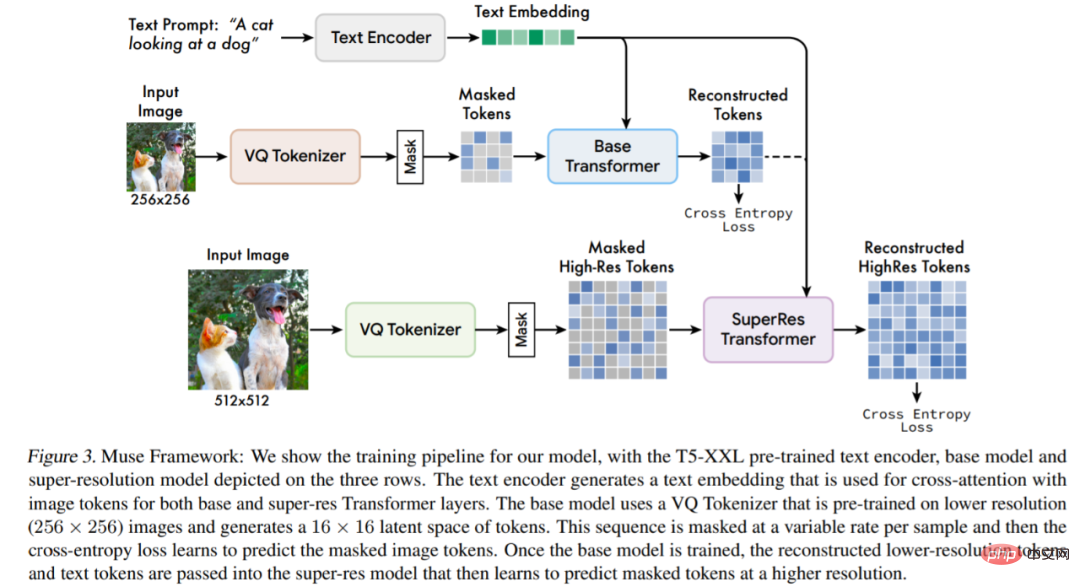

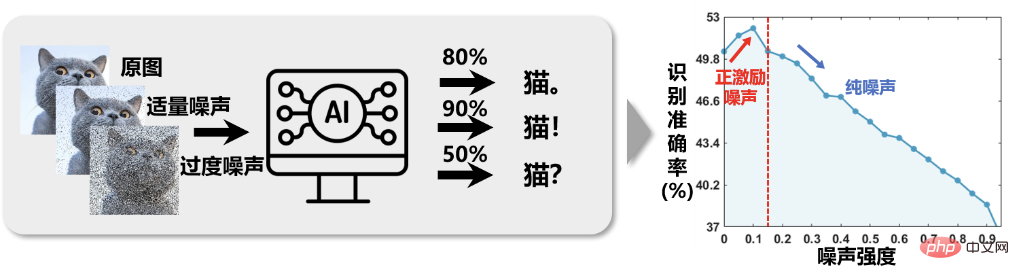

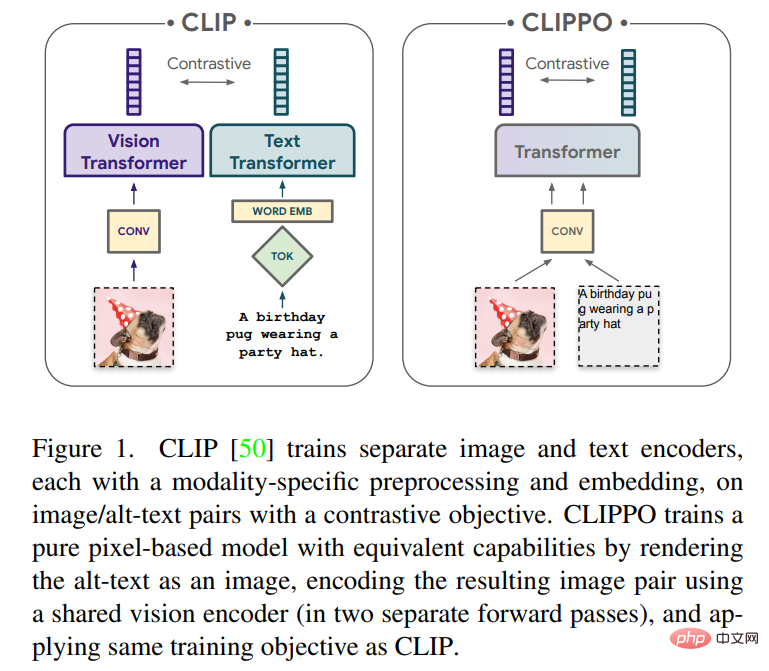

最近発表されたレポートでは、UCLA およびその他の機関の研究者が数学的推論における深層学習の進歩を体系的にレビューしました。 具体的には、この論文ではさまざまなタスクとデータセット (セクション 2) について説明し、数学分野におけるニューラル ネットワーク (セクション 3) と事前学習済み言語モデル (セクション 4) の進歩について考察します。数学的推論における大規模言語モデルの文脈学習の急速な発展も調査されています (セクション 5)。この記事では、既存のベンチマークをさらに分析し、マルチモーダル環境や低リソース環境にはあまり注目が払われていないことがわかりました (セクション 6.1)。証拠に基づいた研究は、現在のコンピューティング能力の表現が不十分であり、深層学習手法が数学的推論に関して一貫性がないことを示しています (セクション 6.2)。その後、著者らは、一般化と堅牢性、信頼できる推論、フィードバックからの学習、およびマルチモーダルな数学的推論の観点から、現在の研究の改善を提案しています (セクション 7)。 推奨事項: 深層学習が数学的推論への扉をゆっくりと開く方法。 #論文 4: Muse: マスクされた生成トランスフォーマーによるテキストから画像への生成 要約: この研究は、画像デコーダ アーキテクチャが導出される、マスクされた画像モデリング アプローチを使用したテキストから画像への合成のための新しいモデルを提案します。事前トレーニングおよび凍結された T5-XXL 大規模言語モデル (LLM) エンコーダーの埋め込みが条件付けされています。 カスケードピクセル空間拡散モデルに基づく Imagen (Saharia et al., 2022) または Dall-E2 (Ramesh et al., 2022) との比較 Muse との比較、効率個別トークンの使用により大幅に改善されます。 SOTA 自己回帰モデル Parti (Yu et al., 2022) と比較すると、Muse は並列デコードを使用するため、より効率的です。 TPU-v4 での実験結果に基づいて、研究者らは、Muse の推論速度は Imagen-3B または Parti-3B モデルよりも 10 倍以上速く、Stable Diffusion v1 よりも速いと推定しています。 .4 (Rombach et al., 2022) 2 倍高速になります。研究者は、拡散モデルが Stable Diffusion v1.4 で使用されており、推論中に明らかにより多くの反復が必要になるため、Muse の方が Stable Diffusion よりも高速であると考えています。 # モデル アーキテクチャの概要。 推奨事項: 推論速度は安定拡散よりも 2 倍速く、画像の生成と修復は 1 つの Google モデルで実行できます。 論文 5: ポジティブインセンティブノイズ #図 1 に示すように、画像インテリジェント分類システムでは、画像に適切な量のノイズを追加してトレーニングすると、認識精度が向上します。これは、私たちにいくつかのインスピレーションをもたらします。画像にノイズを除去するのではなく、ノイズを追加して、画像分類タスクを実行すると、より良い結果が得られる可能性があります。ターゲットへのノイズの影響が背景へのノイズの影響よりもはるかに小さい限り、「敵(背景ノイズ)に1000のダメージを与え、自分(ターゲット信号)に800のダメージを与える」という効果は意味がありますが、ミッションは高い信号対雑音比を追求するためです。本質的に、従来の分類問題に直面した場合、特徴の後に適度なノイズをランダムに追加することは、特徴の次元を増やすことと同じであり、ある意味、それは実際にタスクを完了する特徴にカーネル関数を追加することに似ています。 - 次元空間から高次元空間に変換すると、データがより分離しやすくなり、分類効果が向上します。 図 1 画像認識精度は、画像ノイズ強度が増加するにつれて「最初は増加し、その後減少する」という「直感に反する」関係を示しています。 推奨事項: Western Polytechnic University の Li Xuelong 教授は、タスク エントロピーに基づく数学的分析フレームワークを提案しました。 論文 6: ABPN: 超高解像度写真のリアルタイム ローカル レタッチのためのアダプティブ ブレンド ピラミッド ネットワーク #概要: DAMO アカデミーの研究者は、プロレベルのスマート スキンケアの実現を出発点としていますpoint は、高精細画像用の超微細ローカル レタッチ アルゴリズム ABPN のセットを開発しました。これは、超高精細画像での肌の美化や衣服のシワ除去タスクで優れた結果と応用を達成しました。 推奨: ワンクリックでシミやシワを消去します。 #論文 7: ピクセルのみからの画像と言語の理解 ## 著者: Michael Tschannen、Basil Mustafa など この記事では、純粋にピクセルベースのモデルを使用したテキストと画像のマルチモーダル学習について説明します。このモデルは、RGB イメージとしてレンダリングされるビジュアル入力またはテキスト、またはその両方を一緒に処理する別個のビジュアル Transformer です。すべてのモダリティは、低レベルの特徴処理を含む同じモデル パラメーターを使用します。つまり、モダリティ固有の初期畳み込み、トークン化アルゴリズム、または入力埋め込みテーブルはありません。このモデルは、CLIP と ALIGN によって普及した対照学習という 1 つのタスクのみでトレーニングされます。したがって、このモデルは CLIP-Pixels Only (CLIPPO) と呼ばれます。

推奨: Heart of Machine は、Chu Hang 氏と Luo Ruotian 氏が立ち上げた ArXiv Weekly Radiostation と協力し、NLP、CV、 ML の各分野から 10 件の論文を厳選し、論文の概要を音声で紹介します。詳細は次のとおりです: ##10 NLP PapersAudio: #00:0020:02 #今週選ばれた 10 の NLP 論文は次のとおりです: 1. 検索による再考: 忠実な大規模言語モデル推論。(from Honming Zhang 、Dan Roth) 2. 言語モデルを使用した政治的二極化の理解: データセットとメソッド (Bhiksha Raj より) 3 . 事前学習済み言語モデルによるテーブルからテキストへの生成に向けて: テーブル構造の理解とテキスト熟議アプローチ (Hui Xiong より) 4. 認識論的立場の検出による政治的レトリックの検証 ( Brendan O'Connor より) 5. 数式知識を使用した知識集約型のテキストから SQL へのセマンティック解析に向けて (Min-Yen Kan より) 6. 暗黙的なヘイトスピーチ検出における世界の知識の活用. (Jessica Lin より) 7. ニューラル コーデック言語モデルはゼロショットのテキスト音声合成シンセサイザーです. (Furu より) Wei) 8. EZInterviewer: 模擬面接ジェネレーターを使用して面接のパフォーマンスを向上させる (Tao Zhang より) 9. メモリ拡張ルックアップ自動音声認識のための辞書ベースの言語モデリング (Yuxuan Wang より) 10. パラメーター効率の良い微調整設計空間 (Diyi Yang より) ##10 の履歴書 #00:0021:06 今週選ばれた 10 の履歴書は次のとおりです: 1. CA$^2$T-Net: 単一画像からのカテゴリーに依存しない 3D アーティキュレーション転送 (Jitendra Malik より) 2. 持続可能な樹木を知らせるための小規模農家のカシュー プランテーションのマッピングベナンにおける作物拡大 (Vipin Kumar より) 3. Scale-MAE: マルチスケール地理空間表現学習のためのスケール認識マスク オートエンコーダー (Trevor Darrell より) 4. ステップ: ラベルのない手順ビデオからの自己教師付きキー ステップ抽出 (Rama Chellappa より) ##5. ミューズ: マスクされたテキストから画像への生成Generative Transformers. (Ming-Hsuan Yang、Kevin Murphy、William T. Freeman より) 6. ニューラル崩壊による不均衡なセマンティック セグメンテーションの理解. (Xiangyu Zhang、Jiaya Jia より) 7. 3D オブジェクト検出のための座標エンコーディングによるクロスモーダル トランスフォーマー (Xiangyu Zhang より) 8. セマンティックによる道路シーン レベルの表現の学習領域予測 (Alan Yuille より) 9. 並べ替えによる学習: グループ順序制約による自己教師あり学習(Bernt Schiele より) 10. AttEntropy: セマンティック セグメンテーション トランスフォーマーの空間アテンション エントロピーを使用した、複雑なシーン内の未知のオブジェクトのセグメント化。 (Pascal Fua より) 10 ML Papers音声: # #00:0023:15 本周 10 篇 ML 精選论文: #1.関連情報の原理による自己組織化保存グラフ構造学習。 (フィリップ S. ユウより) 2.電子商取引における情報抽出のための敵対的生成ネットワークによるクエリ拡張の修正。 (アルタン・カキルより) 3.関連する部分空間を見つけることによるニューラル ネットワーク予測のもつれのない説明。 (クラウス・ロバート・ミュラーより) 4. L-HYDRA: マルチヘッドの物理学に基づいたニューラル ネットワーク。 (ジョージ・エム・カルニアダキスより) 5. Transformer による強化学習の変革について: 開発の軌跡。 (タオ大成より) 6.最適化されたバイナリを逆コンパイルするためのニューラル ネットワークの強化。 (カイ・チェンより) 7. NeuroExplainer: 早産児の皮質発達パターンを明らかにするためのきめ細かな注意デコーディング。 (沈丁崗より) 8.人間のような少数ショット学習の理論。 (ミン・リーより) 9.圧縮更新による時間差学習: エラー フィードバックと強化学習の出会い。 (ジョージ・J・パパスより) 10.マルチマージナル最適輸送の反転による、集約データからの潜在人口フローの推定。 (Zha 宏源より)

科学研究のあらゆる側面では、機器の精度不足による機器誤差、操作の人的ミスによる誤差、極限環境などの外部干渉による情報の歪みなど、大量のノイズが発生します。など。騒音は実行される作業に悪影響を与えることが多いということは、研究者の間で共通の想定となっています。したがって、「ノイズ低減」という中核的なタスクを中心に、大量の研究作業が行われてきました。しかし、ノースウェスタン工科大学の Li Xuelong 教授のチームは、信号検出および処理タスクを実行する際の実験観察を通じて、この仮定に疑問を投げかけました。科学研究におけるノイズは本当に常に有害なのでしょうか?

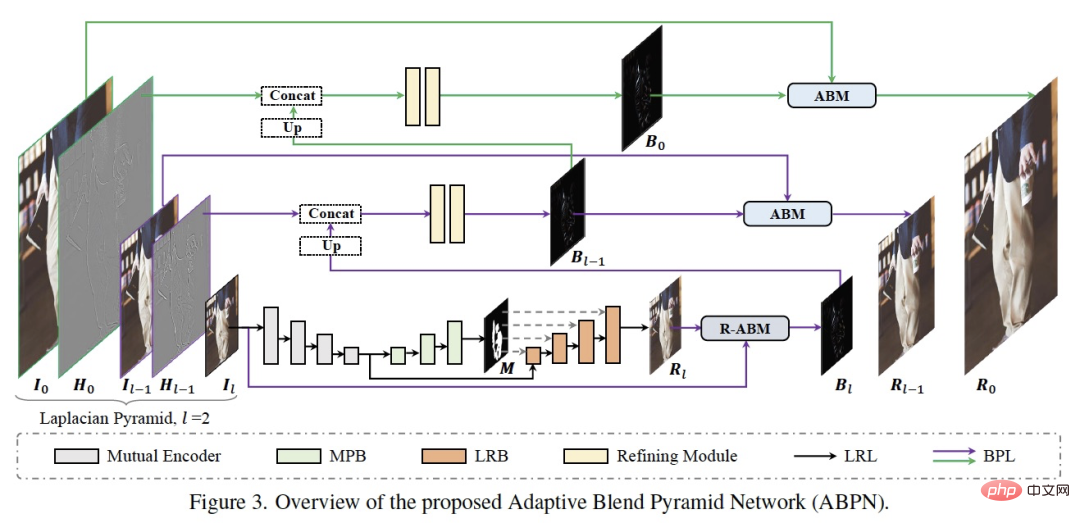

#上の図に示すように、ネットワーク構造は主に 2 つの部分で構成されます。コンテキスト認識型ローカル変更レイヤー (LRL) と適応ハイブリッド ピラミッドです。レイヤー(BPL)。 LRL の目的は、グローバル コンテキスト情報とローカル テクスチャ情報を十分に考慮して、ダウンサンプリングされた低解像度画像を局所的に変更し、低解像度変更結果画像を生成することです。さらに、BPL は、LRL で生成された低解像度の結果を高解像度の結果に徐々にアップスケールするために使用されます。その中で、適応ブレンディング モジュール (ABM) とその逆モジュール (R-ABM) を設計し、中間ブレンディング層 Bi を使用して、元の画像と結果画像の間の適応変換と上方拡張を実現し、強力なスケーラビリティを示します。細部まで忠実な機能。顔の変更と服装の変更の 2 つのデータセットで多数の実験を行った結果、私たちの方法が有効性と効率の点で既存の方法よりも大幅に優れていることがわかりました。私たちのモデルは、1 枚のカード P100 上で 4K 超高解像度画像のリアルタイム推論を実現していることは言及する価値があります。

#上の図に示すように、ネットワーク構造は主に 2 つの部分で構成されます。コンテキスト認識型ローカル変更レイヤー (LRL) と適応ハイブリッド ピラミッドです。レイヤー(BPL)。 LRL の目的は、グローバル コンテキスト情報とローカル テクスチャ情報を十分に考慮して、ダウンサンプリングされた低解像度画像を局所的に変更し、低解像度変更結果画像を生成することです。さらに、BPL は、LRL で生成された低解像度の結果を高解像度の結果に徐々にアップスケールするために使用されます。その中で、適応ブレンディング モジュール (ABM) とその逆モジュール (R-ABM) を設計し、中間ブレンディング層 Bi を使用して、元の画像と結果画像の間の適応変換と上方拡張を実現し、強力なスケーラビリティを示します。細部まで忠実な機能。顔の変更と服装の変更の 2 つのデータセットで多数の実験を行った結果、私たちの方法が有効性と効率の点で既存の方法よりも大幅に優れていることがわかりました。私たちのモデルは、1 枚のカード P100 上で 4K 超高解像度画像のリアルタイム推論を実現していることは言及する価値があります。

CLIP と同様にパラメーターの半分で、Visual Transformer はピクセルから画像とテキストの統合を実現します。

CLIP と同様にパラメーターの半分で、Visual Transformer はピクセルから画像とテキストの統合を実現します。 ArXiv Weekly Radiostation

以上が推論速度は安定拡散の 2 倍高速、Visual Transformer により画像テキストが統一されますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。