- 論文アドレス: https://arxiv.org/pdf/2302.09778v2.pdf

- #プロジェクトアドレス: https://github.com/damo-vilab/composer

最新の研究は、構成品質とモデル作成を維持しながら、出力画像 (空間レイアウトやカラー パレットなど) を柔軟に制御できる新しい生成パラダイムを提供します。

この研究では、構成性を中心的な考え方としており、まず画像を代表的な要素に分解し、次にこれらの要素を条件とした拡散モデルをトレーニングして入力を再構成します。推論段階では、豊富な中間表現が構成可能な要素として機能し、カスタマイズ可能なコンテンツを作成するための巨大な設計スペースを提供します (つまり、分解要素の数に指数関数的に比例します)。 Composer という名前のメソッドが、グローバル情報としてのテキスト記述、ローカル ガイダンスとしての深度マップとスケッチ、低レベルの詳細としてのカラー ヒストグラムなど、さまざまなレベルの条件をサポートしていることは注目に値します。

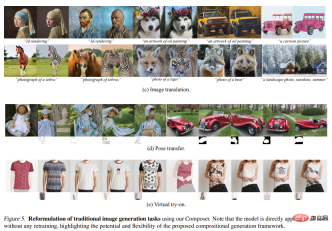

この研究では、制御性の向上に加えて、Composer が再トレーニングを必要とせずに幅広い古典的な生成タスクを容易にする一般的なフレームワークとして機能できることが確認されました。

方法

この記事で紹介するフレームワークには、分解段階 (画像が一連の独立したコンポーネントに分割される) と合成段階 (コンポーネントが再結合される) が含まれます。条件付き拡散モデルを使用)。ここでは、まず Composer を使用して実装された拡散モデルと誘導方向について簡単に紹介し、次に画像の分解と合成の実装について詳しく説明します。

2.1. 拡散モデル

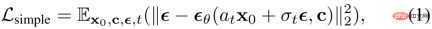

拡散モデルは、反復処理を通じてガウス ノイズからデータを生成する生成モデルです。ノイズ除去プロセス、データの生成。通常、単純な平均二乗誤差がノイズ除去ターゲットとして使用されます。

ここで、x_0 はオプションの条件です。 c のトレーニング データ、

は加法性ガウス ノイズ、a_t と σ_t は t のスカラー関数、 は学習可能なパラメーター θ を持つ拡散モデルです。分類子を使用しないブートストラップは、拡散モデルの条件付きデータ サンプリングの最近の研究で最も広く使用されており、予測ノイズは次のように調整されます。

は学習可能なパラメーター θ を持つ拡散モデルです。分類子を使用しないブートストラップは、拡散モデルの条件付きデータ サンプリングの最近の研究で最も広く使用されており、予測ノイズは次のように調整されます。  ##式

##式

# において、ω はガイダンスの重みです。 DDIM と DPM ソルバーは、拡散モデルのサンプリング プロセスを高速化するためによく使用されます。 DDIM を使用して、サンプル x_0 を純粋なノイズ電位 x_T に反転することもでき、さまざまな画像編集操作が可能になります。

# において、ω はガイダンスの重みです。 DDIM と DPM ソルバーは、拡散モデルのサンプリング プロセスを高速化するためによく使用されます。 DDIM を使用して、サンプル x_0 を純粋なノイズ電位 x_T に反転することもでき、さまざまな画像編集操作が可能になります。

ガイダンスの方向: Composer は、さまざまな条件を受け入れ、分類子のガイダンスなしでさまざまな方向を達成できる拡散モデルです。

##c_1 と c_2 は 2 つの条件セットです。 c_1 と c_2 の異なる選択は、条件の異なる重点を表します。

(c_2 c_1)内の条件はωとして強調され、(c_1 c_2)内の条件は(1−ω)として抑制され、c1∩内の条件の誘導重みはc2は1.0です。双方向ガイダンス: 条件 c_1 を使用して画像 x_0 を基になる x_T に反転し、次に別の条件 c_2 を使用して x_T からサンプリングすることにより、Composer を使用して画像を解きほぐす方法で操作できます。操作の方向は次のとおりです。 c_2 と c_1 は差異によって定義されます。

分解

画像を、画像のさまざまな側面を捉えた分離された表現に分解し、タスクを記述することについての研究で使用される 8 つの表現は、トレーニング プロセス中にリアルタイムで抽出されます。

説明 (キャプション) : 画像テキストのトレーニング データにおけるタイトルまたは説明情報の直接使用を研究します。 (例えば、LAION-5B (Schuhmann et al., 2022)) をイメージ図として示します。注釈が利用できない場合は、事前トレーニングされた画像を利用してモデルを説明することもできます。事前トレーニングされた CLIP ViT-L /14@336px (Radford et al., 2021) モデルから抽出された文と単語の埋め込みを使用して、これらのタイトルを特徴付けます。

セマンティクスとスタイル: 事前トレーニングされた CLIP ViT-L/14@336px モデルを使用して抽出された調査画像 埋め込みは特徴付けに使用されますunCLIP と同様の画像のセマンティクスとスタイル。

Color: 平滑化された CIELab ヒストグラムを使用して、画像の色の統計を調べます。 10 のスムージング シグマを使用して、CIELab 色空間を 11 の色相値、5 つの彩度値、および 5 つの光値に量子化します。経験上、この設定の方が効果的です。

スケッチ : エッジ検出モデルの適用を検討し、スケッチ簡略化アルゴリズムを使用して画像のスケッチを抽出します。 Sketch は、少ないセマンティクスで画像の局所的な詳細をキャプチャします。

インスタンス: 事前トレーニングされた YOLOv5 モデルを使用して、画像にインスタンス セグメンテーションを適用してインスタンス マスクを抽出します。インスタンス セグメンテーション マスクは、ビジュアル オブジェクトのカテゴリおよび形状情報を反映します。

深度マップ : 事前トレーニングされた単眼深度推定モデルを使用して画像の深度マップを抽出し、画像を大まかにキャプチャする方法を研究します。レイアウト。

強度: この研究では、元のグレースケール画像を表現として導入し、モデルに解きほぐされた自由度の処理方法を学習させます。色の。ランダム性を導入するために、事前定義された RGB チャネル重みのセットから均一にサンプリングして、グレースケール イメージを作成します。

マスキング : Composer が画像の生成や操作を編集可能な領域に制限できるようにするために、画像マスクの導入を検討します。 4 チャネル表現が使用されます。最初の 3 チャネルはマスクされた RGB イメージに対応し、最後のチャネルはバイナリ マスクに対応します。

なお、本稿では上記8つの条件で実験を行いましたが、Composerを利用して条件を自由にカスタマイズすることも可能です。

合成

拡散モデルを使用して一連の表現から画像を再結合する研究。具体的には、この研究では GLIDE アーキテクチャを活用し、そのチューニング モジュールを変更します。この研究では、表現に基づいてモデルを適応させるための 2 つの異なるメカニズムを調査します。

グローバル コンディショニング: CLIP 文の埋め込み、画像の埋め込み、カラー パレットを含むグローバル表現の場合、それらを投影してタイムステップの埋め込みに追加します。さらに、画像の埋め込みとカラー パレットを 8 つの追加のトークンに投影し、それらを CLIP の単語の埋め込みと連結します。これらは、unCLIP と同様に、GLIDE でクロスアテンションのコンテキストとして使用されます。条件は加算的であるか、クロスアテンションで選択的にマスクできるため、トレーニング中や推論中に条件を直接削除したり、新しいグローバル条件を導入したりできます。

ローカライゼーション コンディショニング: スケッチ、セグメンテーション マスク、深度マップ、強度イメージ、マスク イメージなどのローカライズされた表現の場合、積み重ねられた畳み込みレイヤーを使用して、それらをノイズとともに投影します。潜在 x_t は均一です。 -同じ空間サイズを持つ次元埋め込み。次に、これらの埋め込みの合計が計算され、その結果が x_t に連結され、UNet に供給されます。埋め込みは付加的であるため、欠落した条件を適応させたり、新しい局所的な条件を組み込んだりすることが簡単です。

共同トレーニング戦略: さまざまな条件の組み合わせから画像をデコードする方法をモデルが学習できるようにする共同トレーニング戦略を設計することが重要です。この調査では、いくつかの構成を実験し、各条件の独立した終了確率 0.5、すべての条件を削除する確率 0.1、およびすべての条件を維持する確率 0.1 を使用する、シンプルかつ効果的な構成を特定しました。強度イメージにはイメージに関する大部分の情報が含まれており、トレーニング中に他の条件を弱める可能性があるため、強度イメージには特別なドロップアウト確率 0.7 が使用されます。

基本的な拡散モデルは、64 × 64 の解像度の画像を生成します。高解像度の画像を生成するために、アップサンプリング用の 2 つの無条件拡散モデルをトレーニングし、それぞれ画像を 64 × 64 から 256 × 256 の解像度に、および 256 × 256 から 1024 × 1024 の解像度にアップサンプリングしました。アップサンプリング モデルのアーキテクチャは unCLIP から変更されており、低解像度レイヤーでより多くのチャネルの使用が検討され、容量を拡張するためにセルフ アテンション ブロックが導入されています。字幕から画像埋め込みを生成するオプションの以前のモデルも導入されています。経験的に、従来のモデルは、条件の特定の組み合わせの下で生成される画像の多様性を向上させることができます。

実験

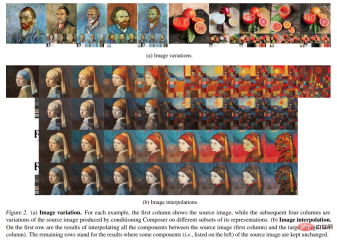

バリエーション: Composer を使用すると、指定された画像に似ていますが、その表現の特定のサブセットに条件付けされた新しい画像を作成できます。いくつかの方法。異なる表現の組み合わせを慎重に選択することで、画像の変化の範囲を柔軟に制御できます (図 2a)。さらに多くの条件を組み込んだ後、研究で提示された方法は、画像の埋め込みのみを条件とする unCLIP のバリアントを生成します。Composer を使用すると、特定の画像に似た新しい画像を作成できますが、その表現の特定のサブセットが条件となります。 . 反省、いくつかの点で異なります。異なる表現の組み合わせを慎重に選択することで、画像の変化の範囲を柔軟に制御できます (図 2a)。より多くの条件を組み込んだ後、提案手法は、画像埋め込みのみを条件とする unCLIP よりも高い再構成精度を達成します。

#

#

以上がAI塗装の新発想:50億パラメータを備えた国産オープンソース新モデル、合成制御性と品質の飛躍を実現の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

あなたは無知のベールの後ろに職場AIを構築する必要がありますApr 29, 2025 am 11:15 AM

あなたは無知のベールの後ろに職場AIを構築する必要がありますApr 29, 2025 am 11:15 AMジョン・ロールズの独創的な1971年の著書「正義の理論」で、彼は私たちが今日のAIデザインの核となり、意思決定を使用するべきであるという思考実験を提案しました:無知のベール。この哲学は、公平性を理解するための簡単なツールを提供し、リーダーがこの理解を使用してAIを公平に設計および実装するための青写真を提供します。 あなたが新しい社会のルールを作っていると想像してください。しかし、前提があります。この社会でどのような役割を果たすかは事前にわかりません。過半数または限界少数派に属している、金持ちまたは貧弱、健康、または障害者になることがあります。この「無知のベール」の下で活動することで、ルールメーカーが自分自身に利益をもたらす決定を下すことができません。それどころか、人々はより公衆を策定する意欲があります

決定、決定…実用的な応用AIの次のステップApr 29, 2025 am 11:14 AM

決定、決定…実用的な応用AIの次のステップApr 29, 2025 am 11:14 AMロボットプロセスオートメーション(RPA)を専門とする多くの企業は、繰り返しタスクを自動化するためのボットを提供しています。 一方、プロセスマイニング、オーケストレーション、インテリジェントドキュメント処理スペシャル

エージェントが来ています - 私たちがAIパートナーの隣ですることについてもっとApr 29, 2025 am 11:13 AM

エージェントが来ています - 私たちがAIパートナーの隣ですることについてもっとApr 29, 2025 am 11:13 AMAIの未来は、単純な単語の予測と会話シミュレーションを超えて動いています。 AIエージェントは出現しており、独立したアクションとタスクの完了が可能です。 このシフトは、AnthropicのClaudeのようなツールですでに明らかです。 AIエージェント:研究a

共感がAI主導の未来におけるリーダーのコントロールよりも重要である理由Apr 29, 2025 am 11:12 AM

共感がAI主導の未来におけるリーダーのコントロールよりも重要である理由Apr 29, 2025 am 11:12 AM急速な技術の進歩は、仕事の未来に関する将来の見通しの視点を必要とします。 AIが単なる生産性向上を超えて、私たちの社会構造の形成を開始するとどうなりますか? Topher McDougalの今後の本、Gaia Wakes:

製品分類のためのAI:マシンは税法を習得できますか?Apr 29, 2025 am 11:11 AM

製品分類のためのAI:マシンは税法を習得できますか?Apr 29, 2025 am 11:11 AM多くの場合、Harmonized System(HS)などのシステムからの「HS 8471.30」などの複雑なコードを含む製品分類は、国際貿易と国内販売に不可欠です。 これらのコードは、すべてのINVに影響を与える正しい税申請を保証します

データセンターの要求は、気候技術のリバウンドを引き起こす可能性がありますか?Apr 29, 2025 am 11:10 AM

データセンターの要求は、気候技術のリバウンドを引き起こす可能性がありますか?Apr 29, 2025 am 11:10 AMデータセンターと気候技術投資におけるエネルギー消費の将来 この記事では、AIが推進するデータセンターのエネルギー消費の急増と気候変動への影響を調査し、この課題に対処するための革新的なソリューションと政策の推奨事項を分析します。 エネルギー需要の課題:大規模で超大規模なデータセンターは、数十万の普通の北米の家族の合計に匹敵する巨大な力を消費し、新たなAIの超大規模なセンターは、これよりも数十倍の力を消費します。 2024年の最初の8か月で、Microsoft、Meta、Google、Amazonは、AIデータセンターの建設と運用に約1,250億米ドルを投資しました(JP Morgan、2024)(表1)。 エネルギー需要の成長は、挑戦と機会の両方です。カナリアメディアによると、迫り来る電気

AIとハリウッドの次の黄金時代Apr 29, 2025 am 11:09 AM

AIとハリウッドの次の黄金時代Apr 29, 2025 am 11:09 AM生成AIは、映画とテレビの制作に革命をもたらしています。 LumaのRay 2モデル、滑走路のGen-4、OpenaiのSora、GoogleのVEO、その他の新しいモデルは、前例のない速度で生成されたビデオの品質を向上させています。これらのモデルは、複雑な特殊効果と現実的なシーンを簡単に作成できます。短いビデオクリップやカメラ認知モーション効果も達成されています。これらのツールの操作と一貫性を改善する必要がありますが、進歩の速度は驚くべきものです。 生成ビデオは独立した媒体になりつつあります。アニメーション制作が得意なモデルもあれば、実写画像が得意なモデルもあります。 AdobeのFireflyとMoonvalleyのMAであることは注目に値します

ChatGptはゆっくりとAIの最大のYES-MANになりますか?Apr 29, 2025 am 11:08 AM

ChatGptはゆっくりとAIの最大のYES-MANになりますか?Apr 29, 2025 am 11:08 AMChatGptユーザーエクスペリエンスは低下します:それはモデルの劣化ですか、それともユーザーの期待ですか? 最近、多数のCHATGPT有料ユーザーがパフォーマンスの劣化について不満を述べています。 ユーザーは、モデルへの応答が遅く、答えが短い、助けの欠如、さらに多くの幻覚を報告しました。一部のユーザーは、ソーシャルメディアに不満を表明し、ChatGptは「お世辞になりすぎて」、重要なフィードバックを提供するのではなく、ユーザービューを検証する傾向があることを指摘しています。 これは、ユーザーエクスペリエンスに影響を与えるだけでなく、生産性の低下やコンピューティングリソースの無駄など、企業の顧客に実際の損失をもたらします。 パフォーマンスの劣化の証拠 多くのユーザーは、特にGPT-4などの古いモデル(今月末にサービスから廃止される)で、ChatGPTパフォーマンスの大幅な分解を報告しています。 これ

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

MinGW - Minimalist GNU for Windows

このプロジェクトは osdn.net/projects/mingw に移行中です。引き続きそこでフォローしていただけます。 MinGW: GNU Compiler Collection (GCC) のネイティブ Windows ポートであり、ネイティブ Windows アプリケーションを構築するための自由に配布可能なインポート ライブラリとヘッダー ファイルであり、C99 機能をサポートする MSVC ランタイムの拡張機能が含まれています。すべての MinGW ソフトウェアは 64 ビット Windows プラットフォームで実行できます。

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!

SublimeText3 Linux 新バージョン

SublimeText3 Linux 最新バージョン

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

ホットトピック

7814

7814 15

15 1646

1646 14

14 1402

1402 52

52 1300

1300 25

25 1238

1238 29

29