ホームページ >テクノロジー周辺機器 >AI >2023 年の初日は、ChatGPT の年末総括をぜひチェックしてください。

2023 年の初日は、ChatGPT の年末総括をぜひチェックしてください。

- PHPz転載

- 2023-04-12 18:31:041041ブラウズ

ChatGPT の出現は、最も技術的なものではないかもしれませんが、2022 年下半期で最も目を引く AI の進歩となるかもしれません。

少し前、ニューオーリンズで開催された 2022 NeurIPS では、GPT-4 に関する噂が絶えませんでした。ニュースメディアに焦点を当てます。

OpenAI は、AI 大規模言語モデルの GPT-3 シリーズの新しいモデル text-davinci-003 を発表しました。これはその「GPT-3.5」です。シリーズ」の部分は、より複雑な命令を処理し、より高品質で長い形式のコンテンツを生成することでパフォーマンスを向上させることができます。

#新しいモデルは InstructGPT に基づいて構築されており、人間のフィードバックによる強化学習を使用して、言語モデルを人間との互換性を高めています。指示がより適切に調整されます。

DaVinci-003 は、ヒューマン フィードバックを使用した真の強化学習 (RLHF) モデルであり、人間によるデモンストレーションや高スコアのモデル サンプルで優れたパフォーマンスを発揮します。生成品質を向上させるためのチューニング。 "

"GPT-3.5 シリーズ" の別の一部として、OpenAI は ChatGPT の初期デモをリリースしました。同社は、この対話型会話モデルだけでなく、あなたは多数のフォローアップの質問に答えることができますが、間違いを認めたり、間違った前提に異議を唱えたり、不適切な要求を拒否したりすることもできます。

#OpenAI はブログ投稿で、ChatGPT の研究リリースは「安全性と有用性が高まる AI の OpenAI による反復展開」であると述べました。システムの最新ステップ。GPT-3 や Codex などの以前のモデルの展開から学んだ多くの教訓が組み込まれており、ヒューマン フィードバックによる強化学習 (RLHF) を活用する際に、有害で非現実的な出力結果が大幅に削減されます。 ##また、ChatGPT はトレーニング中に機械学習モデルであることを強調していましたが、これは少し前に Google のチャットロボット LaMDA によって引き起こされた「AI に意識があるかどうか」の問題を回避するためかもしれません。 紛争。

# もちろん、ChatGPT にも制限があります。

OpenAI は、ブログ投稿の中で、答えが合理的であるように見えても、実際には不正確または無意味である場合があることを含め、その制限について詳しく説明しました。

「この問題を解決することは非常に困難です。その理由は、(1) 現在、強化学習のトレーニング中に信頼できるソースの保証がないためです。(2) ) トレーニングされたモデルは、より多くの情報源を必要とします。慎重で、正しく答えられる可能性のある質問を拒否します。(3) 理想的な答えは、人間のデモンストレーターが知っていることではなく、モデルが知っていることに依存するため、教師ありトレーニングはモデルを誤解させる可能性があります。」

#Open AI は、ChatGPT が「有害な命令に反応したり、偏った動作を示したりすることがあります。私たちは API を使用して、特定の種類の安全でないコンテンツを警告またはブロックしていますが、誤検知や誤検知が発生することが予想されます」と述べています。私たちは、このモデルを改善するための継続的な作業に役立てるために、ユーザーからのフィードバックを収集することに非常に興味を持っています。」

ChatGPT にはまだ改善が必要な問題がたくさんあるかもしれませんが、GPT-4 が登場する前は ChatGPT が依然として現在のトップであることは否定できません。大規模な言語モデルのフロー。

しかし、最近のコミュニティでは、全員の議論の熱意を刺激する新しいモデルが登場しました。最も重要なことは、オープンソースであるということです。今週、Meta の Make-A-Video を含むクローズドソース AI システムのリバース エンジニアリングを担当する開発者 Philip Wang は、テキスト生成モデルである PaLM RLHF をリリースしました。 ChatGPT のように動作します。

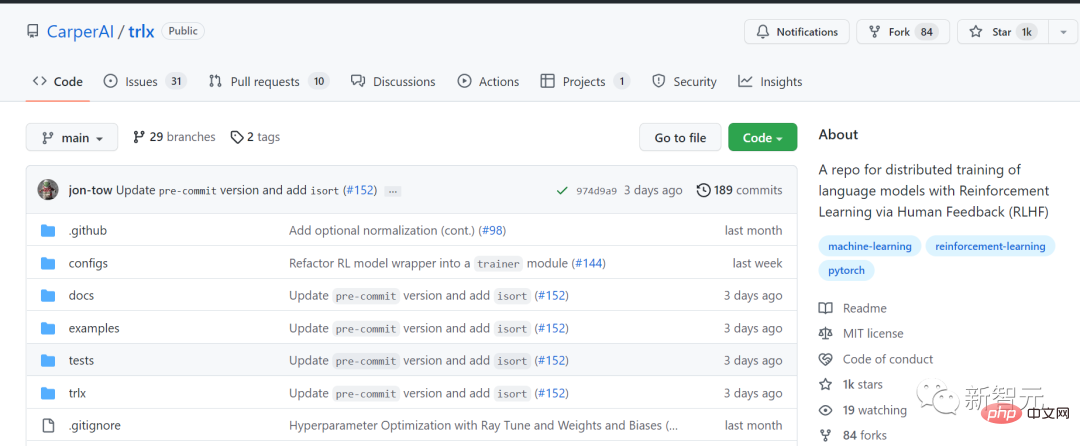

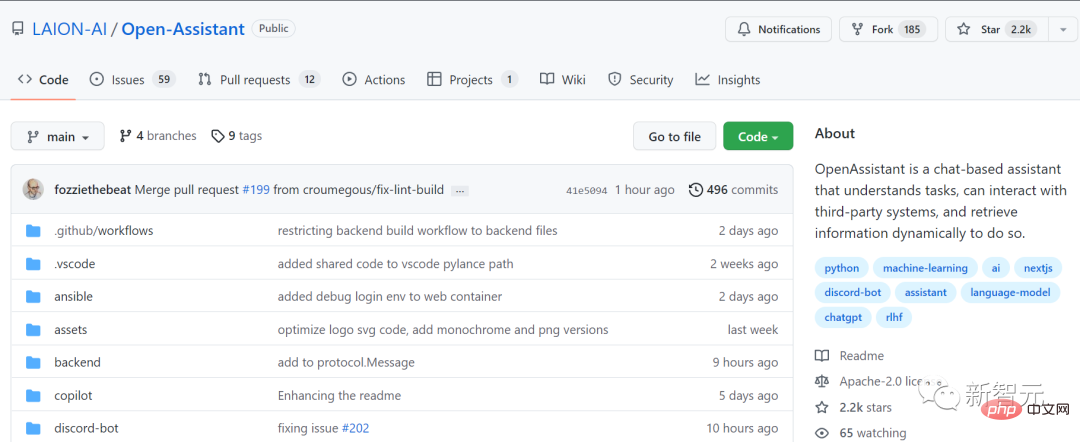

# コードアドレス: https://github.com/lucidrains/PaLM-rlhf-pytorch #このシステムは、Google の大規模言語モデル PaLM と強化学習とヒューマン フィードバック (RLHF) テクノロジーを組み合わせて、電子メールの下書きやコンピューター コードの提案など、ChatGPT のほぼすべてのタスクを完了できるシステムを作成します。 リリース以来、ChatGPT は高解像度の人間データを生成することができました。そして、会話形式でユーザーの質問に応答するその機能は、テクノロジーの世界に旋風を巻き起こしました。 これはチャットボット開発の初期段階では大きな進歩ですが、人工知能の分野の多くのファンは ChatGPT の閉鎖的な性質について懸念を表明しています。 今日に至るまで、ChatGPT モデルは独自仕様のままです。つまり、その基礎となるコードを一般公開することはできません。 OpenAI だけが実際にどのように動作し、どのようなデータを処理するかを知っています。この透明性の欠如は広範囲に影響を与える可能性があり、長期的にはユーザーの信頼に影響を与える可能性があります。 # 多くの開発者がオープンソースの代替手段の構築を熱望してきましたが、ついにそれが実現しました。 PaLM RLHF は Python 言語専用に構築されており、PyTorch 用に実装できます。 開発者は、自己回帰変換器と同じくらい簡単に PaLM をトレーニングし、人間のフィードバックを使用して報酬モデルをトレーニングできます。 ChatGPT と同様、PaLM RLHF は本質的に単語を予測するための統計ツールです。 Reddit からの投稿、ニュース記事、電子書籍などのトレーニング データから多数の例が入力されると、PaLM RLHF は周囲のテキストの意味コンテキストなどのパターンに基づいて単語が出現する可能性を学習します。 # PaLM RLHF を起動するには、ユーザーはブログ、ソーシャル メディア、ニュース記事、電子書籍などのさまざまなソースから取得したギガバイトのテキストを編集する必要があります。もっと。 このデータは、微調整された PaLm モデルに供給され、いくつかの応答が生成されます。たとえば、モデルに「経済学の基礎知識は何ですか?」と質問すると、PaLm は「経済学は社会科学を研究するもので...」といった答えを返します。 #その後、開発者はモデルによって生成された回答を最良から最悪までランク付けし、報酬モデルを作成するよう人々に依頼します。最後に、ランキングは、元のモデルの応答を取得して優先順に並べ替え、特定のプロンプトに対する最良の回答を除外する「報酬モデル」をトレーニングするために使用されます。 # ただし、これは高価なプロセスです。トレーニング データを収集し、モデル自体をトレーニングするのは費用がかかります。 PaLM には 5,400 億のパラメータがあり、言語モデルはこれをトレーニング データから学習します。 2020 年の調査では、わずか 15 億のパラメーターを使用したテキスト生成モデルの開発には、最大 160 万ドルの費用がかかることが示されています。 #今年 7 月、オープンソース モデル Bloom を 1,760 億のパラメータでトレーニングするために、Hugging Face の研究者は 3 か月を費やし、384 個の NVIDIA A100 GPU を使用しました。 A100 の価格はそれぞれ数千ドルですが、平均的なユーザーが支払える金額ではありません。 さらに、モデルをトレーニングした後でも、PaLM RLHF のサイズのモデルを実行するのは簡単ではありません。 Bloom は 8 つの A100 GPU を搭載した専用 PC を所有しており、OpenAI のテキスト生成 GPT-3 (約 1,750 億のパラメータを持つ) の実行コストは年間約 87,000 ドルです。 AI 研究者の Sebastian Raschka 氏は、PaLM RLHF に関する記事の中で、必要な開発ワークフローをスケールアップすることも課題になる可能性があると述べています。 「このモデルをトレーニングするために誰かが 500 GPU を与えたとしても、インフラストラクチャを処理し、それを処理できるソフトウェア フレームワークを用意する必要があります。」彼は言った。 「これは実現可能ですが、現時点では多くの労力が必要です。」 ##高コストと巨大な規模は、潤沢な資金を持つ企業や個人がモデルのトレーニングに苦労しない限り、現時点では PaLM RLHF が ChatGPT を置き換える能力を持っていないことを示しています。 #現時点では、PaLM RLHF の正確なリリース日はありません。参考までに、Hugging Face がブルームを訓練するのに 3 か月かかりました。対照的に、PaLM RLHF には 5,400 億のパラメータがあり、意味のあるバージョンが作成されるまでに 6 ~ 8 か月かかる場合があります。 良いニュースは、これまでのところ、ChatGPT に代わるこのオープンソースの開発に取り組んでいる既知のプレーヤーが 3 名いることです。 CarperAI は、EleutherAI およびスタートアップの Scale AI および Hugging Face An AI と提携して、最初のすぐに実行できる ChatGPT のようなアプリをリリースする予定です。人間のフィードバックでトレーニングされたモデル。 コードアドレス: https://github.com/CarperAI/trlx #LAION は、Stable Diffusion の初期データセットを提供した非営利団体で、最新の機械学習テクノロジーを使用して ChatGPT を複製するプロジェクトの先頭に立っています。 そして、YouTube の有名人で AI 研究者のヤニック・キルチャーによって作成された GPT-4chan は、むしろ「泥の中から出てきて、悪口の専門家」のようなものです。完全に汚れています。」 このモデルの「4chan」はアメリカのオンライン匿名フォーラムで、ネチズンの身元が匿名であるため、多くの人が恐れを知らず、さまざまな政治的意見を表明します。不正確な発言。キルチャー氏は公式に 4chan の投稿をモデルのトレーニングに使用しており、結果は予測可能です。 #フォーラムの一般的な論調と同様に、GPT-4chan の回答は人種差別、性差別、反ユダヤ主義に満ちていました。それだけでなく、キルチャーは他の人がダウンロードできるように、その基礎となるモデルを Hugging Face に投稿しました。しかし、多くの AI 研究者の非難を受けて、当局はすぐにネットユーザーのモデルへのアクセスを制限しました。 #私たちは、より多くのオープンソース言語モデルの出現を楽しみにしていますが、今できることは待つことだけです。もちろん、ChatGPT を無料で使い続けるのも良いでしょう。 #OpenAI は、オープン ソース バージョンが正式にリリースされる前に、開発がまだはるかに先を行っていることは注目に値します。 2023 年、GPT-4 は間違いなく世界中の AI 愛好家が楽しみにしているものです。 無数の AI 巨人がそれについて独自の予測を立てています。これらの予測は良いか悪いかは別として、OpenAI の COO サム アルトマン氏は次のように述べています。「一般的な人工知能の完成は、ほとんどの人が想像しているよりも早くなるでしょう」そしてそれは、ほとんどの人が想像するすべてを変えます。」

#PaLm RLHF のパワー

# もちろん、理想と現実の間にはまだ大きなギャップがあります。 PaLM RLHF は完璧に見えますが、さまざまな問題もあります。最大の問題は、人々がまだそれを使用できないことです。

次のオープンソース ChatGPT

以上が2023 年の初日は、ChatGPT の年末総括をぜひチェックしてください。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。