ホグワーツの魔法がなくても、他の人が何を考えているかを見ることができます。

手法は非常にシンプルで、安定拡散に基づいて脳画像を可視化します。

たとえば、あなたが目にするクマ、飛行機、電車はこんな感じです。

AI が脳信号を認識すると、生成される画像は次のとおりです。ポイントも含まれております。

この AI 脳読み取りテクノロジーは、CVPR 2023 に承認されたばかりで、ファンに瞬時の「頭蓋内オーガズム」を与えます。

#ワイルドすぎる!プロジェクトを促すことは忘れて、頭を使ってそれらの写真について「考える」だけで済みます。

安定拡散を使用して fMRI データから視覚画像を再構成することを想像してください。これは、非侵襲的技術の開発を意味するかもしれません。将来のブレインコンピューターインターフェース。

AI に人間の言語を直接スキップさせ、人間の脳で考えていることを認識させます。

微調整不要、AI で思考をダイレクトに再現

では、AI はどのようにして脳の読み取りを実現しているのでしょうか?最新の研究は、日本の大阪大学の研究チームによるものです。

大阪大学大学院生命機能研究科とNICTのCiNetの研究者らは、潜在拡散モデル(LDM)、より具体的には安定拡散を介して、fMRIデータから視覚体験を再構築しました。

全体の操作プロセスのフレームワークも非常にシンプルです: 1 つの画像エンコーダー、1 つの画像デコーダー、および 1 つのセマンティック デコーダー。

トレーニングする必要があるのは、下部視覚脳領域と上部視覚脳領域からの fMRI 信号を単一の安定拡散コンポーネントにマッピングする単純な線形モデルだけです。

具体的には、研究者らは脳領域を画像およびテキストエンコーダーへの入力としてマッピングしました。下位脳領域は画像エンコーダにマッピングされ、上位脳領域はテキスト エンコーダにマッピングされます。これにより、システムは再構成に画像構成と意味論的なコンテンツを使用できるようになります。

最初はデコード分析です。研究で使用された LDM モデルは、画像エンコーダー ε、画像デコーダー D、およびテキスト エンコーダー τ で構成されます。

研究者らは、それぞれ初期視覚野と高レベル視覚野の fMRI 信号から再構成画像 z の潜在表現と関連テキスト c を解読し、それらを入力として使用して、オートエンコーダ。

研究者らは、LDM のさまざまなコンポーネントからの fMRI 信号を予測するためのコーディング モデルを確立しました。 LDMの仕組み。

研究者らは、自然風景データセット (NSD) の fMRI 画像を使用して実験を行い、安定した拡散が可能かどうかをテストしました。被験者が見たものを再構成します。

符号化モデルと LDM に関連する潜像の予測精度は、最後のモデルが脳の後部の視覚野で最も高い予測精度を生み出すことがわかります。 。

被験者の視覚的再構成の結果は、z のみを使用して再構成された画像が元の画像と視覚的に一致していることを示しています。ただし、意味的な内容をキャプチャすることはできません。

c のみを使用して再構成された画像は意味的忠実度が高くなりますが、視覚的な一貫性が劣りますが、zc を使用して再構成された画像は意味的忠実度が高く、視覚的な一貫性が低い可能性があります。

#同じ画像上のすべての被写体からの再構成結果は、再構成の効果が被写体ごとに異なることを示しています。安定しています。比較的正確です。

特定の詳細の違いは、再構成プロセスのエラーではなく、個人の知覚経験やデータ品質の違いに起因する可能性があります。

#最後に、定量的評価の結果をグラフ化しました。

さまざまな結果は、研究で使用された方法が低レベルの視覚的外観をキャプチャできるだけでなく、元の刺激の高レベルの意味内容もキャプチャできることを示しています。

被験者間で精度には差があったが、これらの違いはfMRI画像の品質に関係していた、と研究者らは述べた。チームによると、再構成の品質は現在のSOTA手法と同等ですが、そこで使用されるAIモデルのトレーニングは必要ありません。

同時に、チームは fMRI データから派生したモデルを使用して、逆拡散プロセス中にセマンティック コンテンツがどのように生成されるかなど、安定拡散のさまざまな構成要素を研究しました。 U-Net でどのようなプロセスが行われるか。

ノイズ除去プロセスの初期段階では、U-Net のボトルネック レイヤー (オレンジ) が最高の予測パフォーマンスを生み出し、ノイズ除去プロセスが進むにつれて、初期レイヤー (青) が予測用に生成されます。初期の視覚野の活動のボトルネック層は、より高いレベルの視覚野に移行します。

これは、拡散プロセスの開始時に画像情報がボトルネック層で圧縮され、ノイズ除去により視覚野に U-Net 層間の分離が現れることを意味します。

# さらに、チームは普及のさまざまな段階での画像変換の定量的な説明を開発中です。このようにして、研究者らは、広く使用されているものの理解がまだ限られている拡散モデルを生物学的な観点からより深く理解することに貢献することを目指しています。

人間の脳画像はAIによって解読されたのでしょうか?

研究者たちは長年にわたり、人工知能モデルを使用して人間の脳からの情報を解読してきました。

ほとんどの手法の中核では、事前に記録された fMRI 画像がテキストまたは画像の生成 AI モデルへの入力として使用されます。

たとえば、2018 年の初めに、日本の研究者チームは、ニューラル ネットワークが fMRI 記録から画像を再構成する方法を示しました。

2019年、グループはサルのニューロンから画像を再構成し、ジャン・レミ・キング率いるメタの研究グループはテキストを取得するためのfMRIデータなどの新しい研究を発表した。

2022 年 10 月、テキサス大学オースティン校のチームは、GPT モデルが fMRI からデータを生成できることを示しました。スキャン ビデオ内で見られる意味論的なコンテンツを説明するテキストが推測されます。

2022 年 11 月、シンガポール国立大学、香港中文大学、スタンフォード大学の研究者は、MinD-Vis 拡散モデルを使用して、fMRI スキャンからの画像を大幅に再構成しました。当時利用可能な方法よりも正確です。

さらに遡ると、一部のネチズンは「脳波に基づいた画像の生成は少なくとも 2008 年から存在していた」と指摘しました。はい、安定拡散が何らかの方法で人々の心を読み取ることができるとほのめかすのはまったくばかげています。」

カリフォルニア大学バークレー校が Nature に掲載したこの論文では、次のように述べられています。脳波活動は、ビジュアル デコーダを使用して画像に変換できます。

しかし、最新の研究と比較すると、この再構成はまったく「高精細」とは言えず、ほとんど認識できません。 #########著者について###

高木 裕

高木 裕は、大阪大学の助教授です。彼の研究対象は、計算神経科学と人工知能の交差点にあります。

博士課程では、ATR 脳情報通信研究室で機能的磁気共鳴画像法 (fMRI) を使用して脳全体の機能的接続から個人差を予測する技術を研究しました。

最近では、オックスフォード大学の人間の脳活動に関するオックスフォード センターと、オックスフォード大学の心理学部で、機械学習技術を使用して、複雑な意思決定タスクにおける動的計算を理解しています。東京大学。

#西本真司

西本真司は大阪大学教授。彼の研究は、脳内の視覚および認知処理の定量的な理解に焦点を当てています。

より具体的には、西本教授のチームの研究の焦点は、自然な知覚および認知条件下で誘発される脳活動の予測モデルを構築することです。そして表現。

一部のネチズンは、この研究が夢の解釈に使用できるかどうかを著者に尋ねました。

「同じ技術を睡眠中の脳活動に適用することは可能ですが、そのような適用の精度は不明です。」

この研究を読んだ後: 合法性は完全に確立されています。

参考:

https: / /www.php.cn/link/0424d20160a6a558e5bf86a7bc9b67f0

https://www.php.cn/link/ 02d72b702eed900577b953ef7a9c1182

以上がAI読書脳が爆発!脳画像をスキャンし、安定拡散により画像をリアルに再現の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

AIゲーム開発は、激動の夢想家ポータルでエージェントの時代に入りますMay 02, 2025 am 11:17 AM

AIゲーム開発は、激動の夢想家ポータルでエージェントの時代に入りますMay 02, 2025 am 11:17 AM激動ゲーム:AIエージェントとのゲーム開発に革命をもたらします BlizzardやObsidianなどの業界の巨人の退役軍人で構成されるゲーム開発スタジオであるUpheavalは、革新的なAIを搭載したPlatforでゲームの作成に革命をもたらす態勢を整えています。

UberはあなたのRobotaxiショップになりたいと思っています、プロバイダーはそれらを許可しますか?May 02, 2025 am 11:16 AM

UberはあなたのRobotaxiショップになりたいと思っています、プロバイダーはそれらを許可しますか?May 02, 2025 am 11:16 AMUberのRobotaxi戦略:自動運転車用の乗車エコシステム 最近のCurbivore Conferenceで、UberのRichard Willderは、Robotaxiプロバイダーの乗車プラットフォームになるための戦略を発表しました。 で支配的な位置を活用します

ビデオゲームをプレイするAIエージェントは、将来のロボットを変革しますMay 02, 2025 am 11:15 AM

ビデオゲームをプレイするAIエージェントは、将来のロボットを変革しますMay 02, 2025 am 11:15 AMビデオゲームは、特に自律的なエージェントと現実世界のロボットの開発において、最先端のAI研究のための非常に貴重なテストの根拠であることが証明されています。 a

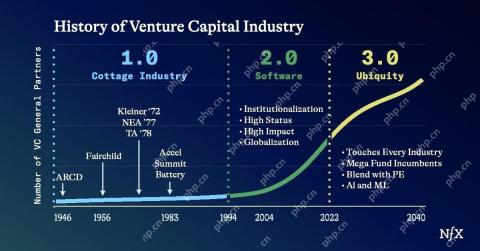

スタートアップインダストリアルコンプレックス、VC 3.0、およびジェームズクーリエのマニフェストMay 02, 2025 am 11:14 AM

スタートアップインダストリアルコンプレックス、VC 3.0、およびジェームズクーリエのマニフェストMay 02, 2025 am 11:14 AM進化するベンチャーキャピタルの景観の影響は、メディア、財務報告、日常の会話で明らかです。 ただし、投資家、スタートアップ、資金に対する特定の結果はしばしば見落とされています。 ベンチャーキャピタル3.0:パラダイム

AdobeはAdobe Max London 2025でクリエイティブクラウドとホタルを更新しますMay 02, 2025 am 11:13 AM

AdobeはAdobe Max London 2025でクリエイティブクラウドとホタルを更新しますMay 02, 2025 am 11:13 AMAdobe Max London 2025は、アクセシビリティと生成AIへの戦略的シフトを反映して、Creative Cloud and Fireflyに大幅な更新を提供しました。 この分析には、イベント以前のブリーフィングからの洞察がAdobeのリーダーシップを取り入れています。 (注:ADOB

すべてのメタがラマコンで発表しましたMay 02, 2025 am 11:12 AM

すべてのメタがラマコンで発表しましたMay 02, 2025 am 11:12 AMMetaのLlamaconアナウンスは、Openaiのような閉じたAIシステムと直接競合するように設計された包括的なAI戦略を紹介し、同時にオープンソースモデルの新しい収益ストリームを作成します。 この多面的なアプローチはBOをターゲットにします

AIは単なる通常のテクノロジーに過ぎないという提案に関する醸造論争May 02, 2025 am 11:10 AM

AIは単なる通常のテクノロジーに過ぎないという提案に関する醸造論争May 02, 2025 am 11:10 AMこの結論に関して、人工知能の分野には深刻な違いがあります。 「皇帝の新しい服」を暴露する時が来たと主張する人もいれば、人工知能は普通の技術であるという考えに強く反対する人もいます。 それについて議論しましょう。 この革新的なAIブレークスルーの分析は、AIの分野での最新の進歩をカバーする私の進行中のForbesコラムの一部です。 一般的な技術としての人工知能 第一に、この重要な議論の基礎を築くためには、いくつかの基本的な知識が必要です。 現在、人工知能をさらに発展させることに専念する大量の研究があります。全体的な目標は、人工的な一般情報(AGI)を達成し、さらには可能な人工スーパーインテリジェンス(AS)を達成することです

モデル市民、なぜAI価値が次のビジネスヤードスティックであるのかMay 02, 2025 am 11:09 AM

モデル市民、なぜAI価値が次のビジネスヤードスティックであるのかMay 02, 2025 am 11:09 AM企業のAIモデルの有効性は、現在、重要なパフォーマンス指標になっています。 AIブーム以来、生成AIは、誕生日の招待状の作成からソフトウェアコードの作成まで、すべてに使用されてきました。 これにより、言語modが急増しました

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

SublimeText3 中国語版

中国語版、とても使いやすい

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター

ドリームウィーバー CS6

ビジュアル Web 開発ツール

Dreamweaver Mac版

ビジュアル Web 開発ツール

SublimeText3 Linux 新バージョン

SublimeText3 Linux 最新バージョン

ホットトピック

7909

7909 15

15 1652

1652 14

14 1411

1411 52

52 1303

1303 25

25 1248

1248 29

29