人工知能に対する需要の高まりにより、物理デバイスに基づく型破りなコンピューティングの研究が推進されています。このようなコンピューティング デバイスは脳にヒントを得たアナログ情報処理を模倣していますが、学習プロセスは依然としてバックプロパゲーションなどの数値処理に最適化された方法に依存しており、物理的な実装には適していません。

日本の NTT デバイス技術研究所 (NTT デバイス技術研究所) と東京大学の研究チームは、ダイレクト フィードバック アライメント (DFA) と呼ばれる手法を拡張しました。物理的な深層学習を実証するためのトレーニング アルゴリズム。 元のアルゴリズムとは異なり、提案された方法は、代替の非線形活性化を伴うランダムな投影に基づいています。したがって、物理ニューラル ネットワークは、物理システムとその勾配についての知識がなくてもトレーニングできます。さらに、このトレーニングの計算は、スケーラブルな物理ハードウェア上でシミュレートできます。

研究者らは、ディープ・リザーバー・コンピューターと呼ばれる光電子リカレント・ニューラル・ネットワークを使用した概念実証を実証しました。ベンチマークで競争力のあるパフォーマンスを備えた高速コンピューティングの可能性が実証されています。その結果は、ニューロモーフィック コンピューティングのトレーニングと高速化のための実用的なソリューションを提供します。

研究のタイトルは「生物学的にインスピレーションを得たトレーニング手法を使用した物理ディープラーニング: 物理ハードウェアに対する勾配のないアプローチ」で、2022 年 12 月 26 日に「」でリリースされました。 ネイチャーコミュニケーションズ」。

物理ディープラーニング

画像処理、音声認識、ゲームなどにおける人工ニューラル ネットワーク (ANN) ベースの機械学習の記録破りのパフォーマンスに成功その卓越した能力を発揮した。これらのアルゴリズムは人間の脳の仕組みに似ていますが、基本的には従来のフォン ノイマン コンピューティング ハードウェアを使用してソフトウェア レベルで実装されます。しかし、このようなデジタルコンピューティングベースの人工ニューラルネットワークは、エネルギー消費と処理速度の点で問題を抱えています。これらの問題は、人工ニューラル ネットワークの実装に代替の物理プラットフォームを使用する動機となります。

興味深いことに、受動的な物理ダイナミクスであっても、ランダムに接続された ANN の計算リソースとして使用できます。物理リザーバー コンピューター (RC) またはエクストリーム ラーニング マシン (ELM) として知られるこのフレームワークの実装の容易さにより、実現可能な材料の選択肢とそのアプリケーションの範囲が大幅に広がります。このように物理的に実装されたニューラル ネットワーク (PNN) は、タスク固有の計算負荷を物理システムにアウトソーシングできます。

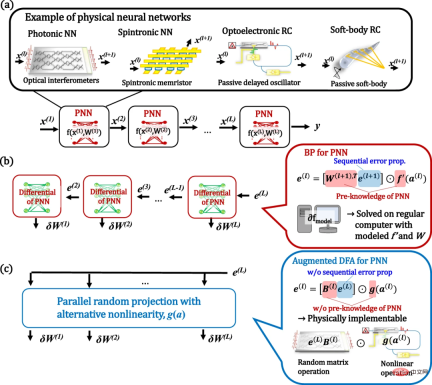

より深い物理ネットワークを構築することは、ネットワーク表現力を飛躍的に拡張できるため、パフォーマンスをさらに向上させるための有望な方向性です。これにより、さまざまな物理プラットフォームを使用したディープ PNN の提案が動機付けられます。彼らのトレーニングは基本的に、ソフトウェアベースの ANN で大きな成功を収めているバックプロパゲーション (BP) と呼ばれる方法に依存しています。ただし、BP は次の点で PNN には適していません。まず、BP 操作の物理的な実装は依然として複雑であり、スケーラブルではありません。第二に、BP では物理システム全体を正確に理解する必要があります。さらに、BP を RC に適用すると、これらの要件は物理 RC の固有の特性、つまりブラックボックスの物理確率ネットワークを正確に理解してシミュレートする必要があるという特性を損なうことになります。

PNN における BP と同様に、生物学的ニューラル ネットワークにおける BP の操作の難しさは脳科学コミュニティによって指摘されており、脳における BP の合理性は常に疑問視されてきました。これらの考慮事項は、生物学的に健全なトレーニング アルゴリズムの開発につながりました。

最近の有望な方向性は、ダイレクト フィードバック アライメント (DFA) です。このアルゴリズムでは、最終出力層エラー信号の固定ランダム線形変換を使用して、逆エラー信号を置き換えます。したがって、この方法はエラー信号の層ごとの伝播や重みの知識を必要としません。さらに、DFA は最新の大規模ネットワーク モデルに拡張可能であると報告されています。この生物学的に動機付けられたトレーニングの成功は、BP よりも PNN をトレーニングするのに適した方法があることを示唆しています。ただし、DFA は依然としてトレーニングのために非線形関数 f(x) の導関数 f'(a) を必要とするため、物理システムへの DFA 法の適用が妨げられます。したがって、DFA のより大きなスケーリングは PNN アプリケーションにとって重要です。

DFA と物理学におけるディープ ラーニングの強化

ここでは、研究者が DFA アルゴリズムを強化することによって物理学におけるディープ ラーニングを実証しています。強化された DFA では、標準 DFA の物理的非線形活性化 f'(a) の導関数を任意の非線形 g(a) に置き換え、パフォーマンスが g(a) の選択に対してロバストであることを示します。この機能強化により、f'(a) を正確にモデル化する必要がなくなりました。提案された方法は、任意の非線形活性化を伴う並列確率的投影に基づいているため、物理的な ELM または RC の概念と同じ方法で物理システム上でトレーニング計算を実行できます。これにより、推論とトレーニングの物理的な高速化が可能になります。

#図: PNN の概念と、BP および拡張 DFA によるトレーニング。 (出典: 論文)

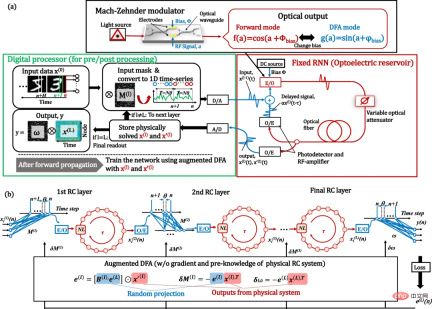

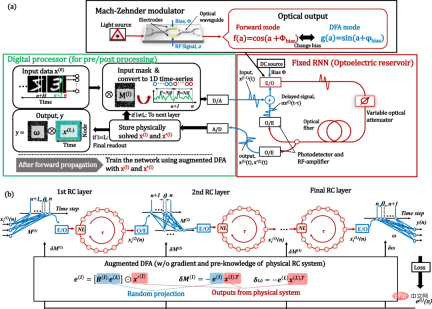

#概念実証を実証するために、研究者らは FPGA 支援の光電子ディープ物理 RC をワークベンチとして構築しました。ベンチトップは使いやすく、ソフトウェア レベルのアップデートのみでさまざまな物理プラットフォームに適用できますが、大規模で複雑な最先端のシステムに匹敵するパフォーマンスを実現します。

図: DFA トレーニングが強化されたオプトエレクトロニクス深度 RC システム。 (出典:論文)

# また、デジタル処理時間を含めた全体の処理時間を比較し、トレーニングプロセスの物理的な高速化の可能性を検討した。見つかった。

#図: 光電子ディープ RC システムの性能。 (出典: 論文)

RC ベンチの処理時間の予算の内訳は次のとおりです: FPGA 処理 (データ転送、メモリ割り当て、および DAC/ADC) ~92% ; デジタル処理の 8% は前処理/後処理に使用されます。したがって、現段階では、FPGA と CPU での数値計算が処理時間の大部分を占めています。これは、オプトエレクトロニクス ベンチが非線形遅延線のみを使用して 1 つのリザーバーを実装しているためであり、これらの制限は、将来的には完全に並列で全光学式のコンピューティング ハードウェアを使用することで緩和される可能性があります。見てわかるように、CPU と GPU での計算ではノード数が O(N^2) の傾向を示していますが、ベンチトップでは O(N) を示していますが、これはデータ転送のボトルネックが原因です。

CPU 外部の物理的加速度は、BP アルゴリズムと拡張 DFA アルゴリズムでそれぞれ N ~5,000 と ~12,000 で観察されます。ただし、計算速度の点では、GPU のメモリ制限のため、GPU に対する有効性は直接観察されていません。 GPU の傾向を推定すると、N ~80,000 で GPU を超える物理速度の向上が観察されます。私たちの知る限り、これはトレーニング プロセス全体の最初の比較であり、PNN を使用したフィジカル トレーニングの高速化の最初のデモンストレーションです。

提案された方法の他のシステムへの適用可能性を検討するために、広く研究されているフォトニック ニューラル ネットワークを使用して数値シミュレーションを実行しました。さらに、実験的に実証された遅延ベースの RC は、さまざまな物理システムに適していることが示されています。物理システムのスケーラビリティに関して、深いネットワークを構築する際の主な問題は、固有のノイズです。ノイズの影響は数値シミュレーションによって研究されます。このシステムはノイズに対して強いことが判明しました。

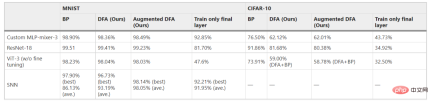

提案されたアプローチのスケーラビリティと制限ここでは、より最新のモデルに対する DFA ベースのアプローチのスケーラビリティについて検討します。実用的な深層学習に最も一般的に使用されるモデルの 1 つは、深層接続畳み込みニューラル ネットワーク (CNN) です。ただし、DFA アルゴリズムを標準の CNN に適用するのは難しいことが報告されています。したがって、提案された方法を単純な方法で畳み込み PNN に適用することは困難である可能性があります。

SNN への適合性も、シミュレーション ハードウェアの実装を考慮した重要なトピックです。 DFA ベースのトレーニングの SNN への適用可能性が報告されており、これは、この研究で提案された強化された DFA によりトレーニングが容易になる可能性があることを意味します。

DFA ベースのアルゴリズムは、単純な MLP や RC よりも実用的なモデルに拡張できる可能性がありますが、DFA ベースのトレーニングをそのようなネットワークに適用する有効性はまだ不明です。ここでは、この研究の追加作業として、上記のモデル (MLP-Mixer、Vision transformer (ViT)、ResNet、および SNN) に対する DFA ベースのトレーニング (DFA 自体および拡張 DFA) のスケーラビリティを調査します。 DFA ベースのトレーニングは、探索的な実践モデルに対しても効果的であることがわかりました。 DFA ベースのトレーニングで達成できる精度は本質的に BP トレーニングの精度よりも低いですが、モデルやアルゴリズムを調整することでパフォーマンスを向上させることができます。特に、DFA と強化された DFA の精度は、調査したすべての実験設定で同等であり、DFA 自体のさらなる改善が強化された DFA の改善に直接貢献することを示唆しています。結果は、この方法が単純な MLP モデルや RC モデルだけでなく、PNN の実用的なモデルの将来の実装にも拡張できることを示しています。

表 1: 拡張 DFA の実際のネットワーク モデルへの適用性。 (出典: 論文)

物理ハードウェアにおける BP と DFA

一般的には、次のように言えます。 BP は計算グラフ内のすべての情報を必要とするため、物理ハードウェアに実装するのは非常に困難です。したがって、物理ハードウェアでのトレーニングは常に計算シミュレーションを通じて行われており、これには多額の計算コストがかかります。さらに、モデルと実際のシステムとの差異により精度が低下します。対照的に、拡張 DFA では、物理システムに関する正確な事前知識は必要ありません。したがって、ディープ PNN では、精度の点で、DFA ベースの方法が BP ベースの方法よりも効果的です。さらに、物理ハードウェアを使用して計算を高速化することもできます。

さらに、DFA トレーニングでは、レイヤーごとに計算される逐次的なエラー伝播は必要ありません。これは、各レイヤーのトレーニングを並行して実行できることを意味します。したがって、より最適化された並列 DFA 実装は、より大幅な高速化につながる可能性があります。これらの独自の特性は、特に物理ハードウェアに基づくニューラル ネットワークに対する DFA ベースの手法の有効性を示しています。一方で、強化された DFA トレーニング済みモデルの精度は、BP トレーニング済みモデルの精度よりもまだ劣っています。 DFA ベースのトレーニングの精度をさらに向上させることは今後の課題です。

さらなる物理の高速化

物理実装では、ノード数が大きい場合の RC ループ処理の高速化を示します。ただし、その利点はまだ限られており、さらなる改善が必要です。現在のプロトタイプの処理時間は、FPGA へのデータ転送とメモリ割り当てとして表されます。したがって、すべてのプロセスを FPGA に統合すると、実験の柔軟性を犠牲にしてパフォーマンスが大幅に向上します。さらに、将来的には、航空光学方式により伝送コストが大幅に削減されるでしょう。大規模な光集積化とオンチップ集積化により、光コンピューティング自体のパフォーマンスがさらに向上します。

以上が生物学にヒントを得たトレーニング方法を使用した物理ディープラーニング: 物理ハードウェアへの勾配のないアプローチの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

SQLケースステートメント:基本から高度な手法までApr 18, 2025 am 09:31 AM

SQLケースステートメント:基本から高度な手法までApr 18, 2025 am 09:31 AMデータの課題:正確な洞察のためのSQLのケースステートメントのマスター あなたがデータ愛好家を持っているとき、誰が弁護士を必要としますか? データアナリスト、科学者、および膨大なデータの世界の全員が独自の複雑な課題に直面し、システム機能FLAを確保する

迅速なエンジニアリングにおける知識の連鎖の力とは何ですか?Apr 18, 2025 am 09:30 AM

迅速なエンジニアリングにおける知識の連鎖の力とは何ですか?Apr 18, 2025 am 09:30 AMAIの知識チェーンの力を活用:迅速なエンジニアリングに深く潜る 人工知能(AI)はあなたの質問を理解するだけでなく、洞察に満ちた答えを提供するために膨大な量の知識を織り込むことができることを知っていますか?

AIはワークライフバランスを達成するのに役立ちますか? - 分析VidhyaApr 18, 2025 am 09:27 AM

AIはワークライフバランスを達成するのに役立ちますか? - 分析VidhyaApr 18, 2025 am 09:27 AM導入 Joanna Maciejewskaは最近、Xに関する洞察に満ちた観察を共有しました。 AIプッシュの最大の課題は? それは誤った方向です。 AIに洗濯と料理を扱ってもらいたいので、アートとライティングに集中できるようにしてください。 - ジョアンナ・マ

Llama 3.1を使用したツールコールのガイドApr 18, 2025 am 09:26 AM

Llama 3.1を使用したツールコールのガイドApr 18, 2025 am 09:26 AMMeta'sLlama3.1:オープンソースLLM機能に深く飛び込む メタは、オープンソースの大手言語モデル(LLMS)で引き続き充電をリードしています。 LlamaからLlama 2、Llama 3、および現在のLlama 3.1に進化するLlamaファミリーは、へのコミットメントを示しています

SPCチャートとは何ですか? - 分析VidhyaApr 18, 2025 am 09:24 AM

SPCチャートとは何ですか? - 分析VidhyaApr 18, 2025 am 09:24 AM導入 統計プロセス制御(SPC)チャートは、品質管理に不可欠なツールであり、組織がプロセスを監視、制御、改善できるようにします。 統計的方法を適用することにより、SPCチャートはデータのバリエーションを視覚的に表します

トップ30 MySQLインタビューの質問 - Analytics VidhyaApr 18, 2025 am 09:23 AM

トップ30 MySQLインタビューの質問 - Analytics VidhyaApr 18, 2025 am 09:23 AMこのガイドは、初心者、中級、高度なレベルにまたがる30の質問をカバーすることにより、MySQLインタビューに備えています。 データ管理と分析の重要なツールであるMySQLは、理論的概念と実用的なクエリの例を通じて検討されています

非リレーショナルデータベースとリレーショナルデータベースApr 18, 2025 am 09:22 AM

非リレーショナルデータベースとリレーショナルデータベースApr 18, 2025 am 09:22 AM適切なデータベースの選択:リレーショナルと非関係 賑やかなカフェを管理することを想像してください:無数の注文、在庫レベルの変動、および要求の厳しい顧客を想像してください。 効率的なツールは成功に不可欠です。 同様に、大規模なデータセットを処理するにはcが必要です

2025年のトップ6ヒューマノイドロボット - 分析VidhyaApr 18, 2025 am 09:16 AM

2025年のトップ6ヒューマノイドロボット - 分析VidhyaApr 18, 2025 am 09:16 AMヒューマノイドロボット:未来を垣間見る 何世紀にもわたって、複雑な時計仕掛けのメカニズムから洗練されたAI駆動の作品まで、ヒューマノイドロボットの概念が私たちの想像力を捉えました。 ジャック・デ・ヴォーカンソンのメカニックなどの初期の例

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

SecLists

SecLists は、セキュリティ テスターの究極の相棒です。これは、セキュリティ評価中に頻繁に使用されるさまざまな種類のリストを 1 か所にまとめたものです。 SecLists は、セキュリティ テスターが必要とする可能性のあるすべてのリストを便利に提供することで、セキュリティ テストをより効率的かつ生産的にするのに役立ちます。リストの種類には、ユーザー名、パスワード、URL、ファジング ペイロード、機密データ パターン、Web シェルなどが含まれます。テスターはこのリポジトリを新しいテスト マシンにプルするだけで、必要なあらゆる種類のリストにアクセスできるようになります。

ドリームウィーバー CS6

ビジュアル Web 開発ツール

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境