大規模な言語モデルは、トレーニングされていないことを実行できるため、ある種の魔法があるように見え、メディアや研究者からの誇大広告や注目の的となっています。

大規模な言語モデルを拡張すると、小規模なモデルでは利用できない新しい機能が現れることがあります。「創造性」に似たこの属性は「創発」機能と呼ばれ、私たちを表します。一般的な人工知能への大きな一歩を踏み出しました。

現在、Google、スタンフォード、ディープマインド、ノースカロライナ大学の研究者たちは、大規模言語モデルにおける「創発」機能を研究しています。

#デコーダーによってプロンプトが表示される DALL-E #魔法の「緊急」能力

自然言語処理 (NLP) は、大量のテキスト データでトレーニングされた言語モデルによって革命をもたらしました。言語モデルをスケールアップすると、多くの場合、さまざまなダウンストリーム NLP タスクのパフォーマンスとサンプル効率が向上します。多くの場合、小規模なモデルのパフォーマンス傾向を推定することで、大規模な言語モデルのパフォーマンスを予測できます。たとえば、言語モデルの複雑さに対するスケールの影響は、7 桁以上にわたって実証されています。

ただし、他の一部のタスクのパフォーマンスは、予想どおりには改善されませんでした。

たとえば、GPT-3 論文は、複数桁の加算を実行する言語モデルの能力が、100M から 13B パラメータまでのモデルに対して平坦なスケーリング曲線を持ち、ほぼランダムであることを示していますが、 1 つのノードでパフォーマンスが飛躍的に低下します。

Machine Learning Research (TMLR) に掲載された最近の論文「大規模言語モデルの創発力」では、研究者らは数十の拡張言語モデルによって生み出される「創発力」を実証しました。能力の。

この「緊急」機能の存在により、追加のスケーリングによって言語モデルの機能の範囲をさらに拡大できるかどうかという疑問が生じます。

# 「緊急」プロンプト タスク

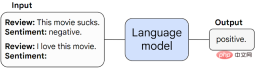

最初に、プロンプト タスクに表示される可能性のある「緊急」アビリティについて説明します。このタイプのタスクでは、事前トレーニングされた言語モデルが次の単語を予測するタスクを実行するように求められ、応答を完了することでタスクを実行します。

さらに微調整を行わなくても、言語モデルはトレーニング中には見られなかったタスクを実行できることがよくあります。

#特定のスケールのしきい値で、タスクのパフォーマンスがランダムからランダムを超えるパフォーマンスに予期せず急上昇する場合、タスクを「緊急」タスクと呼びます。

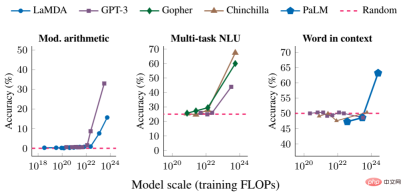

以下に、「緊急」のパフォーマンスを伴うプロンプト タスクの 3 つの例を示します。それは、多段階の算術、大学レベルの試験の受験、および単語の意図された意味の特定です。

いずれの場合も、言語モデルは、特定のしきい値に達するまで、つまりパフォーマンスが急上昇するまで、モデル サイズにはほとんど依存せず、パフォーマンスが低下します。

十分な規模のモデルの場合、これらのタスクのパフォーマンスが非ランダムになるだけです。たとえば、算術およびマルチタスク NLU タスク ( FLOP の 1 秒あたりの浮動小数点演算のトレーニングなど) ) は 10 の 22 乗を超え、コンテキスト タスク内の単語のトレーニング FLOP は 10 の 24 乗を超えます。

「緊急」プロンプト戦略

「緊急」機能の 2 番目のカテゴリには、言語モデルの機能を強化するプロンプト戦略が含まれます。

プロンプト戦略は、さまざまなタスクに適用できるプロンプトの幅広いパラダイムです。これらは、小規模なモデルで障害が発生した場合に「緊急」とみなされ、十分に大きなモデルでのみ使用できます。

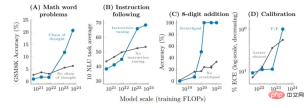

思考連鎖プロンプトは、「緊急」プロンプト戦略の典型的な例であり、プロンプト モデルは最終的な答えを与える前に一連の中間ステップを生成します。

思考連鎖プロンプトを使用すると、言語モデルは、複数ステップの数学の文章題など、複雑な推論を必要とするタスクを実行できます。

モデルは明示的なトレーニングなしで思考連鎖推論の能力を獲得できることに注目する価値があります。下の図は思考連鎖プロンプトの例を示しています。

#思考連鎖プロンプトの実証結果は次のとおりです。

小規模なモデルの場合、思考連鎖プロンプトを適用することは、たとえば、難しい数学である GSM8K に適用する場合、標準プロンプトよりも優れているわけではありません。文章問題のベンチマーク。

ただし、大規模モデルの場合、思考チェーン プロンプトは GSM8K で 57% の解決率を達成し、テストのパフォーマンスが大幅に向上しました。

「創発」能力を研究する意義

では、「創発」能力を研究する意義とは何でしょうか?

大規模な言語モデルにおける「新たな」機能を特定することは、この現象と将来のモデル機能への潜在的な影響を理解するための第一歩です。

たとえば、「緊急」のスモールショット ヒンティング機能と戦略は事前トレーニングで明示的にエンコードされていないため、研究者は現在のスモールショット ヒンティング機能の全範囲を把握していない可能性があります。言語モデル。

さらに、さらなる拡張により、より大規模なモデルに「緊急」機能が提供される可能性があるかどうかという問題も非常に重要です。

- なぜ「緊急」能力が現れるのですか?

- 特定の機能が登場すると、言語モデルの新しい現実世界への応用が可能になるでしょうか?

- コンピューティング リソースは高価であるため、スケーラビリティを向上させることなく、他の手段 (より優れたモデル アーキテクチャやトレーニング手法など) で新しい機能を利用できるでしょうか?

研究者らは、これらの疑問はまだ解明されていないと言っています。

しかし、NLP の分野が発展し続けるにつれて、スケーリングによって生成される「緊急」機能を含む、言語モデルの動作を分析して理解することが非常に重要になります。

以上がパラメータがわずかに向上し、パフォーマンス指数が爆発します! Google:大規模な言語モデルには「謎のスキル」が隠されているの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

Gemma Scope:AI'の思考プロセスを覗くためのGoogle'の顕微鏡Apr 17, 2025 am 11:55 AM

Gemma Scope:AI'の思考プロセスを覗くためのGoogle'の顕微鏡Apr 17, 2025 am 11:55 AMジェマの範囲で言語モデルの内部の仕組みを探る AI言語モデルの複雑さを理解することは、重要な課題です。 包括的なツールキットであるGemma ScopeのGoogleのリリースは、研究者に掘り下げる強力な方法を提供します

ビジネスインテリジェンスアナリストは誰で、どのようになるか?Apr 17, 2025 am 11:44 AM

ビジネスインテリジェンスアナリストは誰で、どのようになるか?Apr 17, 2025 am 11:44 AMビジネスの成功のロック解除:ビジネスインテリジェンスアナリストになるためのガイド 生データを組織の成長を促進する実用的な洞察に変換することを想像してください。 これはビジネスインテリジェンス(BI)アナリストの力です - GUにおける重要な役割

SQLに列を追加する方法は? - 分析VidhyaApr 17, 2025 am 11:43 AM

SQLに列を追加する方法は? - 分析VidhyaApr 17, 2025 am 11:43 AMSQLの変更テーブルステートメント:データベースに列を動的に追加する データ管理では、SQLの適応性が重要です。 その場でデータベース構造を調整する必要がありますか? Alter Tableステートメントはあなたの解決策です。このガイドの詳細は、コルを追加します

ビジネスアナリストとデータアナリストApr 17, 2025 am 11:38 AM

ビジネスアナリストとデータアナリストApr 17, 2025 am 11:38 AM導入 2人の専門家が重要なプロジェクトで協力している賑やかなオフィスを想像してください。 ビジネスアナリストは、会社の目標に焦点を当て、改善の分野を特定し、市場動向との戦略的整合を確保しています。 シム

ExcelのCountとCountaとは何ですか? - 分析VidhyaApr 17, 2025 am 11:34 AM

ExcelのCountとCountaとは何ですか? - 分析VidhyaApr 17, 2025 am 11:34 AMExcelデータカウントと分析:カウントとカウントの機能の詳細な説明 特に大規模なデータセットを使用する場合、Excelでは、正確なデータカウントと分析が重要です。 Excelは、これを達成するためにさまざまな機能を提供し、CountおよびCounta関数は、さまざまな条件下でセルの数をカウントするための重要なツールです。両方の機能はセルをカウントするために使用されますが、設計ターゲットは異なるデータ型をターゲットにしています。 CountおよびCounta機能の特定の詳細を掘り下げ、独自の機能と違いを強調し、データ分析に適用する方法を学びましょう。 キーポイントの概要 カウントとcouを理解します

ChromeはAIと一緒にここにいます:毎日何か新しいことを体験してください!!Apr 17, 2025 am 11:29 AM

ChromeはAIと一緒にここにいます:毎日何か新しいことを体験してください!!Apr 17, 2025 am 11:29 AMGoogle Chrome'sAI Revolution:パーソナライズされた効率的なブラウジングエクスペリエンス 人工知能(AI)は私たちの日常生活を急速に変換しており、Google ChromeはWebブラウジングアリーナで料金をリードしています。 この記事では、興奮を探ります

ai' s Human Side:Wellbeing and the Quadruple bottuntApr 17, 2025 am 11:28 AM

ai' s Human Side:Wellbeing and the Quadruple bottuntApr 17, 2025 am 11:28 AMインパクトの再考:四重材のボトムライン 長い間、会話はAIの影響の狭い見方に支配されており、主に利益の最終ラインに焦点を当てています。ただし、より全体的なアプローチは、BUの相互接続性を認識しています

5ゲームを変える量子コンピューティングの使用ケースあなたが知っておくべきであるApr 17, 2025 am 11:24 AM

5ゲームを変える量子コンピューティングの使用ケースあなたが知っておくべきであるApr 17, 2025 am 11:24 AM物事はその点に向かって着実に動いています。量子サービスプロバイダーとスタートアップに投資する投資は、業界がその重要性を理解していることを示しています。そして、その価値を示すために、現実世界のユースケースの数が増えています

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター

メモ帳++7.3.1

使いやすく無料のコードエディター

MinGW - Minimalist GNU for Windows

このプロジェクトは osdn.net/projects/mingw に移行中です。引き続きそこでフォローしていただけます。 MinGW: GNU Compiler Collection (GCC) のネイティブ Windows ポートであり、ネイティブ Windows アプリケーションを構築するための自由に配布可能なインポート ライブラリとヘッダー ファイルであり、C99 機能をサポートする MSVC ランタイムの拡張機能が含まれています。すべての MinGW ソフトウェアは 64 ビット Windows プラットフォームで実行できます。

WebStorm Mac版

便利なJavaScript開発ツール

SublimeText3 Linux 新バージョン

SublimeText3 Linux 最新バージョン