ホームページ >テクノロジー周辺機器 >AI >数千億のパラメータを備えた Meta の大規模モデルである OPT-IML の「アップグレード バージョン」が登場し、完全なモデルとコードがリリースされました。

数千億のパラメータを備えた Meta の大規模モデルである OPT-IML の「アップグレード バージョン」が登場し、完全なモデルとコードがリリースされました。

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-11 22:31:091681ブラウズ

今年の 5 月、MetaAI は 1,750 億のパラメータに基づく超大型モデル OPT-175B のリリースを正式に発表しました。これもすべてのコミュニティに無料で公開されています。

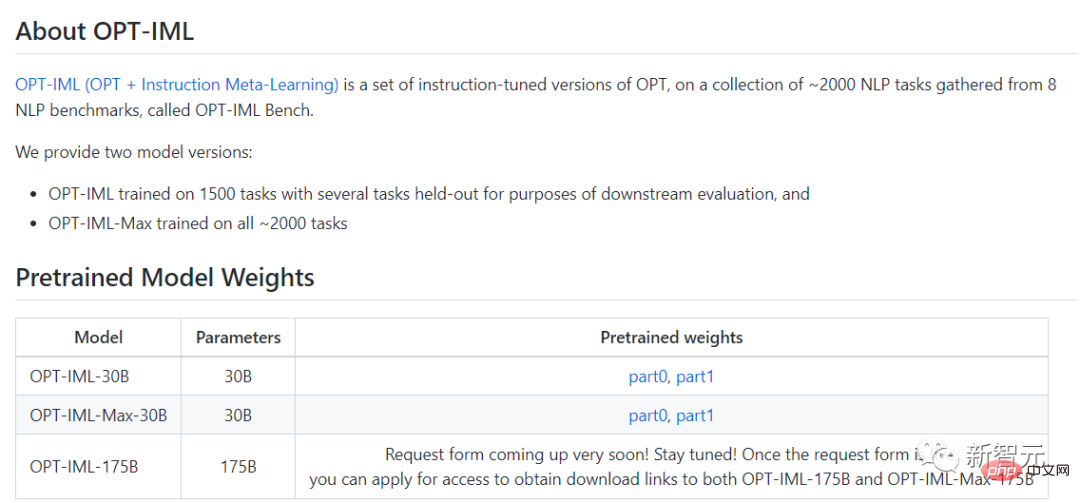

12 月 22 日、このモデルの更新バージョンである OPT-IML (Open Pre-trained Transformer) が正式にリリースされました。Meta 氏によると、それは「2,000 の言語タスクを微調整しました。 1,7500 億のパラメータ」は、非営利の研究目的でも自由に利用できます。

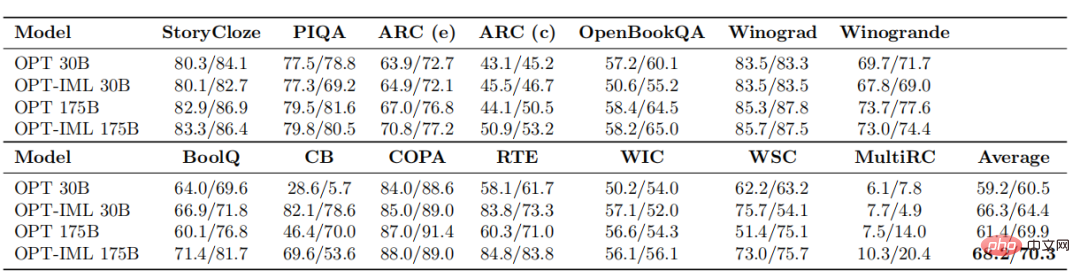

この更新された OPT-IML のパフォーマンスはどうですか? 2 つの写真を見てみましょう。

#今回 OPT-IML では 30B と 175B の 2 つのモデル サイズを作成しました。

古い OPT モデルと比較すると、OPT-IML は 14 の標準 NLP 評価タスクにおいて平均して OPT を上回ります。

2 つのモデル サイズは、ゼロショット学習タスクでは 7%~ 優れており、32 ショット学習タスクでは 4%~ および 0.4%~ 優れています。

この研究では、モデルとベンチマークのサイズの増加が、下流のタスクのパフォーマンスに対する命令チューニングの決定の影響にどのような影響を与えるかを研究者が説明しています。

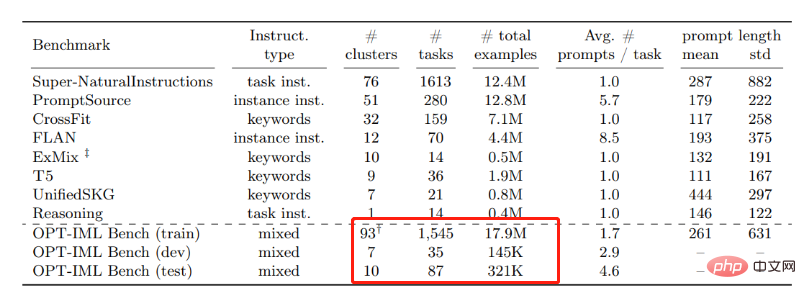

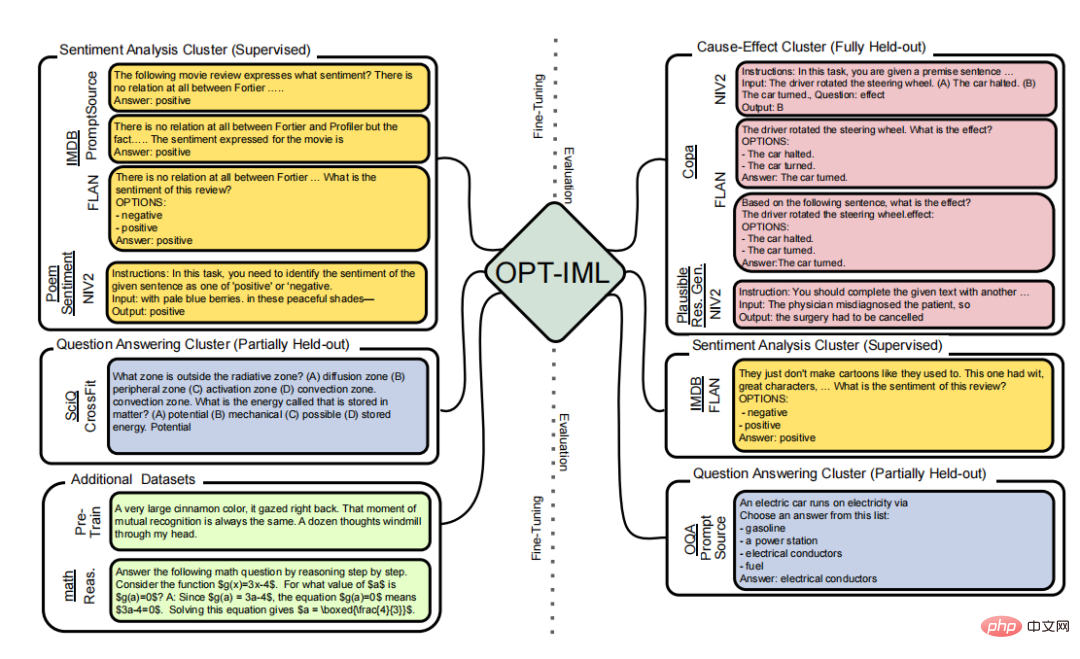

この目的のために、彼らは OPT-IML Bench を開発しました。これは、8 つの既存のベンチマークに基づく 2000 の NLP タスクを含む大規模な指導メタ学習 (IML) ベンチマークであり、タスク カテゴリに分割されています。

OPT-IML 30B および 175B をトレーニングするために、研究者らはまず、次の観点から OPT-30B に適用される命令調整の決定を提案しました。フレームワークによって洞察が得られました。

OPT-IML は、異なるターゲットと入力形式を使用した 4 つの評価ベンチマーク (PromptSource、FLAN、Super-Natural命令、UnifiedSKG) で、3 つの一般化スキルすべてを実証します。

すべてのベンチマークにわたって OPT よりも大幅に優れているだけでなく、この特定のベンチマークに最適化された既存のモデルよりも非常に競争力の高い方法で優れています。

# さらに、OPT-IML はオープンソース化されており、編集者は以下に Github リンクも掲載しています~

##Github リンク: https://github.com/facebookresearch/metaseq/tree/main/projects/OPT-IML

について学びましょうOPT-IML という紙を通してそれを行います。

ペーパーリンク: https://github.com/facebookresearch/metaseq/blob/main/projects/OPT-IML/optimal_paper_v1 .pdf

研究方法大規模な言語モデルの命令による微調整は、ゼロショットおよび少数ショットの一般化機能を強化する効果的な方法となっています。 。この研究では、メタ研究者は命令の微調整に 3 つの重要な追加を加えました。

まず、8 つのデータセット コレクションからタスク タイプごとに分類された 2,000 個の NLP タスクを含む大規模な命令微調整ベンチマークをコンパイルしました。

研究者は、このベンチマークで評価分割を選択的に構築し、3 つの異なるタイプのモデル一般化機能をテストしました。

完全にホールドアウトされたカテゴリからのタスク、認識されたタイプからのホールドアウト タスク、認識されたタスクからのホールドアウト インスタンス (認識されたタスクからのホールドアウト インスタンス) が含まれます。

#コマンドの微調整

コマンドの微調整モデルを次の指示と一致させることは、機械学習における現在の研究の方向性の 1 つです。

#命令の微調整には 2 つの方法があります。 1 つは人間による注釈付きの指示とフィードバックを使用してさまざまなタスクのモデルを微調整することに重点を置き、もう 1 つは注釈を介して、または公的にアクセス可能なベンチマークやデータセットに自動的に指示を追加することに重点を置いています。この研究では、Meta AI メンバーは 2 番目の手法に焦点を当て、OPT を改善する方法を含む、公的にアクセス可能な多数のデータセットを編集しました。

研究中に、Meta メンバーは 4 つのベンチマークの 1836 個のタスクを使用した同様のスケーリング方法を提案しました。最後に、研究者らは、MMLU やビッグベンチ ハード (BBH) などの困難な外部ベンチマークのパフォーマンス限界を押し上げるためにテスト全体を調整しながら、ダウンストリームのパフォーマンスに影響を与える可能性のあるさまざまな命令チューニング戦略の重みについて説明します。

マルチタスク学習

マルチタスク学習は、命令ベースの微調整 (MTL) を表します。

MTL は、同等のパラメーターまたは表現を共有する同様の関数と組み合わせると、タスクの汎化パフォーマンスを向上させることができる一般的なパラダイムです。

近年、MTL は多数の NLP シナリオに適用されており、主に関連アクティビティからのシグナルを活用してトレーニング タスクや新しいドメインのパフォーマンスを向上させることに重点が置かれています。

対照的に、命令ベースの微調整は、これまでに見たことのない問題に対する汎化パフォーマンスを向上させるのに役立ちます。これは、すべてのタスクを 1 つの概念に結合し、すべてのタスクにモデルの重みを割り当てることでそれらを一緒にトレーニングするよう指示することで実現されます。

OPTとは何ですか?

大規模な言語モデル、1,000 億を超えるパラメーターを備えた自然言語処理システムは、過去数年にわたって NLP と AI 研究を変革してきました。これらのモデルは、膨大な数の多様なテキストでトレーニングされ、創造的なテキストを生成し、基本的な数学の問題を解決し、読解の問題に答えるなどの驚くべき新しい能力を実証します。

一般の人々が有料 API を介してこれらのモデルを操作できる場合もありますが、研究への完全なアクセスは依然としてリソースの豊富な少数の研究室に限定されています。

この制限されたアクセスにより、これらの大規模な言語モデルがどのように、そしてなぜ機能するのかを理解する研究者の能力が制限され、堅牢性の向上やバイアスなどの既知の問題の軽減における進歩が妨げられます。

Meta AI は、オープン サイエンスへの取り組みから、今年 5 月に Open Pretrained Transformer (OPT-175B) をリリースしました。これは、公開データで使用できる 1,750 億個のパラメーターを備えたモデルです。このモデルを共有する理由は、Meta AI が大規模モデルに関する基本技術を理解するために、より多くのコミュニティに参加してもらいたいと考えているためです。

簡単に言えば、Meta は人工知能研究で使用される大規模言語モデルへのアクセスを一般に公開し、それによって大規模モデル研究における人工知能の民主化を実現します。

古いバージョンとの比較

Meta によって現在リリースされている IML バージョンは微調整されており、古いバージョンの OPT よりも自然言語タスクのパフォーマンスが向上しています。一般的な言語タスクには、質問への回答、テキストの要約、翻訳などがあります。

微調整するために、研究者たちは約 2,000 の自然言語タスクを使用しました。タスクは 8 つの NLP ベンチマーク (OPT-IML ベンチ) に分割されており、これらも研究者によって提供されています。

30B モデルと 175B モデルを例に挙げると、平均して、OPT-IML は OPT と比較してゼロショット学習精度を約 6 ~ 7% 向上させます。 32 回の学習エポックで、300 億個のパラメーターを含むモデルでは精度が大幅に向上し、1,750 億個のパラメーターを含むモデルではわずかな精度の向上が見られました。

比較後、メタ チームは、すべてのベンチマーク テスト、およびゼロショット学習と少数ショット学習の点で、OPT-IML のパフォーマンスが OPT よりも優れていることを発見しました。精度は、命令に基づいて微調整された他のモデルよりも優れており、より競争力がありました。

以上が数千億のパラメータを備えた Meta の大規模モデルである OPT-IML の「アップグレード バージョン」が登場し、完全なモデルとコードがリリースされました。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。