自動運転技術、インテリジェントアシスタント、顔認識、スマートファクトリー、スマートシティなどの人工知能技術が広く導入され、私たちの生活を急速に変えています。しかし、関連分野でのセキュリティインシデントも急速に増加しており、研究者やユーザーは人工知能のセキュリティに対する懸念を強めています。人工知能の適用によってもたらされる恩恵と、それによって引き起こされるセキュリティ リスクは表裏の関係にあるため、業界全体が細心の注意を払い、効果的な対応方法を見つけることが求められています。

最近、セキュリティ研究者は、人工知能テクノロジーが実際のアプリケーションで直面することが多い 7 つのデータ セキュリティ脅威を整理し、まとめました。

脅威 1 モデル ポイズニング

モデル ポイズニングは、機械学習モデルの結果を操作することを目的とした敵対的攻撃の一種です。脅威アクターは悪意のあるデータをモデルに挿入しようとし、モデルがデータを誤って分類し、誤った決定を下す原因となる可能性があります。たとえば、人工画像は機械学習モデルを騙して、人間が最初に分類したものとは異なるカテゴリに分類する可能性があります (例: 猫の画像をネズミとして分類する)。研究によると、特定の入力が出力前に誤った予測につながるかどうかを判断することは不可能であるため、これは AI システムを騙す効果的な方法であることがわかっています。

悪意のある攻撃者によるモデル入力の改ざんを防ぐために、組織は厳格なアクセス管理ポリシーを実装して、トレーニング データへのアクセスを制限する必要があります。

脅威 2 プライバシー漏洩

プライバシー保護は、さらなる注意と注意が必要なデリケートな問題であり、特に AI モデルに未成年者のデータが含まれている場合、問題はさらに複雑になります。たとえば、青少年向けの一部のデビット カード オプションでは、銀行はセキュリティ基準が規制遵守要件を満たしていることを確認する必要があります。あらゆる形式または手段で顧客情報を収集するすべての企業は、データ保護ポリシーを導入する必要があります。これにより、顧客は組織がデータをどのように処理するかを知ることができます。しかし、ユーザーは自分のデータが人工知能アルゴリズムのアプリケーションに流入しているかどうかをどのようにして知ることができるでしょうか?この情報を含むプライバシー ポリシーはほとんどありません (またはほとんどありません)。

私たちは人工知能によって推進される時代に突入しており、企業が人工知能をどのように使用しているか、その能力、データへの影響を個人が理解することが非常に重要になります。同様に、攻撃者はマルウェアを使用して、クレジット カード番号や社会保障番号などの個人情報を含む機密データ セットを盗もうとする可能性があります。組織は定期的なセキュリティ監査を実施し、AI 開発のすべての段階で強力なデータ保護慣行を実装する必要があります。プライバシー リスクはデータ ライフサイクルのどの段階でも発生する可能性があるため、すべての関係者向けに統一されたプライバシー セキュリティ戦略を策定することが重要です。

脅威 3 データ改ざん

データの操作、暴露、改ざんによって引き起こされるリスクは、AI の大規模な適用の状況において継続的に増幅されています。これらのシステムでは分析と意思決定が必要となるためです。大量のデータに基づいており、このデータは悪意のある攻撃者によって簡単に操作または改ざんされる可能性があります。さらに、アルゴリズムのバイアスも、人工知能の大規模な応用において直面する大きな問題です。 AI アルゴリズムと機械学習プログラムは客観的で公平であると考えられていますが、実際はそうではありません。

人工知能アルゴリズムによるデータ改ざんの脅威は、簡単な解決策がない大きな問題ですが、注意が必要です。アルゴリズムに入力されるデータが正確で信頼性があり、改ざんされていないことを確認するにはどうすればよいでしょうか?データが好ましくない方法で使用されないようにするにはどうすればよいでしょうか?これらの疑問はすべて非常に現実的な問題ですが、業界はまだ明確な答えを見つけていません。

脅威 4 内部関係者の脅威

データ セキュリティの観点から見ると、内部関係者からの脅威は間違いなく最も危険でコストがかかるタイプです。最新の「Cost of Insider Threats: A Global Report」によると、インサイダー脅威インシデントの数は過去 2 年間で 44% 増加し、インシデントあたりの平均コストは 1,538 万ドルとなっています。

内部関係者の脅威が非常に危険なのは、その動機が必ずしも金銭的なものではなく、復讐、好奇心、人的ミスなどの他の要因によって動機付けられている可能性があることです。このため、外部の攻撃者よりも予測して阻止することが困難です。

国民の健康に関わる企業にとって、内部関係者の脅威は間違いなくより有害です。ヘルスケア サービス プロバイダーの HelloRache を例に挙げると、同社は AI ベースのバーチャル スクライブ (コンピューター関連のタスクで医師を支援するアシスタント) ツールを使用して、医師が患者のケアや症状の文書化をリモートで支援できるようにしています。しかし、内部関係者がその方法を見つけた場合、システムが誤って接続され、さらには患者の医療情報を監視および取得する可能性があります。

脅威 5 標的型意図的攻撃

ある調査データによると、企業組織の 86% が人工知能を将来のデジタル開発の「主流」テクノロジーと見なし始めており、さまざまなデータへの投資を増やしています。 AI テクノロジーを活用して、企業がより適切な意思決定を行い、顧客サービスを向上させ、コストを削減できるようにします。しかし、問題があります。AI システムに対する意図的な攻撃が増加しており、制御を導入しないと、組織に数百万ドル以上の損害が発生する可能性があります。

「意図的な攻撃」とは、対戦相手に対する競争上の優位性を獲得することを目的として、人工知能システムにハッキングすることによって組織の業務運営を妨害する意図的な試みを指します。 AI と ML に対するデータ セキュリティの脅威は、意図的な攻撃シナリオで特に損害を与える可能性があります。これらのシステムで使用されるデータは多くの場合、独自のものであり、価値が高いためです。人工知能システムが標的にされ、意図的に攻撃された場合、その結果はデータの盗難だけでなく、企業の競争力の破壊にもつながります。

脅威 6 の大量導入

人工知能は急速に成長している産業であるため、依然として脆弱なままです。 AI アプリケーションの人気が高まり、世界中で採用されるようになると、ハッカーはこれらのプログラムの入力と出力を妨害する新しい方法を見つけるでしょう。 AI は複雑なシステムであることが多いため、開発者がさまざまなアプリケーション状況でコードがどのように動作するかを知ることが困難になります。何が起こるかを予測できない場合、それを防ぐことは困難です。

大規模なアプリケーションの脅威から企業を保護する最善の方法は、適切なコーディング手法、テスト プロセス、および新しい脆弱性が発見されたときのタイムリーな更新を組み合わせることです。もちろん、コロケーション データセンターを使用してサーバーを悪意のある攻撃や外部の脅威から保護するなど、従来の形式のサイバーセキュリティ予防策を放棄しないでください。

脅威 7 AI による攻撃

研究者らは、悪意のある攻撃者が人工知能を武器にして、攻撃の設計と実行を支援していることを発見しました。この場合、「攻撃を設計する」とは、ターゲットを選択し、どのデータを盗んだり破壊しようとしているのかを判断したり、配信方法を決定したりすることを意味します。悪意のある攻撃者は、機械学習アルゴリズムを使用してセキュリティ制御をバイパスして攻撃を実行する方法を見つけたり、深層学習アルゴリズムを使用して現実世界のサンプルに基づいて新しいマルウェアを作成したりする可能性があります。セキュリティの専門家は、ますますインテリジェントになるボットに対して常に防御する必要があります。ボットが 1 つの攻撃を阻止するとすぐに、新しい攻撃が出現するためです。つまり、AI により、攻撃者は現在のセキュリティ保護の穴を見つけやすくなります。

参考リンク:

https://www.php.cn/link/d27b95cac4c27feb850aaa4070cc4675

以上が人工知能アプリケーションは 7 つの主要なデータ セキュリティ脅威に直面していますの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

最高の迅速なエンジニアリング技術の最新の年次編集Apr 10, 2025 am 11:22 AM

最高の迅速なエンジニアリング技術の最新の年次編集Apr 10, 2025 am 11:22 AM私のコラムに新しいかもしれない人のために、具体化されたAI、AI推論、AIのハイテクブレークスルー、AIの迅速なエンジニアリング、AIのトレーニング、AIのフィールディングなどのトピックなど、全面的なAIの最新の進歩を広く探求します。

ヨーロッパのAI大陸行動計画:GigaFactories、Data Labs、Green AIApr 10, 2025 am 11:21 AM

ヨーロッパのAI大陸行動計画:GigaFactories、Data Labs、Green AIApr 10, 2025 am 11:21 AMヨーロッパの野心的なAI大陸行動計画は、人工知能のグローバルリーダーとしてEUを確立することを目指しています。 重要な要素は、AI GigaFactoriesのネットワークの作成であり、それぞれが約100,000の高度なAIチップを収容しています。

Microsoftの簡単なエージェントストーリーは、より多くのファンを作成するのに十分ですか?Apr 10, 2025 am 11:20 AM

Microsoftの簡単なエージェントストーリーは、より多くのファンを作成するのに十分ですか?Apr 10, 2025 am 11:20 AMAIエージェントアプリケーションに対するMicrosoftの統一アプローチ:企業の明確な勝利 新しいAIエージェント機能に関するマイクロソフトの最近の発表は、その明確で統一されたプレゼンテーションに感銘を受けました。 TEで行き詰まった多くのハイテクアナウンスとは異なり

従業員へのAI戦略の販売:Shopify CEOのマニフェストApr 10, 2025 am 11:19 AM

従業員へのAI戦略の販売:Shopify CEOのマニフェストApr 10, 2025 am 11:19 AMShopify CEOのTobiLütkeの最近のメモは、AIの能力がすべての従業員にとって基本的な期待であると大胆に宣言し、会社内の重大な文化的変化を示しています。 これはつかの間の傾向ではありません。これは、pに統合された新しい運用パラダイムです

IBMは、完全なAI統合でZ17メインフレームを起動しますApr 10, 2025 am 11:18 AM

IBMは、完全なAI統合でZ17メインフレームを起動しますApr 10, 2025 am 11:18 AMIBMのZ17メインフレーム:AIを強化した事業運営の統合 先月、IBMのニューヨーク本社で、Z17の機能のプレビューを受け取りました。 Z16の成功に基づいて構築(2022年に開始され、持続的な収益の成長の実証

5 chatgptプロンプトは他の人に依存して停止し、自分を完全に信頼するApr 10, 2025 am 11:17 AM

5 chatgptプロンプトは他の人に依存して停止し、自分を完全に信頼するApr 10, 2025 am 11:17 AM揺るぎない自信のロックを解除し、外部検証の必要性を排除します! これらの5つのCHATGPTプロンプトは、完全な自立と自己認識の変革的な変化に向けて導きます。 ブラケットをコピー、貼り付け、カスタマイズするだけです

AIはあなたの心に危険なほど似ていますApr 10, 2025 am 11:16 AM

AIはあなたの心に危険なほど似ていますApr 10, 2025 am 11:16 AM人工知能のセキュリティおよび研究会社であるAnthropicによる最近の[研究]は、これらの複雑なプロセスについての真実を明らかにし始め、私たち自身の認知領域に不穏に似た複雑さを示しています。自然知能と人工知能は、私たちが思っているよりも似ているかもしれません。 内部スヌーピング:人類の解釈可能性研究 人類によって行われた研究からの新しい発見は、AIの内部コンピューティングをリバースエンジニアリングすることを目的とする機械的解釈可能性の分野の大きな進歩を表しています。AIが何をするかを観察するだけでなく、人工ニューロンレベルでそれがどのように行うかを理解します。 誰かが特定のオブジェクトを見たり、特定のアイデアについて考えたりしたときに、どのニューロンが発射するかを描くことによって脳を理解しようとすることを想像してください。 a

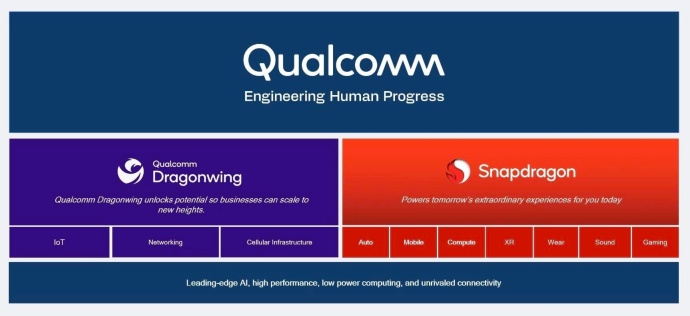

Dragonwingは、QualcommのEdge Momentumを紹介していますApr 10, 2025 am 11:14 AM

Dragonwingは、QualcommのEdge Momentumを紹介していますApr 10, 2025 am 11:14 AMQualcomm's DragonWing:企業とインフラストラクチャへの戦略的な飛躍 Qualcommは、新しいDragonwingブランドで世界的に企業やインフラ市場をターゲットにして、モバイルを超えてリーチを積極的に拡大しています。 これは単なるレブランではありません

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

ドリームウィーバー CS6

ビジュアル Web 開発ツール

DVWA

Damn Vulnerable Web App (DVWA) は、非常に脆弱な PHP/MySQL Web アプリケーションです。その主な目的は、セキュリティ専門家が法的環境でスキルとツールをテストするのに役立ち、Web 開発者が Web アプリケーションを保護するプロセスをより深く理解できるようにし、教師/生徒が教室環境で Web アプリケーションを教え/学習できるようにすることです。安全。 DVWA の目標は、シンプルでわかりやすいインターフェイスを通じて、さまざまな難易度で最も一般的な Web 脆弱性のいくつかを実践することです。このソフトウェアは、

SAP NetWeaver Server Adapter for Eclipse

Eclipse を SAP NetWeaver アプリケーション サーバーと統合します。

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

ホットトピック

7450

7450 15

15 1374

1374 52

52