ホームページ >テクノロジー周辺機器 >AI >デジタルヒューマンモデリングとアニメーションの主要テクノロジー

デジタルヒューマンモデリングとアニメーションの主要テクノロジー

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-11 17:46:031727ブラウズ

はじめに: この記事では、顔のモデリングや髪など、グラフィカルな観点からデジタル ヒューマン モデリングとアニメーションの主要テクノロジーに関する関連研究成果を紹介します。編集、仮想服装など、主に次の部分が含まれます:

- 顔ポートレートの編集と服装のデザイン。

- #まつげカットアウトのデータセットとベースライン方法。

- # 深層学習に基づいた、ゆるい服のリアルタイム アニメーション。

1. 顔ポートレートの編集と衣装デザイン

1. デジタル顔ビデオ ポートレートの太さや薄さの調整

ACM Multimedia2021 にてビデオポートレートの太りや痩せの調整に関する口頭報告論文を発表 主にビデオ内の人物の太りや痩せを視覚的に目立たないよう調整します. トリミングの自然な効果。

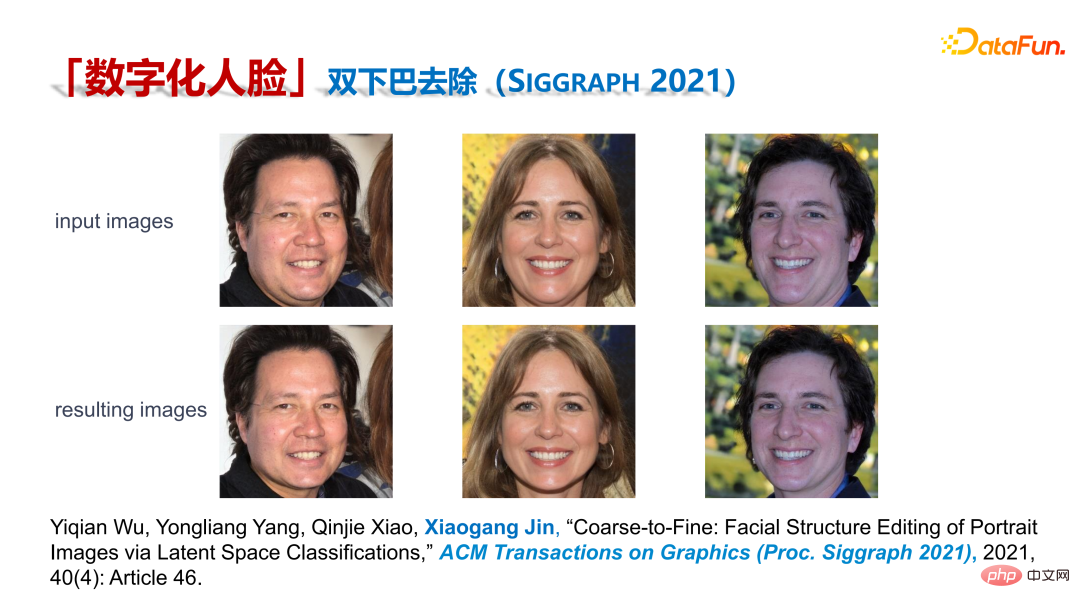

2. 二重あごの除去

Double Chin Removal は、Siggraph 2021 に掲載された論文です。二重あごを除去することは、テクスチャとジオメトリの両方が関係するため、顔の編集では困難です。表示されている場合、1 行目は元の画像であり、パラメーターを調整することで二重あごを徐々に消すことができます (2 行目)。

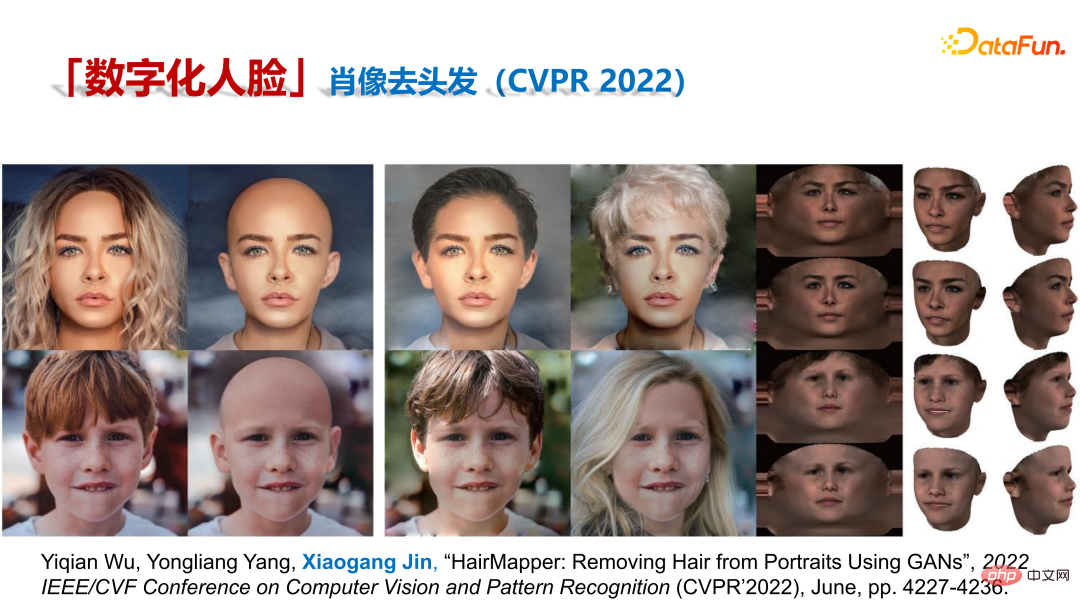

3. ポートレートから髪を削除する

ポートレートから髪を削除することは、指定された写真の人物の髪の毛を取り除きます。キャラクターの髪セットを変更するなどの髪の編集が可能ですが、元の髪をそのままにしておくと合成結果に支障をきたします。デジタル人物の三次元再構成において、元の髪を残すと質感に干渉が生じます。私たちの手法では、毛髪の質感を干渉することなく 3D 再構成結果を得ることができます。

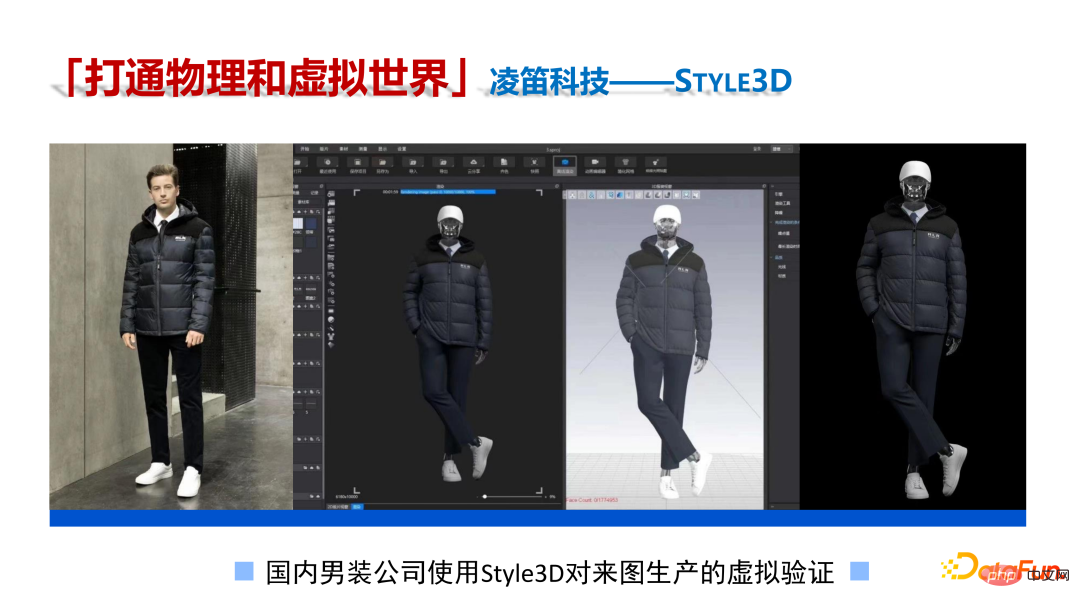

#4. 仮想衣類

これは、メタバース ファッションは、写真を提供し、仮想の服を人の体に合成し、新しい服を好きなように着ることができます。

#持続可能な開発において、ファッション業界には多くの問題があります。バーチャル クロージングは優れたソリューションを提供します。

#たとえば、左側が現実の服、右側が仮想の服です。仮想の服と現実の服は非常に似ていることがわかります。

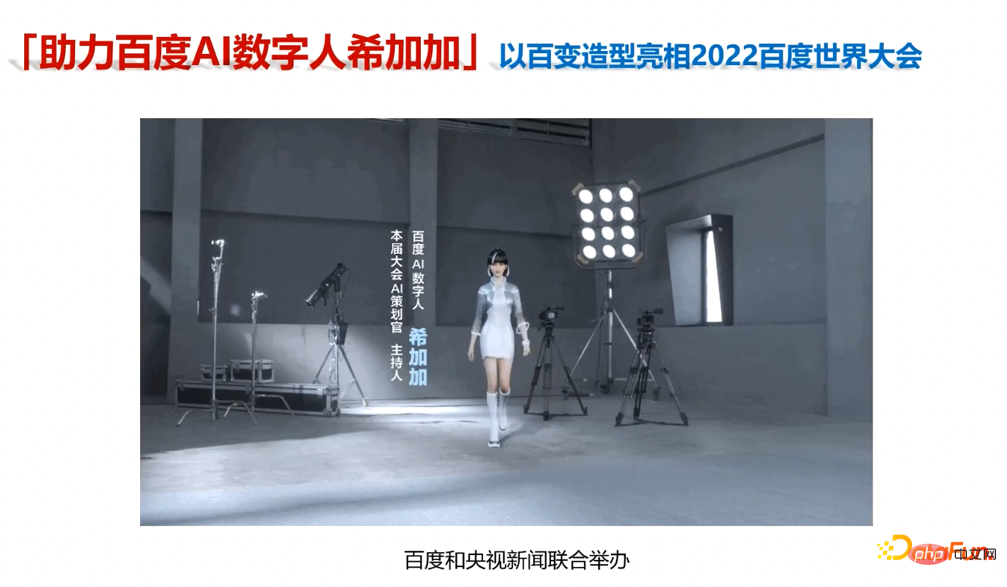

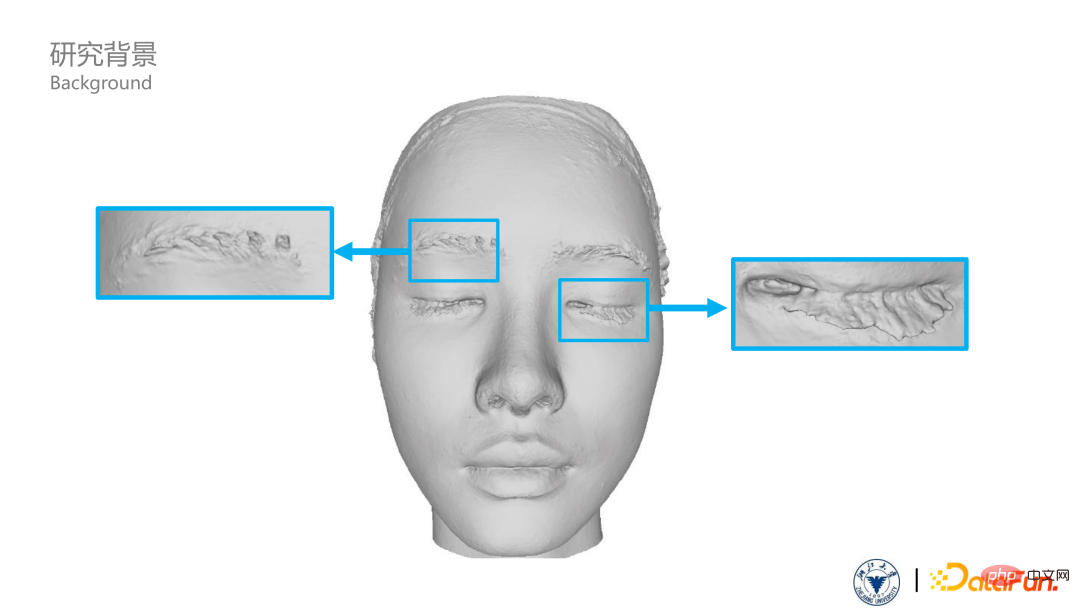

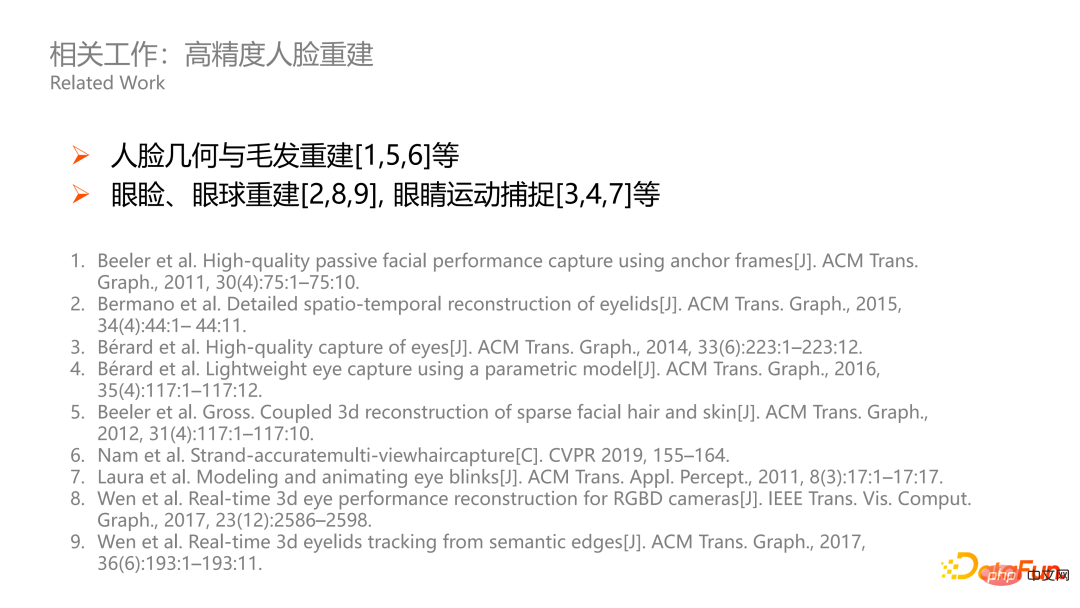

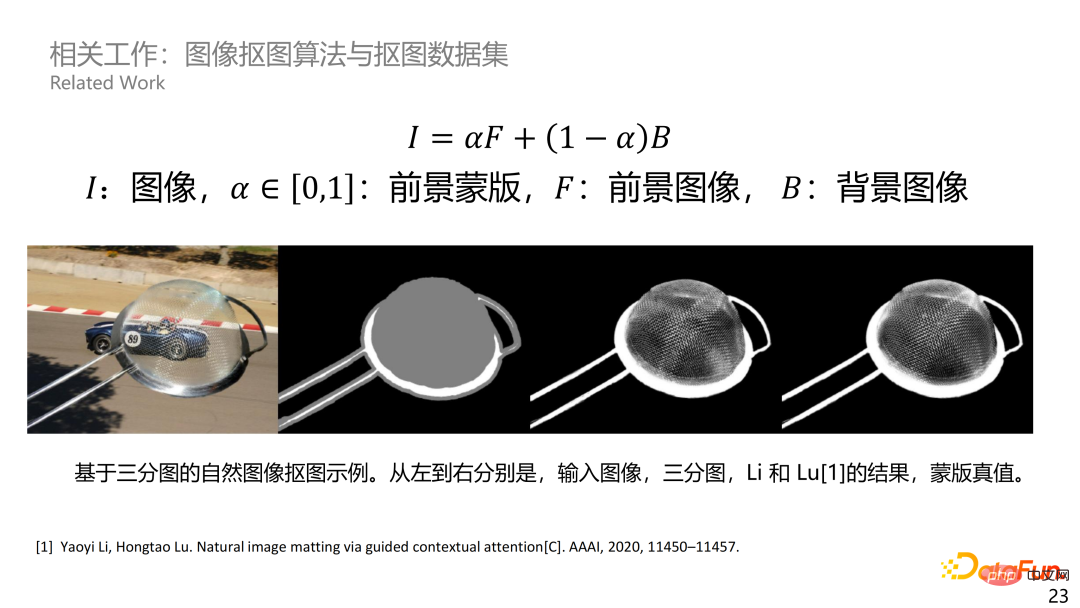

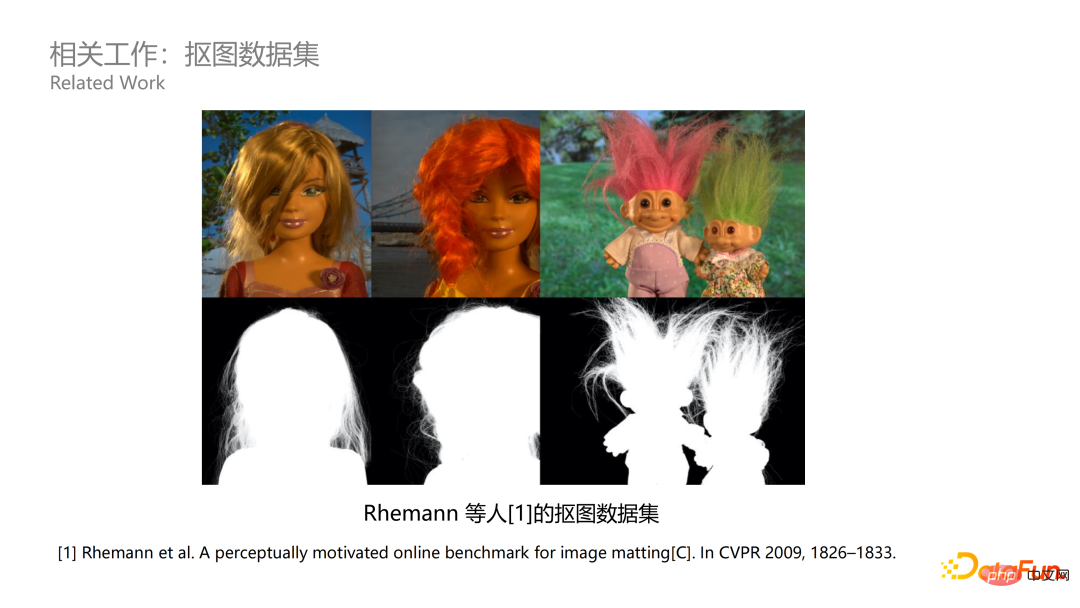

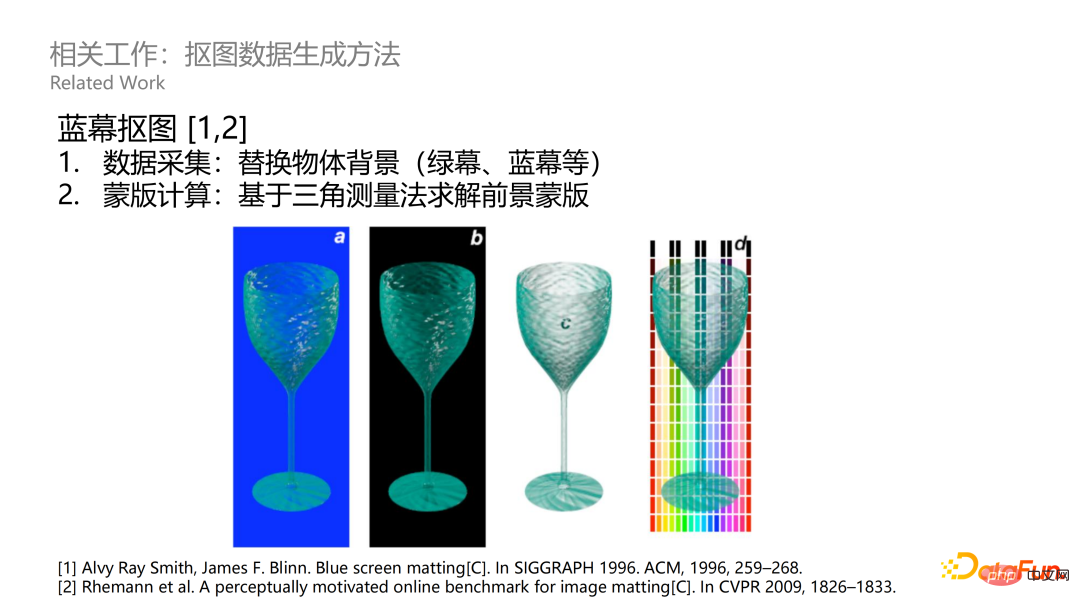

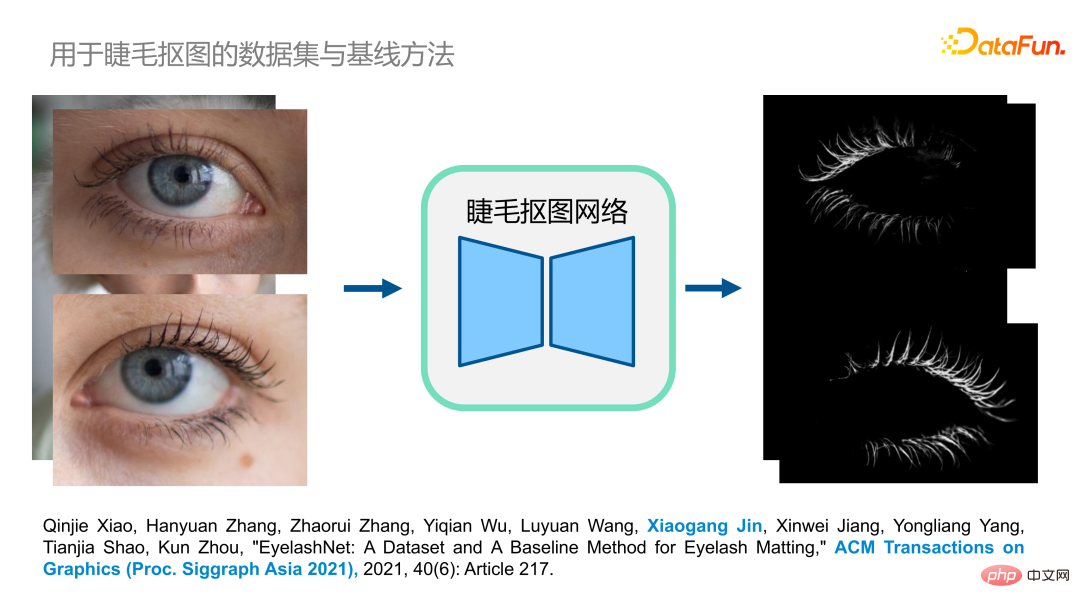

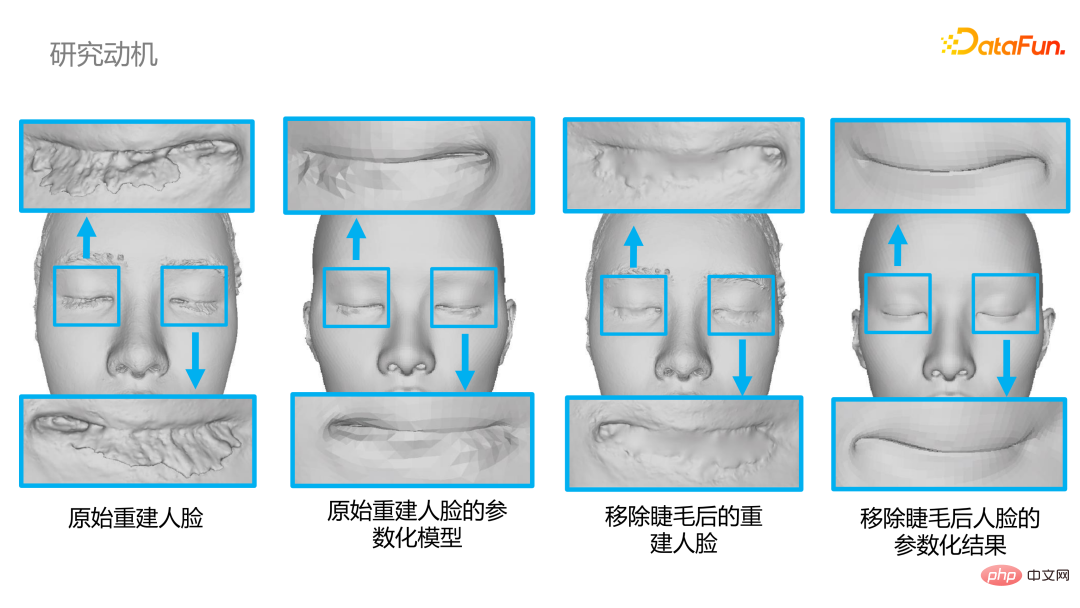

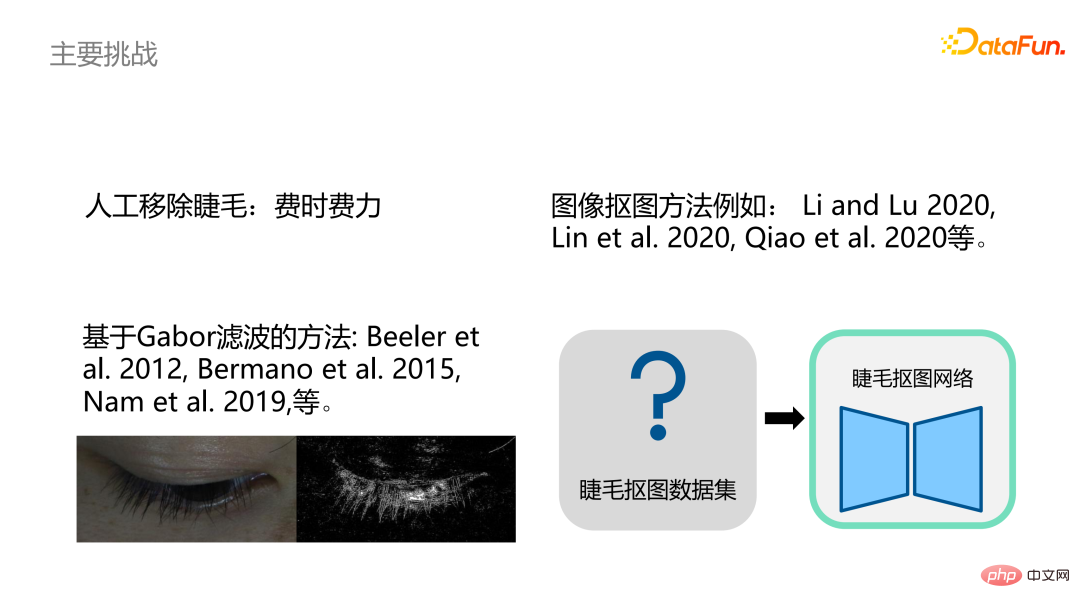

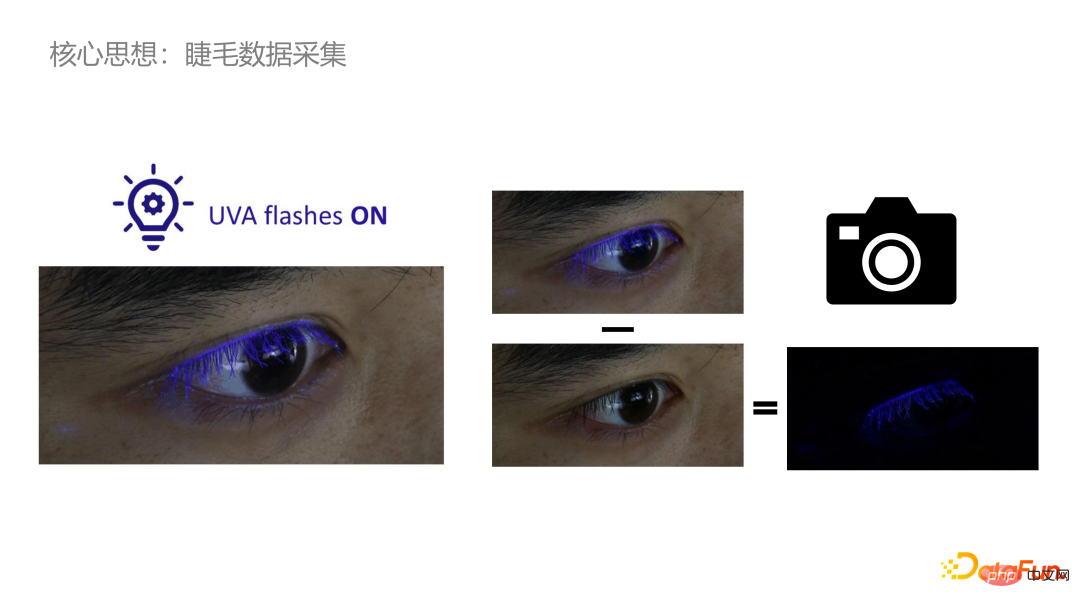

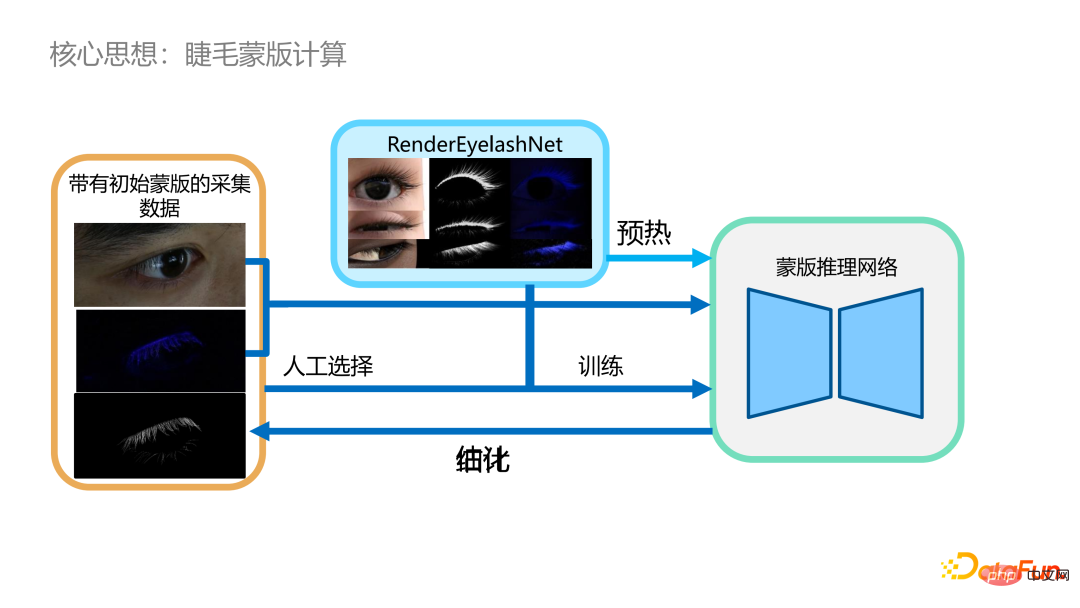

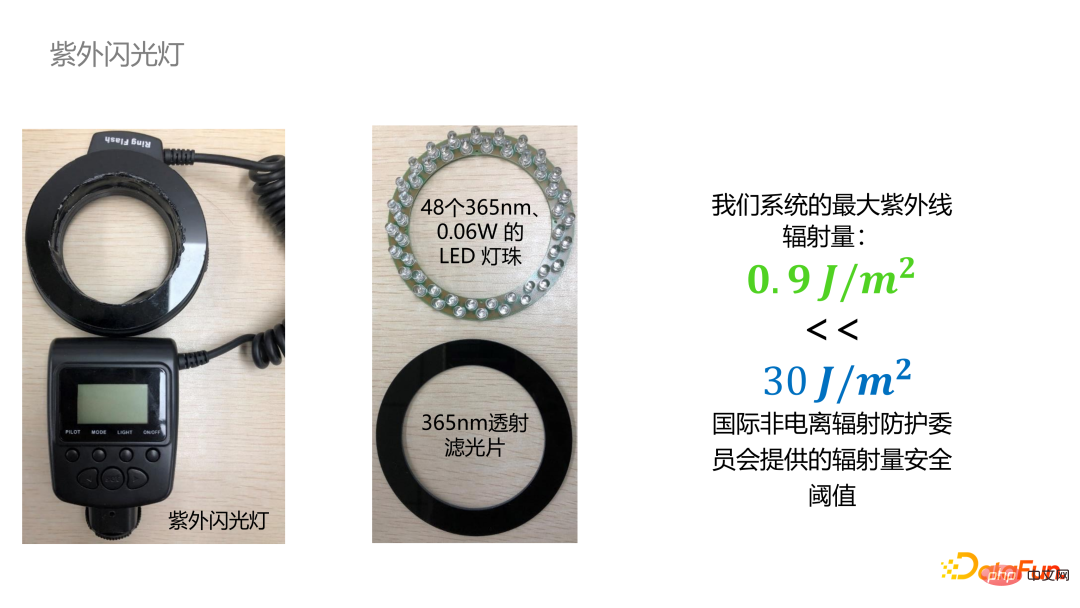

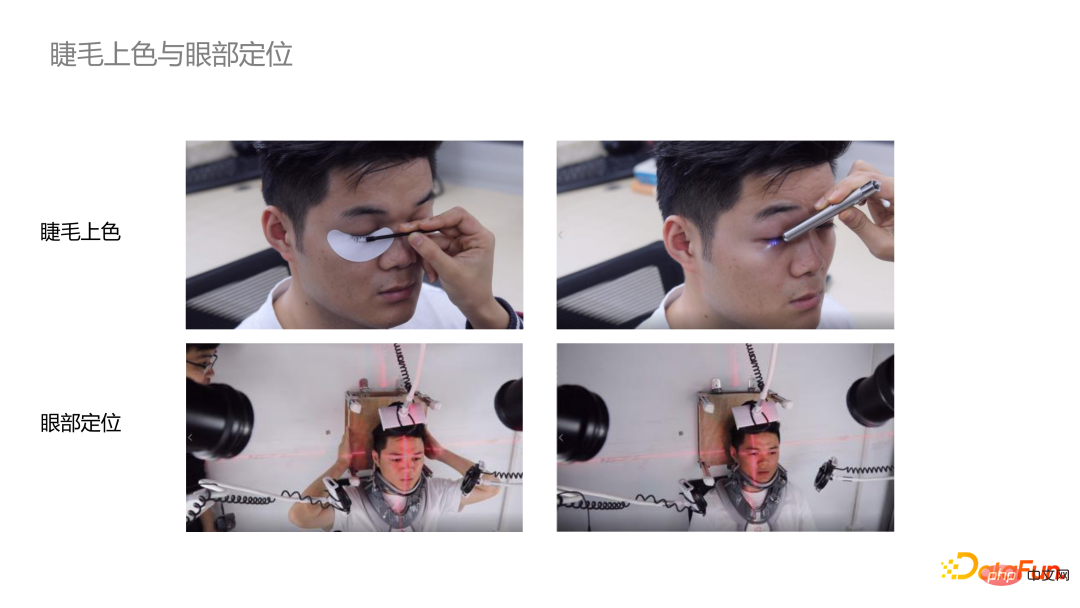

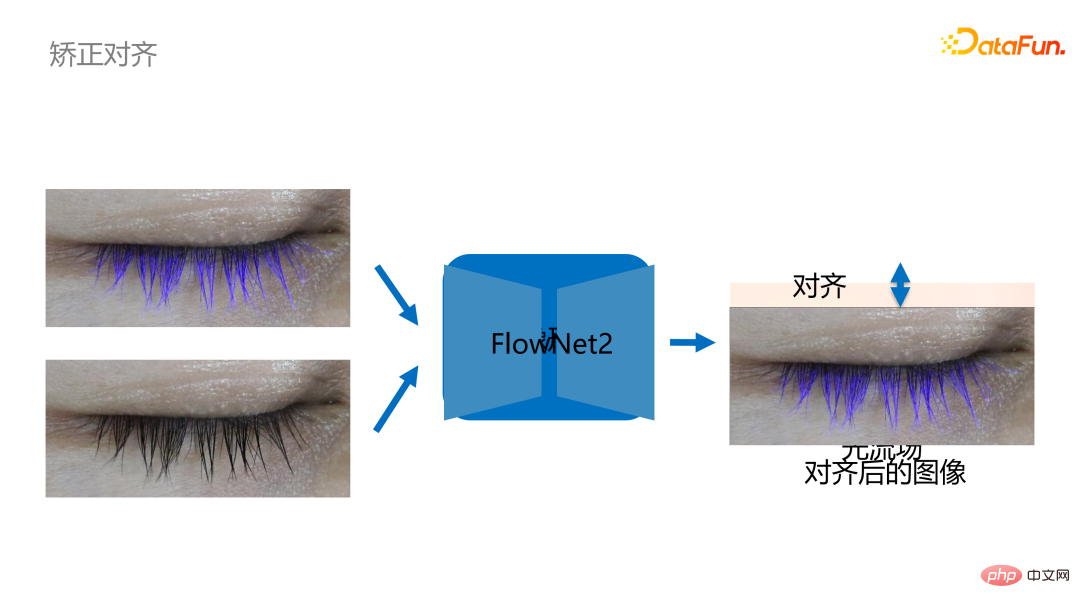

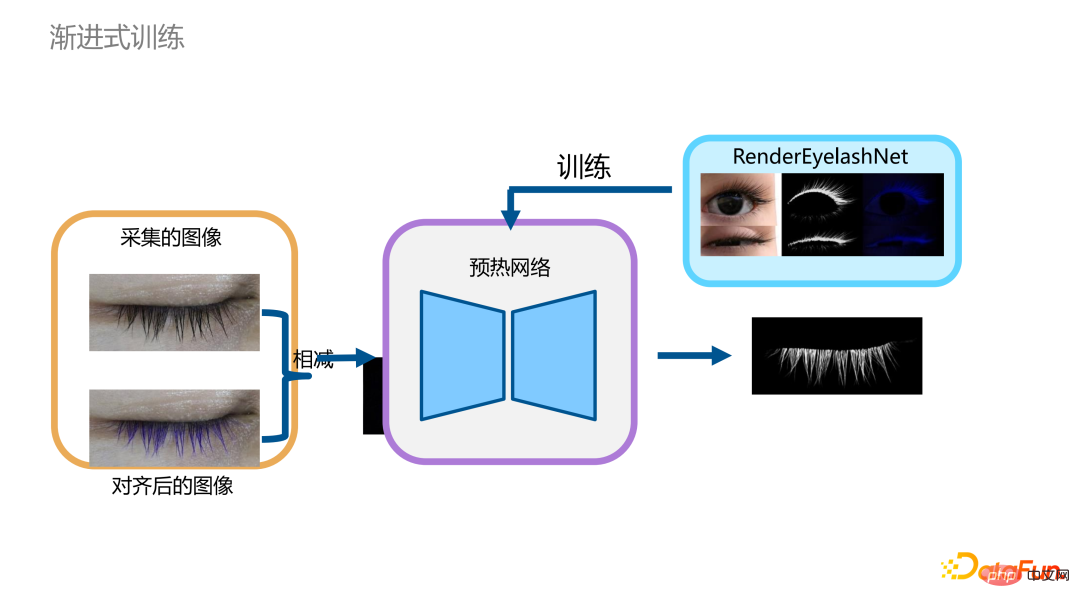

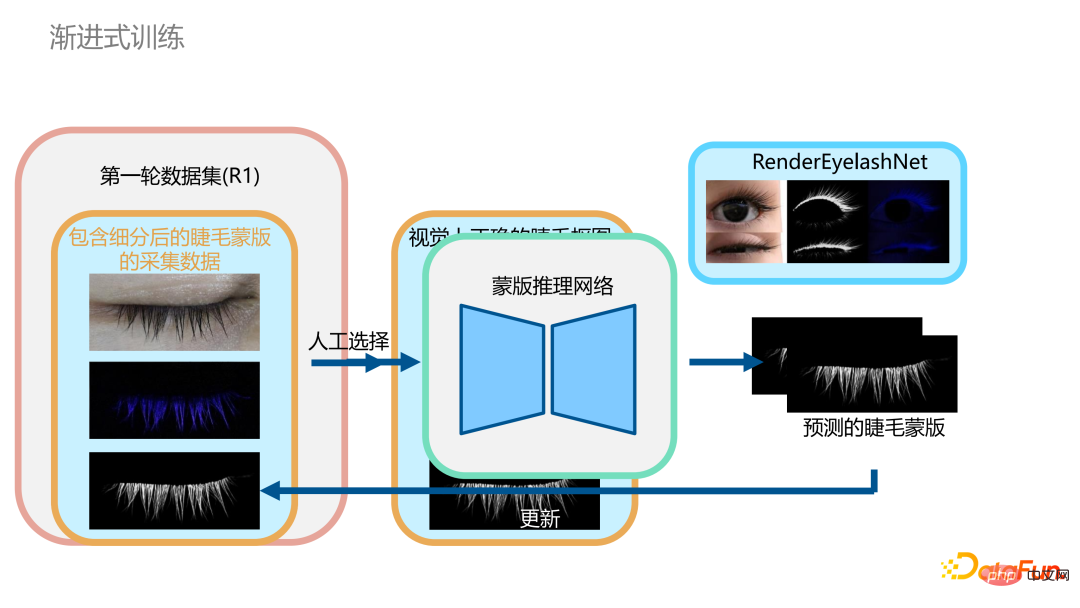

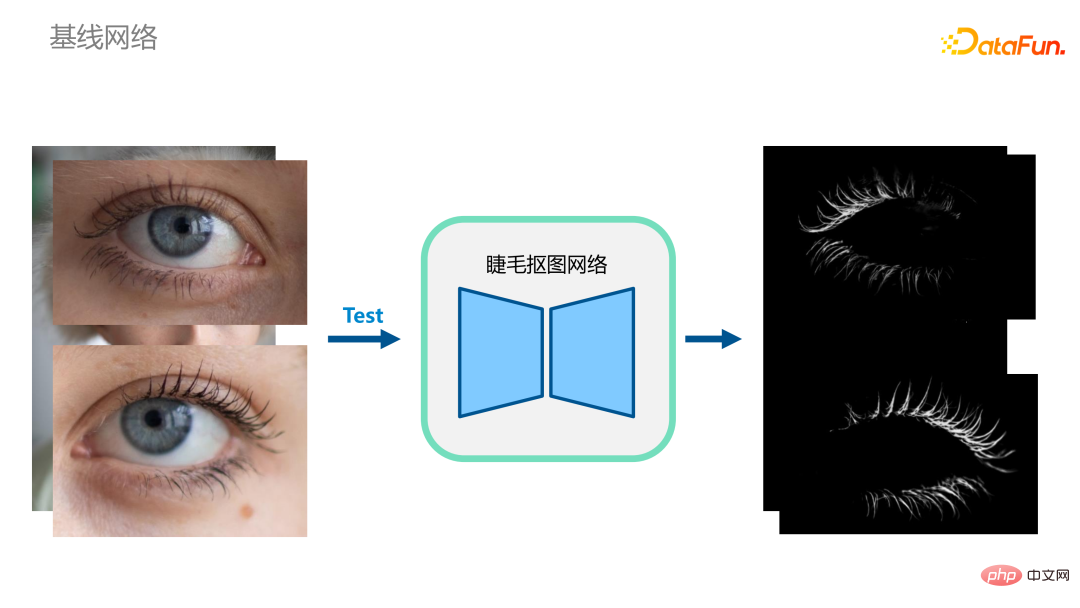

2022 Baidu World Conference のデジタル ヒューマン Xi Jiajia の服装モデルとアニメーションは当社が提供しています。 #上の写真は、映画に登場するデジタル人物と仮想整形手術の作品です。 #私たちが研究したいのは、高精度な三次元顔再構成手法を構築する方法です。ユーザーの写真を収集し、MVS を使用して 3 次元モデルを再構成する方法もありますが、この方法はまつげの処理にあまり効果がありません。まつげには幾何学的な情報があるため、再構成に干渉が生じ、目の領域が不正確になります。 関連顔の形状や髪の再構築、まぶたや眼球の再構築など、多くの研究作業が行われていますが、まつげを正確に編集する実現可能な方法はありません。 まつげを編集するには、カットアウトを使用してまつげを切り取ることができます。下の図に示すように、カットアウトは実際には悪条件方程式を解いています。これは、 3 部構成の図を使用すると、良い結果が得られます。ただし、この方法には 3 つの部分からなるグラフを入力する必要があり、3 つの部分からなるグラフを作成するのが非常に難しいという欠点があります。 最近、カットアウト データ セットについて多くの研究が行われてきました。たとえば、CVPR2009 のデータセットを以下に示します。 ブルー スクリーン カットアウトは、通常、映画の特殊効果でよく使用されます。グリーン スクリーンまたはブルー スクリーンを使用し、いくつかの三角測量法を通じて前景マスクの値を計算します。 解決したいのはまつげのカットです。左側の入力はまつげを含む写真で、マスクの値はマッティング ネットワーク EyelashNet を通じて計算されます。 まつげ部分には幾何学的なテクスチャーが存在します。再構築はパラメータ化されているため、結果に大きな干渉が生じ、効果が非常に悪くなります。アーティストが行うと非常に時間と労力がかかります。そのため、自動的に抽出する方法が必要です。まつげ。 ③主な課題 まつげを手作業で取り除く場合、非常に時間と労力がかかります。ガボールフィルタリング法を使用しても、効果はまだ良くありません。画像マット法も使用できますが、データセットの構築は非常に困難です。ブルースクリーン切り抜きを使用すると、まぶたの上にまつげが生えてくるため、まぶたやまぶたなどの背景画像を分離して差し替えることができず、また、人々はまばたきをするため、まつげを収集するときにじっとしていることが困難になります。厳密に整列した複数のまつげを収集することは、異なる色のまつげを適用することは非常に困難です。 まつ毛をペイントします蛍光剤を塗布し、UVAフラッシュをオンにすると、蛍光効果が確認でき、まつげのセグメンテーション結果が得られます。しかし、これでは十分ではなく、さらなる処理が必要です。 前のステップで取得したデータセットを入力として使用します。使用 マッティング ネットワークは、実際のマッティング結果を予測するために使用されます。しかし、元のデータセットのみを使用した場合、効果はあまり良くなく、グランドトゥルースも得られません。仮想合成手法 Render EyelashNet を設計して予熱し、実験結果を使用して推定結果を予測し、手作業と組み合わせて悪い結果を除外し、最終的に初期マスクを含むデータセットを取得しました。次に、このデータ セットを使用してトレーニングし、洗練された結果を得ることができます。洗練された結果はデータ セットに入れられ、トレーニングされます。反復の後、最終的により良いデータ セットが得られます。

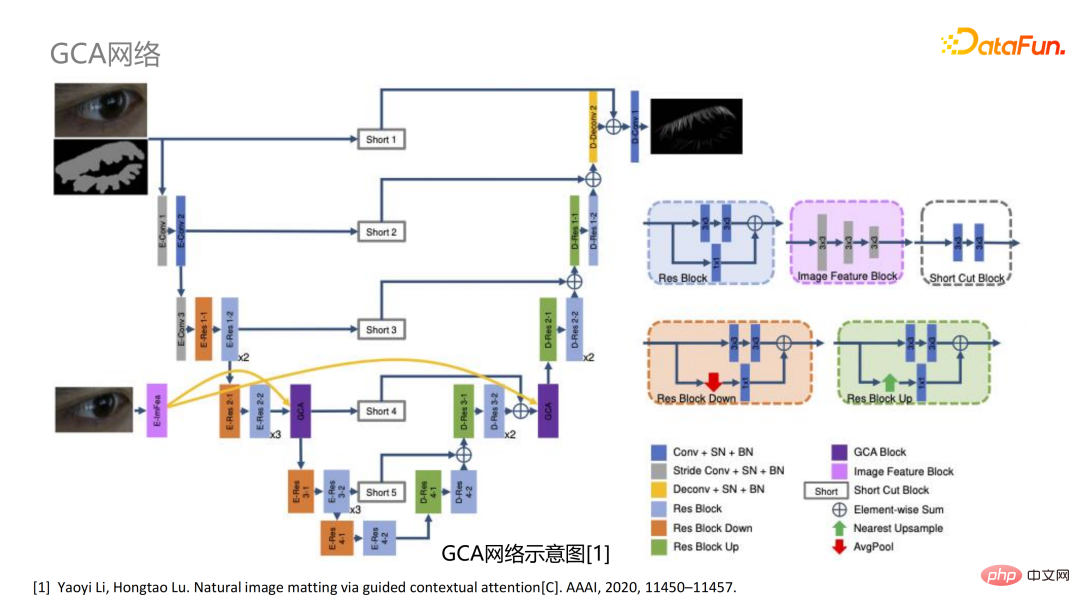

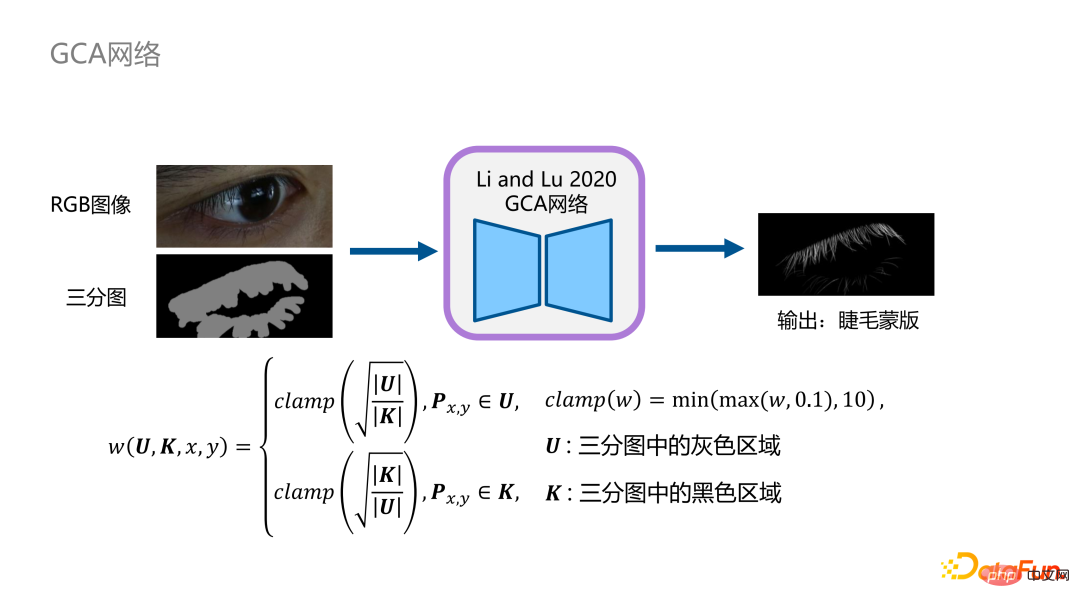

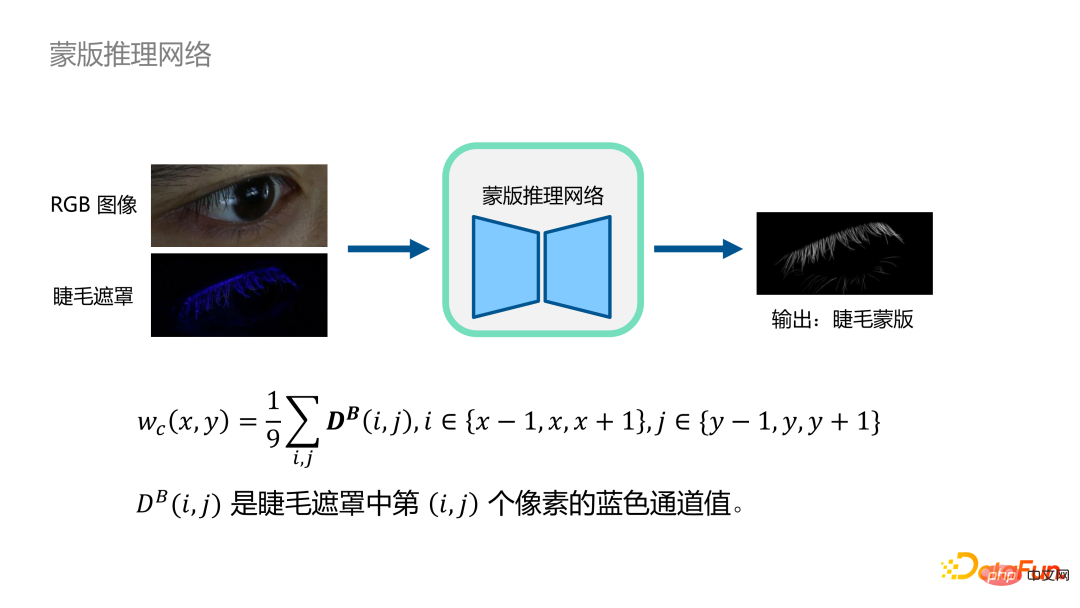

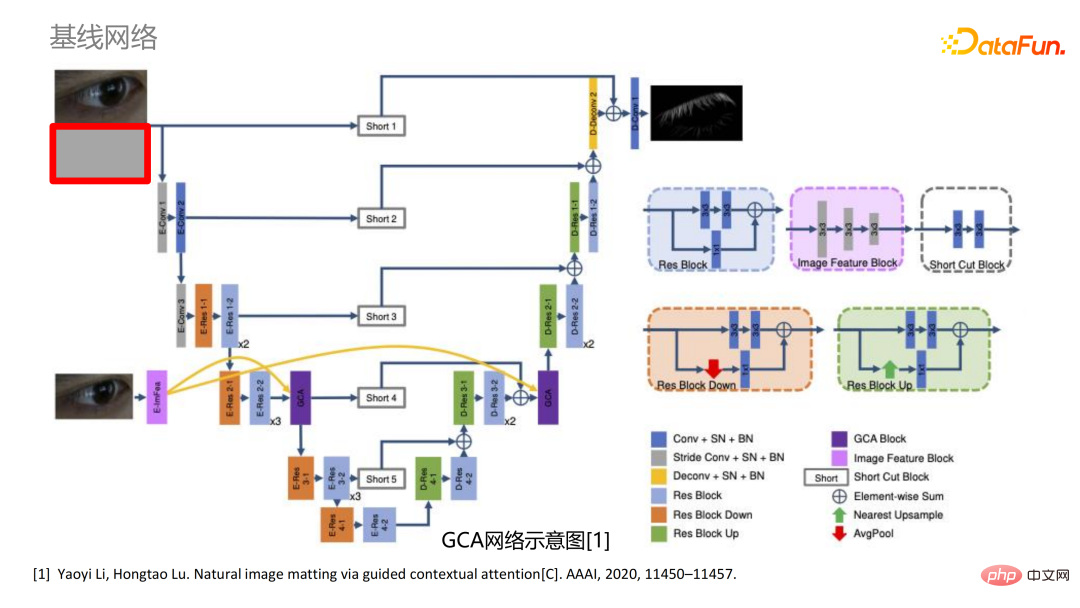

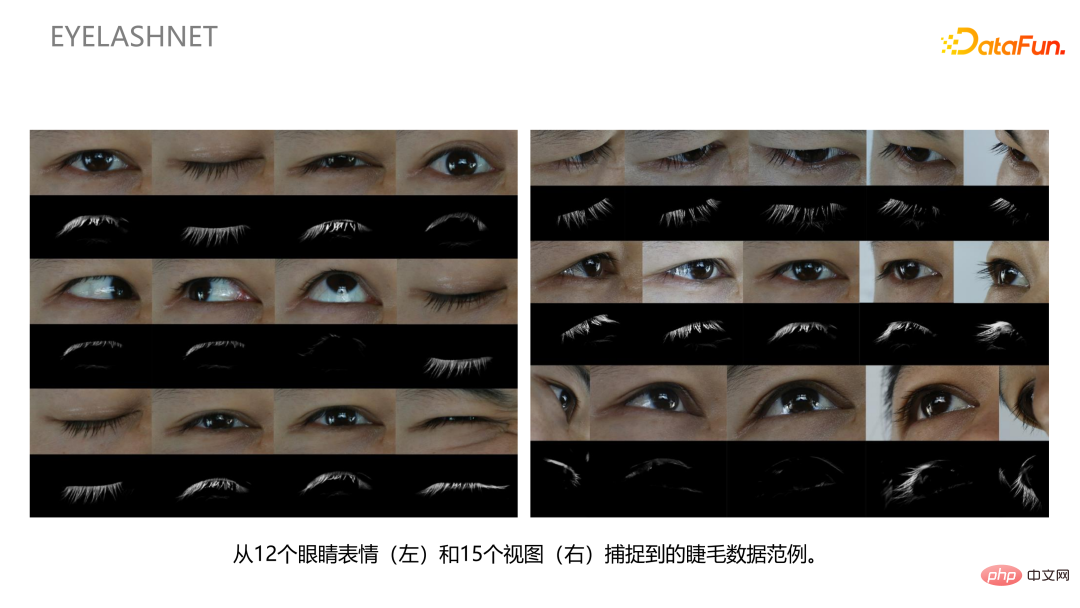

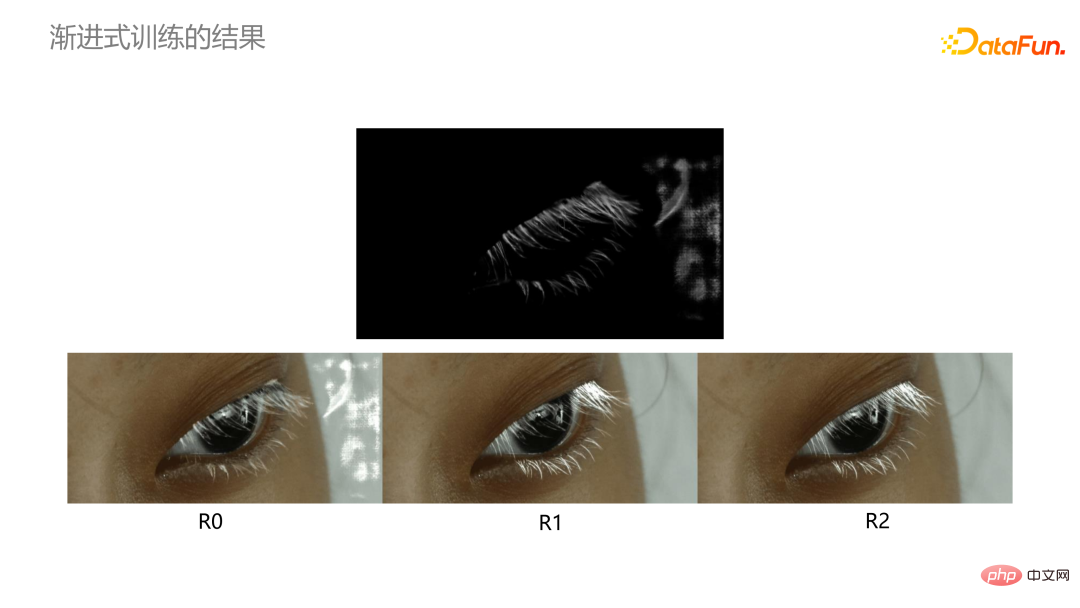

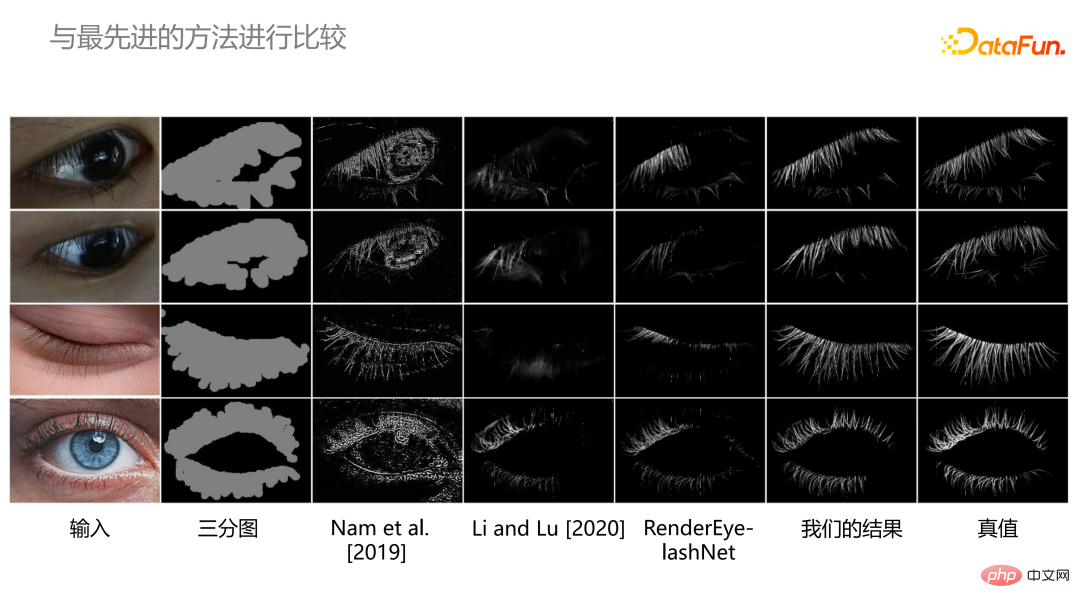

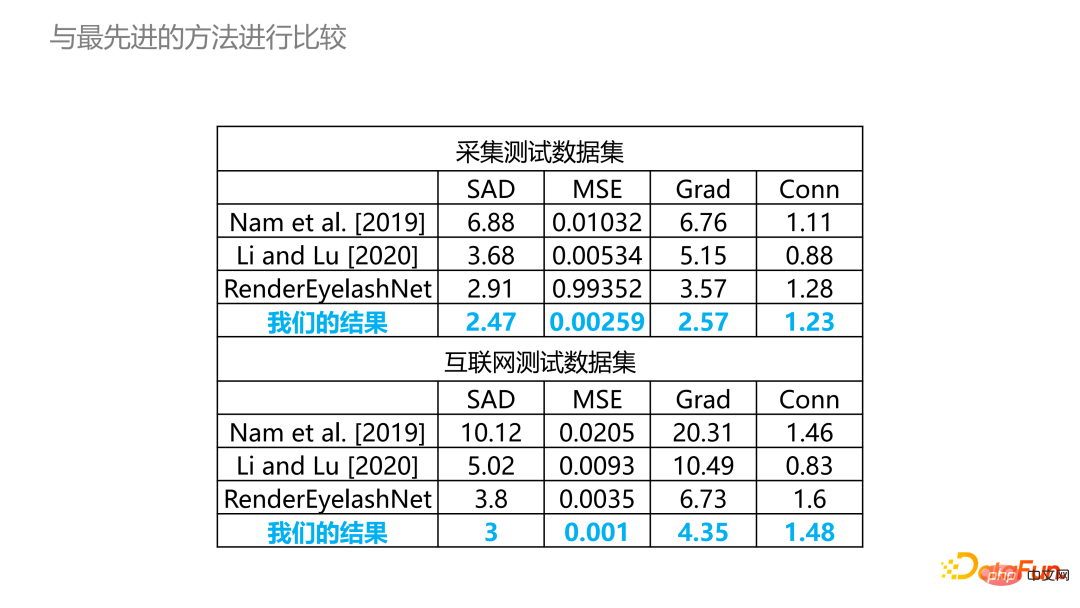

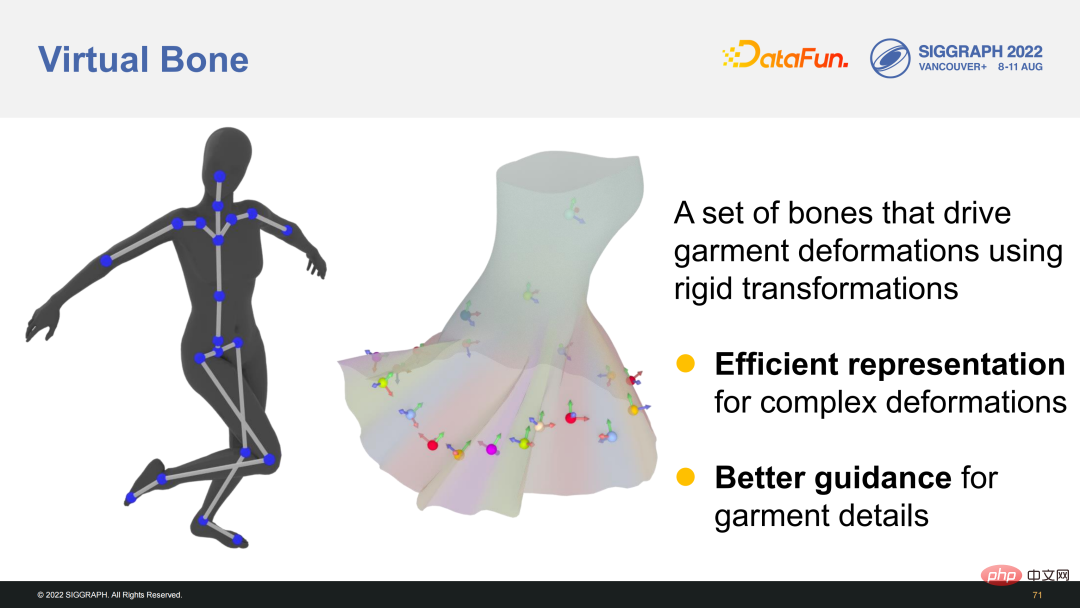

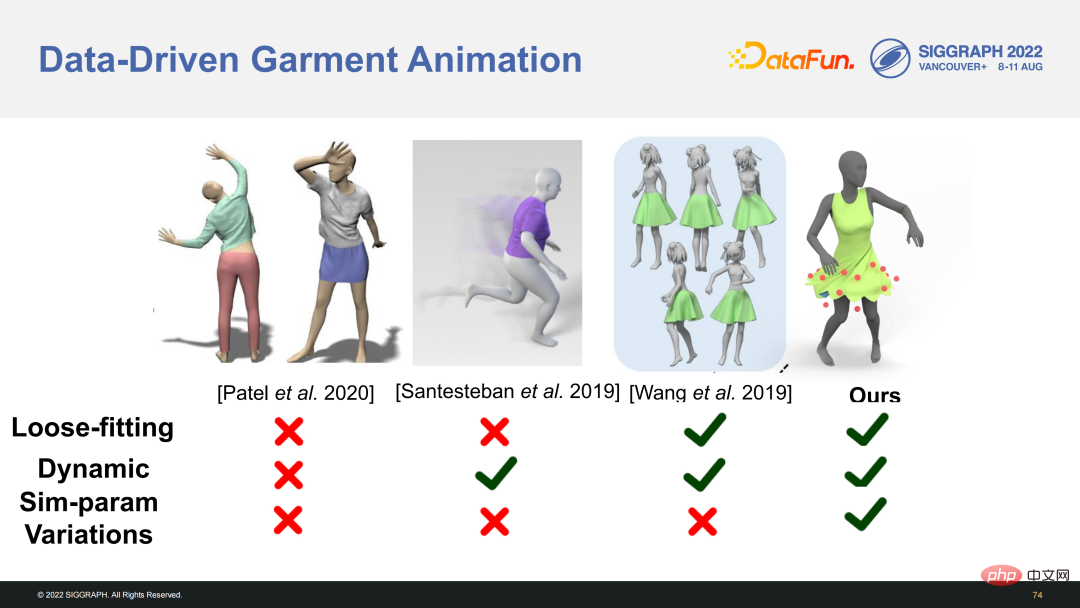

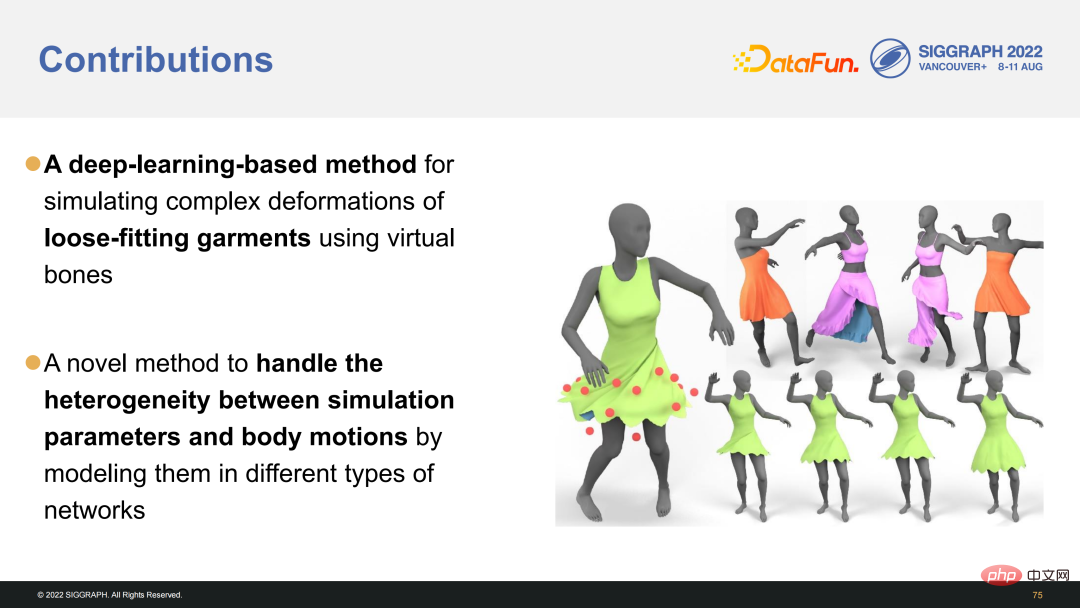

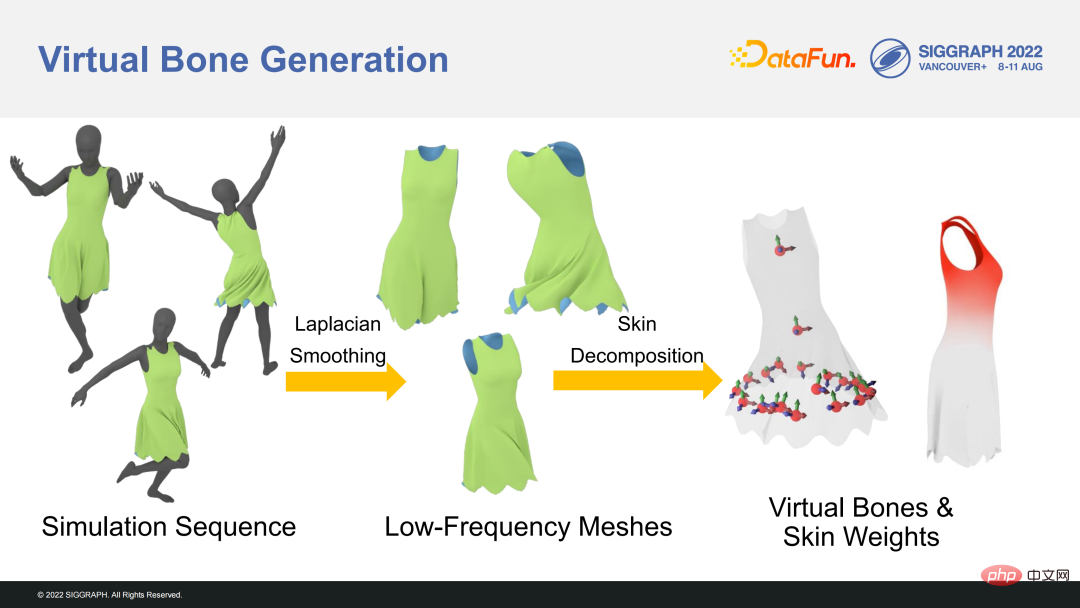

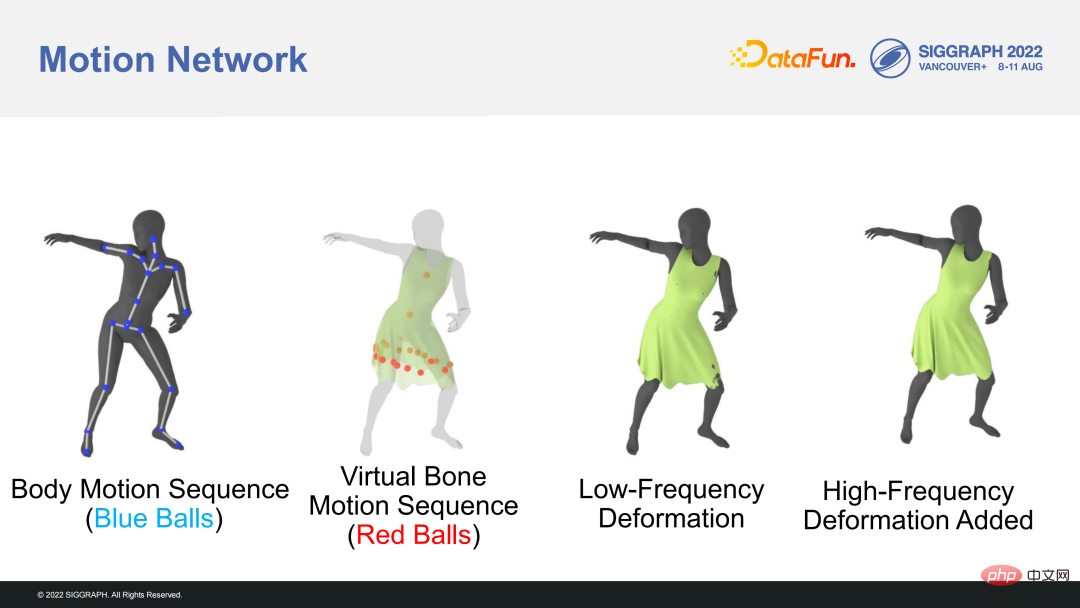

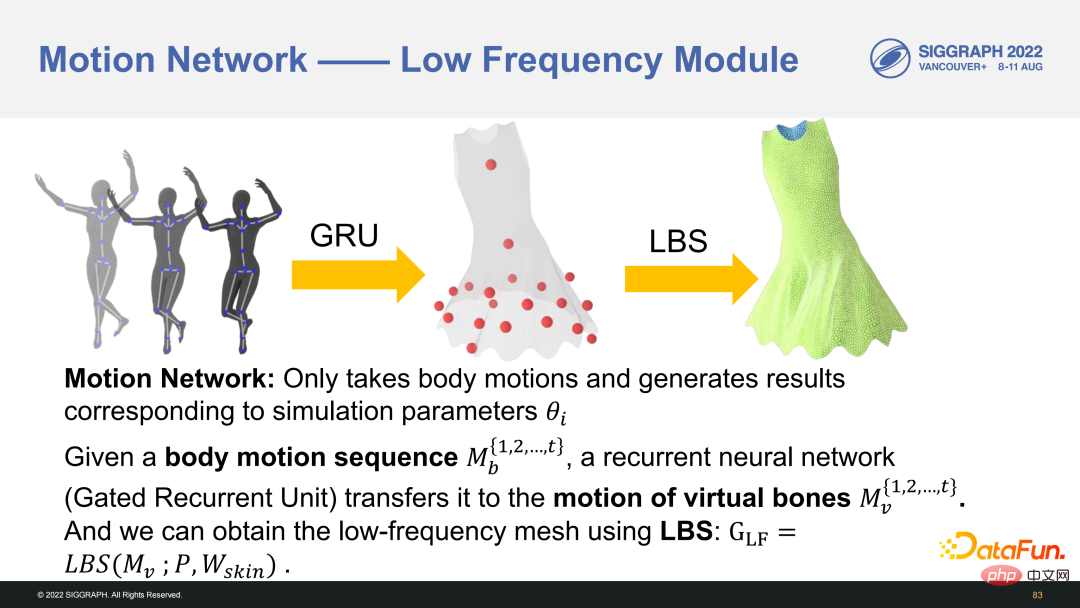

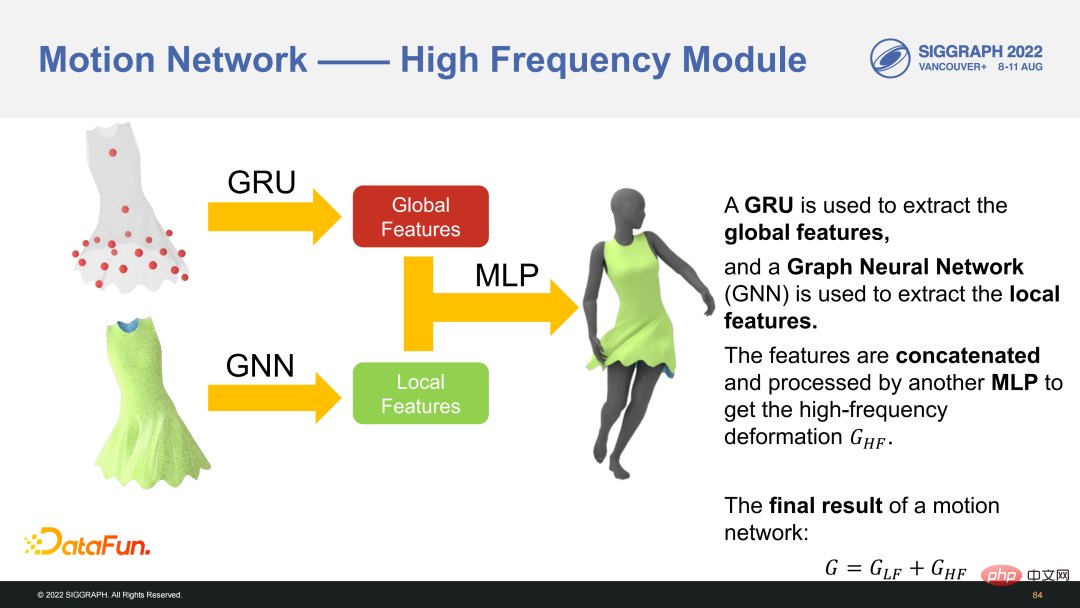

③ 補正位置合わせ ① GCA ネットワーク 私たちが主に使用する出版物AAAI 2020 での GCA Network の推論ステージ。 #GCA ネットワークの入力は RGB 画像と 3 点画像で、出力はまつげですこの結果は、最初の 3 部構成図の結果として使用できるため、まつげの 3 部構成図を手動で作成することが難しいという問題が解決されます。 ここに 3 つあります。画像はまつげマスク画像と入力としての元の RGB 画像に分割されます。RenderEyelashNet と組み合わせたプログレッシブ トレーニングを通じて、予熱ネットワークがトレーニングされてマスク結果が得られます。この結果はトレーニング セットとして入力に追加され、手動でフィルタリングされます仮想データと実際のデータの両方が存在するように、視覚的に正しいまつげの切り抜きデータセットを取得します。このデータセットをトレーニングと推論に使用し、最終的にまつげマスクの予測バージョンを取得します。次に、それをトレーニング セットに入れて再度反復すると、通常は 2 回で望ましい結果が得られます。 最先端のハードウェアおよびソフトウェア機器であっても、まつげの精度を保証することはできません。コレクション トレーニング データの正確性を確保するために、手動選択を通じて一部の悪い結果を削除します。 ベースライン ネットワークのトレーニング後、テスト用に画像を入力すると、より良い結果が得られます。未知の画像の場合、その 3 次元画像がどのようなものであるかはわかりませんが、グレースケール画像を直接入力しても、良好なまつげ予測結果を得ることができます。 # #12の目の表情と15のビューのまつげデータをキャプチャします。 ② テストデータセット 2 回の漸進的な反復の後、得られた結果はすでに非常に良好で、真の値に近いものになっています。 ③ 方法の比較 視覚的に両方とも関係なく、現時点で最良の方法と比較しました。そして定量的には、私たちの方法は以前の方法よりも大幅に優れています。 ④ アブレーション実験 アブレーション実験も行いました私たちのアプローチのさまざまな部分を検証することが不可欠です。 ⑤ 結果表示 インターネット上の写真を検証用に使用しました。グラウンドトゥルースではありません。しかし、これらの写真の場合、私たちの方法は依然としてより良いまつげカットアウト結果を計算できます。 ⑥ アプリケーション Tencent NEXT Studioと協力して、この方法を使用して高精度の3-立体的な顔の再構築により、まつげの領域が非常にリアルになりました。 #もう 1 つのアプリケーションは、まつげの美化編集です。まつげを作成したら、色を変えたり、まつ毛を長くしたりすることができます。ただし、眼鏡をかけている人がいる場所や光の強さが明らかな場所でこの方法を使用すると、結果に偏りが生じます。 私たちが提案したのは、最初の EyelashNet です。キャプチャされた高品質まつげカットデータ 5400 件と仮想まつげカットデータ 5272 件を含む、高品質まつげカットデータセット。 # 当社は、高品質のまつげ画像とマスクをキャプチャするために特別に設計された蛍光標識システムを提案します。 # 私たちの方法は、まつげのカットアウトで最先端のパフォーマンスを実現します。 この作品は、ゆるい服装をシミュレーションするものです。メリーランド大学およびTencent NEXT Studioと協力し、関連論文がSiggraph2022に掲載されました。この研究では、大規模な動きを適切に処理でき、可変のシミュレーション パラメーターをサポートする、深層学習に基づいたゆるい衣服のリアルタイム予測方法を提案します。 この作品の中核技術の 1 つは、剛体変換と線形ハイブリッド シミュレーションを使用した一連の制御である仮想スケルトンです。衣服の変形のためのシミュレートされたスケルトン。仮想ボーンを使用すると、緩んだ衣服の複雑な変形を効率的にシミュレートでき、これらのボーンを入力として使用して、衣服の詳細を生成できます。 一般的に 2 つの方法があります。服が動きます。クラス メソッドの 1 つは、計算コストがかかる物理的なメソッドです。もう 1 つは、実際のデータから学習して実行するデータ駆動型のメソッドです。このメソッドは比較的高速で、パフォーマンスが優れています。 近年、機械学習やディープラーニングの手法が増えていますが、これらの手法は予測静的条件下での衣類の変形、またはぴったりとフィットした衣類の動的変形を予測します。しかし、実際にはスカートなどの衣類はゆるいものが多く、ゆるい衣類の変形を予測する手法はありますが、大きな動きの変形を予測するのはあまり得意ではありません。さらに、現在のメソッドは変数パラメーターをサポートしていません。 私たちの研究は主に 2 つのポイントで構成されています。 1つ目は、ディープラーニング手法を使用して、衣服の複雑な変形を予測し、衣服の変形を低周波部分と高周波部分の2つの部分に分解します。仮想ボーンを使用して低周波部分の変形を表し、それを使用して高周波部分を推論します。2 番目の貢献は、物理シミュレーション パラメータと組み合わせた体の動きを入力として使用し、このメソッドを使用して不均一性を処理することです。 2 つの入力。 ② モーションネットワーク

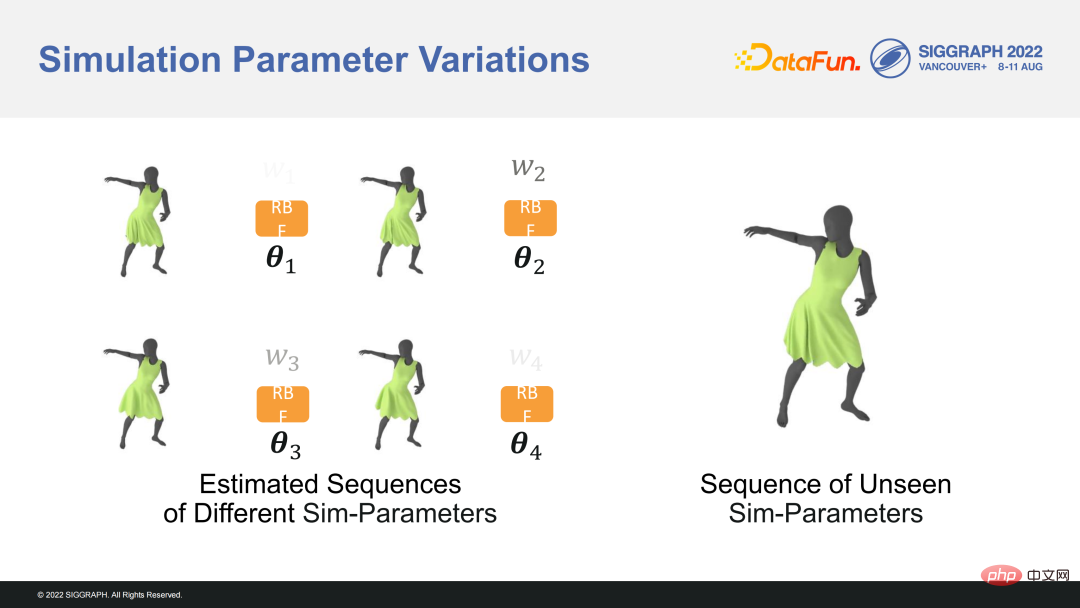

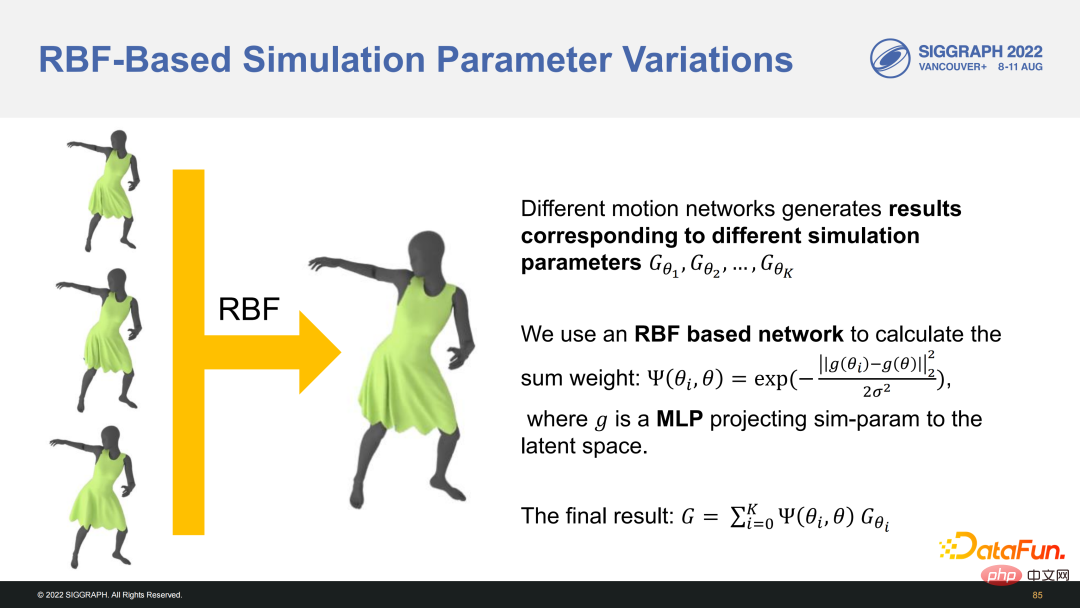

③ シミュレーション パラメーター変数

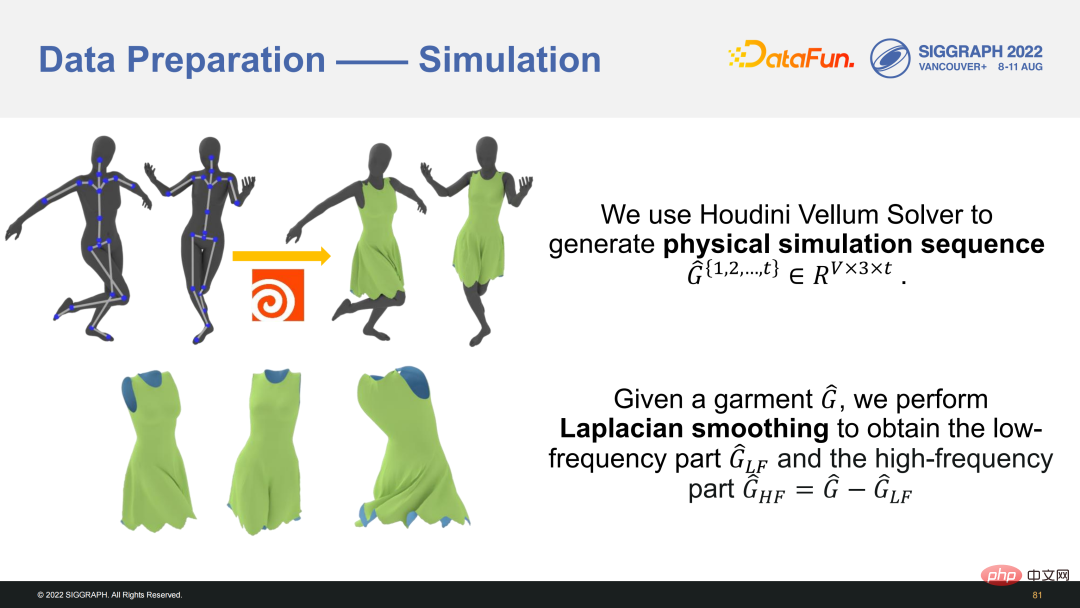

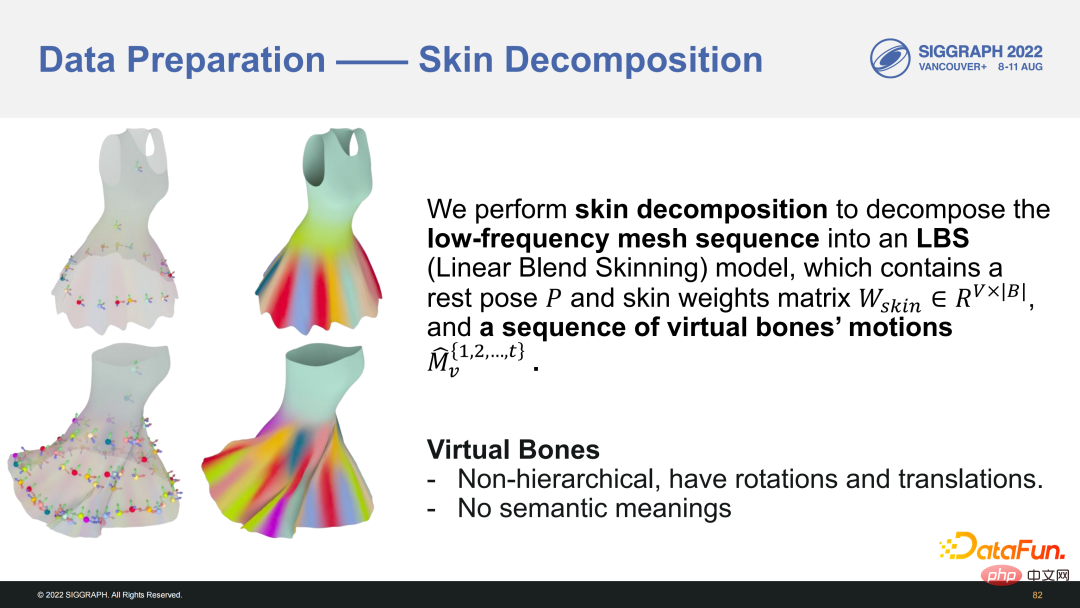

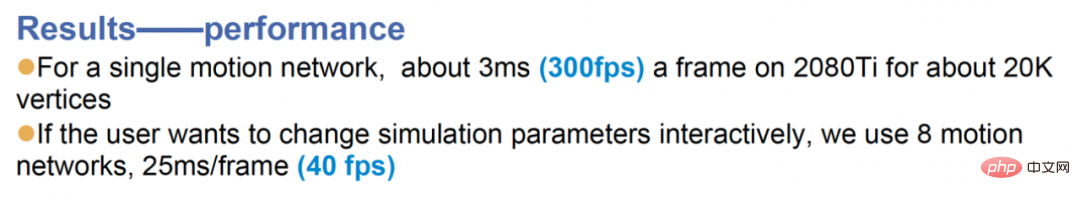

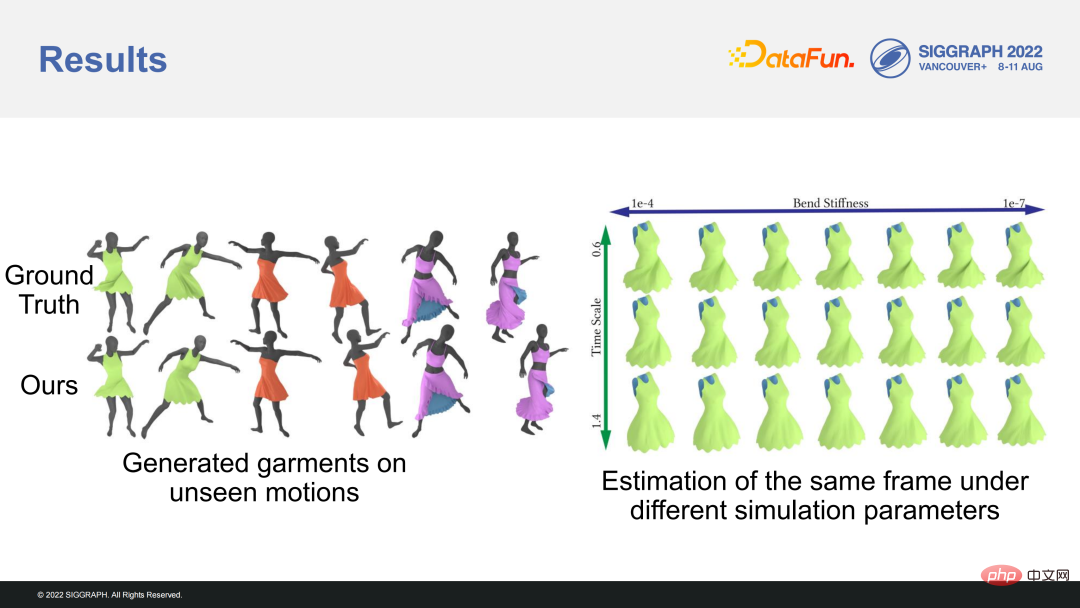

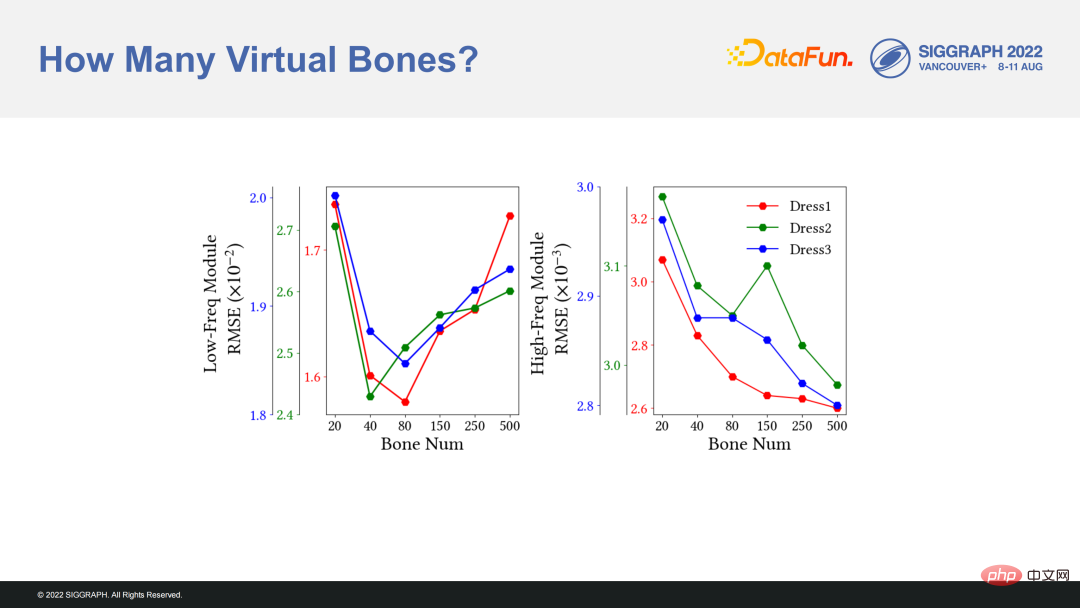

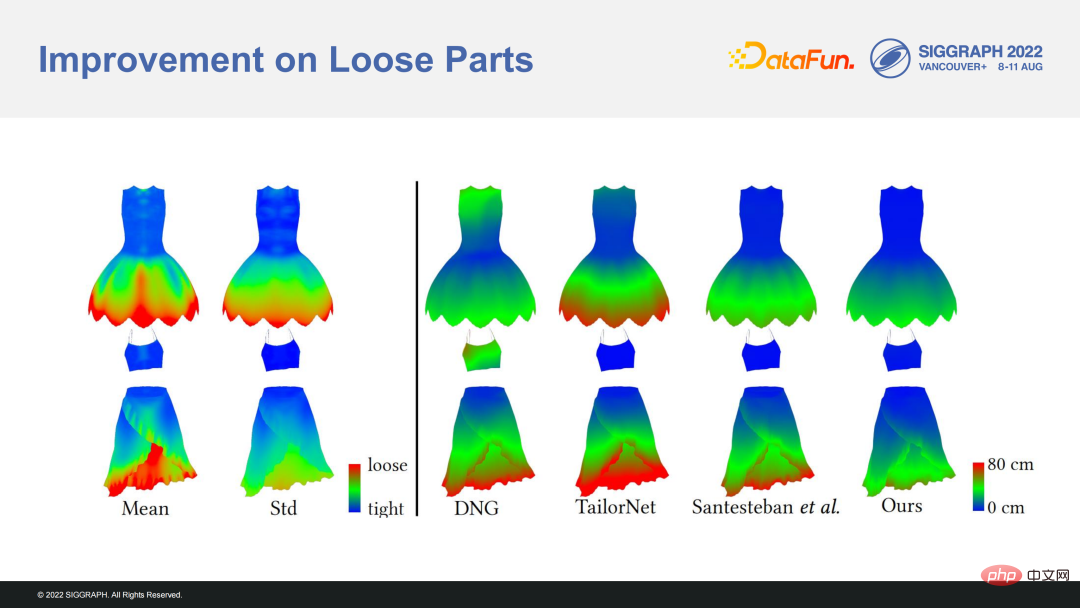

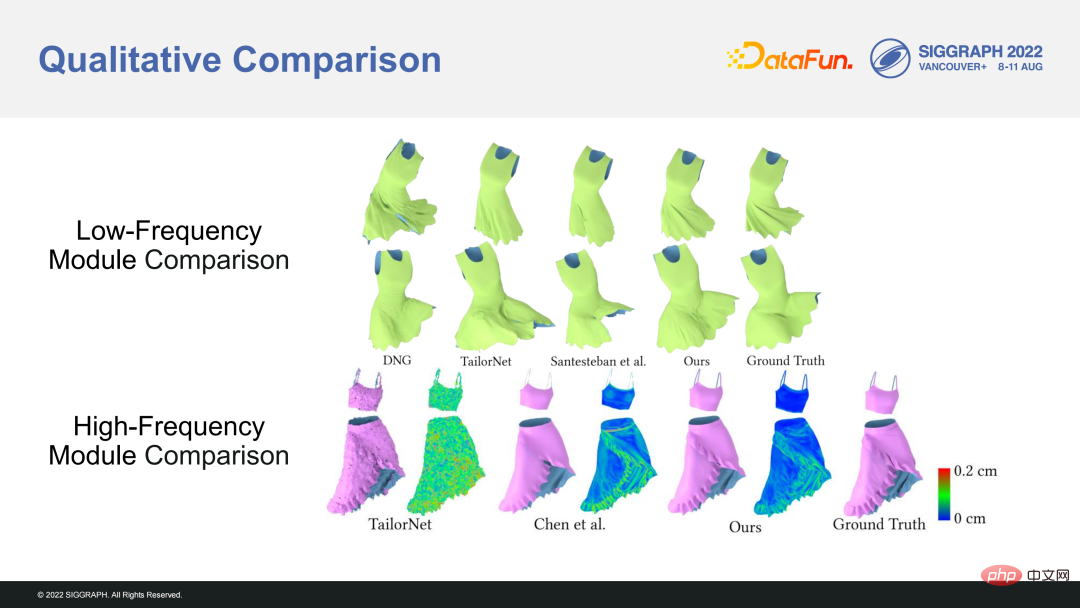

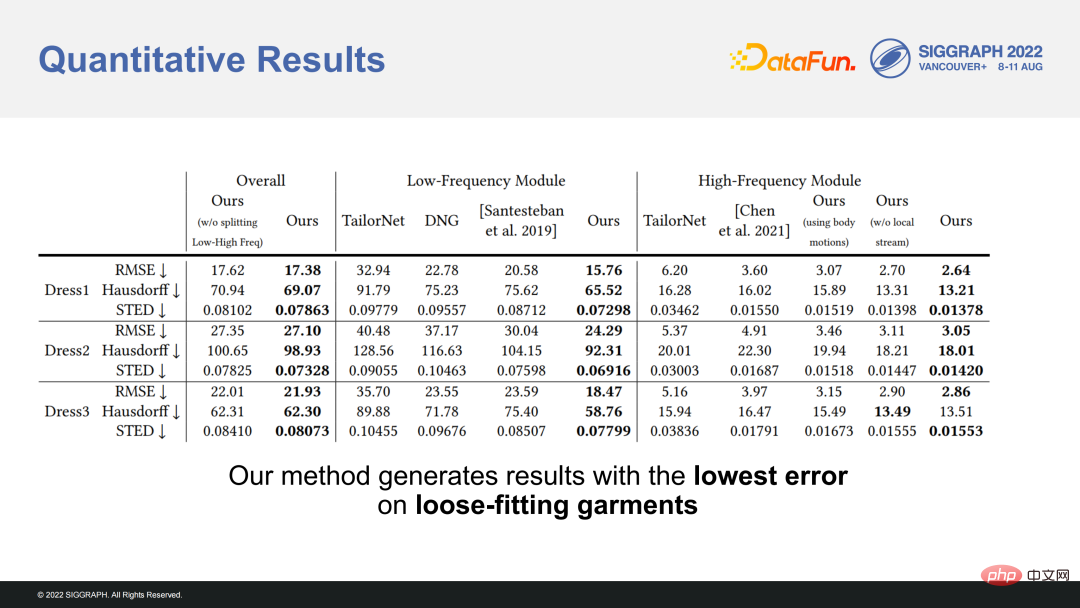

#5.方法 まず、グラウンド トゥルース データを生成する必要があり、Houdini Vellum Solver を使用して、約 40,000 フレームのアニメーションをシミュレートします。実際の人々のモーション キャプチャ結果ではなく、インターネットのビデオ アクションを使用しました。これは、大きな動きをシミュレートしたいが、実際の人の動きは小さいためです。 ② スキン分解 低周波変形シーケンス スキン分解を使用して仮想ボーンを取得します。結果は、レスト ポーズと各ボーンに対応するスキン ウェイトを含む線形ハイブリッド スキン モデルです。各フレームでの仮想スケルトンの平行移動と回転も取得されます。バーチャル ボーンには階層関係がなく、親ボーンと子ボーンの間には関係がなく、各ボーンには独自の回転と移動があります。 #また、仮想ボーンには現実的な意味はなく、特定のアニメーションごとに取得されます。ボディ入力の処理にはモーション ネットワークを使用します。各ネットワークは異なるボディ シミュレーション パラメータに対応します。入力は関節の回転とキャラクターの平行移動のみで、出力は物理パラメータに対応するメッシュ推論結果です。 ③ アクション ネットワーク アクション ネットワークは、低周波部分と高周波部分を推測します。順序。 低周波部分には、リカレント ニューラル ネットワーク GRU は、入力された身体の動きを仮想ボーンの回転と平行移動に変換します。リカレント ニューラル ネットワークを使用する利点は、前のフレームから情報を取得できるため、動的効果をより適切にキャプチャできることです。低周波変形は、次の方法で取得できます。仮想ボーンのリニアハイブリッドスキニング。 アクション ネットワークを使用して高周波部分を予測できます。1 つは GRU で高周波の特徴を取得し、もう 1 つは GNN で低周波部分の特徴を取得します。2 つの部分の特徴は MLP を通過します。高周波情報を取得します。高周波と低周波の結果が加算されて、最終結果が得られます。 6. 結果 #結果パフォーマンス #もう 1 つの問題は、仮想ボーンの数を選択する方法です。私たちの実験では、低周波部分については、数値が小さすぎても効果がなく、多すぎてもあまり役に立たないことがわかりました。80 がより良い結果です。ただし、高周波部分では、仮想ボーンの数が多いほど、細部をよりよく表現できます。 ゆるいとは、衣服と人体との距離を指し、赤い部分は遠いことを意味します。 、青い部分は「tight.」セクションを意味し、結果 (右端) がより優れていることがわかります。 #定性的な比較結果

#7. 今後の見通しと概要 非常に大きな動きにおいて場合によっては、シミュレーション結果の脚が衣服をすり抜けることがあります。これは、エネルギー ネットワークを介して衝突回避が追加されているためです。将来的には、他のスキニング方法を使用して、より良い結果を得ることができます。 高精度の顔の再構成とアニメーションは、ゲーム、バーチャル ヒューマン、メタバースなどの多くのアプリケーションで重要です。いずれもリアルタイム処理が必要ですが、これも大きな課題です。また、衣服は人体の80%以上を覆っており、デジタルヒューマンにとっても重要な部分です。グラフィックス アプリケーションでは、近距離では顔に注意を払うことがありますが、少し離れたところでは服装により注意を払います。今後の開発の方向性は、低コストの手法を使用して、非常にリアルなリアルタイムのデジタル ヒューマン アプリケーションを構築することだと思います。 #A1: 仮想ボーンは計算されており、服を変えると新しいボーンを再生成する必要があり、その数や変形も異なります。推論中にリアルタイムで計算されます。 #A2: 非常に便利です。これまで学んだことがない人でも、トレーニングすればすぐに習得できます。衣装を一からデザインする場合でも、非常に複雑な衣装を 1 ~ 2 時間でデザインできる場合があります。 2. まつげカットアウトのデータセットとベースライン手法

1. 研究の背景

#2. 関連作品: 高精度顔再構成

#4. まつげカットに使用するデータセットとベースライン手法

#4. まつげカットに使用するデータセットとベースライン手法 ① データセットのベースライン手法の紹介

② 研究動機

② 研究動機

#⑤ まつげマスクの計算

#⑤ まつげマスクの計算 #5. まつげデータ収集システム

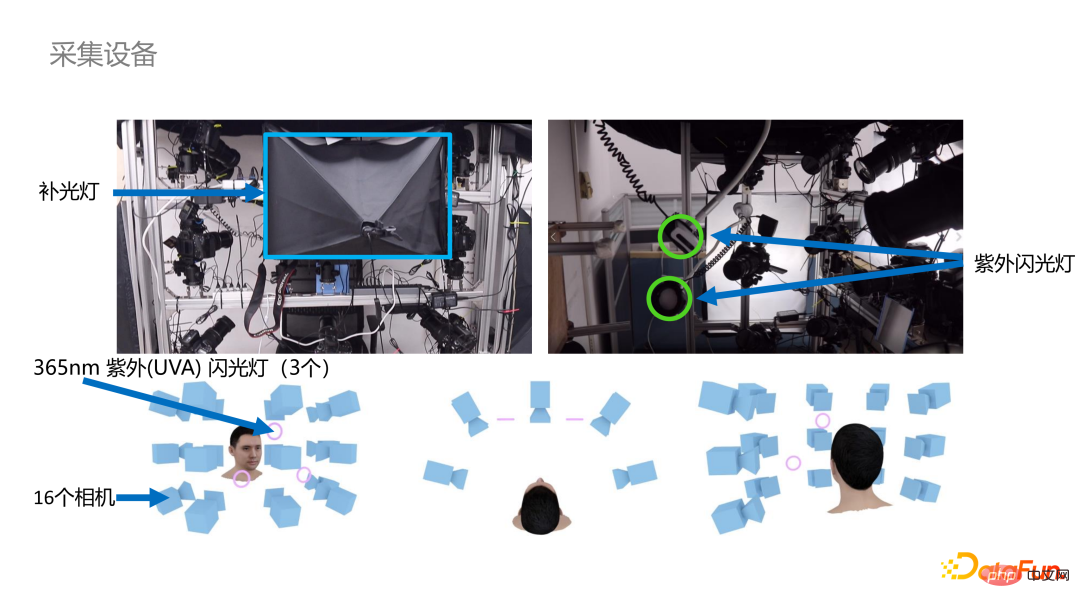

#5. まつげデータ収集システム①収集装置

16 台のカメラ、365 nm UV フラッシュ、補助光システムなどを含む収集システムを構築しました。特定のパラメーターについては、スクリーンショットを参照してください。

6. 推論段階

#④ ベースライン ネットワーク

#④ ベースライン ネットワーク

7. データセット

7. データセット①トレーニングデータセット

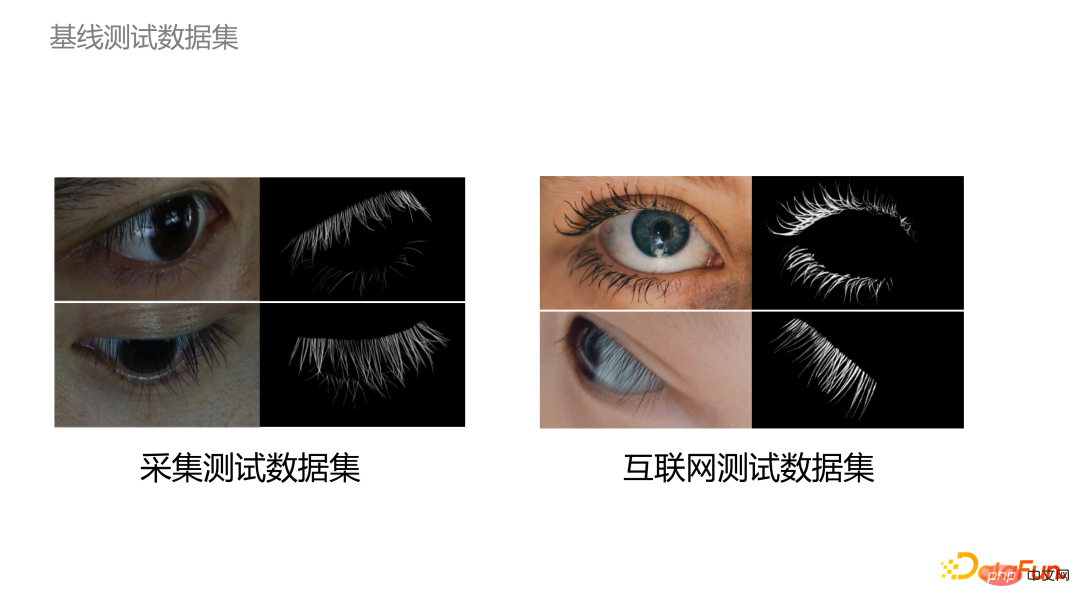

検証するため私たちの方法では、テスト中に自分で収集したデータだけでなく、インターネット上のいくつかの画像データも使用しました。

検証するため私たちの方法では、テスト中に自分で収集したデータだけでなく、インターネット上のいくつかの画像データも使用しました。

1. 仮想スケルトン

#2. 職歴

#4. 概要説明

#4. 概要説明① 仮想スケルトン生成方法

① データ準備

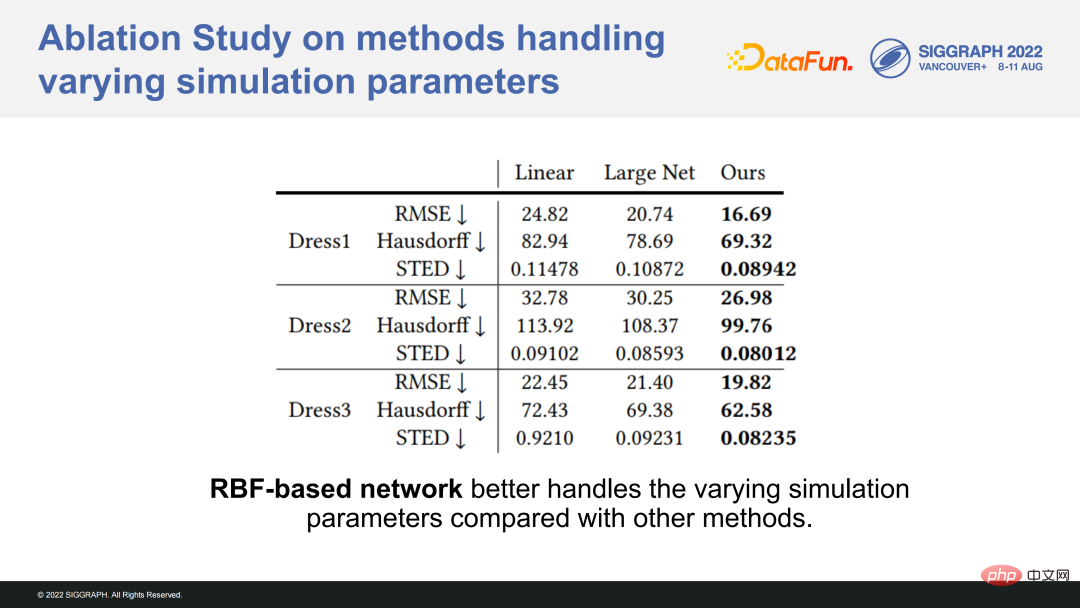

RBF ニューラル ネットワーク

リアルタイム シミュレーションでは、シミュレーション パラメーターを変更せずに、ゆったりとした服装を実現しました。非常によくシミュレーションできます。

##左側のシミュレーション結果はグラウンド トゥルースに非常に近く、右側は可変パラメーターを扱います。

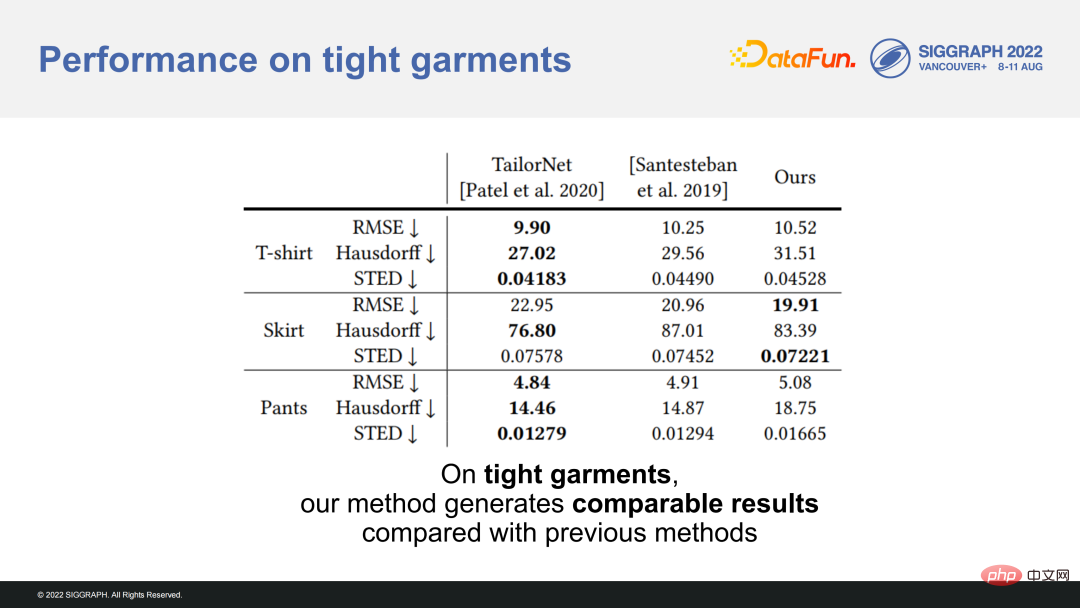

#定量的な比較結果

#定量的な比較結果

#4. 質疑応答セッション

#Q1: 方法仮想ボーンの安定性を確保する 一般化可能性?

以上がデジタルヒューマンモデリングとアニメーションの主要テクノロジーの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。