ChatGPT を使えば、すべての質問に答えることができます。

# これとの各会話にかかる計算コストは、驚くべきものであることをご存知ですか。

# 以前、アナリストは、ChatGPT は 1 回の返信に 2 セントかかると述べていました。

#人工知能チャットボットに必要なコンピューティング能力は GPU によって駆動されることを知っておく必要があります。

#これにより、NVIDIA のようなチップ企業は富を得ることができます。

2 月 23 日、NVIDIA の株価は急騰し、時価総額が 700 億ドル以上増加し、時価総額は 5,800 億ドルを超えました。これはインテルの約 5 倍です。

AMD は、NVIDIA に次いで、グラフィックス プロセッサ業界で第 2 位のメーカーと言え、市場シェアは約 20% です。

#そしてインテルの市場シェアは 1% 未満です。

ChatGPT の可能性が解き放たれるこれは、人工知能アプリケーションに別の変曲点をもたらす可能性があります。

なぜそんなことを言うのですか?

グーグルの親会社アルファベットのジョン・ヘネシー会長はロイターのインタビューで、大規模言語モデルなどの人工知能との対話コストは10ドルかかる可能性があると述べた。従来の検索エンジンの 2 倍以上です。

モルガン・スタンレーの分析によると、昨年のGoogleの検索件数は合計3兆3000億件で、各検索のコストはわずか0.2セントだったという。

Google のチャットボット Bard が検索エンジンに導入され、使用されると、プロセス Google の検索と質問の半分は、回答あたり 50 語に基づいており、2024 年には同社のコストがさらに 60 億ドル増加する可能性があります。

#同様に、チップ技術に特化したコンサルティング会社であるセミアナリシス社は、Tensor Processing Units などの Google の内部チップの影響を受け、検索にチャットボットを追加したと述べています。これにより、Google はさらに 30 億ドルの費用がかかる可能性があります。

彼は、Google がそのような人工知能の運用コストを削減する必要があると信じていますが、このプロセスはそれは簡単ではなく、最悪の場合は数年かかるでしょう。

#AI 言語モデルによる検索には、従来の検索よりも多くのコンピューティング能力が必要となるのはそのためです。

# アナリストらは、追加コストは今後数年間で数十億ドルに達する可能性があると述べています。

Gartner は、2026 年までにデータセンターで使用される GPU などのプロフェッショナル チップのシェアが 3% 未満から 15% 以上増加すると予測しています。 2020年に。

現在、Nvidia の収益のうち AI がどれだけを占めるかを正確に特定することは困難ですが、大手テクノロジー企業が同様の AI アプリケーションの開発を競う中、AI の可能性は飛躍的に増大しています。

水曜日、Nvidia は人工知能クラウド サービスも発表し、Oracle、Microsoft、Google と協力してシンプルなブラウザを通じて Nvidia GTX を提供することを約束しました。サーバーは人工知能処理を実行する機能にアクセスできます。

新しいプラットフォームは他のクラウド サービス プロバイダーによって提供され、独自のインフラストラクチャを構築できないテクノロジー企業を支援します。

#Huang Renxun 氏は次のように述べています。「ChatGPT に対する人々の熱意により、人工知能がビジネス リーダーに見えるようになりました」 「しかし、現在では、それは主に汎用ソフトウェアです。その真の価値を実現するには、企業自身のサービスや製品を改善できるように、企業自身のニーズに合わせて調整する必要があります。」

NVIDIA が GPU 市場の優位性を掌握New Street Research によると、NVIDIA はグラフィックス プロセッサ市場シェアの 95% を占めています。

#フィラデルフィア証券取引所の半導体指数では、NVIDIA 株が今年 42% 上昇し、最高のパフォーマンスを記録しました。

投資家は Nvidia に殺到しており、ChatGPT のような人工知能システムの需要によって同社製品の注文が増加し、同社が再び世界で最も価値のある企業になることに賭けています。 company 最高峰のチップメーカー。

長年にわたり、一流の ChatGPT であれ、Bard や Stable Diffusion などのモデルであれ、それらはすべて、1 枚相当の Nvidia チップによって支えられてきました。約 10,000 米ドル。A100 はコンピューティング能力を提供します。

NVIDIA A100 は、多くの単純な計算を同時に実行できます。これは、ニューラル ネットワーク モデルのトレーニングと使用にとって非常に重要です。

#A100 の背後にあるテクノロジーは、もともとゲームで複雑な 3D グラフィックスをレンダリングするために使用されていました。現在の目標は、機械学習タスクを処理し、データセンターで実行することです。

投資家のネイサン・ベナイッチ氏は、A100は現在、人工知能の専門家にとって「主力」になっていると語った。同氏の報告書には、A100 スーパーコンピューターを使用している企業もリストされている。

#機械学習タスクは、コンピューター全体の処理能力を消費し、場合によっては数時間または数日かかる場合があります。 。

つまり、ベストセラーの AI 製品を持つ企業は、アクセスのピーク期間に対処したり、モデルを改善したりするために、GPU をさらに購入する必要があることがよくあります。

既存のサーバーに接続するカード上の 1 つの A100 に加えて、多くのデータ センターでは 8 つの A100 グラフィックス プロセッサからなるシステムを使用しています。

#このシステムは Nvidia DGX A100 で、単一システムの販売価格は最大 200,000 ドルです。

NVIDIA は水曜日、DGX システムへのクラウド アクセスを直接販売すると発表しました。研究者の参加費。

#それでは、Bing の新しいバージョンを実行するにはどれくらいの費用がかかるのでしょうか? New Street Research による評価では、Bing 検索の OpenAI ベースの ChatGPT モデルでは、1 秒未満で質問に回答するには 8 つの GPU が必要になる可能性があることがわかりました。 #このままでは、Microsoft がこのモデルをすべての人に展開するには、20,000 台を超える 8 GPU サーバーが必要になります。 その場合、Microsoft はインフラストラクチャ支出に 40 億ドルを費やす可能性があります。 #これはまさに Microsoft です。Google の 1 日あたりのクエリ規模、つまり 1 日あたり 80 億から 90 億のクエリを提供したい場合は、次のことが必要になります。 800億ドルを費やします。 別の例として、Stable Diffusion の最新バージョンは 256 個の A100 グラフィックス プロセッサ、または 32 個の DGX A100 で 200,000 時間の計算を実行します。 Stability AI の CEO である Mostaque 氏は、市場価格に基づくと、モデルのトレーニングだけでも 60 万ドルかかるだろうと述べました。価格は競合他社と比較して非常に手頃です。これには、モデルの推論またはデプロイのコストは含まれません。 Huang Renxun 氏はインタビューで、 このタイプには必要なものだけを述べています。計算能力の観点から見ると、Stability AI の製品は実際にはそれほど高価ではありません。 私たちは、CPU を稼働させるのに 10 億ドルかかるデータセンターを 1 億ドルのデータセンターにスケールダウンしました。さて、この 1 億ドルのデータセンターがクラウド上に置かれ、100 社が共有したとしても、それは何のことでもありません。 NVIDIA GPU を使用すると、新興企業が低コストでモデルをトレーニングできるようになります。現在では、GPT などの大規模な言語モデルを約 1,000 万ドルから 2,000 万ドルで構築できます。本当に、本当にお手頃です。 2022 年の人工知能の現状レポートには、2022 年 12 月の時点で 21,000 以上のオープンソース AI 論文が NVIDIA チップを使用していると記載されています。 State of AI Compute Index のほとんどの研究者は、2017 年に発売された Nvidia の V100 チップを使用していますが、A100 チップは 2022 年に急速に成長し、 3 番目に頻繁に使用されるチップ。

A100 の最も熾烈な競争は、2022 年に発売される後継機の H100 になる可能性があります。生産が始まりました。実際、Nvidiaは水曜日、1月に終了した四半期におけるH100の収益がA100の収益を上回ったと発表した。

#現在、NVIDIA は AI の急行列車に乗り、「お金」に向かって突っ走っています。

以上が5,800億米ドル以上! MicrosoftとGoogleの戦いにより、Nvidiaの市場価値はIntelの約5倍に急騰したの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

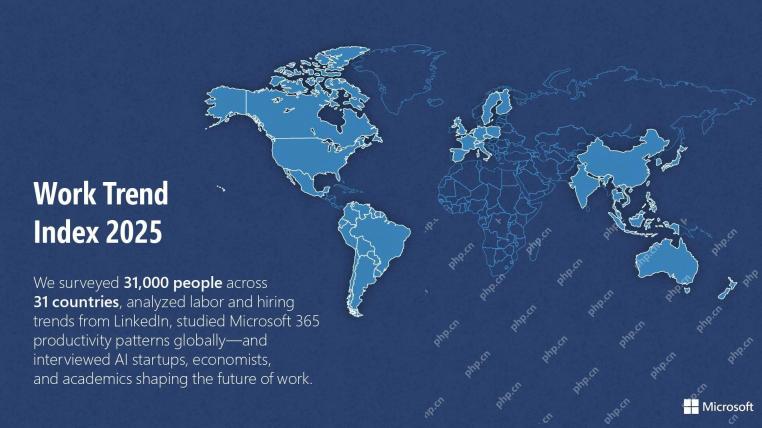

Microsoft Work Trend Index 2025は、職場の容量の緊張を示していますApr 24, 2025 am 11:19 AM

Microsoft Work Trend Index 2025は、職場の容量の緊張を示していますApr 24, 2025 am 11:19 AMAIの急速な統合により悪化した職場での急成長能力の危機は、増分調整を超えて戦略的な変化を要求します。 これは、WTIの調査結果によって強調されています。従業員の68%がワークロードに苦労しており、BURにつながります

AIは理解できますか?中国の部屋の議論はノーと言っていますが、それは正しいですか?Apr 24, 2025 am 11:18 AM

AIは理解できますか?中国の部屋の議論はノーと言っていますが、それは正しいですか?Apr 24, 2025 am 11:18 AMジョン・サールの中国の部屋の議論:AIの理解への挑戦 Searleの思考実験は、人工知能が真に言語を理解できるのか、それとも真の意識を持っているのかを直接疑問に思っています。 チャインを無知な人を想像してください

中国の「スマート」AIアシスタントは、マイクロソフトのリコールのプライバシーの欠陥をエコーしますApr 24, 2025 am 11:17 AM

中国の「スマート」AIアシスタントは、マイクロソフトのリコールのプライバシーの欠陥をエコーしますApr 24, 2025 am 11:17 AM中国のハイテク大手は、西部のカウンターパートと比較して、AI開発の別のコースを図っています。 技術的なベンチマークとAPI統合のみに焦点を当てるのではなく、「スクリーン認識」AIアシスタントを優先しています。

Dockerは、おなじみのコンテナワークフローをAIモデルとMCPツールにもたらしますApr 24, 2025 am 11:16 AM

Dockerは、おなじみのコンテナワークフローをAIモデルとMCPツールにもたらしますApr 24, 2025 am 11:16 AMMCP:AIシステムに外部ツールにアクセスできるようになります モデルコンテキストプロトコル(MCP)により、AIアプリケーションは標準化されたインターフェイスを介して外部ツールとデータソースと対話できます。人類によって開発され、主要なAIプロバイダーによってサポートされているMCPは、言語モデルとエージェントが利用可能なツールを発見し、適切なパラメーターでそれらを呼び出すことができます。ただし、環境紛争、セキュリティの脆弱性、一貫性のないクロスプラットフォーム動作など、MCPサーバーの実装にはいくつかの課題があります。 Forbesの記事「人類のモデルコンテキストプロトコルは、AIエージェントの開発における大きなステップです」著者:Janakiram MSVDockerは、コンテナ化を通じてこれらの問題を解決します。 Docker Hubインフラストラクチャに基づいて構築されたドキュメント

6億ドルのスタートアップを構築するために6つのAIストリートスマート戦略を使用するApr 24, 2025 am 11:15 AM

6億ドルのスタートアップを構築するために6つのAIストリートスマート戦略を使用するApr 24, 2025 am 11:15 AM最先端のテクノロジーと巧妙なビジネスの洞察力を活用して、コントロールを維持しながら非常に収益性の高いスケーラブルな企業を作成する先見の明のある起業家によって採用された6つの戦略。このガイドは、建設を目指している起業家向けのためのものです

Googleフォトの更新は、すべての写真の見事なウルトラHDRのロックを解除しますApr 24, 2025 am 11:14 AM

Googleフォトの更新は、すべての写真の見事なウルトラHDRのロックを解除しますApr 24, 2025 am 11:14 AMGoogle Photosの新しいウルトラHDRツール:画像強化のゲームチェンジャー Google Photosは、強力なウルトラHDR変換ツールを導入し、標準的な写真を活気のある高ダイナミックレンジ画像に変換しました。この強化は写真家に利益をもたらします

Descopeは、AIエージェント統合の認証フレームワークを構築しますApr 24, 2025 am 11:13 AM

Descopeは、AIエージェント統合の認証フレームワークを構築しますApr 24, 2025 am 11:13 AM技術アーキテクチャは、新たな認証の課題を解決します エージェントアイデンティティハブは、AIエージェントの実装を開始した後にのみ多くの組織が発見した問題に取り組んでいます。

Google Cloud Next2025と現代の仕事の接続された未来Apr 24, 2025 am 11:12 AM

Google Cloud Next2025と現代の仕事の接続された未来Apr 24, 2025 am 11:12 AM(注:Googleは私の会社であるMoor Insights&Strategyのアドバイザリークライアントです。) AI:実験からエンタープライズ財団まで Google Cloud Next 2025は、実験機能からエンタープライズテクノロジーのコアコンポーネント、ストリームへのAIの進化を紹介しました

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

EditPlus 中国語クラック版

サイズが小さく、構文の強調表示、コード プロンプト機能はサポートされていません

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

Dreamweaver Mac版

ビジュアル Web 開発ツール

MinGW - Minimalist GNU for Windows

このプロジェクトは osdn.net/projects/mingw に移行中です。引き続きそこでフォローしていただけます。 MinGW: GNU Compiler Collection (GCC) のネイティブ Windows ポートであり、ネイティブ Windows アプリケーションを構築するための自由に配布可能なインポート ライブラリとヘッダー ファイルであり、C99 機能をサポートする MSVC ランタイムの拡張機能が含まれています。すべての MinGW ソフトウェアは 64 ビット Windows プラットフォームで実行できます。

ホットトピック

7686

7686 15

15 1639

1639 14

14 1393

1393 52

52 1287

1287 25

25 1229

1229 29

29