言語モデルは、自然言語処理分野の研究と実践を大きく変えました。近年、大型モデルは多くの分野で重要な進歩を遂げています。下流のタスクで微調整する必要がなく、適切な指示やプロンプトがあれば、優れたパフォーマンス、場合によっては驚くべきパフォーマンスを達成できます。

たとえば、GPT-3 [1] はラブレターやスクリプトを作成し、データを使用して複雑な数学的推論の問題を解決できます。また、PaLM [2] はジョークを解釈できます。上の例は、大規模モデルの機能の氷山の一角にすぎません。多くのアプリケーションは大規模モデルの機能を使用して開発されています。OpenAI Web サイト [3] で多くの関連デモを見ることができますが、これらの機能が小規模モデルに反映されることはほとんどありません。

本日ご紹介した論文では、小規模モデルにはなく大きなモデルにはある能力を創発能力(Emergent Abilities)と呼んでいますが、これはモデルの規模が十分に大きいことを意味します。後になって突然身についた能力。これは、量的な変化が質的な変化を生み出すプロセスです。

新しい機能の出現を予測するのは困難です。なぜスケールが大きくなるにつれてモデルが突然特定の機能を獲得するのかはまだ未解決の疑問であり、答えるためにはさらなる研究が必要です。この記事では、著者が大規模モデルの理解における最近の進歩をいくつか整理し、それに関連する考えをいくつか示します。

関連論文:

-

大規模言語モデルの創発能力。

http://arxiv. org/abs/2206.07682 -

イミテーション ゲームを超えて: 言語モデルの機能の定量化と推定。

https://arxiv.org/abs/ 2206.04615

大規模モデルの創発的能力

大規模モデルとは何ですか?どのくらいのサイズが「大きい」とみなされるのでしょうか?これには明確な定義がありません。

一般的に言えば、小規模モデルのゼロショットや数ショットの能力とは大きく異なる能力を示すには、モデル パラメーターが 10 億レベルに達する必要がある場合があります。近年では、数千億、数兆のパラメータを持つ複数のモデルが登場し、一連のタスクで SOTA パフォーマンスを達成しています。一部のタスクでは、スケールの増加に伴ってモデルのパフォーマンスが確実に向上しますが、他のタスクでは、特定のスケールでモデルのパフォーマンスが突然向上します。異なるタスクを分類するために 2 つの指標を使用できます [4]:

- 直線性: スケールが増加するにつれてモデルがタスクでどの程度実行されるかを測定することを目的としています。確実に改善されました。

- ブレークスルーネス: モデルのサイズが臨界値を超えたときに、タスクがどの程度学習できるかを測定することを目的としています。

これら 2 つの指標はモデル サイズとモデルのパフォーマンスの関数です。具体的な計算の詳細については、[4] を参照してください。以下の図は、高い直線性と高いブレークスルーネスのタスクの例をいくつか示しています。

高線形性タスクはほとんどが知識ベースです。つまり、トレーニングで存在する知識を暗記することに主に依存しています。データ:事実に関する質問への回答などの情報。通常、モデルが大規模になると、トレーニングに使用するデータが増え、より多くの知識を記憶できるため、モデルは規模が大きくなるにつれて、そのようなタスクにおいて着実な改善を示します。画期的なタスクには、数学的推論など、正しい答えに到達するために複数の異なる能力を使用したり、複数のステップを実行したりする必要がある、より複雑なタスクが含まれます。小規模なモデルは、そのようなタスクを実行するために必要なすべての機能を取得するのに苦労します。

次の図は、いくつかの画期的なタスクにおけるさまざまなモデルのパフォーマンスをさらに示しています。

特定のモデル規模に達する前は、これらのタスクに対するモデルのパフォーマンスはランダムですが、特定の規模に達すると大幅な改善が見られます。

それはスムーズですか、それとも突然ですか?

先ほど見たのは、スケールが特定のレベルに増加した後、モデルが突然特定の機能を獲得したということです。タスク固有の指標の観点からは、これらの機能は創発的ですが、別の観点から見ると、モデルの機能の潜在的な変化がよりスムーズになります。この記事では、(1) よりスムーズなインジケーターの使用、(2) 複雑なタスクを複数のサブタスクに分解するという 2 つの観点について説明します。

次の図 (a) は、いくつかの高ブレークスルーネス タスクにおける実際のターゲットの対数確率の変化曲線を示しています。モデル サイズが大きくなるにつれて、実際のターゲットの対数確率は徐々に増加します。 。

さらに、研究者らは、「考えてみましょうステップ」という単純なプロンプトを追加することで、 by step" は、以下の図に示すように、GPT-3 のゼロショット推論能力 [6] を大幅に向上させることができます。 #これが私たちにインスピレーションを与えたのは、大きなモデルが特定のタスクをうまく実行できない場合があるということです。実際にうまくできないのではなく、その能力を刺激する適切な方法が必要なのかもしれません。

モデルが大きいほど強いのは必然ですか?

前の説明では、モデルのサイズが大きくなるにつれてパフォーマンスを向上させる必要があると直感的に感じますが、本当にそうなのでしょうか?実際、一部のタスクでは、以下の図に示すように、モデルが大きくなるにつれて実際にパフォーマンスが低下する可能性があります

#たとえば、質問と回答のタスクで、質問とともに自分の信念を追加すると、大規模なモデルがより影響を受けやすくなります。興味のある学生は注目してみてください。

要約と感想

- ほとんどのタスクでは、モデルのサイズが大きくなるにつれて、モデルのパフォーマンスが向上します。 , しかし、反例もいくつかあります。モデルの動作をより深く理解するには、さらなる研究が必要です。

- #大規模モデルの能力は、適切な方法で刺激される必要があります。

- #大規模モデルは本当に推論を行っているのでしょうか?以前見たように、「ステップごとに考えてみましょう」というプロンプトを追加することで、大規模なモデルは多段階の推論を実行し、数的推論タスクで満足のいく結果を得ることができ、モデルはすでに人間の推論能力を備えているようです。ただし、以下に示すように、GPT-3 に意味のない質問を与えて多段階の推論を実行させると、GPT-3 は推論を行っているように見えますが、実際には意味のない出力になります。ことわざにあるように、「ゴミは入ったらゴミは出る」。それに比べて、人間は質問が合理的かどうか、つまり現在の質問が与えられた条件下で回答可能かどうかを判断できます。 「ステップごとに考えてみましょう」は機能します。根本的な理由は、GPT-3 がトレーニング プロセス中に多くの同様のデータを確認したためだと思います。GPT-3 が行うことは、前のトークンに基づいて次のトークンを予測するだけです。人間とは異なり、考え方には根本的な違いがまだあります。もちろん、質問が合理的かどうかを判断するための適切なプロンプトが GPT-3 に与えられれば、ある程度の判断は可能かもしれませんが、「思考」と「推論」の間にはまだかなりの距離があるのではないかと思います。これは単純な問題ではなく、モデルのサイズを大きくすることで解決できます。モデルは人間のように考える必要はないかもしれませんが、モデルのサイズを増やす以外の道を探るためには、さらなる研究が緊急に必要です。

- # システム 1 ですか、それともシステム 2 ですか?人間の脳には、互いに連携する 2 つのシステムがあり、システム 1 (直感) は速く自動的に働き、システム 2 (理性) は遅く、制御可能です。人は直感を使って判断や決定をすることを好み、合理性によって直感によって引き起こされるバイアスを修正できることが、多くの実験で証明されています。現在のほとんどのモデルはシステム 1 またはシステム 2 に基づいて設計されています。将来のモデルはデュアル システムに基づいて設計できますか?

- #大規模モデル時代のクエリ言語。以前は、ナレッジとデータをデータベースとナレッジ グラフに保存していました。SQL を使用してリレーショナル データベースをクエリし、SPARQL を使用してナレッジ グラフをクエリできます。では、大規模モデルのナレッジと機能を呼び出すにはどのようなクエリ言語を使用すればよいでしょうか?

以上がGoogle とスタンフォードは共同で、「なぜ大規模なモデルを使用しなければならないのか?」という記事を発表しました。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM1 前言在发布DALL·E的15个月后,OpenAI在今年春天带了续作DALL·E 2,以其更加惊艳的效果和丰富的可玩性迅速占领了各大AI社区的头条。近年来,随着生成对抗网络(GAN)、变分自编码器(VAE)、扩散模型(Diffusion models)的出现,深度学习已向世人展现其强大的图像生成能力;加上GPT-3、BERT等NLP模型的成功,人类正逐步打破文本和图像的信息界限。在DALL·E 2中,只需输入简单的文本(prompt),它就可以生成多张1024*1024的高清图像。这些图像甚至

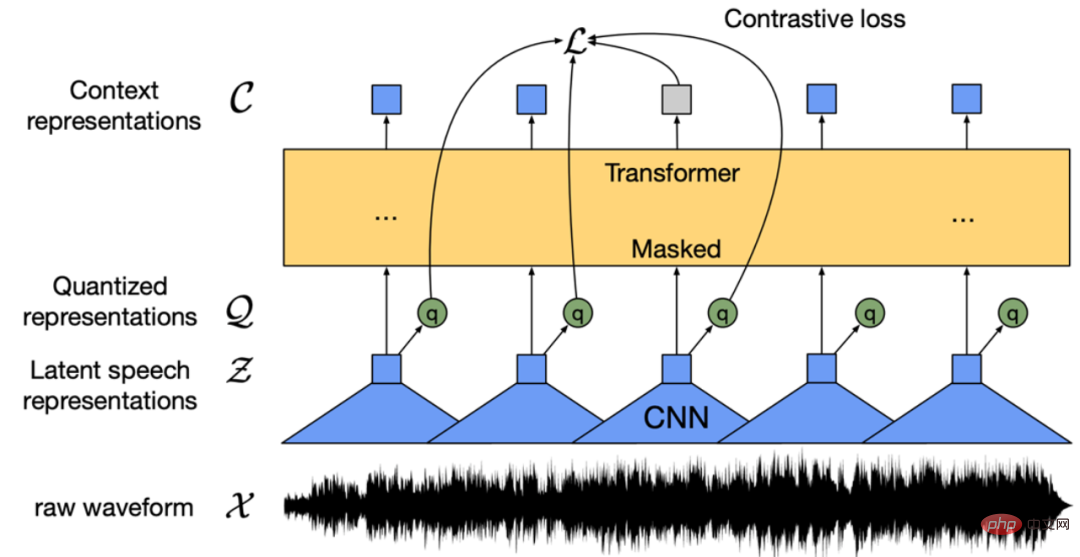

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PM

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PMWav2vec 2.0 [1],HuBERT [2] 和 WavLM [3] 等语音预训练模型,通过在多达上万小时的无标注语音数据(如 Libri-light )上的自监督学习,显著提升了自动语音识别(Automatic Speech Recognition, ASR),语音合成(Text-to-speech, TTS)和语音转换(Voice Conversation,VC)等语音下游任务的性能。然而这些模型都没有公开的中文版本,不便于应用在中文语音研究场景。 WenetSpeech [4] 是

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM“Making large models smaller”这是很多语言模型研究人员的学术追求,针对大模型昂贵的环境和训练成本,陈丹琦在智源大会青源学术年会上做了题为“Making large models smaller”的特邀报告。报告中重点提及了基于记忆增强的TRIME算法和基于粗细粒度联合剪枝和逐层蒸馏的CofiPruning算法。前者能够在不改变模型结构的基础上兼顾语言模型困惑度和检索速度方面的优势;而后者可以在保证下游任务准确度的同时实现更快的处理速度,具有更小的模型结构。陈丹琦 普

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM由于复杂的注意力机制和模型设计,大多数现有的视觉 Transformer(ViT)在现实的工业部署场景中不能像卷积神经网络(CNN)那样高效地执行。这就带来了一个问题:视觉神经网络能否像 CNN 一样快速推断并像 ViT 一样强大?近期一些工作试图设计 CNN-Transformer 混合架构来解决这个问题,但这些工作的整体性能远不能令人满意。基于此,来自字节跳动的研究者提出了一种能在现实工业场景中有效部署的下一代视觉 Transformer——Next-ViT。从延迟 / 准确性权衡的角度看,

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM3月27号,Stability AI的创始人兼首席执行官Emad Mostaque在一条推文中宣布,Stable Diffusion XL 现已可用于公开测试。以下是一些事项:“XL”不是这个新的AI模型的官方名称。一旦发布稳定性AI公司的官方公告,名称将会更改。与先前版本相比,图像质量有所提高与先前版本相比,图像生成速度大大加快。示例图像让我们看看新旧AI模型在结果上的差异。Prompt: Luxury sports car with aerodynamic curves, shot in a

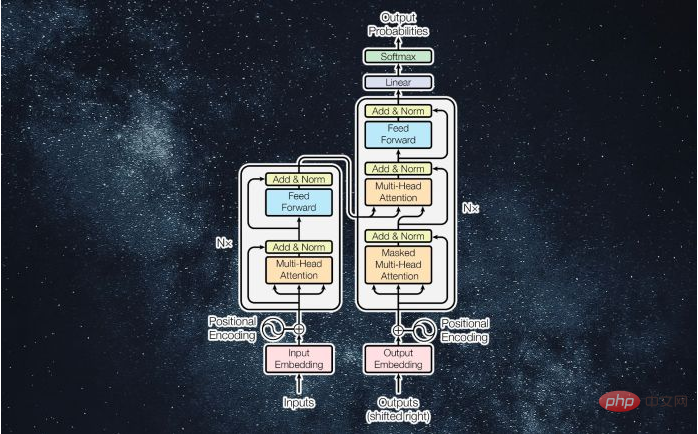

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM译者 | 李睿审校 | 孙淑娟近年来, Transformer 机器学习模型已经成为深度学习和深度神经网络技术进步的主要亮点之一。它主要用于自然语言处理中的高级应用。谷歌正在使用它来增强其搜索引擎结果。OpenAI 使用 Transformer 创建了著名的 GPT-2和 GPT-3模型。自从2017年首次亮相以来,Transformer 架构不断发展并扩展到多种不同的变体,从语言任务扩展到其他领域。它们已被用于时间序列预测。它们是 DeepMind 的蛋白质结构预测模型 AlphaFold

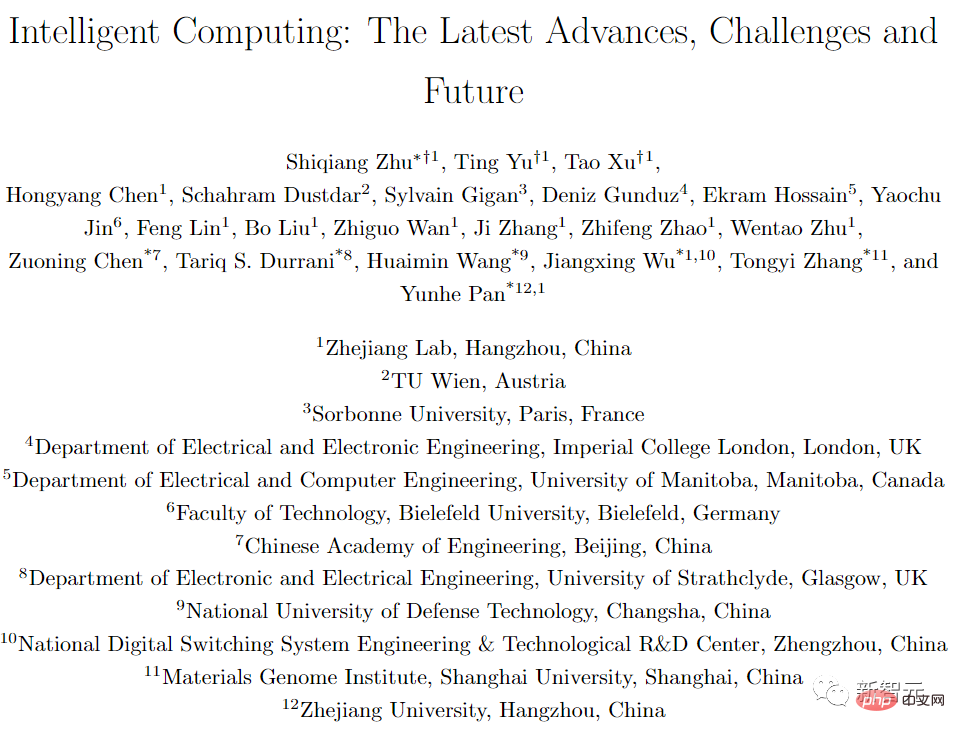

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM人工智能就是一个「拼财力」的行业,如果没有高性能计算设备,别说开发基础模型,就连微调模型都做不到。但如果只靠拼硬件,单靠当前计算性能的发展速度,迟早有一天无法满足日益膨胀的需求,所以还需要配套的软件来协调统筹计算能力,这时候就需要用到「智能计算」技术。最近,来自之江实验室、中国工程院、国防科技大学、浙江大学等多达十二个国内外研究机构共同发表了一篇论文,首次对智能计算领域进行了全面的调研,涵盖了理论基础、智能与计算的技术融合、重要应用、挑战和未来前景。论文链接:https://spj.scien

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM说起2010年南非世界杯的最大网红,一定非「章鱼保罗」莫属!这只位于德国海洋生物中心的神奇章鱼,不仅成功预测了德国队全部七场比赛的结果,还顺利地选出了最终的总冠军西班牙队。不幸的是,保罗已经永远地离开了我们,但它的「遗产」却在人们预测足球比赛结果的尝试中持续存在。在艾伦图灵研究所(The Alan Turing Institute),随着2022年卡塔尔世界杯的持续进行,三位研究员Nick Barlow、Jack Roberts和Ryan Chan决定用一种AI算法预测今年的冠军归属。预测模型图

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

MantisBT

Mantis は、製品の欠陥追跡を支援するために設計された、導入が簡単な Web ベースの欠陥追跡ツールです。 PHP、MySQL、Web サーバーが必要です。デモおよびホスティング サービスをチェックしてください。

SecLists

SecLists は、セキュリティ テスターの究極の相棒です。これは、セキュリティ評価中に頻繁に使用されるさまざまな種類のリストを 1 か所にまとめたものです。 SecLists は、セキュリティ テスターが必要とする可能性のあるすべてのリストを便利に提供することで、セキュリティ テストをより効率的かつ生産的にするのに役立ちます。リストの種類には、ユーザー名、パスワード、URL、ファジング ペイロード、機密データ パターン、Web シェルなどが含まれます。テスターはこのリポジトリを新しいテスト マシンにプルするだけで、必要なあらゆる種類のリストにアクセスできるようになります。

PhpStorm Mac バージョン

最新(2018.2.1)のプロフェッショナル向けPHP統合開発ツール

ドリームウィーバー CS6

ビジュアル Web 開発ツール

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ホットトピック

7442

7442 15

15 1371

1371 52

52