エレクトロニクス技術の発達により、いつでもどこでも「視聴覚の饗宴」が楽しめるようになり、人間の聴覚と視覚は完全に解放されました。

#近年、デバイスに「ハプティクス」を追加することが、特に「メタバース」の概念の恩恵により、徐々に新しい研究の注目の的となっています。高い触覚が仮想世界のリアリティを大幅に高めることは間違いありません。

現在の触覚センシング技術は主に「データ駆動型」モデルを通じてタッチをシミュレートし、レンダリングします。モデルは最初にユーザーと実際のテクスチャとのインタラクションを記録します。信号はテクスチャ生成部分に入力され、触感が振動の形でユーザーに「再生」されます。

# 最近のいくつかの手法は、主にユーザーのインタラクティブな動作と高周波振動信号に基づいて、摩擦や微細な表面特徴などのテクスチャ特徴をモデル化しています。 。

データドリブンによりシミュレーションの現実性が大幅に向上しますが、依然として多くの制限があります。

#例えば、世の中には「無数」のテクスチャが存在しており、それぞれのテクスチャを記録するとなると、想像を絶する人手と物的資源が必要となります。また、一部のニッチなユーザーのニーズを満たすこともできません。

人間は接触に対して非常に敏感です。同じ物体に対しても人によって感情が異なります。データ駆動型のアプローチでは、問題を根本的に解決することはできません。タッチ テクスチャ記録とテクスチャ レンダリングの知覚的な不一致の問題。

最近、南カリフォルニア大学ビタビ工学部の 3 人の博士課程の学生が、人間を使用してテクスチャの詳細を解決する新しい「好み主導型」モデル フレームワークを提案しました。生成された仮想知覚を調整する機能により、最終的に非常に現実的な触覚を実現できます。この論文は、IEEE Transactions on Haptics に掲載されました。

論文リンク: https://ieeexplore.ieee.org/document/9772285

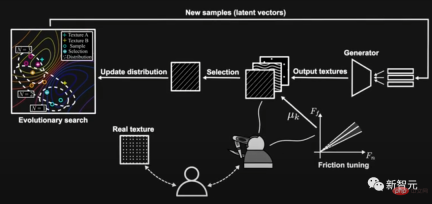

好み主導のモデルは、まずユーザーに現実的なタッチ テクスチャを提供し、次にモデルは、数十の変数を使用して 3 つの仮想テクスチャをランダムに生成し、ユーザーはその中から実際のオブジェクトに最も似ていると感じるテクスチャを選択できます。

継続的な試行錯誤とフィードバックにより、モデルは検索を通じて変数の分布を継続的に最適化し、生成されるテクスチャをユーザーの好みに近づけます。コンピュータが読み取った内容と人間が実際に感じた内容との間には常にギャップがあるため、この方法にはテクスチャを直接記録して再生する場合に比べて大きな利点があります。

このプロセスは、実際には、「当事者 A と当事者 B」に似ています。間違っている場合は、戻ってアルゴリズム (当事者 B) を修正し、生成されたエフェクトが満足のいくまで再生成します。

これは実際には非常に合理的です。なぜなら、同じ物体に触れたときに人によって異なる感情が生じるからです。しかし、コンピュータが発する信号は同じなので、人それぞれに合わせたタッチのカスタマイズが必要です!

システム全体は 2 つのモジュールで構成されています。1 つ目は、潜在空間のベクトルをテクスチャ モデルにマッピングするために使用される深層畳み込み敵対的生成ネットワーク (DCGAN) です。トレーニング用の UPenn Haptic Texture Toolkit (HaTT)。

2 番目のモジュールは比較ベースの進化アルゴリズムです: 生成されたテクスチャ モデルのセットから、共分散行列適応進化戦略 (CMA-ES) がユーザーの好みのフィードバックに基づいて新しいテクスチャ モデルを作成します。

実際のテクスチャをシミュレートするために、研究者らはまずユーザーにカスタム ツールを使用して実際のテクスチャに触れるよう依頼し、次に触覚デバイスを使用して一連の仮想テクスチャ候補に触れるように依頼します。 、触覚フィードバックは、デバイスのスタイラスに接続された Haptuator を介して送信されます。

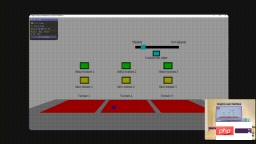

ユーザーが行う必要があるのは、実際のテクスチャに最も近い仮想テクスチャを選択し、シンプルなスライダー インターフェイスを使用してテクスチャの量を調整することだけです。摩擦 摩擦は質感に重要な要素であるため、摩擦は人によって異なります。

次に、ユーザーの選択に応じた進化戦略に従ってすべての仮想テクスチャが更新され、ユーザーは再度選択して調整します。

ユーザーが実際のテクスチャに近いと思われる仮想テクスチャを見つけて保存するか、より近い仮想テクスチャが見つかるまで、上記のプロセスを繰り返します。見つからない 。

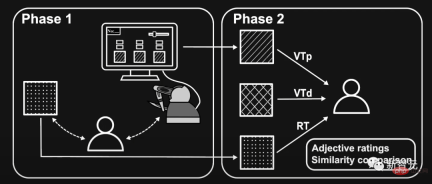

研究者らは、評価プロセスを 2 つのフェーズに分割し、それぞれに別の参加者グループを設けました。

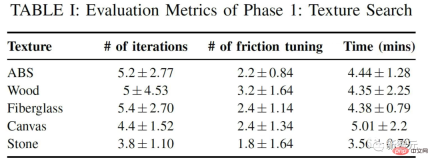

#最初のステージでは、5 人の参加者がそれぞれ 5 つの実際のテクスチャに対して仮想テクスチャを生成および検索しました。

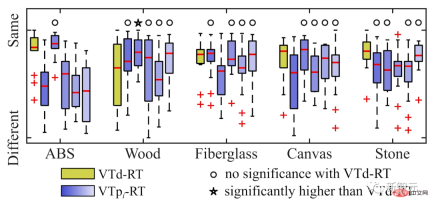

第 2 段階では、最終的に保存されたプリファレンス駆動テクスチャ (VTp) とそれに対応する実際のテクスチャ (RT) との間のギャップを評価します。

評価方法は主に形容詞評価を使用して、粗さ、硬さ、滑らかさを含む知覚次元を評価します。

#そして、VTp、RT、データドリブン テクスチャ (VTd) の類似点を比較します。

#実験結果は、進化のプロセスに従って、ユーザーがデータ駆動型モデルよりも現実的な仮想テクスチャ モデルを効果的に見つけることができることも示しています。

さらに、参加者の 80% 以上が、好み主導型モデルによって生成された仮想テクスチャ評価の方が、優先モデルによって生成された仮想テクスチャ評価よりも優れていると信じていました。データ駆動型モデル。

触覚デバイスは、ビデオ ゲーム、ファッション デザイン、手術シミュレーションなどでますます人気が高まっており、家庭でも使用できるようになってきています。ラップトップを使用するユーザーは、触覚デバイスと同じくらい人気があります。

#たとえば、一人称視点のビデオ ゲームにタッチを追加すると、プレーヤーの現実感が大幅に高まります。

論文の著者は、私たちがツールを通じて環境と対話するとき、触覚フィードバックは単なる形式、感覚フィードバックの一種にすぎないと述べています。そしてオーディオもまた感覚的なフィードバックであり、どちらも非常に重要です。

#ゲームに加えて、この作業の結果は、非常に正確である必要がある歯科または外科のトレーニングで使用される仮想テクスチャに特に役立ちます。

「外科トレーニングは、非常にリアルなテクスチャと触覚フィードバックを必要とする非常に巨大な分野です。また、装飾デザインでは、開発中にテクスチャの高度な精度が必要です。それをシミュレートしてください」地上で製造してから製造します。」

ビデオ ゲームからファッション デザインに至るまで、あらゆるものに触覚テクノロジーが統合されており、既存の仮想テクスチャ データベースはこのユーザー好みのアプローチで改善できます。

テクスチャ検索モデルを使用すると、ユーザーはペンシルベニア大学の触覚テクスチャ ツールキットなどのデータベースから仮想テクスチャを抽出することもでき、目的のテクスチャが得られるまで改良できます。結果。

#このテクノロジーをテクスチャ検索モデルと組み合わせると、他の人が以前に記録した仮想テクスチャを使用し、それに基づいてテクスチャを最適化できます。戦略。

#著者は、将来的にはモデルに実際のテクスチャさえ必要なくなるかもしれないと想像しています。

私たちの生活の中で共通するいくつかのことの感覚は非常に直感的であり、私たちは写真を見ることで感覚を微調整するように組み込まれています。実際のテクスチャを参照する必要はありません。

たとえば、テーブルを見たとき、その表面についての事前の知識を使用して、テーブルに触れたときにどのように感じるかを想像できます。知識があれば、ユーザーに視覚的なフィードバックを提供し、一致するコンテンツを選択できるようにすることができます。

この記事の筆頭著者である Shihan Lu は、現在、南カリフォルニア大学コンピュータ サイエンス学部の博士候補者です。イマーシブ テクノロジーにおけるサウンド関連の作業。ツールが仮想テクスチャと対話するときに一致するサウンドを導入することで、仮想テクスチャをより没入型にします。

この記事の 2 番目の著者である Mianlun Zheng (Zheng Mianlun) は、南方大学コンピュータ サイエンス学部の博士候補者です。カリフォルニア州武漢大学を卒業し、学士号と修士号を取得しました。

##

##

以上がタッチはこれまでにないほどリアルです。南カリフォルニア大学の2人の中国人博士が「触覚」アルゴリズムを革新の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

Gemma Scope:AI'の思考プロセスを覗くためのGoogle'の顕微鏡Apr 17, 2025 am 11:55 AM

Gemma Scope:AI'の思考プロセスを覗くためのGoogle'の顕微鏡Apr 17, 2025 am 11:55 AMジェマの範囲で言語モデルの内部の仕組みを探る AI言語モデルの複雑さを理解することは、重要な課題です。 包括的なツールキットであるGemma ScopeのGoogleのリリースは、研究者に掘り下げる強力な方法を提供します

ビジネスインテリジェンスアナリストは誰で、どのようになるか?Apr 17, 2025 am 11:44 AM

ビジネスインテリジェンスアナリストは誰で、どのようになるか?Apr 17, 2025 am 11:44 AMビジネスの成功のロック解除:ビジネスインテリジェンスアナリストになるためのガイド 生データを組織の成長を促進する実用的な洞察に変換することを想像してください。 これはビジネスインテリジェンス(BI)アナリストの力です - GUにおける重要な役割

SQLに列を追加する方法は? - 分析VidhyaApr 17, 2025 am 11:43 AM

SQLに列を追加する方法は? - 分析VidhyaApr 17, 2025 am 11:43 AMSQLの変更テーブルステートメント:データベースに列を動的に追加する データ管理では、SQLの適応性が重要です。 その場でデータベース構造を調整する必要がありますか? Alter Tableステートメントはあなたの解決策です。このガイドの詳細は、コルを追加します

ビジネスアナリストとデータアナリストApr 17, 2025 am 11:38 AM

ビジネスアナリストとデータアナリストApr 17, 2025 am 11:38 AM導入 2人の専門家が重要なプロジェクトで協力している賑やかなオフィスを想像してください。 ビジネスアナリストは、会社の目標に焦点を当て、改善の分野を特定し、市場動向との戦略的整合を確保しています。 シム

ExcelのCountとCountaとは何ですか? - 分析VidhyaApr 17, 2025 am 11:34 AM

ExcelのCountとCountaとは何ですか? - 分析VidhyaApr 17, 2025 am 11:34 AMExcelデータカウントと分析:カウントとカウントの機能の詳細な説明 特に大規模なデータセットを使用する場合、Excelでは、正確なデータカウントと分析が重要です。 Excelは、これを達成するためにさまざまな機能を提供し、CountおよびCounta関数は、さまざまな条件下でセルの数をカウントするための重要なツールです。両方の機能はセルをカウントするために使用されますが、設計ターゲットは異なるデータ型をターゲットにしています。 CountおよびCounta機能の特定の詳細を掘り下げ、独自の機能と違いを強調し、データ分析に適用する方法を学びましょう。 キーポイントの概要 カウントとcouを理解します

ChromeはAIと一緒にここにいます:毎日何か新しいことを体験してください!!Apr 17, 2025 am 11:29 AM

ChromeはAIと一緒にここにいます:毎日何か新しいことを体験してください!!Apr 17, 2025 am 11:29 AMGoogle Chrome'sAI Revolution:パーソナライズされた効率的なブラウジングエクスペリエンス 人工知能(AI)は私たちの日常生活を急速に変換しており、Google ChromeはWebブラウジングアリーナで料金をリードしています。 この記事では、興奮を探ります

ai' s Human Side:Wellbeing and the Quadruple bottuntApr 17, 2025 am 11:28 AM

ai' s Human Side:Wellbeing and the Quadruple bottuntApr 17, 2025 am 11:28 AMインパクトの再考:四重材のボトムライン 長い間、会話はAIの影響の狭い見方に支配されており、主に利益の最終ラインに焦点を当てています。ただし、より全体的なアプローチは、BUの相互接続性を認識しています

5ゲームを変える量子コンピューティングの使用ケースあなたが知っておくべきであるApr 17, 2025 am 11:24 AM

5ゲームを変える量子コンピューティングの使用ケースあなたが知っておくべきであるApr 17, 2025 am 11:24 AM物事はその点に向かって着実に動いています。量子サービスプロバイダーとスタートアップに投資する投資は、業界がその重要性を理解していることを示しています。そして、その価値を示すために、現実世界のユースケースの数が増えています

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

SublimeText3 英語版

推奨: Win バージョン、コードプロンプトをサポート!

SecLists

SecLists は、セキュリティ テスターの究極の相棒です。これは、セキュリティ評価中に頻繁に使用されるさまざまな種類のリストを 1 か所にまとめたものです。 SecLists は、セキュリティ テスターが必要とする可能性のあるすべてのリストを便利に提供することで、セキュリティ テストをより効率的かつ生産的にするのに役立ちます。リストの種類には、ユーザー名、パスワード、URL、ファジング ペイロード、機密データ パターン、Web シェルなどが含まれます。テスターはこのリポジトリを新しいテスト マシンにプルするだけで、必要なあらゆる種類のリストにアクセスできるようになります。

SAP NetWeaver Server Adapter for Eclipse

Eclipse を SAP NetWeaver アプリケーション サーバーと統合します。

VSCode Windows 64 ビットのダウンロード

Microsoft によって発売された無料で強力な IDE エディター

EditPlus 中国語クラック版

サイズが小さく、構文の強調表示、コード プロンプト機能はサポートされていません