ホームページ >テクノロジー周辺機器 >AI >自動運転の規制と制御における深層学習アルゴリズムの適用についての 1 万語の解釈

自動運転の規制と制御における深層学習アルゴリズムの適用についての 1 万語の解釈

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWB転載

- 2023-04-04 12:55:01959ブラウズ

「データ駆動型」は自動運転業界の基本的なコンセンサスになって久しいですが、実際には、これまでのところ、データ駆動型の深層学習アルゴリズムは依然として主に認識モジュールで使用されていますが、規制ではほとんど使用されていません

記事の本題に入る前に、この記事で言及されている「規制」とは何なのかを簡単に説明する必要があります。

自動運転業界の誰もが、知覚、位置決め、意思決定、計画、制御の主要なモジュールを知っている必要があると思います。日常のコミュニケーションでは誰もがそのような区別をしていますが、もしそうなら少し混乱するでしょう。特定の作品では依然としてこのように分類されています。

ここでの問題は意思決定にあります。大まかに言えば、意思決定には予測が含まれますが、予測の分割は非常に厄介です。予測自体は知覚と深く関係していますが、予測は意思決定の前段階です。最初に予測のみが行われ、その後、決定が行われます。

これまでに起こったすべての確立された事実を T0 と呼ぶことができ、認識はすでに起こった確立された事実です。例えば、車両が将来どのように動くべきか、他の人が何をするかなど、将来に起こることすべてを T0- と呼ぶことができます。

T0 を分水界分割として使用することには利点があります。認識リンクは、道路上で発生した確立された事実のみを考慮する必要があり、この確立された事実に基づく推論を直接システムに組み込むことができます。意思決定の部分。

このような分類により、予測結果と意思決定部分をより密接に組み合わせることができるため、予測と認識の関係を人為的に「弱め」、予測と意思決定の関係を「強化」することができます。実際の作業に反映されると、この部門は何を予測すべきか、また予測結果を意思決定に役立てるためにどのように活用するかをより適切に決定できるようになります。 (上記の内容は、Leadjun Technology CEO のヤン・ウェンリー博士とのやり取りを経て、著者が要約したものです)

上記の論理に基づくと、通常、自動運転会社内には PNC グループが存在します。動燃グループは規制と管理の責任を負う。動燃グループで長く働いていると、みんな予測、意思決定、計画、管理を総称して「規制と管理」と呼ぶようになります。

では、この「規制と統制」というのが、この記事で言うところの「規制と統制」です。

次に、「データドリブン」と「規制」を組み合わせてみましょう。

「データ駆動型」は自動運転業界の基本的なコンセンサスになって久しいですが、実際には、これまでのところ、データ駆動型の深層学習アルゴリズムは依然として主に認識モジュールで使用されており、認識モジュールではほとんど使用されていません。規制と制御 ——現在、業界における規制関連のアルゴリズムは主にルール駆動型です。

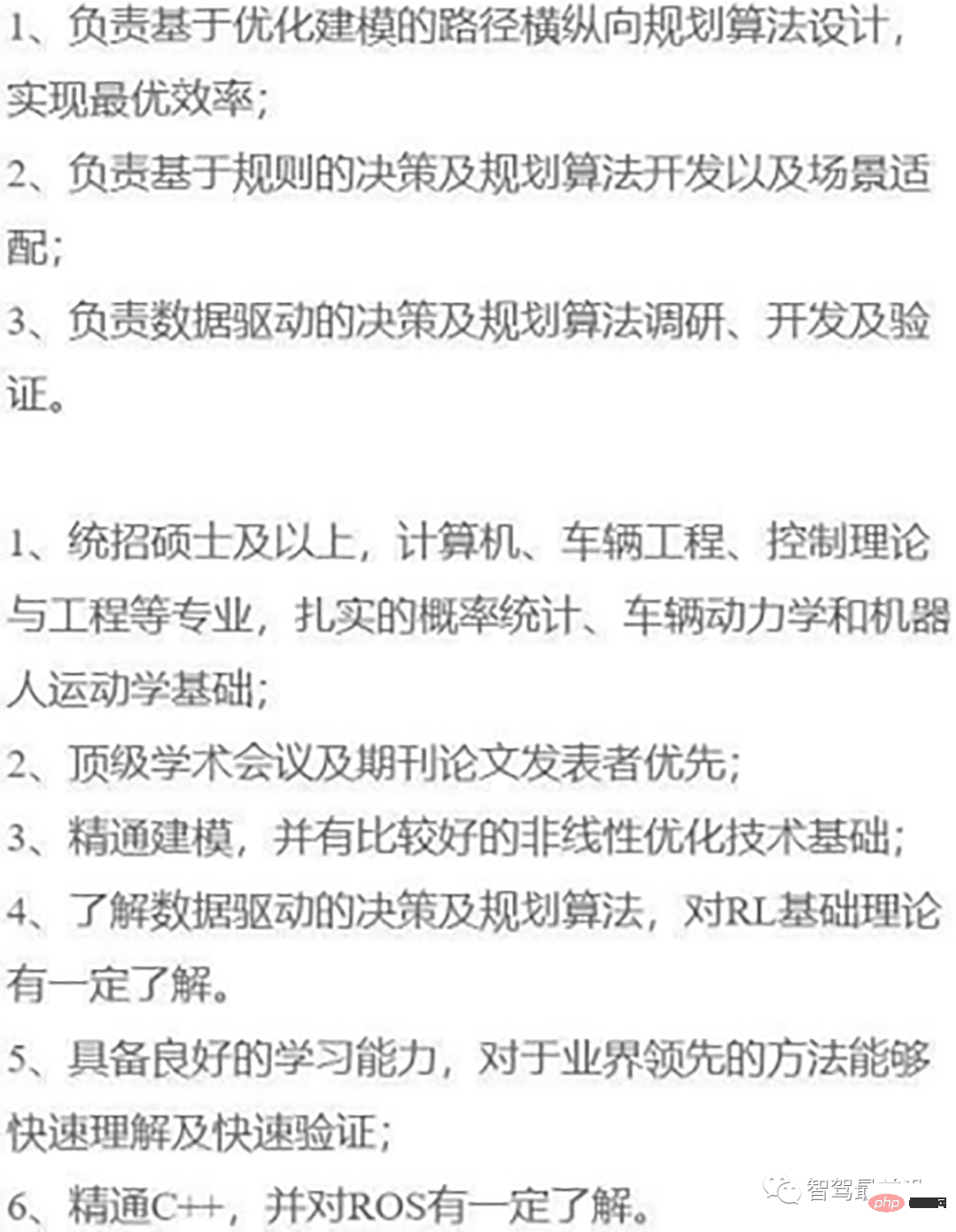

現在公開されている自動運転制御アルゴリズムに関する情報はほとんどがルールベースアルゴリズムに関するものですが、採用ソフトを開いてみると、自動運転企業が制御アルゴリズムエンジニアを募集する際に、候補者にディープラーニングの理解が求められていることがよくあります。これは、多くの企業が現在ハイブリッド意思決定アルゴリズムに向かって「進んでいる」ことをある程度示しています。

写真は自動運転会社の募集要項から引用したものです

現時点では、深層学習アルゴリズムの使用について完全かつ丁寧に説明した記事はほとんどありません。自動運転制御アプリケーション。したがって、この記事では、ルールの限界と深層学習アルゴリズムの潜在的な利点、現段階で深層学習アルゴリズムがまだ大規模な制御アルゴリズムに適用できない理由、将来の制御アルゴリズムはルールと深層学習のどちらに基づくのかについて説明します。 . 3 つの側面について詳しく説明しましょう。

01 ルールの制限と深層学習アルゴリズムの潜在的な利点

1. ルールベースのアルゴリズムには制限があります

現在、規制に関連するアルゴリズムは主にルールに基づいていますが、自動運転レベルの向上と適用シナリオの継続的な拡大に伴い、実際のテストではルールベースの制御アルゴリズムの限界が明らかになります。

ルールベースの規制および制御アルゴリズムの欠点は、主に、非決定性シナリオ、強力な対話型シナリオ、および非常に主観的なシナリオという 3 つのカテゴリのコーナーケースによって引き起こされます。 (1) 非決定的シナリオ

非決定的シナリオは決定的シナリオと相対的なものであり、最も単純な決定的シナリオは、赤信号で停止し、青信号が点灯したら発進することです。白点線は車線変更不可 白実線は車線変更不可 これ以外のシナリオは「非決定的シナリオ」とみなすことができます。

たとえば、車は車線境界線のある道路を走行することが多いですが、あるケースでは、現在の道路が幹線道路3本と補助道路1本で構成されており、車線境界線のみで緑地帯がない場合がありました。これは、補助道路を走行する車両がどのような状況でも本道路に合流する可能性があることを意味しており、典型的な非決定的なシナリオです。ほとんどのドライバーは実線や点線をまったく気にしないため、いつ周囲に突然車が現れるか、また直接車線変更する可能性がどれくらいあるかわかりません。 道路上の他の車両の軌跡は確率的なものであるため、ルールベースのアルゴリズムを処理するのは困難です。(2) 強力なインタラクションシーン

最も典型的なシーンは交差点であり、シーン内の複数のオブジェクトのルートは相互作用し、互いに影響を及ぼします。ある程度のゲームが関与しています。

非常に複雑な道路シーンでは、常に周囲の車両を予測し、相互作用の結果に基づいて計画を調整することは、人間のルールでは明確に記述することができません。(3) 主観的なシーンが強い

簡単に言えば、道路状況が異なると、人は環境に応じて無意識に自分の車と前の車との車間距離を調整します。なぜなら、人間の脳には一定のルールがあるかもしれないが、それは非常に抽象的で特定することができず、車線変更のタイミングや交差点での他車への反応など、言葉では言い表せないものしか理解できないからである。

一部のシナリオでは、ルール アルゴリズムを使用して車の所有者の一部の行動や運転スタイルを模倣することはできますが、人々の主観的な習慣をルールで解決するのは難しく、たとえ解決できたとしても多くの時間が必要になります。人力の。

ルールベースのアルゴリズムを使用して特殊なケースに対処する場合、最も難しい部分は予測プロセスです。なぜなら、自動運転車は自分の車両の軌道を予測するだけでなく、「他の道路利用者」の軌道も予測する必要があり、道路上には複数の「他の道路利用者」が存在することが多く、それらは相互作用するからです。お互いに関係しているため、軌道を予測するのは困難です。

人間のドライバーは予測を行う際、クルマの歴史の軌跡やドライバーの運転スタイルなどを観察し、「経験」と「勘」に基づいて判断します。ただし、ルールベースのアルゴリズムでは人間と同様の予測効果を達成することは困難です。

さらに、車両がいくつかのコーナーケースに遭遇してブレーキが必要な場合、ルールベースの制御システムが常にスムーズなカーブを確保することは困難です。

たとえば、前に極低速で走行する車がいて、自動運転システムが「右に車線変更して追い越ししてください」と指示を出し、途中で追い越しをしたとします。車線変更の際、突然隣に車が来ました。その車は右車線で急速に追い越しをしましたが、意思決定システムは直ちに車線変更の決定をキャンセルし、滑らかなカーブを再生して車両を元の車線に戻しました。 。

ここでの難しさは、快適性、安全性、効率性、パワーモデルの達成可能性などの要素のバランスをどのように取り、このときに生成される軌道計画パスがスムーズであることを保証するかということです。

さらに上記の例を例に挙げますが、このときに生成された経路が滑らかであることが保証できない場合、車両は非常に「激しく」運転し、運転中に非常に不快になります。このとき、ドライバーや同乗者が周囲で緊急事態が発生しているのがわかり、システムが事故を間に合うように回避するのに役立つ場合、ドライバーや同乗者はシステムが非常に信頼できると考えるでしょう。駆動システムは「事故を回避するのに役立ちました。事故」。

しかし現実には、ほとんどの場合、システムはずっと前に問題を発見し、直接「芽を摘む」という決定を下しています。しかし、問題は、ほとんどの運転手や乗客は、「一見普通に見える」車線変更が「事故を起こしそうになった」ことに気づかず、後ろから来る車の存在にも気づかない可能性があることです。したがって、このときに制御システムが滑らかな曲線を生成できない場合、運転者や同乗者はシステムのおかげで「事故を回避できた」と考えるだけでなく、システムが「硬すぎる」「振り回されている」と非難することになります。車線変更のとき。ゴー」。

このタイプの問題はルールベースのアルゴリズムを使用して解決することもできますが、解決プロセスは非常に面倒です。

さらに、理論的には、一部のロングテール シナリオはルールベースのアルゴリズムでも解決できますが、実際の作業では、エンジニアがこれらの複雑なコードで問題を効果的に解決できることを確認することは困難です。同時に、コンピューティング リソースをあまり消費しません。これらのコードはオフライン システムでは簡単に実行できますが、車に搭載されると、オンボード チップはそのような膨大なコンピューティング パワーの消費に対応できるでしょうか?これらの問題を解決するには、エンジニアのコーディング レベルとエンジニアリング能力が大きく試されます。

さらに、何千行ものコードを書いたものの、何を書いたか忘れてしまったエンジニアもいるかもしれません。ルールはますます増え、ロジックはますます複雑になり、「将来」のある時点で新しい要件が追加されると、システムの維持が困難になります。

2. 深層学習アルゴリズムは、適切なシナリオでシステムの擬人化を改善できます

上記ではルール アルゴリズムの多くの制限について言及しましたが、実際にはルール アルゴリズムの制限そこで止まらないでください。すべての問題をまとめて見ると、それらをまとめてルール アルゴリズムの「低擬人化」と呼ぶことができます。

いわゆる擬人化とは、運転中にシステムが「高齢のドライバー」のように見えるかどうかを指します。 Hao Mo Zhixingの制御アルゴリズム専門家は、「擬人化されたベテランドライバーの中核となる能力は変化に適応することであり、ルールベースのシステムを使用するには、シナリオを区別するための多くのルールを設定し、多数の環境パラメータを設定する必要がある」と述べた。

現在、路上でテストできる自動運転車は、ほとんどの場合「初心者ドライバー」に近いものです。 「初心者ドライバー」と「経験豊富なドライバー」の最大の違いは、「経験豊富なドライバー」の方がより強力な予測能力を持ち、ロングテールのシナリオにうまく適応できることです。

両者を比較すると、ほとんどの「初心者ドライバー」も安全性は高いですが、「初心者ドライバー」は道路を運転する際に「バカ」になるのに対し、「経験豊富なドライバー」は安全を確保しながらさまざまな操作を行うことができます。よりスムーズかつ効率的になります。この違いを「仮釈放経験」といいます。

本質的に、「初心者ドライバー」は路上で「自動車学校ベースの教材」に依存しており、意思決定と計画の方法は if else (ルール アルゴリズム) に近いのに対し、「経験豊富なドライバー」は意思決定を行う際は経験と主観的な判断に依存するため、意思決定と計画の方法は比較的抽象的であり、「深層学習アルゴリズム」に似ています。

要約すると、規制と制御のプロセスに深層学習アルゴリズムを導入し、人間のドライバーの経験から可能な限り学習し、機能を自動的に調整してパターンを見つけることで、規制と制御の「擬人化」を改善することができます。アルゴリズム。

今回の AI Day で Tesla が言及したデータ エンジンは、データをニューラル ネットワークに入力して現実世界の予測問題をより適切に解決することで、確実性を向上させます。

Qingzhou Zhihang の計画および制御アルゴリズムの責任者は、予測 (他の車両の将来の軌道を判断する) がディープラーニング アルゴリズムを大規模に適用するための最も適した第一歩であると考えています。同氏は、「Qingzhou Zhihang の予測アルゴリズムはディープ ラーニングを使用しています。」と述べています。

特にシナリオに関して言えば、人間の主観的な判断に大きく依存するシナリオはディープ ラーニング アルゴリズムによって導かれる必要があると彼は考えています。

「たとえば、従来の分類 AI モデル (ディープ ラーニングまたは従来の機械学習分類モデル) を意思決定に使用したり、ディープ ラーニングを軌道生成に使用して経路計画をガイドしたり、エンドツーエンドで使用したりできます。強化学習は、動作計画 (最終的な軌道の計画) をガイドするために実行すべき現在のアクションを提供します。」

この専門家はまた、構造化された高速シーンは、構造化されたアルゴリズムよりも従来のアルゴリズムで解決する方が簡単である可能性があると考えています。都市部には AI モデルを活用する余地がさらにあるかもしれません。

Zhitu は、高速ランプ交差点シナリオの意思決定プロセスで強化学習アルゴリズムを使用します。

Lingjun Technology CEO のヤン・ウェンリー博士は、深層学習アルゴリズムの重要性と適用可能性は、自動運転のさまざまなモジュールにおいてまったく同じではないと考えています。

「知覚 - 融合 - 予測 - 意思決定 - 計画 - 制御のプロセスは、早い段階ほど深層学習アルゴリズムの効果が高くなります。」

#ヤン・ウェンリー博士は次のように述べています。 : 「知覚システムには大量のデータ処理がありますが、エラーが許容され、精度と再現率にある程度の許容範囲があるため (その後の融合と意思決定によって知覚エラーを修正できるため)、深層学習手法の方が適しています。

「意思決定の部分では、ルールと学習にそれぞれ利点があるため、ハイブリッド アーキテクチャを使用し、ディープラーニング手法を使用してパフォーマンスを向上させ、ルール手法を使用して安全性を確保します。

「制御システムには少量のデータがあり、信頼性に対する強い要件があり、エラーがまったく許されません。深層学習アルゴリズムを使用すると、パフォーマンスが向上しないだけでなく、不確実性や信頼性の低い要因が発生する可能性があります。 」さらに、計画アルゴリズムにエラーが発生した場合、制御アルゴリズムも安全である必要があります。古典的な制御アルゴリズムの PID では、安全性を確保するために、制御層は計画層が発行した「間違った命令」の実行を拒否できます。たとえば、計画が車両を時速 120 km で運転する命令を出したが、車両自体のハードウェアが時速 120 km の速度をサポートできない場合、現時点では、制御アルゴリズムがチェックを行って実行を直接拒否することができます。車両が正常に走行できるようにするための指示、横転しないように運転すること。

制御アルゴリズムがすべてのエラーをカバーしたい場合は、ルールベースのアルゴリズムを使用して信頼性を確保する必要があります。

このことから、「深層学習アルゴリズムを規制・制御に適用する」という場合、皆さんが「規制・制御」と呼んでいるのは、実は主に予測・意思決定・計画を指しており、そこには含まれていません。コントロール。

ディープ ラーニング アルゴリズムには、実際的な技術的問題の解決に加えて、無視できない大きな利点もあります。それは、GPU またはニューラル ネットワーク専用プロセッサを最大限に活用して、CPU のコンピューティング電力消費を削減することです。

自動運転開発の初期段階で使用される複雑なルールコードは、特定の機能を実現するために多くのCPU演算能力を消費しますが、一般に車載チップの設計により演算能力が増大する傾向にあります。ディープラーニングの能力と CPU 部分の計算能力には限界があるため、エンジニアは節約する方法を見つける必要があります。多数の複雑なルールベースのアルゴリズムを深層学習アルゴリズムに置き換えることにより、CPU の計算能力を大幅に節約できます。

青州 Zhihang の計画と制御アルゴリズムの専門家は、都市部の NOA 量産車両は一般的に組み込みチップを使用しており、CPU は ARM アーキテクチャに基づいており、CPU の演算能力リソースは X86 アーキテクチャに基づく L4 デモ車両と比較できないと考えています。したがって、L4に近い運転体験を実現したい場合、サプライヤーは規制・制御プロセスに深層学習アルゴリズムを導入し、深層学習専用プロセッサに演算負荷をかける努力をする必要がある。

02 現段階では、ディープ ラーニング アルゴリズムを大規模な制御アルゴリズムに適用することはできません。

ディープ ラーニング アルゴリズムは非常に「クール」に聞こえるのに、なぜ実際に制御アルゴリズムが使用されるのでしょうか。ディープラーニングアルゴリズムではなくルールに引き続き焦点を当てるのはどうですか?

これは、深層学習アルゴリズムにも多くの欠点があるためであり、これらの欠点により、短期的には深層学習アルゴリズムの効果がルールよりも低くなります。

1. 人間のドライバーの運転行動が「学習する価値がある」かどうかを判断するのは困難です理想的な状況では、トレーニングに使用されるデータが増えるほど、深層学習アルゴリズムが優れているほど効果は高くなりますが、データ量が増えるとアルゴリズムの効果が低下する場合があります。どうしてこれなの?

深層学習アルゴリズムは、規制アルゴリズムに適用する前に、まず多数の人間のドライバーの運転行動を学習する必要があります。ただし、問題は、ドライバーが異なれば運転スタイルも異なり、同じドライバーの運転スタイルであっても、完全に一貫性があるわけではありませんが、人間のドライバーの運転行動が学習に値する適切なデータであることを確認するにはどうすればよいでしょうか?

たとえば、交差点での一部の車線変更動作では、通常の運転では実線を押して車線変更することはできませんが、多くのドライバーは実線を押して車線変更を好むことがよくあります。

Pony.ai の制御アルゴリズムの専門家は、「人間のドライバーも、運転中に多くの悪い習慣を持っています。彼らがただ盲目的に擬人化を追求し、自動運転システムの 3 つの主要な最適化目標である安全性、快適性、効率性を無視すると、 「それは本末転倒です。実際、従来のアルゴリズムの欠点を補うために AI モデルが使用されたとしても、これら 3 つの側面を改善する必要があります。」

したがって、多くの分野では、データが「クリーン化」された場合にのみ、深層学習アルゴリズムのパフォーマンスが向上します。しかし、大規模なリアルタイム データ クリーニングの効率と品質を確保するにはどうすればよいでしょうか?これは問題だ。

この問題に対応して、一部の企業はドライバーの運転が上手いかどうかを評価し、悪いと思われるドライバーを除外するルールを人為的に設定していますが、これはルールが深く「制約」するために使用されているものです。さらに、このアプローチはあまりにも単純かつ粗雑で、「赤ちゃんをお風呂のお湯と一緒に捨てる」ようなもので、有用な運転行動データの一部を誤って削除してしまう可能性があります。

2. 深層学習アルゴリズムはルールよりも需要の変化に対応するのが難しい

ある自動運転会社のアルゴリズムでは、道路を走行する際に、前方車両との安全距離は 5 メートル以上である必要があります。ある日、プロダクト マネージャーが新しい要件を提案しました。それは、道路を通常通り走行する場合、前方車両との安全距離が 5 メートル以上から 10 メートル以上に変更されるというものでした。

この状況では、深層学習アルゴリズムの問題が明らかになります。エンジニアが要件に応じてモデルを変更したい場合は、モデルを再トレーニングする必要があり、非常にコストがかかります。ただし、ルールベースのアルゴリズムを使用すると、現時点では非常に簡単で、数行のコードで問題を解決できます。

また、ディープラーニングアルゴリズムでは、ルールアルゴリズムのように、事故が発生した場合に、どこに問題があるのかを最短時間で迅速に発見することが困難です。

3. 深層学習アルゴリズムの効果はルールほど良くない可能性がある

青州志航の規制および制御アルゴリズムの専門家は次のように述べています: データインフラストラクチャが不完全な場合, AIモデルを導入すると、AIモデルのパフォーマンスが期待に応えることが難しくなります。

たとえば、ACC の車間距離は簡単なテスト キャリブレーションで決定できますが、AI モデルで同じ効果を達成するのは難しい場合があります。その主な理由は、多くの企業のデータ インフラストラクチャが不完全であり、さまざまな車両追従シナリオで多様なデータを見つける方法がないため、ルールのパフォーマンスを満たす、またはそれを超えるモデルをトレーニングすることが困難であるためです。

Haomo Zhixing の制御アルゴリズムの専門家も次のように述べています。「現在の AI モデルの効果は、ルールを完全に破ったわけではありません。AI は人々を擬人化しようとしますが、モデル アーキテクチャと入力および出力の定義により、その効果は十分ではありません」このタイプの認知ネットワークです。データの準備はまだ完了しておらず、知覚モデルのレベルに達していません。誰もがまだ模索中です (しかし、1 年以内に大きな進歩があると思います)。」

4. ディープラーニング アルゴリズムには真実を伝えるためのルールがまだ必要です

道路上で車両を運転するプロセスでは、意思決定アルゴリズムのエラーを完全に回避することはできません。なぜなら、たとえ人が運転していても、その経験豊富なドライバーであっても、その意思決定が常に完全に正しいことを保証することは不可能であり、ディープラーニング モデルに基づく意思決定アルゴリズムにも同じことが当てはまります。

したがって、システムを設計する際、開発者は「意思決定アルゴリズムが間違いを犯す」可能性を考慮し、意思決定アルゴリズムが判断する潜在的な事実を「受け入れる」ための「心理的準備」をしておく必要があります。間違い。

この点に関して、Lingjun Technology はハイブリッド意思決定アーキテクチャを採用しており、同社 CEO のヤン・ウェンリー博士は、「深層学習アルゴリズムは人間の運転経験からの学習に優れているため、主にパフォーマンスを向上させるために使用されます」と述べています。 「ルールは完全にテストされ、安全性が確保され、より高い優先度が与えられることが実証されています。」

さらに下を見ると、計画層は意思決定からの「間違った指示」を拒否することもできます。たとえば、入力される障害物の速度や大きさは一定の範囲内である必要があります(たとえば、「発進」のような速度 100m/s の車は存在しません)、別の例としては、意思決定層が「左に車線変更せよ」という指示ですが、これは左側に車がいる場合、現時点では車線変更時の空間計画に完全な解決策がないため、計画は直接「指示の実行を拒否」することができます。

ここで説明した、前のリンクからの「間違った指示」を拒否する計画アルゴリズムは、ルールにのみ基づくことができます。

上記に基づいて、深層学習アルゴリズムが使用できるシナリオでは、「隠蔽」の役割を果たすためのルールが依然として不可欠であることがわかります。

5. ディープ ラーニング アルゴリズムの導入は、大量のコードを置き換える必要があることを意味します。自動運転企業にとっては、次のような非常に困難な問題もあります。ハイブリッド規制を採用する アルゴリズムは必然的に大量のコードを置き換える必要があるという問題に直面し、そのためには必然的に「大量の人員」が必要になります。

青州の計画および制御アルゴリズムの専門家は、従来のルールベースのシステムは設計時に深層学習に関連するインターフェースの追加を考慮しておらず、コードベースは長年の開発を経て比較的強固になっていると述べ、コードの再構築には非常にコストがかかると述べた。高、

「しかし、青州志航は、2019 年に意思決定計画アルゴリズム スタックの構築を開始したときに、AI の普及を考慮し、モデル導入後の状況を事前に考慮しました。各インターフェイスレベルで、ターゲットを絞った構造調整を行いました。」

かつて大手ロボタクシー会社で規制アルゴリズムの責任者を務めていた上級専門家によれば、規制におけるディープラーニングの導入後、コード書き換えの作業負荷は非常に大きくなったという。オンラインとオフライン、シミュレーションおよびその他のシステム変換。

著者はインターネット業界で、なぜ特定のソフトウェアのプログラマは肥大化したシステムを再構築するのではなくパッチを適用することを常に選択するのかというユーザーからの苦情を何度も聞いてきました。この例は、ルールベースのガバナンス アルゴリズムをハイブリッド ガバナンス アルゴリズムに置き換えるときに直面する問題に似ています。つまり、リファクタリングの利点は低いということです。

書き直しました。システム運用レベルの向上には限界がありますが、それには莫大なコストがかかります。このような「苦労は必ずしも報われないかもしれない」ということが「耐えられない」のです。あらゆる企業の「重さ」。この懸念により、自動運転会社は「ハイブリッド制御アルゴリズムをいじりたくない、遠くから見守りたいだけ」という心理を抱くようになります。

実際、いくつかの自動運転会社の制御アルゴリズムのディレクター/エンジニアと連絡を取った後、著者は、ディープラーニング ニューラル ネットワークが 2014 年から 2015 年に知覚に適用された「場面」とは異なり、現在では誰もが知覚に適用されていることに気づきました。規制と制御における深層学習アルゴリズムの適用については、一般に「急いでいない」。

誰もが依然として「必要不可欠」の精神で事前研究や実用化を行っていると言えます。

より具体的に言うと、自動運転企業は、ルールベースの深層学習アルゴリズムを使用した「ハイブリッド制御アルゴリズム」が将来性があることを認識していますが、現時点ではハイブリッド制御アルゴリズムを使用できるシナリオがそれほど多くないため、なぜ使用しないのですか?数人募集して「ゆっくりと自分で調べさせてみましょう」。

したがって、現段階では、ほとんどの自動運転企業のハイブリッド計画および制御アルゴリズムに対する姿勢は、ランプや交差点などのごく少数のシナリオを扱う場合にのみハイブリッド計画および制御アルゴリズムを使用するというものです。 、ルールベースのアルゴリズムが使用されました。アルゴリズムによって解決されたコーナーケースは、「耐えられない」問題が見つからない限り、移動されません。

また、計画および制御アルゴリズムの専門家の中には、ハイブリッドな計画および制御アルゴリズムを使用するかどうかは需要次第であり、これはエンジニアリングの問題であると非常に率直に述べた人もいます。

上記の論理に基づくと、自動運転企業のハイブリッド制御アルゴリズムに対する現在の姿勢は「必要ない」ものであり、将来のハイブリッド制御アルゴリズムの適用範囲も「疑問視」される必要がある。

03 ルールそれとも深層学習アルゴリズム?

前のセクションのロジックに基づいて議論を続けましょう。

多くの専門家は、深層学習アルゴリズムとハイブリッド フレームワークがどれほど成熟していても、ルール コードが常に制御アルゴリズムの大部分を占め、深層学習アルゴリズムは補助的な役割を果たすだけであると考えています。

彼らが挙げた主な理由は、深層学習アルゴリズムには「説明不能」という特性があるということです。深層学習アルゴリズムを使用して予測や決定を行うと、厳密な因果関係ではなく、確率に従うことになります。したがって、必然的に人々が「不安になる」ことになります。規制に対する「第一の責任」を負うことが認められる場合。

Rulingjun Technology CEOのヤン・ウェンリー博士は、「ディープラーニングはブラックボックスだ。人間が理解する『シナリオ』は、ディープラーニングが理解する『シナリオ』とは異なる可能性がある。一例があった」と述べた。以前、人工知能をディスった画像の中で、いくつかのピクセルを変更すると、人工知能は間違いを認識しますが、交通標識にいくつかの黒いテープを貼った場合、テスラはそれを認識できません。ピクセルレベルでは、人々が「同じシーン」だと思っているものは、同じようには認識されません。ディープラーニングの観点からは、それはおそらく「異なるシナリオ」です。

「ディープラーニング」学習アルゴリズムは入力と出力のフィッティングに基づいており、入力と出力の特性からより適切な擬人化を得ることができますが、実際には運転の内部ロジックを理解することは困難です。 「深層学習アルゴリズムを使用した意思決定におけるエラーの可能性に対処するために、私たちはハイブリッド意思決定アーキテクチャを採用しました。」

商用車自動運転会社の CTO と新車の制御アルゴリズムの専門家 -作成勢力も同様の見解を持っています。

9 月末の技術交換イベントで、Horizon CTO の Huang Chang 博士もこの問題について話しましたが、Huang Chang 氏は、ハイブリッド規制アルゴリズムではディープラーニングが主流となり、ルールのみが主流になると考えていました。 「必要な支援」として - 明白で意味的に説明可能なエラーを回避するため。

Huang Chang 氏は、自身の経験に基づいて、長年にわたり改良され、よく調整されたルールベースのシステムの場合、ディープラーニングを特定のローカル モジュールにのみ導入した場合、改善は期待できないと説明しました。 「他のモジュールはまだルールに基づいて設計されているためです。この大きなフレームワークの下で、モジュールを深層学習アルゴリズムに置き換えると、他のモジュールをこの新しいモジュールに適応させるコストはすごく高い。検証サイクル全体は非常に長く、完了する忍耐力がありません。

ロボタクシー会社の制御アルゴリズムの責任者と青州の制御アルゴリズムの専門家も、将来の制御アルゴリズムは深層学習に基づいており、ルールによって補足されるものになると考えています。

青州計画制御アルゴリズムの専門家によると、現在予測プロセスにある青州志航市では、深層学習アルゴリズム関連の操作 (前処理、モデル推論、後処理を含む) が実行中のモジュール全体の 95% 近くを占めている意思決定や計画においても、ディープラーニングアルゴリズムの運用割合が約30%に達しています。

「数値化するのは簡単ではありませんが、一般的に、深層学習アルゴリズムは規制アルゴリズムの 50% ~ 60% を占めるはずです。」

彼は、最終的には規制が実現すると信じています。制御アルゴリズムの計算時間の 80% ~ 90% が深層学習アルゴリズムに費やされます。さらに、ヤン・ウェンリー博士が先に述べた「基礎となる制御アルゴリズムにAIを使用する必要はない」とは異なり、制御アルゴリズムはルールベースであるが、深層学習モデルを使用して制御パラメータやアルゴリズムの適応性を高めます。

彼は次のように指摘しました。「『AI ベース』か『ルール ベース』をめぐって業界で以前の論争があったのは理解できますが、テスラが最新の AI DAY で発表した情報によると、テスラの深層学習制御アルゴリズムの広範な使用は非常にうまく機能しており、これはマスクの「第一原則」が、ある意味では深層学習ベースの制御アルゴリズムにも適用できることを側面から反映しています。

ディープラーニングアルゴリズムには大きな問題があります。議論の対象となっているのは、その「説明不能さ」です。 、特定のシーンが「未知」から「既知」に変化した場合、それを「決定」するためのルールをアルゴリズムに追加する必要がありますか?

著者の質問に関して、ロボタクシー会社の制御アルゴリズムの専門家は、AI のシーン認識の不確実性をルールによって判断することは「実現可能」であると考えていますが、Huang Chang と Qingzhou の制御アルゴリズムの専門家は、「それは可能である」と考えています。実現不可能」と「不必要」。

Huang Chang 氏は次のように述べています。「このシステムを強制的に『説明可能』にすることはできません。なぜなら、いわゆる『説明可能』とは、ルールを使用してシステムを制約したり、エキスパート システムのようにルールに完全に依存したりすることを意味するからです。その結果、都市 A でスムーズに動作するシステムが、都市 B で動作するときにもデバッグに多数のエンジニアが必要となり、さらに、複雑で人為的なルールでは説明できない特殊なケースが「解決不可能」になります。」

システムを強制的に「解釈可能」にすることは、この記事の最初のセクションで述べた「ルールの制限」に戻ることがわかります。

Huang Chang 氏は、深層学習アルゴリズムを規制に導入する際、システムが「説明可能」であるかどうかについてあまり心配する必要はないと考えています。

「私はあなたとコミュニケーションをとっています。ここだけの話、私はあなたのことを完全に理解し、あなたの一連の論理を推測することはできますが、あなたの根底にある直感や隠れた特徴の一部は知りません。(あなたでさえそうでないかもしれません)それは自分で知っています) しかし、これは私たちが信頼を築き、スムーズにコミュニケーションする能力には影響しません。同様に、ディープ ラーニング アルゴリズムのアプリケーション境界の探索を、それが「説明可能」かどうかによって制限する必要もありません。

「私は少し前に、ディープ ラーニングと古典的な統計の違いは、古典的な統計はシステム全体を「解釈可能」にするためにルール モデルを使用しようとしているという投稿を読みましたが、ディープ ラーニングはこれを突破します。最終目標を最適化するために極端な行動をとることさえあります。

「人は間違いを犯すし、ルール システムも間違いを犯すし、データ システムも間違いを犯すでしょう。しかし、統計的に広い意味で、データの規模が十分に大きければ、ディープ ラーニング アルゴリズムは桁違いに大きくなります。

「これをベースに、環境モデルなどをわかりやすく可視化し、制約に必要な少数のルールを導入する」計画の最終段階での深さ アルゴリズムを学ぶだけで十分です。 「

Huang Chang 氏は、アルゴリズム 2.0 の時代には、AI が完全に自己適応する能力を備えていると信じています。したがって、自動運転企業は、アルゴリズム 2.0 を実現できるように、「アルゴリズムの上にアルゴリズム」を設計する必要があるかもしれません。

青州制御アルゴリズムの専門家は、著者が述べたように、「シナリオが未知から既知に変化するとき、ルールを使用して対応計画を与える」と信じています。実際のシーンは動的に調整されることが多いため、「定義する」という考えは実際に機能するのが困難です。最初は鮮明かもしれませんが、変化するにつれて「ぼやけて」しまうため、非常に困難です。難しい ルールを使って明確に説明するのは難しいです。

ディープ ラーニング アルゴリズムの「説明不能」について、彼の答えは次のとおりです。 「解釈可能性」の効果が得られるように深層学習アルゴリズムを設計してください。この説明可能性でさえ、ルールよりも強力である可能性があります。 「

同氏は、自動運転車が交差点を右折する際、直進車を避ける必要があるが、現時点では直進車の速度と直進車の速度をルールで網羅的に判断することは困難であるとの例を挙げた。自動運転システムは、どの時点でどのような対策を講じるべきでしょうか? しかし、深層学習アルゴリズムを使用すると、自動運転車の位置と状態、および潜在的な障害物 (車両を通過する) が把握できれば、関連する環境情報や歴史情報に加えて、学習済みのニューラル ネットワークが与えられると、「あなたは私に任せます」または「私はあなたに任せます」の確率をそれぞれ計算できます。これは、人間が運転中に意思決定を行うときと同じ考え方です。 「ルールよりも確率の方が説明しやすい。」

そういえば、この記事のテーマとは直接関係なさそうだが、深く関係しているテーマ、「人間とは何か」について著者が思いついた。直感」?

企業経営の研究をしている人が、起業家は重要な事柄について決定を下す際、重要な瞬間に研究ではなく直感に頼ることが多い、と言っているのをよく見てきました。この直感とは何かを明確に説明できる人は少ないが、この「直感」が実はデータ駆動型の「深層学習アルゴリズム」ではないかと著者は感じている。

いわゆる「直感の正確さ」は才能ではなく、その背景には情報の蓄積とそれに基づいて形成された認識があります。ビッグデータ分析と同様に、結論と情報の間に相関関係はあるものの、因果関係がないか、因果関係が直接的または明らかではなく、論理的に明確に説明することが難しいため、「」と呼ばれます。直感。"

この意味では、深層学習アルゴリズムを強制的に「解釈可能」にする必要はありません。

しかし、Hao Mo Zhixing の制御アルゴリズムの専門家は、たとえ多数の AI モデルが認知に使用されるとしても、それはシナリオベースでなければならず、明示的で解釈可能な「意図と意味」を持たなければならないと考えています。私たちの原則です。」

専門家は次のように述べています。「ディープラーニングの強みは、変化する状況に適応でき、さまざまな複雑な環境で迅速に解決策を提供できることです。しかし、そのブラックボックスの特性により、誤った解決策やルールが導かれることがあります。このアルゴリズムは実際には「知っている、知っている」と「知っている、知らない」だけであり、「未知」の複雑なシーンに対して正しい解を与える可能性はディープラーニング手法よりも低いですが、 「正しくできません。」 答えを見て正しいか間違っているかの判断には、答えは影響しません。したがって、質問に答えるのはAIが主力であり、ルールは検証を担当します。

Pony.ai の規制 アルゴリズムの専門家は、現段階ではディープラーニング アルゴリズムでセキュリティを確保することは困難であると考えており、そのため今後長い期間、従来のアルゴリズムとディープラーニングが使用されることになるでしょう。組み合わせる必要があります。

規制アルゴリズムの専門家は次のように述べています。「AI はすべての特殊なケースに対処する必要はないため、L2 は AI 主導の状態に到達する可能性が高いと考えています。結局のところ、ドライバーは依然として存在します。最終的な安全性の保証を提供することができます。AI Day でのテスラの共有もこの点を示しています。

「しかし、L4 アルゴリズムは将来的に長い間 AI ベースになる可能性は低いです。主な理由は、そこにあります」解釈可能性と、セキュリティ リスクを伴う特殊なケースに対処する能力の問題がありますが、テクノロジーの進歩に伴い、アルゴリズムに AI 部分がますます多く含まれるようになると考えられます。

「実際、従来の計画および制御アルゴリズムは、決してルールの山ではありません。優れた従来の計画および制御アルゴリズムは、シナリオを要約して要約する、より抽象的な数学モデルであり、さまざまな数学ツールを使用して計画問題を構築します。最適化手法を通じてモデル化して解決することで、問題の本質を特徴づけ、理論的な範囲内でセキュリティを根本的に確保する機能を備えています。

「したがって、深層学習の導入には多くのコードの書き換えは必要ありません。もっと重要なのは、従来のアルゴリズムとディープラーニングをどのように組み合わせ、従来のアルゴリズムを使用して運転の安全性を確保するかということです。従来の制御アルゴリズムとAIモデルは単純な置き換え関係ではないと言えますが、アルゴリズム開発も段階的に反復的に行われており、多額の費用をかけてルールコードをAIモデルに置き換える必要はありません。一度だけですが、段階的に。 「

OEM のアーキテクトは、メイン システムでルールベースのアルゴリズムを実行し、シャドウ モードでディープ ラーニング アルゴリズムを実行し、ディープ ラーニング アルゴリズムのトレーニング効果がルールを超えるまで待つという提案をしました。

自動運転制御におけるディープラーニング アルゴリズムの適用に関する 2 つの事例を添付します

1. Zhijia : 燃料消費量の削減ディープ ラーニング アルゴリズムを通じて

#Zhijia のデータ駆動型意思決定アプリケーションも、ルールベースの意思決定からルールとデータのハイブリッド意思決定への移行を経験しました。Zhijia のチーフサイエンティスト、Cui Dixiao 氏は、 Technology Zeng 氏は、車線変更のタイミングは、意思決定を支援するためにディープラーニング アルゴリズムを使用するのに非常に適していると考えていると述べました。不適切な車線変更により、ドライバーは自動 車線変更機能の割合が減少します。その一方で、ルールベースの車線変更アルゴリズムは保守的です。「車線変更」コマンドが車の速度が一定の場合にのみトリガーされる場合、前車の車高が低すぎると後続のブレーキが多くなり、全体の適時性が低下し、燃料消費量が低下します。燃料消費量を削減するために、自動運転システムはドライバーがどのように判断するかを観察するためのデータを収集し、研究します。より人間らしい車線変更の意思決定。この計画は 2 つの段階を経ました。最初の段階は、車線変更の意思決定がドライバーの「自己トリガー」形式から「システム推奨」に変更されるときです。この段階では、エンジニアはドライバーが特定の時点で車線変更の決断を下した理由を引き続き研究し、車線変更を推奨するためのルールを策定します。システムが車線変更を提案した後、ドライバーが車線変更を許可した場合、システムはその時点での判断が適切であると判断し、ドライバーが現時点で車線変更を行うべきではないと考える場合、ドライバーは車線変更を行う必要はありません。車線変更提案を採用する。

第 2 段階では、エンジニアはさまざまなシナリオでの手動車線変更データも収集し、第 1 段階で収集したデータをシステムの車線変更の決定と、一貫性のないシナリオ (たとえば、次のような) でのドライバーの車線変更の決定と組み合わせます。ドライバーが車線変更をトリガーする)、システムがトリガーされない、またはシステムが車線変更をトリガーするが、ドライバーがそれを採用しない)ラベリングとモデルトレーニングのために、車線変更決定モデルが取得され、オリジナルの計画と制御アルゴリズムが提供されます。システムを改良し、省燃費性能がさらに向上しました。

2. Qingzhou Zhihang: 深層学習アルゴリズムを使用してシステムの「擬人化」を改善

Qingzhou Zhihang の予測および制御の専門家によると、現段階では、青州制御アルゴリズムは、深層学習用に多数のインターフェイスを予約し、深層学習制御アルゴリズムを積極的に開発しています。 Qingzhou Zhihang の全体的な計画および制御アルゴリズム アーキテクチャの最終目標は、AI ファースト (深層学習アルゴリズムの優先順位) を達成し、行動出力のほとんどをモデルに実行させ、ルールを使用してそれを補完することです (ルールは主に安全関連を扱います)問題)。

Qingzhou Zhihang は、規制と制御の能力が都市 NOA の機能分化の重要な現れになると考えています。現在、青州志航市は、都市NOA計画の規制と制御の側面でAIを可能な限り使用する試みを開始しており、システムの意思決定がほとんどの場合「人間に近い」ものであり、「人間を超えた」ものになるようにしています。極端な場合には。

たとえば、青州市は、車線変更のタイミング、ランプ合流のタイミング、交差点ゲームなど、都市部の NOA を使用する際に遭遇する特定の重要な計画シナリオを処理するための、特殊な深層学習アルゴリズムをすでに備えています。

深層学習アルゴリズムの予測可能性と制御可能性を確保するために、Qingzhou Zhihang は入力と出力の検証を設定し、入力データが現在の設計要件を満たしているかどうかを確認します。入力レベルでは、ルールを使用して深層学習アルゴリズムに適用可能なシナリオを選択し、モデル入力の合理性を確保し、設計された問題の範囲内でモデルの実行を制限します。出力レベルでも、ルールは次の目的で使用されます。出力を検証して、出力が事前設定された効果を達成していることを確認します。同時に、モデルがうまく処理できないシーンに遭遇した場合は、時点とシーン関連情報を自動的に記録し、データ閉ループを通じてモデルを更新することで、モデルの一般化能力を強化し、状況に適応させることができます。さらに多くのシーン。

現在、青州志航では、深層学習(模倣学習や強化学習など)によって車両の「可能な将来の軌道」を生成する技術が比較的成熟しており、大量のデータを収集して訓練されています。モデルの場合、モデルによって生成された軌道は 90% のケースで変更する必要がなくなりましたが、10% のケースでは、ディープラーニングによって生成された軌道は効果的でなかったり、安全上のリスクを引き起こしたりする可能性があります。この場合、修正/変更するにはフレームワークが必要です。 Qingzhou は、国内で先駆的な時空結合アルゴリズム (数値最適化に基づくアルゴリズム) を使用して、深層学習によって生成された軌道を微調整します。

青州の計画および制御アルゴリズムの専門家は、時空共同計画アルゴリズムは、従来の水平および垂直分離よりも深層学習アルゴリズムと組み合わせて使用するのに適していると述べています。なぜなら、深層学習アルゴリズムによって生成される軌跡自体は、実際には時空を組み合わせた軌跡であり、この軌跡には位置、速度、方向の情報だけでなく、時間情報も含まれています。したがって、時空間共同計画アルゴリズムをモデルの結果とより適切に統合できるため、深層学習アルゴリズムにセキュリティ保護をシームレスに追加できます。

以上が自動運転の規制と制御における深層学習アルゴリズムの適用についての 1 万語の解釈の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。