テクノロジー周辺機器

テクノロジー周辺機器 AI

AI 証明写真をデジタル人物に変換するのに数秒しかかかりません. Microsoft は 3D 拡散モデルの最初の高品質世代を達成しており、たった 1 つの文で見た目と外観を変更できます。

証明写真をデジタル人物に変換するのに数秒しかかかりません. Microsoft は 3D 拡散モデルの最初の高品質世代を達成しており、たった 1 つの文で見た目と外観を変更できます。証明写真をデジタル人物に変換するのに数秒しかかかりません. Microsoft は 3D 拡散モデルの最初の高品質世代を達成しており、たった 1 つの文で見た目と外観を変更できます。

3D生成ディフュージョンモデル「ロダン」の名前RODINは、フランスの彫刻家オーギュスト・ロダンからインスピレーションを得たものです。

2D 証明写真があれば、わずか数秒で 3D ゲーム アバターをデザインできます。

これは3D分野における普及モデルの最新の成果です。たとえば、フランスの彫刻家ロダンの古い写真だけで、数分で彼をゲームに「変身」させることができます:

CVPR 2023 に受理されました。

見に行きましょう。 3D データを直接使用して拡散モデルをトレーニングこの 3D 生成拡散モデル「ロダン」RODIN の名前は、フランスの彫刻家オーギュスト・ロダンからインスピレーションを得ています。 以前は、2D で生成された 3D 画像モデルは、通常、敵対的生成ネットワーク (GAN) または変分オートエンコーダー (VAE) を 2D データでトレーニングすることによって取得されていましたが、結果は満足のいくものではないことがよくありました。 研究者らは、この現象の理由は、これらの手法に基本的な未決定 (不適切な設定) 問題があるためであると分析しました。つまり、単視点画像の幾何学的な曖昧さのため、大量の 2D データだけで高品質の 3D アバターの合理的な分布を学習することは難しく、その結果、生成結果が不十分になります。 そこで、今回は3D データを直接使用して拡散モデルをトレーニングすることを試みました 、主に 3 つの問題を解決しました:

- まず、拡散モデルの使用方法モデルを使用して 3D モデルのマルチビュー図を生成します。これまで、3D データ上の拡散モデルについては、実践的な手法や前例がありませんでした。

- 第二に、高品質で大規模な 3D 画像データセットは入手が難しく、プライバシーと著作権のリスクがありますが、インターネット上で公開されている 3D 画像については、多視点の一貫性が保証されません。

- 最後に、2D 拡散モデルは 3D 生成に直接拡張されますが、これには膨大なメモリ、ストレージ、およびコンピューティングのオーバーヘッドが必要になります。

#△3D 対応コンボリューションで 3D 特徴を効率的に処理

#△3D 対応コンボリューションで 3D 特徴を効率的に処理

上図の左側では、3D 空間を表現するためにトライプレーンが使用されています。今度は、一番下の特徴面の特徴点は、他の 2 つの特徴面の 2 つの線に対応します。上図の右側では、拡張された 2D 特徴面を処理するために 3D 知覚畳み込みが導入されています。 3 つの平面の次元固有の対応関係。

具体的には、3D 画像の生成を実現するには 3 つの重要な要素が必要です。

まず、3D 対応の畳み込みにより、次元削減後の 3 つの平面の固有の相関が保証されます。従来の 2D 拡散で使用される 2D 畳み込みニューラル ネットワーク (CNN) は、Triplane 特徴マップを適切に処理できません。

3D 対応の畳み込みは、単に 3 つの 2D フィーチャ平面を生成するのではなく、そのような 3D 表現を処理するときにその固有の 3 次元特性を考慮します。つまり、3 つのビュー平面のうちの 1 つの 2D フィーチャは本質的に直線の投影です。したがって、3D 空間内の線は、他の 2 つの平面内の対応する直線投影フィーチャに関連付けられます。

クロスプレーン通信を実現するために、研究者はこのような 3D 相関を畳み込みで考慮し、3D の詳細を 2D に効率的に合成します。

2つ目、潜在空間協奏曲3面3D表現生成。

研究者は、潜在ベクトルを通じて特徴生成を調整して、3 次元空間全体にわたってグローバルに一貫性を持たせ、その結果、より高品質のアバターとセマンティック編集が可能になります。

同時に、トレーニング データセット内の画像を使用して追加の画像エンコーダーもトレーニングされ、意味論的な潜在ベクトルを拡散モデルへの条件付き入力として抽出できます。

このようにして、生成ネットワーク全体を、拡散モデルを復号潜在空間ベクトルとして使用するオートエンコーダとみなすことができます。セマンティックな編集性を実現するために、研究者らはテキスト プロンプトと潜在スペースを共有するフリーズされた CLIP 画像エンコーダーを採用しました。

3 番目の階層合成により、忠実度の高い 3 次元の詳細が生成されます。

研究者らは拡散モデルを使用して、まず低解像度の 3 ビュー プレーン (64×64) を生成し、次に拡散を通じて高解像度の 3 ビュー プレーン (256×256) を生成しました。アップサンプリング。

このように、基本的な拡散モデルは全体的な 3D 構造の生成に焦点を当て、後続のアップサンプリング モデルは詳細の生成に焦点を当てます。

Blender に基づいた大量のランダム データの生成

トレーニング データ セット 上で、研究者はオープンソース 3D レンダリング ソフトウェア Blender を使用して、仮想 3D キャラクターをランダムに組み合わせました。アーティストによって手動で作成された画像と、多数の髪、衣服、表情、アクセサリーからのランダム サンプリングを組み合わせて、100,000 人の合成個人を作成し、各個人に対して解像度 256*256 の 300 枚のマルチビュー画像をレンダリングします。

3D アバターへのテキストの生成に関して、研究者らは LAION-400M データ セットのポートレート サブセットを使用して、入力モダリティから 3D 拡散モデルの隠れた空間へのマッピングをトレーニングし、最終的に1 つだけを使用する RODIN モデル 2D 画像またはテキスト説明により、リアルな 3D アバターを作成できます。

△写真を与えてアバターを生成する

は、「巻き毛とひげを生やした男性」のように、一文で画像を変更するだけでなく、黒い革のジャケットを着ている" ":

性別さえも自由に変えることができます、「アフリカの髪型に赤い服を着た女性」: (手動の犬の頭)

研究者らは、アプリケーション デモのデモンストレーションも行いました。独自のイメージの作成に必要なのは、いくつかのボタンだけです:

△テキストを使用して、 3D ポートレート編集を行う

その他の効果については、プロジェクト アドレスをクリックして表示できます~

3D 半身ポートレート に焦点を当てており、これは主に顔データをトレーニングに使用しているという事実とも関係していますが、 3D 画像の生成 需要は人の顔に限定されません。

次に、チームは、「1 つのモデルですべてを 3D 生成する」という最終目標を達成するために、RODIN モデルを使用して花、木、建物、車、家などを含むさらに 3D シーンを作成することを検討します。 」。 論文アドレス:https://arxiv.org/abs/2212.06135

https://3d-avatar-diffusion.microsoft.com

以上が証明写真をデジタル人物に変換するのに数秒しかかかりません. Microsoft は 3D 拡散モデルの最初の高品質世代を達成しており、たった 1 つの文で見た目と外観を変更できます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

最高の迅速なエンジニアリング技術の最新の年次編集Apr 10, 2025 am 11:22 AM

最高の迅速なエンジニアリング技術の最新の年次編集Apr 10, 2025 am 11:22 AM私のコラムに新しいかもしれない人のために、具体化されたAI、AI推論、AIのハイテクブレークスルー、AIの迅速なエンジニアリング、AIのトレーニング、AIのフィールディングなどのトピックなど、全面的なAIの最新の進歩を広く探求します。

ヨーロッパのAI大陸行動計画:GigaFactories、Data Labs、Green AIApr 10, 2025 am 11:21 AM

ヨーロッパのAI大陸行動計画:GigaFactories、Data Labs、Green AIApr 10, 2025 am 11:21 AMヨーロッパの野心的なAI大陸行動計画は、人工知能のグローバルリーダーとしてEUを確立することを目指しています。 重要な要素は、AI GigaFactoriesのネットワークの作成であり、それぞれが約100,000の高度なAIチップを収容しています。

Microsoftの簡単なエージェントストーリーは、より多くのファンを作成するのに十分ですか?Apr 10, 2025 am 11:20 AM

Microsoftの簡単なエージェントストーリーは、より多くのファンを作成するのに十分ですか?Apr 10, 2025 am 11:20 AMAIエージェントアプリケーションに対するMicrosoftの統一アプローチ:企業の明確な勝利 新しいAIエージェント機能に関するマイクロソフトの最近の発表は、その明確で統一されたプレゼンテーションに感銘を受けました。 TEで行き詰まった多くのハイテクアナウンスとは異なり

従業員へのAI戦略の販売:Shopify CEOのマニフェストApr 10, 2025 am 11:19 AM

従業員へのAI戦略の販売:Shopify CEOのマニフェストApr 10, 2025 am 11:19 AMShopify CEOのTobiLütkeの最近のメモは、AIの能力がすべての従業員にとって基本的な期待であると大胆に宣言し、会社内の重大な文化的変化を示しています。 これはつかの間の傾向ではありません。これは、pに統合された新しい運用パラダイムです

IBMは、完全なAI統合でZ17メインフレームを起動しますApr 10, 2025 am 11:18 AM

IBMは、完全なAI統合でZ17メインフレームを起動しますApr 10, 2025 am 11:18 AMIBMのZ17メインフレーム:AIを強化した事業運営の統合 先月、IBMのニューヨーク本社で、Z17の機能のプレビューを受け取りました。 Z16の成功に基づいて構築(2022年に開始され、持続的な収益の成長の実証

5 chatgptプロンプトは他の人に依存して停止し、自分を完全に信頼するApr 10, 2025 am 11:17 AM

5 chatgptプロンプトは他の人に依存して停止し、自分を完全に信頼するApr 10, 2025 am 11:17 AM揺るぎない自信のロックを解除し、外部検証の必要性を排除します! これらの5つのCHATGPTプロンプトは、完全な自立と自己認識の変革的な変化に向けて導きます。 ブラケットをコピー、貼り付け、カスタマイズするだけです

AIはあなたの心に危険なほど似ていますApr 10, 2025 am 11:16 AM

AIはあなたの心に危険なほど似ていますApr 10, 2025 am 11:16 AM人工知能のセキュリティおよび研究会社であるAnthropicによる最近の[研究]は、これらの複雑なプロセスについての真実を明らかにし始め、私たち自身の認知領域に不穏に似た複雑さを示しています。自然知能と人工知能は、私たちが思っているよりも似ているかもしれません。 内部スヌーピング:人類の解釈可能性研究 人類によって行われた研究からの新しい発見は、AIの内部コンピューティングをリバースエンジニアリングすることを目的とする機械的解釈可能性の分野の大きな進歩を表しています。AIが何をするかを観察するだけでなく、人工ニューロンレベルでそれがどのように行うかを理解します。 誰かが特定のオブジェクトを見たり、特定のアイデアについて考えたりしたときに、どのニューロンが発射するかを描くことによって脳を理解しようとすることを想像してください。 a

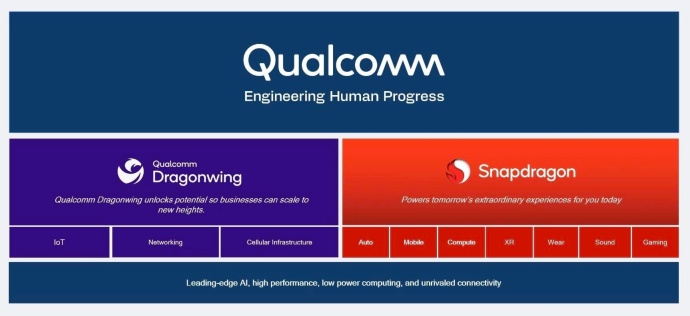

Dragonwingは、QualcommのEdge Momentumを紹介していますApr 10, 2025 am 11:14 AM

Dragonwingは、QualcommのEdge Momentumを紹介していますApr 10, 2025 am 11:14 AMQualcomm's DragonWing:企業とインフラストラクチャへの戦略的な飛躍 Qualcommは、新しいDragonwingブランドで世界的に企業やインフラ市場をターゲットにして、モバイルを超えてリーチを積極的に拡大しています。 これは単なるレブランではありません

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

ZendStudio 13.5.1 Mac

強力な PHP 統合開発環境

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

Safe Exam Browser

Safe Exam Browser は、オンライン試験を安全に受験するための安全なブラウザ環境です。このソフトウェアは、あらゆるコンピュータを安全なワークステーションに変えます。あらゆるユーティリティへのアクセスを制御し、学生が無許可のリソースを使用するのを防ぎます。

SublimeText3 Linux 新バージョン

SublimeText3 Linux 最新バージョン

SublimeText3 中国語版

中国語版、とても使いやすい