現代の大規模言語モデルの背後にある設計、制約、進化について学ぶには、この記事の参考文献リストを参照してください。

大規模言語モデルは世間の注目を集め、わずか 5 年で Transforme などのモデルは自然言語処理の分野をほぼ完全に変えました。さらに、コンピューター ビジョンや計算生物学などの分野にも革命を起こし始めています。

Transformers がすべての研究プロセスに非常に大きな影響を与えていることを考慮して、この記事では、機械学習の研究者や実践者が始めるための短い参考文献リストを紹介します。

次のリストは、主にいくつかの学術研究論文を時系列順に展開したものです。もちろん、他にも役立つリソースがたくさんあります。例:

- 「The Illustrated Transformer」Jay Alammar 著

- 「The Transformer Family」Lilian Weng 著

- 「Transformer モデル: 概要とカタログ」 — 2023 年版》

- nanoGPT ライブラリ (Andrej Karpathy 著)

主なアーキテクチャとタスクの理解

Transformers と大規模な言語モデルを初めて使用する場合は、これらの記事があなたに最適です。

論文 1: 「位置合わせと翻訳を共同学習することによるニューラル機械翻訳」

論文アドレス: https:// arxiv.org/pdf/1409.0473.pdf

この記事では、モデルの長距離シーケンス モデリング機能を向上させるリカレント ニューラル ネットワーク (RNN) アテンション メカニズムを紹介します。これにより、RNN は長い文をより正確に翻訳できるようになります。これが、元の Transformer アーキテクチャの開発の背後にある動機です。

画像ソース: https://arxiv.org/abs/1409.0473

論文 2: 「必要なのは注意だけです」 》

論文アドレス: https://arxiv.org/abs/1706.03762

この記事では、エンコーダとデコーダの構成について紹介します。オリジナルの Transformer アーキテクチャでは、これらの部分は後で別個のモジュールとして導入されます。さらに、この記事では、スケーリング ドット積アテンション メカニズム、マルチヘッド アテンション ブロック、位置入力エンコーディングなどの概念も紹介します。これらは依然として現代の Transformers の基礎となっています。

出典: https://arxiv.org/abs/1706.03762

論文 3: 「BERT: Pre -言語理解のための深い双方向トランスフォーマーのトレーニング》

論文アドレス: https://arxiv.org/abs/1810.04805

Large - スケール言語モデルの研究は、初期の Transformer アーキテクチャに従い、その後、予測モデリング タスク (テキスト分類など) 用の Transformer と生成モデリング タスク (翻訳、要約、その他の形式のテキスト作成) 用の Transformer の 2 つの方向に拡張し始めました。変成器。

BERT 論文では、マスクされた言語モデリングの独自の概念が紹介されています。この研究分野に興味がある場合は、事前トレーニングの目標を簡素化する RoBERTa をフォローしてください。

画像ソース: https://arxiv.org/abs/1810.04805

論文 4: 「言語の改善」生成的事前トレーニングによる理解》

論文アドレス: https://www.semanticscholar.org/paper/Improving-Language-Understanding-by-Generative- Radford-Narasimhan/cd18800a0fe0b668a1cc19f2ec95b5003d0a5035

元の GPT 論文では、人気のあるデコーダー スタイルのアーキテクチャと次の単語予測による事前トレーニングが紹介されています。 BERT は、マスクされた言語モデルの事前トレーニング目標により双方向の Transformer であると考えることができますが、GPT は一方向の自己回帰モデルです。 GPT 埋め込みも分類に使用できますが、GPT メソッドは ChatGPT など、今日最も影響力のある LLM の中核となっています。

この研究分野に興味がある場合は、GPT-2 および GPT-3 の論文をフォローしてください。なお、この記事ではInstructGPTメソッドについては後ほど別途紹介します。

#論文 5: 「BART: 自然言語の生成、翻訳、理解のためのシーケンス間の事前トレーニングのノイズ除去」

#拡張則と効率改善

#拡張則と効率改善

変圧器の効率を改善する技術について詳しく知りたい場合は、次の論文を参照してください

論文 1:「変圧器の効率的なトレーニングに関する調査」- 論文アドレス: https://arxiv.org/abs/2302.01107

##論文 2:「FlashAttendant: IO 認識による高速かつメモリ効率の高い Exact Attendance」

論文 3: 「詰め込み: 1 日で 1 つの GPU で言語モデルをトレーニングする」

論文 4:「コンピューティングに最適な大規模言語モデルのトレーニング」

- さらに、論文「Training Compute-Optimal Large Language Models」

- 論文アドレス: https:// arxiv.org/abs /2203.15556

この記事では、生成モデリング タスクにおいて一般的な 1,750 億パラメータの GPT-3 モデルを上回る 700 億パラメータのチンチラ モデルを紹介します。ただし、その主なハイライトは、現代の大規模言語モデルが大幅にトレーニングされていないことです。

この記事では、大規模言語モデルのトレーニングのための線形スケーリング則を定義します。たとえば、Chinchilla は GPT-3 の半分のサイズですが、(3,000 億ではなく) 1 兆 4,000 億のトークンでトレーニングされているため、GPT-3 よりも優れたパフォーマンスを発揮します。言い換えれば、トレーニング トークンの数はモデルのサイズと同じくらい重要です。

調整 - 大規模な言語モデルを望ましい目標と関心に向けて導く

近年、比較的強力な手法が数多く登場しています。実際のテキストを生成できるモデル (GPT-3 や Chinchilla など)。一般的に使用されている事前トレーニング パラダイムに関しては、上限に達しているようです。 言語モデルを人間にとってより役立つものにし、誤った情報や悪い言葉を減らすために、研究者は、次の論文を含む、事前トレーニングされた基本モデルを微調整するための追加のトレーニング パラダイムを設計しました。

論文 1:「人間のフィードバックによる指示に従う言語モデルのトレーニング」論文のアドレス: https://arxiv.org/abs/2203.02155- このいわゆる InstructGPT 論文では、研究者は RLHF (ヒューマン フィードバックからの強化学習) を使用しました。彼らは、事前トレーニングされた GPT-3 ベース モデルから開始し、教師あり学習 (ステップ 1) を使用して、人間が生成したキューと応答のペアでモデルをさらに微調整しました。次に、報酬モデルをトレーニングするためにモデルの出力をランク付けするよう人間に依頼しました (ステップ 2)。最後に、報酬モデルを使用して、近位ポリシー最適化による強化学習を使用して、事前トレーニングおよび微調整された GPT-3 モデルを更新します (ステップ 3)。

- ところで、この論文は、ChatGPT の背後にあるアイデアを説明した論文としても知られています。最近の噂によると、ChatGPT は、より大きなデータセットで微調整された InstructGPT の拡張バージョンです。

- 論文 2: 「憲法上の AI: AI フィードバックによる無害性」

- 論文アドレス: https://arxiv.org/abs/2212.08073

この記事の内容論文の中で、研究者らはアライメントの考え方をさらに進め、「無害な」AI システムを作成するためのトレーニング メカニズムを提案しています。研究者らは、人間が直接監督するのではなく、(人間が提供する)ルールのリストに基づいた自己訓練メカニズムを提案した。前述の InstructGPT の論文と同様に、提案された手法は強化学習手法を使用します。

概要

この記事では、上記のフォームの配置をできるだけシンプルかつ美しく保つよう努めています。最初の 10 個に焦点を当てることをお勧めします。現代の大規模言語モデルの背後にある考え方、設計、制限、進化を理解するための論文。

さらに詳しく読みたい場合は、上記の論文の参考文献を参照することをお勧めします。あるいは、読者がさらに詳しく調べるための追加リソースがいくつかあります:

GPT の代替オープンソース

- 論文 1: 「BLOOM: A 176B-Parameter Open」 -多言語言語モデルへのアクセス》

- 論文アドレス: https://arxiv.org/abs/2211.05100

- 論文 2 : 「OPT: オープンな事前トレーニング済み Transformer 言語モデル」

- 論文アドレス: https://arxiv.org/abs/2205.01068

ChatGPT 代替案

- 論文 1「LaMDA: ダイアログ アプリケーションの言語モデル」

- 論文アドレス: https://arxiv.org/abs/2201.08239

- 論文 2: 「対象を絞った人間の判断による対話エージェントの調整の改善」

- 論文のアドレス: https://arxiv.org/abs/2209.14375

- 論文 3: 「BlenderBot 3: 責任を持って関与することを継続的に学習する、デプロイされた会話型エージェント」

- 論文のアドレス: https://arxiv.org/abs /2208.03188

計算生物学における大規模言語モデル

- 論文 1: 「ProtTrans: 自己を介して生命のコードの言語を解読することに向けて」教師あり学習》

- 論文アドレス: https://arxiv.org/abs/2007.06225

- 論文 2: 「高精度」 AlphaFold によるタンパク質構造予測」

- 論文アドレス: https://www.nature.com/articles/s41586-021-03819-2

- ##論文 3:「大規模言語モデルは多様なファミリーにわたる機能的タンパク質配列を生成する」

- 論文アドレス: https://www.nature.com/articles/s41587-022-01618- 2

以上が大規模な言語モデルを包括的に理解するための参考文献リストは次のとおりです。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

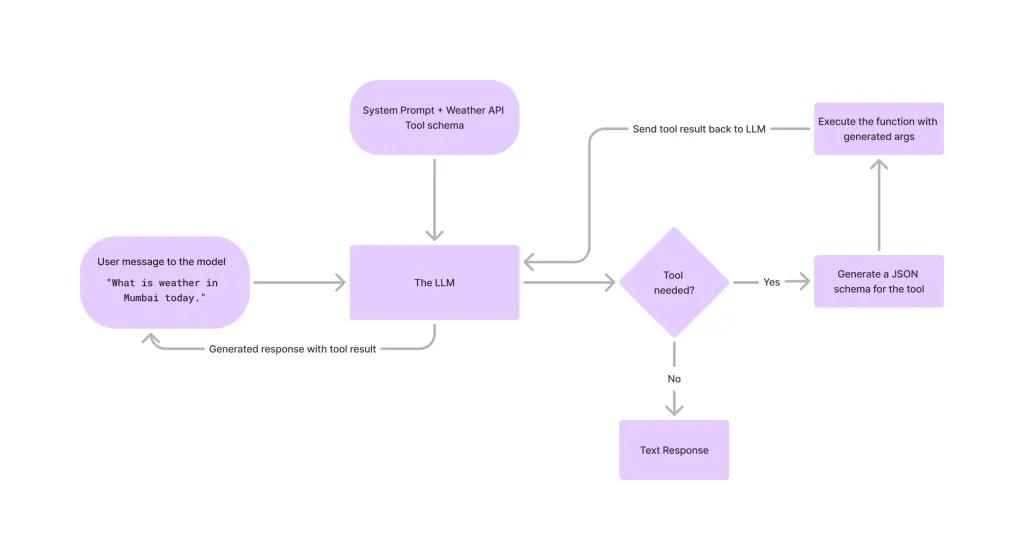

LLMSでのツール呼び出しApr 14, 2025 am 11:28 AM

LLMSでのツール呼び出しApr 14, 2025 am 11:28 AM大規模な言語モデル(LLM)は人気が急増しており、ツールコール機能は単純なテキスト生成を超えて機能を劇的に拡大しています。 これで、LLMSは動的なUI作成や自律的なaなどの複雑な自動化タスクを処理できます。

ADHDゲーム、ヘルスツール、AIチャットボットがグローバルヘルスを変える方法Apr 14, 2025 am 11:27 AM

ADHDゲーム、ヘルスツール、AIチャットボットがグローバルヘルスを変える方法Apr 14, 2025 am 11:27 AMビデオゲームは不安を緩和したり、ADHDの子供を焦点を合わせたり、サポートしたりできますか? ヘルスケアの課題が世界的に急増しているため、特に若者の間では、イノベーターはありそうもないツールであるビデオゲームに目を向けています。現在、世界最大のエンターテイメントインダスの1つです

AIに関する国連入力:勝者、敗者、および機会Apr 14, 2025 am 11:25 AM

AIに関する国連入力:勝者、敗者、および機会Apr 14, 2025 am 11:25 AM「歴史は、技術の進歩が経済成長を促進する一方で、それ自体が公平な所得分布を確保したり、包括的な人間開発を促進したりしないことを示しています」とUNCTADの事務総長であるRebeca Grynspanは前文で書いています。

生成AIを介した交渉スキルを学ぶApr 14, 2025 am 11:23 AM

生成AIを介した交渉スキルを学ぶApr 14, 2025 am 11:23 AM簡単な、Generative AIを交渉の家庭教師およびスパーリングパートナーとして使用してください。 それについて話しましょう。 革新的なAIブレークスルーのこの分析は、最新のAIに関する私の進行中のフォーブス列のカバレッジの一部であり、特定と説明を含む

テッドは、Openai、Google、Metaが法廷に向かい、自分自身とセルフィーから明らかにしますApr 14, 2025 am 11:22 AM

テッドは、Openai、Google、Metaが法廷に向かい、自分自身とセルフィーから明らかにしますApr 14, 2025 am 11:22 AMバンクーバーで開催されたTED2025会議は、昨日4月11日の第36版を締めくくりました。サム・アルトマン、エリック・シュミット、パーマー・ラッキーを含む60か国以上の80人の講演者が登場しました。テッドのテーマ「人類が再考された」は、仕立てられたものでした

ジョセフ・スティグリッツは、AI独占権の中で迫り来る不平等を警告しているApr 14, 2025 am 11:21 AM

ジョセフ・スティグリッツは、AI独占権の中で迫り来る不平等を警告しているApr 14, 2025 am 11:21 AMジョセフ・スティグリッツは、2001年にノーベル経済賞を受賞した経済学者であり、2001年にノーベル経済賞を受賞しています。スティグリッツは、AIが既存の不平等を悪化させ、いくつかの支配的な企業の手に統合した力を悪化させ、最終的に経済を損なうと仮定しています。

グラフデータベースとは何ですか?Apr 14, 2025 am 11:19 AM

グラフデータベースとは何ですか?Apr 14, 2025 am 11:19 AMグラフデータベース:関係を通じてデータ管理に革命をもたらす データが拡大し、その特性がさまざまなフィールドで進化するにつれて、グラフデータベースは、相互接続されたデータを管理するための変換ソリューションとして浮上しています。伝統とは異なり

LLMルーティング:戦略、テクニック、およびPythonの実装Apr 14, 2025 am 11:14 AM

LLMルーティング:戦略、テクニック、およびPythonの実装Apr 14, 2025 am 11:14 AM大規模な言語モデル(LLM)ルーティング:インテリジェントタスク分布によるパフォーマンスの最適 LLMSの急速に進化する風景は、それぞれが独自の長所と短所を備えた多様なモデルを提供します。 創造的なコンテンツGenに優れている人もいます

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

MantisBT

Mantis は、製品の欠陥追跡を支援するために設計された、導入が簡単な Web ベースの欠陥追跡ツールです。 PHP、MySQL、Web サーバーが必要です。デモおよびホスティング サービスをチェックしてください。

AtomエディタMac版ダウンロード

最も人気のあるオープンソースエディター

SublimeText3 Linux 新バージョン

SublimeText3 Linux 最新バージョン

DVWA

Damn Vulnerable Web App (DVWA) は、非常に脆弱な PHP/MySQL Web アプリケーションです。その主な目的は、セキュリティ専門家が法的環境でスキルとツールをテストするのに役立ち、Web 開発者が Web アプリケーションを保護するプロセスをより深く理解できるようにし、教師/生徒が教室環境で Web アプリケーションを教え/学習できるようにすることです。安全。 DVWA の目標は、シンプルでわかりやすいインターフェイスを通じて、さまざまな難易度で最も一般的な Web 脆弱性のいくつかを実践することです。このソフトウェアは、

mPDF

mPDF は、UTF-8 でエンコードされた HTML から PDF ファイルを生成できる PHP ライブラリです。オリジナルの作者である Ian Back は、Web サイトから「オンザフライ」で PDF ファイルを出力し、さまざまな言語を処理するために mPDF を作成しました。 HTML2FPDF などのオリジナルのスクリプトよりも遅く、Unicode フォントを使用すると生成されるファイルが大きくなりますが、CSS スタイルなどをサポートし、多くの機能強化が施されています。 RTL (アラビア語とヘブライ語) や CJK (中国語、日本語、韓国語) を含むほぼすべての言語をサポートします。ネストされたブロックレベル要素 (P、DIV など) をサポートします。