ホームページ >データベース >mysql チュートリアル >MapReduceの基本内容の紹介(コード付き)

MapReduceの基本内容の紹介(コード付き)

- 不言転載

- 2019-02-12 11:42:412108ブラウズ

この記事では、MapReduce の基本的な概要を説明します (コード付き)。必要な方は参考にしていただければ幸いです。

1. WordCount プログラム

1.1 WordCount ソース プログラム

import java.io.IOException;

import java.util.Iterator;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

public class WordCount {

public WordCount() {

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

String[] otherArgs = (new GenericOptionsParser(conf, args)).getRemainingArgs();

if(otherArgs.length < 2) {

System.err.println("Usage: wordcount <in> [<in>...] <out>");

System.exit(2);

}

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(WordCount.TokenizerMapper.class);

job.setCombinerClass(WordCount.IntSumReducer.class);

job.setReducerClass(WordCount.IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

for(int i = 0; i < otherArgs.length - 1; ++i) {

FileInputFormat.addInputPath(job, new Path(otherArgs[i]));

}

FileOutputFormat.setOutputPath(job, new Path(otherArgs[otherArgs.length - 1]));

System.exit(job.waitForCompletion(true)?0:1);

}

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private static final IntWritable one = new IntWritable(1);

private Text word = new Text();

public TokenizerMapper() {

}

public void map(Object key, Text value, Mapper<Object, Text, Text, IntWritable>.Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while(itr.hasMoreTokens()) {

this.word.set(itr.nextToken());

context.write(this.word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public IntSumReducer() {

}

public void reduce(Text key, Iterable<IntWritable> values, Reducer<Text, IntWritable, Text, IntWritable>.Context context) throws IOException, InterruptedException {

int sum = 0;

IntWritable val;

for(Iterator i$ = values.iterator(); i$.hasNext(); sum += val.get()) {

val = (IntWritable)i$.next();

}

this.result.set(sum);

context.write(key, this.result);

}

}

}1.2 プログラムを実行し、[名前を付けて実行] > [Java アプリケーション]

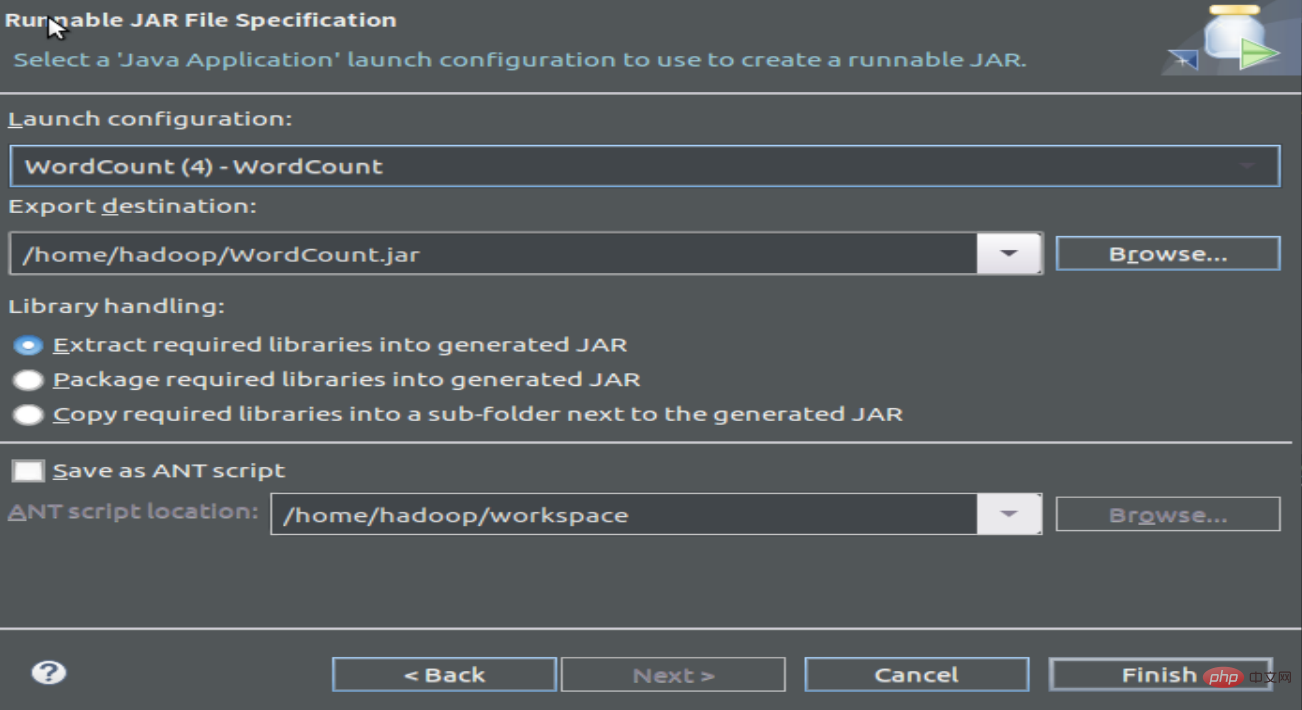

1.3 コンパイルします。 Jar ファイルを生成するプログラムをパッケージ化します

2 プログラムを実行します

2.1 単語の頻度をカウントするためのテキスト ファイルを作成します

wordfile1.txt

Spark Hadoop

Big Data

wordfile2.txt

Spark Hadoop

Big Cloud

2.2 HDF の開始新しい入力ファイル フォルダーを作成し、単語頻度ファイル

cd /usr/local/hadoop/

./sbin/start-dfs.sh

./ をアップロードします。 bin/hadoop fs -mkdir input

./bin/hadoop fs -put /home/hadoop/wordfile1.txt input

./bin/hadoop fs -put /home/hadoop/wordfile2 .txt input

2.3 アップロードされた単語頻度ファイルを表示します:

hadoop@dblab-VirtualBox:/usr/local/hadoop$ ./bin/hadoop fs -ls .

Found 2 items

drwxr-xr- x - hadoop スーパーグループ 0 2019-02-11 15:40 input

-rw-r--r-- 1 hadoop スーパーグループ 5 2019-02-10 20:22 test.txt

hadoop@dblab-VirtualBox: /usr/local/hadoop$ ./bin/hadoop fs -ls ./input

2 個のアイテムが見つかりました

-rw-r--r-- 1 つの hadoop スーパーグループ 27 2019- 02-11 15:40 input/wordfile1.txt

-rw-r--r-- 1 hadoop スーパーグループ 29 2019-02-11 15:40 input/wordfile2.txt

2.4 WordCount# を実行

##./bin /hadoop jar /home/hadoop/WordCount.jar 入力出力大量の情報が画面に入力されます その後、実行中のファイルを表示できます。結果:hadoop@dblab-VirtualBox: /usr/local/hadoop$ ./bin/hadoop fs -cat 出力/*Hadoop 2

Spark 2

以上がMapReduceの基本内容の紹介(コード付き)の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。