ホームページ >バックエンド開発 >Python チュートリアル >初心者向けの Python クローラー: クロール ジョーク

初心者向けの Python クローラー: クロール ジョーク

- 巴扎黑オリジナル

- 2017-06-23 16:28:581470ブラウズ

私は最近このブログで Python クローラーを学び始めました。ブロガーは Python バージョン 2.7 を使用していますが、互換性のない点がたくさんありますが、問題はありません。自分で変更してください。

Web サイトのコンテンツをフィルタリングして、興味のある部分だけを取得したいと考えています。たとえば、XX Web サイト上のポルノ画像をフィルタリングしてパッケージ化したいとします。ここでは、Baisi Bujie が書いたジョーク (プレーン テキスト) を例として、簡単な実装のみを行います。次の機能を実装したいと考えています:

複数ページの段落をローカルファイルに一括ダウンロード

任意のキーを押して次の段落の読み取りを開始します

1. Web ページのコードを取得します

インポートurllib は、Python 3 では次のように記述する必要があります: urllib的相关库,Python 3中应该这样写:

import urllib.requestimport urllib.parseimport re

re库是正则表达式(Regular Expression),后面作匹配时会用到。

百思不得姐的段子页面url ='http://www.budejie.com/text/1',这里末尾数字1代表此为第一页。通过以下代码就能返回网页内容。

req = urllib.request.Request(url)# 添加headers 使之看起来像浏览器在访问req.add_header('User-Agent', 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 ' '(KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36')

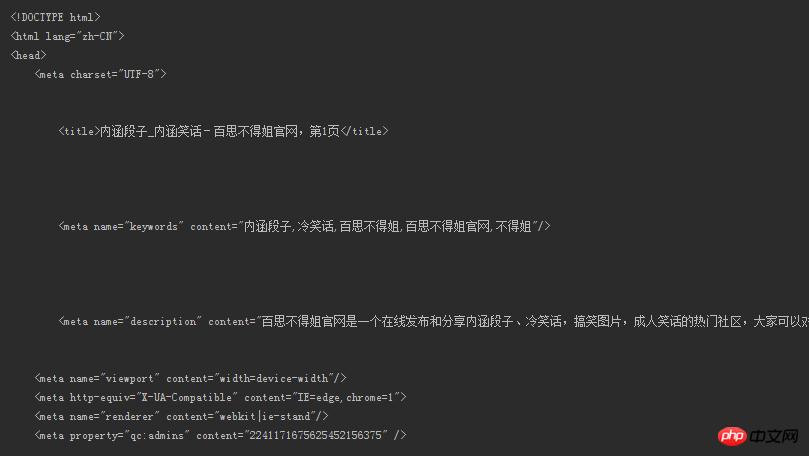

response = urllib.request.urlopen(req)# 得到网页内容,注意必须使用decode()解码html = response.read().decode('utf-8')print(html)的话,就是如下所示的内容:

这能看?段子呢?我们想要的段子呢?!

哦对了headers这样查看。

按F12,然后...看图吧

2. 正则匹配提取段子

要想筛选符合普通人阅读的内容(如果还带着html标签那还咋读是不),成功提取出段子,为此我们需要一些既定的模式去和网页全部内容进行匹配,将模式下匹配成功的对象返回。我们使用强大的正则表达式进行匹配(Regular Expression),相关语法可以看这里。

仅仅针对本例中的网页内容,先看看我们需要的段子对应了网页中的什么内容。

可以看到段子被5b0fad1dab3da7dcd513889256dead2f(我们要的内容)16b28748ea4df4d9c2150843fecfba68这样的标签所包围,只需要指定相应规则提取出来即可!上图可以看出段子正文前后是有很多空格的,需要匹配进去。

pattern = re.compile(r'<div class="j-r-list-c-desc">\s+(.*)\s+</div>') result = re.findall(pattern, html)

通过

re库的compile函数制定规则。

s+可以匹配一个或更多的空格

.匹配除开换行符n外的所有字符。

现在我们得到了匹配后的结果,来看下。

Bingo!提取出来了不是?!

可是我们发现里面还有些讨厌的df250b2156c434f3390392d09b1c9563。没关系,写几行代码的事。这里就不再展示去掉后的内容,自行脑补哈哈。

for each in content:# 如果某个段子里有<br />if '<br />' in each:# 替换成换行符并输出new_each = re.sub(r'<br />', '\n', each)print(new_each)# 没有就照常输出else:print(each)

这里

content是我们通过re.findall()返回的列表。

至此,我们成功得到我们想看的段子了!如果想要下载到本地呢?

3. 下载段子到本地

通过定义一个save()函数即可,num参数用户自定,想下载最近100页的内容都没问题!里面还有些变量没有提到,最后会给出源代码。

# num是指定网页页数def save(num):# 写方式打开一个文本,把获取的段子列表存放进去with open('a.txt', 'w', encoding='utf-8') as f:

text = get_content(num)# 和上面去掉<br />类似for each in text:if '<br />' in each:

new_each = re.sub(r'<br />', '\n', each)

f.write(new_each)else:

f.write(str(each) + '\n')下载到本地文档后如下图所示

4. 逐条读取段子

段子太多,琳琅满目。可我们只希望一条条阅读。通过按下键盘任意键可以切换到下一条,直到读取到最后一条程序才结束,或者通过设置一个退出键随时退出程序,比如设定qimport urllib.requestimport urllib.parseimport re

pattern = re.compile(r'

' in each:

new_each = re.sub(r'

', '\n', each)print(new_each)else:print(each)# 用户输入user_input = input()# 不区分大小写的q,输入则退出if user_input == 'q' or user_input == 'Q':break

Baidejie のジョーク ページ url ='http://www.budejie.com/text/1'、ここの最後の数字 1 は、これが最初のページであることを意味します。次のコードは、Web ページのコンテンツを返すことができます。

print(html)、内容は次のとおりです:

これを見てもらえますか?どこが冗談なの?私たちが望んでいるジョークはどこにあるのでしょうか? !

あ、ちなみにヘッダーはこんな感じです。 🎜🎜F12 を押して...写真を見てください🎜🎜 🎜🎜 🎜 2. ジョークを抽出するための定期的なマッチング 🎜🎜 一般の人が読むのに適したコンテンツをフィルタリングし (HTML タグがまだある場合、どうやって読み取ることができますか?)、ジョークを正常に抽出するには、いくつかの確立されたパターンが必要です。 Web ページのコンテンツ全体を照合する 照合を実行し、パターン内で正常に照合したオブジェクトを返します。一致には強力な正規表現を使用します (正規表現)。関連する構文はここにあります。 🎜🎜この例の Web ページのコンテンツについてのみ、必要な段落が Web ページ内のどのコンテンツに対応するかを最初に確認してみましょう。 🎜🎜

🎜🎜 🎜 2. ジョークを抽出するための定期的なマッチング 🎜🎜 一般の人が読むのに適したコンテンツをフィルタリングし (HTML タグがまだある場合、どうやって読み取ることができますか?)、ジョークを正常に抽出するには、いくつかの確立されたパターンが必要です。 Web ページのコンテンツ全体を照合する 照合を実行し、パターン内で正常に照合したオブジェクトを返します。一致には強力な正規表現を使用します (正規表現)。関連する構文はここにあります。 🎜🎜この例の Web ページのコンテンツについてのみ、必要な段落が Web ページ内のどのコンテンツに対応するかを最初に確認してみましょう。 🎜🎜 🎜🎜段落が

🎜🎜段落が d975839e8620e7e3f5560af3a59efb6d(必要なコンテンツ)16b28748ea4df4d9c2150843fecfba68 のようなタグで囲まれているため、対応するルールを指定するだけでそれを抽出できます。上の図からわかるように、段落のテキストの前後に多くのスペースがあり、それらを一致させる必要があります。 🎜🎜🎜rrreee🎜🎜🎜 re ライブラリの compile 関数を使用してルールを作成します。 🎜🎜🎜🎜s+ は 1 つ以上のスペースと一致します。 🎜🎜🎜🎜. は、改行文字 n を除くすべての文字と一致します。 🎜🎜🎜🎜🎜マッチング結果が得られたので、見てみましょう。 🎜🎜 🎜🎜ビンゴ!抽出されたんですよね? ! 🎜🎜しかし、この中には

🎜🎜ビンゴ!抽出されたんですよね? ! 🎜🎜しかし、この中には df250b2156c434f3390392d09b1c9563 という厄介な要素が含まれていることがわかりました。問題はありません。コードを数行書くだけです。削除されたコンテンツはここでは紹介しません。ご自身の判断で決めてください(笑)。 🎜🎜rrreee🎜🎜🎜ここで、content は、re.findall() を通じて返されるリストです。 🎜🎜🎜この時点で、私たちが見たいジョークを正常に取得しました!ローカルにダウンロードしたい場合はどうすればよいでしょうか? 🎜🎜3. ジョークをローカルにダウンロードします 🎜🎜 save() 関数を定義することで、num パラメーターはユーザー定義になります。最後の 100 ページです。言及されていない変数がいくつかあります。ソースコードは最後に記載されています。 🎜🎜rrreee🎜🎜ローカルドキュメントにダウンロードした後は以下のように🎜🎜 🎜 🎜4. ジョークを 1 つずつ読んでください 🎜🎜 ジョークが多すぎて、目もくらむような配列です。しかし、私たちはそれらを一つ一つ読んでいきたいと思っています。キーボードの任意のキーを押すと次の項目に切り替えることができ、最後の項目が読み取られるまでプログラムは終了しません。また、

🎜 🎜4. ジョークを 1 つずつ読んでください 🎜🎜 ジョークが多すぎて、目もくらむような配列です。しかし、私たちはそれらを一つ一つ読んでいきたいと思っています。キーボードの任意のキーを押すと次の項目に切り替えることができ、最後の項目が読み取られるまでプログラムは終了しません。また、 を設定するなど、終了キーを設定することでいつでもプログラムを終了できます。 q キーを押して終了します。 🎜コード全体をここに示します。 🎜🎜🎜rrreee🎜🎜 実演してみると、効果はこんな感じです。 🎜🎜🎜🎜🎜機能は非常に役に立ちませんが、初心者としては、それでも非常に満足していますので、興味がある場合のみ深く掘り下げることができます。クローラーはそれだけではなく、今後さらに高度な機能を学んでいきます。 🎜🎜🎜🎜by @sunhaiyu🎜🎜2016.8.15🎜以上が初心者向けの Python クローラー: クロール ジョークの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。