ホームページ >バックエンド開発 >Python チュートリアル >Python が Baidu Encyclopedia データをクロールする

Python が Baidu Encyclopedia データをクロールする

- 高洛峰オリジナル

- 2017-02-15 15:13:251464ブラウズ

クロール戦略

目標を決定する: どの Web サイトのどのページのデータのどの部分をクロールするかを決定します。この例では、Baidu Encyclopedia の Python エントリ ページと Python 関連のエントリ ページのタイトルと紹介をキャプチャします。

分析目標: クロールされる URL の形式を分析し、クロール範囲を制限します。キャプチャするデータの形式を分析する この例では、タイトルと紹介の 2 つのデータが配置されているタグの形式を分析する必要があります。クロールするページのエンコーディングの形式を分析する。正しい解析を実行するには、Web ページのパーサー セクションで Web ページのエンコーディングを指定する必要があります。

コードの記述: Web ページのパーサー部分では、ターゲットを分析して得られた結果が使用されます。

クローラーの実行: データキャプチャを実行します。

分析の目的

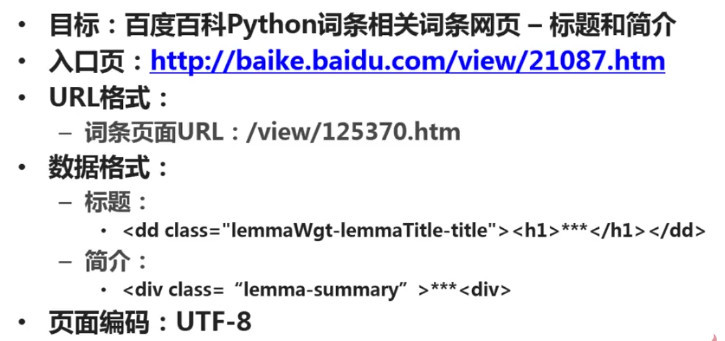

1. URL 形式

Baidu Encyclopedia の Python エントリ ページにアクセスします。ページ上の関連エントリへのリンクは、ほとんどが /view/xxx.htm です。 /view/xxx.htm。

2、数据格式

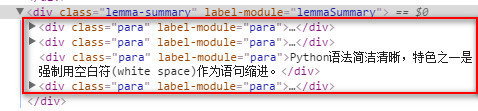

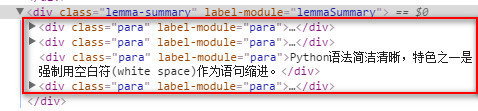

标题位于类lemmaWgt-lemmaTitle-title下的h1子标签,简介位于类lemma-summary下。

3、编码格式

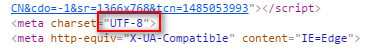

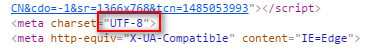

查看页面编码格式,为utf-8。

经过以上分析,得到结果如下:

代码编写

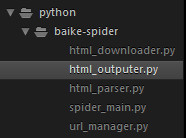

项目结构

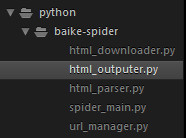

在sublime下,新建文件夹baike-spider,作为项目根目录。

新建spider_main.py,作为爬虫总调度程序。

新建url_manger.py,作为url管理器。

新建html_downloader.py,作为html下载器。

新建html_parser.py,作为html解析器。

新建html_outputer.py,作为写出数据的工具。

最终项目结构如下图:

spider_main.py

# coding:utf-8

import url_manager, html_downloader, html_parser, html_outputer

class SpiderMain(object):

def __init__(self):

self.urls = url_manager.UrlManager()

self.downloader = html_downloader.HtmlDownloader()

self.parser = html_parser.HtmlParser()

self.outputer = html_outputer.HtmlOutputer()

def craw(self, root_url):

count = 1

self.urls.add_new_url(root_url)

while self.urls.has_new_url():

try:

new_url = self.urls.get_new_url()

print('craw %d : %s' % (count, new_url))

html_cont = self.downloader.download(new_url)

new_urls, new_data = self.parser.parse(new_url, html_cont)

self.urls.add_new_urls(new_urls)

self.outputer.collect_data(new_data)

if count == 10:

break

count = count + 1

except:

print('craw failed')

self.outputer.output_html()

if __name__=='__main__':

root_url = 'http://baike.baidu.com/view/21087.htm'

obj_spider = SpiderMain()

obj_spider.craw(root_url)

url_manger.py

# coding:utf-8 class UrlManager(object): def __init__(self): self.new_urls = set() self.old_urls = set() def add_new_url(self, url): if url is None: return if url not in self.new_urls and url not in self.old_urls: self.new_urls.add(url) def add_new_urls(self, urls): if urls is None or len(urls) == 0: return for url in urls: self.add_new_url(url) def has_new_url(self): return len(self.new_urls) != 0 def get_new_url(self): new_url = self.new_urls.pop() self.old_urls.add(new_url) return new_url

html_downloader.py

# coding:utf-8 import urllib.request class HtmlDownloader(object): def download(self, url): if url is None: return None response = urllib.request.urlopen(url) if response.getcode() != 200: return None return response.read()

html_parser.py

# coding:utf-8

from bs4 import BeautifulSoup

import re

from urllib.parse import urljoin

class HtmlParser(object):

def _get_new_urls(self, page_url, soup):

new_urls = set()

# /view/123.htm

links = soup.find_all('a', href=re.compile(r'/view/\d+\.htm'))

for link in links:

new_url = link['href']

new_full_url = urljoin(page_url, new_url)

# print(new_full_url)

new_urls.add(new_full_url)

#print(new_urls)

return new_urls

def _get_new_data(self, page_url, soup):

res_data = {}

# url

res_data['url'] = page_url

# <dd class="lemmaWgt-lemmaTitle-title"> <h1>Python</h1>

title_node = soup.find('dd', class_='lemmaWgt-lemmaTitle-title').find('h1')

res_data['title'] = title_node.get_text()

# <p class="lemma-summary" label-module="lemmaSummary">

summary_node = soup.find('p', class_='lemma-summary')

res_data['summary'] = summary_node.get_text()

# print(res_data)

return res_data

def parse(self, page_url, html_cont):

if page_url is None or html_cont is None:

return

soup = BeautifulSoup(html_cont, 'html.parser')

# print(soup.prettify())

new_urls = self._get_new_urls(page_url, soup)

new_data = self._get_new_data(page_url, soup)

# print('mark')

return new_urls, new_data

html_outputer.py

# coding:utf-8

class HtmlOutputer(object):

def __init__(self):

self.datas = []

def collect_data(self, data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = open('output.html','w', encoding='utf-8')

fout.write('<html>')

fout.write('<body>')

fout.write('<table>')

for data in self.datas:

fout.write('<tr>')

fout.write('<td>%s</td>' % data['url'])

fout.write('<td>%s</td>' % data['title'])

fout.write('<td>%s</td>' % data['summary'])

fout.write('</tr>')

fout.write('</table>')

fout.write('</body>')

fout.write('</html>')

fout.close()

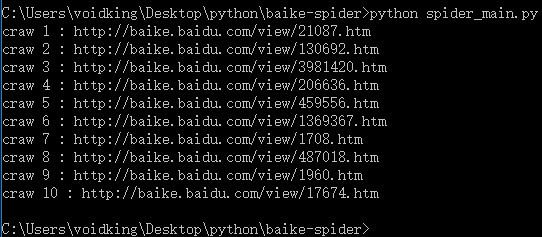

运行

在命令行下,执行python spider_main.py

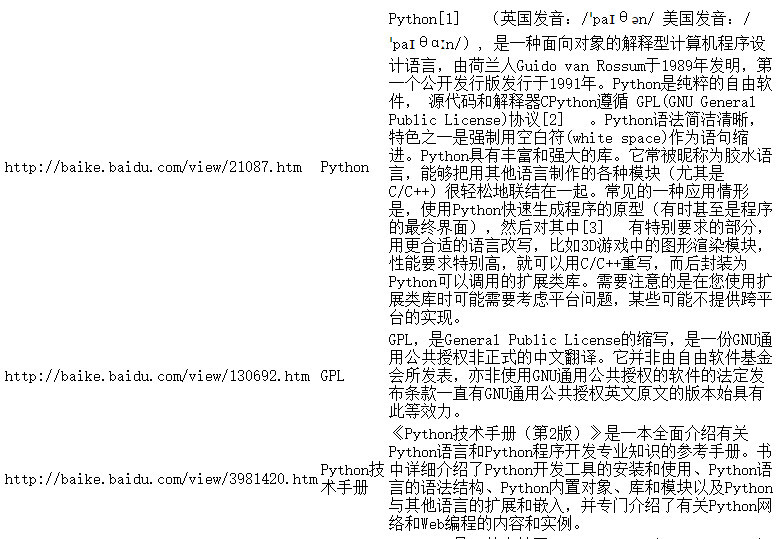

2. データ形式

タイトルはクラス lemmaWgt-lemmaTitle-title の下の h1 サブタグにあり、序文はクラス lemma-summary の下にあります。

3. エンコード形式

3. エンコード形式 ページのエンコード形式 (utf-8) を表示します。

上記の分析後の結果は次のとおりです:

コード作成

プロジェクト構造

クローラーのマスター スケジューラとして新しい Spider_main.py を作成します。

URL マネージャーとして新しい url_manger.py を作成します。 🎜HTML ダウンローダーとして新しい html_downloader.py を作成します。 🎜HTMLパーサーとして新しいhtml_parser.pyを作成します。 🎜データを書き込むためのツールとして新しい html_outputer.py を作成します。 🎜最終的なプロジェクト構造は以下のとおりです: 🎜 🎜🎜spider_main.py🎜

🎜🎜spider_main.py🎜fout = open('output.html','w')

fout.write(str)🎜url_manger.py🎜fout = open('output.html','w', encoding='utf-8')🎜html_downloader.py🎜rrreee🎜html_parser.py🎜rrreee🎜html_outputer。 py 🎜rrreee🎜Run🎜🎜 コマンドラインで、python Spider_main.py を実行します。 🎜🎜エンコーディングの問題🎜🎜問題の説明: UnicodeEncodeError: 'gbk' コーデックは位置の文字 'xa0' をエンコードできません...🎜🎜 Python を使用してファイルを書き込むとき、またはネットワーク データ ストリームをローカル ファイルに書き込むときに、この問題が発生しますほとんどの場合。この問題の解決方法に関する同様の記事がインターネット上にたくさんありますが、それらはエンコードとデコードにすぎません。これがこの問題の本当の原因でしょうか。いいえ。多くの場合、デコードとエンコードを使用し、utf8、utf-8、gbk、gb2312 などのさまざまなエンコードを試します。すべてのエンコードを試しましたが、依然としてエラーが発生し、イライラします。 🎜🎜Windows で Python スクリプトを書く場合、コーディングの問題は非常に深刻です。ネットワーク データ ストリームをファイルに書き込む場合、いくつかのエンコーディングが発生します: 🎜1. #encoding='XXX' 🎜 ここでのエンコーディング (つまり、Python ファイルの最初の行の内容) は、Python スクリプトのエンコーディングを指します。ファイル自体は関係ありません。 XXX のエンコードとファイル自体が同じであれば問題ありません。 🎜たとえば、notepad++の「フォーマット」メニューではさまざまなエンコードを設定できますが、このとき、メニューで設定したエンコードがXXXのエンコードと同じであることを確認する必要があります。異なる場合はエラーが報告されます。 。 🎜🎜2. ネットワーク データ ストリームのエンコーディング🎜 たとえば、Web ページを取得した場合、ネットワーク データ ストリームのエンコーディングが Web ページのエンコーディングになります。 Unicode エンコードにデコードするには、デコードを使用する必要があります。 🎜🎜3. ターゲット ファイルのエンコーディング🎜 ネットワーク データ ストリームを新しいファイルに書き込みます。ファイル書き込みコードは次のとおりです:🎜rrreee🎜 Windows では、新しいファイルのデフォルトのエンコーディングは gbk であり、Python インタープリターは gbk を使用します。ネットワーク データ ストリーム str を解析するためのエンコーディングですが、str はデコードされた Unicode エンコーディングであるため、解析に失敗し、上記の問題が発生します。 解決策は、ターゲット ファイルのエンコーディングを変更することです: 🎜fout = open('output.html','w', encoding='utf-8')

运行结果

更多Python抓取百度百科数据 相关文章请关注PHP中文网!