Maison >Périphériques technologiques >IA >Mise à niveau open source complète d'Open-Sora : prend en charge la génération vidéo 16 s et la résolution 720p

Mise à niveau open source complète d'Open-Sora : prend en charge la génération vidéo 16 s et la résolution 720p

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2024-04-25 14:55:141089parcourir

Open-Sora a été discrètement mis à jour dans la communauté open source. Il prend désormais en charge la génération de vidéos jusqu'à 16 secondes, avec des résolutions allant jusqu'à 720p, et peut gérer n'importe quel rapport hauteur/largeur de texte à image, texte à vidéo, image à vidéo. , Vidéo vers vidéo et besoins de génération vidéo de longueur infinie. Essayons-le.

Générez une scène de neige de Noël sur écran horizontal, publiez-la sur le site B

puis créez un écran vertical, tweetez

et générez également une vidéo de 16 secondes, maintenant tout le monde Comment jouer si vous êtes accro à l'écriture de scénarios ? Conseils

GitHub : https://github.com/hpcaitech/Open-Sora

Ce qui est encore plus cool, c'est qu'Open-Sora est toujours entièrement open source, y comprisla dernière architecture de modèle, les derniers poids de modèle, et plus encore Le processus de formation temps/résolution/rapport hauteur/largeur/fréquence d'images, le processus complet de collecte et de prétraitement des données, tous les détails de la formation, des exemples de démonstration

et untutoriel détaillé de démarrage. Interprétation complète du rapport technique d'Open-Sora

Aperçu des dernières fonctionnalités

L'équipe d'auteur a officiellement publié le rapport technique d'Open-Sora [1] sur GitHub selon la compréhension de l'auteur. , cette mise à jour comprend principalement les fonctionnalités clés suivantes :

Prend en charge la génération de vidéos longues ;

- Résolution de génération vidéo jusqu'à 720p

- Un seul modèle prend en charge le texte dans n'importe quel rapport d'aspect, différentes résolutions et durées. Besoins en matière de génération d'images, de texte en vidéo, d'image en vidéo, de vidéo en vidéo et de longueur infinie ;

- Propose une conception d'architecture de modèle plus stable qui prend en charge l'entraînement multi-temps/résolution/rapport d'aspect/fréquence d'images ;

- Le dernier processus de traitement automatique des données est open source.

- Modèle de diffusion spatio-temporelle ST-DiT-2

L'équipe d'auteurs a déclaré avoir apporté des améliorations clés à l'architecture STDiT dans Open-Sora 1.0, dans le but d'améliorer la stabilité de l'entraînement et les performances globales. du modèle. Pour la tâche actuelle de prédiction de séquence, l’équipe a adopté les meilleures pratiques des grands modèles de langage (LLM) et a remplacé le codage positionnel sinusoïdal dans l’attention temporelle par le codage positionnel rotationnel plus efficace (intégration RoPE). De plus, afin d'améliorer la stabilité de la formation, ils se sont référés à l'architecture du modèle SD3 et ont introduit en outre la technologie de normalisation QK pour améliorer la stabilité de la formation de demi-précision. Afin de prendre en charge les exigences de formation de plusieurs résolutions, différents formats d'image et fréquences d'images, l'architecture ST-DiT-2 proposée par l'équipe de l'auteur peut automatiquement mettre à l'échelle le codage de position et gérer des entrées de différentes tailles.

Entraînement en plusieurs étapes

Selon le rapport technique d'Open-Sora, Open-Sora adopte une méthode d'entraînement en plusieurs étapes, et chaque étape continuera l'entraînement en fonction du poids de l'étape précédente. Par rapport à la formation en une seule étape, cette formation en plusieurs étapes atteint plus efficacement l'objectif de génération vidéo de haute qualité en introduisant les données étape par étape.

Dans la phase initiale, la plupart des vidéos utilisent une résolution de 144p et sont mélangées avec des images et des vidéos de 240p et 480p pour la formation. La formation dure environ 1 semaine, avec une taille totale de pas de 81k. Dans la deuxième étape, la résolution de la plupart des données vidéo est augmentée à 240p et 480p, la durée d'entraînement est de 1 jour et la taille du pas atteint 22k. La troisième étape a été encore améliorée à 480p et 720p, la durée de l'entraînement était de 1 jour et l'entraînement de 4 000 pas a été terminé. L'ensemble du processus de formation en plusieurs étapes a été achevé en 9 jours environ. Par rapport à Open-Sora1.0, la qualité de la génération vidéo a été améliorée dans plusieurs dimensions.

Cadre unifié image-vidéo/vidéo-vidéo

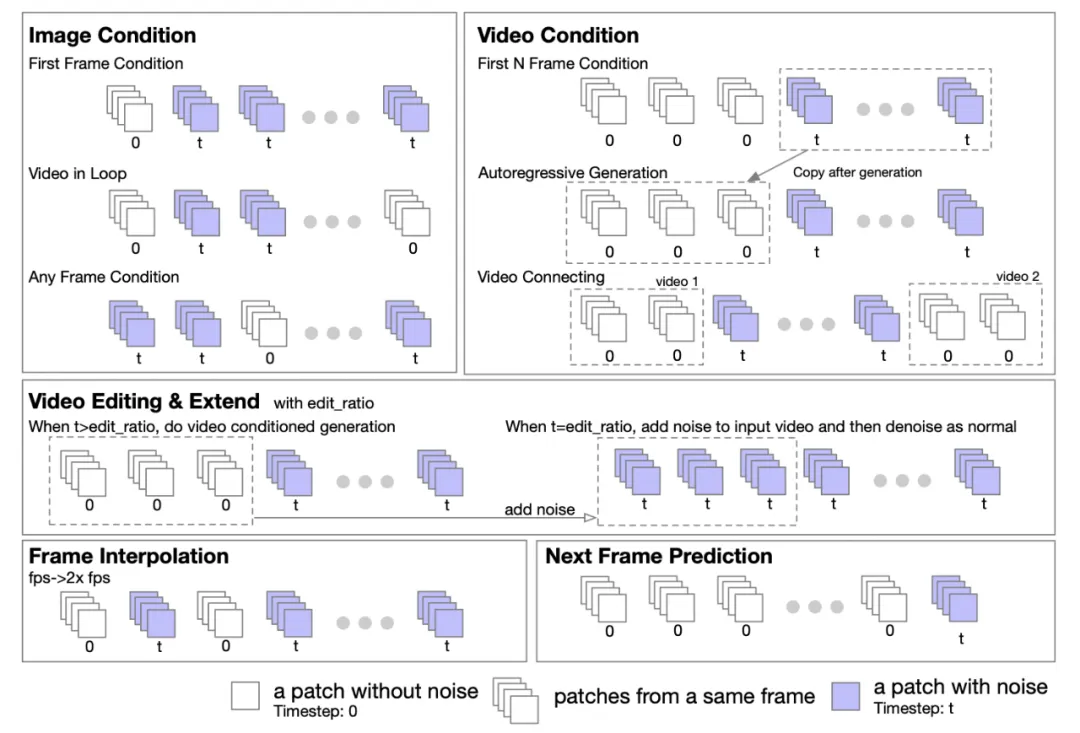

L'équipe d'auteurs a déclaré que, sur la base des caractéristiques de Transformer, l'architecture DiT peut être facilement étendue pour prendre en charge l'image à l'image et tâches vidéo à vidéo. Ils ont proposé une stratégie de masquage pour prendre en charge le traitement conditionnel des images et des vidéos. En définissant différents masques, diverses tâches de génération peuvent être prises en charge, notamment : vidéo graphique, vidéo en boucle, extension vidéo, génération vidéo autorégressive, connexion vidéo, montage vidéo, insertion de trames, etc.

Soutien à la stratégie de masquage pour le traitement conditionnel d'images et de vidéos

L'équipe d'auteurs a déclaré qu'en s'inspirant de la méthode UL2[2], ils ont introduit une stratégie de masquage aléatoire dans la phase de formation du modèle. Plus précisément, les trames masquées sont sélectionnées et démasquées de manière aléatoire pendant le processus d'apprentissage, y compris, mais sans s'y limiter, le démasquage de la première trame, des k premières trames, des k trames suivantes, des k trames éventuelles, etc. Les auteurs nous ont également révélé que, sur la base d'expériences avec Open-Sora 1.0, en appliquant la stratégie de masquage avec une probabilité de 50 %, le modèle peut mieux apprendre à gérer le conditionnement d'images avec seulement un petit nombre d'étapes. Dans la dernière version d'Open-Sora, ils ont adopté une méthode de pré-entraînement à partir de zéro utilisant une stratégie de masquage.

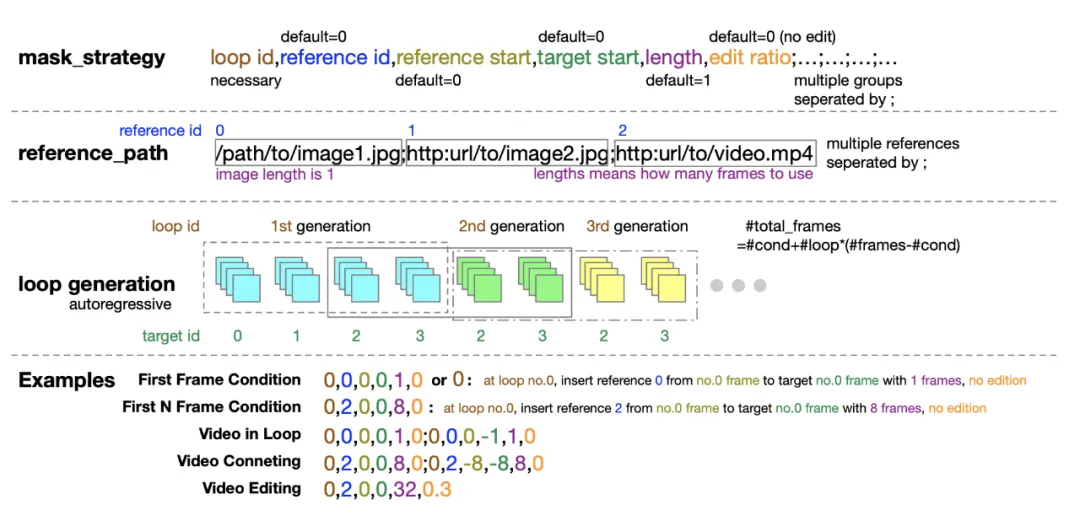

De plus, l'équipe d'auteurs fournit également un guide détaillé pour la configuration de la stratégie de masquage pour l'étape d'inférence. La forme tuple de cinq nombres offre une grande flexibilité et un grand contrôle lors de la définition de la stratégie de masquage.

Instructions de configuration de la politique de masque

Prend en charge l'entraînement multi-temps/résolution/rapport d'aspect/fréquence d'images

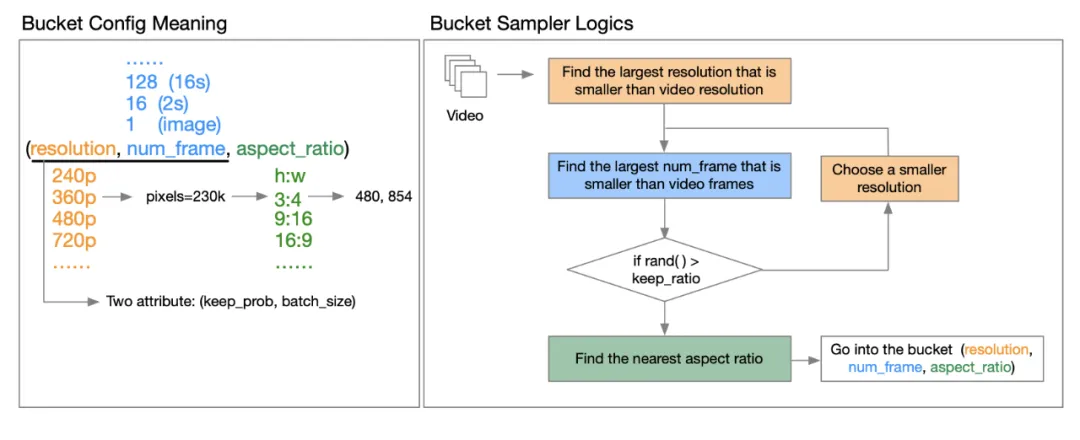

Le rapport technique d'OpenAI Sora [3] a souligné que l'utilisation de la formation vidéo originale avec la résolution, le rapport hauteur/largeur et la longueur peuvent augmenter la flexibilité de l’échantillonnage et améliorer le cadrage et la composition. À cet égard, l’équipe des auteurs a proposé une stratégie de regroupement.

Comment le mettre en œuvre concrètement ? Grâce à une lecture approfondie du rapport technique publié par l'auteur, nous avons appris que ce qu'on appelle le bucket est un triplet de (résolution, nombre d'images, rapport hauteur/largeur). L'équipe a prédéfini une gamme de formats d'image pour les vidéos à différentes résolutions afin de couvrir les types de formats vidéo les plus courants. Avant le début de chaque époque du cycle de formation, ils remanient l'ensemble de données et attribuent les échantillons aux compartiments correspondants en fonction de leurs caractéristiques. Plus précisément, ils placent chaque échantillon dans un compartiment dont la résolution et la longueur d'image sont inférieures ou égales à cette fonctionnalité vidéo.

Stratégie de bucketing Open-Sora

L'équipe d'auteur a en outre révélé que afin de réduire les besoins en ressources informatiques, ils ont introduit deux attributs (résolution, nombre d'images) pour chaque keep_prob et batch_size afin de réduire Calculez les coûts et mettez en œuvre une formation en plusieurs étapes. De cette façon, ils peuvent contrôler le nombre d'échantillons dans différents compartiments et équilibrer la charge du GPU en recherchant une bonne taille de lot pour chaque compartiment. L'auteur développe cela dans le rapport technique. Les amis intéressés peuvent lire le rapport technique publié par l'auteur sur GitHub pour obtenir plus d'informations : https://github.com/hpcaitech/Open-Sora

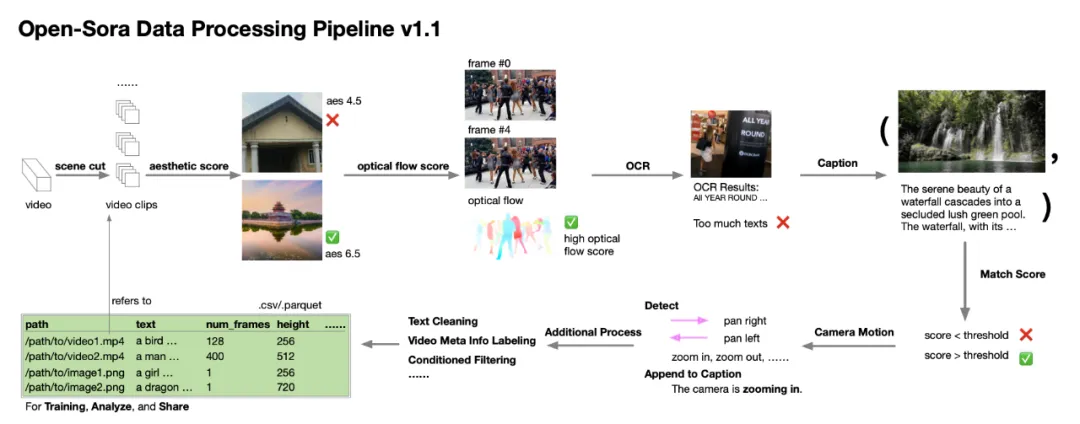

Collecte de données et pré-analyse. -processus de traitement

L'équipe d'auteurs fournit même des conseils détaillés sur la collecte et le traitement des données. Selon l'explication de l'auteur dans le rapport technique, au cours du processus de développement d'Open-Sora 1.0, ils ont réalisé que la quantité et la qualité des données sont extrêmement critiques pour cultiver un modèle performant, ils se sont donc consacrés à l'expansion et à l'optimisation des données. ensemble. Ils ont établi un processus de traitement automatisé des données qui suit le principe de décomposition en valeurs singulières (SVD) et couvre la segmentation des scènes, le traitement des sous-titres, la notation et le filtrage de la diversité, ainsi que le système de gestion et la spécification de l'ensemble de données. De même, ils partagent de manière désintéressée des scripts liés au traitement des données avec la communauté open source. Les développeurs intéressés peuvent désormais utiliser ces ressources, combinées à des rapports techniques et du code, pour traiter et optimiser efficacement leurs propres ensembles de données.

Processus de traitement des données Open-Sora

Évaluation complète des performances d'Open-Sora

Affichage des effets de génération vidéo

Le point culminant le plus accrocheur d'Open-Sora est que il Il peut capturer et transformer la scène dans votre esprit en une vidéo animée grâce à une description textuelle. Les images et les imaginations qui vous traversent l’esprit peuvent désormais être enregistrées de manière permanente et partagées avec d’autres. Ici, l’auteur a essayé plusieurs invites différentes comme point de départ.

Par exemple, l'auteur a essayé de générer une vidéo de visite d'une forêt en hiver. Peu de temps après que la neige soit tombée, les pins étaient recouverts de neige blanche. Des aiguilles de pin sombres et des flocons de neige blancs étaient dispersés en couches claires.

Ou, par une nuit calme, vous êtes dans une forêt sombre comme celle décrite dans d'innombrables contes de fées, avec le lac profond scintille sous les étoiles brillantes partout dans le ciel.

La vue nocturne de l'île animée depuis les airs est encore plus belle. Les lumières jaunes chaudes et l'eau bleue en forme de ruban attirent les gens dans le temps tranquille des vacances.

Le trafic intense de la ville, les immeubles de grande hauteur et les magasins de rue encore allumés tard dans la nuit ont une saveur différente.

En plus des décors, Open-Sora peut également restaurer diverses créatures naturelles. Qu'il s'agisse d'une fleur rouge vif,

ou d'un caméléon tournant lentement la tête, Open-Sora peut générer des vidéos plus réalistes.

L'auteur a également essayé une variété de tests rapides et a fourni de nombreuses vidéos générées pour votre référence, y compris différents contenus, différentes résolutions, différents formats d'image et différentes durées. L'auteur a également découvert qu'avec une seule commande simple, Open-Sora peut générer des clips vidéo multi-résolution, brisant complètement les limites de la créativité.

Résolution : 16*240p

Résolution : 16*240p

Résolution : 64*360p

Résolution : 480 *854p

Nous pouvons également alimenter Open-Sora avec une image statique pour générer une courte vidéo

Open-Sora peut également connecter intelligemment deux images statiques. Appuyez sur la vidéo ci-dessous pour vous faire découvrir la lumière et l'ombre changeantes de l'après-midi au crépuscule. Chaque image est un poème du temps.

Pour un autre exemple, si nous voulons éditer la vidéo originale, avec juste une simple commande, la forêt initialement lumineuse a inauguré de fortes chutes de neige.

Nous pouvons également utiliser Open-Sora pour générer des images haute définition

C'est à noter que les poids du modèle Open-Sora sont déjà entièrement gratuit Il est public sur leur communauté open source, vous pouvez donc aussi bien le télécharger et l'essayer. Puisqu'ils prennent également en charge la fonction de collage vidéo, cela signifie que vous avez la possibilité de créer gratuitement une nouvelle avec une histoire pour concrétiser votre créativité.

Adresse de téléchargement du poids : https://github.com/hpcaitech/Open-Sora

Limites actuelles et projets futurs

Bien que de bons résultats aient été obtenus dans la reproduction de modèles vidéo Vincent de type Sora, les progrès ont été réalisé, mais l'équipe d'auteur souligne également humblement que les vidéos actuellement générées doivent encore être améliorées sur de nombreux aspects : notamment les problèmes de bruit pendant le processus de génération, le manque de cohérence temporelle, la mauvaise qualité de génération des personnages et les faibles scores esthétiques. Concernant ces défis, l'équipe d'auteurs a déclaré qu'elle donnerait la priorité à leur résolution lors du développement de la prochaine version afin d'atteindre des normes de génération vidéo plus élevées. Les amis intéressés souhaiteront peut-être continuer à y prêter attention. Nous attendons avec impatience la prochaine surprise que la communauté Open-Sora nous apportera.

Adresse Open source : https://github.com/hpcaitech/Open-Sora

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!