Périphériques technologiques

Périphériques technologiques IA

IA Article très bien noté CVPR 2024 : Nouveau cadre d'édition générative GenN2N, unifiant les tâches de conversion NeRF

Article très bien noté CVPR 2024 : Nouveau cadre d'édition générative GenN2N, unifiant les tâches de conversion NeRFArticle très bien noté CVPR 2024 : Nouveau cadre d'édition générative GenN2N, unifiant les tâches de conversion NeRF

La rubrique AIxiv de notre site Web est une rubrique sur le contenu académique et technique. Au cours des dernières années, la rubrique AIxiv de notre site Web a reçu plus de 2 000 contenus, couvrant les meilleurs laboratoires de grandes universités et entreprises du monde entier, contribuant ainsi à promouvoir les échanges et la diffusion académiques. Si vous souhaitez partager un excellent travail, n'hésitez pas à contribuer ou à nous contacter pour un rapport. L'adresse e-mail de soumission est liyazhou@jiqizhixin.com ; zhaoyunfeng@jiqizhixin.com.

Adresse papier : https://arxiv.org/abs/2404.02788 Page d'accueil papier : https://xiangyueliu.github.io/GenN2N/ Git Adresse du hub : https://github.com/Lxiangyue/GenN2N Titre de l'article : GenN2N : Generative NeRF2NeRF Translation

Dans la partie centrale de GenN2N, 1) le cadre génératif de 3D VAE-GAN est introduit, en utilisant VAE pour représenter l'ensemble de l'espace d'édition afin d'apprendre toutes les distributions d'édition NeRF 3D possibles correspondant à un ensemble d'images d'édition 2D d'entrée , et utilisez GAN pour fournir une supervision raisonnable pour l'édition de différentes vues de NeRF afin de garantir l'authenticité des résultats de l'édition 2) Utiliser l'apprentissage contrastif pour découpler le contenu d'édition et les perspectives afin de garantir la cohérence de l'édition du contenu entre les différentes perspectives 3) Pendant l'inférence. , l'utilisateur échantillonne simplement au hasard plusieurs codes d'édition à partir du modèle de génération conditionnelle peut générer divers résultats d'édition 3D correspondant à la cible d'édition.

Par rapport aux méthodes SOTA pour diverses tâches d'édition NeRF (ICCV2023 Oral, etc.), GenN2N est supérieure aux méthodes existantes en termes de qualité d'édition, de diversité, d'efficacité, etc.

Nous effectuons d'abord l'édition d'images 2D, puis mettons à niveau ces modifications 2D vers NeRF 3D pour obtenir une conversion générative NeRF en NeRF.

(échantillon négatif) ou l'image modifiée

(échantillon négatif) ou l'image modifiée  (échantillon positif) dans les données d'entraînement, nous sélectionnons une image modifiée

(échantillon positif) dans les données d'entraînement, nous sélectionnons une image modifiée  de la même perspective à partir des données d'entraînement comme condition, ce qui empêche le Le discriminateur n'est pas gêné par des facteurs de perspective lors de la distinction des échantillons positifs et négatifs.

de la même perspective à partir des données d'entraînement comme condition, ce qui empêche le Le discriminateur n'est pas gêné par des facteurs de perspective lors de la distinction des échantillons positifs et négatifs.  B

B  Expériences de comparaison

Expériences de comparaison  Notre méthode est comparée qualitativement et quantitativement à SO. Méthodes TA pour diverses tâches NeRF spécifiques ( y compris l'édition basée sur le texte, la colorisation, la super-résolution et l'inpainting, etc.). Les résultats montrent que GenN2N, en tant que cadre général, fonctionne aussi bien ou mieux que SOTA spécifique à une tâche, tandis que les résultats d'édition ont une plus grande diversité (ce qui suit est une comparaison entre GenN2N et Instruct-NeRF2NeRF sur la tâche d'édition NeRF basée sur du texte. ).

Notre méthode est comparée qualitativement et quantitativement à SO. Méthodes TA pour diverses tâches NeRF spécifiques ( y compris l'édition basée sur le texte, la colorisation, la super-résolution et l'inpainting, etc.). Les résultats montrent que GenN2N, en tant que cadre général, fonctionne aussi bien ou mieux que SOTA spécifique à une tâche, tandis que les résultats d'édition ont une plus grande diversité (ce qui suit est une comparaison entre GenN2N et Instruct-NeRF2NeRF sur la tâche d'édition NeRF basée sur du texte. ).

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Les dangers cachés du déploiement interne de l'IA: lacunes de gouvernance et risques catastrophiquesApr 28, 2025 am 11:12 AM

Les dangers cachés du déploiement interne de l'IA: lacunes de gouvernance et risques catastrophiquesApr 28, 2025 am 11:12 AMLe déploiement interne non contrôlé des systèmes d'IA avancés présente des risques importants, selon un nouveau rapport d'Apollo Research. Ce manque de surveillance, répandu parmi les grandes entreprises d'IA, permet des résultats catastrophiques potentiels, allant de peu

Construire le polygraphe AIApr 28, 2025 am 11:11 AM

Construire le polygraphe AIApr 28, 2025 am 11:11 AMLes détecteurs de mensonges traditionnels sont dépassés. S'appuyant sur le pointeur connecté par le bracelet, un détecteur de mensonge qui imprime les signes vitaux et les réactions physiques du sujet n'est pas précis pour identifier les mensonges. C'est pourquoi les résultats de détection de mensonge ne sont généralement pas adoptés par le tribunal, bien que cela ait conduit à de nombreuses personnes innocentes emprisonnées. En revanche, l'intelligence artificielle est un puissant moteur de données, et son principe de travail est d'observer tous les aspects. Cela signifie que les scientifiques peuvent appliquer l'intelligence artificielle aux applications qui recherchent la vérité de diverses manières. Une approche consiste à analyser les réponses des signes vitaux de la personne interrogée comme un détecteur de mensonge, mais avec une analyse comparative plus détaillée et précise. Une autre approche consiste à utiliser le balisage linguistique pour analyser ce que les gens disent réellement et utiliser la logique et le raisonnement. Comme le dit le dicton, un mensonge engendre un autre mensonge, et finalement

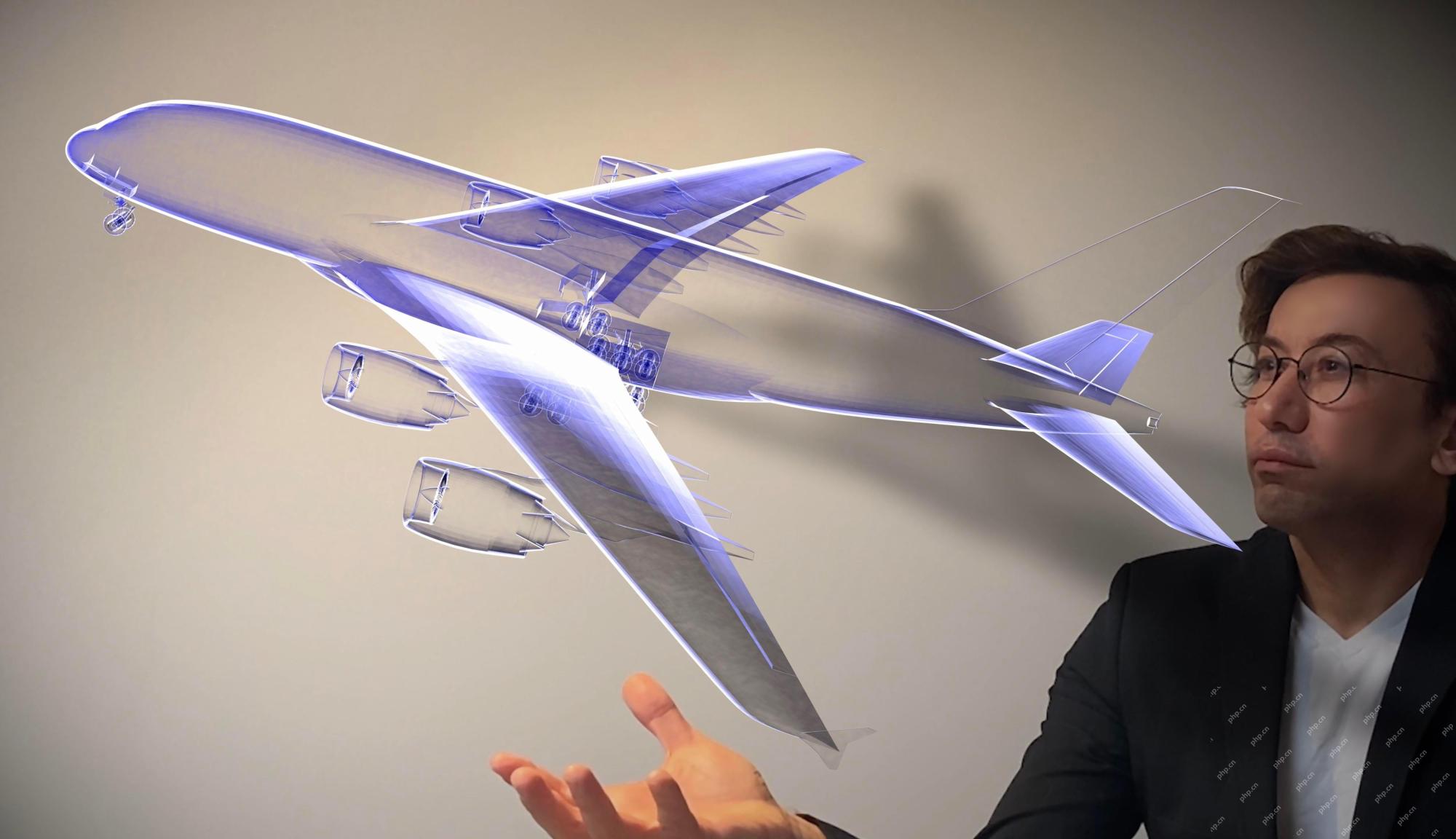

L'IA est-elle autorisée pour le décollage dans l'industrie aérospatiale?Apr 28, 2025 am 11:10 AM

L'IA est-elle autorisée pour le décollage dans l'industrie aérospatiale?Apr 28, 2025 am 11:10 AML'industrie aérospatiale, pionnière de l'innovation, tire parti de l'IA pour relever ses défis les plus complexes. La complexité croissante de l'Aviation moderne nécessite l'automatisation de l'IA et les capacités d'intelligence en temps réel pour une sécurité améliorée, un fonctionnement réduit

Regarder la course de robot de printemps de PékinApr 28, 2025 am 11:09 AM

Regarder la course de robot de printemps de PékinApr 28, 2025 am 11:09 AMLe développement rapide de la robotique nous a apporté une étude de cas fascinante. Le robot N2 de Noetix pèse plus de 40 livres et mesure 3 pieds de haut et pourrait être en mesure de se retourner. Le robot G1 de Uniree pèse environ deux fois la taille du N2 et mesure environ 4 pieds de haut. Il existe également de nombreux petits robots humanoïdes qui participent à la compétition, et il y a même un robot qui est poussé par un fan. Interprétation des données Le demi-marathon a attiré plus de 12 000 spectateurs, mais seulement 21 robots humanoïdes ont participé. Bien que le gouvernement ait souligné que les robots participants ont mené une "formation intensive" avant le concours, tous les robots n'ont pas terminé l'ensemble de la compétition. Champion - Tiangong Ult développé par Pékin Humanoid Robot Innovation Center

Le piège miroir: l'éthique de l'IA et l'effondrement de l'imagination humaineApr 28, 2025 am 11:08 AM

Le piège miroir: l'éthique de l'IA et l'effondrement de l'imagination humaineApr 28, 2025 am 11:08 AML'intelligence artificielle, dans sa forme actuelle, n'est pas vraiment intelligente; Il est apte à imiter et à affiner les données existantes. Nous ne créons pas de l'intelligence artificielle, mais plutôt une inférence artificielle - qui traite qui traitent les informations, tandis que les humains

La nouvelle fuite Google révèle la mise à jour des fonctionnalités de Google PhotosApr 28, 2025 am 11:07 AM

La nouvelle fuite Google révèle la mise à jour des fonctionnalités de Google PhotosApr 28, 2025 am 11:07 AMUn rapport a révélé qu'une interface mise à jour était masquée dans le code de Google Photos Android version 7.26, et chaque fois que vous visualisez une photo, une rangée de miniatures de visage nouvellement détectées s'affiche en bas de l'écran. Les nouvelles miniatures faciales manquent de balises de nom, donc je soupçonne que vous devez cliquer sur eux individuellement pour voir plus d'informations sur chaque personne détectée. Pour l'instant, cette fonctionnalité ne fournit aucune information autre que les personnes que Google Photos a trouvées dans vos images. Cette fonctionnalité n'est pas encore disponible, nous ne savons donc pas comment Google l'utilisera avec précision. Google peut utiliser des miniatures pour accélérer la recherche de plus de photos de personnes sélectionnées, ou peut être utilisée à d'autres fins, comme la sélection de l'individu à modifier. Attendons et voyons. Pour l'instant

Guide du renforcement Finetuning - Analytics VidhyaApr 28, 2025 am 09:30 AM

Guide du renforcement Finetuning - Analytics VidhyaApr 28, 2025 am 09:30 AMLe renforcement de la fintuning a secoué le développement de l'IA en enseignant les modèles à s'ajuster en fonction de la rétroaction humaine. Il mélange des fondations d'apprentissage supervisées avec des mises à jour basées sur la récompense pour les rendre plus sûres, plus précises et vraiment aider

Dançon: mouvement structuré pour affiner nos filets neuronaux humainsApr 27, 2025 am 11:09 AM

Dançon: mouvement structuré pour affiner nos filets neuronaux humainsApr 27, 2025 am 11:09 AMLes scientifiques ont largement étudié les réseaux de neurones humains et plus simples (comme ceux de C. elegans) pour comprendre leur fonctionnalité. Cependant, une question cruciale se pose: comment adapter nos propres réseaux de neurones pour travailler efficacement aux côtés de nouvelles IA

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Adaptateur de serveur SAP NetWeaver pour Eclipse

Intégrez Eclipse au serveur d'applications SAP NetWeaver.

SublimeText3 version anglaise

Recommandé : version Win, prend en charge les invites de code !

MantisBT

Mantis est un outil Web de suivi des défauts facile à déployer, conçu pour faciliter le suivi des défauts des produits. Cela nécessite PHP, MySQL et un serveur Web. Découvrez nos services de démonstration et d'hébergement.

DVWA

Damn Vulnerable Web App (DVWA) est une application Web PHP/MySQL très vulnérable. Ses principaux objectifs sont d'aider les professionnels de la sécurité à tester leurs compétences et leurs outils dans un environnement juridique, d'aider les développeurs Web à mieux comprendre le processus de sécurisation des applications Web et d'aider les enseignants/étudiants à enseigner/apprendre dans un environnement de classe. Application Web sécurité. L'objectif de DVWA est de mettre en pratique certaines des vulnérabilités Web les plus courantes via une interface simple et directe, avec différents degrés de difficulté. Veuillez noter que ce logiciel

Listes Sec

SecLists est le compagnon ultime du testeur de sécurité. Il s'agit d'une collection de différents types de listes fréquemment utilisées lors des évaluations de sécurité, le tout en un seul endroit. SecLists contribue à rendre les tests de sécurité plus efficaces et productifs en fournissant facilement toutes les listes dont un testeur de sécurité pourrait avoir besoin. Les types de listes incluent les noms d'utilisateur, les mots de passe, les URL, les charges utiles floues, les modèles de données sensibles, les shells Web, etc. Le testeur peut simplement extraire ce référentiel sur une nouvelle machine de test et il aura accès à tous les types de listes dont il a besoin.