Périphériques technologiques

Périphériques technologiques IA

IA Anything in Any Scene : Insertion d'objets réalistes (pour aider à la synthèse de diverses données de conduite)

Anything in Any Scene : Insertion d'objets réalistes (pour aider à la synthèse de diverses données de conduite)Titre original : Anything in Any Scene : Photorealistic Video Object Insertion

Lien papier : https://arxiv.org/pdf/2401.17509.pdf

Lien code : https://github.com/AnythingInAnyScene/anything_in_anyscene

Affiliation de l'auteur : Xpeng Motors

Idée de thèse

La simulation vidéo réaliste a montré un grand potentiel dans divers domaines d'application, de la réalité virtuelle à la production cinématographique. Surtout lorsque la capture vidéo dans le monde réel est peu pratique ou coûteuse. Les méthodes existantes de simulation vidéo ne parviennent souvent pas à modéliser avec précision les environnements d'éclairage, à représenter la géométrie des objets ou à atteindre des niveaux élevés de photoréalisme. Cet article propose Anything in Any Scene, un cadre de simulation vidéo réelle novateur et polyvalent qui peut insérer de manière transparente n'importe quel objet dans des vidéos dynamiques existantes et mettre l'accent sur le réalisme physique. Le cadre global proposé dans cet article contient trois processus clés : 1) intégrer des objets réels dans une scène vidéo donnée et les placer dans des emplacements appropriés pour garantir le réalisme géométrique ; 2) estimer la distribution de l'éclairage du ciel et de l'environnement et simuler des ombres réelles et améliorer le réalisme de la lumière ; 3) Utilisez un réseau de transfert de style pour affiner la sortie vidéo finale afin de maximiser le réalisme photo. Cet article prouve expérimentalement que le framework Anything in Any Scene peut générer des vidéos de simulation avec un excellent réalisme géométrique, réalisme d'éclairage et réalisme photo. En atténuant considérablement les défis associés à la génération de données vidéo, notre cadre fournit une solution efficace et rentable pour obtenir des vidéos de haute qualité. De plus, ses applications s'étendent bien au-delà de l'amélioration des données vidéo, montrant un potentiel prometteur dans la réalité virtuelle, le montage vidéo et diverses autres applications centrées sur la vidéo.

Contribution principale

Cet article présente un cadre de simulation vidéo novateur et extensible Anything in Any Scene, capable d'intégrer n'importe quel objet dans n'importe quelle vidéo de scène dynamique.

Cet article est structuré de manière unique et se concentre sur le maintien de la géométrie, de l'éclairage et du photoréalisme dans les simulations vidéo afin de garantir une haute qualité et l'authenticité des résultats de sortie.

Après une vérification approfondie, les résultats montrent que le framework a la capacité de produire des simulations vidéo très réalistes, élargissant ainsi considérablement la portée d'application et le potentiel de développement de ce domaine.

Conception de thèse

Les simulations d'images et de vidéos sont utilisées avec succès dans une variété d'applications allant de la réalité virtuelle à la production cinématographique. La capacité de générer un contenu visuel diversifié et de haute qualité grâce à la simulation d’images et de vidéos photoréalistes a le potentiel de faire progresser ces domaines, en introduisant de nouvelles possibilités et applications. Même si l’authenticité des images et des vidéos capturées dans le monde réel est inestimable, elles sont souvent limitées par des distributions à longue traîne. Cela conduit à une surreprésentation des scénarios courants et à une sous-représentation de situations rares mais critiques, ce qui présente un défi connu sous le nom de problème de non-distribution. Les méthodes traditionnelles permettant de remédier à ces limitations via la capture et le montage vidéo se sont révélées peu pratiques ou d'un coût prohibitif, car il était difficile de couvrir tous les scénarios possibles. L'importance de la simulation vidéo, notamment en intégrant des vidéos existantes avec des objets nouvellement insérés, devient cruciale pour surmonter ces défis. En générant un contenu visuel à grande échelle, diversifié et réaliste, la simulation vidéo contribue à enrichir les applications de réalité virtuelle, de montage vidéo et d'augmentation des données vidéo.

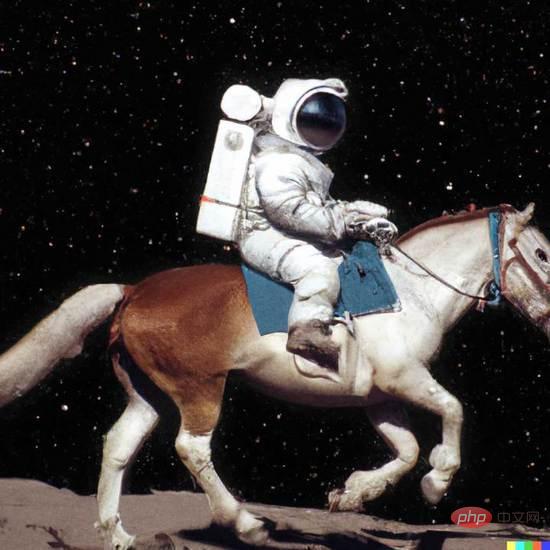

Cependant, générer des vidéos de simulation réalistes en tenant compte du réalisme physique reste un problème ouvert et difficile. Les méthodes existantes présentent souvent des limites en se concentrant sur des paramètres spécifiques, en particulier les environnements intérieurs [9, 26, 45, 46, 57]. Ces méthodes peuvent ne pas répondre de manière adéquate à la complexité des scènes extérieures, notamment aux conditions d'éclairage variables et aux objets en mouvement rapide. Les méthodes reposant sur l'enregistrement de modèles 3D se limitent à intégrer des classes limitées d'objets [12, 32, 40, 42]. De nombreuses méthodes ignorent des facteurs importants tels que la modélisation de l'environnement lumineux, le placement correct des objets et l'obtention du réalisme [12, 36]. Le cas d’échec est illustré à la figure 1. Par conséquent, ces limitations limitent considérablement leur application dans les domaines qui nécessitent des simulations vidéo de scènes hautement évolutives, géométriquement cohérentes et réalistes, telles que la conduite autonome et la robotique.

Cet article propose Anything in Any Scene, un cadre complet pour l'insertion d'objets vidéo photoréalistes qui répond à ces défis. Le cadre est conçu pour être polyvalent et adapté aux scènes intérieures et extérieures, garantissant une précision physique en termes de réalisme géométrique, de réalisme d'éclairage et de photoréalisme. L'objectif de cet article est de créer des simulations vidéo qui sont non seulement utiles pour l'augmentation des données visuelles dans l'apprentissage automatique, mais également adaptées à diverses applications vidéo telles que la réalité virtuelle et le montage vidéo.

L'aperçu du cadre Anything in Any Scene de cet article est présenté dans la figure 2. Cet article détaille notre pipeline novateur et évolutif pour créer une bibliothèque d'actifs diversifiée de vidéos de scène et de maillages d'objets dans la section 3. Cet article présente un moteur de requête de données visuelles conçu pour récupérer efficacement des clips vidéo pertinents à partir de requêtes visuelles à l'aide de mots-clés descriptifs. Ensuite, cet article propose deux méthodes pour générer des maillages 3D, en tirant parti des ressources 3D existantes ainsi que de la reconstruction d'images multi-vues. Cela permet l'insertion sans restriction de n'importe quel objet souhaité, même s'il est très irrégulier ou sémantiquement faible. Dans la section 4, l'article détaille les méthodes d'intégration d'objets dans des vidéos de scènes dynamiques, en se concentrant sur le maintien du réalisme physique. Cet article conçoit la méthode de placement et de stabilisation d'objet décrite dans la section 4.1 pour garantir que l'objet inséré est ancré de manière stable sur des images vidéo consécutives. Pour relever le défi de la création d'effets d'éclairage et d'ombre réalistes, cet article estime l'éclairage du ciel et de l'environnement et génère des ombres réalistes pendant le rendu, comme décrit dans la section 4.2. Les images vidéo simulées générées contiennent inévitablement des artefacts irréalistes qui diffèrent de la vidéo capturée dans le monde réel, tels que des différences de qualité d'image en termes de niveaux de bruit, de fidélité des couleurs et de netteté. Cet article utilise un réseau de transfert de style pour améliorer le réalisme photographique dans la section 4.3.

Les vidéos de simulation générées à partir du cadre proposé dans cet article atteignent un degré élevé de réalisme d'éclairage, de réalisme géométrique et de réalisme photo, surpassant les autres vidéos en qualité et en quantité, comme le montre la section 5.3. Cet article démontre en outre l'application de la vidéo de simulation de cet article dans les algorithmes de perception de formation dans la section 5.4 pour vérifier sa valeur pratique. Le cadre Anything in Any Scene permet la création d'ensembles de données vidéo à grande échelle et à faible coût pour l'augmentation des données avec un gain de temps et une qualité visuelle réaliste, allégeant ainsi le fardeau de la génération de données vidéo et améliorant potentiellement la longue traîne et les sorties. défis de distribution. Grâce à sa conception générale, le framework Anything in Any Scene peut facilement intégrer des modèles améliorés et de nouveaux modules, tels que des méthodes améliorées de reconstruction de maillage 3D, pour améliorer encore les performances de simulation vidéo.

Figure 1. Exemples d'images vidéo simulées avec des erreurs dans l'estimation de l'environnement d'éclairage, des erreurs dans le placement des objets et des styles de texture irréalistes. Ces problèmes font que l'image manque de réalisme physique.

Figure 1. Exemples d'images vidéo simulées avec des erreurs dans l'estimation de l'environnement d'éclairage, des erreurs dans le placement des objets et des styles de texture irréalistes. Ces problèmes font que l'image manque de réalisme physique.  Figure 2. Présentation du cadre Anything in Any Scene pour l'insertion d'objets vidéo photoréalistes

Figure 2. Présentation du cadre Anything in Any Scene pour l'insertion d'objets vidéo photoréalistes  Figure 3. Exemple de vidéo de scène de conduite pour le placement d'objets. Les points rouges sur chaque image correspondent à l'endroit où les objets ont été insérés.

Figure 3. Exemple de vidéo de scène de conduite pour le placement d'objets. Les points rouges sur chaque image correspondent à l'endroit où les objets ont été insérés.

Résultats expérimentaux

Figure 4. Exemples d'images originales du ciel, d'images HDR reconstruites et de leurs cartes de répartition de l'éclairage solaire associées

Figure 5. Exemples d'images panoramiques d'environnement HDR originales et reconstruites

Figure 6. Exemple de génération d'ombres pour les objets insérés

Figure 7. Comparaison qualitative des images vidéo simulées à partir de l'ensemble de données PandaSet à l'aide de réseaux de transfert de différents styles.

Figure 8. Comparaison qualitative des images vidéo simulées à partir de l'ensemble de données PandaSet dans diverses conditions de rendu.

Résumé :

Cet article propose un cadre innovant et extensible, "Anything in Any Scene", conçu pour la simulation vidéo réaliste. Le cadre proposé dans cet article intègre de manière transparente divers objets dans différentes vidéos dynamiques, garantissant ainsi la préservation du réalisme géométrique, du réalisme de l'éclairage et du photoréalisme. Grâce à de nombreuses démonstrations, cet article démontre son efficacité pour atténuer les défis associés à la collecte et à la génération de données vidéo, en fournissant des solutions rentables et permettant de gagner du temps pour une variété de scénarios. L'application de notre cadre montre des améliorations significatives dans les tâches de perception en aval, en particulier dans la résolution du problème de distribution à longue traîne dans la détection d'objets. La flexibilité de notre framework permet l'intégration directe de modèles améliorés pour chaque module, et notre framework pose une base solide pour l'exploration et l'innovation futures dans le domaine de la simulation vidéo réaliste.

Citation :

Bai C, Shao Z, Zhang G et al. Tout dans n'importe quelle scène : insertion d'objet vidéo photoréaliste [J].

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM

从VAE到扩散模型:一文解读以文生图新范式Apr 08, 2023 pm 08:41 PM1 前言在发布DALL·E的15个月后,OpenAI在今年春天带了续作DALL·E 2,以其更加惊艳的效果和丰富的可玩性迅速占领了各大AI社区的头条。近年来,随着生成对抗网络(GAN)、变分自编码器(VAE)、扩散模型(Diffusion models)的出现,深度学习已向世人展现其强大的图像生成能力;加上GPT-3、BERT等NLP模型的成功,人类正逐步打破文本和图像的信息界限。在DALL·E 2中,只需输入简单的文本(prompt),它就可以生成多张1024*1024的高清图像。这些图像甚至

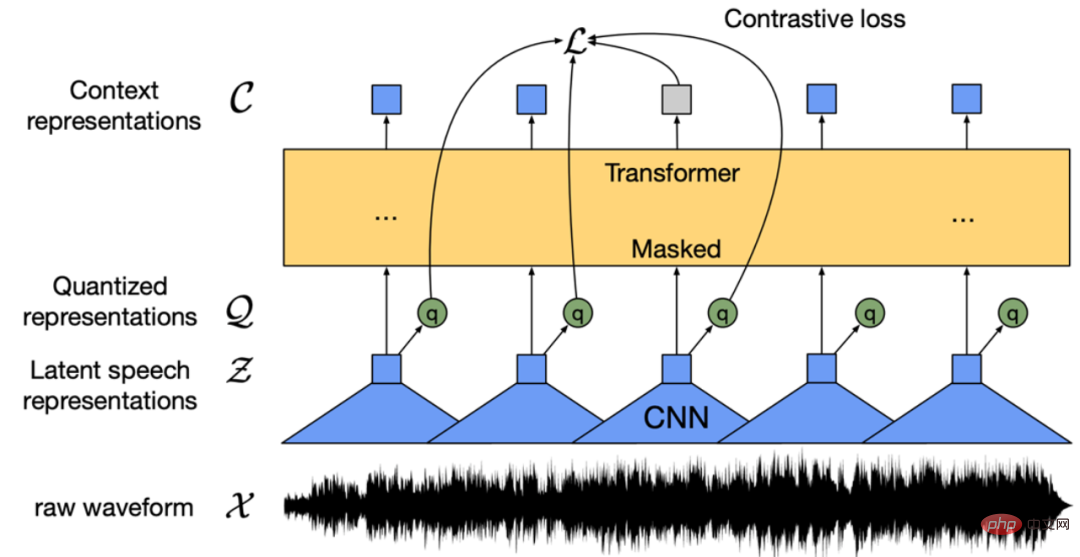

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PM

找不到中文语音预训练模型?中文版 Wav2vec 2.0和HuBERT来了Apr 08, 2023 pm 06:21 PMWav2vec 2.0 [1],HuBERT [2] 和 WavLM [3] 等语音预训练模型,通过在多达上万小时的无标注语音数据(如 Libri-light )上的自监督学习,显著提升了自动语音识别(Automatic Speech Recognition, ASR),语音合成(Text-to-speech, TTS)和语音转换(Voice Conversation,VC)等语音下游任务的性能。然而这些模型都没有公开的中文版本,不便于应用在中文语音研究场景。 WenetSpeech [4] 是

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM

普林斯顿陈丹琦:如何让「大模型」变小Apr 08, 2023 pm 04:01 PM“Making large models smaller”这是很多语言模型研究人员的学术追求,针对大模型昂贵的环境和训练成本,陈丹琦在智源大会青源学术年会上做了题为“Making large models smaller”的特邀报告。报告中重点提及了基于记忆增强的TRIME算法和基于粗细粒度联合剪枝和逐层蒸馏的CofiPruning算法。前者能够在不改变模型结构的基础上兼顾语言模型困惑度和检索速度方面的优势;而后者可以在保证下游任务准确度的同时实现更快的处理速度,具有更小的模型结构。陈丹琦 普

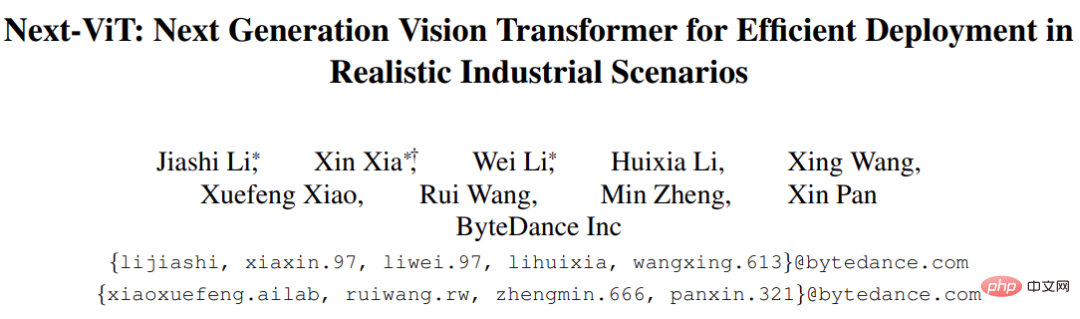

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM

解锁CNN和Transformer正确结合方法,字节跳动提出有效的下一代视觉TransformerApr 09, 2023 pm 02:01 PM由于复杂的注意力机制和模型设计,大多数现有的视觉 Transformer(ViT)在现实的工业部署场景中不能像卷积神经网络(CNN)那样高效地执行。这就带来了一个问题:视觉神经网络能否像 CNN 一样快速推断并像 ViT 一样强大?近期一些工作试图设计 CNN-Transformer 混合架构来解决这个问题,但这些工作的整体性能远不能令人满意。基于此,来自字节跳动的研究者提出了一种能在现实工业场景中有效部署的下一代视觉 Transformer——Next-ViT。从延迟 / 准确性权衡的角度看,

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM

Stable Diffusion XL 现已推出—有什么新功能,你知道吗?Apr 07, 2023 pm 11:21 PM3月27号,Stability AI的创始人兼首席执行官Emad Mostaque在一条推文中宣布,Stable Diffusion XL 现已可用于公开测试。以下是一些事项:“XL”不是这个新的AI模型的官方名称。一旦发布稳定性AI公司的官方公告,名称将会更改。与先前版本相比,图像质量有所提高与先前版本相比,图像生成速度大大加快。示例图像让我们看看新旧AI模型在结果上的差异。Prompt: Luxury sports car with aerodynamic curves, shot in a

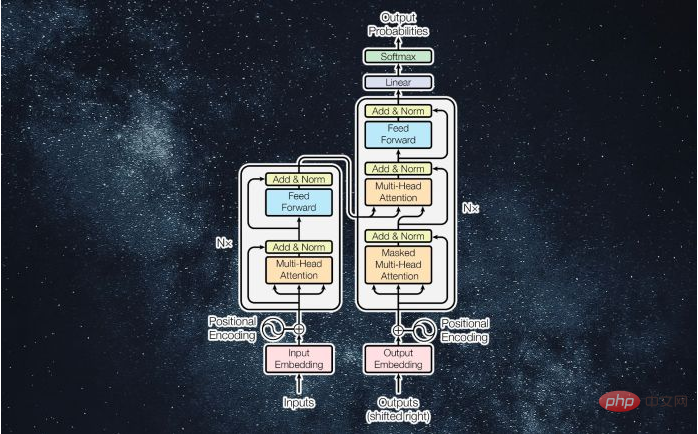

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM

什么是Transformer机器学习模型?Apr 08, 2023 pm 06:31 PM译者 | 李睿审校 | 孙淑娟近年来, Transformer 机器学习模型已经成为深度学习和深度神经网络技术进步的主要亮点之一。它主要用于自然语言处理中的高级应用。谷歌正在使用它来增强其搜索引擎结果。OpenAI 使用 Transformer 创建了著名的 GPT-2和 GPT-3模型。自从2017年首次亮相以来,Transformer 架构不断发展并扩展到多种不同的变体,从语言任务扩展到其他领域。它们已被用于时间序列预测。它们是 DeepMind 的蛋白质结构预测模型 AlphaFold

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM

五年后AI所需算力超100万倍!十二家机构联合发表88页长文:「智能计算」是解药Apr 09, 2023 pm 07:01 PM人工智能就是一个「拼财力」的行业,如果没有高性能计算设备,别说开发基础模型,就连微调模型都做不到。但如果只靠拼硬件,单靠当前计算性能的发展速度,迟早有一天无法满足日益膨胀的需求,所以还需要配套的软件来协调统筹计算能力,这时候就需要用到「智能计算」技术。最近,来自之江实验室、中国工程院、国防科技大学、浙江大学等多达十二个国内外研究机构共同发表了一篇论文,首次对智能计算领域进行了全面的调研,涵盖了理论基础、智能与计算的技术融合、重要应用、挑战和未来前景。论文链接:https://spj.scien

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM

AI模型告诉你,为啥巴西最可能在今年夺冠!曾精准预测前两届冠军Apr 09, 2023 pm 01:51 PM说起2010年南非世界杯的最大网红,一定非「章鱼保罗」莫属!这只位于德国海洋生物中心的神奇章鱼,不仅成功预测了德国队全部七场比赛的结果,还顺利地选出了最终的总冠军西班牙队。不幸的是,保罗已经永远地离开了我们,但它的「遗产」却在人们预测足球比赛结果的尝试中持续存在。在艾伦图灵研究所(The Alan Turing Institute),随着2022年卡塔尔世界杯的持续进行,三位研究员Nick Barlow、Jack Roberts和Ryan Chan决定用一种AI算法预测今年的冠军归属。预测模型图

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

MinGW - GNU minimaliste pour Windows

Ce projet est en cours de migration vers osdn.net/projects/mingw, vous pouvez continuer à nous suivre là-bas. MinGW : un port Windows natif de GNU Compiler Collection (GCC), des bibliothèques d'importation et des fichiers d'en-tête librement distribuables pour la création d'applications Windows natives ; inclut des extensions du runtime MSVC pour prendre en charge la fonctionnalité C99. Tous les logiciels MinGW peuvent fonctionner sur les plates-formes Windows 64 bits.

mPDF

mPDF est une bibliothèque PHP qui peut générer des fichiers PDF à partir de HTML encodé en UTF-8. L'auteur original, Ian Back, a écrit mPDF pour générer des fichiers PDF « à la volée » depuis son site Web et gérer différentes langues. Il est plus lent et produit des fichiers plus volumineux lors de l'utilisation de polices Unicode que les scripts originaux comme HTML2FPDF, mais prend en charge les styles CSS, etc. et présente de nombreuses améliorations. Prend en charge presque toutes les langues, y compris RTL (arabe et hébreu) et CJK (chinois, japonais et coréen). Prend en charge les éléments imbriqués au niveau du bloc (tels que P, DIV),

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

Télécharger la version Mac de l'éditeur Atom

L'éditeur open source le plus populaire