Récemment, des chercheurs de Waabi AI, de l'Université de Toronto, de l'Université de Waterloo et du MIT ont proposé une nouvelle plateforme de simulation d'éclairage de conduite autonome LightSim au NeurIPS 2023. Les chercheurs ont proposé des méthodes pour générer des données d'apprentissage d'éclairage appariées à partir de données réelles, résolvant ainsi les problèmes de données manquantes et de perte de migration de modèle. LightSim utilise des champs de rayonnement neuronal (NeRF) et des réseaux profonds basés sur la physique pour restituer des vidéos de conduite de véhicules, réalisant pour la première fois une simulation d'éclairage de scènes dynamiques sur des données réelles à grande échelle.

- Site Web du projet : https://waabi.ai/lightsim

- Lien papier : https://openreview.net/pdf?id=mcx8IGneYw

Pourquoi avez-vous besoin d’une simulation d’éclairage de conduite autonome ? La simulation de caméra est très importante en robotique, notamment pour que les véhicules autonomes perçoivent les scènes extérieures. Cependant, les systèmes de perception par caméra existants fonctionnent mal lorsqu'ils sont confrontés à des conditions d'éclairage extérieur qui n'ont pas été apprises lors de la formation. La génération d'un riche ensemble de données sur les changements d'éclairage extérieur grâce à la simulation de caméra peut améliorer la robustesse des systèmes de conduite autonome. Les méthodes courantes de simulation de caméra sont généralement basées sur des moteurs physiques. Cette méthode restitue la scène en définissant le modèle 3D et les conditions d'éclairage. Cependant, les effets de simulation manquent souvent de diversité et ne sont pas suffisamment réalistes. De plus, en raison du nombre limité de modèles 3D de haute qualité, les résultats du rendu physique ne correspondent pas exactement aux scènes du monde réel. Cela conduit à une faible capacité de généralisation du modèle formé sur des données réelles. L'autre est basé sur une méthode de simulation basée sur les données. Il utilise le rendu neuronal pour reconstruire des jumeaux numériques du monde réel qui reproduisent les données observées par les capteurs. Cette approche permet une création de scènes plus évolutive et un réalisme amélioré, mais les technologies existantes ont tendance à intégrer l'éclairage de la scène dans le modèle 3D, ce qui entrave l'édition du jumeau numérique, comme la modification des conditions d'éclairage ou l'ajout ou la suppression de nouveaux objets, etc. Dans un travail à NeurIPS 2023, des chercheurs de Waabi AI ont démontré un système de simulation d'éclairage basé sur un moteur physique et un réseau neuronal LightSim : Neural Lighting Simulation for Urban Scenes.

Différent de Dans des travaux antérieurs, LightSim a a également réalisé : 1. Réaliste : Pour la première fois, il a réalisé une simulation d'éclairage de scènes dynamiques extérieures à grande échelle et peut simuler plus précisément les ombres, les effets d'éclairage entre les objets, etc. 2. Contrôlable : Prend en charge l'édition de scènes de conduite dynamiques (ajout, suppression d'objets, positions et paramètres de caméra, modification de l'éclairage, génération de scènes critiques pour la sécurité, etc.) pour générer des vidéos plus réalistes et cohérentes. Pour améliorer la robustesse du système. conditions d'éclairage et de bord. 3. Évolutif : Il est facile de s'étendre à davantage de scénarios et à différents ensembles de données. Il suffit de collecter des données une seule fois (un seul passage) pour reconstruire et effectuer des tests de simulation réels et contrôlables.

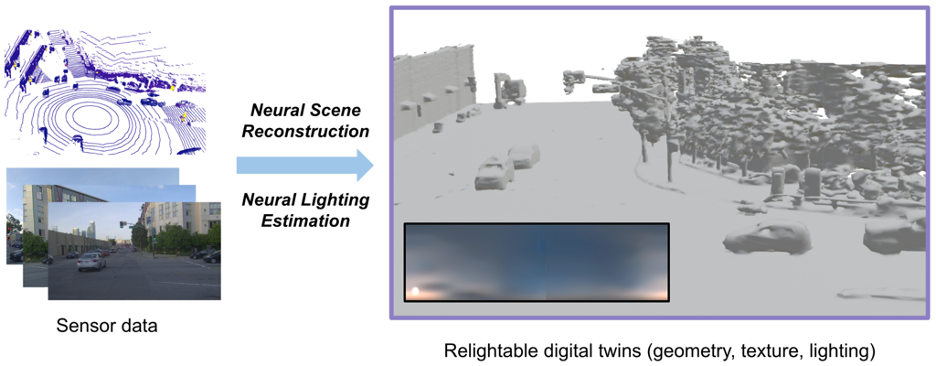

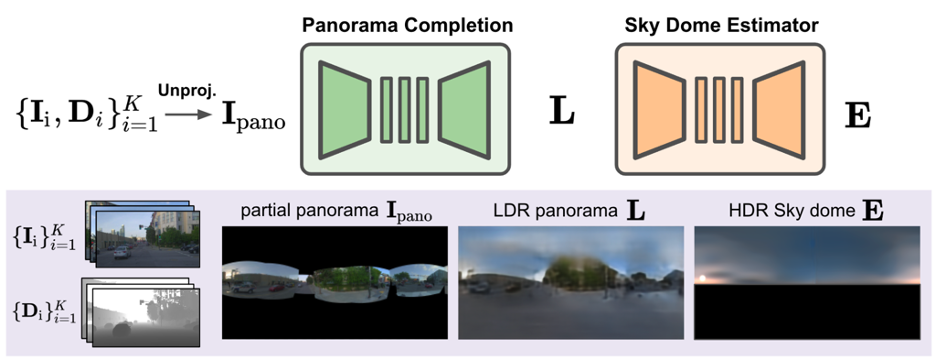

Création d'un système de simulationÉtape 1 : Construire un jumeau numérique rééclairable dans le monde réelAfin de reconstruire la scène de la conduite autonome dans le monde numérique, LightSim part d'abord du données collectées Divisez les objets dynamiques et les scènes statiques. Cette étape utilise UniSim pour reconstruire la scène et supprimer la dépendance à la vue de la caméra dans le réseau. Utilisez ensuite le cube de marche pour obtenir la géométrie, puis convertissez-la en un maillage avec des matériaux de base.  En plus des matériaux et de la géométrie, LightSim peut également estimer l'éclairage extérieur en fonction du soleil et du ciel, les principales sources lumineuses des scènes extérieures de jour, et obtenir une carte d'environnement à plage dynamique élevée (dôme HDR Sky). À l'aide des données de capteurs et de la géométrie extraite, LightSim estime une image panoramique incomplète puis la complète pour obtenir une vue complète à 360° du ciel. Cette image panoramique et les informations GPS sont ensuite utilisées pour générer une carte de l'environnement HDR qui estime avec précision l'intensité du soleil, la direction du soleil et l'apparence du ciel.

En plus des matériaux et de la géométrie, LightSim peut également estimer l'éclairage extérieur en fonction du soleil et du ciel, les principales sources lumineuses des scènes extérieures de jour, et obtenir une carte d'environnement à plage dynamique élevée (dôme HDR Sky). À l'aide des données de capteurs et de la géométrie extraite, LightSim estime une image panoramique incomplète puis la complète pour obtenir une vue complète à 360° du ciel. Cette image panoramique et les informations GPS sont ensuite utilisées pour générer une carte de l'environnement HDR qui estime avec précision l'intensité du soleil, la direction du soleil et l'apparence du ciel.

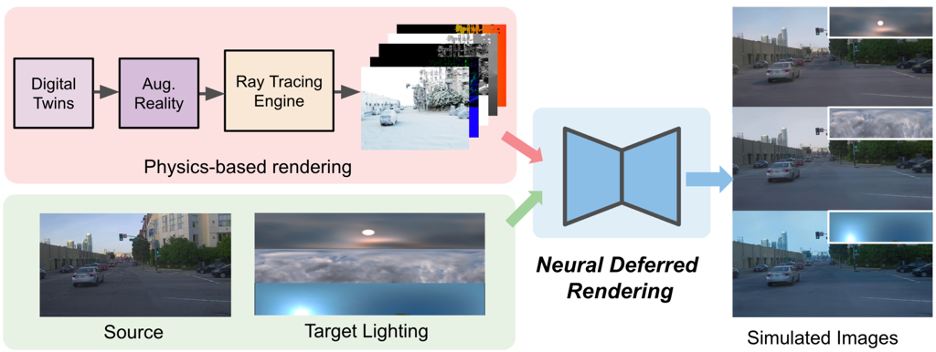

Deuxième étape : simulation d'éclairage neuronal de scènes urbaines dynamiques Après avoir obtenu le jumeau numérique, il peut être modifié davantage, par exemple en ajoutant ou en supprimant des objets, en modifiant la trajectoire des véhicules ou en modifiant l'éclairage, etc. pour générer des représentations de réalité augmentée. LightSim effectuera un rendu basé sur la physique, générant des données liées à l'éclairage pour modifier la scène, telles que la couleur de base, la profondeur, les vecteurs normaux et les ombres. En utilisant ces données liées à l'éclairage et une estimation des conditions d'éclairage source et cible de la scène, le flux de travail LightSim est le suivant.

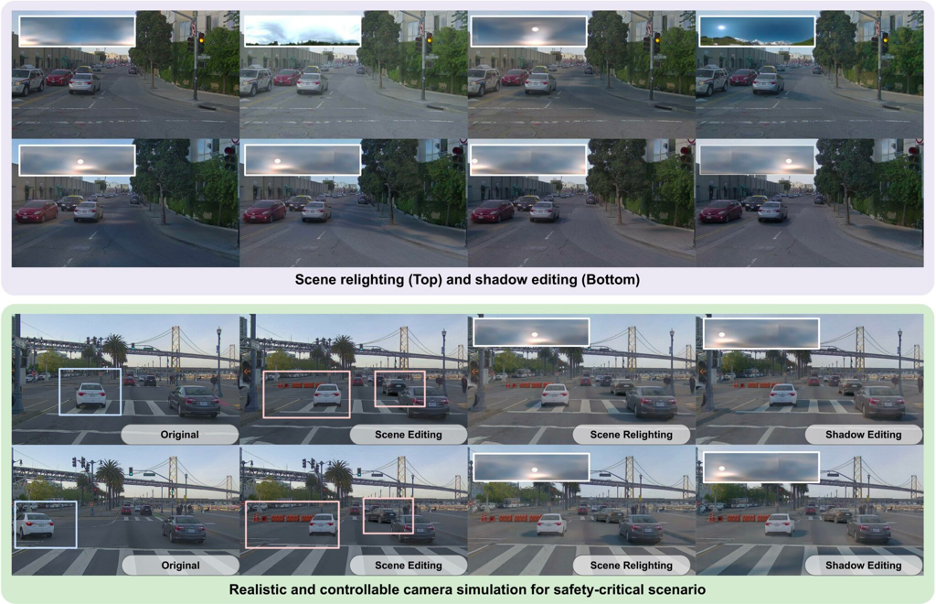

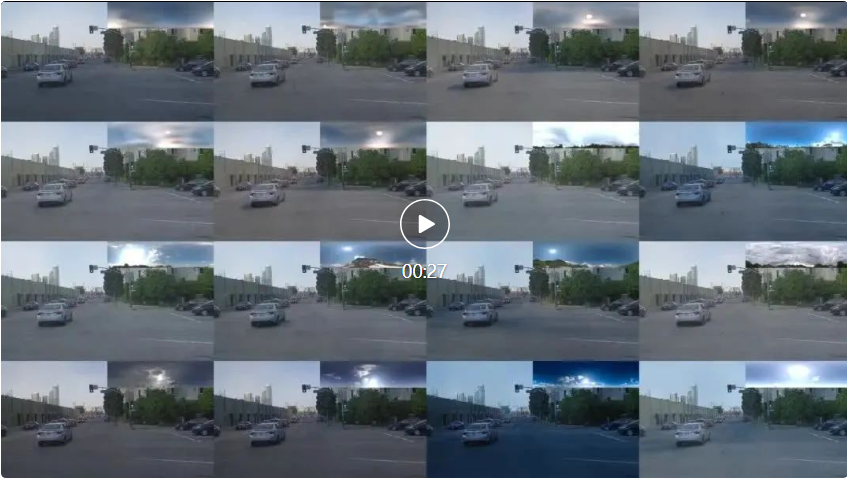

Bien que les images rendues à base physique réussissent bien à reconstruire les effets d'éclairage d'une scène, en raison d'imperfections de géométrie et d'erreurs de décomposition du matériau/de l'éclairage, les résultats du rendu manquent souvent de réalisme, comme des réflexions de surface floues et irréalistes et des artefacts de bordure. Par conséquent, les chercheurs ont proposé un rendu neuronal différé pour améliorer le réalisme. Ils ont introduit un réseau de synthèse d'images qui prend une image source et un tampon précalculé de données liées à l'éclairage générées par le moteur de rendu pour générer l'image finale. Dans le même temps, la méthode décrite dans l'article fournit également au réseau une carte de l'environnement pour améliorer le contexte d'éclairage et génère des images appariées via le jumeau numérique, fournissant ainsi une nouvelle simulation par paire et un schéma de formation de données réelles. Démonstration de la capacité de simulationChangement d'éclairage de scène (Scene Relighting)LightSim peut restituer la même scène de manière cohérente dans le temps dans de nouvelles conditions d'éclairage. Comme le montre la vidéo, la nouvelle position du soleil et l'apparence du ciel modifient les ombres et l'apparence de la scène.  LightSim peut effectuer un rééclairage de scène par lots, générant de nouveaux changements d'éclairage de la même scène, cohérents dans le temps et tenant compte de la 3D, à partir de cartes d'environnement HDR estimées et réelles.

LightSim peut effectuer un rééclairage de scène par lots, générant de nouveaux changements d'éclairage de la même scène, cohérents dans le temps et tenant compte de la 3D, à partir de cartes d'environnement HDR estimées et réelles.  La représentation de l'éclairage de LightSim est modifiable et peut changer la direction du soleil, mettant ainsi à jour les changements d'éclairage et les ombres liés à la direction de la lumière du soleil. LightSim génère la vidéo suivante en faisant pivoter une carte d'environnement HDR et en la transmettant au module Neural Deferred Rendering.

La représentation de l'éclairage de LightSim est modifiable et peut changer la direction du soleil, mettant ainsi à jour les changements d'éclairage et les ombres liés à la direction de la lumière du soleil. LightSim génère la vidéo suivante en faisant pivoter une carte d'environnement HDR et en la transmettant au module Neural Deferred Rendering.  LightSim peut également effectuer l'édition d'ombres par lots.

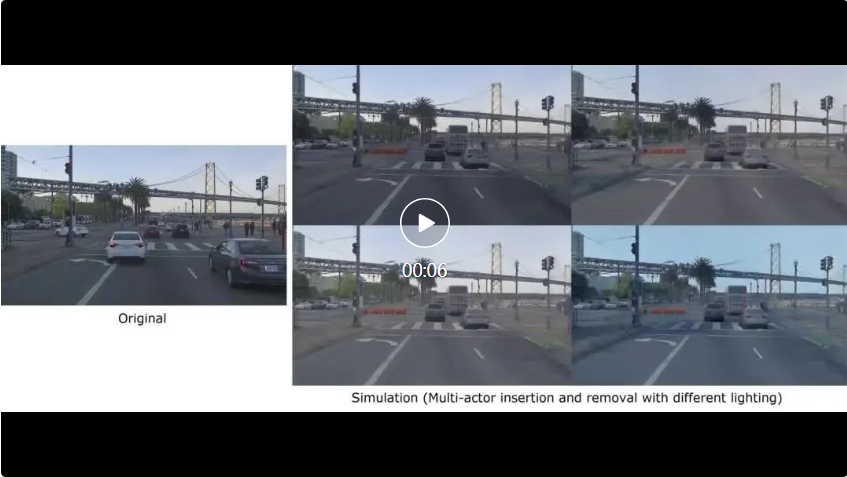

LightSim peut également effectuer l'édition d'ombres par lots.  Insertion d'acteur sensible à l'éclairageEn plus de modifier l'éclairage, LightSim peut également effectuer des ajouts tenant compte de l'éclairage à des objets inhabituels tels que des obstacles architecturaux. Ces objets ajoutés peuvent mettre à jour les ombres d'éclairage de l'objet, occulter avec précision les objets et s'adapter spatialement à l'ensemble de la configuration de la caméra.

Insertion d'acteur sensible à l'éclairageEn plus de modifier l'éclairage, LightSim peut également effectuer des ajouts tenant compte de l'éclairage à des objets inhabituels tels que des obstacles architecturaux. Ces objets ajoutés peuvent mettre à jour les ombres d'éclairage de l'objet, occulter avec précision les objets et s'adapter spatialement à l'ensemble de la configuration de la caméra.  Transfert de simulation (généralisation à nuScenes)Étant donné que le réseau de rendu neuronal différé de LightSim est formé sur plusieurs vidéos de conduite, LightSim peut être généralisé à de nouvelles scènes. La vidéo suivante démontre la capacité de LightSim à généraliser aux scènes de conduite dans nuScenes. LightSim crée un jumeau numérique prenant en compte l'éclairage de chaque scène, qui est ensuite appliqué à un modèle de rendu neuronal différé pré-entraîné sur PandaSet. La migration LightSim fonctionne bien et peut rééclairer les scènes de manière relativement robuste.

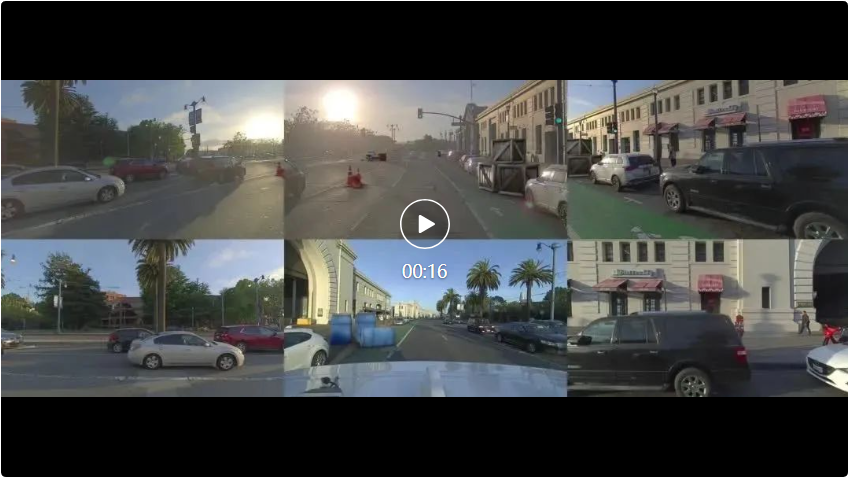

Transfert de simulation (généralisation à nuScenes)Étant donné que le réseau de rendu neuronal différé de LightSim est formé sur plusieurs vidéos de conduite, LightSim peut être généralisé à de nouvelles scènes. La vidéo suivante démontre la capacité de LightSim à généraliser aux scènes de conduite dans nuScenes. LightSim crée un jumeau numérique prenant en compte l'éclairage de chaque scène, qui est ensuite appliqué à un modèle de rendu neuronal différé pré-entraîné sur PandaSet. La migration LightSim fonctionne bien et peut rééclairer les scènes de manière relativement robuste.  Simulation de caméra réelle et contrôlableBasé sur toutes les fonctions présentées ci-dessus, LightSim réalise une simulation de caméra contrôlable, diversifiée et réaliste. La vidéo suivante montre les capacités de simulation de scène de LightSim. Dans la vidéo, une voiture blanche a effectué un changement de voie d'urgence vers la voie SDV, introduisant un nouveau barrage routier, ce qui a fait entrer la voiture blanche dans une scène complètement nouvelle. Les effets générés par LightSim dans diverses conditions d'éclairage dans la nouvelle scène sont les suivants. : .

Simulation de caméra réelle et contrôlableBasé sur toutes les fonctions présentées ci-dessus, LightSim réalise une simulation de caméra contrôlable, diversifiée et réaliste. La vidéo suivante montre les capacités de simulation de scène de LightSim. Dans la vidéo, une voiture blanche a effectué un changement de voie d'urgence vers la voie SDV, introduisant un nouveau barrage routier, ce qui a fait entrer la voiture blanche dans une scène complètement nouvelle. Les effets générés par LightSim dans diverses conditions d'éclairage dans la nouvelle scène sont les suivants. : . Un autre exemple est montré dans la vidéo ci-dessous, où un nouvel ensemble de véhicules a été ajouté après l'insertion d'un nouvel obstacle routier. Grâce à un éclairage simulé construit avec LightSim, les véhicules nouvellement ajoutés peuvent être intégrés de manière transparente dans la scène.

Un autre exemple est montré dans la vidéo ci-dessous, où un nouvel ensemble de véhicules a été ajouté après l'insertion d'un nouvel obstacle routier. Grâce à un éclairage simulé construit avec LightSim, les véhicules nouvellement ajoutés peuvent être intégrés de manière transparente dans la scène.  LightSim est une plate-forme de simulation de caméra sensible à la lumière qui sert à gérer des scènes de conduite dynamiques à grande échelle. Il peut créer des jumeaux numériques sensibles à l'éclairage, basés sur des données du monde réel, et les modifier pour créer de nouvelles scènes avec différentes dispositions d'objets et perspectives SDV. LightSim est capable de simuler de nouvelles conditions d'éclairage sur une scène pour une simulation de caméra diversifiée, réaliste et contrôlable, résultant en une vidéo cohérente dans le temps et dans l'espace. Il convient de noter que LightSim peut également être combiné avec le rendu inversé, la simulation météorologique et d'autres technologies pour améliorer encore les performances de simulation.

LightSim est une plate-forme de simulation de caméra sensible à la lumière qui sert à gérer des scènes de conduite dynamiques à grande échelle. Il peut créer des jumeaux numériques sensibles à l'éclairage, basés sur des données du monde réel, et les modifier pour créer de nouvelles scènes avec différentes dispositions d'objets et perspectives SDV. LightSim est capable de simuler de nouvelles conditions d'éclairage sur une scène pour une simulation de caméra diversifiée, réaliste et contrôlable, résultant en une vidéo cohérente dans le temps et dans l'espace. Il convient de noter que LightSim peut également être combiné avec le rendu inversé, la simulation météorologique et d'autres technologies pour améliorer encore les performances de simulation. Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

LightSim peut effectuer un rééclairage de scène par lots, générant de nouveaux changements d'éclairage de la même scène, cohérents dans le temps et tenant compte de la 3D, à partir de cartes d'environnement HDR estimées et réelles.

LightSim peut effectuer un rééclairage de scène par lots, générant de nouveaux changements d'éclairage de la même scène, cohérents dans le temps et tenant compte de la 3D, à partir de cartes d'environnement HDR estimées et réelles.

LightSim peut également effectuer l'édition d'ombres par lots.

LightSim peut également effectuer l'édition d'ombres par lots.

Un autre exemple est montré dans la vidéo ci-dessous, où un nouvel ensemble de véhicules a été ajouté après l'insertion d'un nouvel obstacle routier. Grâce à un éclairage simulé construit avec LightSim, les véhicules nouvellement ajoutés peuvent être intégrés de manière transparente dans la scène.

Un autre exemple est montré dans la vidéo ci-dessous, où un nouvel ensemble de véhicules a été ajouté après l'insertion d'un nouvel obstacle routier. Grâce à un éclairage simulé construit avec LightSim, les véhicules nouvellement ajoutés peuvent être intégrés de manière transparente dans la scène.