Maison >Périphériques technologiques >IA >La danse Douyin ne nécessite pas que de vraies personnes apparaissent devant la caméra, une simple photo peut générer une vidéo de haute qualité ! Même le CTO qui serre le visage a expérimenté la nouvelle technologie de Byte

La danse Douyin ne nécessite pas que de vraies personnes apparaissent devant la caméra, une simple photo peut générer une vidéo de haute qualité ! Même le CTO qui serre le visage a expérimenté la nouvelle technologie de Byte

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-12-14 23:05:291332parcourir

Regardez ! Il y a maintenant quatre jeunes filles qui exhibent leurs danses torrides devant vous :

Vous pensiez que c'était une œuvre publiée par certains présentateurs sur une courte plateforme vidéo ?

Non, non, non.

La vraie réponse est : fausse, générée et du genre qui ne repose que sur une image !

La vraie façon de l'activer est la suivante :

Il s'agit de la dernière recherche de l'Université nationale de Singapour et de Bytedance, appelée Magic Animate.

Sa fonction peut se résumer en une formule simple : une image + un ensemble d' actions = une vidéo sans aucun sentiment de violation.

Avec l'annonce de cette technologie, il y a eu un tollé dans le cercle technologique, et de nombreux géants et geeks de la technologie se sont joints les uns après les autres

Même le HuggingFace CTO a utilisé son propre avatar pour l'essayer :

Au fait, j'ai aussi fait une blague de manière humoristique :

C'est considéré comme du fitness, non ? Je peux sauter le gymnase cette semaine.

Il y a aussi des internautes assez au courant, qui jouent avec les personnages de la bande-annonce du nouveau GTA6 (Grand Theft Auto 6) :

Même les émoticônes sont devenues les cible choisie par les internautes...

Magic Animate peut être considéré comme ayant concentré l'attention du cercle technologique sur lui-même, alors certains internautes ont plaisanté :

OpenAI peut faire une pause.

Le feu, vraiment le feu.

Vous pouvez générer une danse avec une seule image

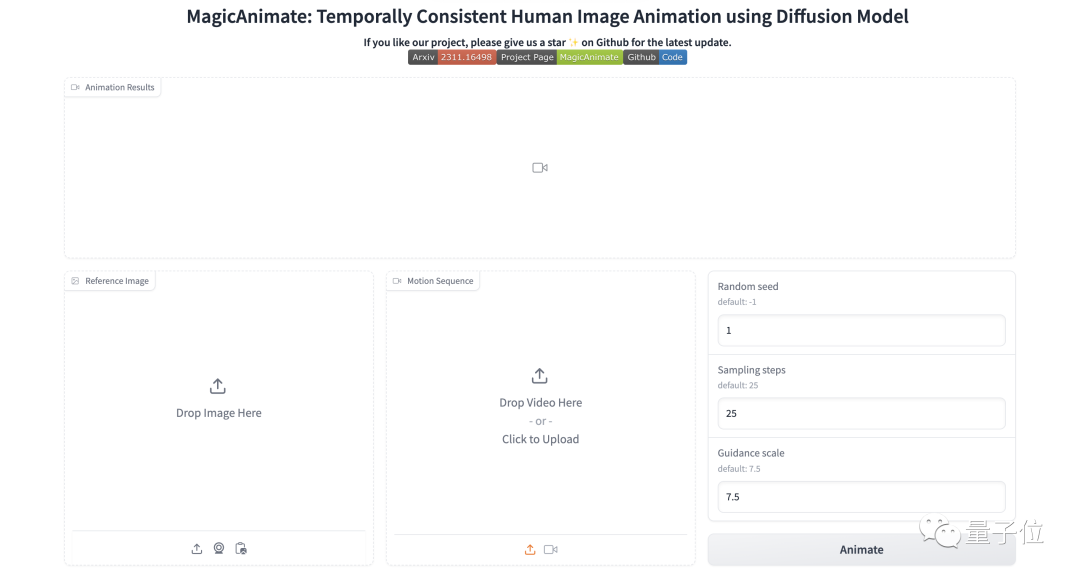

MagicAnimate est si populaire, comment devriez-vous l'utiliser ?

Sans plus tard, découvrons-le étape par étape.

Actuellement, notre équipe de projet a ouvert une page d'expérience en ligne sur HuggingFace

Le fonctionnement est très simple et ne nécessite que trois étapes :

- Téléchargez une photo statique d'une personne

- Téléchargez la vidéo de démonstration d'action que vous souhaitez générer

- Ajustez les paramètres et cliquez sur "Animer"

Par exemple, voici mes photos et la danse "Sujet Trois" récemment populaire clip :

△ Source vidéo : Douyin (ID : QC0217)

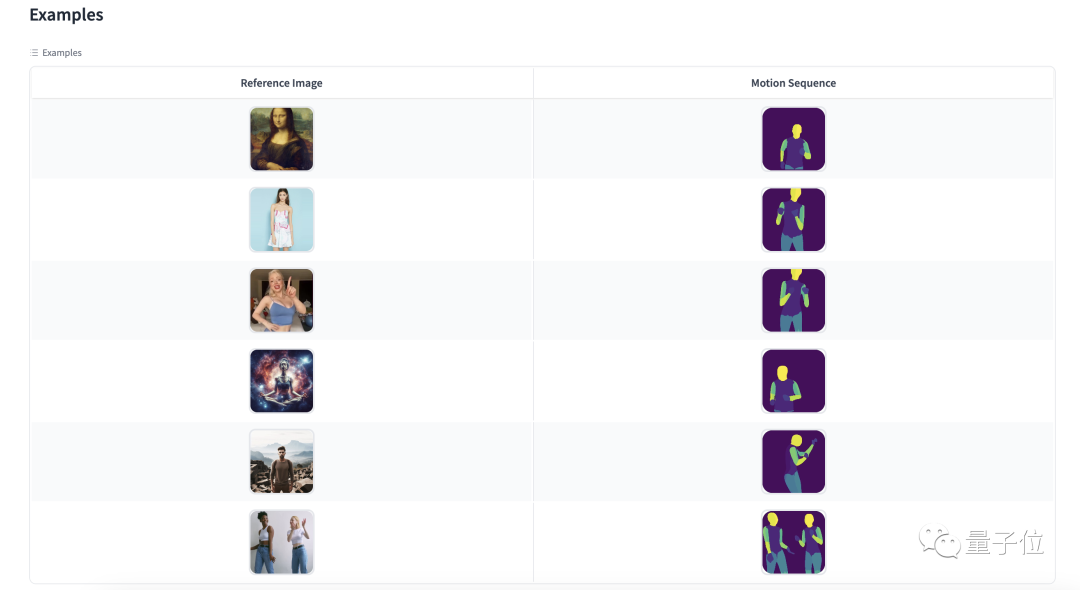

Vous pouvez également choisir le modèle fourni en bas de la page pour expérimenter :

Cependant, il convient de noter que parce que MagicAnimate est actuellement trop populaire, en Il peut y avoir des "temps d'arrêt" pendant le processus de génération :

Même si vous réussissez à le "manger", vous devrez peut-être faire la queue  ...

...

(C'est vrai ! Au moment de mettre sous presse, le résultat n'était pas encore attendu) ! )

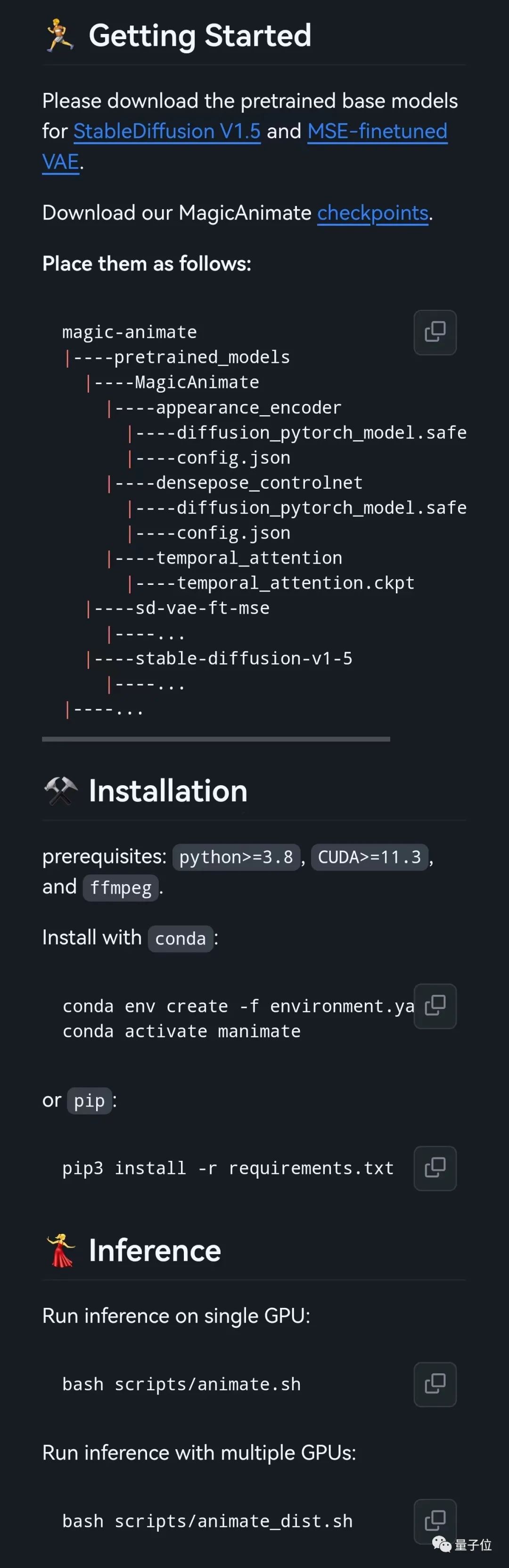

De plus, MagicAnimate propose également une méthode d'expérience locale dans GitHub. Les amis intéressés peuvent l'essayer~

Alors la question suivante est :

.Comment?

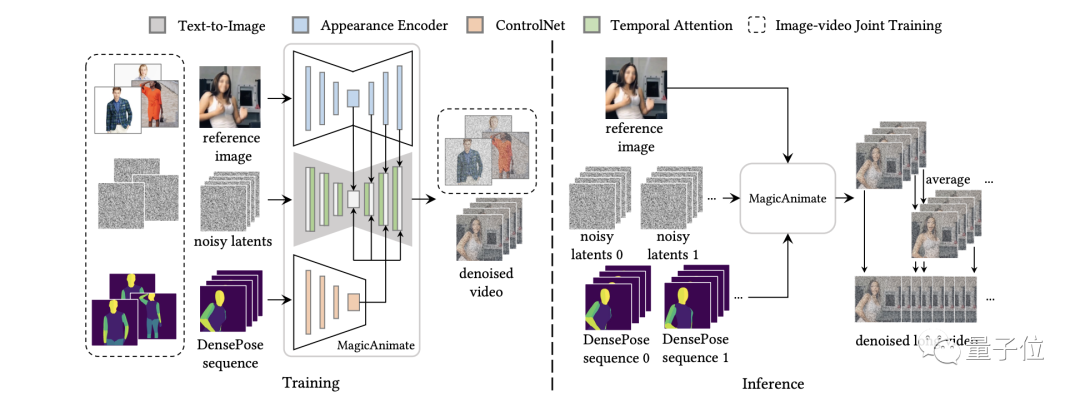

En général, MagicAnimate utilise un framework basé sur le modèle de diffusion (diffusion) Le but est d'améliorer la cohérence temporelle, de maintenir l'authenticité de l'image de référence et d'améliorer la fidélité de l'animation.

À cette fin, l'équipe a d'abord développé un Modèle de diffusion vidéo (Modélisation de cohérence temporelle) pour encoder les informations temporelles.

Ce modèle code les informations temporelles en ajoutant un module d'attention temporelle au réseau de diffusion pour assurer la cohérence temporelle entre les images de l'animation.

Deuxièmement, afin de maintenir la cohérence de l'apparence entre les images, l'équipe a introduit un nouveau Appearance Encoder(Appearance Encoder) pour préserver les détails complexes de l'image de référence.

Cet encodeur est différent des méthodes précédentes d'utilisation de l'encodage CLIP. Il est capable d'extraire des caractéristiques visuelles plus denses pour guider la production d'animation et ainsi mieux préserver les informations telles que l'identité, l'arrière-plan et les vêtements

Dans ces deux technologies innovantes. , l'équipe a en outre adopté une technologie de fusion vidéo simple (Video Fusion Technique) pour favoriser la transition en douceur des longues animations vidéo.

Enfin, après vérification par deux expériences de référence, les résultats montrent que MagicAnimate surpasse de loin les méthodes précédentes

En particulier sur l'ensemble de données de danse difficile de TikTok, MagicAnimate surpasse la base de référence la plus solide en termes de fidélité vidéo de plus de 38 % !

Ce qui suit est une comparaison qualitative donnée par l'équipe :

Et par rapport au modèle de base de pointe de cross-ID, nos résultats sont les suivants :

One More Thing

Je dois dire que des projets comme MagicAnimate sont vraiment très populaires ces derniers temps

Non, peu de temps avant ses "débuts", l'équipe Ali a également sorti un projet appelé Animate Any 's Le projet ne nécessite également que « une image » et « l'action souhaitée » :

À partir de là, certains internautes ont également soulevé des questions :

Cela semble être une guerre entre MagicAnimate et AnimateAnyone. Qui est le meilleur ?

Qu'en pensez-vous ?

Veuillez cliquer sur le lien suivant pour consulter l'article : https://arxiv.org/abs/2311.16498

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!