Maison >Périphériques technologiques >IA >Meta lance la suite de traduction IA Seamless Communication

Meta lance la suite de traduction IA Seamless Communication

- 王林avant

- 2023-12-04 17:23:20726parcourir

Meta a récemment publié Seamless Communication, une suite de traduction IA. Ce kit contient quatre modèles d'IA. Meta affirme que ce kit d'IA peut reproduire avec précision les émotions de l'orateur et peut atteindre des capacités d'interprétation simultanée avec un délai de seulement deux secondes, tout en prenant également en charge la saisie dans près d'une centaine de langues

.Il est rapporté que Seamless Communication est un résultat de recherche publié par Meta pour célébrer le 10e anniversaire de la création de sa propre organisation de recherche en IA « Fundamental AI Research ».

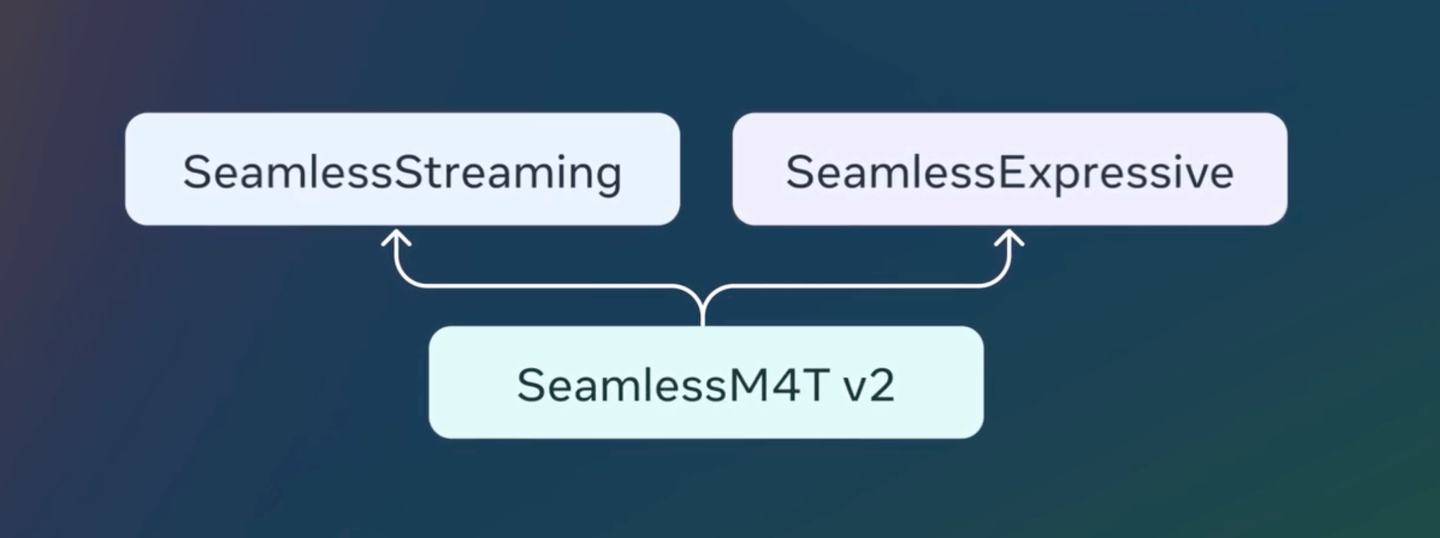

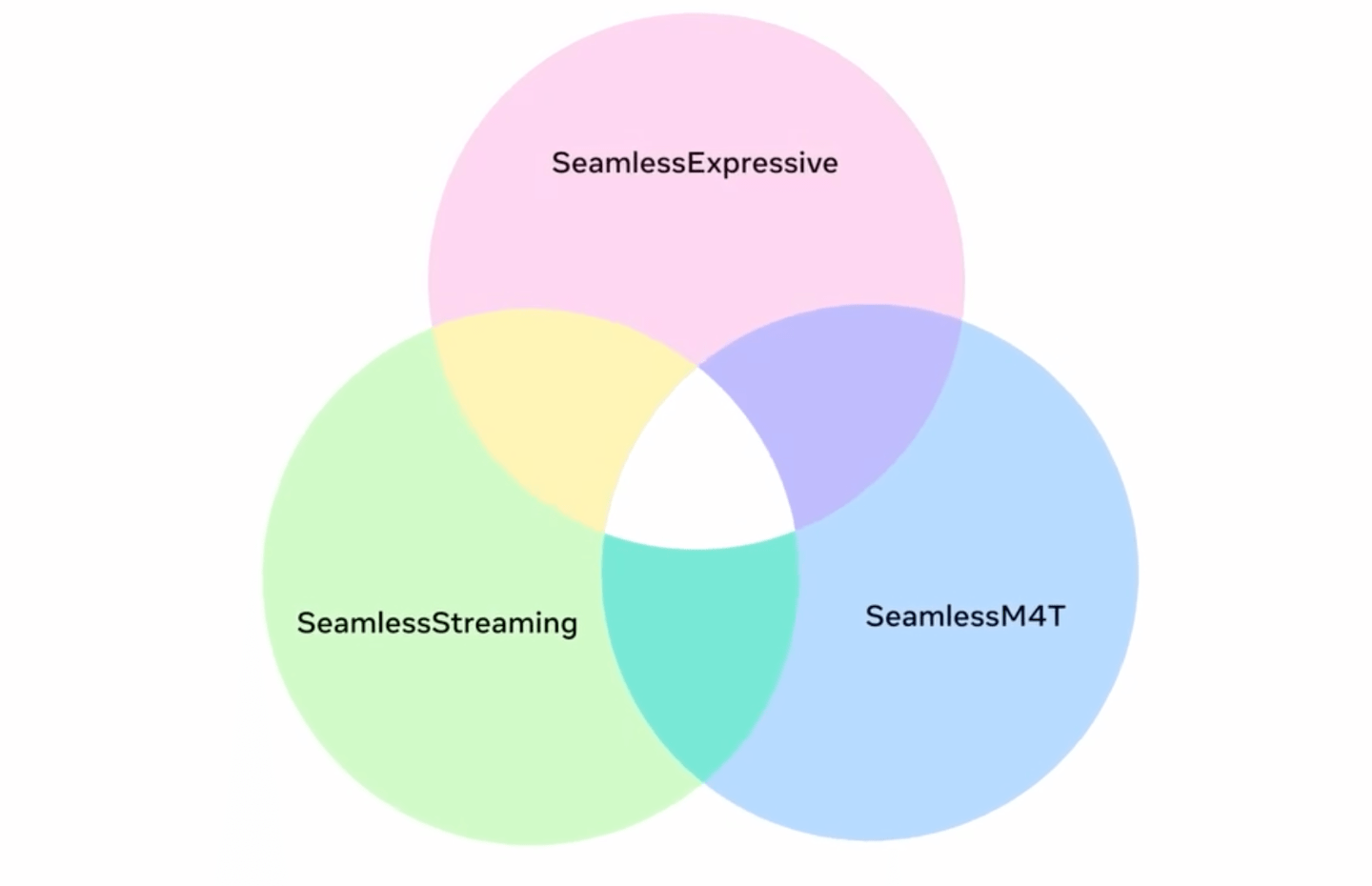

Meta a déclaré que le kit comprend le « modèle SeamlessM4T de deuxième génération » pour accélérer la traduction, le modèle d'interprétation « Seamless Expressive », le modèle de traduction simultanée « Seamless Streaming » et le modèle complet « Seamless ». Voici les informations pertinentes compilées par IT House :

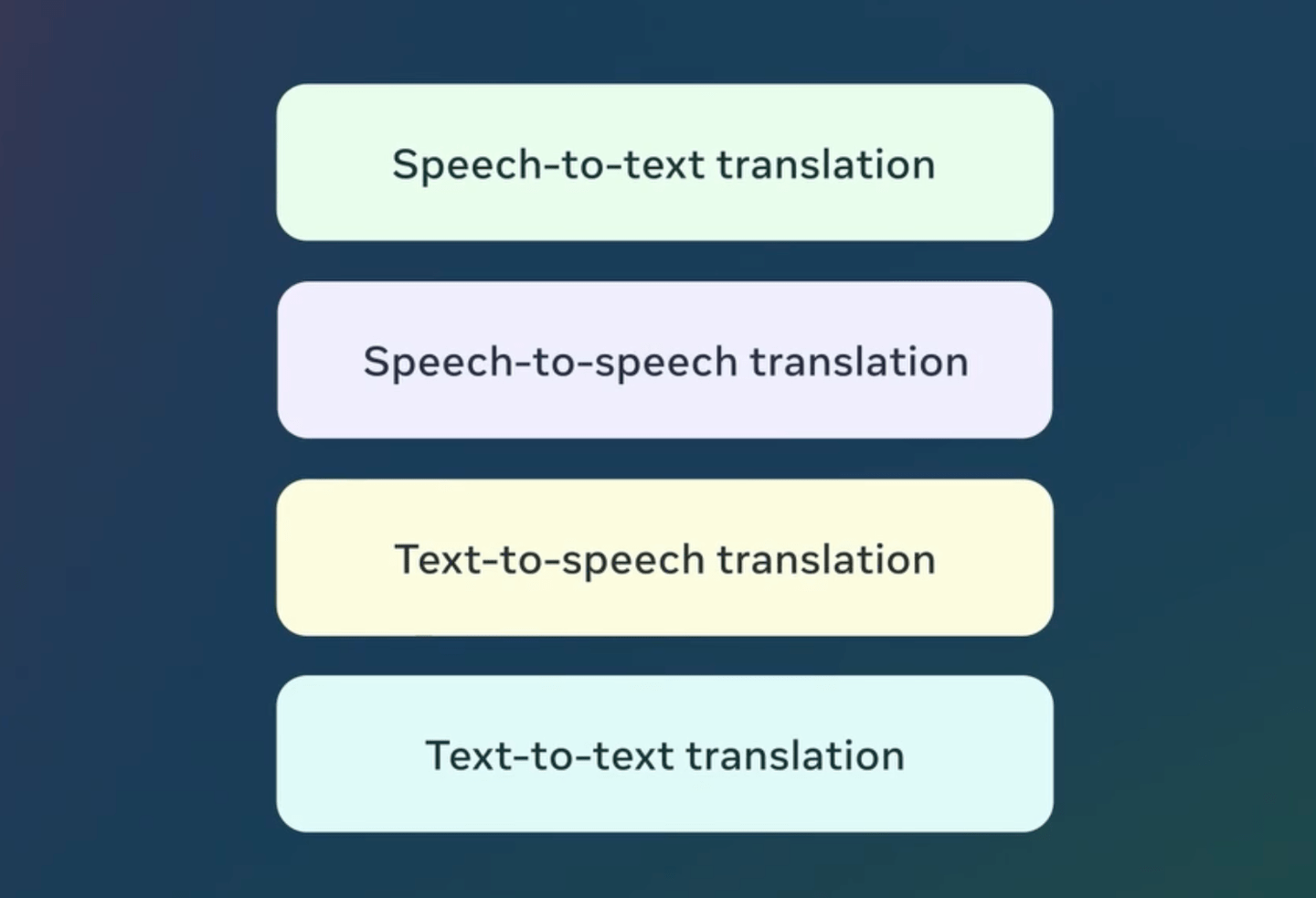

Le modèle SeamlessM4T prétend être capable d'associer automatiquement d'éventuels textes ultérieurs au cours du processus de traduction en fonction du contenu oral de l'utilisateur pour accélérer la traduction

Seamless Expressive est un modèle d'interprétation censé être capable de résoudre le problème selon lequel la traduction IA traditionnelle ne peut pas capturer l'intonation, les pauses et l'accentuation des mots de l'utilisateur. Elle peut également conserver l'émotion, le style et la vitesse de parole de l'utilisateur tout en conservant la qualité de la traduction. , pauses et rythme, apportant ainsi plus d'informations émotionnelles au contenu traduit

Seamless Streaming est un modèle d'interprétation simultanée qui vise à fournir une traduction vocale et textuelle avec un délai de 2 secondes, prenant en charge l'interprétation en temps réel, la traduction parole-texte (S2TT) et la reconnaissance automatique de la parole (ASR)

Le modèle complet Seamless intègre les trois modèles de langage ci-dessus pour faciliter les scénarios universels.

Actuellement, Meta a publié l'exemple de vidéo sur GitHub et le site Web HuggingFace. Les amis intéressés peuvent cliquer ici pour le voir.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI