Maison >Périphériques technologiques >IA >L'interface cerveau-ordinateur partagée brevetée Samsung XR offre une stimulation sensorielle complète - odeur, goût, etc.

L'interface cerveau-ordinateur partagée brevetée Samsung XR offre une stimulation sensorielle complète - odeur, goût, etc.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-11-27 12:58:49777parcourir

(Nwe le 27 novembre 2023) Selon des renseignements antérieurs, Samsung a formulé une stratégie métaverse complète et vise à construire un écosystème XR centré sur Samsung, et recrute activement des talents. Selon la demande de brevet, la société a en fait envisagé l’interface cerveau-ordinateur ultime.

Dans le passé, la recherche sur les interfaces cerveau-ordinateur était plus courante parmi Meta, Valve et d'autres startups. Bien entendu, des entreprises comme Microsoft l’ont également exploré. De nos jours, les entreprises qui se déploient activement dans le domaine XR commencent à explorer des interfaces cerveau-ordinateur plus avancées. Dans une demande de brevet intitulée « Méthode et dispositif de génération d'informations », Samsung a proposé d'appliquer l'interface cerveau-ordinateur au domaine de la stimulation par rétroaction sensorielle XR

Cette société estime que dans la technologie XR, diverses simulations sensorielles sont principalement mises en œuvre sur la base de capteurs. Mais chaque simulation sensorielle est réalisée grâce à un capteur, le processus est donc fastidieux. De plus, les capteurs ne sont pas assez complets, donc de nombreuses simulations ne peuvent pas être mises en œuvre. En d’autres termes, les effets obtenus à l’aide des capteurs concernés sont loin de la réalité et les utilisateurs ne peuvent obtenir des simulations réalistes.

Ainsi, Samsung propose d'utiliser des dispositifs d'interface cerveau-ordinateur pour fournir des simulations sensorielles réalistes. Parmi eux, le système peut obtenir des informations sur la position de l'utilisateur par rapport à l'objet cible dans l'environnement virtuel, puis déterminer des informations sensorielles correspondant à l'objet cible sur la base des informations de position et des informations d'attribut, et enfin convertir les informations sensorielles en signaux électriques et faites-les passer par des dispositifs d'interface cerveau-ordinateur pour stimuler les utilisateurs.

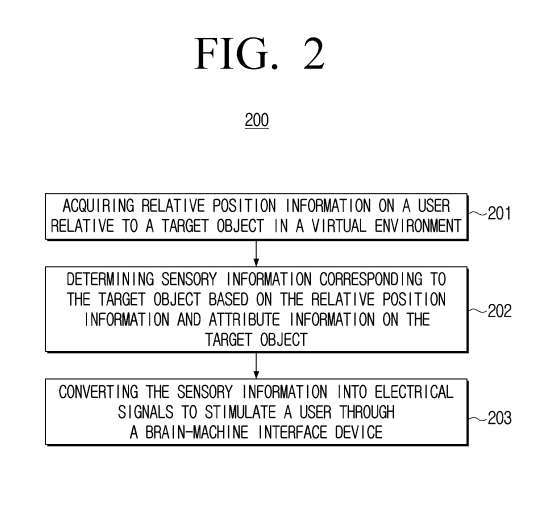

Selon un exemple de mode de réalisation, la figure 2 montre un organigramme de génération d'informations associé 200. Le procédé de génération d'informations comprend une opération d'obtention d'informations de position relative de l'utilisateur par rapport à l'objet cible dans l'environnement virtuel 201

Dans un mode de réalisation, un ou plusieurs dispositifs qui fonctionnent en coopération les uns avec les autres peuvent être appelés entités d'exécution. L'entité d'exécution peut établir un système de coordonnées rectangulaires spatiales, obtenir les informations de localisation de l'utilisateur dans le système de coordonnées rectangulaires et les informations de localisation de l'objet cible dans l'environnement virtuel en temps réel, et déterminer sur la base des informations de localisation de l'utilisateur et des informations de localisation de l'objet cible. Informations de position relative de l'utilisateur par rapport à l'objet cible.

L'entité d'exécution peut obtenir périodiquement les informations de position de l'utilisateur dans le système de coordonnées rectangulaires et les informations de position de l'objet cible dans l'environnement virtuel. L'objet cible peut être n'importe quel objet cible dans l'environnement virtuel, tel qu'une table, un verre d'eau, du pain, etc.

Lors de l'opération 202, les informations sensorielles correspondant à l'objet cible sont déterminées sur la base des informations de position relative et des informations d'attribut de l'objet cible.

Selon un exemple de mode de réalisation, après avoir obtenu les informations de position relative de l'utilisateur par rapport à l'objet cible dans l'environnement virtuel, l'entité d'exécution peut en outre déterminer les informations sensorielles correspondant à l'objet cible selon la table de correspondance ou la prédiction des informations sensorielles. modèle. Par exemple, la table de correspondance peut stocker des informations de position relative prédéterminées, des informations d'attribut de l'objet cible et des informations sensorielles interdépendantes. Le modèle de prédiction d'informations sensorielles peut être un modèle de prédiction d'informations sensorielles prédéterminé déterminé par la réalisation d'une opération d'entraînement.

Selon l'exemple de mode de réalisation, nous pouvons utiliser les informations de position relative de l'objet cible et attribuer des échantillons avec des informations sensorielles pour entraîner le modèle, obtenant ainsi un modèle qui prédit les informations sensorielles

Les informations sensorielles de l'objet cible peuvent inclure au moins le toucher, l'ouïe, l'odorat ou le goût. Les informations sensorielles peuvent être représentées par des paramètres de stimulus. Les paramètres de stimulation peuvent être déterminés sur la base des informations sensorielles réellement produites par l'utilisateur sur l'objet cible dans l'environnement réel

Fait intéressant, Samsung a proposé que le stimulateur pertinent pourrait être CereStim, un neurostimulateur à 96 canaux entièrement programmable de la startup de cerveau-ordinateur Blackrock. Mais bien sûr, la société affirme que l’appareil en question n’est qu’une option et que d’autres émulateurs sont possibles.

Dans un exemple de scénario, l'utilisateur touche un objet à 30 degrés Celsius et l'activité de l'électrode est enregistrée à l'aide du collecteur de signaux neuronaux du port neuronal. L'activité neuronale enregistrée par les électrodes est amplifiée et échantillonnée de manière analogique-numérique (A/D) à une fréquence d'échantillonnage de 30 kHz, puis enregistrée à l'aide du système NSP du processeur de signal neuronal du port neuronal. Ensuite, écrivez les paramètres de stimulation via l’API Matlab de CereStim et obtenez à nouveau les signaux des électrodes grâce à différentes stimulations par impulsions et en ajustant l’intensité du courant. Lorsque les signaux des électrodes sont infiniment proches les uns des autres, ils peuvent toucher les paramètres de stimulation de l'objet à 30 degrés Celsius.

De même, tous les paramètres de stimulation du toucher, de l'audition ou de l'odorat peuvent être obtenus.

Lors de l'exécution de 203 opérations, la méthode consiste à convertir les informations sensorielles en signaux électriques et à stimuler l'utilisateur via un dispositif d'interface cerveau-ordinateur

Après avoir déterminé les informations sensorielles correspondant à l'objet cible, l'entité d'exécution peut utiliser le dispositif d'interface cerveau-ordinateur pour convertir ces informations sensorielles en signaux électriques, puis produire la sensation correspondante en stimulant les parties correspondantes du cortex cérébral de l'utilisateur

Selon un autre exemple de mode de réalisation, l'opération de détermination des informations sensorielles correspondant à l'objet cible sur la base des informations de position relative et des informations d'attribut de l'objet cible peut comprendre la détermination des informations sensorielles correspondant à l'objet cible sur la base de l'orientation du visage de l'utilisateur et de la distance entre la tête de l'utilisateur et l'objet cible. des informations olfactives correspondant à l'objet et déterminer les informations olfactives en tant qu'informations sensorielles correspondant à l'objet cible.

Selon un autre exemple de mode de réalisation, le procédé peut consister à déterminer que l'objet cible possède un attribut d'odeur, et à déterminer des informations olfactives correspondant à l'objet cible en fonction de l'orientation du visage de l'utilisateur et de la distance entre la tête de l'utilisateur et l'objet cible. En réponse ou sur la base de la détermination du fait que l'objet cible possède un attribut d'odeur, des informations olfactives sont déterminées en tant qu'informations sensorielles correspondant à l'objet cible.

Les attributs olfactifs peuvent inclure l'arôme des fruits, l'arôme des fleurs, l'arôme des aliments et d'autres informations sur les attributs.

Dans un mode de réalisation, les informations sensorielles liées à l'objet cible sont déterminées en utilisant des informations de position relative et des informations d'attribut de l'objet cible. Sur la base de la confirmation que l'objet cible possède des attributs sonores, les informations auditives liées à l'objet cible peuvent être déterminées sur la base de la direction du visage de l'utilisateur et de la distance entre la tête de l'utilisateur et l'objet cible, puis les informations auditives sont déterminé comme étant lié à l’objet cible Informations sensorielles

L'entité d'exécution peut utiliser les dispositifs de positionnement portables sur les côtés gauche et droit de la tête de l'utilisateur pour déterminer les coordonnées gauche et droite de l'utilisateur, déterminer davantage la ligne reliant les coordonnées gauche et droite de la tête de l'utilisateur et calculer les coordonnées en fonction de la ligne et des coordonnées sur le côté droit de la tête de l'utilisateur. L'angle entre les directions du plan où se trouvent les coordonnées de l'objet cible détermine l'orientation du visage de l'utilisateur.

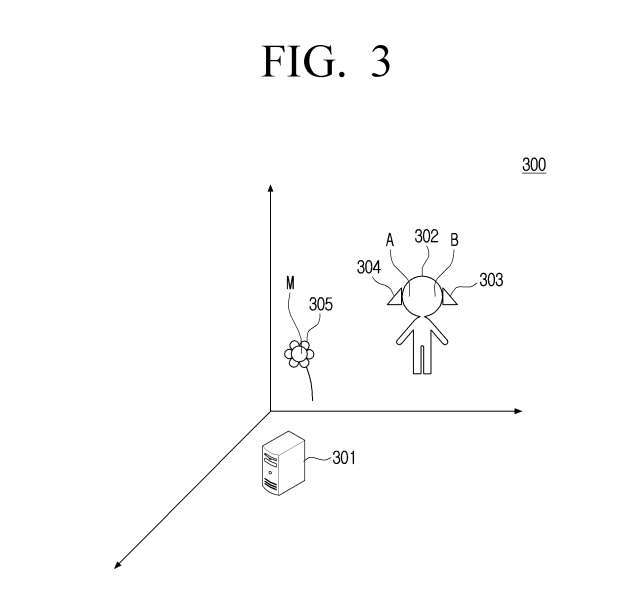

Selon la figure 3, en utilisant la station de base UWB comme origine, l'entité d'exécution 301 peut établir un système de coordonnées spatiales rectangulaires et utiliser le premier dispositif de positionnement portable 303 sur le côté gauche de la tête de l'utilisateur et le deuxième dispositif de positionnement portable. 303 sur le côté droit de la tête de l'utilisateur. Le dispositif de positionnement portable 304 obtient les coordonnées A et B correspondant à la tête de l'utilisateur

.Selon des exemples de modes de réalisation, les dispositifs de positionnement portables 303 et 304 peuvent être des puces UWB. La station de base UWB peut être mise en œuvre par l'entité d'exécution 301. La coordonnée A correspond à la puce 303, c'est-à-dire la coordonnée du côté gauche de la tête de l'utilisateur, et la coordonnée B correspond à la puce 304, c'est-à-dire la coordonnée du côté droit de la tête de l'utilisateur.

En même temps, obtenez la coordonnée M de l'objet cible 305, et déterminez l'angle entre la droite AB et la direction du plan où se trouve M comme orientation de l'utilisateur. Ici, l'objet cible 305 est une fleur virtuelle. L'entité d'exécution peut déterminer les informations olfactives correspondant à l'objet cible à partir de la table de correspondance prédéterminée en fonction de l'orientation du visage de l'utilisateur et de la distance entre la tête de l'utilisateur et l'objet cible, et déterminer cela. les informations olfactives correspondent à l'information sensorielle. La table de correspondance enregistre l'orientation du visage de l'utilisateur, la distance entre la tête de l'utilisateur et l'objet cible, ainsi que les informations olfactives associées.

Dans ce mode de réalisation, les coordonnées des côtés gauche et droit de la tête de l'utilisateur sont déterminées à l'aide de dispositifs de positionnement portables sur les côtés gauche et droit de la tête de l'utilisateur. La direction du visage de l'utilisateur est déterminée en calculant l'angle entre la ligne droite reliant les coordonnées des côtés gauche et droit de la tête de l'utilisateur et la direction du plan où se trouvent les coordonnées de l'objet cible. Cela améliore efficacement la précision de la détermination de l'orientation du visage de l'utilisateur

L'entité d'exécution peut détecter sur la base des informations de position relative de la tête de l'utilisateur par rapport à l'objet cible, et déterminer le goût correspondant à l'attribut comestible sur la base de la condition selon laquelle l'objet cible est situé à une position prédéterminée de la tête de l'utilisateur et l'objet cible possède des attributs comestibles. Des informations sous forme d'informations sensorielles correspondant à l'objet cible

Peut inclure des informations sur les attributs, telles que la saveur de banane, la saveur de pomme, etc.

Il convient de noter qu'avant de déterminer que l'objet cible est situé à la position prédéterminée de la tête de l'utilisateur, il peut y avoir une action de l'utilisateur touchant l'objet cible, ou il peut ne pas y avoir d'action de l'utilisateur touchant l'objet cible. objet cible dans la plage de temps prédéterminée.

Dans un mode de réalisation, en déterminant si la distance entre la main de l'utilisateur et l'objet cible atteint un seuil prédéterminé, il peut être déterminé s'il y a une action de l'utilisateur touchant l'objet virtuel.

Dans ce mode de réalisation, premièrement, sur la base de la position prédéterminée de l'objet cible sur la tête de l'utilisateur et de ses attributs comestibles, les informations gustatives correspondant aux attributs comestibles sont déterminées en tant qu'informations sensorielles de l'objet cible. Les informations sensorielles sont ensuite converties en signaux électriques et stimulées via des dispositifs d'interface cerveau-ordinateur, aidant ainsi les utilisateurs à découvrir les propriétés comestibles des objets dans l'environnement virtuel et améliorant l'authenticité de l'interaction

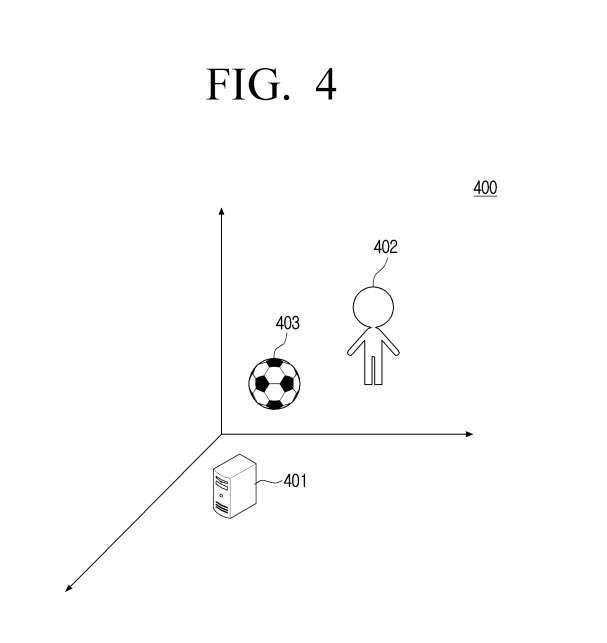

Le diagramme schématique montre le scénario d'application de la méthode de génération d'informations, comme le montre la figure 4

Dans le scénario d'application illustré à la figure 4, l'entité 401 peut établir un système de coordonnées spatiales rectangulaires avec la station de base UWB comme origine. En utilisant un dispositif de positionnement portable sur une ou plusieurs parties du corps de l'utilisateur 402, les informations de position de l'utilisateur dans le système de coordonnées spatiales rectangulaires peuvent être obtenues

Par exemple, des dispositifs de positionnement portables peuvent être placés sur les mains et la tête de l'utilisateur. La station de base UWB peut être mise en œuvre par l'entité d'exécution 401. Selon un exemple de mode de réalisation, l'entité peut obtenir des informations de position sur un objet cible 403, tel qu'un ballon de football virtuel, pour ainsi déterminer la position relative de l'utilisateur par rapport à l'objet cible sur la base des informations de position de l'utilisateur et des informations de position sur l'objet cible. informations sur l’objet cible.

Ensuite, déterminez les informations sensorielles correspondant à l'objet cible selon la table de correspondance. Cette table de correspondance enregistre les informations de position relative prédéterminées, les informations d'attribut (telles que la douceur, la douceur, etc.) et les informations sensorielles correspondantes de l'objet cible. Ensuite, ces informations sensorielles sont converties en signaux électriques et stimulées par le dispositif d'interface cerveau-ordinateur 402

Le procédé de génération d'informations peut consister à obtenir les informations de position relative de l'utilisateur par rapport à l'objet cible dans l'environnement virtuel, à déterminer les informations sensorielles correspondant à l'objet cible en fonction des informations de position relative et des informations d'attribut de l'objet cible, et à utiliser le cerveau-ordinateur Le dispositif d'interface convertit les informations sensorielles en signaux électriques pour stimuler l'utilisateur ; cela l'aide à découvrir les propriétés des objets dans l'environnement virtuel et améliore l'authenticité de l'interaction.

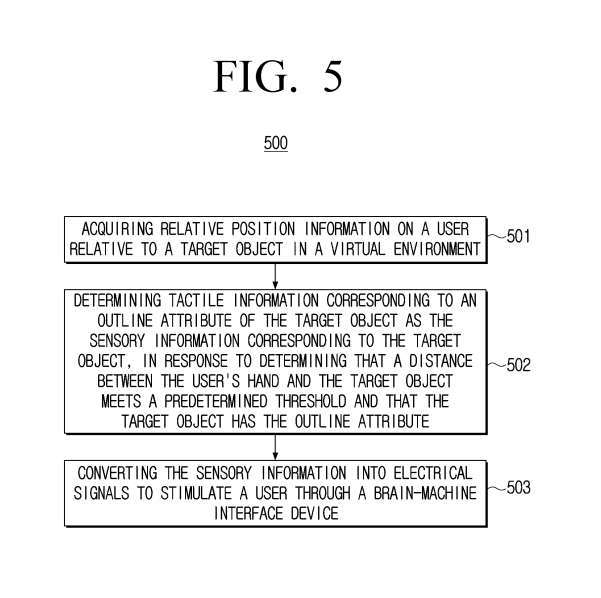

Veuillez vous référer à la figure 5, qui est un organigramme 500 de la méthode de génération d'informations

Dans l'opération 501, les informations de position relative de l'utilisateur par rapport à l'objet cible dans l'environnement virtuel peuvent être obtenues grâce à la méthode de génération d'informations

Lors de l'exécution de l'opération 502, s'il est déterminé que la distance entre la main de l'utilisateur et l'objet cible atteint le seuil prédéfini et que l'objet cible présente des caractéristiques de contour, alors les informations tactiles correspondant aux caractéristiques de contour de l'objet cible seront déterminé comme objet cible Informations sensorielles correspondantes

Contenu réécrit : les informations de position relative peuvent inclure des informations de position relative entre la main de l'utilisateur et l'objet cible, et l'entité d'exécution peut détecter la distance entre la main de l'utilisateur et l'objet cible. En réponse à la détermination du fait que la distance entre la main de l'utilisateur et l'objet cible satisfait un seuil prédéterminé et que l'objet cible possède un attribut de contour, les informations tactiles correspondant à l'attribut de contour de l'objet cible sont déterminées en tant qu'informations sensorielles correspondant à l'objet cible

Peut inclure le profil, le matériau, la texture, la douceur, la température, la qualité et d'autres informations sur les attributs

Parmi eux, des seuils prédéterminés peuvent être fixés en fonction de l'expérience, des besoins réels et de scénarios d'application spécifiques. Par exemple, la distance entre les doigts et/ou la paume et l'objet cible est inférieure ou égale à 1 cm, ou la distance entre les doigts et/ou la paume et l'objet cible est inférieure ou égale à 0,5 cm, ce qui n'est pas limité dans la présente divulgation.

Plus précisément, le système établit un système de coordonnées spatiales rectangulaires avec la station de base UWB comme origine, utilise un gant de données porté sur la main de l'utilisateur pour obtenir les informations sur la position de la main de l'utilisateur et obtient en même temps les informations sur la position de l'objet cible. . L'objet cible est un gobelet d'eau, et le seuil prédéfini est que la distance entre les doigts et/ou les paumes de l'utilisateur et le gobelet d'eau soit inférieure ou égale à 1 cm

Afin de respecter le seuil prédéterminé, la distance entre les doigts et/ou la paume de l'utilisateur et le gobelet à eau est déterminée, tout en prenant en compte les attributs de contour du gobelet à eau, les informations tactiles correspondant aux attributs de contour du gobelet à eau est déterminé comme l'information sensorielle de la tasse d'eau

Dans l'opération 503, elle comprend la conversion des informations sensorielles en signaux électriques via le dispositif d'interface cerveau-ordinateur pour stimuler l'utilisateur.

Par rapport au procédé présenté dans l'exemple de mode de réalisation de la figure 2, selon le procédé présenté dans l'organigramme 500 de la figure 5, afin de déterminer que la distance entre la main de l'utilisateur et l'objet cible satisfait le seuil prédéterminé et la L'objet cible possède un attribut de contour, la cible. Les informations tactiles correspondant aux attributs de contour de l'objet sont déterminées en tant qu'informations sensorielles correspondant à l'objet cible.

Grâce au dispositif d'interface cerveau-ordinateur, les informations perçues par l'utilisateur sont converties en signaux électriques et l'utilisateur est stimulé pour l'aider à expérimenter les propriétés de contour de l'objet dans l'environnement virtuel afin d'améliorer l'authenticité de l'interaction

Lecture approfondie : Brevet Samsung | Méthode et dispositif de génération d'informations

La demande de brevet de Samsung intitulée « Méthode et dispositif de génération d'informations » a été initialement soumise en juillet 2023 et a été récemment publiée par l'Office américain des brevets et des marques.

Normalement, après examen d'une demande de brevet américain, elle sera publiée automatiquement ou à la demande du demandeur dans les 18 mois à compter de la date de dépôt ou de la date de priorité. Il convient de noter que la publication d'une demande de brevet ne signifie pas que le brevet a été délivré. Une fois la demande de brevet publiée, l'USPTO doit procéder à un examen approfondi, ce qui peut prendre 1 à 3 ans

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Axé sur des domaines de pointe tels que l'intelligence artificielle et l'interface cerveau-ordinateur, le Forum Zhongguancun 2023 présente de nombreux moments forts.

- Branchez les électrodes et Musk vous coupera le cerveau ! L'essai clinique Neuralink approuvé par la FDA et le projet d'interface cerveau-ordinateur franchissent une nouvelle étape

- enfin! La FDA approuve l'interface cerveau-ordinateur de Musk pour la chirurgie réelle, ce qui revêt une grande importance

- Technologie Brain Tiger : à l'avant-garde de « l'interface cerveau-ordinateur » et obtenant des résultats progressifs en matière d'intégration transfrontalière

- Musk révèle une grande nouvelle ! Sa société d'interface cerveau-ordinateur développe une puce de vision...