Maison >Périphériques technologiques >IA >Nouveau titre : Meta améliore l'architecture Transformer : un nouveau mécanisme d'attention qui améliore les capacités de raisonnement

Nouveau titre : Meta améliore l'architecture Transformer : un nouveau mécanisme d'attention qui améliore les capacités de raisonnement

- PHPzavant

- 2023-11-24 14:53:48891parcourir

La puissance des grands modèles de langage (LLM) est un fait incontestable. Cependant, ils commettent encore parfois de simples erreurs, montrant un côté faible de la capacité de raisonnement.

Par exemple, le LLM peut ne pas être pertinent en raison du contexte, des préférences ou des opinions. inhérents aux invites de saisie. Le problème présenté par ce dernier cas est appelé « flagornerie », où le modèle reste cohérent avec l'entrée. Existe-t-il un moyen d'atténuer ce type de problème ? Certains chercheurs tentent de le résoudre en ajoutant davantage de données d'entraînement supervisé ou de stratégies d'apprentissage par renforcement, mais ces méthodes ne peuvent pas fondamentalement résoudre le problème.

Dans une étude récente, les chercheurs de Meta ont souligné que la façon dont le modèle Transformer lui-même est construit comporte des problèmes, notamment avec son mécanisme d’attention. En d'autres termes, l'attention douce a tendance à attribuer une probabilité à la plupart du contexte (y compris les parties non pertinentes) et à accorder trop d'attention aux jetons répétés.

Par conséquent, les chercheurs ont proposé une approche complètement différente du mécanisme d'attention, c'est-à-dire que l'attention est effectuée en utilisant LLM comme raisonneur en langage naturel. Plus précisément, ils ont exploité la capacité de LLM à suivre des instructions qui les incitent à générer le contexte sur lequel ils doivent se concentrer, afin d'inclure uniquement des éléments pertinents qui ne déforment pas leur propre raisonnement. Les chercheurs appellent ce processus l'attention du système 2 (S2A) et ils considèrent le transformateur sous-jacent et son mécanisme d'attention comme une opération automatique similaire au raisonnement du système 1 humain

Lorsque les gens doivent accorder une attention particulière à une tâche et au système 1 lorsque quelque chose ne va pas, le système 2 attribue une activité mentale intense et prend en charge le travail humain. Par conséquent, ce sous-système a des objectifs similaires à ceux du S2A proposé par le chercheur, qui espère atténuer l'échec de l'attention douce du transformateur ci-dessus grâce à un travail supplémentaire du moteur d'inférence

Le contenu qui doit être réécrit est : Lien papier : https://arxiv.org/pdf/2311.11829.pdf

Le chercheur a décrit en détail les catégories, les motivations et plusieurs mises en œuvre spécifiques du mécanisme S2A. Dans la phase expérimentale, ils ont confirmé que S2A peut produire un LLM de flatterie ou de biais plus objectif et moins subjectif qu'un LLM standard basé sur l'attention

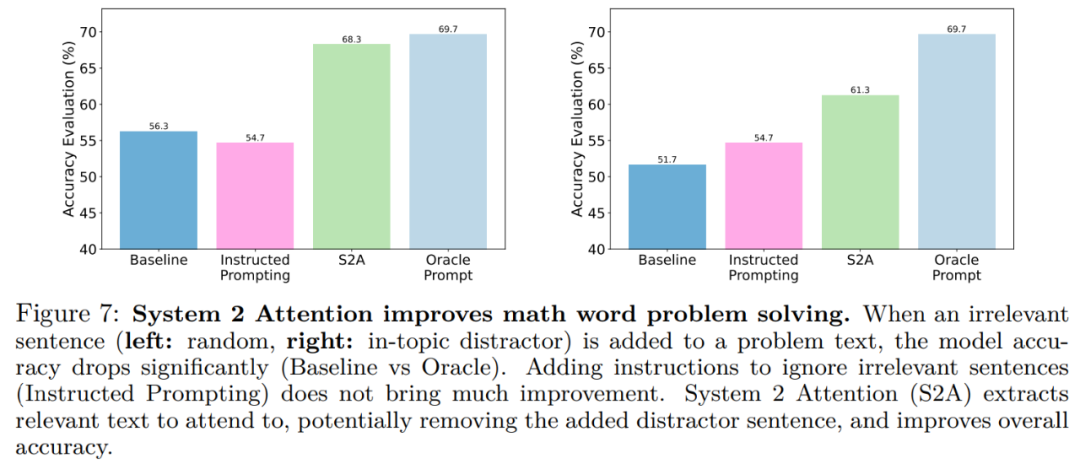

en particulier sur l'ensemble de données TriviQA modifié où la question contient des points de vue interférents, par rapport à LLaMA. -2-70B-chat, S2A a amélioré la factualité de 62,8 % à 80,3 % ; dans la tâche de génération de paramètres de forme longue contenant des émotions d'entrée distrayantes, l'objectivité de S2A s'est améliorée de 57,4 % et n'a pratiquement pas été affectée par l'impact de l'insertion de perspectives. De plus, pour les problèmes de mots mathématiques avec des phrases non pertinentes dans GSM-IC, S2A a amélioré la précision de 51,7 % à 61,3 %.

Cette étude a été recommandée par Yann LeCun.

Système 2 Attention

La figure 1 ci-dessous montre un exemple de pseudo corrélation. Même le LLM le plus puissant changera la réponse à une question de fait simple lorsque le contexte contient des phrases non pertinentes, car la présence de mots dans le contexte augmente par inadvertance la probabilité d'une mauvaise réponse

Par conséquent, nous devons travailler sur un mécanisme d’attention mieux compris et plus réfléchi. Afin de le distinguer du mécanisme d’attention de niveau inférieur, les chercheurs ont proposé un système appelé S2A. Ils ont exploré un moyen d'exploiter le LLM lui-même pour construire ce mécanisme d'attention, en ajustant spécifiquement le LLM en supprimant le texte non pertinent pour réécrire les instructions contextuelles.

Avec cette approche, le LLM est capable de répondre avant de générer une réponse. Raisonnement et prise de décision minutieux sur les parties pertinentes de l’entrée. Un autre avantage de l'utilisation du LLM ajusté aux instructions est qu'il peut contrôler la concentration de l'attention, ce qui est quelque peu similaire à la façon dont les humains contrôlent leur attention et qui comprend deux étapes :

.- Étant donné un contexte x, S2A régénère d'abord le contexte x', supprimant ainsi les parties non pertinentes du contexte qui nuiraient à la sortie. Cet article l’exprime sous la forme x ′ ∼ S2A (x).

- Étant donné x ′ , le contexte régénéré est ensuite utilisé à la place du contexte d'origine pour générer la réponse finale du LLM : y ∼ LLM (x ′ ).

Implémentations et variantes alternatives

Dans cet article, nous avons examiné plusieurs versions différentes de l'approche S2A

sans séparation du contexte et des problèmes. Dans la mise en œuvre de la figure 2, nous choisissons de régénérer le contexte décomposé en deux parties (contexte et question). La figure 12 montre une variante de cette invite.

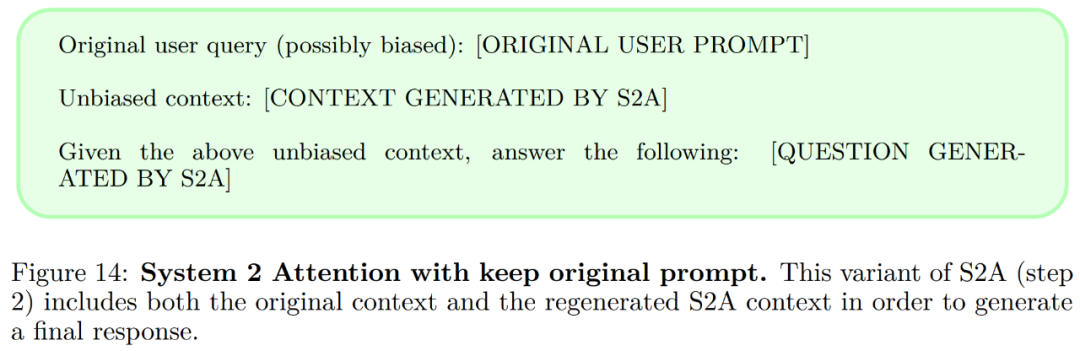

Préserver le contexte original Dans S2A, après avoir régénéré le contexte, tous les éléments nécessaires qui doivent être pris en charge doivent être inclus, puis le modèle répond uniquement sur le contexte régénéré, le contexte original est supprimé. La figure 14 montre une variante de cette invite.

Invites impératives. L'invite S2A donnée dans la figure 2 encourage à retirer le texte opiniâtre du contexte et nécessite une réponse qui n'est pas opiniâtre en utilisant les instructions de l'étape 2 (figure 13).

Les implémentations S2A mettent toutes l'accent sur la régénération du contexte pour accroître l'objectivité et réduire la flagornerie. Cependant, l'article soutient qu'il y a d'autres points qui doivent être soulignés, par exemple, nous pouvons mettre l'accent sur la pertinence par rapport à la non-pertinence. La variante d'invite de la figure 15 donne un exemple

Expérience

Cet article a mené des expériences dans trois contextes : questions et réponses factuelles, génération d'arguments longs et résolution de problèmes d'application mathématique. De plus, cet article utilise LLaMA-2-70B-chat comme modèle de base, qui est évalué dans deux paramètres

- Baseline : les invites de saisie fournies dans l'ensemble de données sont transmises au modèle et répondues de manière zéro. . La génération du modèle peut être affectée par de fausses corrélations fournies dans l'entrée.

- Invite Oracle : les invites sans avis supplémentaires ni phrases non pertinentes sont introduites dans le modèle et répondues de manière zéro.

La figure 5 (à gauche) montre les résultats de l'évaluation des réponses à des questions factuelles. System 2 Attention constitue une amélioration considérable par rapport à l'invite de saisie d'origine, atteignant une précision de 80,3 %, soit une performance proche des performances d'Oracle Prompt.

Les résultats globaux montrent que la ligne de base, Oracle Prompt et System 2 Attention sont tous évalués comme étant capables de fournir des évaluations similaires de haute qualité. La figure 6 (à droite) montre les sous-résultats :

Dans la tâche GSM-IC, la figure 7 montre les résultats de différentes méthodes. Conformément aux résultats de Shi et al., nous constatons que la précision de base est bien inférieure à celle d'Oracle. Cet effet est encore plus important lorsque les phrases non pertinentes appartiennent au même sujet que la question, comme le montre la figure 7 (à droite)

Pour plus d'informations, veuillez vous référer à l'article original.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- À quelle couche du modèle osi la fonction de sélection de chemin est-elle terminée ?

- Retour vers le futur ! En utilisant des journaux d'enfance pour entraîner l'IA, ce programmeur a utilisé GPT-3 pour établir un dialogue avec son « moi passé »

- La formation ViT et MAE réduit la quantité de calcul de moitié ! Sea et l'Université de Pékin ont proposé conjointement l'optimiseur efficace Adan, qui peut être utilisé pour les modèles profonds

- Volcano Engine aide Shenzhen Technology à lancer le premier modèle de pré-entraînement moléculaire 3D du secteur, Uni-Mol

- Explication détaillée du modèle de pré-formation d'apprentissage profond en Python