Maison >Périphériques technologiques >IA >L'authenticité est choquante ! Google et l'Université Cornell lancent la technologie de complétion d'images réelles RealFill

L'authenticité est choquante ! Google et l'Université Cornell lancent la technologie de complétion d'images réelles RealFill

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-10-03 18:17:061375parcourir

Obtenir une belle photo devient de plus en plus facile.

Lorsqu'on voyage pendant les vacances, prendre des photos est un incontournable. Cependant, la plupart des photos prises dans des endroits pittoresques sont plus ou moins regrettables. Soit il y a quelque chose de plus en arrière-plan, soit il manque quelque chose.

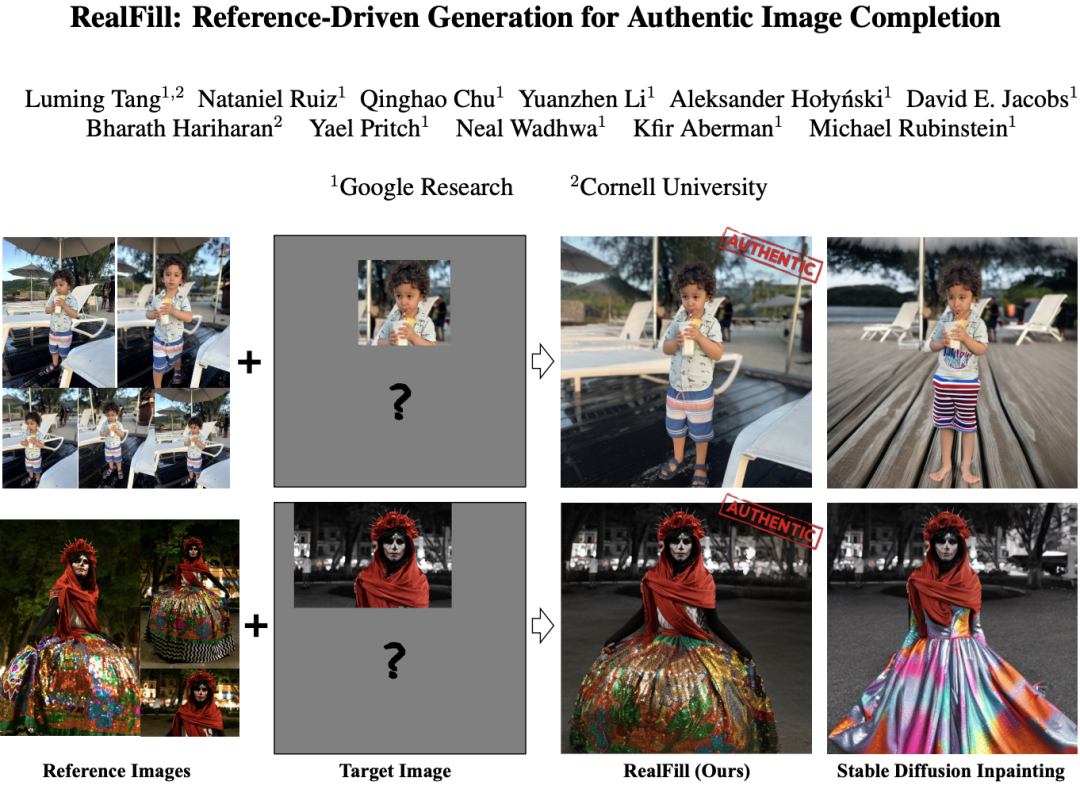

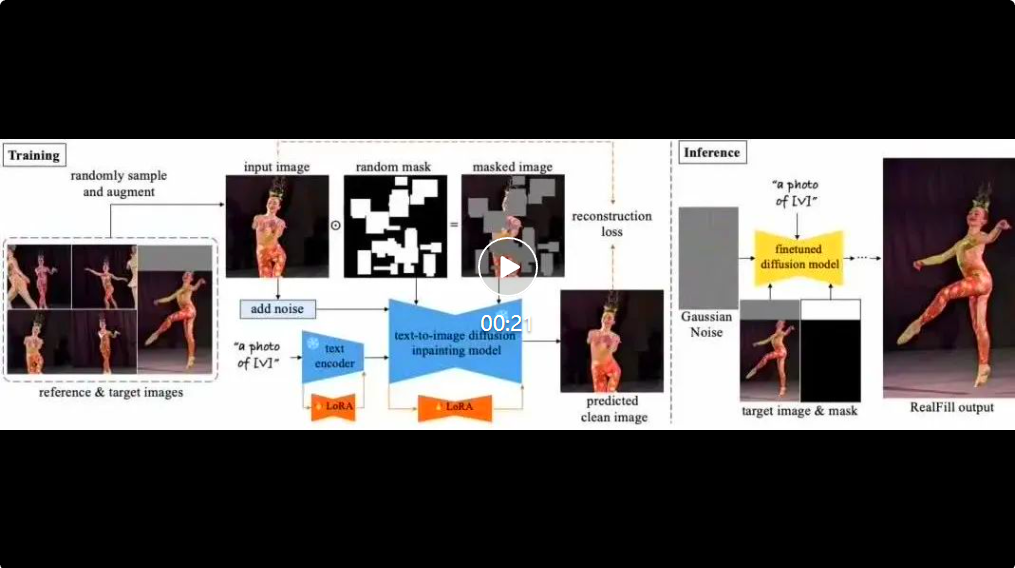

Obtenir une image « parfaite » est l'un des objectifs que recherchent les chercheurs en CV depuis longtemps. Récemment, des chercheurs de Google Research et de l'Université Cornell ont collaboré pour proposer une technologie de « complétion authentique d'images » : RealFill, un modèle génératif pour la complétion d'images.

L'avantage du modèle RealFill est qu'il peut être personnalisé avec un petit nombre d'images de référence de scène qui n'ont pas besoin d'être alignées avec l'image cible et peuvent même varier considérablement en termes d'angle de vue, de conditions d'éclairage, d'ouverture de la caméra ou style d'images. Une fois la personnalisation terminée, RealFill peut compléter l'image cible avec un contenu visuellement attrayant, fidèle à la scène originale.

Veuillez cliquer sur le lien suivant pour consulter l'article : https://arxiv.org/abs/2309.16668

Lien de la page du projet : https://realfill.github.io/

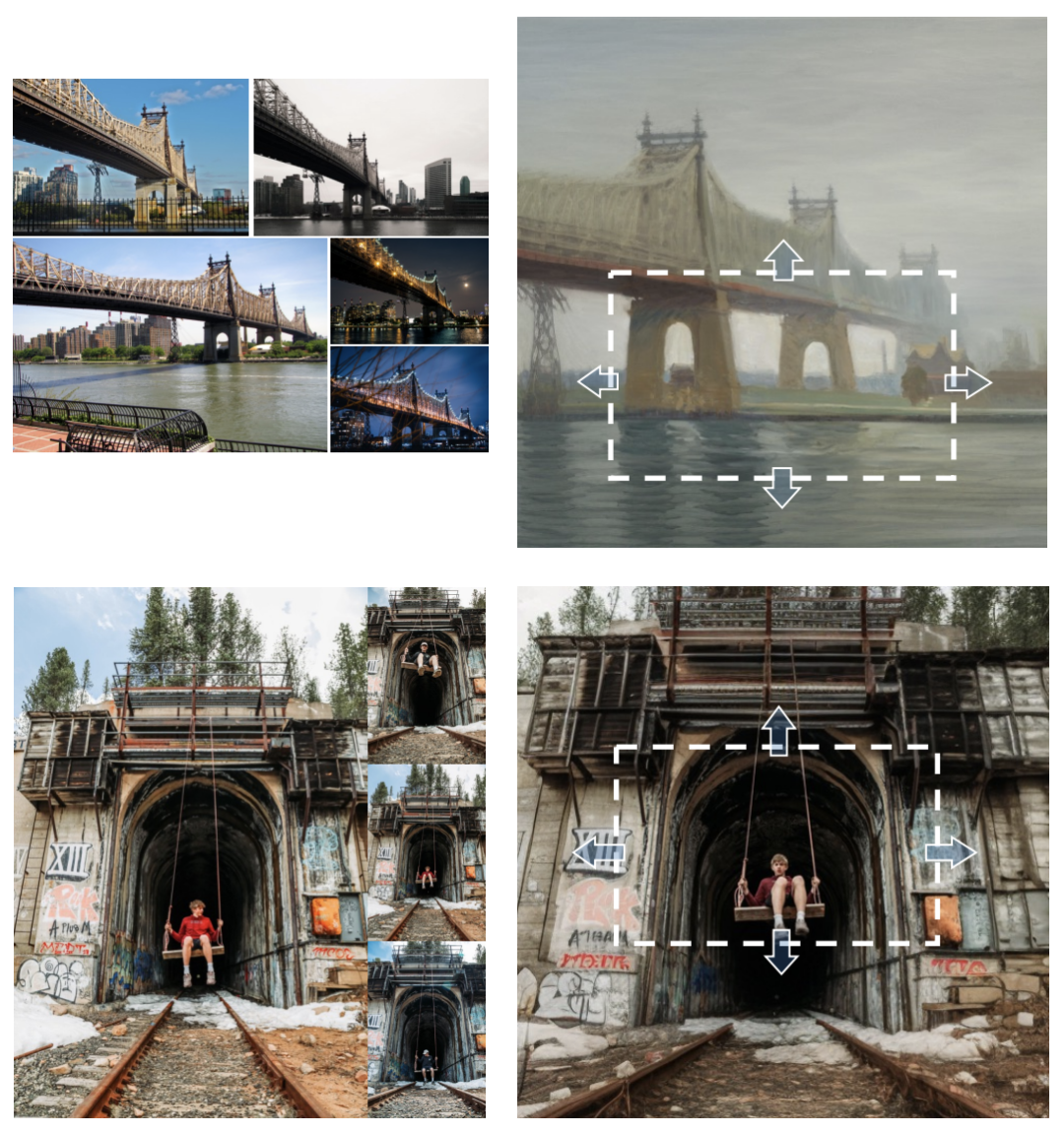

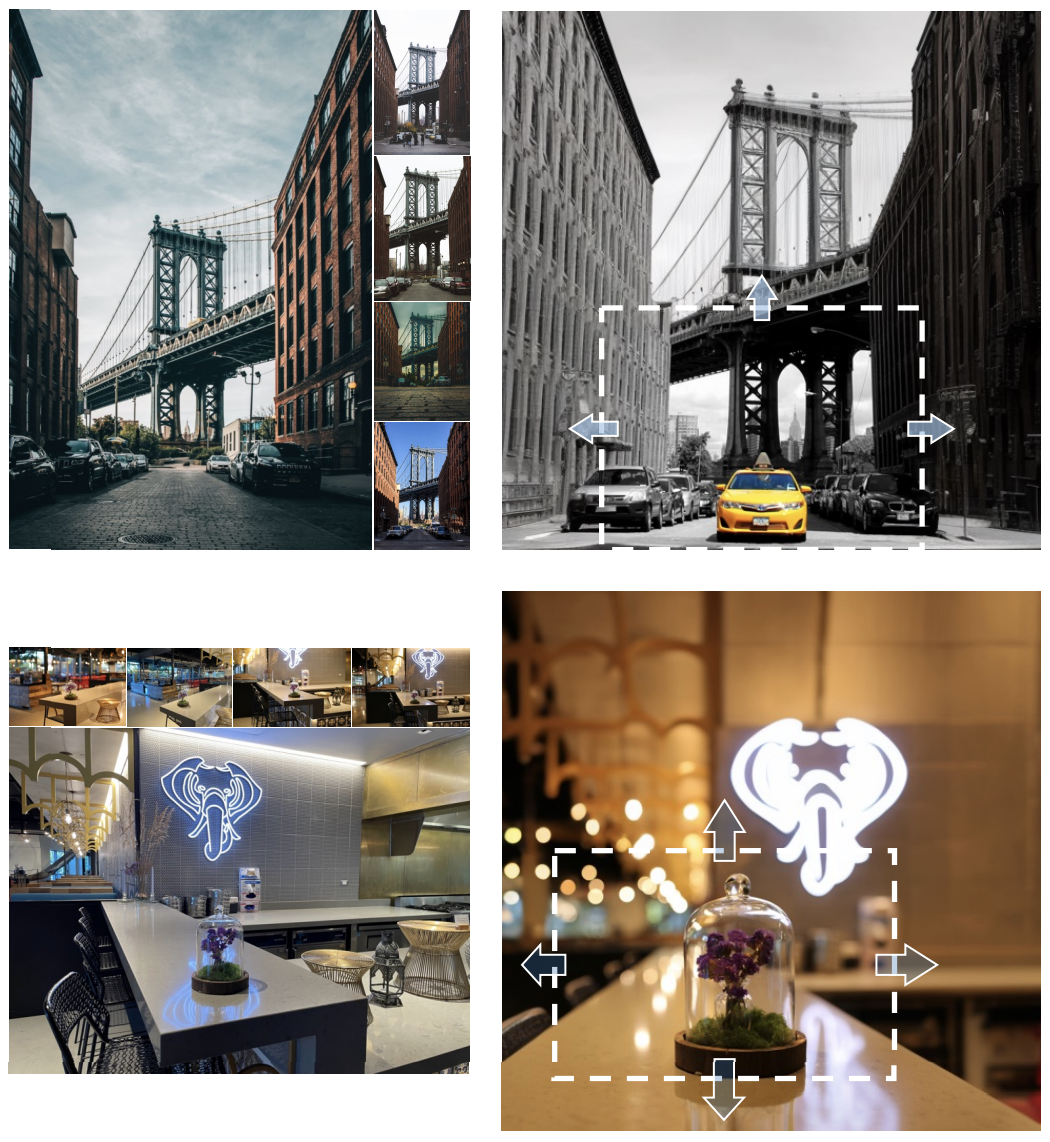

Effet de sortie du modèle RealFill. Étant donné une image de référence à gauche, RealFill peut agrandir l'image cible correspondante à droite. Les zones à l'intérieur de la boîte blanche sont fournies au réseau sous forme de pixels connus, tandis que les zones à l'extérieur de la boîte blanche sont générées. Les résultats montrent que RealFill peut générer des images de haute qualité fidèles à l'image de référence même s'il existe d'énormes différences entre l'image de référence et l'image cible, notamment le point de vue, l'ouverture, l'éclairage, le style d'image et le mouvement de l'objet. Source : Papier

Effet de sortie du modèle RealFill. Étant donné une image de référence à gauche, RealFill peut agrandir l'image cible correspondante à droite. Les zones à l'intérieur de la boîte blanche sont fournies au réseau sous forme de pixels connus, tandis que les zones à l'extérieur de la boîte blanche sont générées. Les résultats montrent que RealFill peut générer des images de haute qualité fidèles à l'image de référence même s'il existe d'énormes différences entre l'image de référence et l'image cible, notamment le point de vue, l'ouverture, l'éclairage, le style d'image et le mouvement de l'objet. Source : Papier

Enfin, les auteurs expriment leur gratitude à leurs collaborateurs :

Nous tenons à remercier Rundi Wu, Qianqian Wang, Viraj Shah, Ethan Weber, Zhengqi Li, Kyle Genova, Boyang Deng, Maya Goldenberg, Noah Snavely, Ben Poole, Ben Mildenhall, Alex Rav-Acha, Pratul Srinivasan, Dor Verbin et Jon Barron pour leurs discussions et commentaires précieux, et nous remercions également Zeya Peng, Rundi Wu et Shan Nan pour leurs contributions à l'ensemble de données d'évaluation. Nous sommes particulièrement reconnaissants à Jason Baldridge, Kihyuk Sohn, Kathy Meier-Hellstern et Nicole Brichtova pour leurs commentaires et leur soutien sur le projet.

Veuillez lire l'article original et visiter la page d'accueil du projet pour plus d'informations

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Ministère de la Science et de la Technologie : apporter un soutien fort à l'intelligence artificielle en tant qu'industrie stratégique émergente

- En se concentrant sur l'écosystème commercial numérique et l'industrie des métaverses, Lujiazui Digital Intelligence World s'efforce de créer un cluster industriel d'éléments de données.

- Le ministère de l'Industrie et des Technologies de l'information a annoncé : Accélérer le développement de l'industrie des interfaces cerveau-ordinateur

- Dirigeant d'Audi : la pénurie de semi-conducteurs a plongé l'industrie automobile allemande dans une période de goulot d'étranglement qui durera plusieurs années

- La taille de l'industrie informatique de la Chine atteint 2 600 milliards de yuans, avec plus de 20,91 millions de serveurs à usage général et 820 000 serveurs d'IA livrés au cours des six dernières années.