Maison >Périphériques technologiques >IA >Explorez les techniques de formation pour les segments de test en monde ouvert à l'aide de méthodes d'auto-formation avec des extensions de prototypes dynamiques

Explorez les techniques de formation pour les segments de test en monde ouvert à l'aide de méthodes d'auto-formation avec des extensions de prototypes dynamiques

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-09-13 14:17:10986parcourir

L'amélioration de la capacité de généralisation du modèle est une base importante pour promouvoir la mise en œuvre de méthodes de perception basées sur la vision. La formation/adaptation au moment du test généralise le modèle à des domaines cibles inconnus en ajustant les poids des paramètres du modèle dans la section de test Segment de distribution des données. . Les méthodes TTT/TTA existantes se concentrent généralement sur l'amélioration des performances de formation des segments de test sous les données du domaine cible dans un monde en boucle fermée.

Cependant, dans de nombreux scénarios d'application, le domaine cible est facilement contaminé par de fortes données hors domaine (Strong OOD), telles que des données sans rapport avec des catégories sémantiques. Ce scénario est également connu sous le nom de Open World Test Segment Training (OWTTT). Dans ce cas, les TTT/TTA existants forcent généralement la classification des données hors domaine fortes en catégories connues, interférant ainsi finalement avec la capacité à résoudre les données hors domaine faibles (Weak OOD) telles que les images qui sont interférées avec by noise

Récemment, l'Université de technologie de Chine du Sud et l'équipe A*STAR ont proposé pour la première fois la mise en place d'une formation de segment de test en monde ouvert et ont lancé la méthode de formation correspondante

- Papier : https ://arxiv.org/abs/2308.09942

- Code : https://github.com/Yushu-Li/OWTTT

Cet article propose d'abord une solide méthode de filtrage d'échantillons de données hors domaine avec seuil adaptatif pour améliorer la méthode d'auto-formation TTT dans le monde ouvert de la robustesse. Le procédé propose en outre une méthode pour caractériser des échantillons forts hors domaine sur la base de prototypes étendus dynamiquement afin d'améliorer l'effet de séparation de données hors domaine faible/fort. Enfin, l'auto-formation est limitée par l'alignement de la distribution

La méthode de cette étude a obtenu les meilleures performances sur 5 benchmarks OWTTT différents et a ouvert une nouvelle direction pour des méthodes TTT plus robustes pour des recherches ultérieures sur TTT. Cette recherche a été acceptée comme document de présentation orale à l'ICCV 2023

Introduction

La formation sur les segments de test (TTT) peut accéder aux données du domaine cible uniquement dans la phase d'inférence et effectuer une inférence à la volée sur des distributions décalées. données de test. Le succès du TTT a été démontré sur un certain nombre de données de domaine cible artificiellement sélectionnées et corrompues. Cependant, les limites des capacités des méthodes TTT existantes n’ont pas été entièrement explorées.

Pour promouvoir les applications TTT dans des scénarios ouverts, la recherche s'est déplacée vers l'étude des scénarios dans lesquels les méthodes TTT peuvent échouer. De nombreux efforts ont été déployés pour développer des méthodes TTT stables et robustes dans des environnements de monde ouvert plus réalistes. Dans ce travail, nous explorons un scénario de monde ouvert courant mais négligé, dans lequel le domaine cible peut contenir des distributions de données de test tirées d'environnements significativement différents, tels que des catégories sémantiques différentes de celles du domaine source, ou simplement du bruit aléatoire.

Nous appelons les données de test ci-dessus des données fortes hors distribution (strong OOD). Ce que l'on appelle dans ce travail des données OOD faibles sont des données de test avec des changements de distribution, tels que des dommages synthétiques courants. Par conséquent, le manque de travaux existants sur cet environnement réaliste nous motive à explorer l’amélioration de la robustesse de l’Open World Test Segment Training (OWTTT), où les données de test sont contaminées par de forts échantillons OOD.

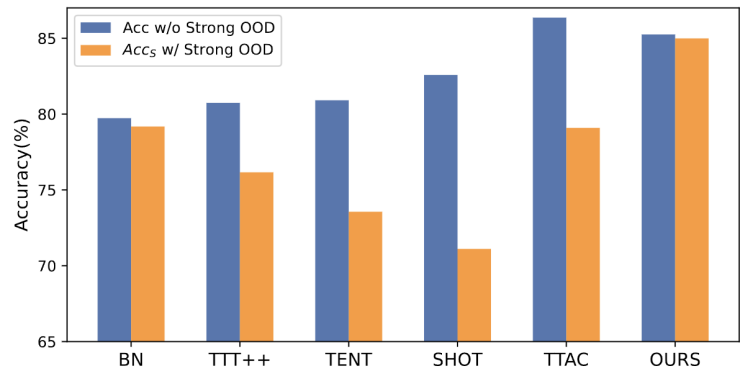

Figure 1 : Résultats de l'évaluation de la méthode TTT existante sous le paramètre OWTTT

Comme le montre la figure 1, nous avons d'abord évalué la méthode TTT existante sous le paramètre OWTTT et avons constaté que les deux méthodes TTT via l'auto -l'alignement de la formation et de la distribution est affecté par de forts échantillons OOD. Ces résultats démontrent qu’une formation sécurisée pendant les tests dans le monde ouvert ne peut pas être obtenue en appliquant les techniques TTT existantes. Nous attribuons leur échec aux deux raisons suivantes.

- Le TTT basé sur l'auto-formation a du mal à gérer des échantillons OOD forts car il doit attribuer des échantillons de test à des catégories connues. Bien que certains échantillons peu fiables puissent être filtrés en appliquant le seuil utilisé dans l’apprentissage semi-supervisé, il n’y a toujours aucune garantie que tous les échantillons OOD forts seront filtrés.

- Les méthodes basées sur l'alignement de la distribution seront affectées lorsque des échantillons OOD forts sont calculés pour estimer la distribution du domaine cible. L'alignement de la distribution globale [1] et l'alignement de la distribution des classes [2] peuvent être affectés et conduire à un alignement inexact de la distribution des fonctionnalités.

Afin de résoudre les raisons potentielles de l'échec des méthodes TTT existantes, nous proposons une méthode qui combine deux technologies pour améliorer la robustesse du TTT en monde ouvert dans un cadre d'auto-formation

Tout d'abord, nous construisons la base de référence de TTT sur la variante auto-entraînée, c'est-à-dire le clustering dans le domaine cible avec le prototype du domaine source comme centre du cluster. Pour atténuer l'impact de l'auto-formation sur les OOD forts avec des pseudo-étiquettes incorrectes, nous concevons une méthode sans hyperparamètres pour rejeter les échantillons OOD forts.

Pour séparer davantage les caractéristiques des échantillons OOD faibles et des échantillons OOD forts, nous permettons au pool de prototypes de s'étendre en sélectionnant des échantillons OOD forts isolés. Par conséquent, l’auto-formation permettra aux échantillons OOD forts de former des groupes serrés autour du prototype OOD fort nouvellement développé. Cela facilitera l’alignement de la distribution entre les domaines source et cible. Nous proposons en outre de régulariser l'auto-formation grâce à un alignement de la distribution mondiale afin de réduire le risque de biais de confirmation.

Enfin, pour synthétiser des scénarios TTT en monde ouvert, nous adoptons les ensembles de données CIFAR10-C, CIFAR100-C, ImageNet-C, VisDA-C, ImageNet-R, Tiny-ImageNet, MNIST et SVHN, et utilisons un Les données l'ensemble est un OOD faible et les autres sont un OOD fort pour établir un ensemble de données de référence. Nous appelons cette référence l'Open World Test Segment Training Benchmark et espérons que cela encouragera davantage de travaux futurs à se concentrer sur la robustesse de la formation des segments de test dans des scénarios plus réalistes.

Méthode

L'article divise la méthode proposée en quatre parties pour présenter

1) Aperçu du paramétrage du segment de test tâche de formation dans le monde ouvert.

2) Décrit comment implémenter TTT via Réécrire le contenu comme : analyse de cluster et comment étendre le prototype pour une formation en temps de test en monde ouvert.

3) Présente comment utiliser les données du domaine cible pour l'expansion dynamique du prototype.

4) Présentation de Distribution Alignment combiné à un contenu réécrit : analyse de cluster pour obtenir une puissante formation en temps de test en monde ouvert.

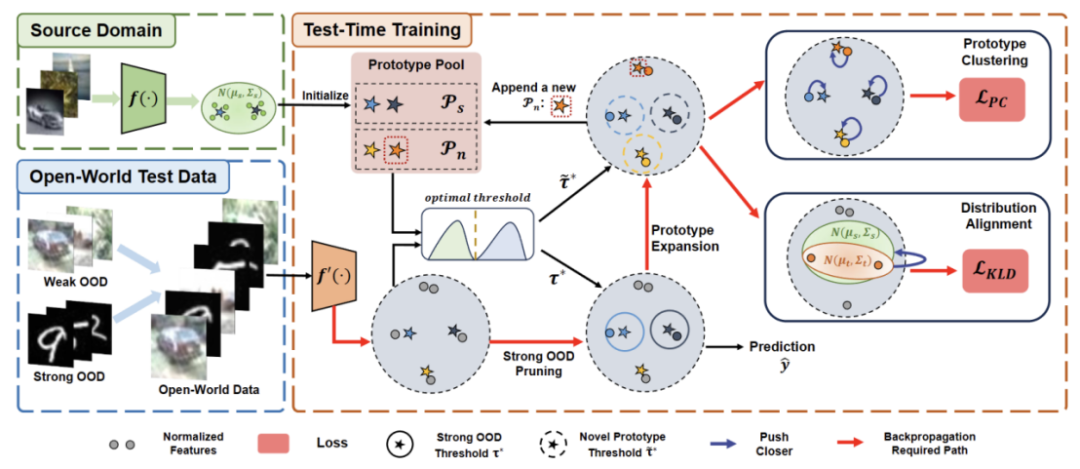

Figure 2 : Présentation de la méthode

Paramètre de la tâche

Le but de TTT est d'adapter le modèle pré-entraîné du domaine source au domaine cible, où le domaine cible peut présenter des différences par rapport à la migration de distribution du domaine source. Dans le TTT standard en monde fermé, les espaces d'étiquettes des domaines source et cible sont les mêmes. Cependant, dans le TTT en monde ouvert, l'espace d'étiquettes du domaine cible contient l'espace cible du domaine source, ce qui signifie que le domaine cible a de nouvelles catégories sémantiques inédites

Afin d'éviter toute confusion entre les définitions de TTT, nous adoptons TTAC [2 Le protocole d'entraînement au temps de test séquentiel (sTTT) proposé dans ] est évalué. Dans le cadre du protocole sTTT, les échantillons de test sont testés séquentiellement et les mises à jour du modèle sont effectuées après avoir observé de petits lots d'échantillons de test. La prédiction pour tout échantillon de test arrivant à l'horodatage t n'est affectée par aucun échantillon de test arrivant à t+k (dont k est supérieur à 0).

Contenu réécrit comme : Analyse de cluster

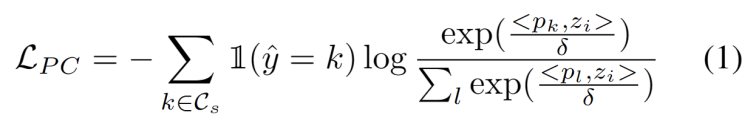

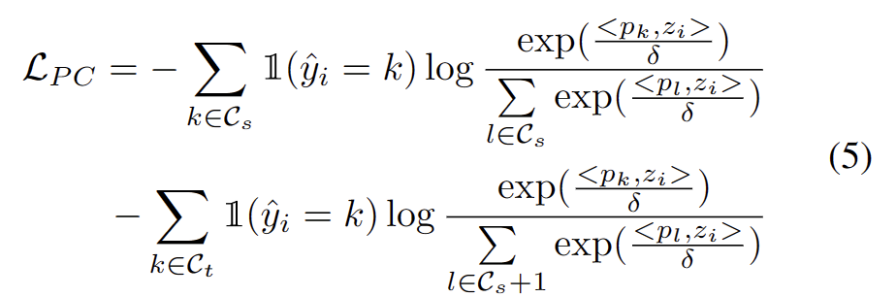

Inspiré par les travaux utilisant le clustering dans les tâches d'adaptation de domaine [3,4], nous traitons la formation de segments de test comme la découverte de structures de cluster dans les données du domaine cible. En identifiant des prototypes représentatifs en tant que centres de cluster, les structures de cluster sont identifiées dans le domaine cible et les échantillons de test sont encouragés à s'intégrer à proximité de l'un des prototypes. Le contenu réécrit est le suivant : L'objectif de l'analyse groupée est défini comme minimisant la perte de log-vraisemblance négative de la similarité cosinus entre l'échantillon et le centre de la grappe, comme le montre la formule suivante.

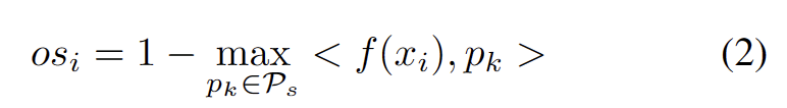

Nous développons une méthode sans hyperparamètres pour filtrer les échantillons OOD forts afin d'éviter l'impact négatif de l'ajustement des poids des modèles. Plus précisément, nous définissons un score OOD fort pour chaque échantillon de test comme la plus grande similarité avec le prototype du domaine source, comme le montre l'équation suivante.

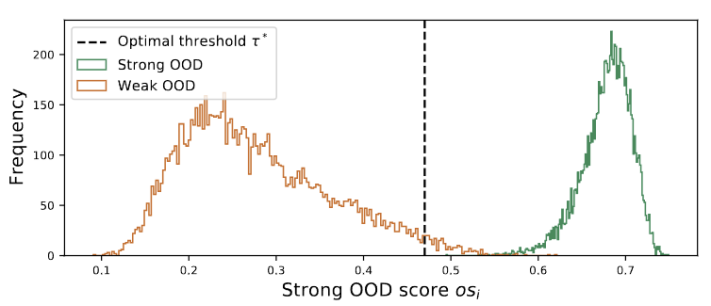

Les valeurs aberrantes de la figure 3 montrent une distribution bimodale

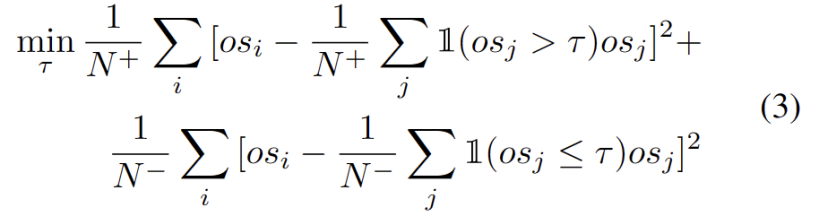

Nous observons que les valeurs aberrantes suivent une distribution bimodale, comme le montre la figure 3. Par conséquent, au lieu de spécifier un seuil fixe, nous définissons le seuil optimal comme la meilleure valeur séparant les deux distributions. Plus précisément, le problème peut être formulé en divisant les valeurs aberrantes en deux groupes, et le seuil optimal minimisera la variance au sein du groupe. L'optimisation de l'équation suivante peut être réalisée efficacement en recherchant de manière exhaustive tous les seuils possibles de 0 à 1 par pas de 0,01.

Extension de prototype dynamique

L'expansion du pool de prototypes OOD forts nécessite de prendre en compte à la fois le domaine source et le prototype OOD fort pour évaluer les échantillons de test. Pour estimer dynamiquement le nombre de clusters à partir des données, des études antérieures ont étudié des problèmes similaires. L'algorithme déterministe de clustering dur DP-means [5] a été développé en mesurant la distance des points de données aux centres de cluster connus, et un nouveau cluster est initialisé lorsque la distance est supérieure à un seuil. DP-means s'avère équivalent à l'optimisation de l'objectif K-means mais avec une pénalité supplémentaire sur le nombre de clusters, fournissant une solution réalisable pour l'expansion dynamique des prototypes.

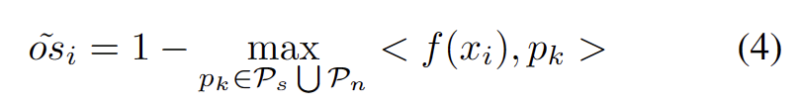

Pour atténuer la difficulté d'estimer des hyperparamètres supplémentaires, nous définissons d'abord un échantillon de test avec un score OOD fort étendu comme la distance la plus proche du prototype de domaine source existant et du prototype OOD fort, comme suit. Par conséquent, tester des échantillons au-dessus de ce seuil permettra de construire un nouveau prototype. Pour éviter d'ajouter des échantillons de test à proximité, nous répétons progressivement ce processus d'expansion du prototype.

Avec d'autres prototypes OOD forts identifiés, nous avons défini la réécriture de l'échantillon de test comme : perte d'analyse de cluster, en tenant compte de deux facteurs. Premièrement, les échantillons de test classés dans des classes connues doivent être intégrés plus près des prototypes et plus éloignés des autres prototypes, ce qui définit la tâche de classification en classe K. Deuxièmement, les échantillons de test classés comme prototypes OOD forts doivent être éloignés de tout prototype du domaine source, ce qui définit la tâche de classification de classe K+1. En gardant ces objectifs à l’esprit, nous réécrirons le contenu comme suit : La perte de l’analyse groupée est définie comme l’équation suivante.

Les contraintes d'alignement distribué signifient que dans une conception ou une mise en page, les éléments doivent être disposés et alignés d'une manière spécifique. Cette contrainte peut être appliquée à une variété de scénarios différents, notamment la conception Web, la conception graphique et l'aménagement de l'espace. En utilisant des contraintes d'alignement distribuées, la relation entre les éléments peut être rendue plus claire et plus unifiée, améliorant ainsi l'esthétique et la lisibilité de la conception globale.

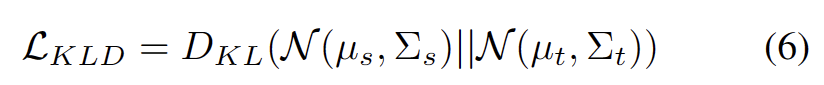

Il est bien connu que l'auto-apprentissage est sensible aux pseudo-étiquettes erronées. La situation est aggravée lorsque le domaine cible est constitué d'échantillons OOD. Pour réduire le risque d'échec, nous utilisons en outre l'alignement de distribution [1] comme régularisation pour l'auto-formation, comme suit.

Expériences

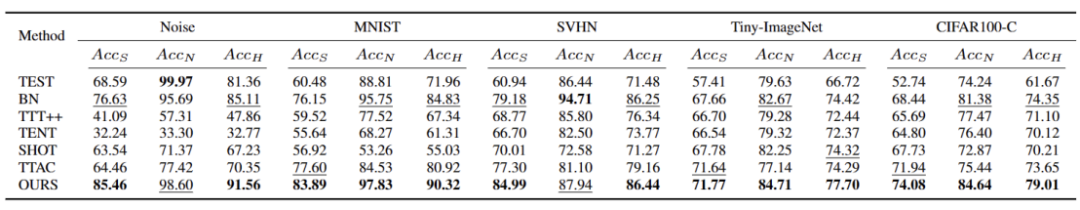

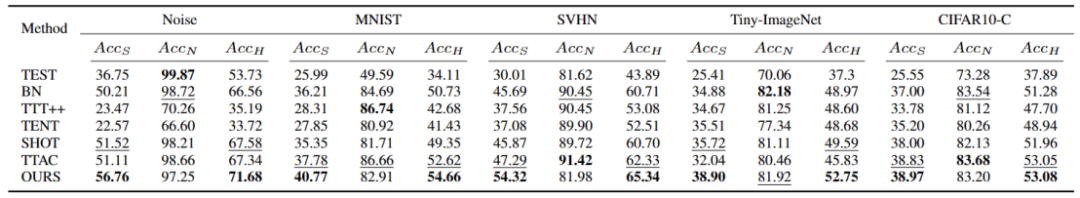

Nous avons testé sur 5 ensembles de données de référence OWTTT différents, y compris des ensembles de données synthétiques corrompus et des ensembles de données de style variable. L'expérience utilise principalement trois indicateurs d'évaluation : une faible précision de classification OOD ACCS, une forte précision de classification OOD ACCN et la moyenne harmonique des deux ACCH

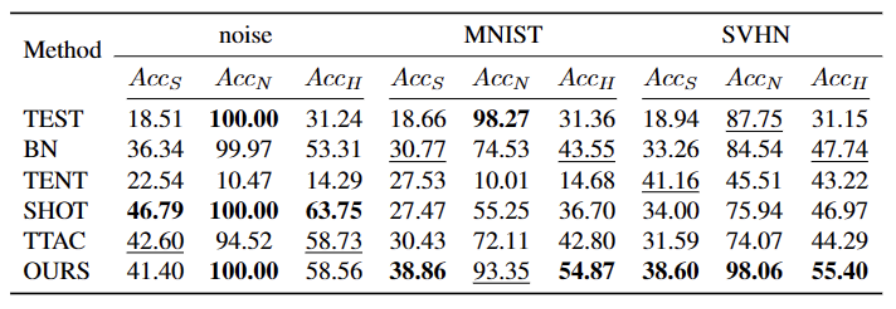

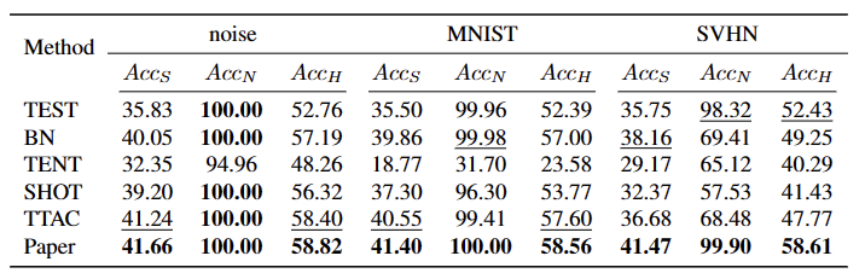

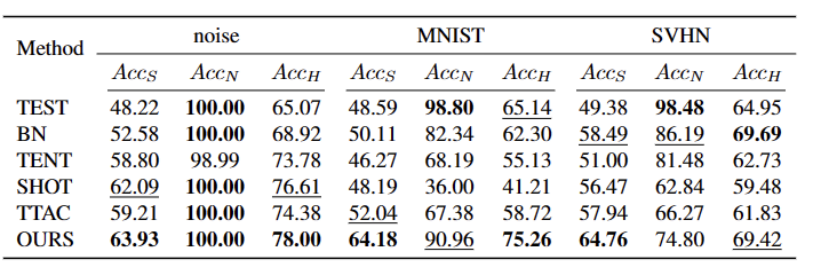

Ce qui doit être réécrit est : L'ensemble de données Cifar10-C est différent La performance de la méthode est présentée dans le tableau ci-dessous

Le contenu qui doit être réécrit est : Les performances des différentes méthodes dans l'ensemble de données Cifar100-C sont présentées dans le tableau ci-dessous :

Le contenu qui doit être réécrit est le suivant : Sur l'ensemble de données ImageNet-C, les performances des différentes méthodes sont présentées dans le tableau ci-dessous

Tableau 4 Performances des différentes méthodes sur l'ensemble de données ImageNet-R

Tableau 5 Performances des différentes méthodes sur l'ensemble de données VisDA-C

Notre méthode est cohérente sur presque toutes les données sets Par rapport aux meilleures méthodes actuelles, il existe des améliorations significatives, comme le montre le tableau ci-dessus. Il peut identifier efficacement les échantillons OOD forts et réduire l'impact sur la classification des échantillons OOD faibles. Par conséquent, dans le scénario du monde ouvert, notre méthode peut obtenir un TTT plus robuste

Résumé

Cet article propose d'abord les problèmes et les paramètres de la formation de segments de test en monde ouvert (OWTTT), en soulignant l'existant. Nous rencontrons des difficultés lors du traitement de données du domaine cible contenant des échantillons OOD forts qui présentent des décalages sémantiques par rapport aux échantillons du domaine source. Une méthode d'auto-apprentissage basée sur l'expansion dynamique de prototypes est proposée pour résoudre les problèmes ci-dessus. Nous espérons que ce travail pourra fournir de nouvelles orientations pour les recherches ultérieures sur le TTT afin d'explorer des méthodes TTT plus robustes

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Comment utiliser le framework de tests unitaires PHP PHPUnit

- qu'est-ce que les tests unitaires Java

- PHP 8 est là ! L'équipe PHP publie la première version bêta Alpha1

- Le premier examen gouvernemental de ChatGPT pourrait provenir de la Commission fédérale du commerce des États-Unis, OpenAI : GPT5 pas encore formé

- Zoom garantit la transparence dans l'utilisation des données et garantit que la formation en IA est soumise à l'autorisation de l'utilisateur