Maison >développement back-end >Tutoriel Python >Comment implémenter la classification linéaire à l'aide de Python Scikit-learn ?

Comment implémenter la classification linéaire à l'aide de Python Scikit-learn ?

- PHPzavant

- 2023-08-20 18:57:02927parcourir

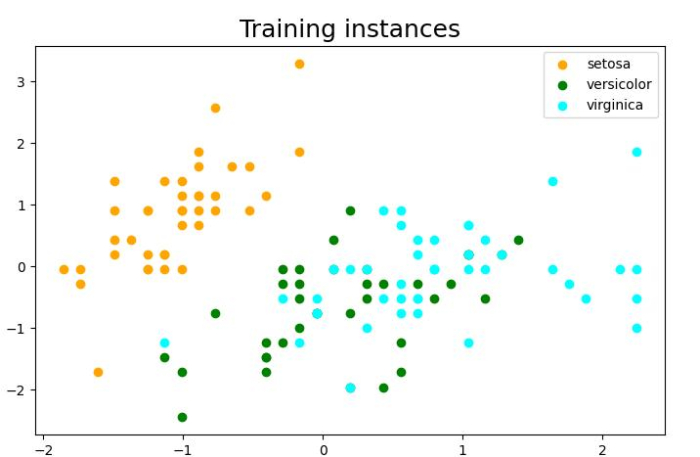

Classification linéaire est l'un des problèmes d'apprentissage automatique les plus simples. Pour obtenir une classification linéaire, nous utiliserons le classificateur SGD (Stochastic Gradient Descent) de sklearn pour prédire les variétés de fleurs d'iris.

Étapes

Vous pouvez implémenter la classification linéaire à l'aide de Python Scikit-learn en suivant les étapes ci-dessous :

Étape 1 − Importez d'abord les packages nécessaires scikit-learn, NumPy et matplotlib

Étape 2 − Chargez l'ensemble de données et créez des ensembles de données de formation et de test.

Étape 3 - Utilisez matplotlib pour dessiner l'instance de formation. Bien que cette étape soit facultative, il est conseillé de démontrer l'exemple plus clairement.

Étape 4 - Créez un objet du classificateur SGD, initialisez ses paramètres et entraînez le modèle à l'aide de la méthode fit().

Étape 5 − Évaluez les résultats à l'aide du package métrique de la bibliothèque Python Scikit-learn.

Exemple

se traduit par :Exemple

Regardons l'exemple ci-dessous où nous allons prédire l'espèce d'une fleur d'iris en utilisant deux caractéristiques de la fleur d'iris, à savoir la largeur et la longueur des sépales.

# Import required libraries

import sklearn

import numpy as np

import matplotlib.pyplot as plt

# %matplotlib inline

# Loading Iris flower dataset

from sklearn import datasets

iris = datasets.load_iris()

X_data, y_data = iris.data, iris.target

# Print iris data shape

print ("Original Dataset Shape:",X_data.shape, y_data.shape)

# Dividing dataset into training and testing dataset and standarized the features

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

# Getting the Iris dataset with only the first two attributes

X, y = X_data[:,:2], y_data

# Split the dataset into a training and a testing set(20 percent)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.20, random_state=1)

print ("\nTesting Dataset Shape:", X_train.shape, y_train.shape)

# Standarize the features

scaler = StandardScaler().fit(X_train)

X_train = scaler.transform(X_train)

X_test = scaler.transform(X_test)

# Plot the dataset

# Set the figure size

plt.figure(figsize=(7.16, 3.50))

plt.subplots_adjust(bottom=0.05, top=0.9, left=0.05, right=0.95)

plt.title('Training instances', size ='18')

colors = ['orange', 'green', 'cyan']

for i in range(len(colors)):

px = X_train[:, 0][y_train == i]

py = X_train[:, 1][y_train == i]

plt.scatter(px, py, c=colors[i])

plt.legend(iris.target_names)

plt.xlabel('Sepal length')

plt.ylabel('Sepal width')

plt.show()

# create the linear model SGDclassifier

from sklearn.linear_model import SGDClassifier

linear_clf = SGDClassifier()

# Train the classifier using fit() function

linear_clf.fit(X_train, y_train)

# Print the learned coeficients

print ("\nThe coefficients of the linear boundary are:", linear_clf.coef_)

print ("\nThe point of intersection of the line are:",linear_clf.intercept_)

# Evaluate the result

from sklearn import metrics

y_train_pred = linear_clf.predict(X_train)

print ("\nThe Accuracy of our classifier is:", metrics.accuracy_score(y_train, y_train_pred)*100)

Sortie

Il produira le résultat suivant

Original Dataset Shape: (150, 4) (150,) Testing Dataset Shape: (120, 2) (120,) The coefficients of the linear boundary are: [[-28.85486061 13.42772422] [ 2.54806641 -5.04803702] [ 7.03088805 -0.73391906]] The point of intersection of the line are: [-19.61738307 -3.54055412 -0.35387805]

La précision de notre classificateur : 76.66666666666667

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!