Maison >Périphériques technologiques >IA >Lancement de la nouvelle génération de grand modèle d'IA « Zidong Taichu 2.0 » auto-développé par l'Académie chinoise des sciences

Lancement de la nouvelle génération de grand modèle d'IA « Zidong Taichu 2.0 » auto-développé par l'Académie chinoise des sciences

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-06-16 17:35:551508parcourir

IT Home Selon les informations du 16 juin, l'Institut d'automatisation de l'Académie chinoise des sciences a publié ce matin une nouvelle génération de grand modèle d'intelligence artificielle développée par l'institut de Shanghai - Zidong Taichu 2.0.

Selon les rapports, par rapport à la première génération, le nouveau grand modèle se concentre sur l'amélioration des capacités de prise de décision et de jugement, en passant de la perception, de la cognition à la prise de décision, et jouera un rôle plus important dans les domaines des soins médicaux, le transport, la production industrielle et d'autres domaines à l'avenir.

Selon les rapports précédents d'IT House, le grand modèle d'IA de première génération de Zidong Taichu a été lancé en 2021. Il a été développé conjointement par l'Institut d'automatisation, l'Académie chinoise des sciences et Huawei, et est considéré comme « le premier multimodal au monde ». grand modèle avec 100 milliards de paramètres.

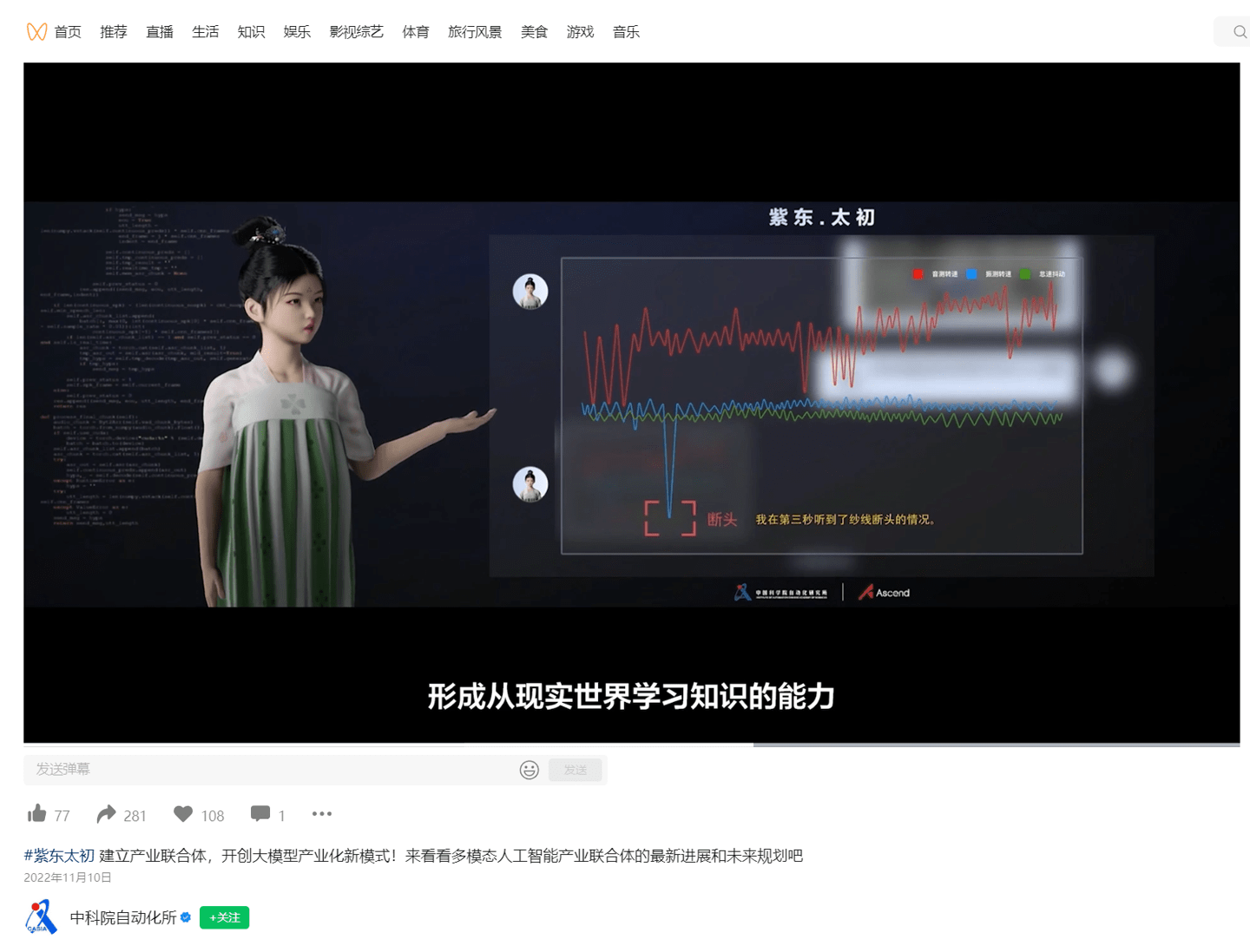

Différent de la plupart des grands modèles de langage actuels qui sont principalement basés sur du texte, le grand modèle « Zidong Taichu » s'appuie sur la technologie multimodale au début de son développement, utilisant davantage de types de données telles que des images, de l'audio, et texte pour la modélisation intermodale. La représentation et l'apprentissage unifiés réalisent la « représentation unifiée » et la « génération mutuelle » des données trimodales d'image, de texte et de voix.

Selon les rapports, Zidong Taichu 2.0 est basé sur la plate-forme logicielle et matérielle domestique complète de Huawei, Shengteng AI et Shengsi MindSpore, et est construit conjointement par l'Institut d'automatisation de l'Académie chinoise des sciences et l'Institut d'intelligence artificielle de Wuhan.

Sur la base du texte, des images et de l'audio, "Zidong Taichu" 2.0 peut intégrer davantage de données modales telles que la 3D, la vidéo et les signaux de capteurs, et optimiser des fonctions telles que la cognition intégrée de la voix, de la vidéo et du texte, ainsi que le bon sens. calcul. En outre, « briser les barrières d’interaction de la perception, de la cognition et de la prise de décision ».

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI