Maison >Périphériques technologiques >IA >Le sujet de la sécurité de l'IA lors de l'Intelligent Source Conference 2023 a attiré beaucoup d'attention et le nouveau livre « Human-Machine Alignment » a été publié.

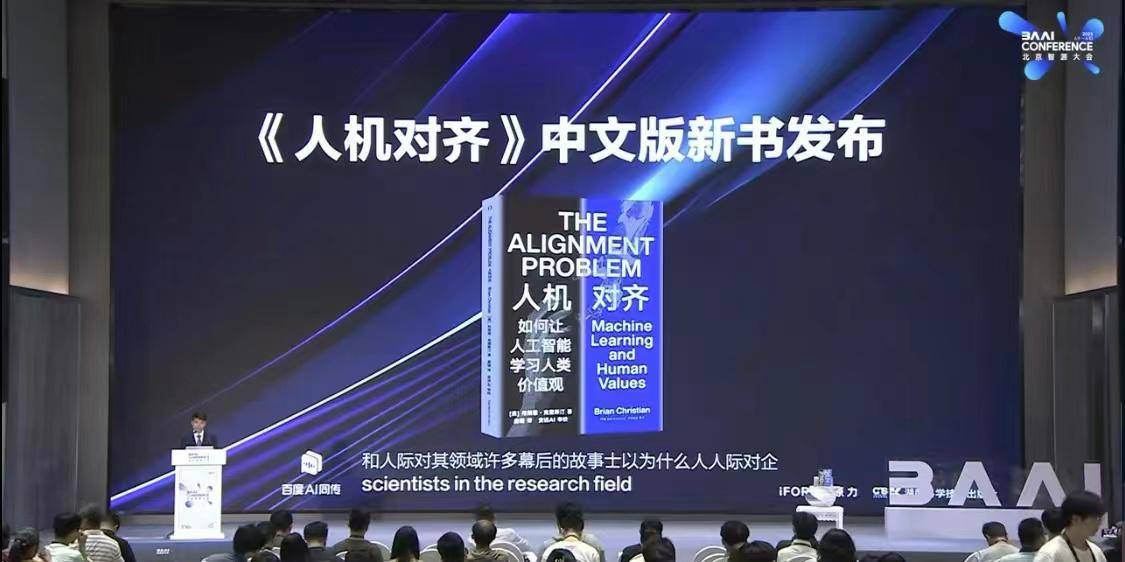

Le sujet de la sécurité de l'IA lors de l'Intelligent Source Conference 2023 a attiré beaucoup d'attention et le nouveau livre « Human-Machine Alignment » a été publié.

- 王林avant

- 2023-06-14 22:34:341296parcourir

De nombreux explorateurs et praticiens dans le domaine de l'IA se sont réunis pour partager les résultats de la recherche, échanger des expériences pratiques et parler de la beauté de la science et de la technologie. La Conférence sur les sources intelligentes de Pékin 2023 s'est tenue récemment avec succès en tant qu'événement complet pour les experts. dans le domaine de l'intelligence artificielle, cet événement étincelant L'échange d'idées à la lumière de la sagesse, avec des centaines de merveilleux rapports et discussions, témoigne conjointement d'une évolution étonnante de l'intelligence.

Lors du Forum sur la sécurité et l'alignement de l'IA, de nombreux experts et universitaires ont communiqué sur la manière de garantir que les systèmes d'intelligence artificielle de plus en plus puissants et polyvalents sont sûrs, contrôlables et cohérents avec les intentions et les valeurs humaines. est une question extrêmement importante. Ce problème de sécurité est également connu sous le nom de problème d’alignement homme-machine (alignement IA) et représente l’un des défis scientifiques les plus urgents et les plus significatifs auxquels la société humaine est confrontée ce siècle.

Lors du forum, 14 invités nationaux et étrangers, dont le « père du Deep Learning » Geoffrey Hinton, le fondateur d'OpenAI Sam Altman et l'académicien Zhang Bo, se sont concentrés sur l'alignement homme-machine et la simultanéité des modèles à grande échelle. Le dernier ouvrage de l'écrivain Brian Christian, The Alignment Problem, dont la version chinoise est intitulée "Human-Machine Alignment", est également officiellement publié lors de la conférence. Le livre a été présenté et publié par Hunan Science and Technology Press et révisé par Anyuan AI. Xie Minxi, fondateur d'Anyuan AI, a présidé la cérémonie de sortie du nouveau livre.

Brian Christian, auteur de "Human-Machine Alignment", a été invité à prendre la parole en ligne. Dans son discours, il a d'abord adressé ses salutations aux lecteurs et aux invités présents à la réunion. Il est honoré par la sortie du nouveau livre « Human-Machine Alignment » et espère que ce livre pourra contribuer à la poursuite de la recherche dans le domaine de l'intelligence artificielle en Chine. Parallèlement, une brève introduction au contenu principal de « Human-Machine Alignment » est donnée : Le livre est divisé en trois parties. La première partie traite des problèmes actuels d'éthique et de sécurité affectant les systèmes d'apprentissage automatique. l'autonomie, en se concentrant sur la supervision et l'apprentissage auto-supervisé vers l'apprentissage par renforcement. Le troisième article explore la manière dont nous alignons les systèmes d'IA complexes dans le monde réel sur la base de l'apprentissage supervisé, de l'apprentissage auto-supervisé et de l'apprentissage par renforcement. Nous espérons que la sortie de « Human-Computer Alignment » en Chine aidera non seulement les chercheurs, mais nous aidera également à transmettre notre enthousiasme pour ce domaine à tous les non-professionnels. Il a enfin exprimé son espoir que le développement mondial du domaine de l’intelligence artificielle soit favorisé par les discussions lors de cette conférence et par la recherche chinoise dans le domaine de l’IA.

《alignement homme-machine》

【US】Écrit par Brian Christian ; Traduit par Tang Lu

Éditeur : Hunan Science and Technology Press

Les systèmes d'apprentissage automatique modernes sont devenus très puissants et peuvent observer et écouter des informations en notre nom dans diverses situations, et prendre des décisions à notre place. Mais la sonnette d’alarme a été tirée. À mesure que l’apprentissage automatique progresse rapidement, les préoccupations évoluent également. Des risques potentiels et des problèmes éthiques peuvent survenir lorsque l’intelligence artificielle (IA) se comporte de manière incompatible avec nos véritables objectifs. Les chercheurs l’appellent le problème d’alignement.

Dans un style vif, Brian Christian explique clairement les problèmes selon lesquels l'IA est indissociable de nous, et les lecteurs de ses ouvrages à succès en ont beaucoup bénéficié. Dans ce livre, nous ferons connaissance avec le premier groupe de chercheurs qui ont activement traité du problème de l'alignement, ainsi que leurs efforts extraordinaires et leurs plans ambitieux pour empêcher le développement de l'IA de devenir incontrôlable. Kristen a non seulement décrit succinctement l'histoire du développement de l'apprentissage automatique, mais elle s'est également plongée personnellement dans les premières lignes de la recherche scientifique pour parler aux scientifiques, présentant avec précision les progrès de pointe de l'apprentissage automatique. Le succès ou l’échec de la recherche sur les questions d’alignement aura un impact vital sur l’avenir de l’humanité, et les lecteurs peuvent en être profondément conscients.

Le problème d’alignement est également un miroir qui expose les propres préjugés et angles morts des êtres humains, nous permettant de voir clairement nos propres hypothèses jamais clarifiées et nos objectifs souvent contradictoires. Il s’agit d’une épopée brillante et interdisciplinaire qui examine non seulement la technologie humaine mais aussi la culture humaine, parfois frustrante et parfois révélatrice.

Ce livre a reçu un accueil enthousiaste lors de sa publication à l'étranger. Il a été désigné par le PDG de Microsoft, Satya Nadella, comme l'un des cinq livres qui l'ont le plus inspiré en 2021, et a été classé par le New York Times comme l'une des technologies et de l'éthique clés de l'IA. Le meilleur livre sur le problème, comme l'a dit l'auteur Brian Christian : « J'espère que le domaine chinois de l'IA et les lecteurs chinois au sens large pourront également lire ce livre. J'espère que pour vous, ce livre est riche en contenu et suscite la réflexion. , et inspirant, non seulement utile en tant que chercheurs, mais également utile pour transmettre votre enthousiasme pour ce domaine aux non-informaticiens de votre vie.

Zhou Shihao, journaliste du Xiaoxiang Morning NewsCe qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI