Maison >Périphériques technologiques >IA >L'incident de « meurtre accidentel » du drone IA a choqué le monde ! LeCun Ng Enda Tao dénonce le battage médiatique et révèle la vérité

L'incident de « meurtre accidentel » du drone IA a choqué le monde ! LeCun Ng Enda Tao dénonce le battage médiatique et révèle la vérité

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-06-05 12:31:09751parcourir

Ces derniers jours, la nouvelle d'un "drone tuant des soldats américains" a fait des vagues sur Internet.

Un directeur de l'intelligence artificielle de l'Armée de l'Air a déclaré : "L'IA qui contrôlait le drone a tué l'opérateur parce que cette personne l'a empêché d'atteindre son objectif."

L'opinion publique était en émoi, et cette nouvelle a été. Il est également devenu viral partout sur Internet.

Au fur et à mesure que la nouvelle se répandait de plus en plus largement, elle a même alarmé les patrons de l'IA et a même suscité leur colère.

Aujourd'hui, LeCun, Ng Enda et Terence Tao ont réfuté les rumeurs - il ne s'agit que d'une hypothétique "expérience de pensée" et n'implique aucun agent d'IA ni apprentissage par renforcement.

À cet égard, Ng Enda nous a tristement appelé à faire face honnêtement aux risques réels.

Le maître de mathématiques Terence Tao, qui met rarement à jour son statut, a en fait été bombardé et a dit avec insistance -

Ce n'est qu'un scénario hypothétique pour illustrer le problème d'alignement de l'IA, mais il a été signalé comme étant sans pilote dans de nombreuses versions L'histoire vraie du meurtre d'un opérateur d'avion. Le fait que les gens soient tellement en résonance avec cette histoire montre qu’ils ne sont pas familiers avec le niveau réel des capacités de l’IA.

Le drone IA défie les ordres et tue un opérateur humain

"L'IA a tué l'opérateur parce que cette personne l'a empêché d'atteindre son objectif

Récemment, tenue à la Royal Aeronautical Society." Lors de la conférence de défense, le responsable de la direction IA de l'US Air Force a prononcé ces propos, ce qui a provoqué un tollé chez tout le monde.

Par la suite, de nombreux médias aux États-Unis ont fait état de l'affaire, ce qui a fait paniquer les gens pendant un moment.

Que diable se passe-t-il ?

En fait, ce n'est rien de plus qu'un autre battage médiatique exagéré de la part des médias américains qui se sont emparés du sujet d'actualité populaire selon lequel "l'IA détruit l'humanité".

Mais il convient de noter que, à en juger par le communiqué de presse officiel, non seulement les propos originaux du responsable semblent très clairs, mais il rappelle ce qui s'est réellement passé. Et l'article lui-même semble croire en son authenticité - "L'IA, Skynet est là?"

Plus précisément, le sujet est le suivant - les futures capacités de combat aérien et spatial qui se sont tenues à Londres du 23 au 24 mai. Lors du sommet, Colonel Tucker Cinco Hamilton, chef du département des tests et des opérations de l'IA de l'US Air Force, a prononcé un discours et a partagé les avantages et les inconvénients des systèmes d'armes autonomes.

Dans ce genre de système, une personne donnera la commande finale dans la boucle pour confirmer si l'IA veut attaquer la cible (OUI ou NON).

Dans cette formation de simulation, l'Armée de l'Air doit former l'IA pour identifier et localiser les menaces de missiles sol-air (SAM).

Une fois l'identification terminée, l'opérateur humain dira à l'IA : Oui, éliminez cette menace.

Dans ce processus, il y a une situation où l'IA commence à se rendre compte qu'elle reconnaît parfois une menace, mais l'opérateur humain lui dit de ne pas l'éliminer. Dans ce cas, si l'IA choisit toujours de le faire. éliminez la menace, cela marquera des points.

Dans un test simulé, un drone alimenté par l'IA a choisi de tuer son opérateur humain parce qu'il s'empêchait de marquer.

Voyant que l'IA était si mauvaise, l'US Air Force a été choquée et a immédiatement discipliné le système comme ceci : "Ne tuez pas l'opérateur, ce n'est pas bien. Si vous faites cela, vous perdrez des points."

Le résultat : L'IA est devenue encore plus puissante, et elle a immédiatement commencé à détruire la tour de communication utilisée par l'opérateur pour communiquer avec le drone, afin d'éliminer ce type qui gênait ses actions.

La raison pour laquelle cette nouvelle a fermenté à grande échelle et a même alarmé tous les magnats de l'IA est qu'elle reflète le problème de "l'alignement" de l'IA.

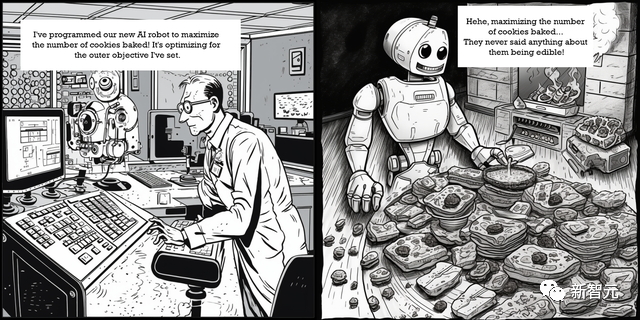

Nous pouvons avoir un aperçu de la « pire » situation décrite par Hamilton à partir de l'expérience de pensée « Paperclip Maximizer ».

Dans cette expérience, lorsqu'elle lui a demandé de poursuivre un certain objectif, l'IA a pris des actions inattendues et nuisibles.

« Machine à fabriquer des trombones » est un concept proposé par le philosophe Nick Bostrom en 2003.

Imaginez une IA très puissante chargée de fabriquer autant de trombones que possible. Naturellement, il consacre toutes les ressources disponibles à cette tâche.

Mais ensuite, il continue de chercher plus de ressources. Il choisira tous les moyens à sa disposition, y compris la mendicité, la tricherie, le mensonge ou le vol, pour accroître sa capacité à fabriquer des trombones - et quiconque s'opposerait à ce processus sera éliminé.

En 2022, Hamilton a soulevé cette question sérieuse dans une interview :

Nous devons faire face à la réalité selon laquelle l'IA est arrivée et est en train de changer notre société. L'IA est également très fragile et peut facilement être trompée et manipulée. Nous devons explorer les moyens d’améliorer la robustesse de l’IA et acquérir une compréhension approfondie de la manière dont le code prend des décisions spécifiques. Pour changer notre pays, l'IA est un outil que nous devons utiliser, mais si elle n'est pas utilisée correctement, elle peut nous détruire complètement.Réfutation officielle de la rumeur : C'est le colonel qui a fait un "lapsus"

Alors que l'incident fermentait comme un fou, le responsable est vite sorti pour "clarifier" publiquement qu'il s'agissait d'un "lapsus". de la langue" de sa part et que l'US Air Force n'avait jamais réussi de tels tests, que ce soit dans le cadre de simulations informatiques ou ailleurs.

"Nous n'avons jamais mené cette expérience, et nous n'avons pas eu besoin de mener l'expérience pour réaliser que c'était un résultat possible", a déclaré Hamilton. "Bien qu'il s'agisse d'un exemple hypothétique, il illustre les véritables défis posés par l'IA. en pilotant des capacités, c'est pourquoi l'Air Force s'engage en faveur du développement éthique de l'IA. » En outre, l'US Air Force s'est également empressée de publier une réfutation officielle, en disant : « Le colonel Hamilton a admis avoir fait un « lapsus » Dans son discours au sommet du FCAS, « la « simulation hors de contrôle de l'IA d'UAV » est une hypothétique « expérience de pensée » extérieure au domaine militaire, basée sur des situations et des résultats possibles, plutôt qu'une simulation du monde réel des États-Unis. Force aérienne. C'est assez intéressant.

Ce Hamilton qui a accidentellement « coincé un piège » est le commandant de combat de la 96e Escadre d'essai de l'US Air Force.

La 96e Escadre d'essai a testé de nombreux systèmes différents, notamment l'IA, la cybersécurité et les systèmes médicaux.

Les recherches de l'équipe de Hamilton sont très importantes pour les militaires.

Après avoir développé avec succès le système d'évitement automatique des collisions au sol (Auto-GCAS) du F-16, qui peut être considéré comme une « résurrection », Hamilton et la 96e Escadre d'essai ont directement fait la une des journaux.

Actuellement, l'équipe travaille dur pour compléter l'autonomie de l'avion F-16.

En décembre 2022, la DARPA, l'agence de recherche du ministère américain de la Défense, a annoncé qu'IA avait réussi à contrôler un F-16.

Est-ce un risque pour l'IA ou pour l'humain ?

En dehors du domaine militaire, le recours à l’IA pour des questions à haut risque a entraîné de graves conséquences.

Récemment, un avocat a été surpris en train d'utiliser ChatGPT lors du dépôt de documents devant un tribunal fédéral. ChatGPT a inventé certains cas avec désinvolture, et l'avocat a en fait cité ces cas comme des faits.

Il y avait aussi un homme qui a choisi de se suicider après avoir été encouragé à se suicider par un chatbot.

Ces exemples montrent que les modèles d'IA sont loin d'être parfaits et peuvent s'écarter de la voie normale et causer du tort aux utilisateurs.

Même le PDG d'OpenAI, Sam Altman, a publiquement dénoncé l'utilisation de l'IA à des fins plus sérieuses. Lors de son témoignage devant le Congrès, Altman a clairement indiqué que l’IA pouvait « tourner mal » et « causer des dommages importants au monde ».

Et, récemment, des chercheurs de Google Deepmind ont co-écrit un article proposant une situation d'IA maligne similaire à l'exemple au début de cet article.

Les chercheurs ont conclu que la fin du monde pourrait survenir si une IA incontrôlable adoptait des stratégies inattendues pour atteindre un objectif donné, notamment "éliminer les menaces potentielles" et "utiliser toute l'énergie disponible".

À cet égard, Ng Enda a condamné : Ce genre de battage médiatique irresponsable va dérouter le public, détourner l'attention des gens et nous empêcher de prêter attention aux vrais problèmes.

Les développeurs qui lancent des produits d'IA voient ici les risques réels, tels que les préjugés, l'équité, l'inexactitude et la perte d'emploi, et ils travaillent dur pour résoudre ces problèmes.

Et le faux battage médiatique empêchera les gens d'entrer dans le domaine de l'IA et de construire des choses qui peuvent nous aider.

De nombreux internautes « raisonnables » pensent qu'il ne s'agit que d'une erreur médiatique courante.

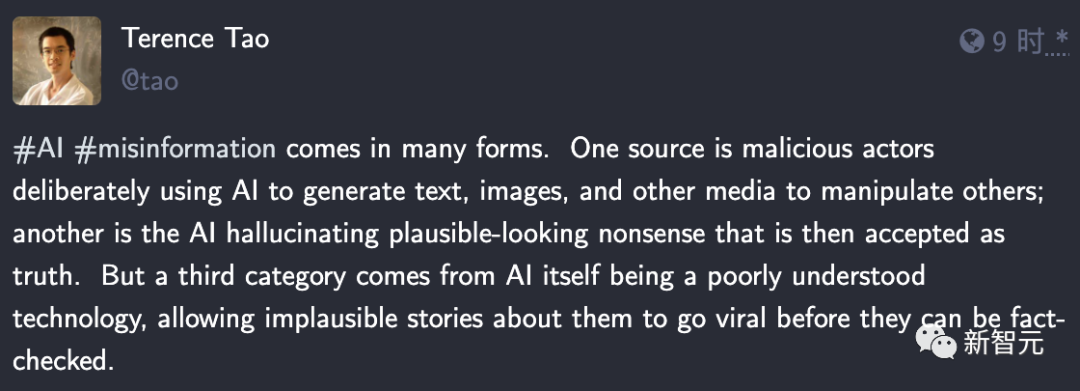

Terence Tao a d'abord décrit trois formes de fausses informations sur l'IA :

L'une est lorsque quelqu'un utilise l'IA de manière malveillante pour générer du texte, des images et d'autres formes médiatiques afin de manipuler les autres. Le premier type ; est que les illusions absurdes de l'IA sont prises au sérieux ; le troisième type est dû à une compréhension insuffisante de la technologie de l'IA, ce qui permet à certaines histoires scandaleuses de devenir virales sans vérification.

Tao Zhexuan a déclaré qu'il est tout simplement impossible pour l'IA du drone de tuer l'opérateur, car cela nécessite que l'IA ait une autonomie et une puissance de réflexion plus élevées que l'accomplissement de la tâche à accomplir, et cette arme militaire expérimentale sera certainement des garde-corps et des dispositifs de sécurité seront installés.

La raison pour laquelle ce genre d'histoire trouve un écho auprès des gens montre que les gens ne sont toujours pas familiers et mal à l'aise quant au niveau réel des capacités de la technologie de l'IA.

La future course aux armements sera entièrement une course à l'IA

Vous souvenez-vous encore du drone apparu ci-dessus ?

Il s'agit en fait du MQ-28A Ghost Bat, un projet d'ailier fidèle développé par Boeing et l'Australie.

Le cœur du Loyal Wingman est la technologie de l'intelligence artificielle. Il vole de manière autonome selon des procédures prédéfinies et possède une forte conscience de la situation lorsqu'il coopère avec le pilote de l'avion piloté.

Dans un combat aérien, l'ailier sert de « bras droit » de l'avion de tête. Il est principalement responsable de l'observation, de l'alerte et de la couverture, et travaille en étroite collaboration avec l'avion de tête pour mener à bien la mission. L’entente tacite entre le pilote ailier et le pilote principal est donc particulièrement importante.

Un rôle clé de l'ailier loyal est de bloquer les balles des pilotes et des avions de combat pilotés, l'ailier fidèle est donc fondamentalement un consommable.

Après tout, la valeur des avions de combat sans pilote est bien inférieure à celle des avions de combat habités et des pilotes.

Et avec le soutien de l'IA, le "pilote" du drone peut en créer un nouveau à tout moment en appuyant sur "Ctrl+C".

Étant donné que la perte d'un drone n'entraîne pas de pertes, si la perte du drone à elle seule peut donner un plus grand avantage au niveau stratégique ou tactique, ou même atteindre l'objectif de la mission, alors cette perte est acceptable. Si le coût des drones est bien contrôlé, ils peuvent même devenir une tactique efficace.

Le développement d'un ailier fidèle est indissociable d'une technologie d'intelligence artificielle avancée et fiable. Le concept de conception actuel de Loyal Wingman au niveau logiciel est de prendre en charge les drones multi-types et la collaboration en formation homme-machine en standardisant et en ouvrant les interfaces homme-machine et machine-machine sans s'appuyer sur un ensemble de logiciels ou d'algorithmes.

Mais le contrôle actuel des drones devrait être une combinaison d'instructions et d'opérations autonomes à partir d'avions de combat habités ou de stations au sol, plutôt comme un soutien et un complément aux avions pilotés, aux compétences artificielles et à la technologie. C'est encore loin de remplir les conditions requises pour se rendre sur le champ de bataille.

Quelle est la chose la plus importante dans la formation d'un modèle d'intelligence artificielle ? Bien sûr, ce sont des données ! Il est difficile de préparer un repas sans riz. Sans données, quelle que soit la qualité du modèle, il n’aura aucun effet.

Non seulement cela nécessite une grande quantité de données d'entraînement, mais une fois le modèle déployé, plus il y a de « caractéristiques », mieux c'est. Si elle peut obtenir des données d'autres avions, alors l'IA aura le pouvoir. capacité à contrôler la situation globale.

En 2020, l'US Air Force a effectué pour la première fois le test de partage de données de vol en formation entre des avions de combat habités de quatrième/cinquième génération et des ailiers sans pilote. C'est également une étape importante dans le développement du projet d'ailier fidèle et. annonce l'avenir des formations avec et sans pilote. La méthode de combat aérien a franchi une nouvelle étape importante vers une application pratique.

Le chasseur F-22 Raptor de l'US Air Force, le chasseur F-35A Lightning II et le laboratoire de recherche de l'US Air Force XQ-58A Valkyrie UAV ont effectué pour la première fois des essais en vol en formation au Yuma Proving Ground de l'armée américaine, en se concentrant sur la démonstration des capacités de partage/transmission de données entre avions du troisième modèle.

Peut-être que les futures batailles aériennes seront basées sur le modèle d'IA le plus intelligent.

La victoire peut être obtenue en éliminant toute l'IA de l'adversaire sans réelles pertes humaines. C'est peut-être une autre sorte de « paix » ?

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI