Maison >Périphériques technologiques >IA >Le PDG d'OpenAI assiste à une audience du Sénat américain pour discuter de la manière de mieux réglementer l'IA

Le PDG d'OpenAI assiste à une audience du Sénat américain pour discuter de la manière de mieux réglementer l'IA

- 王林avant

- 2023-05-28 17:52:551596parcourir

Récemment, Google développe pleinement la technologie d'intelligence artificielle générative. Lors de sa conférence annuelle I/O, la société a annoncé son intention d'intégrer des outils d'IA dans presque tous ses produits, de Google Docs à la programmation et à la recherche en ligne.

L’annonce de Google est significative. Des milliards de personnes auront désormais accès à des modèles d’intelligence artificielle puissants et de pointe qui les aideront à accomplir des tâches allant de la génération de texte à la réponse à des questions en passant par l’écriture et le débogage de code. Comme l'a écrit Mat Honan, rédacteur en chef de la MIT Technology Review, dans son analyse de la conférence I/O, il est clair que l'intelligence artificielle est désormais un produit clé de Google.

(Source : STEPHANIE ARNET/MITTR)

(Source : STEPHANIE ARNET/MITTR)

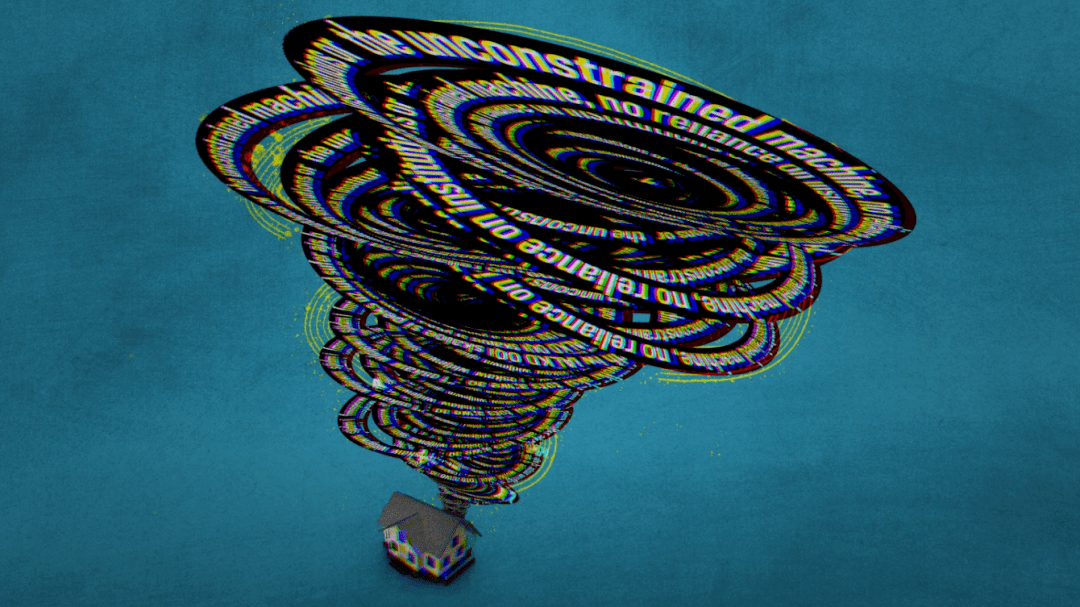

Leur approche consiste à introduire progressivement ces nouvelles fonctionnalités dans les produits Google, mais tôt ou tard, des problèmes surgiront. L'entreprise n'a résolu aucun des problèmes courants liés à ces modèles d'IA : ils aiment toujours inventer des choses ; ils sont toujours facilement manipulables pour enfreindre les règles établies par les humains, ils sont toujours vulnérables aux attaques et il n'y a presque rien ; les empêchant d'être utilisés comme générateurs d'outils de désinformation, d'escroqueries et de spam.

Ces types d’outils d’IA sont relativement nouveaux et sont donc encore largement non réglementés. Mais cela n’est pas viable. La popularité de ChatGPT diminue progressivement, mais les besoins réglementaires continuent de croître et les agences de réglementation commencent à faire face aux défis posés par la technologie ChatGPT.

Les régulateurs américains tentent de trouver un moyen de réglementer ces puissants outils d’intelligence artificielle. Cette semaine, le PDG d'OpenAI, Sam Altman, a témoigné devant le Sénat américain (après avoir eu un dîner « éducatif » avec des politiciens la veille). L'audience intervient une semaine après que la vice-présidente américaine Kamala Harris a tenu une réunion avec les PDG d'Alphabet, Microsoft, OpenAI et Anthropic.

Photo | Sam Altman, fondateur d'OpenAI (Source : Carte de données)

Photo | Sam Altman, fondateur d'OpenAI (Source : Carte de données)

Dans la déclaration, Harris a souligné que ces entreprises doivent assumer des responsabilités éthiques et juridiques pour garantir la sécurité de leurs produits. Le chef de la majorité Chuck Schumer, DN.Y., a présenté une législation visant à réglementer l'intelligence artificielle, qui pourrait inclure la création d'une nouvelle agence chargée de faire respecter les règles.

Jennifer King, chercheuse en politique de confidentialité et de données à l’Institut pour l’intelligence artificielle centrée sur l’humain de l’Université de Stanford, a déclaré : « Tout le monde veut que ce qu’il fait soit vu. Les gens sont très enthousiasmés par la façon dont cela se passe. »

King a déclaré qu'il serait difficile d'obtenir un soutien bipartisan pour un nouveau projet de loi sur l'IA : « Cela dépendra de la mesure dans laquelle (l'IA générative) est considérée comme une menace réelle au niveau sociétal, soulignant en outre que la Commission fédérale du commerce. La présidente Lena Khan a pris des mesures agressives. Khan a écrit un éditorial plus tôt ce mois-ci appelant à une réglementation de l'IA maintenant pour empêcher l'approche laxiste qui a caractérisé l'industrie technologique dans le passé. Selon elle, les agences américaines réglementant l'IA préfèrent se tromper. tirer parti des boîtes à outils juridiques existantes, telles que les lois antitrust et sur les pratiques commerciales

Pendant ce temps, en Europe, les législateurs sont sur le point de parvenir à un accord final sur la loi sur l'intelligence artificielle (AI Act). Les députés européens ont approuvé la semaine dernière un projet de règlement appelant à l'interdiction de l'utilisation de la technologie de reconnaissance faciale dans les lieux publics. Il interdit également la police prédictive et la reconnaissance des émotions lorsque des données biométriques sont collectées en ligne, ainsi que les arrestations aveugles de toute personne.

Le Parlement espère introduire davantage de réglementations pour réglementer l'intelligence artificielle générative, et l'Union européenne renforcera également la surveillance et exigera que les entreprises impliquées dans le développement de modèles d'intelligence artificielle à grande échelle soient plus transparentes. Les mesures potentielles comprennent l'étiquetage du contenu généré par l'IA, la divulgation sous forme résumée des données protégées par le droit d'auteur qui ont été utilisées dans la formation des modèles et l'établissement de garanties pour empêcher les modèles de générer du contenu illégal.

Mais voilà : l’UE est encore loin de mettre en œuvre ces règles. De nombreux éléments proposés pour la loi sur l’intelligence artificielle n’ont pas été intégrés dans la version finale. Des négociations difficiles demeurent entre le Parlement, la Commission européenne et les États membres de l'UE. Il faudra plusieurs années avant que la loi sur l’intelligence artificielle entre en vigueur.

Des personnalités technologiques bien connues commencent à travailler dans la direction opposée et à faire le contraire. L'économiste en chef de Microsoft, Michael Schwarz, a déclaré lors d'un événement récent que nous devrions attendre de constater des « dommages significatifs » causés par l'intelligence artificielle avant de la réglementer. Il compare l’IA à un permis de conduire : de nombreuses personnes n’obtiennent un permis de conduire qu’après avoir été tuées dans un accident. Ce n’est qu’avec un certain niveau de préjudice que nous pouvons vraiment comprendre le problème. »

Cette affirmation est trop scandaleuse. Les méfaits causés par l’intelligence artificielle sont bien documentés depuis des années. Cette approche est partiale et discriminatoire et génère de fausses nouvelles et des escroqueries. Des milliers de personnes ont été plongées dans la pauvreté à cause de fausses accusations de fraude, suite à des arrestations innocentes provoquées par d’autres systèmes d’IA. À mesure que Google annonce massivement ses prochaines étapes et que l’IA générative s’intègre de plus en plus dans notre société, ces méfaits pourraient croître de façon exponentielle.

La question que nous devrions nous poser est : quel mal sommes-nous prêts à voir ? Et ma réponse est : nous en avons assez vu.

Soutien : Ren

Texte original :

https://www.technologyreview.com/2023/05/16/1073167/how-do-you-solve-a-problem-like-out-of-control-ai/

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI