Maison >Périphériques technologiques >IA >Votre selfie est peut-être inclus dans la « bibliothèque d'images indécentes », et le mal de l'IA est en fait très proche de vous !

Votre selfie est peut-être inclus dans la « bibliothèque d'images indécentes », et le mal de l'IA est en fait très proche de vous !

- 王林avant

- 2023-05-26 09:57:592647parcourir

Auteur | Kazi

Editeur | Bouclé Yu Tian

Headshot | À mi-parcours

* L'image d'en-tête d'aujourd'hui a été créée à l'aide de Midjourney, avec le mot-clé « une fille assise dans une pièce sombre en train de pleurer, style d'illustration »

La distance entre nous et le mal est liée aux outils.

IA, cet outil (peut-être) le plus puissant de l'histoire, est également entièrement armé entre les mains de personnes maléfiques. Pour les gens ordinaires, l’ajout de l’IA a rendu toutes sortes d’escroqueries et de préjudices encore plus difficiles à prévenir.

Imaginez, n'importe quelle silhouette ou mouvement, ce visage pourrait être le vôtre, est-ce effrayant ?

Les selfies et les vidéos publiés par des individus sur les plateformes sociales peuvent facilement être traités par les technologies de changement de visage et de peinture par l'IA, et utilisés par les criminels comme « matériel » pour des images et des vidéos indécentes, pour être vendus ou utilisés frauduleusement.

Réfléchissez-y encore, les informations que vous voyez en grande majorité sont toutes produites et distribuées dans un certain but, n'est-ce pas effrayant ?

Il est difficile de dire l'authenticité des diverses captures d'écran et enregistrements de discussions circulant sur Internet. Lorsque l'IA est ajoutée à la « création », le style peut être imité, la logique peut être cohérente, et elle peut aussi inlassablement. production de masse, pollution de l'information et un seul clic obtenu.

Les incidents pervers suivants ont tous l'application de l'IA.

Modèle d'image couleur IA "raffiné"

1. Des photos pornographiques douces d'enfants synthétisées par l'IA apparaissent sur les plateformes sociales

Le 16 mai, le blogueur Weibo « Cyber Shikuai Appraisal Office » a publié qu'il avait été découvert que certains utilisateurs de la station B avaient téléchargé des images pornographiques douces et réalistes d'enfants synthétisées par des outils de peinture d'IA. Les filles sur les images générées sont légèrement vêtues et se comportent de manière indécente, et les utilisateurs partageront des « paquets d'images » dans les commentaires et les mises à jour.

Après que l'incidenta été révélé, en raison des rapports des utilisateurs, certaines vidéos ont été supprimées des étagères et les comptes des utilisateurs concernés ont été bloqués.

Source : Département d'évaluation de Cyber Ten Blocks

Source : Département d'évaluation de Cyber Ten Blocks

2. Les photos de l'exposition BD CP29 étaient "raffinées" et indécentes

Le 6 mai, un internaute a publié un article sur le blogueur Weibo "Spring Short Man", disant qu'un internaute avait exprimé son mécontentement à l'égard des photos de cosplay prises lors de l'exposition de bandes dessinées ce jour-là sur un forum, il a donc utilisé des outils de peinture IA. et les modèles LoRA (Un modèle de réglage fin), qui « affine » les photos d'amateurs en photos indécentes de « jupes relevées » grâce à des ajustements partiels.

Après la publication de la contribution sur Weibo, elle a été transmise jusqu'à 21 000 fois.

Source : Spring Short Man via Weibo

Source : Spring Short Man via Weibo

Par coïncidence, le 3 mai, le blogueur DeadPrince a été informé dans un message privé sur Weibo que son selfie avait été transformé en modèle LoRA par un inconnu et téléchargé sur le site de partage de modèles de peinture Civil, et que quelqu'un avait utilisé le modèle pour dessiner des nus. photos.

Source : DeadPrince

Source : DeadPrince

AI écrit de fausses nouvelles

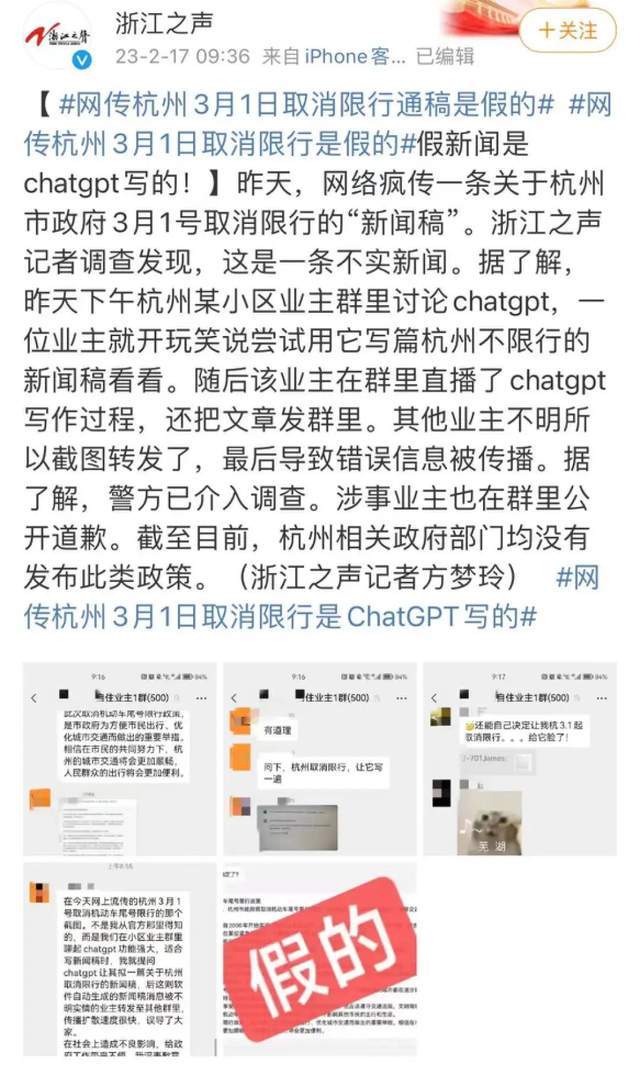

Le 16 février, ChatGPT a été discuté dans un groupe de propriétaires communautaires à Hangzhou. Un propriétaire a tenté d'utiliser ChatGPT pour rédiger un faux communiqué de presse, qui disait en gros : « À partir du 1er mars 2023, Hangzhou annulera les restrictions de voyage. " ". Par la suite, ces fausses nouvelles ont été capturées et diffusées par des membres du groupe qui n'en comprenaient pas la raison, et ont même fait l'objet d'une recherche brûlante. Finalement, la police est intervenue dans l'enquête et le propriétaire de l'entreprise impliqué s'est excusé publiquement.

Source : Zhejiang Voice

Source : Zhejiang Voice

AI fait semblant d'être une célébrité pour tricher

Le 13 mai, selon le "Daily Mail", une petite société cinématographique espagnole Peabody Films a reçu un appel du célèbre acteur britannique Benedict Cumberbatch "Je m'intéresse aux scénarios de films et je veux faire un film ensemble.

Mais la société cinématographique l'a invité à plusieurs reprises pour des interviews, mais "Juan Fu" a refusé. Il a même proposé des frais d'interview exorbitants et a demandé à la société de lui remettre d'abord 200 000 livres.

En raison de quelque chose qui ne va pas, la société de production cinématographique a confirmé auprès de l'agence "Juan Fu", et ce n'est qu'après confirmation qu'ils ont découvert qu'il s'agissait d'une arnaque à l'IA.

Selon le personnel de la société cinématographique, s'ils ne regardent que l'appel vocal, puisque la similitude vocale atteint 100 %, ils sont complètement convaincus que l'autre partie est "Quan Fu".

AI qui change de visage pour générer des vidéos indécentes

Le 26 avril, la célébrité Internet "Caro Lailai_" a posté sur Weibo qu'elle s'était fait "voler" le visage par une plateforme sociale externe, faisant semblant d'enregistrer son propre compte factice, et que les fans pouvaient la regarder tant qu'ils payaient. vidéo.

Elle a également découvert que de nombreuses photos de célébrités, de blogueurs et même d'amateurs ont été transformées en vidéos indécentes pour gagner de l'argent de cette manière. Ils fournissent même des services de personnalisation d'IA En utilisant la technologie d'IA des sites Web en ligne, vous pouvez « vous déshabiller avec une seule ». cliquez sur « ».

AI "Déshabillage en un clic"

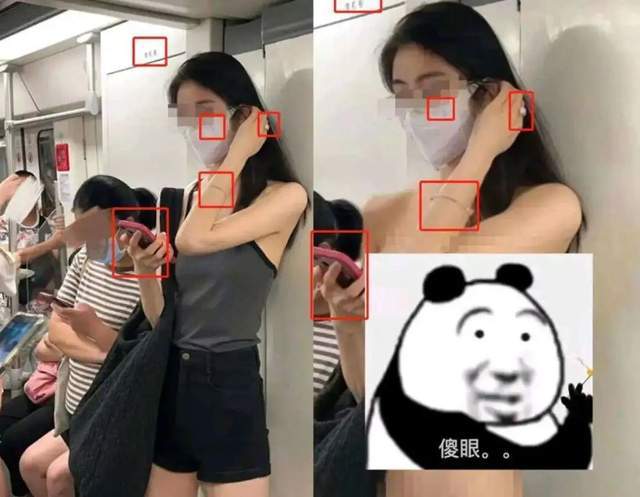

Le 28 mars, « Des photos de femmes dans le métro ont été diffusées par l'IA en un seul clic en se déshabillant » est devenue une recherche brûlante sur Weibo. La femme sur la photo était une blogueuse de Xiaohongshu, et les soi-disant « photos nues » étaient d'elle. en juillet de l’année dernière. Une photo partagée sur la plateforme.

Sur la photo originale, elle était habillée normalement, mais quelqu'un avec de mauvaises intentions a utilisé un logiciel d'IA pour se "déshabiller" en un seul clic et l'a délibérément diffusé sur Internet, provoquant un mauvais impact. Après que l'incident a éclaté, le blogueur a demandé la protection de ses droits auprès des services concernés.

Il est difficile de déterminer l'authenticité du contenu de l'IA, et la supervision au pays et à l'étranger a été renforcée

En raison de la popularisation de la technologie de l'IA, une grande quantité de contenu généré par l'IA a émergé sur les principales plateformes de médias sociaux. Cependant, des images et des vidéos réalistes de personnes réelles générées par l'IA, ainsi que des manuscrits de textes difficiles à distinguer entre le vrai et le faux. . Si vous ne connaissez pas grand-chose à la technologie de l’IA, il est facile de se « tromper ».

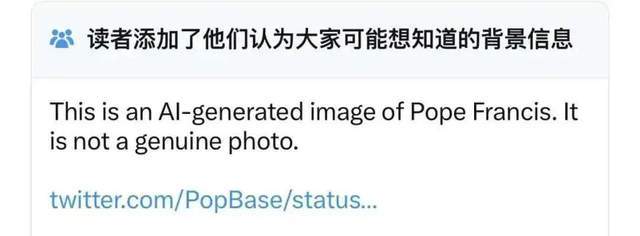

Par exemple, il y a quelque temps, un internaute étranger a publié une série de fausses photos du « Fashion Pope » sur la plateforme Twitter, qui sont devenues virales. Le « faux pape » sur la photo a enlevé ses robes traditionnelles et a enfilé une doudoune blanche à la mode. Il est très facile pour les passants qui ne connaissent pas la vérité de se méprendre sur le fait qu'il s'agit du vrai pape qui change de vêtements, mais il a en fait été dessiné à l'aide de l'outil de dessin AI Midjourney.

Source de l'image : @skyferrori via twitter

Source de l'image : @skyferrori via twitter

Parce que les images générées par ce groupe d'IA sont trop « chaudes » pour éviter que les passants ne se méprennent, Twitter, en tant que plateforme, a rapidement marqué les images comme « générées par l'IA ».

Au pays et à l'étranger, de nombreuses plateformes ont récemment suivi en temps opportun la supervision du contenu de l'IA et ont publié des spécifications et des mesures liées à l'intelligence artificielle.

1. Douyin publie « Spécifications de la plate-forme Douyin et initiatives de l'industrie sur le contenu généré par l'intelligence artificielle »

Les articles 9 à 11 de cette initiative industrielle mentionnent l'identification du contenu généré par l'IA et la possibilité d'enregistrer des personnes virtuelles et d'ouvrir des canaux de commentaires des utilisateurs.

9. La plate-forme fournira des capacités unifiées d'identification de contenu générées par l'intelligence artificielle pour aider les créateurs à marquer et faciliter la distinction entre les utilisateurs.

10. La plateforme offrira la possibilité d'enregistrer des personnes virtuelles et de protéger les images des personnes virtuelles enregistrées.

11. La plateforme fournira des canaux de retour d'information aux utilisateurs pour permettre aux utilisateurs de signaler le contenu généré illégalement.

Articles associés : "Les nouvelles règles de Douyin entrent en vigueur !" Les présentateurs virtuels sont enfin "légaux", mais ils doivent révéler leur identité et être pilotés par de vraies personnes》

2. Xiaohongshu ajoute le logo de création d'IA aux notes

Fin avril, certains utilisateurs de Xiaohongshu ont découvert que la plateforme commençait à marquer le contenu généré par l'IA et ont demandé aux utilisateurs de faire attention à leur authenticité.

Source de l'image : Internet

Source de l'image : Internet

3. Google a annoncé le filigrane des images générées par l'IA lors de la conférence des développeurs 2023

Google a annoncé lors de la récente conférence des développeurs de 2023 qu'il veillerait à ce que chaque image de l'entreprise générée par l'IA comporte un filigrane intégré. Bien que le filigrane ne puisse pas être reconnu à l'œil nu, des logiciels tels que les moteurs de recherche Google peuvent le lire et l'afficher. comme étiquette pour indiquer à l'utilisateur que l'image a été générée par l'IA. Cette fonctionnalité sera disponible dans les mois à venir.

De plus, mon pays a publié le « Code d'éthique de l'intelligence artificielle de nouvelle génération » en 2021, qui implique la planification stratégique, la formulation et la mise en œuvre de politiques, de réglementations et de normes techniques, l'allocation de ressources, la supervision et l'examen, etc. Et en mars de cette année, l'Administration chinoise du cyberespace a publié le « Règlement sur la gestion des services d'intelligence artificielle générative (projet pour commentaires) », qui réglemente le comportement des fournisseurs de services d'IA générative, y compris la protection des droits et intérêts des utilisateurs, des informations. assurance de sécurité, technologie sûreté et sécurité, etc.

À l’étranger, le gouvernement italien a imposé une interdiction temporaire de ChatGPT en mars de cette année, invoquant des craintes qu’il viole le règlement général sur la protection des données de l’Union européenne. Le 16 mai, le PDG d'OpenAI, Sam Altman, a également témoigné devant le Sénat américain sur les dangers potentiels de la technologie de l'IA et a exhorté les législateurs à mettre en œuvre des exigences de licence et d'autres réglementations pour les organisations développant des systèmes d'IA avancés tels que GPT-4.

Le PDG d'OpenAI est apparu au Capitole aux États-Unis, appelant à la réglementation de l'IA Source : Internet

Le PDG d'OpenAI est apparu au Capitole aux États-Unis, appelant à la réglementation de l'IA Source : Internet

On constate que la plupart de ces infractions se situent actuellement dans le domaine de l'information. D'une part, d'un point de vue matériel, il s'agit d'une information publique relativement sans propriétaire. Les choses qui étaient initialement discutées dans les rues après le dîner, bien qu'il y ait beaucoup de mensonges et de conjectures, ne font que se propager d'une rue à l'autre. ruelle. Mais tout comme les médias sociaux peuvent diffuser des informations. À mesure que l'exil augmente, les personnes maléfiques peuvent également utiliser l'IA pour amplifier le courant trouble. D'un autre côté, du point de vue des victimes, la plupart d'entre elles sont des gens ordinaires qui ont du mal à parler ; Personne ne lira la déclaration, et il est encore plus difficile d'envoyer une lettre à un avocat. Bien que les lois, réglementations et plateformes suivent le contrôle de la technologie de l’IA, le coût de la protection des droits des citoyens ordinaires reste très élevé.

Le problème revient aux méchants Lorsqu'ils se cachent derrière Internet, il devient indispensable de contrôler le couteau entre leurs mains.

ps. Demain il sera 520

, en tant que joueur romantique d'IA, comment puis-je manquer des roses ?

Répondez au mot-clé "520" ou "521" dans le backend du compte officiel "Number One AI Player", et vous obtiendrez au hasard une rose aveugle générée par AI

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI