Maison >Périphériques technologiques >IA >OpenAI utilise GPT-4 pour expliquer les 300 000 neurones de GPT-2 : voici à quoi ressemble la sagesse

OpenAI utilise GPT-4 pour expliquer les 300 000 neurones de GPT-2 : voici à quoi ressemble la sagesse

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-05-25 12:04:061281parcourir

Bien que ChatGPT semble rapprocher les humains de la recréation de l'intelligence, jusqu'à présent, nous n'avons jamais complètement compris ce qu'est l'intelligence, qu'elle soit naturelle ou artificielle.

Il est évidemment nécessaire de comprendre les principes de l'intelligence. Comment comprendre l'intelligence des grands modèles de langage ? La solution proposée par OpenAI est la suivante : demandez ce que dit GPT-4.

Le 9 mai, OpenAI a publié ses dernières recherches, qui ont utilisé GPT-4 pour interpréter automatiquement le comportement des neurones dans de grands modèles de langage, et ont obtenu de nombreux résultats intéressants.

Une façon simple d'étudier l'interprétabilité est d'abord de comprendre ce que font les différentes composantes du modèle d'IA (neurones et têtes d'attention). Les méthodes traditionnelles nécessitent que les humains inspectent manuellement les neurones pour déterminer les caractéristiques des données qu'ils représentent. Ce processus est difficile à mettre à l’échelle et son application à des réseaux de neurones comportant des centaines ou des centaines de milliards de paramètres est d’un coût prohibitif.

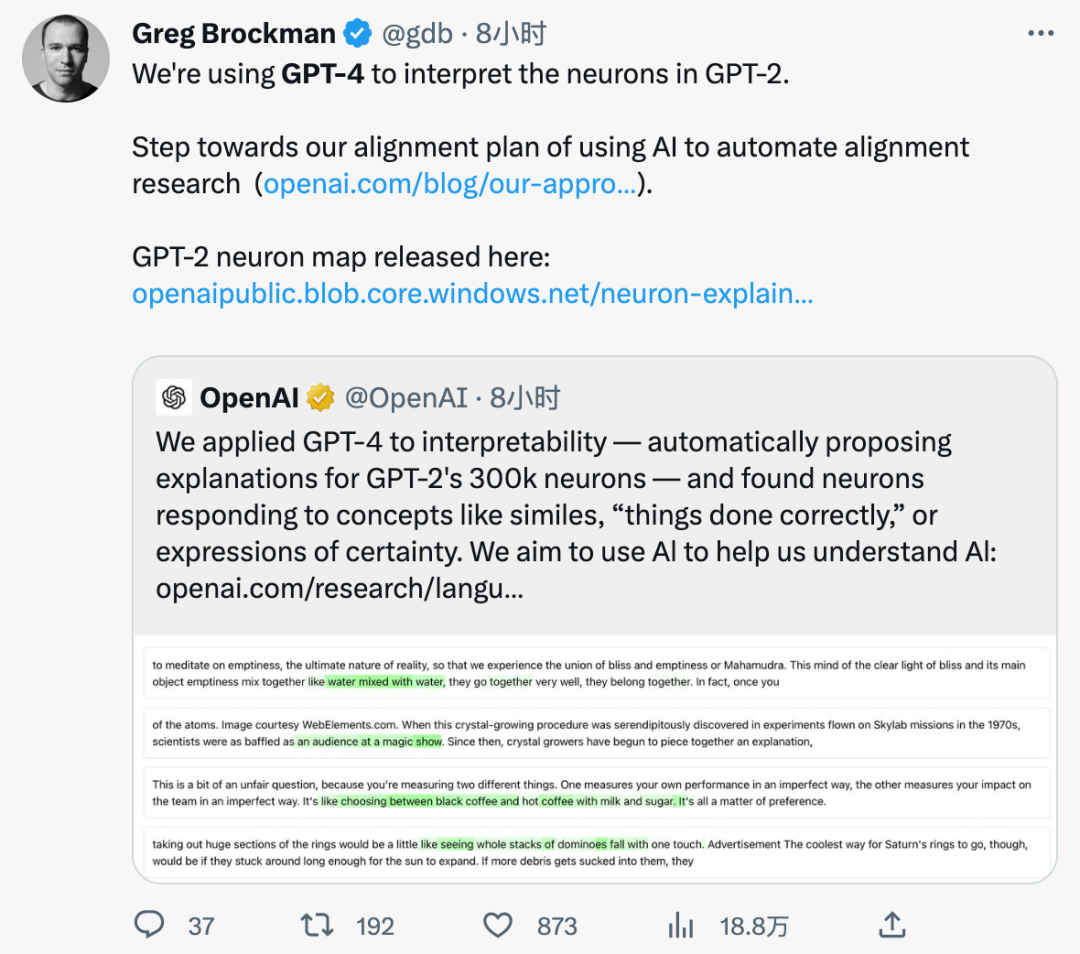

OpenAI a donc proposé une méthode automatisée - utilisant GPT-4 pour générer et noter des explications en langage naturel du comportement des neurones et l'appliquer aux neurones dans un autre modèle de langage - ici, ils ont sélectionné GPT-2 comme échantillon expérimental et ont publié des données ensemble de ces interprétations et scores des neurones GPT-2.

- Adresse papier : https://openaipublic.blob.core.windows.net/neuron-explainer/paper/index.html

- Diagramme des neurones GPT-2 : https ://openaipublic.blob.core.windows.net/neuron-explainer/neuron-viewer/index.html

- Code et ensemble de données : https://github.com/openai/automated-interpretability

Cette technologie permet aux gens d'utiliser GPT-4 pour définir et mesurer automatiquement le concept quantitatif d'interprétabilité des modèles d'IA : elle est utilisée pour mesurer la capacité des modèles de langage à utiliser le langage naturel pour compresser et reconstruire les activations neuronales. En raison de leur nature quantitative, nous pouvons désormais mesurer les progrès dans la compréhension des objectifs informatiques des réseaux de neurones.

OpenAI a déclaré qu'en utilisant la référence qu'ils ont établie, le score d'utilisation de l'IA pour expliquer l'IA peut atteindre un niveau proche de celui des humains.

Le co-fondateur d'OpenAI, Greg Brockman, a également déclaré que nous avons franchi une étape importante vers l'utilisation de l'IA pour mener des recherches d'alignement automatisées.

Méthode spécifique

La méthode d'utilisation de l'IA pour expliquer l'IA consiste à exécuter trois étapes sur chaque neurone :

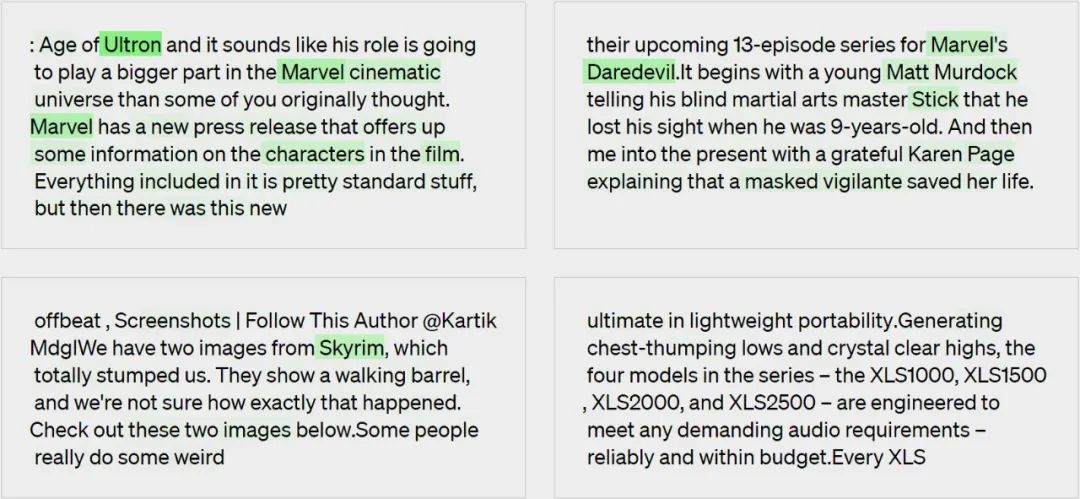

Étape 1 : Utiliser GPT-4 pour générer des explications

Étant donné un neurone GPT-2, génère une explication de son comportement en affichant les séquences de texte et les activations pertinentes pour GPT-4.

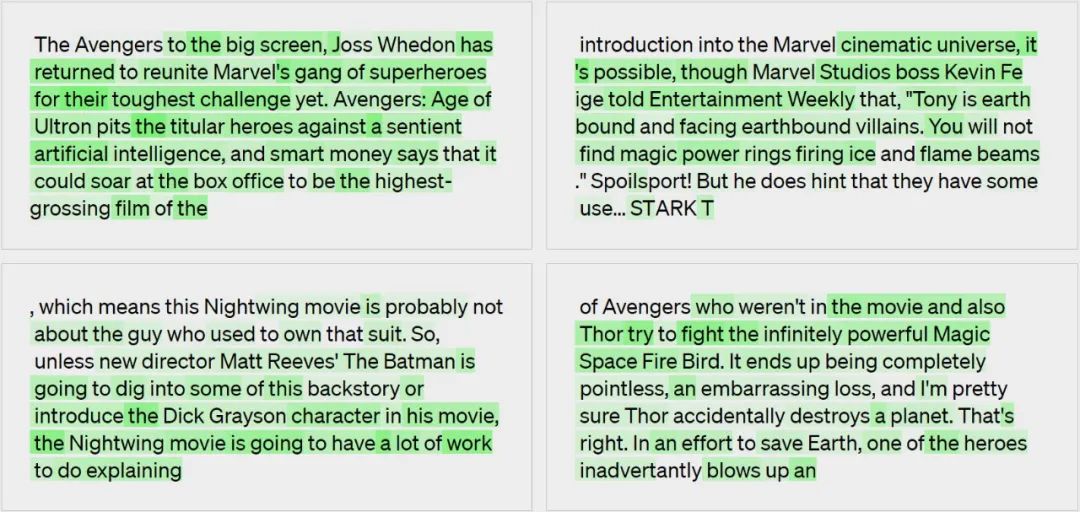

Explication de la génération de modèles : références aux films, personnages et divertissements.

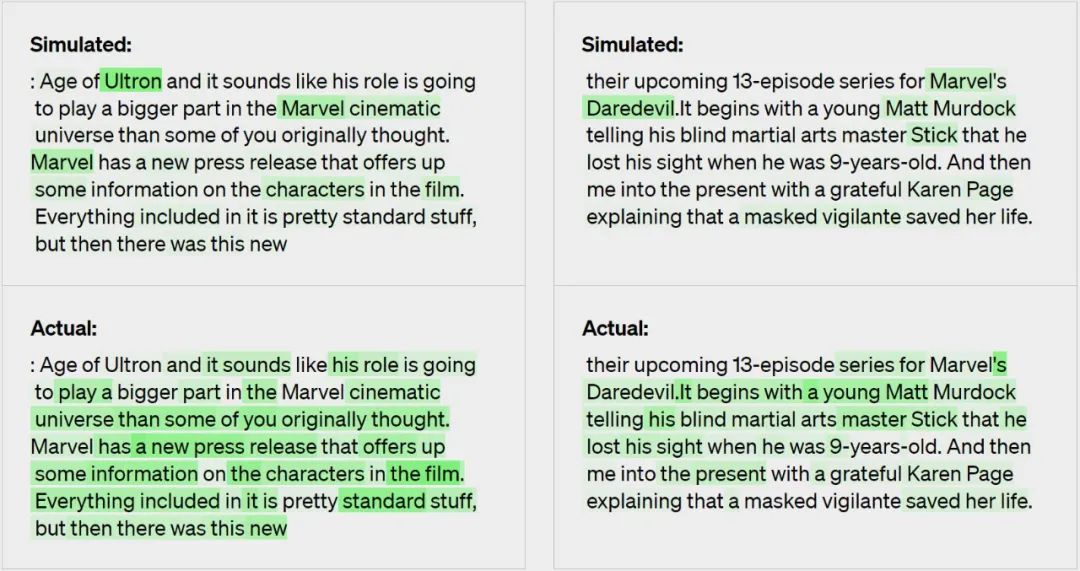

Étape 2 : Utilisez GPT-4 pour simuler

Utilisez à nouveau GPT-4 pour simuler ce que fera le neurone interprété.

Étape 3 : Comparaison

Les explications sont notées en fonction de la façon dont les activations simulées correspondent aux activations réelles - dans ce cas, GPT-4 a obtenu un score de 0,34.

Principaux résultats

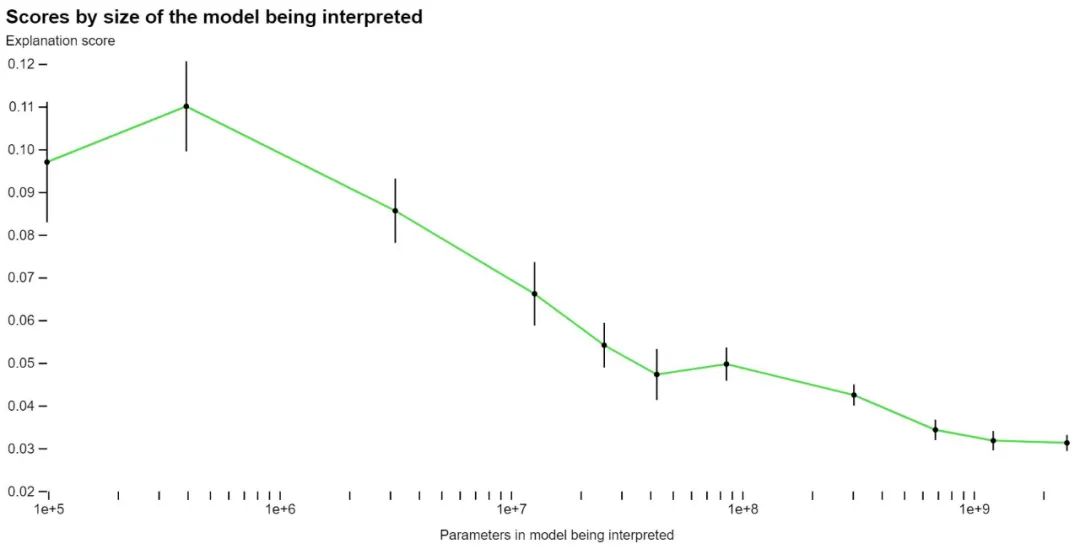

En utilisant sa propre méthode de notation, OpenAI a commencé à mesurer l'efficacité de sa technologie sur différentes parties du réseau et à essayer d'améliorer la technologie pour les parties qui ne sont actuellement pas claires . Par exemple, leur technique ne fonctionne pas bien avec des modèles plus grands, peut-être parce que les couches ultérieures sont plus difficiles à interpréter.

OpenAI affirme que même si la grande majorité de leurs explications n'obtiennent pas un score élevé, ils pensent qu'ils peuvent désormais utiliser les techniques de ML pour améliorer encore leur capacité à générer des explications. Par exemple, ils ont constaté que les éléments suivants les ont aidés à améliorer leurs scores :

- Explications itératives. Ils pourraient améliorer leurs scores en demandant à GPT-4 de réfléchir à des contre-exemples possibles, puis de modifier l'explication en fonction de leur activation.

- Utilisez un modèle plus grand pour l'explication. À mesure que la capacité du modèle explicatif s’améliore, le score moyen augmentera également. Cependant, même GPT-4 a donné des explications pires que celles des humains, ce qui suggère qu’il y a place à amélioration.

- Changez l'architecture du modèle expliqué. Entraîner le modèle avec différentes fonctions d'activation améliore le score d'explication.

OpenAI dit qu'ils créent l'ensemble de données et les outils de visualisation écrits en GPT-4 interprétant les 307 200 neurones de GPT-2 open source. Dans le même temps, ils fournissent également du code pour l’interprétation et la notation à l’aide de modèles accessibles au public sur l’API OpenAI. Ils espèrent que la communauté des chercheurs développera de nouvelles techniques pour générer des explications plus performantes, ainsi que de meilleurs outils pour explorer GPT-2 à travers des explications.

Ils ont découvert qu'il y avait plus de 1 000 neurones avec un score d'explication d'au moins 0,8, ce qui signifie qu'ils représentaient la plupart des principaux comportements d'activation des neurones selon GPT-4. La plupart de ces neurones bien expliqués ne sont pas très intéressants. Cependant, ils ont également découvert de nombreux neurones intéressants que GPT-4 ne comprenait pas. OpenAI espère qu’à mesure que les explications s’améliorent, ils pourront rapidement découvrir des informations qualitatives intéressantes sur les calculs des modèles.

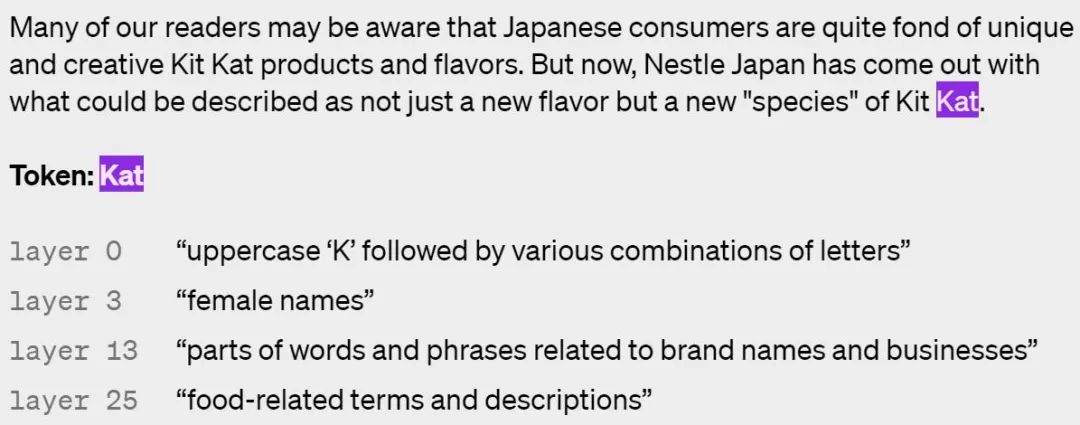

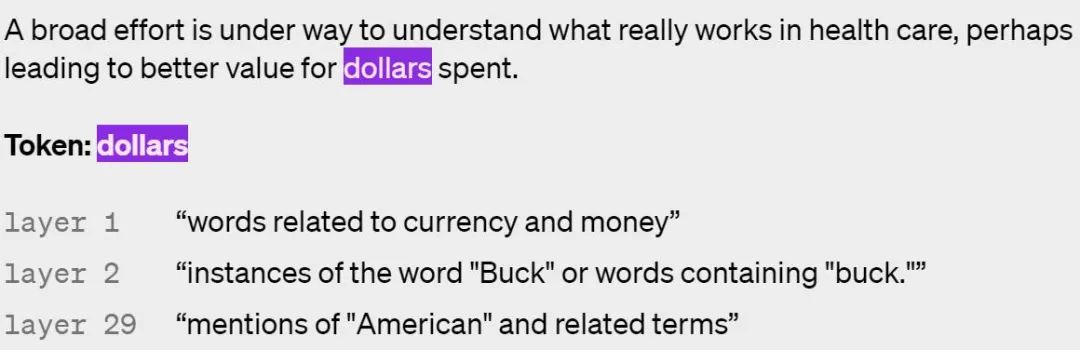

Voici quelques exemples de neurones activés dans différentes couches, les couches supérieures étant plus abstraites :

On dirait, GPT comprend-il les concepts différemment des humains ?

Actuellement, cette méthode présente encore certaines limites, qu'OpenAI espère résoudre dans les travaux futurs :

- Cette méthode se concentre sur de courtes explications en langage naturel, mais les neurones peuvent avoir des comportements très complexes qui ne peuvent pas être décrits de manière concise ;

- OpenAI espère éventuellement trouver et expliquer automatiquement des circuits neuronaux entiers pour obtenir des comportements complexes. Les neurones et les têtes d'attention fonctionnent ; ensemble. Les méthodes actuelles interprètent simplement le comportement des neurones en fonction de la saisie de texte brut sans tenir compte de ses effets en aval. Par exemple, un neurone qui s'active sur un point peut indiquer que le mot suivant doit commencer par une majuscule, ou incrémenter un compteur de phrases

- OpenAI explique ce comportement des neurones, mais ne tente pas d'en expliquer la génération ; mécanisme de comportement. Cela signifie que même les explications les plus performantes peuvent avoir de mauvais résultats sur des textes non distribués car elles ne décrivent qu'une corrélation.

- L'ensemble du processus est extrêmement gourmand en calcul ;

À terme, OpenAI espère utiliser des modèles pour former, tester et itérer des hypothèses complètement générales, tout comme le font les chercheurs en explicabilité. De plus, OpenAI espère interpréter ses plus grands modèles comme un moyen de détecter les problèmes d'alignement et de sécurité avant et après le déploiement. Cependant, il reste encore beaucoup de chemin à parcourir avant que cela se produise.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI