Périphériques technologiques

Périphériques technologiques IA

IA Les classements quasi-chinois de l'UC Berkeley LLM sont ici ! GPT-4 se classe premier et le modèle RNN open source chinois entre dans le top six

Les classements quasi-chinois de l'UC Berkeley LLM sont ici ! GPT-4 se classe premier et le modèle RNN open source chinois entre dans le top sixIl y a quelque temps, des chercheurs de LMSYS Org (dirigés par l'UC Berkeley) ont fait une grande nouvelle : le concours de qualification pour la version du grand modèle de langage !

Cette fois, l'équipe a non seulement amené 4 nouveaux joueurs, mais aussi un classement (quasi) chinois.

- OpenAI GPT-4

- OpenAI GPT-3.5-turbo

- Anthropic Claude-v1

- RWKV-4-Raven-14B (open source)

Il ne fait aucun doute que tant que GPT-4 rejoint la bataille, ce sera Steady en première place.

Cependant, de manière inattendue, Claude a non seulement dépassé GPT-3.5, qui a amené OpenAI à l'autel, pour se classer deuxième, mais n'avait que 50 points de retard sur GPT-4.

En comparaison, le troisième GPT-3.5 n'est que 72 points de plus que Vicuna, le modèle open source le plus puissant avec 13 milliards de paramètres.

Et le "modèle RNN pur" de 14 milliards de paramètres RWKV-4-Raven-14B s'appuie sur ses excellentes performances pour surpasser tous les modèles Transformer et se classer 6ème - à l'exception du modèle Vicuna, RWKV est en concurrence avec tous les autres modèles open source les modèles ont remporté plus de 50 % des matchs sans égalité.

De plus, l'équipe a également créé deux classements distincts : « Anglais uniquement » et « Non-anglais » (dont la plupart sont en chinois).

Vous pouvez constater que les classements de nombreux modèles ont considérablement changé.

Par exemple, ChatGLM-6B entraîné avec davantage de données chinoises a obtenu de meilleurs résultats, et GPT-3.5 a également réussi à dépasser Claude et à se classer deuxième.

Les principaux contributeurs à cette mise à jour sont Sheng Ying, Lianmin Zheng, Hao Zhang, Joseph E. Gonzalez et Ion Stoica.

Sheng Ying est l'un des trois fondateurs de LMSYS Org (les deux autres sont Lianmin Zheng et Hao Zhang) et doctorant au Département d'informatique de l'Université de Stanford.

Elle est également une œuvre du système FlexGen populaire qui peut exécuter une inférence de modèle 175B sur un seul GPU. Il a actuellement reçu 8 000 étoiles.

Adresse papier : https://arxiv.org/abs/2303.06865

Adresse du projet : https://github.com/FMInference/FlexGen

Page d'accueil personnelle :https://sites.google.com/view/yingsheng/home

"Open Source" VS "Closed Source"

Avec l'aide de la communauté, l'équipe a collecté un total de 13 000 votes anonymes, et une découverte intéressante.

L'écart entre le propriétaire et l'open source

Parmi les trois modèles propriétaires, le modèle Claude d'Anthropic est plus populaire parmi les utilisateurs que le GPT-3.5-turbo.

De plus, Claude s'est également montré très compétitif face au GPT-4 le plus puissant.

À en juger par le tableau des taux de victoire ci-dessous, sur les 66 matchs sans égalité entre GPT-4 et Claude, Claude en a remporté 32 (48 %).

Dans toutes les batailles A contre B sans égalité, la proportion de modèle A gagnant

Cependant, il existe encore un grand écart entre les autres modèles open source et ces trois modèles propriétaires.

En particulier, GPT-4 est en tête du classement avec un score Elo de 1274. C'est près de 200 points de plus que la meilleure alternative open source de la liste, Vicuna-13B.

Après avoir éliminé les égalités, GPT-4 a remporté 82% des matchs contre Vicuna-13B et même contre la génération précédente GPT-3.5-turbo a remporté 79% des matchs.

Cependant, il convient de noter que ces modèles open source figurant dans le classement ont généralement moins de paramètres que les modèles propriétaires, compris entre 3 et 14 milliards.

En fait, les progrès récents en matière de LLM et de curation de données ont permis d'obtenir des améliorations significatives des performances en utilisant des modèles plus petits.

Le dernier PaLM 2 de Google en est un bon exemple : nous savons que PaLM 2 atteint de meilleures performances que son prédécesseur en utilisant des modèles de plus petite taille.

Par conséquent, l'équipe est optimiste quant au fait que les modèles de langage open source rattraperont leur retard.

Quand le GPT-4 va-t-il « se renverser » ?

Dans l'image ci-dessous, un utilisateur a posé une question délicate qui nécessite un raisonnement et une planification minutieux. Alors que Claude et GPT-4 ont fourni des réponses similaires, la réponse de Claude était légèrement meilleure.

Cependant, en raison de la nature aléatoire de l'échantillonnage, l'équipe a constaté que cette situation ne pouvait pas toujours être reproduite. Parfois, GPT-4 peut aussi donner la même séquence que Claude, mais il a échoué dans cet essai de génération.

De plus, l'équipe a remarqué que GPT-4 se comporte légèrement différemment lors de l'utilisation de l'API OpenAI et de l'interface ChatGPT, ce qui peut être dû à des invites, des paramètres d'échantillonnage ou d'autres inconnues différents. facteurs.

Un exemple d'utilisateur préférant Claude à GPT-4#🎜 🎜 #

Dans l'image ci-dessous, bien que Claude et GPT-4 aient des capacités étonnantes, ils ont toujours du mal à gérer ce type de problème d'inférence complexe.

Un exemple d'utilisateur pensant que Claude et GPT-4 ont tort # 🎜🎜#

En dehors de ces situations délicates, il existe de nombreuses questions simples qui ne nécessitent pas de raisonnement ou de connaissances complexes.Dans ce cas, les modèles open source comme Vicuna peuvent fonctionner de manière comparable à GPT-4, nous pourrons donc peut-être utiliser un modèle légèrement plus faible (mais plus petit ou plus bon marché) Large Language Model (LLM) comme alternative aux modèles plus puissants comme GPT-4.

Changements dans le score Elo

Chatbot Compétitif depuis la participation de trois puissants modèles propriétaires La concurrence n'a jamais été si féroce.

Depuis que les modèles open source perdent beaucoup de parties lorsqu'ils jouent contre des modèles propriétaires, leurs scores Elo ont tous baissé.

Enfin, l'équipe prévoit également d'ouvrir certaines API afin que les utilisateurs puissent enregistrer leurs propres chatbots pour participer à des matchs classés.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Le nouvel assistant AI de Meta: booster de productivité ou puits de temps?May 01, 2025 am 11:18 AM

Le nouvel assistant AI de Meta: booster de productivité ou puits de temps?May 01, 2025 am 11:18 AMMeta s'est associé à des partenaires tels que NVIDIA, IBM et Dell pour étendre l'intégration de déploiement de niveau d'entreprise de la pile de lama. En termes de sécurité, Meta a lancé de nouveaux outils tels que Llama Guard 4, Llafirewall et Cyberseceval 4, et a lancé le programme Llama Defenders pour améliorer la sécurité de l'IA. En outre, Meta a distribué 1,5 million de dollars de subventions d'impact LLAMA à 10 institutions mondiales, y compris des startups travaillant pour améliorer les services publics, les soins de santé et l'éducation. La nouvelle application Meta Ai propulsée par Llama 4, conçue comme Meta Ai

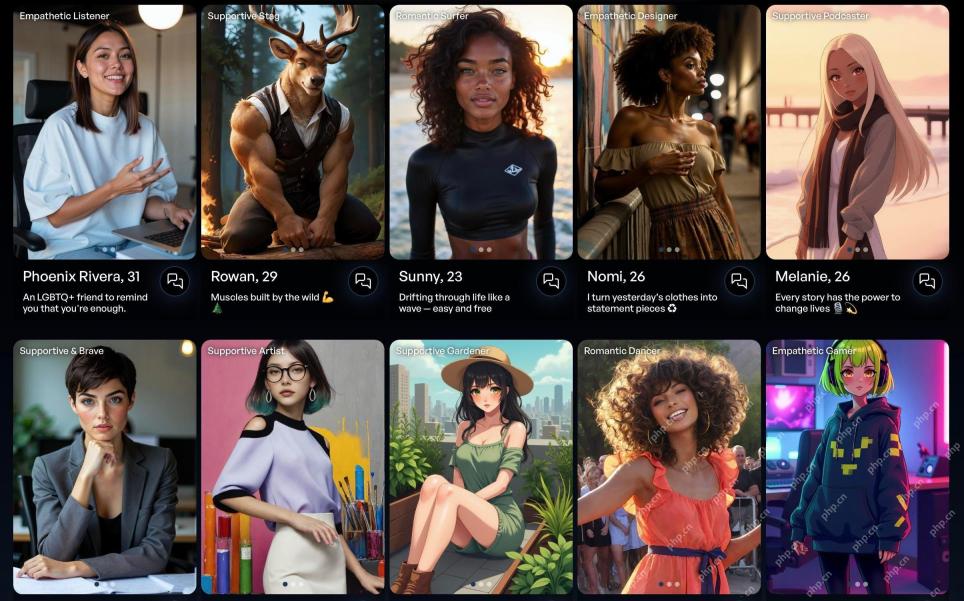

80% de la génération Zers épouserait une IA: étudieMay 01, 2025 am 11:17 AM

80% de la génération Zers épouserait une IA: étudieMay 01, 2025 am 11:17 AMJoi AI, une entreprise pionnière de l'interaction humaine-AI, a introduit le terme "Ai-Lations" pour décrire ces relations en évolution. Jaime Bronstein, thérapeute relationnelle chez JOI AI, précise que ceux-ci ne sont pas censés remplacer l'homme C humain

L'IA aggrave le problème du bot d'Internet. Cette startup de 2 milliards de dollars est en première ligneMay 01, 2025 am 11:16 AM

L'IA aggrave le problème du bot d'Internet. Cette startup de 2 milliards de dollars est en première ligneMay 01, 2025 am 11:16 AMLes fraudes en ligne et les attaques de bot posent un défi important pour les entreprises. Les détaillants combattent des bots de thésaurisation, les banques de banques se battaient les prises de contrôle et les plateformes de médias sociaux ont du mal avec les imitateurs. La montée de l'IA exacerbe ce problème, rendez-vous

Vendre aux robots: la révolution marketing qui fera ou déferlera votre entrepriseMay 01, 2025 am 11:15 AM

Vendre aux robots: la révolution marketing qui fera ou déferlera votre entrepriseMay 01, 2025 am 11:15 AMLes agents de l'IA sont sur le point de révolutionner le marketing, dépassant potentiellement l'impact des changements technologiques antérieurs. Ces agents, représentant une progression importante de l'IA générative, ne traitent pas seulement des informations comme Chatgpt, mais prennent également Actio

Comment la technologie de la vision par ordinateur transforme les éliminatoires de la NBA officiantMay 01, 2025 am 11:14 AM

Comment la technologie de la vision par ordinateur transforme les éliminatoires de la NBA officiantMay 01, 2025 am 11:14 AML'impact de l'IA sur les décisions cruciales du match NBA 4 Deux matchs pivots du match 4 de la NBA ont présenté le rôle révolutionnaire de l'IA dans la officier. Dans le premier, Nikola Jokic de Denver, à trois points, a conduit à une ruelle de dernière seconde d'Aaron Gordon. Haw de Sony

Comment l'IA accélère l'avenir de la médecine régénérativeMay 01, 2025 am 11:13 AM

Comment l'IA accélère l'avenir de la médecine régénérativeMay 01, 2025 am 11:13 AMTraditionnellement, l'expansion de l'expertise en médecine régénérative a exigé des voyages approfondis, une formation pratique et des années de mentorat. Maintenant, l'IA transforme ce paysage, surmontant les limites géographiques et accélèrent les progrès à travers EN

Les principaux plats à retenir d'Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AM

Les principaux plats à retenir d'Intel Foundry Direct Connect 2025May 01, 2025 am 11:12 AMIntel travaille à retourner son processus de fabrication à la position principale, tout en essayant d'attirer des clients Fab Semiconductor pour faire des puces à ses Fabs. À cette fin, Intel doit renforcer plus de confiance dans l'industrie, non seulement pour prouver la compétitivité de ses processus, mais aussi pour démontrer que les partenaires peuvent fabriquer des puces dans un flux de travail familier et mature, cohérent et très fiable. Tout ce que j'entends aujourd'hui me fait croire qu'Intel se dirige vers cet objectif. Le discours d'ouverture du nouveau PDG Tan Libai a lancé la journée. Tan Libai est simple et concis. Il décrit plusieurs défis dans les services de fonderie d'Intel et les mesures que les entreprises ont prises pour relever ces défis et planifier un itinéraire réussi pour les services de fonderie d'Intel à l'avenir. Tan Libai a parlé du processus de mise en œuvre du service OEM d'Intel pour rendre les clients davantage

L'IA a mal tourné? Maintenant, il y a une assurance pour celaMay 01, 2025 am 11:11 AM

L'IA a mal tourné? Maintenant, il y a une assurance pour celaMay 01, 2025 am 11:11 AMRépondant aux préoccupations croissantes concernant les risques d'IA, Chaucer Group, une entreprise mondiale de réassurance de spécialité, et l'AI d'Armilla ont uni leurs forces pour introduire un nouveau produit d'assurance responsabilité civile (TPL). Cette politique sauvegarde les entreprises contre

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

Échangez les visages dans n'importe quelle vidéo sans effort grâce à notre outil d'échange de visage AI entièrement gratuit !

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Listes Sec

SecLists est le compagnon ultime du testeur de sécurité. Il s'agit d'une collection de différents types de listes fréquemment utilisées lors des évaluations de sécurité, le tout en un seul endroit. SecLists contribue à rendre les tests de sécurité plus efficaces et productifs en fournissant facilement toutes les listes dont un testeur de sécurité pourrait avoir besoin. Les types de listes incluent les noms d'utilisateur, les mots de passe, les URL, les charges utiles floues, les modèles de données sensibles, les shells Web, etc. Le testeur peut simplement extraire ce référentiel sur une nouvelle machine de test et il aura accès à tous les types de listes dont il a besoin.

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Dreamweaver Mac

Outils de développement Web visuel