Maison >Périphériques technologiques >IA >L'orientation de Google en matière d'IA change radicalement. Les nouvelles recherches seront fermées, laissant OpenAI sans rien à voir.

L'orientation de Google en matière d'IA change radicalement. Les nouvelles recherches seront fermées, laissant OpenAI sans rien à voir.

- PHPzavant

- 2023-05-09 15:55:091525parcourir

Comme nous le savons tous, Google est comme la « Whampoa Military Academy » dans le domaine de l'intelligence artificielle. Depuis l'essor du deep learning, elle a formé toute une génération de chercheurs et d'ingénieurs en apprentissage automatique. Depuis longtemps, Google est synonyme de technologie d’IA de pointe.

Les gens se sont habitués à suivre les traces de Google et à utiliser les nouvelles technologies et outils qu'il propose comme base de recherche. Google a également produit un grand nombre de talents et est devenu l'épine dorsale de diverses institutions et entreprises de recherche. Cependant, récemment, sous l’impact de ChatGPT, Google a décidé de ne pas le faire.

Selon le Washington Post, en février, Jeff Dean, chef de longue date de l'IA chez Google, a annoncé un changement de politique choquant à l'égard de ses employés : Google devrait retarder le partage des résultats de son travail avec le monde extérieur.

Pendant des années, l'IA de Google dirigée par Jeff Dean, à l'instar des départements d'informatique des universités, a encouragé les chercheurs à publier un grand nombre d'articles académiques. Selon le site Google Research, ils ont lancé près de 500 études depuis 2019.

Mais à la fin de l’année dernière, le révolutionnaire ChatGPT d’OpenAI a changé le statu quo de l’ensemble du domaine technologique. La startup soutenue par Microsoft produit des articles soumis par Google AI pour suivre le rythme de Google, a déclaré Jeff Dean lors de la réunion trimestrielle de la branche recherche de l'entreprise. De telles « accusations » ne sont pas surprenantes. En fait, le transformateur T dans ChatGPT, un fondement important des grands modèles de langage, est une recherche réalisée en 2017 par Google.

Transformer est une direction de recherche générale dans le domaine du traitement du langage naturel (NLP) depuis sa proposition et est à l'origine de la vague actuelle de percées dans le domaine de l'IA. Mais Google estime que cela doit changer et stipulera que ses découvertes en matière d'intelligence artificielle ne pourront être partagées dans des documents qu'après que les travaux de laboratoire auront été transformés en produits, selon deux personnes proches du dossier.

Les nouveaux changements de politique font partie d'un changement plus large au sein de Google. Le géant de la technologie a longtemps été considéré comme un leader en matière d’IA, mais il est désormais obligé de rattraper son retard – en repoussant un essaim de rivaux agiles en matière d’IA, en protégeant son activité principale de recherche, le cours de ses actions, et potentiellement son avenir.

Dans des articles d'opinion, des podcasts et des apparitions télévisées, le PDG de Google, Sundar Pichai, a insisté sur la nécessité de faire preuve de prudence à l'égard de l'intelligence artificielle. « Sur le plan social, cela pourrait faire beaucoup de mal », prévenait-il dans « 60 Minutes » en avril, décrivant comment l’IA générative pourrait accélérer la création de fausses images et vidéos.

Mais contrairement à ce que les dirigeants ont révélé, ces derniers mois, selon des entretiens avec 11 employés actuels et anciens de Google, Google a remanié son activité d'IA dans le but de lancer des produits rapidement.

Il abaisse la barre pour le déploiement d'outils expérimentaux d'IA auprès des groupes minoritaires, établissant un nouvel ensemble de mesures d'évaluation et de priorités dans des domaines tels que l'équité. Pichai a déclaré dans un communiqué que Google avait également fusionné DeepMind et Google Brain pour "accélérer les progrès de l'intelligence artificielle". La nouvelle unité ne sera pas dirigée par Jeff Dean, mais par Hassabis, le PDG de DeepMind, que certains considèrent comme une marque plus fraîche et plus dynamique.

Lors d'une conférence plus tôt la semaine dernière, Hassabis a déclaré que l'intelligence artificielle pourrait être plus proche de l'intelligence humaine que ne le prédisent la plupart des autres experts en intelligence artificielle : « Nous ne serons peut-être qu'à quelques années d'ici, peut-être... Nous y parviendrons dans dix ans. ans"

Alors que Google accélère, diverses voix, y compris des entreprises de premier plan, des chercheurs et des vétérans de l'industrie, appellent les développeurs d'IA à ralentir et mettent en garde contre la technologie. La vitesse de développement a été trop rapide.

Geoffrey Hinton est l'un des pionniers de la technologie de l'IA. Il a rejoint Google en 2013 et a récemment annoncé qu'il quittait l'entreprise. Hinton a récemment mis en garde dans les médias contre les dangers d’une intelligence artificielle générale échappant au contrôle humain. Pichai et les PDG d'OpenAI et de Microsoft ont également rencontré jeudi des responsables de la Maison Blanche, et les régulateurs du monde entier discutent de la manière d'élaborer de nouvelles règles autour de la technologie.

La semaine dernière, le pionnier de l'intelligence artificielle Geoffrey Hinton a démissionné de son poste de vice-président chez Google, invoquant des inquiétudes quant aux progrès rapides de la technologie qui entraîneraient des pertes d'emplois massives et la prolifération de la désinformation.

Nouvelles mitigées : certains soutiennent, certains démissionnent par frustration

Pour les employés de Google, exiger une approbation supplémentaire avant de publier une recherche pertinente sur l'IA signifie risquer d'être « sauté » par d'autres dans le monde en évolution rapide de l'IA générative. De telles politiques pourraient également être utilisées pour supprimer discrètement des articles controversés, comme une étude de 2020 sur les dangers des grands modèles linguistiques co-écrite par Timnit Gebru et Margaret Mitchell, responsables de l’équipe Ethical AI de Google.

Une chose que je dois admettre est que Google a perdu de nombreux chercheurs de premier plan en IA en 2022 et s'est tourné vers des startups considérées comme plus avant-gardistes. Une partie de cette fuite des cerveaux vient de la frustration que Google ne prend pas de décisions intelligentes, comme ne pas intégrer de chatbots dans la recherche.

Un ancien chercheur de Google affirme que l'obtention de l'approbation de la publication d'un article peut nécessiter des examens rigoureux avec les cadres supérieurs. De nombreux scientifiques viennent chez Google avec la promesse de pouvoir mener des recherches plus larges dans leur domaine, mais abandonnent ensuite en raison des restrictions imposées à la publication de leurs recherches.

Cependant, lors de la diffusion en direct de la réunion trimestrielle, la déclaration de Jeff Dean a également reçu des réponses positives de la part de certains employés. Ils ont exprimé leur optimisme quant au fait que ce changement aiderait Google à retrouver son avantage. Pour certains chercheurs, c’est la première fois qu’ils entendent parler de restrictions sur la publication de recherches.

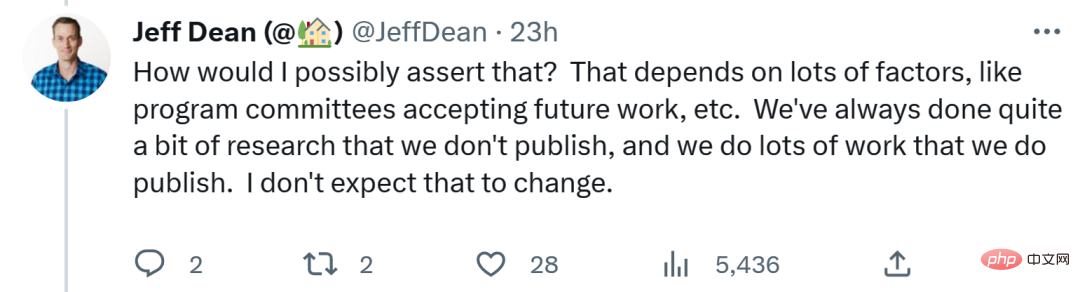

Dernière réponse de Jeff Dean : Nous n'avons pas cessé de partager des recherches

Cependant, en réponse à ce rapport du Washington Post, Jeff Dean a présenté des faits pour réfuter leurs opinions. Il a déclaré que plus de 100 articles collaborés par les chercheurs de Google ont été publiés lors de la conférence ICLR 2023 la semaine dernière et qu'ils ont servi de conférencier dans un grand nombre d'organisations de conférences et d'ateliers.

Et les collègues de DeepMind ont également publié de nombreux articles et discours lors de la conférence ICLR 2023.

Cependant, certaines personnes ont interrogé Jeff, pensant que ces plus de 100 articles sont un indicateur retardé, et ont demandé à Jeff s'il pouvait affirmer que les futurs échanges de recherche entre Google et DeepMind seront aussi forts que dans le passé? Par exemple, Hassabis a déclaré publiquement que DeepMind ne partagerait pas grand-chose à l'avenir.

Jeff Dean a répondu que c'est quelque chose qui ne devrait jamais être affirmé. La publication de nouvelles recherches dépend de nombreux facteurs, tout comme l'acceptation des articles par les conférences. Nous avons beaucoup de travaux qui ne seront pas publiés et beaucoup de travaux qui sont publiés. Je ne pense pas que la situation va changer.

Le récit de Stanford NLP rétorque qu'il semblerait que certains doctorants effectuant des stages d'été ne soient plus en mesure de publier des articles.

Certaines personnes pensent qu'il serait plus convaincant si Jeff Dean pouvait directement nier les opinions rapportées par le Washington Post.

Enfin, comme l'a dit un internaute : "Ce dont vous devez vous soucier à l'avenir, ce n'est pas de publier des journaux. Ils continueront certainement d'exister avec leur forte influence. Ce dont vous devez vous soucier davantage, c'est les codes et modèles de publication, et récemment les articles à fort impact, semblent être en déclin ces dernières années."

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI