Maison >Périphériques technologiques >IA >Utilisez l'IA pour combattre les guerriers du clavier et les trolls d'Internet, et protégez la vie de ceux qui sont victimes d'intimidation en ligne.

Utilisez l'IA pour combattre les guerriers du clavier et les trolls d'Internet, et protégez la vie de ceux qui sont victimes d'intimidation en ligne.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-05-06 16:55:091212parcourir

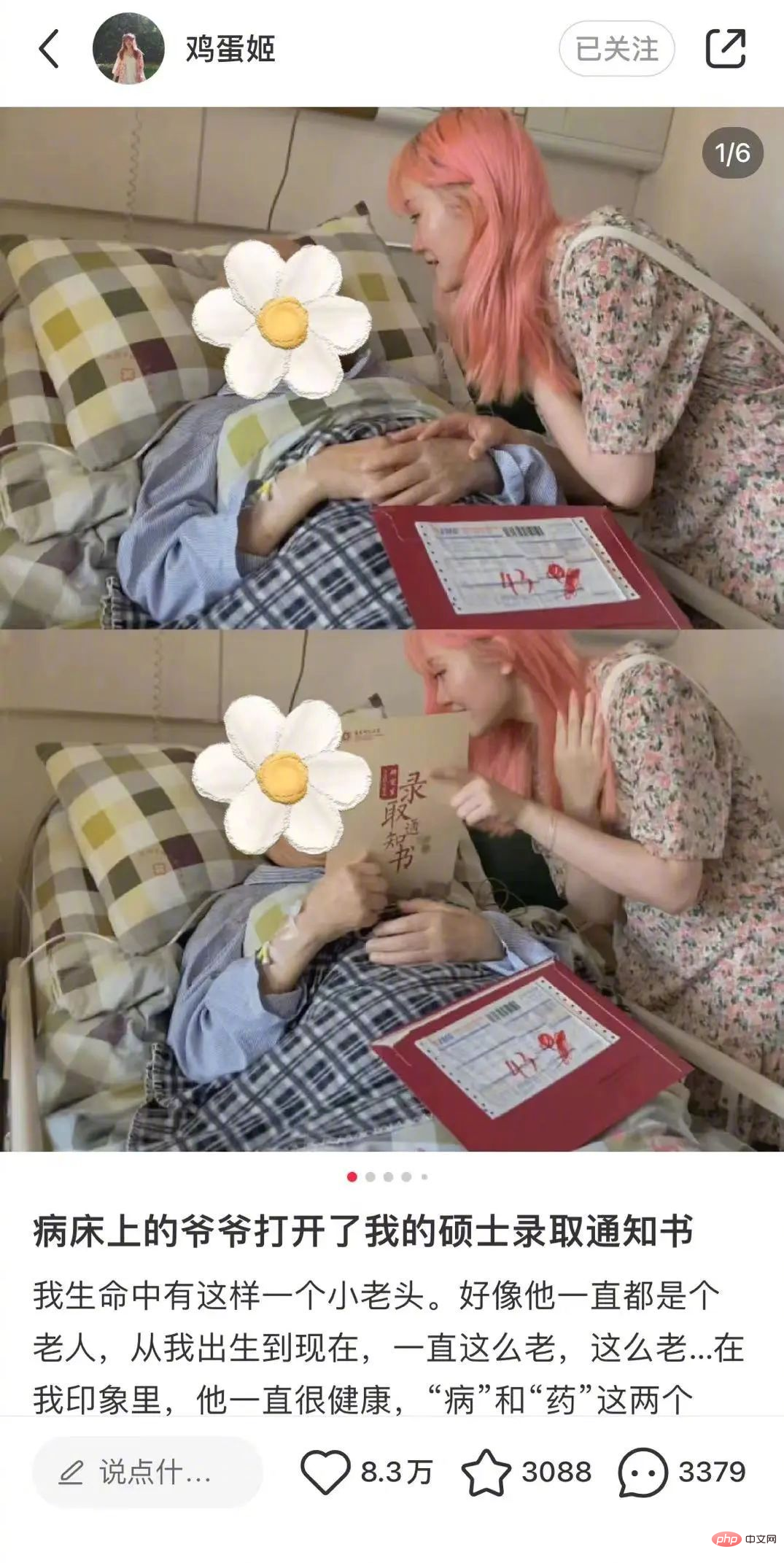

Une fille née en 1995 s'est suicidée parce qu'elle avait publié un tel article de blog en ligne.

Après la publication de ce tendre article de blog, le protagoniste Zheng Linghua a rencontré Beaucoup de rumeurs et d'insultes.

Certaines personnes ont remis en question son identité et ont répandu des rumeurs selon lesquelles elle était une « barmaid » simplement parce que ses cheveux étaient roses ; "amante", "Qialiu" et "menteuse" ont répandu des rumeurs selon lesquelles elle profitait de la maladie de son grand-père pour gagner de l'argent.

C'est tellement inesthétique. Bien que de nombreux médias aient réfuté les rumeurs, Zheng Linghua n'a pas reçu d'excuses. Même lorsque Zheng Linghua a utilisé les armes légales pour défendre ses droits, elle a quand même été harcelée.

Finalement, Zheng Linghua a souffert de dépression et a mis fin à ses jours il n'y a pas si longtemps.

De telles choses se sont produites à plusieurs reprises sur Internet. Ce genre de « mots terribles » qui imprègnent le monde en ligne rend non seulement les gens dégoûtants, mais peut même leur voler la vie. attention. Ce type de comportement a également un terme spécial : la cyber-violence, ou « cyber-violence » en abrégé.

Alors aujourd’hui, alors que l’IA peut déjà communiquer couramment avec les humains, l’IA peut-elle jouer un rôle dans l’identification des cyber-atrocités ?

Surmontant deux difficultés majeures, le taux d'exactitude de l'identification des commentaires violents en ligne est supérieur à 90%

Bien que la plupart des plateformes Internet ont déjà lancé des systèmes d'identification de discours spéciaux, mais la plupart de ces systèmes détectent et suppriment uniquement les mots clés, ce qui n'est évidemment pas assez intelligent. Vous pouvez contourner ces restrictions avec un peu d'attention.

En fait, pour identifier avec précision les propos de cyber-violence, deux choses doivent être faites :

- Comment identifier avec précision les cyber violence basée sur le contexte Discours ?

- Comment identifier efficacement les commentaires violents en ligne ?

Le premier point auquel il faut prêter attention est le contenu des propos violents en ligne, car la plupart des lettres et messages sur Internet sont segmentés, souvent dans des conversations, La cyberviolence est progressivement devenue plus grave et a finalement entraîné des conséquences négatives.

Le deuxième point de préoccupation est la vitesse. Après tout, dans l'environnement Internet, il y a trop de données à traiter. Si la détection prend beaucoup de temps, alors. ce système n'aura aucune valeur pratique, ne sera pas adopté. Une équipe de chercheurs britanniques a développé un nouveau modèle d'intelligence artificielle, appelé BiCapsHate, qui surmonte ces deux défis, dont les résultats ont été publiés le 19 janvier dans un article de la revue IEEE Transactions on Computational Social Systems.

Le modèle se compose de cinq couches de réseau neuronal profond, qui part de une entrée Les couches commencent par traiter le texte d'entrée, puis passent à une couche d'intégration pour intégrer le texte dans une représentation numérique, puis la couche BiCaps apprend la représentation du contexte séquentiel et linguistique, la couche dense prépare le modèle pour la classification finale, et enfin la couche de sortie génère les résultats.

La couche BiCaps est le composant le plus important, qui obtient efficacement des informations contextuelles dans différentes directions avant et après le texte saisi via des réseaux de capsules. Rendez votre modèle encore plus informatif grâce à une multitude de fonctions auxiliaires superficielles et approfondies réglées à la main (y compris les dictionnaires Hatebase). Les chercheurs ont mené des expériences approfondies sur cinq ensembles de données de référence pour démontrer l'efficacité du modèle BiCapsHate proposé. Les résultats globaux montrent que BiCapsHate surpasse les méthodes de pointe existantes, notamment fBERT, HateBERT et ToxicBERT.

Comme l'a souligné Anwar, le langage peut être ambigu dans certains cas, c'est-à-dire qu'un mot peut être positif dans un contexte et négatif dans un autre. Les modèles précédents n'étaient pas assez bons à cet égard, comme HateBERT, toxicBERT et fBERT. Ces intelligences artificielles peuvent capturer le contexte dans une certaine mesure, mais Tariq Anwar estime qu'« elles ne sont toujours pas assez bonnes ».

Un autre avantage de BiCapsHate est la capacité du modèle à effectuer des calculs en utilisant des ressources matérielles limitées. "[D'autres modèles] nécessitent des ressources matérielles haut de gamme telles que des GPU et des systèmes informatiques haut de gamme", a expliqué Tariq Anwar. "En revanche, BiCapsHate... peut être exécuté sur une machine à processeur, même si vous ne disposez que de 8 Go de mémoire." a été développé et testé uniquement pour analyser la parole en anglais, il devra donc être adapté à d'autres langues. Il est également moins efficace pour repérer les mots offensants avec un ton haineux léger ou subtil que les discours de haine plus intenses.

Les chercheurs espèrent ensuite explorer les moyens d'évaluer la santé mentale des utilisateurs qui expriment de la haine en ligne. Si l’on craint que la personne soit mentalement instable et puisse être physiquement violente envers des personnes dans le monde réel, une intervention précoce peut être envisagée pour réduire la probabilité que cela se produise.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI